LlamaIndex:RAG开发首选框架实践教程

·

LlamaIndex:RAG开发首选框架,GitHub 28k⭐的AI数据连接神器!

当大模型遇到私有数据,如何让AI"读懂"你的知识库?答案就在LlamaIndex…

🤔 问题来了:大模型很聪明,但不知道你的事

场景对话

你:ChatGPT,我需要做一个用户画像分析

ChatGPT:好的,请提供用户数据...

你:我的数据在公司服务器上,能联网查看

ChatGPT:抱歉,我无法访问外部数据...

你:那我把数据发给你

ChatGPT:❌ 上传功能不可用

你:那怎么办???

ChatGPT:🤷 你可以试试RAG...

这就是 RAG(检索增强生成) 的用武之地!

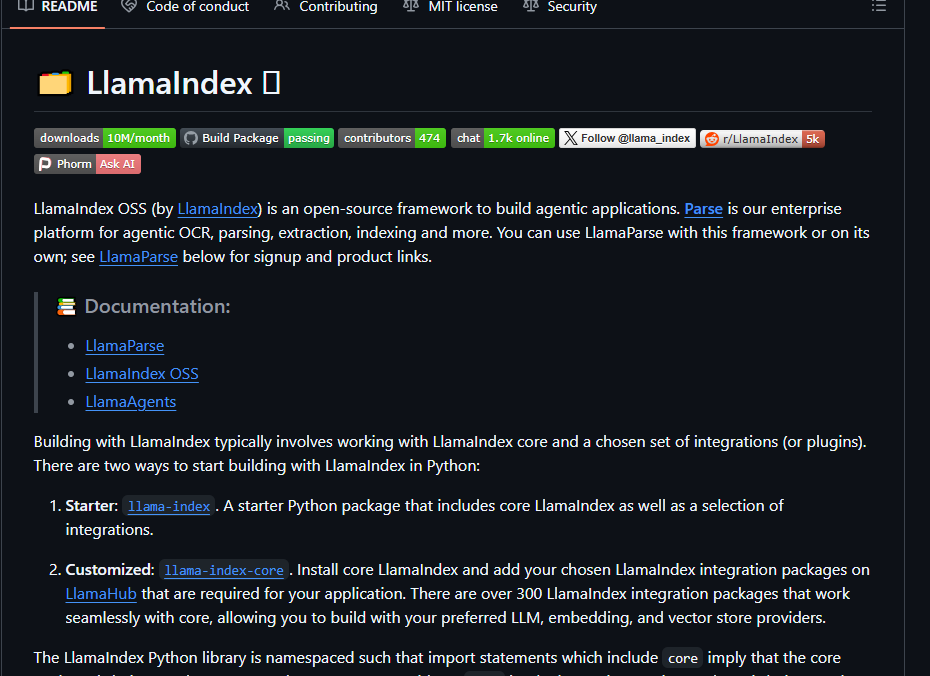

📚 LlamaIndex是什么?

LlamaIndex(原名GPT Index)是一个专门用于构建 LLM应用的数据连接框架。它让大模型能够"读取"你的私有数据,实现真正个性化的AI应用。

核心能力

你的数据源 LlamaIndex处理 LLM理解

┌─────────────┐ ┌─────────────────┐ ┌─────────────┐

│ PDF文档 │ ──────────→ │ 文档解析 │ ────────→ │ GPT-4 │

│ 网页内容 │ │ 语义分块 │ │ Claude │

│ 数据库 │ │ 向量化存储 │ │ Llama本地模型│

│ API数据 │ │ 智能检索 │ │ │

│ Notion笔记 │ │ 上下文注入 │ │ │

└─────────────┘ └─────────────────┘ └─────────────┘

项目数据

| 指标 | 数据 |

|---|---|

| GitHub Stars | 28k+ |

| GitHub Forks | 4k+ |

| 下载量 | 500万+ / 月 |

| 贡献者 | 500+ |

| 文档完善度 | ⭐⭐⭐⭐⭐ |

| 维护活跃度 | 非常活跃 |

🚀 5分钟快速上手

安装

# 基础安装

pip install llama-index

# 可选依赖(根据数据源选择)

pip install llama-index-readers-file # 本地文件

pip install llama-index-readers-notion # Notion

pip install llama-index-readers-web # 网页

pip install llama-index-readers-slack # Slack

pip install llama-index-readers-discord # Discord

最简示例:读取本地文档问答

from llama_index.core import VectorStoreIndex, SimpleDirectoryReader

# 1. 加载文档(支持 PDF, TXT, Markdown, Word...)

documents = SimpleDirectoryReader("./data").load_data()

# 2. 构建索引

index = VectorStoreIndex.from_documents(documents)

# 3. 创建查询引擎

query_engine = index.as_query_engine()

# 4. 问答!

response = query_engine.query("这份文档的主要观点是什么?")

print(response)

就这样!4行代码,一个本地文档问答机器人就完成了!

🏗️ 核心概念详解

1. 数据连接器(Data Connectors)

LlamaIndex支持 100+ 数据源:

# Notion

from llama_index.readers.notion import NotionReader

notion_reader = NotionReader("notion-token")

documents = notion_reader.load_data("database-id")

# 网页

from llama_index.readers.web import SimpleWebPageReader

web_reader = SimpleWebPageReader()

documents = web_reader.load_data(["https://example.com/article"])

# Slack

from llama_index.readers.slack import SlackReader

slack_reader = SlackReader("slack-token")

documents = slack_reader.load_data(["channel-id"])

# 自定义数据源

from llama_index.core import Document

custom_doc = Document(text="你的内容", metadata={"source": "custom"})

2. 索引类型(Index Types)

from llama_index.core import VectorStoreIndex, SummaryIndex, KnowledgeGraphIndex

# 向量索引 - 最常用,适合语义搜索

vector_index = VectorStoreIndex.from_documents(documents)

# 摘要索引 - 适合需要整体理解的任务

summary_index = SummaryIndex.from_documents(documents)

# 知识图谱索引 - 保留实体关系

kg_index = KnowledgeGraphIndex.from_documents(

documents,

max_triplets_per_chunk=10

)

3. 查询引擎(Query Engines)

# 基础查询

query_engine = index.as_query_engine()

# 带重新排序的查询(更精准)

from llama_index.core import QueryBundle

from llama_index.postprocessor.cohere_rerank import CohereRerank

query_engine = index.as_query_engine(

similarity_top_k=10, # 先检索10个

node_postprocessors=[

CohereRerank(top_n=3) # 再精排到3个

]

)

# 对话式查询(支持多轮对话)

chat_engine = index.as_chat_engine()

response = chat_engine.chat("你觉得这个方案怎么样?")

response = chat_engine.chat("那如果加上缓存呢?")

📊 实战案例:从零构建RAG应用

场景:企业知识库问答系统

项目结构

enterprise-rag/

├── app.py # 主应用

├── requirements.txt # 依赖

├── data/ # 知识库文档

│ ├── 公司介绍.pdf

│ ├── 产品手册.md

│ └── 规章制度.docx

└── config.py # 配置文件

完整代码

# app.py

from llama_index.core import VectorStoreIndex, SimpleDirectoryReader

from llama_index.llms.openai import OpenAI

from llama_index.core import Settings

import chainlit as cl

# 配置LLM

Settings.llm = OpenAI(model="gpt-4", temperature=0)

# 加载并索引知识库

documents = SimpleDirectoryReader("./data").load_data()

index = VectorStoreIndex.from_documents(documents)

# 创建聊天引擎

chat_engine = index.as_chat_engine(

system_prompt="""

你是一个企业知识库助手,只能根据提供的文档回答问题。

如果文档中没有相关信息,请明确告知用户。

回答要专业、简洁、有条理。

"""

)

@cl.on_message

async def main(message: cl.Message):

response = await cl.make_async(chat_engine.chat)(message.content)

await cl.Message(content=str(response)).send()

启动命令

pip install chainlit

chainlit run app.py

# 访问 http://localhost:8000 即可使用!

💡 进阶技巧

技巧1:智能文档分块

from llama_index.core.node_parser import SentenceSplitter

# 按句子分块,保留重叠

node_parser = SentenceSplitter(

chunk_size=512, # 每块512字符

chunk_overlap=50, # 50字符重叠,保证上下文连贯

separator=" " # 按空格分割

)

# 自定义分块策略

from llama_index.core.node_parser import MarkdownElementNodeParser

node_parser = MarkdownElementNodeParser(

hdr_tag_separator=True, # 保留Markdown标题结构

flatten=False

)

技巧2:混合搜索

from llama_index.core.query_engine import RetrieverQueryEngine

from llama_index.core.retrievers import QueryFusionRetriever

# 融合关键词搜索和向量搜索

retriever = QueryFusionRetriever([

vector_index.as_retriever(similarity_top_k=5), # 语义相似

keyword_index.as_retriever(similarity_top_k=5), # 关键词精确

], mode="reciprocal_rank") # 综合排名

技巧3:查询改写

from llama_index.core.prompts import PromptTemplate

# 让LLM先改写查询,再检索

query_engine = index.as_query_engine(

text_qa_template=PromptTemplate(

"""请先根据用户问题,从以下文档中找出最相关的信息。

问题:{query_str}

文档内容:

{context_str}

回答:"""

)

)

技巧4:流式输出

# 启用流式响应,体验更好

chat_engine = index.as_chat_engine(

streaming=True,

system_prompt="你是一个技术文档助手"

)

# 流式输出

response = chat_engine.stream_chat("如何部署Docker应用?")

for token in response.response_gen:

print(token, end="", flush=True)

🔧 生产环境最佳实践

1. 选择合适的向量数据库

# Milvus(推荐生产使用)

from llama_index.vector_stores.milvus import MilvusVectorStore

vector_store = MilvusVectorStore(

host="localhost",

port="19530",

collection_name="knowledge_base",

dimension=1536

)

# Pinecone(云服务)

from llama_index.vector_stores.pinecone import PineconeVectorStore

vector_store = PineconeVectorStore(

api_key="your-api-key",

index_name="knowledge-base"

)

2. 添加缓存层

from llama_index.core import load_index_from_storage

from llama_index.core.storage import StorageContext

import diskcache

# 本地磁盘缓存

cache = diskcache.Cache("./cache")

# 加载已有索引(避免重复构建)

storage_context = StorageContext.from_defaults(

persist_dir="./storage"

)

index = load_index_from_storage(storage_context)

3. 监控和评估

from llama_index.core.evaluation import QueryResponseEvaluator

# 评估RAG效果

evaluator = QueryResponseEvaluator()

eval_result = await evaluator.aevaluate(

query="用户问题",

response="AI回答",

contexts=["检索到的文档块"]

)

print(f"评估结果: {eval_result.score}")

📊 与竞品对比

| 特性 | LlamaIndex | LangChain | Haystack |

|---|---|---|---|

| 数据源支持 | 100+ | 50+ | 30+ |

| 索引类型 | 7种 | 5种 | 4种 |

| 文档处理 | ⭐⭐⭐⭐⭐ | ⭐⭐⭐ | ⭐⭐⭐⭐ |

| 生产级功能 | ⭐⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ |

| 学习曲线 | 中等 | 陡峭 | 中等 |

| 社区活跃度 | 非常活跃 | 活跃 | 一般 |

🎯 适用场景

✅ 企业知识库 - 让AI读懂公司文档

✅ 客服机器人 - 基于产品文档自动回答

✅ 代码助手 - 理解你的代码库结构

✅ 数据分析 - 用自然语言查询数据库

✅ 个人笔记搜索 - 用AI总结搜索Notion/Obsidian

🔗 资源链接

- 官网:https://www.llamaindex.ai/

- GitHub:https://github.com/run-llama/llama_index

- 文档:https://docs.llamaindex.ai/

- 示例库:https://github.com/run-llama/llama_index/tree/main/docs/examples

- Discord社区:https://discord.gg/eG6CkrBnJb

🎁 写在最后

用LlamaIndex做了几个项目后,最大的感受是:它让RAG开发变得如此简单。

以前要搭一个像样的知识库问答系统:

- 需要理解向量化原理

- 需要自己实现检索逻辑

- 需要处理各种边界情况

现在:

- 几行代码搞定基础功能

- 丰富的组件按需组合

- 完善的文档和社区支持

强烈建议每个AI开发者都学一学,无论是做内部工具还是产品原型,LlamaIndex都是效率利器!

🔥 觉得有用?赶紧收藏+转发!

💬 评论区聊聊:你在用LlamaIndex做什么项目?有什么踩坑经验?

👀 下期预告:LangChain vs LlamaIndex,哪个更适合你?

本文首发于公众号,转载请注明出处。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献8条内容

已为社区贡献8条内容

所有评论(0)