ICML 2025论文分享|一种用于智能体的知识库增强与经验复用框架AGENT KB

本推文介绍的是发表于ICML 2025上的一篇论文《AGENT KB: Leveraging Cross-Domain Experience For Agentic Problem Solving》。该论文针对AI Agent领域各自为战、重复造轮子的痛点,提出了首个跨框架通用记忆库AGENT KB。该框架通过异构轨迹抽象和混合检索机制结合,实现了不同Agent框架之间的经验无缝共享。实验结果显示,AGENT KB在无需微调的情况下,让smolagents智能体在GAIA基准上的准确率提升了18.7%,让OpenHands智能体在SWE-bench上的通过率提升了4.0%。这一成果标志着集体智能Agent迈出了关键一步,证明了共享记忆库能有效打破框架孤岛,让Agent通过复用历史经验解决复杂问题。

推文作者为黄星宇,审校为许东舟和邱雪。

论文链接:https://arxiv.org/abs/2507.06229

代码链接:https://github.com/OPPO-PersonalAI/Agent-KB

一、研究背景

随着大模型与智能体技术的发展,基于工具调用与复杂推理的智能体系统在多任务问题求解中表现出越来越强的能力。然而,现有主流智能体框架通常以独立运行为主,内部积累的推理经验与执行轨迹很难在不同框架之间共享与复用。这种现象导致不同智能体在面对相似问题时,仍然需要重复探索解决路径,不仅降低了效率,也限制了系统整体性能的提升。已有研究虽然尝试通过记忆机制或检索增强方法提升单个智能体的能力,但大多局限于单一模型或单一框架内部,缺乏跨架构的知识迁移能力。此外,不同智能体在表示方式、工具环境及推理流程上的差异,使得经验直接迁移面临表示不一致、上下文不匹配以及知识干扰等挑战。

因此,如何构建一种统一的跨框架知识共享机制,使不同智能体能够高效复用历史经验、避免重复错误,并逐步形成可积累的“群体智能”,成为当前智能体研究中的一个重要问题。

二、研究方法

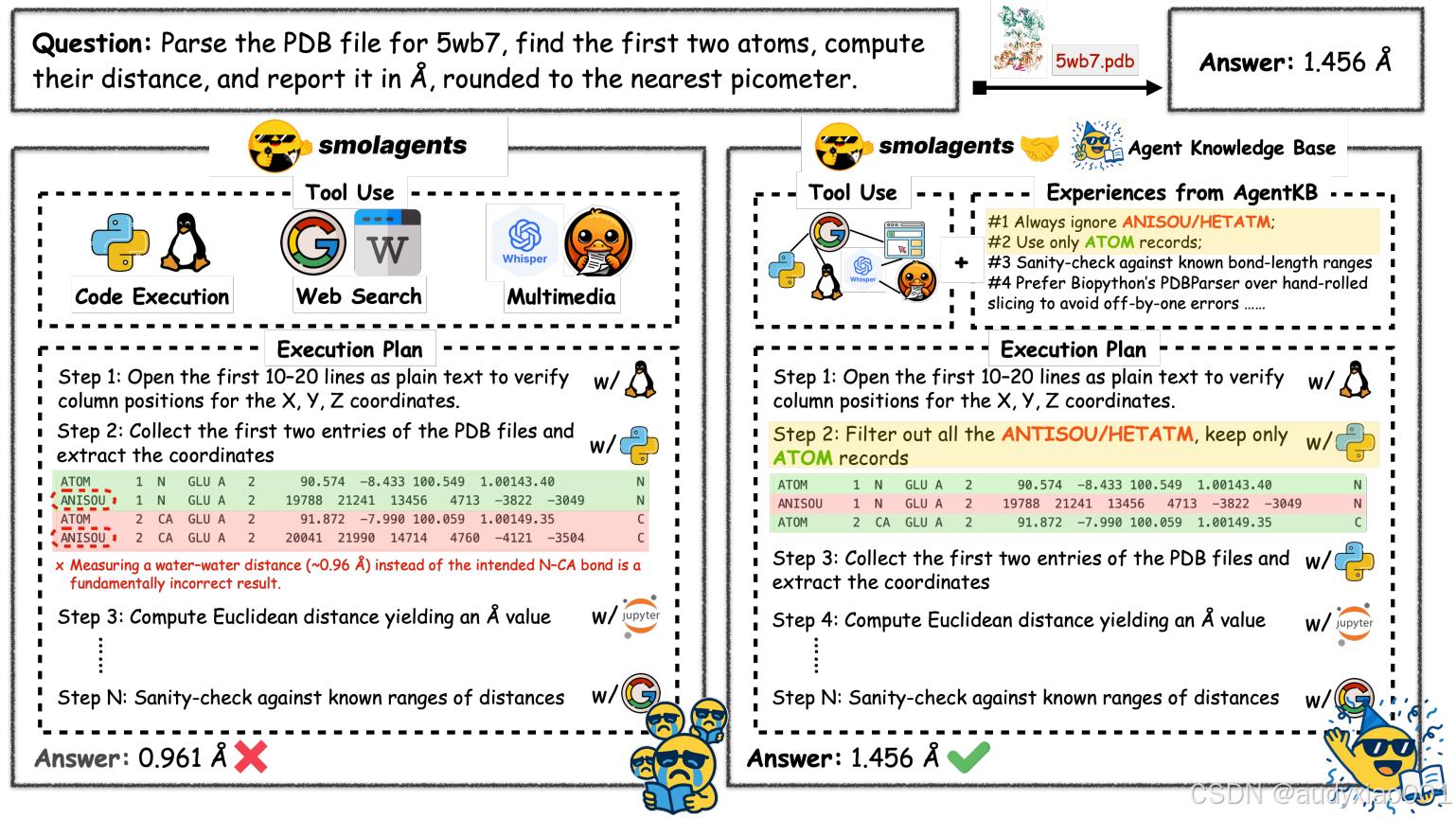

图1 使用AGENT KB与不使用AGENT KB进行PDB距离计算的Agent工作流对比

图1通过解析PDB文件计算原子距离来对比AI Agent在使用和不使用AGENT KB记忆库时的工作流程差异。左边是无AGENT KB的情况,Agent直接读取PDB文件的前几行,把所有记录,包括水分子的ANISOU记录都当作有效原子来计算。结果它算出了一个错误的距离(0.961Å),因为实际上它测量的是水分子之间的距离,而不是题目要求的蛋白质主链N-CA键长。右边是使用AGENT KB的情况,Agent在执行前先从知识库中检索到了关键经验,比如“忽略ANISOU/HETATM记录”、“只用ATOM记录”。最终,它正确地提取了两个目标原子的坐标,并计算出准确的距离(1.456Å)。这个对比清晰地展示了AGENT KB如何通过提供历史经验,帮助Agent避免常见错误,提升解决问题的准确性。

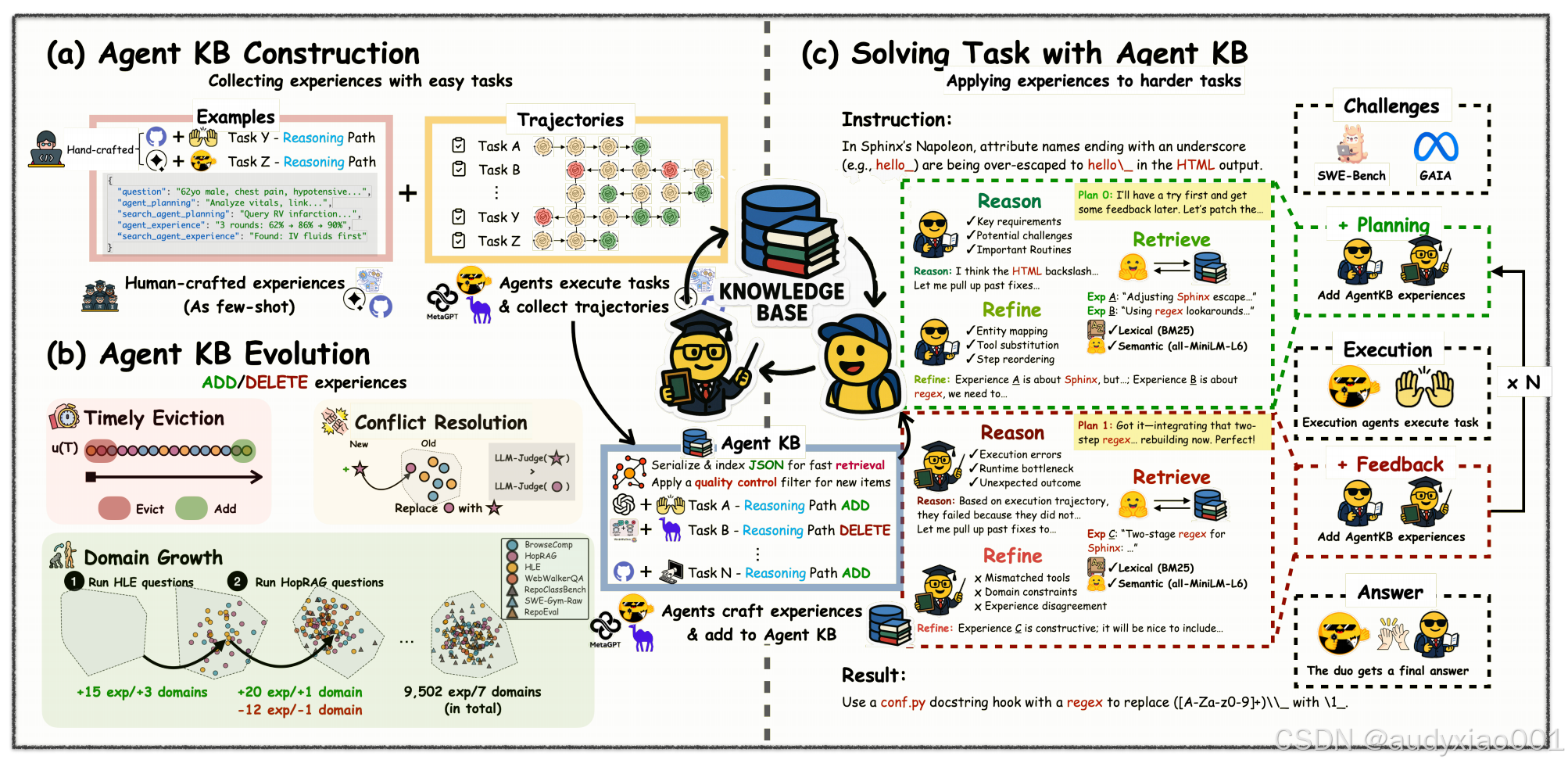

图2 Agent KB端到端工作流

图2完整描绘了AGENT KB从构建、演化到实际应用的端到端工作流程,清晰展现了它如何作为一个动态、可扩展的集体经验库来赋能各类智能体。在左侧的构建与演化部分,系统首先通过两种方式填充初始知识:一是由人类专家提供少量高质量的示范性经验(few-shot examples),这些经验经过结构化处理后成为知识库的“种子”;二是让基础版Agent在一系列简单任务上自主运行,将其成功或失败的执行轨迹(trajectories)自动抽象、提炼为标准化的经验单元,并加入知识库。随着如HLE、HopRAG等更多任务被解决,知识库持续扩充。更重要的是,AGENT KB并非静态存储,它具备自我演化能力,当新经验与已有条目冲突时,系统会调用大模型作为裁判进行判别,保留更优方案。同时,通过及时淘汰(Timely Eviction)机制,定期移除长期未被检索或验证无效的陈旧经验,确保知识库的精炼与高效。

在右侧的任务求解部分,AGENT KB的价值在复杂场景中得以体现。以修复Sphinx文档中的HTML转义错误为例,普通Agent可能因缺乏相关经验而反复试错。而接入AGENT KB的Agent则采用“推理-检索-精炼”(Reason-Retrieve-Refine)循环机制,它首先基于当前任务进行初步规划(Reason),然后向知识库发起检索(Retrieve),找到语义或工具使用上相似的历史经验。接着,Agent会对检索结果进行上下文适配和具体化(Refine),将通用规则转化为针对Sphinx和HTML转义问题的可执行步骤。若执行失败,该过程还会迭代进行,不断修正策略。最终,Agent不仅解决了当前问题,其成功轨迹还可反哺知识库,形成“实践—沉淀—复用—再实践”的良性闭环。整体来看,该图AGENT KB是将分散在不同框架、不同任务中的个体经验,转化为可共享、可演化、可复用的集体智慧,从而显著提升Agent在未知复杂任务上的泛化与解决能力。

三、实验结果

为了全面验证AGENT KB的有效性与泛化能力,论文在多个具有代表性的智能体评测基准上开展了系统性实验。这些基准覆盖了通用推理(GAIA)、软件工程(SWE-bench Lite)、高难度科学问答GPQA等不同领域和任务类型,并在smolagents、OWL、OpenHands等主流Agent框架以及GPT、Claude、Qwen、DeepSeek等多种大模型上进行了测试。实验不仅提升了核心性能,还通过消融研究、超参数分析和跨域迁移等维度,深入剖析了AGENT KB的工作机制与关键设计选择,充分证明了其作为一种通用记忆基础设施的实用价值和广泛适用性。

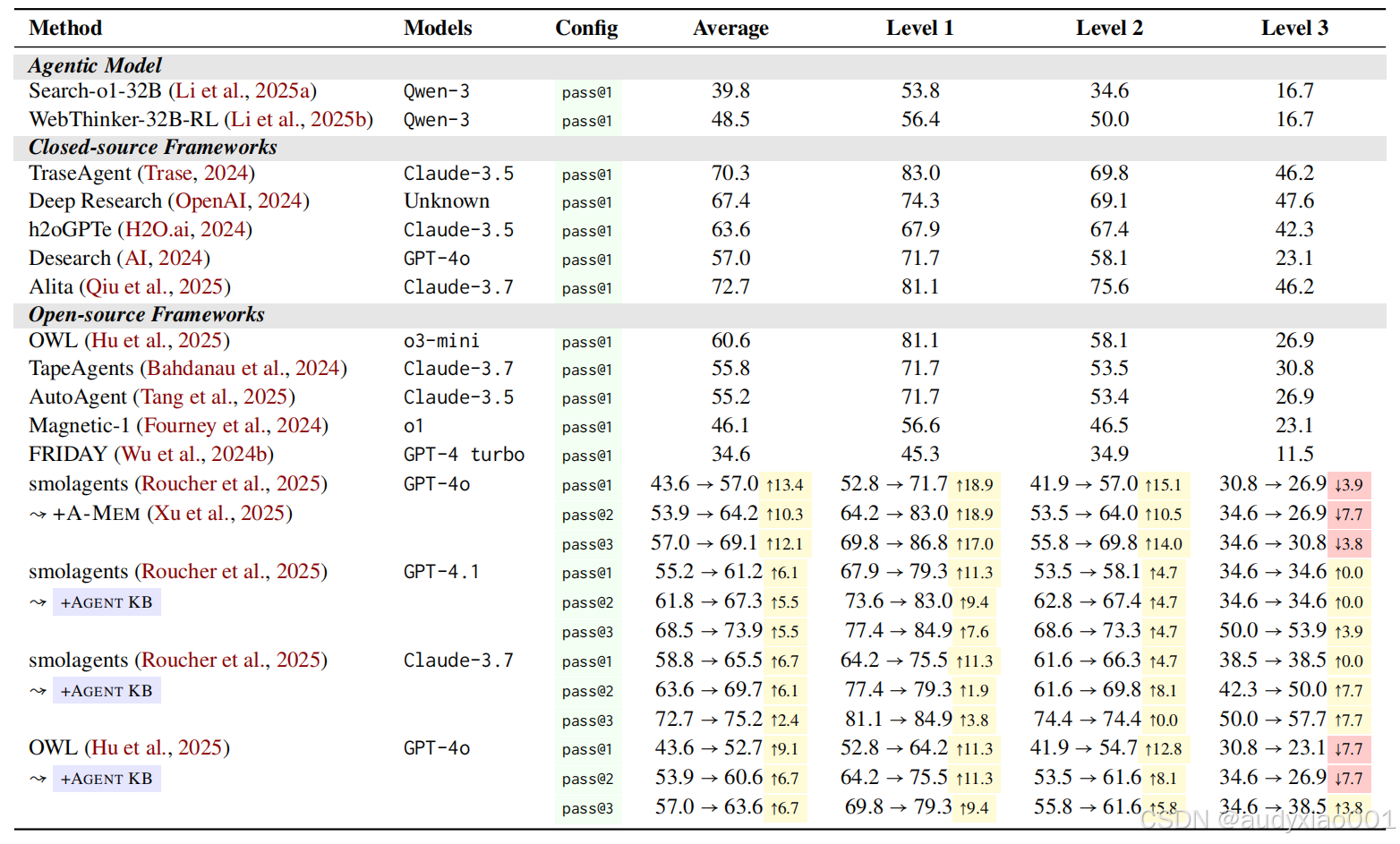

表1 GAIA基准测试结果

表1展示了在GAIA基准上,多种主流Agent框架和模型的性能对比。smolagents框架在加入AGENT KB后表现较好。以GPT-4.1为底座模型时,smolagents的平均准确率从55.2%提升至73.9%,增幅高达18.7个百分点;在更难的Level 2任务中,提升了的19.2个百分点。这一数据清晰地证明了AGENT KB的强大增益效果,它能有效弥补基础模型在复杂推理上的不足。值得注意的是,即使在Level 3这种极高难度的任务上,AGENT KB依然带来了显著提升(+13.9%),这表明其经验复用机制对解决复杂问题具有普遍价值。

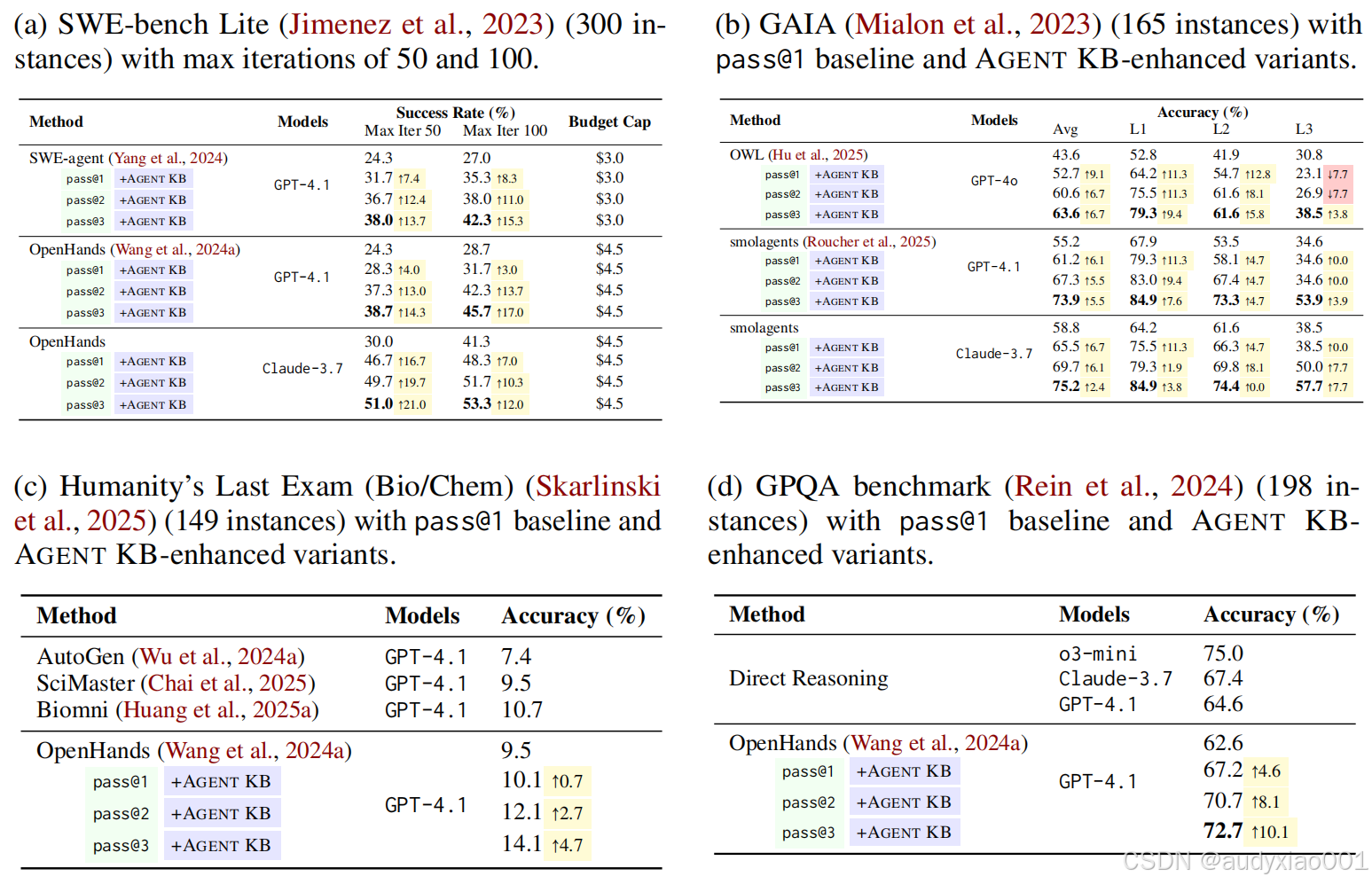

表2 SWE-Bench Lite和GAIA各级别性能对比

表2汇总了AGENT KB在四个不同基准SWE-bench Lite, GAIA, Humanity's Last Exam, GPQA上的全面表现。在SWE-bench Lite上,AGENT KB让OpenHands的成功率从24.3%提升至51.0%(+26.7%),证明了其在代码工程领域的强大能力。在GAIA上,它让OWL和smolagents的准确率分别提升了16.7%和15.5%以上。在极具挑战性的Bio/Chem中,AGENT KB将OpenHands的准确率从9.5%提升至14.1%(+4.6%),虽然绝对值不高,但在如此高难度的领域仍能带来可观提升,意义重大。最后,在GPQA科学问答基准上,AGENT KB使OpenHands的准确率从62.6%跃升至72.7%(+10.1%),再次印证了其在多模态、复杂推理任务中的普适性和有效性。这些数据共同构成了一个强有力的证据链,证明AGENT KB是一种具有广泛适用性的通用增强技术。

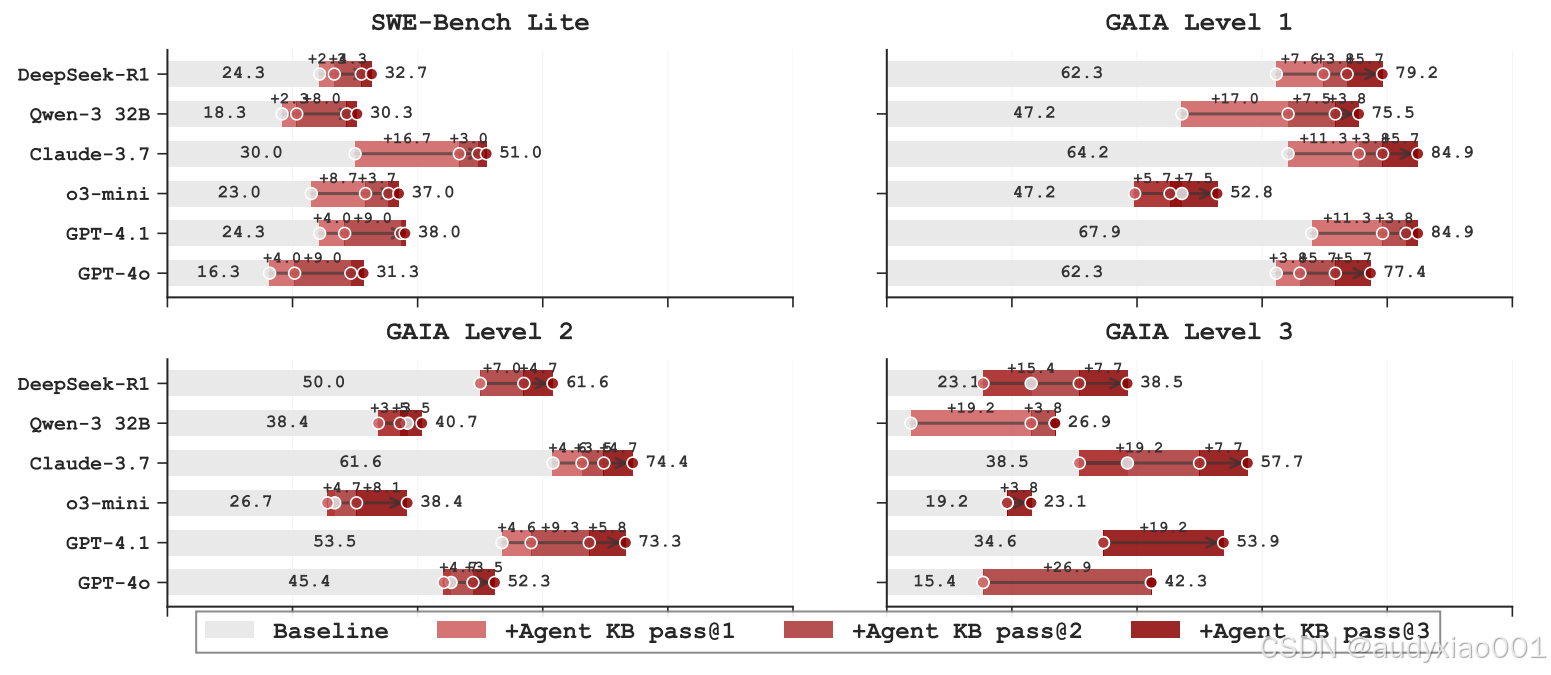

图3 SWE-Bench Lite和GAIA各级别性能对比

图3通过柱状图直观地呈现了AGENT KB在不同任务和模型上的泛化能力。左侧的SWE-Bench Lite显示,无论使用DeepSeek-R1、Qwen-3 32B还是GPT-4o等模型,加入AGENT KB后成功率均有明显提升,最高提升达+16.7个百分点(Claude-3.7)。右侧的GAIA Level 1-3则进一步验证了这一点,在所有模型和所有难度等级下,AGENT KB都能带来正向收益。尤其是在GAIA Level 3(最难级别),对于GPT-4o模型,提升幅度高达+26.9个百分点。这说明AGENT KB不仅能在特定框架上生效,还能跨越不同模型架构,成为一种通用的性能增强工具。

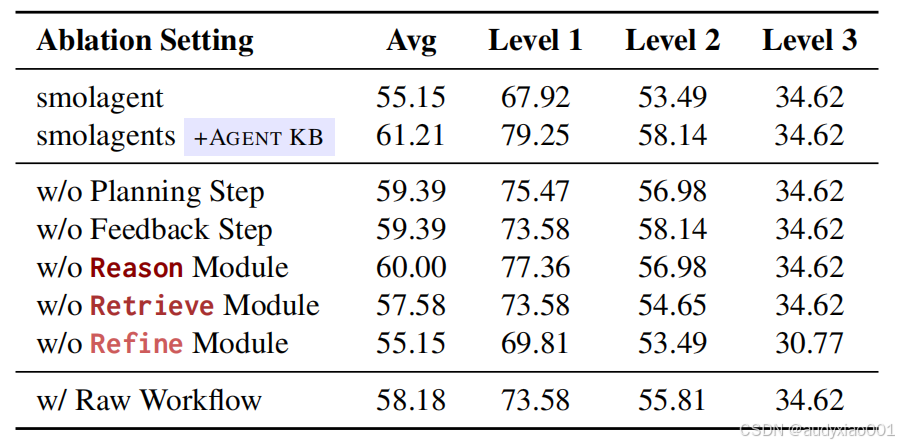

表3 消融实验分析

表3结果显示,移除Refine(提炼)模块会导致性能大幅下降,这说明将检索到的经验转化为当前任务可执行的方案至关重要。移除Retrieve(检索)模块同样导致性能严重下滑,证明了知识库本身的价值。而移除Reason(推理)或Feedback(反馈)步骤的影响相对较小,但依然存在。最值得关注的是,w/ Raw Workflow(直接注入原始轨迹)的性能(58.18)远低于完整流程(61.21),这强有力地证明了AGENT KB的“Reason-Retrieve-Refine”循环设计比简单地堆砌历史日志要有效得多,其核心在于对经验的智能处理与适配。

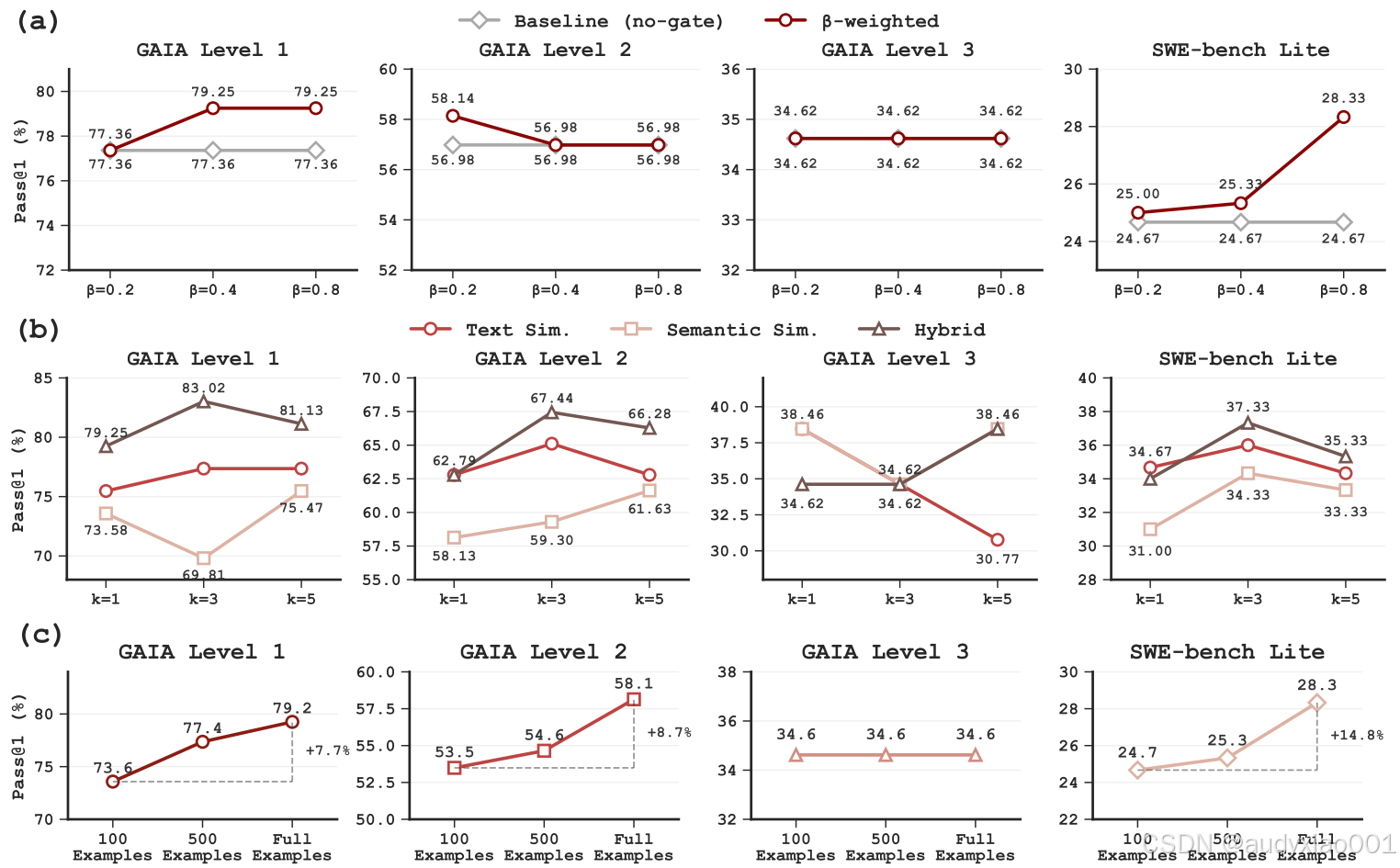

图4 超参数与检索策略分析

图4深入剖析了AGENT KB内部参数和策略的有效性。图(a)显示,引入“β-weighted”门控机制后,性能稳定且优于无门控的基线,特别是在SWE-bench Lite上提升了超过4个百分点,证明了该安全机制能有效防止错误经验干扰。图(b)比较了三种检索方式:纯文本相似度、语义相似度和混合方法。结果表明,混合检索在大多数情况下表现最佳,尤其在GAIA Level 2上取得了最高的Pass@1(67.44%),证实了结合词汇和语义信息的必要性。图(c)则展示了知识库规模的影响,随着训练样本数量从100增加到500再到全部,性能稳步提升,最终在GAIA Level 2上实现了+8.7%的绝对增长,充分说明了AGENT KB是一个能够随经验积累而持续进步的系统。

四、总结

论文提出了一种面向智能体的外部知识增强方法AGENT KB,通过构建可持续积累与检索的知识库,使智能体能够在多步推理与复杂任务中复用历史经验,从而弥补大模型在长期记忆与稳定性方面的不足。该研究在软件工程、通用推理、科学问题等多种基准上进行了系统实验,结果表明该方法在不同模型和任务中均能带来稳定的性能提升,且在高难度任务中增益更为明显,验证了其良好的通用性与扩展性。未来的工作将致力于支持更丰富的模态和更长周期的推理。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)