给想转行 AI 测试的提个醒

这两年,AI 太火了。

火到什么程度?

很多人一边被裁员消息刺激,一边被“AI 岗位高薪”“AI 测试缺人”“不会 AI 就要被淘汰”这样的信息不断轰炸。

于是,越来越多做功能测试、自动化测试、测试开发,甚至做实施、运维、产品的人,都开始冒出一个念头:

我要不要转行做 AI 测试?

这个想法很正常。

一方面,传统测试岗位确实在承压;另一方面,AI 赛道看起来机会很多,仿佛只要贴上“AI”两个字,职业天花板都能往上抬一截。

但今天这篇文章,我想先不讲“风口”,也不讲“前景”,而是想认真地给想转行 AI 测试的人提个醒:

AI 测试不是传统测试换个名字,也不是学几个大模型工具就能顺利上岸。

如果你正准备往这个方向走,希望你先把这几个问题想明白。

一、先泼一盆冷水:AI 测试并不是“更轻松的测试”

很多人对 AI 测试有一种误解,觉得它大概是这样:

-

比传统测试更高级

-

比业务测试更有技术含量

-

比普通自动化更有前景

-

工资更高

-

岗位更新

-

竞争还没那么卷

这些判断不能说全错,但如果你因此以为 AI 测试是一个“更轻松、更体面、学点皮毛就能转过去”的方向,那大概率会失望。

因为 AI 测试真正难的地方,不在“会不会点工具”,而在于:

-

你要理解模型能力边界

-

你要理解数据质量问题

-

你要理解评测方法

-

你要理解提示词、工作流、知识库、Agent 这些系统结构

-

你还要能把“模型表现不好”翻译成可分析、可验证、可优化的问题

传统测试里,很多时候你测的是“功能是否正确”;

但 AI 测试里,你经常面对的是:

结果不稳定、标准不绝对、表现依赖上下文、问题难以复现、评估带有主观性。

这类测试,不是更简单,而是很多时候更抽象、更模糊,也更考验思维能力。

所以第一句提醒就是:

如果你只是因为“AI 热”“怕被淘汰”“听说工资高”,就想仓促转行,那你很可能低估了这个方向的门槛。

二、你以为 AI 测试是在测“软件”,其实很多时候是在测“概率”

传统软件测试,很多场景的判断相对清楚:

-

页面能不能打开

-

接口返回码对不对

-

数据是否入库

-

权限是否生效

-

流程有没有走通

对就是对,错就是错。

但 AI 系统不是这样。

尤其是大模型相关产品,很多时候它不是一个“固定逻辑程序”,而是一个“带概率输出的生成系统”。

同一个问题,在不同时间、不同上下文、不同参数设置下,可能会得到不同答案。

这就意味着,AI 测试的核心挑战之一是:

你不能再只用“传统功能测试”的思路去测 AI。

你会遇到很多新的问题,比如:

-

回答看起来通顺,但事实是错的,怎么算?

-

回答不算错,但不够好,怎么算?

-

模型偶尔答错和经常答错,风险等级一样吗?

-

一轮对话表现正常,多轮对话开始“跑偏”,怎么测?

-

Prompt 一改,效果波动很大,问题算模型的还是产品设计的?

-

RAG 检索命中了,但生成答案还是偏了,该归谁?

你会发现,AI 测试测到最后,很多时候测的不只是“功能”,而是:

-

准确性

-

稳定性

-

一致性

-

幻觉率

-

鲁棒性

-

安全性

-

可控性

-

用户体验

也就是说,AI 测试本质上更像“质量评估 + 风险分析 + 系统理解”的结合体。

如果你还停留在“我会写用例、会提 Bug、会跑回归”这个层面,那是远远不够的。

三、别把“会用 AI 工具”误以为“懂 AI 测试”

这是我特别想提醒的一点。

现在很多人学 AI,第一步就是:

-

用几个大模型产品

-

玩一玩提示词

-

搭一下知识库

-

跑一下工作流平台

-

看几个 Agent 演示视频

然后就觉得自己差不多懂 AI 测试了。

但说实话,会用 AI 产品,和能做 AI 测试,是两回事。

就像你天天用短视频,不代表你会做推荐算法测试;

你天天网购,也不代表你会做电商测试。

AI 测试真正需要的是更偏工程化、分析化的能力,比如:

1. 你能不能拆解 AI 系统的组成

一个 AI 应用,往往不只是“大模型”本身,它可能包含:

-

前端交互层

-

Prompt 模板

-

RAG 检索模块

-

向量库

-

重排模块

-

多轮会话管理

-

工具调用

-

工作流编排

-

审核与兜底逻辑

-

模型路由机制

如果你只盯着最终回答好不好,却看不清系统链路,那很多问题你根本没法测清楚。

2. 你能不能设计评测标准

AI 测试很少有绝对标准答案,所以你要学会建立“相对可执行”的评测框架,比如:

-

什么叫回答正确

-

什么叫回答完整

-

什么叫高风险错误

-

什么叫不可接受的幻觉

-

什么叫用户可感知的体验问题

没有标准,就没有测试;

标准不清,测试结论就很容易变成“靠感觉”。

3. 你能不能把模糊问题结构化

很多 AI 问题非常模糊,例如:

-

“它感觉不太聪明”

-

“有时候答得不稳”

-

“结果偶尔怪怪的”

-

“多聊几轮就不对了”

这时候真正有价值的测试,不是重复一句“模型效果不好”,而是把问题拆成可定位的维度,例如:

-

是检索召回问题

-

是上下文窗口问题

-

是提示词约束不足

-

是温度参数影响输出波动

-

是知识库内容本身不完整

-

是安全策略拦截过强或过弱

这才叫 AI 测试能力。

四、转 AI 测试之前,你最好先问自己三个问题

不是每个测试人都不适合做 AI 测试,但也不是每个人都适合为了风口硬转。

你可以先问自己这三个问题。

1. 我是真的对 AI 系统感兴趣,还是只是对“AI 岗位薪资”感兴趣?

这个问题很现实。

因为 AI 测试不是短期冲刺就能拿下的,它需要你持续学习很多新东西:

-

模型基础概念

-

提示词设计

-

数据集构造

-

评测方法

-

AI 产品交互逻辑

-

知识库问答机制

-

智能体工作流

-

安全对齐与内容风控

如果你对这些东西本身没有兴趣,只是想“换个标签涨工资”,你大概率很难坚持学下去。

AI 测试是一个需要持续更新认知的方向,

不是学一套固定流程就能吃很多年的岗位。

2. 我的基础能力够不够支撑转型?

转行 AI 测试,不等于从零开始,但也绝不是无门槛。

比较有帮助的基础包括:

-

扎实的软件测试思维

-

对业务流程和异常场景敏感

-

一定的自动化能力

-

基本的接口和日志分析能力

-

能基本的脚本或简单代码

-

能理解系统架构和模块边界

-

有一定的数据分析意识

如果你目前连传统测试的很多核心能力都还没建立起来,那么直接冲 AI 测试,很可能会变成“传统测试没学明白,AI 测试也浮在表面”。

3. 我愿不愿意接受“转过去也可能先做脏活累活”?

很多人想象中的 AI 测试,是高大上的:

-

测大模型

-

研究 Prompt

-

搭评测体系

-

做智能体效果验证

但现实里,很多岗位一开始的工作可能是:

-

标注数据

-

清洗测试集

-

验证问答结果

-

整理 badcase

-

重复跑回归场景

-

比对不同版本输出差异

-

写大量评测用例和结果记录

这些工作并不性感,甚至有点“苦”。

但恰恰是这些基础工作,构成了 AI 测试真正的地基。

如果你期待的是一转过去就做很高级的事情”,那现实很可能会让你失落。

五、AI 测试真正缺的,不是“会说 AI 黑话的人”

现在市场上有一种很常见的现象:

很多人简历上写满了这些词:

-

LLM

-

Prompt Engineering

-

RAG

-

Agent

-

Evaluation

-

Fine-tuning

-

Multi-agent

看起来很唬人,但一问具体做过什么,往往回答比较空:

-

“调过提示词”

-

“体验过知识库”

-

“做过一些模型测试”

-

“参与过 AI 项目”

-

“了解评测流程”

问题是,企业招 AI 测试,不是为了招一个“会背概念的人”,而是为了招一个能把 AI 系统测明白、测出问题、推动改进的人。

真正有竞争力的人,往往不是最会说概念的,而是最能落地的,比如他能说清:

-

测了哪些场景

-

怎么构建测试集

-

怎么定义评判标准

-

怎么区分模型问题和工程问题

-

怎么评估版本迭代效果

-

怎么发现高风险 badcase

-

怎么把问题分类沉淀成可复用的评测资产

所以,如果你想转 AI 测试,别急着先包装自己,先问问自己:

我到底做过什么真实、有方法、有结果的事情?

六、对传统测试来说,转 AI 测试最容易踩的几个坑

这里我想直接讲几个常见误区。

1. 只学概念,不做项目

听了很多课,看了很多文章,收藏了很多资料,但没有真正动手。

这是最大的问题。

AI 测试不是靠“知道”,而是靠“做过”。

哪怕你没有正式工作机会,也可以自己做一些练习:

-

找公开大模型产品做对比测试

-

用公开文档搭一个简单 RAG 场景

-

自己整理一套评测维度

-

设计多轮对话测试集

-

尝试分析幻觉案例

-

写一份完整的测试方案和评测报告

你做过,和你看过,完全不是一回事。

2. 只盯模型,不看业务

很多人一提 AI 测试,就只关注模型回答效果,但忽略了业务场景才是测试价值的核心。

企业真正关心的不是“这个模型会不会背知识”,而是:

-

它能不能服务真实用户

-

它会不会答错关键业务信息

-

它会不会造成误导

-

它会不会影响转化和留存

-

它会不会带来合规和安全风险

脱离业务场景谈 AI 测试,很容易变成自嗨。

3. 觉得 AI 测试不需要代码能力

这也是误解。

虽然不是每个 AI 测试岗位都要求很强的开发能力,但如果你完全没有脚本、接口、自动化、数据处理能力,你会非常吃亏。

因为很多实际工作都离不开这些能力:

-

批量调用接口

-

自动执行评测

-

清洗测试数据

-

统计评测结果

-

分析 badcase

-

建立简单工具链

代码能力不一定要很强,但不能完全没有。

4. 以为 AI 测试岗很多、门槛很低

现实是,AI 测试岗位确实在增长,但并没有增长到“谁都能轻松进”。

而且这类岗位经常有两个特点:

-

要求复合能力

-

更看重实际经验

很多公司招 AI 测试时,希望你既懂测试,又懂一点模型,又懂一点数据,又能和算法、产品、研发一起协作。

这意味着,AI 测试不是低门槛跳板,很多时候反而是更高要求的升级岗位。

七、如果你真想转,建议你这样准备

说了这么多提醒,不是为了劝退,而是为了让你少走弯路。

如果你真想往 AI 测试走,我更建议你按下面这个思路准备。

1. 先补基础认知,不要急着“神化 AI”

你至少要搞清楚这些基础概念:

-

大模型是什么

-

Prompt 是怎么影响输出的

-

RAG 的基本链路是什么

-

Agent 和工作流有什么区别

-

模型评测常见维度有哪些

-

幻觉、鲁棒性、一致性、安全性是什么意思

不要求你一上来就研究很深,但至少不能只停留在“会用”。

2. 从传统测试能力延伸,而不是推倒重来

你以前做过的很多能力其实都还有用:

-

测试设计

-

异常场景分析

-

缺陷分类

-

回归思维

-

风险意识

-

协作沟通

真正聪明的转型方式,不是把过去全否掉,而是把过去的测试能力迁移到 AI 场景里。

3. 补一点数据和脚本能力

建议至少具备这些能力:

-

能写基础 Python

-

能处理 JSON、CSV 这类数据

-

能调接口

-

能做简单批处理

-

能统计评测结果

-

能辅助搭一套小型测试流程

这会让你在 AI 测试岗位上实用很多。

4. 自己做一点“可展示的项目”

比起在简历上写“了解 AI 测试”,更有说服力的是你能拿出东西:

-

一个测试方案

-

一套评测集

-

一份 badcase 分析报告

-

一个简单的自动评测脚本

-

一个知识库问答测试案例库

-

一个多轮对话稳定性分析样例

不需要多大,但要真实,要完整,要能讲清楚你的思路。

5. 提前接受一个现实:转型初期别太挑

如果你没有 AI 测试实际经验,第一份相关机会可能并不完美:

-

标题不一定很高级

-

薪资不一定立刻暴涨

-

工作内容可能偏基础

-

团队流程可能还在摸索

但只要方向对、场景真、能积累方法论,很多时候这比“等一个完美岗位”更重要。

八、最后想说:别盲目追风口,先把自己变成有用的人

AI 测试当然是一个值得关注的方向。

它确实有前景,也确实会成为越来越多企业真实需要的能力。

但风口越热,越要冷静。

因为很多人一看到新方向,就习惯性地问:

“现在入场晚不晚?”

“这个岗位还能不能做?”

“会不会赚得更多?”

可比这些更重要的问题其实是:

“我有没有能力在这个方向上真正解决问题?”

行业永远不缺追风口的人,

真正稀缺的,是那些能在新方向里快速建立专业能力、能把事情做扎实的人。

所以,给想转行 AI 测试的人一个真心提醒:

不要把 AI 测试看成逃离现状的捷径,

要把它看成一次对自己能力结构的升级。

如果你只是想换个名字,可能很快失望。

但如果你愿意补基础、做项目、练判断、建方法,那 AI 测试确实可能成为你职业发展的一个新台阶。

结尾

AI 测试不是不能转,

而是别用“想象中的 AI 测试”指导“现实中的职业选择”。

先看清,再行动;

先打底,再转身。

这大概就是给想转行 AI 测试的人,最重要的一个提醒。

感谢每一个认真阅读我文章的人!!!

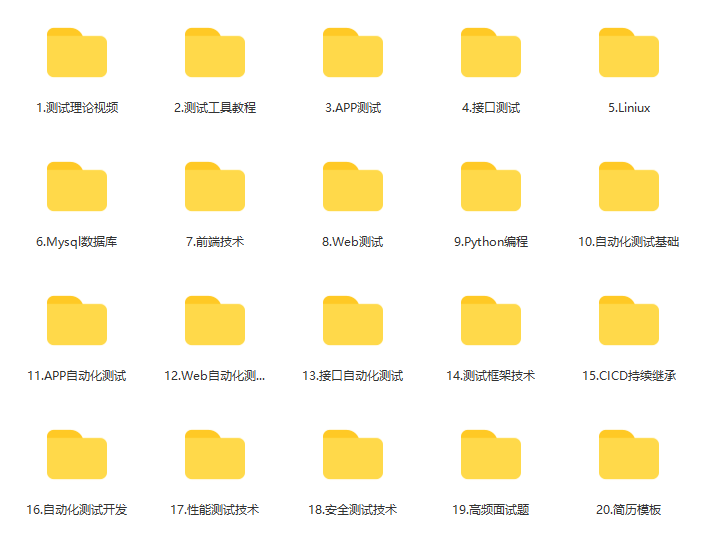

作为一位过来人也是希望大家少走一些弯路,如果你不想再体验一次学习时找不到资料,没人解答问题,坚持几天便放弃的感受的话,在这里我给大家分享一些自动化测试的学习资源,希望能给你前进的路上带来帮助。

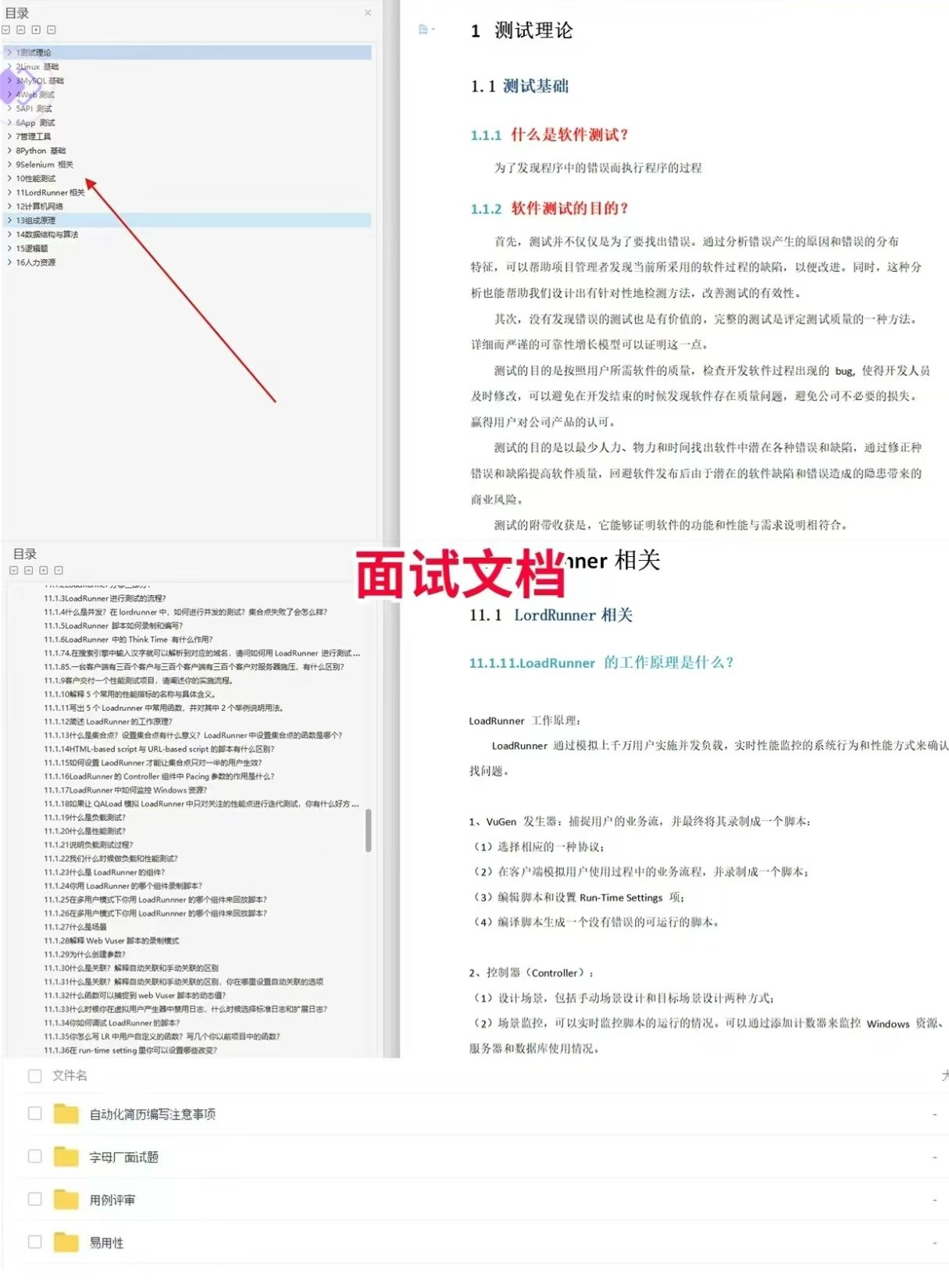

软件测试面试文档

我们学习必然是为了找到高薪的工作,下面这些面试题是来自阿里、腾讯、字节等一线互联网大厂最新的面试资料,并且有字节大佬给出了权威的解答,刷完这一套面试资料相信大家都能找到满意的工作。

视频文档获取方式:

这份文档和视频资料,对于想从事【软件测试】的朋友来说应该是最全面最完整的备战仓库,这个仓库也陪伴我走过了最艰难的路程,希望也能帮助到你!以上均可以分享,点下方小卡片即可自行领取。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献7条内容

已为社区贡献7条内容

所有评论(0)