深度掌控 Agent 调试:LangGraph 本地服务器与 Studio 核心指南

深度掌控 Agent 调试:LangGraph 本地服务器与 Studio 核心指南

在开发复杂的 LLM Agent 时,开发者最头疼的往往不是代码逻辑,而是“黑盒状态”:Agent 刚才为什么跳到了那个节点?状态变量在这一步是怎么变化的? 为了解决这些痛点,LangChain 团队推出了 LangGraph 本地服务器 (LangGraph Server) 及其配套的 LangGraph Studio。它不仅是一个运行环境,更是 Agent 的“X 光机”。

一、 核心技术深度解析与底层原理

1. 什么是 LangGraph 本地服务器?

LangGraph Server 是一个专门为运行和管理 LangGraph 应用设计的轻量级后端服务。它基于 Python 的异步框架(通常是 FastAPI)构建,提供了一套标准化的 API 接口。

- 核心定义:它是连接你的代码逻辑与可视化调试界面的“桥梁”。

- 核心价值:支持多线程管理、**持久化检查点(Checkpoints)*和*实时流输出。这意味着你可以随时暂停、修改状态并回滚(Time Travel)。

2. 底层架构:持久化与并发

LangGraph 服务器的核心竞争力在于其持久化层(Persistence Layer)。

- Checkpointer(检查点机制):当图在节点间跳转时,服务器会自动将当前

State序列化并存入内存或数据库(如 SQLite/Postgres)。 - Threading(线程管理):服务器允许你为同一个图开启多个“Thread”,每个 Thread 代表一个独立的对话上下文,互不干扰。

内嵌式科普:什么是持久化(Persistence)?

在 Web 开发中,持久化是指将内存中的数据保存到硬盘或其他非易失性存储设备中。在 LangGraph 中,这确保了如果服务器崩溃或需要人工介入审批,Agent 的任务进度不会丢失。

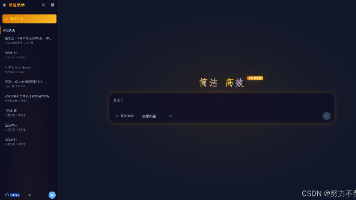

3. 可视化辅助:LangGraph Studio 交互逻辑

当你启动本地服务器后,可以使用 LangGraph Studio 进行可视化交互。

二、 实际应用场景与典型案例

1. 场景化建模

- 痛点:在编写具有 10 个以上节点的复杂 Agent 时,仅凭终端(Terminal)日志很难追踪长链条的状态流转。

- 解决方案:本地服务器通过可视化图表展示当前执行路径,甚至可以手动触发某个特定节点进行压力测试。

2. 典型用例

- 断点审批 (Human-in-the-loop):在财务转账 Agent 中,设置一个“审批节点”。服务器会挂起任务,等待开发者在 UI 上点击“确认”后继续。

- 状态回溯调试 (Time Travel):如果 Agent 在第 5 步回答错了,你可以直接点击第 4 步的快照,修改那一刻的状态数据,看它是否能走入正确的逻辑。

- 多版本测试:同时开启多个 Thread,对比不同提示词(Prompt)对同一逻辑图的影响。

三、 基础实战项目:可可视化 Agent 开发环境搭建

我们将搭建一个能够进行简单逻辑判断的 Agent,并演示如何将其部署在本地服务器上。

1. 环境搭建 (Conda 优先)

部署本地服务器需要安装 langgraph-cli 命令行工具。

# 1. 创建环境

conda create -n langgraph_server_env python=3.11 -y

conda activate langgraph_server_env

# 2. 安装 LangGraph 及开发服务器套件

pip install langgraph langchain-openai langgraph-cli

2. 项目目录结构

LangGraph 服务器要求特定的目录结构,核心是 langgraph.json 配置文件。

my_agent_app/

├── agent.py # 编写图逻辑

├── langgraph.json # 服务器配置文件

└── requirements.txt # 依赖声明

3. 全量代码实现

(1) 编写逻辑:agent.py

我们需要定义一个简单的状态图。

# -*- coding: utf-8 -*-

from typing import TypedDict, Annotated

from langgraph.graph import StateGraph, END

# 定义状态

class State(TypedDict):

input: str

decision: str

count: int

# 定义节点逻辑

def start_node(state: State):

print("--- 执行起始节点 ---")

# 模拟决策逻辑

decision = "go_to_end" if "finish" in state['input'] else "continue"

return {"decision": decision, "count": state.get('count', 0) + 1}

def process_node(state: State):

print("--- 执行处理节点 ---")

return {"input": state['input'] + " (已处理)", "count": state['count'] + 1}

# 构建图

workflow = StateGraph(State)

workflow.add_node("start", start_node)

workflow.add_node("process", process_node)

workflow.set_entry_point("start")

# 设置条件边

workflow.add_conditional_edges(

"start",

lambda x: x["decision"],

{

"continue": "process",

"go_to_end": END

}

)

workflow.add_edge("process", "start")

# 编译图(注意:服务器加载的是编译后的变量)

graph = workflow.compile()

(2) 配置文件:langgraph.json

这是本地服务器识别项目的核心文件。

{

"dependencies": ["."],

"graphs": {

"my_agent": "./agent.py:graph"

},

"env": {

"OPENAI_API_KEY": "sk-your-key-here"

}

}

4. 启动与预期运行结果

在终端输入以下命令启动服务器:

# 在 my_agent_app 目录下运行

langgraph dev

预期输出日志:

Ready!

🚀 API: http://localhost:8123

🎨 Studio: https://smith.langchain.com/studio/?baseUrl=http://localhost:8123

操作指引:

- 点击日志中的 Studio 链接(或者在本地安装的 LangGraph Studio 客户端中打开)。

- 在左侧配置栏输入

{"input": "keep going"}。 - 点击 Run,你会看到 UI 界面实时绘制出 Agent 在

start和process节点之间循环的动画。 - 如果你输入

{"input": "finish it"},你会观察到 Agent 走入END状态。

四、 总结与建议

LangGraph 本地服务器将 AI 协作从“写代码跑脚本”提升到了“可视化工程管理”的高度。

- 核心要点回顾:服务器通过

langgraph.json挂载代码,提供 API 和 Studio 界面,支持状态持久化和实时调试。 - 上手路径:

- 确保 Python 版本在 3.11+ 以获得最佳异步支持。

- 先通过命令行

langgraph dev跑通最简 Demo。 - 利用 Thread 功能进行不同场景的并行对比。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献33条内容

已为社区贡献33条内容

所有评论(0)