AI光电识别跟踪技术架构解析与实践——边缘AI模块、算法体系、通信协议与应用场景全解析

一、引言:边缘AI在光电探测中的技术挑战

计算机视觉技术在光电探测领域的应用正在经历一场深刻变革。从传统的人工监控到智能化的自动识别跟踪,AI技术的融入使得光电设备能够自主完成目标检测、分类、定位和持续跟踪。然而,将强大的深度学习算法部署到体积小、功耗低的嵌入式设备中,同时保证实时性和准确性,始终是行业面临的核心技术挑战。

在国防安全、边境巡逻、海事监控、无人机反制、智慧交通等场景中,对“人、车、船、无人机”等多类型目标的实时识别与高精度跟踪已成为关键需求。这类系统通常需要在边缘端完成所有推理计算,对算力、功耗、体积、可靠性都提出了极高要求。

本文以Tofu系列AI识别跟踪模块为案例,从技术架构、算法体系、通信协议设计等维度进行深入拆解,探讨边缘AI在光电探测领域的工程实践与技术思考。

二、边缘AI光电设备的架构设计思路

边缘AI光电设备的架构设计通常采用“模块化 + 整机化 + 生态化”的三层架构。这种设计思路的核心思想是:将AI识别跟踪能力封装为独立的嵌入式模块,可以灵活集成到不同形态的光电设备中,同时通过统一的通信协议和接口标准实现生态化集成。

2.1 三层架构概览

第一层:AI识别跟踪模块

这是整个系统的核心计算单元,负责视频接收、目标检测、分类、跟踪以及结果输出。典型的设计需要在有限的算力(2~10 TOPS)和功耗(2~5W)下,实现多类型目标的实时识别与稳定跟踪。以Tofu系列为例,其模块产品线覆盖了从2 TOPS到10 TOPS的不同算力等级,体积从40×40×25mm到60×70×24mm不等,可以嵌入到各类光电设备中。

第二层:整机产品集成

AI模块与云台、相机深度集成后,形成开箱即用的整机解决方案。这类产品通常支持可见光、热红外、双光融合等多种工作模式,覆盖从紧凑型到远程大型的全场景需求。典型型号包括紧凑型、中型、大型等多种规格。

第三层:接口与生态配件

为解决各类传感器、相机、云台之间的接口兼容问题,通常需要一系列接口转换模块,包括串口服务器(TCP/UDP/HTTP/MQTT)、视频转换板(BT.1120等)、CameraLink输入模块、网络交换板、无线组网模块等。这些配件使得系统能够灵活适配不同的现场环境和传感器类型。

三、核心模块技术对比与分析

以下通过对四款不同算力等级的AI识别跟踪模块进行技术对比,分析边缘AI模块在算力、识别速度、跟踪性能、视频接口等方面的设计考量:

|

技术指标 |

入门型(3 TOPS) |

紧凑型(2 TOPS) |

高性能(10 TOPS) |

旗舰型(6 TOPS) |

|

算力 |

3 TOPS |

2 TOPS |

10 TOPS |

6 TOPS |

|

识别速度 |

标准 20fps |

标准 15fps |

最大 67fps 标准 25fps |

最大 25fps 标准 25fps |

|

跟踪速度 |

最大 50fps 标准 25fps |

10fps |

最大 50fps 标准 25fps |

最大 50fps 标准 25fps |

|

视频输入 |

H.264 RTSP BT.656 CameraLink |

H.264 RTSP BT.656/1120 MIPI CameraLink |

H.264 RTSP BT.1120/656 MIPI/USB CameraLink |

H.264 RTSP USB |

|

跟踪稳定性 |

优,可自适应 |

目标变化下较弱 |

优,可自适应 |

优,可自适应 |

|

功耗 |

2.5W |

2W |

5W |

5W |

|

体积(含外壳) |

60×70×24mm |

40×40×25mm |

60×55×20mm |

41×56×28mm |

算力与实际性能的关系

上表中有一个值得注意的现象:算力并不与实际处理速度简单成正比。例如,10 TOPS的高性能模块识别速度可达67fps,而6 TOPS的旗舰型则在双光同时处理方面表现更优。这说明在边缘AI设计中,架构优化、内存带宽、算法效率等因素的影响往往比纯粹的算力数值更为关键。这对工程师在选型时提供了重要参考:不应仅仅看TOPS数字,而应综合考虑实际场景下的处理帧率、跟踪稳定性和功耗等指标。

3.1 旗舰型模块的技术突破

双光同时处理架构

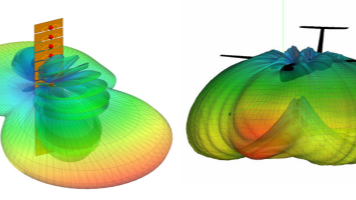

旗舰型模块能够同时处理热红外和可见光两路视频,识别速度可达40帧/秒。这种双光融合架构的技术难点在于:两路视频的时间同步、特征对齐、决策融合。在夜间或低能见度环境下,设备可以同时利用热红外的温度信息和可见光的纹理信息进行互补融合,大幅提升检测的可靠性。

Boost模式与高帧率跟踪

在跟踪场景下,旗舰型的跟踪速度可达50fps,而在Boost模式下更是可以飙升至200fps。这种极高帧率的实现,通常需要在算法上做出权衡:在保证跟踪精度的前提下,通过简化特征提取、采用轻量级跟踪头等技术手段来提升处理速度。这对跟踪高速运动的无人机、飞行中的鸟类等快速目标至关重要。

自适应跟踪算法

自适应跟踪算法是边缘AI跟踪的核心技术之一。当目标尺寸、形态发生变化时,算法需要在不重新检测的情况下保持稳定跟踪。关键技术包括:基于外观特征的模型更新机制、基于运动预测的目标位置估计、以及在目标遮挡后的重新捕获策略。

3.2 广域光电搜索技术

广域光电搜索是一种“先发现、后跟踪”的协同工作模式。以4800万像素广域搜索器为例,其核心思路是:

|

技术参数 |

规格 |

|

分辨率 |

8000 × 6000(4800万像素) |

|

帧率 |

5Hz |

|

识别速度 |

1秒/帧 |

|

最远识别距离 |

小目标 1.2Km(狭角配置) |

其工作流程为:先通过高分辨率广域相机进行大视场扫探,识别到小目标后,自动引导配套的窄视场跟踪模块进行精确跟踪。这种广域+窄域的协同工作方式,特别适合边境巡逻、海上目标搜索等需要大范围监控的场景。技术上的难点在于如何在有限算力下处理超高分辨率图像,以及广域模块与跟踪模块之间的快速交接与目标坐标转换。

四、算法体系与功能架构

4.1 目标识别能力设计

边缘AI光电设备的目标识别通常需要覆盖人、车、船、无人机等多种目标类型,部分高端产品还支持飞机、直升机、鸟类的识别。在技术实现上,这通常采用基于深度学习的目标检测算法(如YOLO系列),并针对边缘设备进行模型轻量化和量化处理。

值得注意的是,目标类型的编码设计往往采用简洁的数值映射方式,例如:0xA1表示人/飞机,0xA2表示车/直升机,0xA3表示船/鸟,0xA4表示无人机。跟踪状态中0xB1表示跟踪正常,0xB2表示跟踪丢失。这种编码方式简洁高效,便于嵌入式设备快速解析。

4.2 多模式跟踪体系设计

为覆盖不同的实际使用场景,边缘AI跟踪系统通常设计了多种跟踪模式:

|

跟踪模式 |

模式编码 |

技术原理 |

|

自动跟踪 |

0x02 |

AI自动锁定最优目标,基于目标大小、距离、类型等综合评分选择跟踪目标 |

|

点选跟踪 |

0x03 |

用户点击指定目标,系统自动锁定最近目标并启动跟踪 |

|

波门跟踪 |

0x04 |

固定尺寸正方形区域内的目标检测与跟踪,适合固定视场监控 |

|

框选跟踪 |

0x04 |

用户拖拽任意大小矩形区域,基于图像特征匹配进行跟踪 |

4.3 核心功能架构一览

一套完整的边缘AI光电设备通常需要具备以下核心功能:

- 多类型目标识别跟踪:人、车、船、无人机、飞机、鸟类等

- 多模式跟踪:自动跟踪、点选跟踪、波门/框选跟踪

- 云台/镜头控制:支持无级变速云台控制

- 数字变倍:1X~2X无级数字变倍(需硬件支持)

- 跟踪过程自动变焦:基于目标像素大小自动调整焦距

- 目标重捕获:目标丢失后自动重新捕获策略

- 图像融合:可见光与热红外图像融合显示

- 目标方位角与经纬度计算:配合云台角度信息实现

- 激光测距、激光补光接入:与外部传感器联动

- 第三方算法部署:支持通过授权方式部署自训练模型

五、通信协议设计解析

通信协议是边缘AI设备与上位机系统交互的桥梁。一套设计良好的通信协议体系对于系统的集成性和可维护性至关重要。以下对常见的协议架构进行技术解析。

5.1 JSON跨平台网络协议

基于TCP/IP的JSON协议是边缘AI设备与客户端之间最常用的通信方式。其优势在于跨平台兼容性好、可读性强、便于二次开发。

协议帧结构

典型的数据帧由固定长度的帧头和可变长度的JSON内容组成:

|

标识码1 |

标识码2 |

帧类型 |

帧长度 |

帧内容 |

|

0xEC |

0x91 |

见帧类型表 |

4Byte |

JSON数据 |

帧类型通常覆盖:状态推送(0x01)、控制指令(0x03)、图像抓拍(0x04)、参数查询(0x05)、检测区域设置(0x06)、显示模式设置(0x07)、算法模型设置(0x08)等。

目标识别数据示例

以下是典型的目标识别信息推送的JSON数据结构:

{

"ControlType": "AIInfo",

"WorkMode": 1, // 识别模式

"ObjectCount": 2, // 检测到的目标数量

"Object": {

"01": {

"Class": 161, // 0xA1 表示人

"Points": {

"Left": 100, "Top": 100,

"Right": 200, "Bottom": 200

},

"Distance": 1066.0, // 目标距离(米)

"Angle": { "Hor": 12.3, "Ver": 1.3 }

}

}

}

5.2 云台控制协议

云台控制通常采用Pelco-D协议控制云台运动,VISCA协议控制镜头变倍和聚焦。这是光电行业广泛使用的标准协议,兼容性好。控制与查询周期通常为200ms。

5.3 其他常见协议

- 串口控制与报警协议:通过串口实现设备控制与状态获取

- 脱靶量协议:将识别跟踪偏差转换为云台控制指令

- 高精度云台控制协议:用于跟踪精度要求高、跟踪距离超过500米的场景

- 全景拼接控制协议:用于多台设备的全景拼接控制

5.4 视频接口设计

视频输入支持的格式通常包括H.264 RTSP、BT.656、BT.1120、MIPI、USB、CameraLink等,视频输出采用RTSP/Onvif协议,支持修改分辨率、码率、编码格式。接口设计的关键在于兼容性:需要适配不同厂商的相机、云台、传感器,这对硬件接口的灵活性和协议的可扩展性提出了很高要求。

六、典型应用场景与技术要点

6.1 国防安全与边境防御

在边境巡逻场景中,核心挑战是在大范围、复杂地形、恶劣天气条件下实现可靠目标检测。广域光电搜索技术可以在1.2Km距离上识别小目标,配合全景拼接和地图联动功能,实现大范围区域的实时监控。技术难点包括:长时间运行的稳定性、户外环境的适应性、多设备协同工作。

6.2 无人机反制与低空防御

无人机反制是边缘AI跟踪技术的典型应用。核心挑战在于:无人机目标尺寸小、速度快、飞行路径不可预测。高帧率跟踪(200fps)和自适应算法是应对这些挑战的关键技术。此外,机载平台的振动、电磁干扰等因素也需要在硬件设计中予以考虑。

6.3 海事监控与海上目标跟踪

海事监控场景的特殊性在于:目标距离远、海面环境复杂(波浪、雾气、夜间)。双光融合技术在这类场景中价值尤为突出,热红外成像能够在低能见度条件下提供有效的目标检测能力。

6.4 智慧交通与城市安防

在智慧交通场景中,边缘AI设备可以实现交通流量统计、违规行为检测、人员安全监控等功能。目标计数与统计功能可以为交通管理提供数据支撑。技术上的难点在于处理密集目标场景下的识别准确率和实时性。

七、集成与二次开发实践

7.1 快速集成流程

边缘AI设备的典型集成流程通常包括:

- 设备连接:通过网络或串口连接AI设备

- 视频获取:通过RTSP协议获取视频流(端口554)

- 数据接收:通过JSON协议接收识别跟踪数据(端口8089)

- 控制指令:通过JSON指令控制工作模式、跟踪目标等

- 图像抓拍:获取目标区域截图(抓拍间隔150ms~300ms)

7.2 定制化开发考虑

在实际项目中,往往需要根据具体需求进行定制开发:

- 算法定制:根据特殊目标类型训练专用识别模型

- 模型部署:通过授权方式在设备上部署自训练模型

- 硬件适配:根据环境需求定制接口、防护等级、功耗指标

- 协议对接:与现有系统的通信协议进行对接开发

八、技术展望

边缘AI在光电探测领域的应用正在快速发展,从技术趋势来看,未来将在以下方向继续深化:

- 更强大的边缘算力:随着NPU芯片的持续迭代,边缘端将能够运行更复杂的模型

- 多模态融合:可见光、热红外、激光雷达、SAR等多传感器融合将成为趋势

- 多目标协同跟踪:从单目标跟踪向多目标同时跟踪演进

- 边缘-云端协同:边缘端进行轻量级推理,云端进行复杂分析与决策

- 更开放的算法生态:支持第三方开发者部署自定义算法

对于工程师而言,选择边缘AI设备时不应仅关注TOPS算力数字,更应综合考虑实际场景下的处理帧率、跟踪稳定性、接口兼容性、协议完备性以及功耗等因素。完善的通信协议文档和源码支持,是降低二次开发成本的关键。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)