Langflow ——可视化 AI 应用构建框架入门指南

目录

1. 项目概述

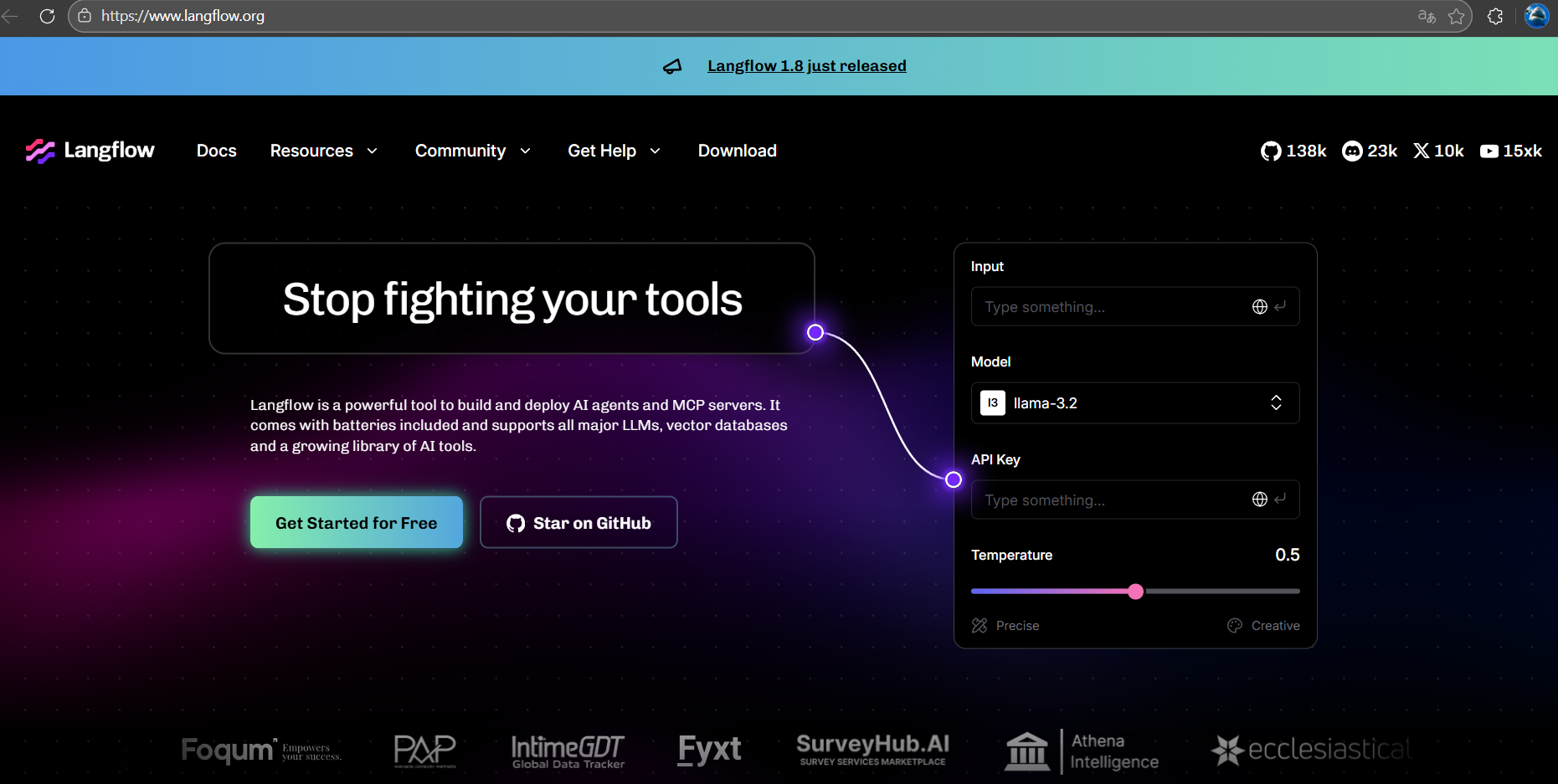

1.1 什么是 Langflow

Langflow 是一个开源的、基于 Python 的可视化 AI 应用构建框架,专为构建多智能体(Multi-Agent)和检索增强生成(RAG)应用而设计。它提供了一个直观的拖拽式界面,使开发者能够快速原型化和部署复杂的 AI 工作流,而无需编写大量样板代码。

核心特点:

- 模型无关性:不强制绑定特定的 LLM 或向量数据库,支持 OpenAI、Anthropic、Groq、HuggingFace 等多种模型提供商

- 可视化编程:通过拖拽组件和连接节点来构建 AI 工作流,类似绘制流程图

- Python 底层:所有组件都基于 Python 构建,支持代码访问和自定义

- 完全开源:采用 MIT 许可协议,可自由使用、修改和分发

- 生产级部署:支持多种部署方式,包括本地、Docker、云平台和 Kubernetes

1.2 开发背景

Langflow 项目由 DataStax 于 2024 年 4 月收购,旨在让 GenAI 应用的开发变得更容易、更快、更有趣。截至 2026 年 3 月,Langflow 在 GitHub 上已获得超过 146,000 颗星,成为 AI 开发领域最受欢迎的开源项目之一。

重要里程碑:

- 2025 年 8 月 14 日:GitHub Stars 突破 100,000

- 2025 年 10 月 2 日:发布 1.6 版本,新增 OAuth for MCP 和 OpenAI Responses API 兼容性

- 2026 年 3 月 6 日:发布 1.8 版本,引入全局模型提供商设置、V2 工作流 API 和更快的调试功能

1.3 核心功能

1.3.1 可视化工作流构建器

Langflow 提供了一个功能丰富的可视化界面,开发者可以:

- 从组件库拖拽各种预构建组件到画布

- 通过连接端口(ports)将组件串联成完整的工作流

- 实时查看每个组件的输入输出

- 在 Playground 中即时测试和调试工作流

1.3.2 丰富的组件生态

Langflow 内置了数百个组件,涵盖以下类别:

- 输入/输出组件:Chat Input、Chat Output、File Upload、Webhook 等

- 模型组件:OpenAI、Anthropic、Groq、Azure OpenAI、HuggingFace 等

- 提示词组件:Prompt Template、Prompt Chat、Simple Prompt 等

- 数据组件:DataFrame Loader、JSON Loader、Text Splitter 等

- 向量存储组件:Chroma、Pinecone、Weaviate、Qdrant、Milvus、Redis 等

- Agent 组件:Python Agent、OpenAI Agent、LangGraph Agent 等

- 工具组件:Calculator、URL、Wikipedia、Search 等

1.3.3 实时调试与测试

- Playground:提供交互式聊天界面,可以实时测试工作流

- 组件级运行:单独运行任意组件,查看其输出结果

- Traces 功能(1.8+):记录详细的执行轨迹,帮助调试和性能分析

- 检查面板:实时查看组件的内部状态、输入和输出

1.3.4 多种部署选项

- 本地部署:Python 包安装或 Docker 容器

- 云端托管:DataStax Langflow Cloud(免费账户可用)

- Kubernetes 部署:官方 Helm Chart 支持

- MCP Server:将工作流作为 Model Context Protocol 工具暴露

- API 集成:通过 REST API 调用工作流

1.4 适用场景

1.4.1 聊天机器人

构建智能客服、虚拟助手、对话系统等应用,支持多轮对话、记忆管理、工具调用等高级功能。

1.4.2 RAG 系统(检索增强生成)

基于文档库构建问答系统,包括文档加载、分块、向量化、检索和生成等完整流程。

1.4.3 多智能体应用

构建能够调用多个工具的智能体,执行复杂的任务编排和自动化工作流。

1.4.4 内容生成

自动化博客写作、营销文案生成、报告撰写等内容创作应用。

1.4.5 数据分析

构建数据分析助手,支持 SQL 查询、数据可视化、报告生成等功能。

1.4.6 企业集成

与企业现有系统(如 CRM、ERP、文档管理系统)集成,提供 AI 增强的功能。

2. 安装指南

Langflow 提供多种安装方式,以满足不同用户的需求。本节将详细介绍 Windows、macOS 和 Linux 系统上的安装步骤。

2.1 系统要求

2.1.1 硬件要求

- 最低配置:双核 CPU,2GB RAM

- 推荐配置:多核 CPU,4GB 或更多 RAM

- 磁盘空间:至少 2GB 可用空间(用于依赖包和缓存)

2.1.2 软件要求

| 组件 | Windows | macOS | Linux |

|---|---|---|---|

| Python 版本 | 3.10 - 3.12 | 3.10 - 3.13 | 3.10 - 3.13 |

| 包管理器 | uv(推荐)或 pip | uv(推荐)或 pip | uv(推荐)或 pip |

| 浏览器 | Chrome(推荐) | Chrome(推荐) | Chrome(推荐) |

注意:Windows 系统不支持 Python 3.13 版本。macOS 13+ 和 Windows 支持桌面应用版本。

2.2 安装方式概览

Langflow 提供以下五种安装方式:

- 桌面应用:最简单的安装方式,包含所有依赖,一键启动

- Python 包安装:最灵活的方式,适合开发者

- Docker:容器化部署,环境隔离

- 源码安装:适合贡献者或需要自定义修改的用户

- 云端托管:DataStax Langflow Cloud,零配置

2.3 方式一:桌面应用安装(推荐新手)

2.3.1 macOS 安装步骤

- 访问 Langflow Desktop 官方下载页面

- 点击 “Download Langflow”,填写联系信息

- 下载

.dmg安装包 - 双击打开安装包,将 Langflow 拖拽到 Applications 文件夹

- 从应用程序文件夹启动 Langflow

- 首次启动时会自动检查和配置所需环境

2.3.2 Windows 安装步骤

- 访问 Langflow Desktop 官方下载页面

- 点击 “Download Langflow”,填写联系信息

- 下载

.msi安装文件 - 双击运行安装程序,按照向导完成安装

- 安装过程中可能需要安装 Microsoft C++ Build Tools(如有提示,按照屏幕说明安装)

- 从开始菜单启动 Langflow

警告:Windows 用户升级到 1.6.0 版本时,不要使用应用内更新功能。请从官网下载新版本重新安装。

桌面应用的优势:

- 无需配置 Python 环境

- 自动管理依赖和升级

- 开箱即用,适合快速体验

桌面应用的限制:

- 不支持可共享的 Playground

- 不支持语音模式

- 可用性略低于完整的 Python 安装

2.4 方式二:Python 包安装(推荐开发者)

这是最灵活的安装方式,适合需要自定义环境或参与开发的用户。

2.4.1 前置要求

安装 Langflow 前,需要确保系统已安装:

- Python 3.10 或更高版本(根据系统要求选择)

uv包管理器(推荐,比 pip 快 10 倍以上)

2.4.2 安装 uv 包管理器

uv 是由 Astral 团队用 Rust 开发的现代 Python 包管理器,比传统的 pip 快得多。

使用 pip 安装 uv:

pip install uv

验证安装:

uv --version

如果提示找不到命令,需要将 uv 的安装路径添加到系统 PATH 环境变量中。

2.4.3 创建虚拟环境(强烈推荐)

使用虚拟环境可以避免依赖冲突,保持系统环境的干净。

Linux / macOS:

# 创建虚拟环境

uv venv langflow-env

# 激活虚拟环境

source langflow-env/bin/activate

Windows:

# 创建虚拟环境

uv venv langflow-env

# 激活虚拟环境

langflow-env\Scripts\activate

激活虚拟环境后,终端提示符会显示 (langflow-env) 前缀。

虚拟环境管理:

- 退出虚拟环境:

deactivate - 删除虚拟环境:

rm -rf langflow-env(Linux/macOS)或rmdir /s langflow-env(Windows)

2.4.4 安装 Langflow

在虚拟环境中,使用以下命令安装 Langflow:

uv pip install langflow

安装特定版本:

uv pip install langflow==1.8.0

升级到最新版本:

uv pip install langflow -U

强制重新安装:

uv pip install langflow --force-reinstall

2.4.5 启动 Langflow

安装完成后,使用以下命令启动 Langflow:

uv run langflow run

或者,如果使用 pip 安装:

python -m langflow run

启动成功后,会在终端看到类似以下输出:

INFO: Started server process [12345]

INFO: Waiting for application startup.

INFO: Application startup complete.

INFO: Uvicorn running on http://127.0.0.1:7860 (Press CTRL+C to quit)

默认访问地址:http://127.0.0.1:7860 或 http://localhost:7860

自定义端口:

langflow run --port 7861

2.4.6 可选依赖项

Langflow 提供多个可选功能模块,可按需安装:

# 安装 PostgreSQL 支持

uv pip install "langflow[postgresql]"

# 同时安装多个扩展

uv pip install "langflow[deploy,local,postgresql]"

可用扩展包括:audio、cassio、clickhouse-connect、couchbase、docling、local、nv-ingest、postgresql 等。

2.5 方式三:Docker 安装(推荐生产环境)

Docker 方式提供了完全隔离的环境,适合需要一致部署或多台机器的场景。

2.5.1 安装 Docker

确保系统已安装 Docker Engine 或 Docker Desktop。

2.5.2 拉取并运行 Langflow 镜像

docker run -d -p 7860:7860 langflowai/langflow:latest

参数说明:

-d:后台运行容器-p 7860:7860:将主机的 7860 端口映射到容器的 7860 端口

2.5.3 访问 Langflow

打开浏览器访问:http://localhost:7860

2.5.4 高级 Docker 配置

使用环境变量配置:

docker run -d \

-p 7860:7860 \

-e LANGFLOW_HOST=0.0.0.0 \

-e LANGFLOW_PORT=7860 \

langflowai/langflow:latest

挂载自定义组件目录:

docker run -d \

-p 7860:7860 \

-v /path/to/custom_components:/app/custom_components \

-e LANGFLOW_COMPONENTS_PATH=/app/custom_components \

langflowai/langflow:latest

使用 Docker Compose:

创建 docker-compose.yml 文件:

version: '3.8'

services:

langflow:

image: langflowai/langflow:latest

container_name: langflow

ports:

- "7860:7860"

environment:

- LANGFLOW_HOST=0.0.0.0

- LANGFLOW_PORT=7860

volumes:

- ./custom_components:/app/custom_components

- ./data:/app/data

restart: unless-stopped

启动服务:

docker-compose up -d

2.6 方式四:从源码安装(适合贡献者)

如果你需要为 Langflow 贡献代码或进行自定义修改,可以从源码安装。

2.6.1 克隆仓库

git clone https://github.com/langflow-ai/langflow.git

cd langflow

2.6.2 安装依赖

# 使用 poetry(推荐)

poetry install

# 或使用 pip

pip install -e ".[dev]"

2.6.3 构建前端

make install_frontend && make build_frontend

2.6.4 启动开发服务器

poetry run python -m langflow run

或使用 Make 命令:

make run_cli

2.7 方式五:云端托管(零配置)

DataStax 提供托管的 Langflow 服务,无需任何本地安装。

- 访问 DataStax Langflow

- 注册免费账户

- 登录后即可开始创建工作流

云端托管的优势:

- 零配置,开箱即用

- 企业级安全性和可扩展性

- 与 Astra DB 深度集成

- 自动备份和升级

2.8 常见安装问题及解决方案

2.8.1 Microsoft C++ Build Tools 缺失(Windows)

错误信息:

error: Microsoft Visual C++ 14.0 or greater is required.

解决方案:

- 访问 Microsoft C++ Build Tools 下载页面

- 下载并安装 Visual Studio Build Tools

- 在安装过程中选择 “Desktop development with C++” 工作负载

- 重新运行安装命令

2.8.2 端口被占用

错误信息:

OSError: [Errno 48] Address already in use

解决方案:使用其他端口启动 Langflow

langflow run --port 7861

或找到并停止占用 7860 端口的进程。

2.8.3 依赖解析卡顿或失败

问题:安装过程长时间停留在依赖解析阶段。

解决方案:

- 使用

uv代替pip进行安装 - 确保网络连接稳定

- 使用国内镜像源:

uv pip install langflow -i https://pypi.tuna.tsinghua.edu.cn/simple

2.8.4 构建失败(Linux 系统)

错误信息:

Failed to build webrtcvad==2.0.10

解决方案:安装构建依赖

sudo apt-get update

sudo apt-get install build-essential python3-dev gcc

2.8.5 数据库迁移错误

错误信息:

Something went wrong running migrations

解决方案:清除缓存目录

Linux/WSL:

rm -rf ~/.cache/langflow/

macOS:

rm -rf ~/Library/Caches/langflow/

Windows:

rmdir /s %APPDATA%\langflow

然后重新启动 Langflow。

2.8.6 模块导入错误

错误信息:

No module named 'langflow.__main__'

解决方案:

- 尝试使用

uv run langflow run命令 - 升级 Langflow 到最新版本

- 强制重新安装所有依赖

uv pip install langflow --force-reinstall

2.9 安全更新提示

重要安全公告:

根据官方安全建议,用户必须升级到以下版本以保护已知漏洞:

- CVE-2025-3248:严重 RCE 漏洞,影响 1.3.0 之前的版本

- CVE-2025-68477 和 CVE-2025-68478:需升级到 >= 1.7.1

- CVE-2025-57760:高严重性权限提升漏洞,影响容器版本 1.5.1 之前

验证当前版本:

uv run langflow version

或在 Langflow 界面左上角查看版本号。

3. 界面详解

Langflow 提供了一个功能强大且直观的可视化界面。本节将详细介绍核心功能区和使用方法。

3.1 整体布局

Langflow 界面主要分为以下几个区域:

┌─────────────────────────────────────────────────────────────┐

│ Logo 项目名称下拉菜单 Playground API Share 用户头像 │

├──────┬──────────────────────────────────────────────────────┤

│ │ │

│ 组件 │ 工作画布 │

│ 侧边 │ │

│ 栏 │ │

│ │ │

├──────┴──────────────────────────────────────────────────────┤

│ 画布控制工具栏 运行控制工具栏 │

└─────────────────────────────────────────────────────────────┘

3.2 顶部导航栏

顶部导航栏包含以下元素:

3.2.1 Langflow 图标

- 点击返回项目页面

- 或刷新当前工作流

3.2.2 项目名称下拉菜单

点击项目名称可打开以下选项:

- New(新建):创建空白工作流

- Settings(设置):编辑工作流名称、描述、端点名称等

- Logs(日志):查看项目日志,包括执行历史、错误和运行时事件

- Import(导入):从 JSON 文件导入工作流或组件

- Export(导出):将当前工作流导出为 JSON 文件

- Undo(撤销):撤销上一步操作(快捷键:⌘Z / Ctrl+Z)

- Redo(重做):重做已撤销的操作(快捷键:⌘Y / Ctrl+Y)

- Refresh All(刷新全部):刷新所有组件并清除缓存

3.2.3 Playground 按钮

打开 Playground 测试界面,用于实时测试和调试工作流。

3.2.4 API 按钮

提供 API 访问详情和集成选项,包括:

- 自动生成的 Python、JavaScript 和 curl 代码片段

- API 端点信息

- 输入配置(Input Schema)

3.2.5 Share 按钮

提供以下分享选项:

- API access:API 访问

- Export:导出工作流

- MCP Server:作为 MCP 工具暴露

- Embed into site:嵌入网站

- Shareable Playground:分享 Playground 链接(桌面应用不可用)

3.2.6 用户头像

点击用户头像可访问:

- Settings:全局设置,包括:

- Langflow API Keys

- Global Variables(全局变量)

- Shortcuts(快捷键)

- Messages(消息日志)

- Profile:个人资料

- Logout:登出

3.3 组件侧边栏

组件侧边栏位于界面左侧,包含所有可用的组件。

3.3.1 搜索框

在顶部搜索框中输入关键词,快速查找组件。

3.3.2 分类菜单

组件按以下分类组织:

-

Core Components(核心组件)

- Agents:智能体组件

- Chat:聊天组件

- Data:数据处理组件

- Experimental:实验性组件

- Helpers:辅助工具组件

- Inputs:输入组件

- LLMs:大语言模型组件

- Memory:记忆管理组件

- Outputs:输出组件

- Prompts:提示词组件

- Retrieval:检索组件

- Tools:工具组件

- Utilities:实用工具组件

-

Bundles(组件包)

- Anthropic:Anthropic 模型集成

- AstraDB:DataStax Astra DB 集成

- Azure:Azure 服务集成

- Couchbase:Couchbase 数据库集成

- Docling:文档解析组件

- Milvus:Milvus 向量数据库

- OpenAI:OpenAI 模型集成

- PostgreSQL:PostgreSQL 集成

- Redis:Redis 集成

- Weaviate:Weaviate 向量数据库

- 其他第三方集成包

-

Custom Components(自定义组件)

- 用户创建的自定义组件

- 通过

LANGFLOW_COMPONENTS_PATH环境变量添加

-

MCP Servers(MCP 服务器)

- 已连接的 Model Context Protocol 服务器

3.3.3 添加组件到画布

将组件从侧边栏拖拽到画布即可添加。组件会自动放置在鼠标松开的位置。

3.4 工作画布

工作画布是构建工作流的主要区域。

3.4.1 画布操作

- 平移:点击并拖动画布空白区域

- 缩放:滚动鼠标滚轮,或使用画布控制工具栏

- 重置视图:点击画布控制工具栏中的 “Zoom to 100%” 或 “Zoom to Fit”

3.4.2 组件操作

- 移动组件:点击并拖动组件标题栏

- 选择组件:点击组件(选中后会有蓝色边框)

- 多选组件:按住 Shift 键点击多个组件,或按住 Shift 拖动框选

- 复制组件:选中组件后按 ⌘C / Ctrl+C

- 粘贴组件:按 ⌘V / Ctrl+V

- 删除组件:选中后按 Delete / Backspace 键

- 添加备注:点击工具栏的 “Add Note” 按钮

3.4.3 连接组件

每个组件都有输入端口(左侧)和输出端口(右侧),端口用不同颜色的圆圈表示,代表不同的数据类型。

连接步骤:

- 找到源组件的输出端口

- 点击并拖动到目标组件的输入端口

- 释放鼠标完成连接

- 连线会显示数据类型信息

端口类型:

常见的端口类型包括:

- Message:聊天消息类型

- Data:通用数据类型

- Document:文档类型

- LanguageModel:语言模型类型

- VectorStore:向量存储类型

- Tool:工具类型

删除连接:

- 双击连线

- 右键点击连线选择 “Delete”

- 选中连线后按 Delete 键

3.4.4 智能辅助功能

启用智能辅助可显示对齐参考线:

- 点击顶部菜单的 Help

- 切换 “Enable smart guides”

3.5 组件详情面板

单击任意组件,会打开组件的配置面板。

3.5.1 组件菜单栏

每个组件顶部都有一个菜单栏,包含以下选项:

- Code(代码):查看和编辑组件的 Python 源代码

- Advanced(高级):查看和调整所有组件参数

- Freeze(冻结):锁定组件的输出状态,防止重新运行

- Update Component(更新组件):将组件更新到最新版本

- Delete(删除):删除组件

3.5.2 组件基本信息

- Display Name:显示名称(可编辑)

- Description:描述信息(支持 Markdown)

3.5.3 配置参数

根据组件类型不同,配置参数也会不同。常见参数包括:

- 必填参数:标有红色星号(*)

- 可选参数:默认值或留空

- 高级参数:点击 “Advanced” 按钮查看

3.5.4 输入输出端口

组件左侧为输入端口,右侧为输出端口。每个端口都有:

- 端口名称:如

input_value、message等 - 数据类型:如 Message、Data 等

- 连接状态:已连接的端口会显示连线信息

3.5.5 运行按钮

组件右上角的播放按钮(▶)可以单独运行该组件,查看其输出结果。

3.5.6 输出预览

运行组件后,可以预览其输出结果,帮助调试和理解数据流。

3.5.7 状态指示器

组件运行后会显示状态图标:

- ✓ 绿色勾选:运行成功

- ✗ 红色叉号:运行错误

- ⏱ 时钟图标:运行中

悬停在状态图标上可查看详细信息。

3.5.8 组件分组

可以将多个组件组合成一个单独的组件,便于复用和管理。

创建分组的步骤:

- 按住 Shift 键,拖动选择多个组件

- 右键点击选中的组件

- 选择 “Group”

- 组件会合并为一个单独的组件

- 双击名称和描述可以修改

取消分组:

- 右键点击已分组的组件

- 选择 “Ungroup”

3.6 画布控制工具栏(左下角)

位于画布左下角,包含以下控制选项:

- Zoom In:放大视图

- Zoom Out:缩小视图

- Zoom to 100%:重置为 100% 缩放

- Zoom to Fit:自动缩放以适应所有组件

- Lock Canvas:锁定/解锁画布

3.7 运行控制工具栏(右下角)

位于画布右下角,包含以下按钮:

- Playground:打开 Playground 测试界面

- API:打开 API 访问面板

- Share:打开分享选项

3.8 Playground 界面

Playground 是一个动态交互界面,用于实时测试工作流。

3.8.1 访问 Playground

点击工具栏的 “Playground” 按钮打开。

3.8.2 Playground 布局

┌─────────────────────────────────────────────────────────┐

│ 会话列表 │ 聊天交互区域 │

│ │ │

│ - Default Session │ AI: 你好!有什么可以帮助你的? │

│ - Session 2 │ │

│ - Session 3 │ User: 计算一下 2 + 2 │

│ │ │

│ │ AI: 2 + 2 = 4 │

│ │ │

│ │ [输入框] │

└─────────────────────────────────────────────────────────┘

3.8.3 核心功能

- 实时聊天:与工作流进行对话交互

- 多会话管理:支持多个独立的聊天会话

- Agent 工具调用追踪:如果工作流包含 Agent 组件,会显示工具调用详情

- 记忆编辑:可以编辑或删除聊天记忆中的特定消息

- 消息日志:查看详细的交互历史记录

3.8.4 自定义 Session ID

默认情况下,所有对话使用同一个 Session ID(Flow ID)。可以设置自定义 Session ID 来:

- 区分不同用户的对话

- 在多次运行间保持上下文

- 调试时隔离测试场景

设置方法:

- 在 Chat Input 或 Chat Output 组件的设置中

- 点击组件菜单中的 “Controls”

- 启用 “Session ID”

- 输入自定义 Session ID

3.9 Settings 界面

通过顶部菜单的 Settings 可访问以下设置:

3.9.1 Flow Settings(工作流设置)

- Name:工作流名称

- Description:工作流描述

- Endpoint Name:API 端点名称

3.9.2 Global Variables(全局变量)

集中管理 API 密钥、配置参数等,可在所有工作流中重复使用。

添加全局变量:

- 点击 Settings > Global Variables

- 点击 “Add New”

- 输入变量名和值

- 选择应用范围(Apply To Fields)

- 点击 “Save”

3.9.3 Langflow API Keys

创建和管理用于 API 认证的密钥。

3.9.4 Shortcuts(快捷键)

查看和自定义键盘快捷键。

3.9.5 Messages(消息日志)

查看所有工作流的消息日志。

3.10 Projects 页面

这是 Langflow 启动后的默认页面,用于管理工作流和项目。

3.10.1 项目管理

- Starter Project:默认项目,所有新创建的工作流默认存储在这里

- Create new project:创建新项目

- 项目结构:项目类似文件夹,用于组织相关工作流

3.10.2 工作流操作

对于每个工作流,可以执行以下操作:

- Open:打开工作流

- Duplicate:复制工作流

- Edit Details:编辑名称和描述

- Lock Flow:锁定工作流,防止修改

- Delete:删除工作流

- Move:拖拽移动到其他项目

3.10.3 项目操作

- Download:下载项目(ZIP 格式,包含所有工作流)

- Upload:上传项目文件

3.11 键盘快捷键

常用快捷键列表:

| 快捷键 | 功能 |

|---|---|

| ⌘Z / Ctrl+Z | 撤销 |

| ⌘Y / Ctrl+Y | 重做 |

| Delete / Backspace | 删除选中组件 |

| ⌘C / Ctrl+C | 复制 |

| ⌘V / Ctrl+V | 粘贴 |

| ⌘A / Ctrl+A | 全选 |

| ⌘F / Ctrl+F | 搜索组件 |

| 空格 + 拖动 | 平移画布 |

| 滚轮 | 缩放画布 |

查看完整快捷键列表:点击 Help > Shortcuts

4. 核心功能实践

本节将通过实际操作演示 Langflow 的核心功能,包括组件组合、工作流构建、测试和分享等。

4.1 理解 Flows(工作流)

**Flow(工作流)**是 Langflow 中的核心概念,它代表了应用的功能流程。一个 Flow 接收输入、处理数据、产生输出。

Flow 的特性:

- 由多个组件组成

- 组件通过边连接,形成有向无环图(DAG)

- 完全可序列化,可以保存为 JSON 文件

- 可以通过 API 触发执行

- 支持模板快速创建

4.2 创建工作流的四种方式

在 Projects 页面,可以通过以下方式创建工作流:

-

创建空白工作流

- 选择项目 > 点击 “New Flow” > 点击 “Blank Flow”

-

从模板创建

- 选择项目 > 点击 “New Flow” > 选择模板

-

复制现有工作流

- 找到要复制的工作流 > 点击 “More” > 选择 “Duplicate”

-

导入工作流

- 点击 “Upload a flow” > 选择 JSON 文件

- 或拖拽 JSON 文件到 Langflow 窗口

4.3 常用模板介绍

Langflow 提供了多个预构建模板,适合快速上手:

4.3.1 Basic Prompting(基础提示词)

展示最简单的 OpenAI 聊天机器人,包含:

- Chat Input(聊天输入)

- Prompt Template(提示词模板)

- OpenAI Model(OpenAI 模型)

- Chat Output(聊天输出)

4.3.2 Simple Agent(简单智能体)

展示如何构建使用工具的 Agent,包含:

- Agent(智能体)

- Chat Input / Chat Output(聊天输入/输出)

- Calculator(计算器工具)

- URL(URL 工具)

4.3.3 Vector Store RAG(向量存储 RAG)

展示如何构建检索增强生成系统,包含两个子流程:

- 数据加载子流程:加载文档、分块、向量化、存储到向量数据库

- 查询子流程:接收用户查询、检索相关文档、生成答案

4.4 实践:构建第一个简单工作流

我们将从零开始构建一个简单的聊天机器人工作流。

4.4.1 步骤 1:创建空白工作流

- 打开 Langflow

- 在 Projects 页面点击 “New Flow”

- 点击 “Blank Flow”

4.4.2 步骤 2:添加组件

从组件侧边栏拖拽以下组件到画布:

-

Chat Input

- 分类:Inputs

- 用途:接收用户输入

-

Prompt Template

- 分类:Prompts

- 用途:定义提示词模板

-

OpenAI Model

- 分类:LLMs

- 用途:调用 OpenAI 模型

-

Chat Output

- 分类:Outputs

- 用途:输出 AI 响应

4.4.3 步骤 3:配置组件

配置 Chat Input:

- 点击 Chat Input 组件

- 默认配置即可,无需修改

配置 Prompt Template:

- 点击 Prompt Template 组件

- 在 Template 字段中输入:

你是一个友好的助手。请用中文回答用户的问题。

用户问题:{question}

- 确保

question变量在模板中正确使用

配置 OpenAI Model:

- 点击 OpenAI Model 组件

- 在 API Key 字段中输入你的 OpenAI API 密钥

- 或使用全局变量(推荐)

配置 Chat Output:

- 点击 Chat Output 组件

- 默认配置即可,无需修改

4.4.4 步骤 4:连接组件

按照以下顺序连接组件:

- 从 Chat Input 的输出端口(

message)连接到 Prompt Template 的输入端口(question) - 从 Prompt Template 的输出端口(

prompt)连接到 OpenAI Model 的输入端口(input_value) - 从 OpenAI Model 的输出端口(

output)连接到 Chat Output 的输入端口(message)

连接完成后,工作流应该如下所示:

Chat Input ──> Prompt Template ──> OpenAI Model ──> Chat Output

4.4.5 步骤 5:测试工作流

- 点击工具栏的 “Playground” 按钮

- 在输入框中输入问题,如:“你好,请介绍一下你自己”

- 发送消息,查看 AI 的响应

- 尝试不同的问题,测试工作流的功能

4.4.6 步骤 6:保存工作流

- 点击顶部菜单的项目名称

- 选择 “Settings”

- 输入工作流名称,如 “Simple Chatbot”

- 输入描述,如 “基于 OpenAI 的简单聊天机器人”

- 点击 “Save”

工作流会自动保存到当前项目中。

4.5 实践:构建带工具的 Agent 工作流

现在让我们构建一个更复杂的智能体工作流,它可以调用工具来完成任务。

4.5.1 使用 Simple Agent 模板

- 在 Projects 页面点击 “New Flow”

- 选择 “Simple Agent” 模板

模板会自动创建包含以下组件的工作流:

- Agent:智能体组件

- Chat Input:聊天输入

- Chat Output:聊天输出

- Calculator:计算器工具

- URL:URL 工具

4.5.2 配置 Agent

- 点击 Agent 组件

- 在 API Key 字段中输入 OpenAI API 密钥

- 确保 Model Provider 选择 “OpenAI”

- Model Name 选择 “gpt-4o-mini” 或其他可用模型

4.5.3 配置工具

Calculator 工具:

- 点击 Calculator 组件

- 默认配置即可

URL 工具:

- 点击 URL 组件

- 默认配置即可

4.5.4 连接工具到 Agent

Simple Agent 模板已经预配置好了连接,Agent 会自动识别并使用连接的工具。

4.5.5 测试 Agent

- 打开 Playground

- 测试计算功能:“计算 123 乘以 456”

- 测试 URL 功能:“查询今天的新闻”

- 观察 Agent 如何选择和调用工具

Agent 会在 Playground 中显示其推理过程,包括:

- 选择哪个工具

- 工具的调用参数

- 工具的返回结果

- 最终的答案

4.6 实践:构建 RAG 工作流

检索增强生成(RAG)是 Langflow 最重要的应用场景之一。本节演示如何使用 Vector Store RAG 模板构建 RAG 系统。

4.6.1 使用 Vector Store RAG 模板

- 点击 “New Flow”

- 选择 “Vector Store RAG” 模板

模板包含两个子流程:

数据加载子流程:

- File(文件上传)

- Text Splitter(文本分割器)

- Embeddings(向量化)

- Astra DB(向量数据库)

查询子流程:

- Chat Input(聊天输入)

- Astra DB(向量检索)

- Prompt Template(提示词模板)

- OpenAI Model(模型)

- Chat Output(聊天输出)

4.6.2 配置数据加载子流程

-

配置 File 组件:

- 上传一个文档(PDF、TXT 等)

-

配置 Text Splitter:

- Chunk Size:1000(每个文档块的大小)

- Chunk Overlap:200(块之间的重叠)

-

配置 Embeddings:

- API Key:OpenAI API 密钥

- Model:text-embedding-3-small

-

配置 Astra DB:

- API Endpoint:你的 Astra DB 端点

- Application Token:你的 Astra DB 令牌

- Collection Name:创建一个集合名称

4.6.3 运行数据加载

- 点击 File 组件的运行按钮

- 依次运行整个数据加载子流程

- 文档会被分割、向量化并存储到 Astra DB

4.6.4 配置查询子流程

-

配置 Astra DB(检索):

- 使用相同的数据库配置

- Number of Results:3(检索结果数量)

-

配置 Prompt Template:

- 使用提供的模板,包含检索到的文档上下文

-

配置 OpenAI Model:

- 输入 API 密钥

4.6.5 测试 RAG 系统

- 打开 Playground

- 提出与上传文档相关的问题

- 观察 AI 如何检索相关文档并生成答案

4.7 工作流的保存、导出与分享

4.7.1 保存工作流

Langflow 会自动保存工作流。也可以手动保存:

- 点击顶部菜单的项目名称

- 选择 “Settings”

- 修改名称和描述

- 点击 “Save”

4.7.2 导出工作流

有三种导出方式:

方式 1:从 Projects 页面导出

- 在 Projects 页面找到工作流

- 点击 “More” > “Export”

- 选择是否保存 API 密钥

- 文件会下载为

FLOW_NAME.json

方式 2:从 Share 菜单导出

- 打开工作流

- 点击 “Share” > “Export”

- 选择是否保存 API 密钥

方式 3:导出整个项目

- 在 Projects 页面

- 点击项目列表的 “Options” > “Download”

- 所有工作流会打包为 ZIP 文件

4.7.3 导入工作流

方式 1:从 Projects 页面导入

- 在 Projects 页面点击 “Upload a flow”

- 选择 JSON 文件

- 工作流会导入到当前项目

方式 2:拖拽导入

- 将 JSON 文件从文件管理器拖拽到 Langflow 窗口

- 工作流会自动导入

方式 3:导入项目

- 在 Projects 页面点击 “Upload” 按钮

- 选择项目 ZIP 文件

4.7.4 分享工作流

API 访问:

- 点击 “Share” > “API access”

- 选择语言(Python / JavaScript / curl)

- 复制代码片段

- 集成到你的应用中

分享 Playground:

- 点击 “Share” > “Shareable Playground”

- 启用分享

- 复制生成的链接

- 发送给其他用户

注意:Shareable Playground 仅用于测试,不适合生产环境。

嵌入网站:

- 点击 “Share” > “Embed into site”

- 选择框架(HTML / React / Angular)

- 复制嵌入代码

- 添加到你的网站

4.7.5 API 集成示例

Python 示例:

import requests

url = "http://localhost:7860/api/v1/run/YOUR_FLOW_ID"

headers = {

"Content-Type": "application/json",

"x-api-key": "YOUR_LANGFLOW_API_KEY"

}

payload = {

"output_type": "chat",

"input_type": "chat",

"input_value": "你好,请介绍一下你自己"

}

response = requests.post(url, json=payload, headers=headers)

result = response.json()

print(result["outputs"][0]["outputs"][0]["outputs"]["message"]["message"])

JavaScript 示例:

const payload = {

"output_type": "chat",

"input_type": "chat",

"input_value": "你好,请介绍一下你自己"

};

const options = {

method: 'POST',

headers: {

'Content-Type': 'application/json',

'x-api-key': 'YOUR_LANGFLOW_API_KEY'

},

body: JSON.stringify(payload)

};

fetch('http://localhost:7860/api/v1/run/YOUR_FLOW_ID', options)

.then(response => response.json())

.then(response => console.log(response))

.catch(err => console.error(err));

curl 示例:

curl --request POST \

--url 'http://localhost:7860/api/v1/run/YOUR_FLOW_ID?stream=false' \

--header 'Content-Type: application/json' \

--header "x-api-key: YOUR_LANGFLOW_API_KEY" \

--data '{

"output_type": "chat",

"input_type": "chat",

"input_value": "你好,请介绍一下你自己"

}'

4.8 使用 Tweaks 进行运行时参数覆盖

Tweaks 允许在 API 调用时临时修改工作流参数,而不改变工作流本身。

4.8.1 定义 Tweaks

- 点击 “Share” > “API access”

- 点击 “Input Schema”

- 选择要修改的参数

- 代码会自动更新,包含

tweaks对象

4.8.2 使用 Tweaks

示例:切换模型提供商

payload = {

"output_type": "chat",

"input_type": "chat",

"input_value": "hello world!",

"tweaks": {

"OpenAI-abc": {

"model_name": "gpt-4o",

"temperature": 0.7

}

}

}

4.8.3 Tweaks 的优势

- 不修改工作流配置

- 适用于单次请求

- 可以测试不同参数组合

- 便于 A/B 测试

5. 高级应用

本节介绍 Langflow 的高级功能,包括自定义组件开发、外部系统集成、批量处理等。

5.1 自定义组件开发

Langflow 允许开发者创建自定义组件,扩展框架功能。

5.1.1 自定义组件结构

自定义组件是继承自 langflow.custom.Component 的 Python 类,包含以下元素:

- Display Name:显示名称

- Description:描述信息

- Icon:图标

- Inputs:输入定义

- Outputs:输出定义

- Methods:处理方法

5.1.2 最小示例

创建一个简单的自定义组件 custom_component.py:

from langflow import CustomComponent

from langflow.schema import Message

class MyCustomComponent(CustomComponent):

display_name = "My Custom Component"

description = "A simple custom component example"

icon = "⚡"

name = "my_custom_component"

inputs = [

TextInput(name="input_value", display_name="Input Text")

]

outputs = [

Output(name="output_value", display_name="Output Message", method="build")

]

def build(self, input_value: str) -> Message:

# 处理逻辑

result = f"Processed: {input_value}"

return Message(text=result)

5.1.3 目录结构要求

自定义组件必须放在特定的目录结构中才能被 Langflow 识别:

/app/custom_components/

└── helpers/ # 类别文件夹

├── __init__.py # 必需

└── custom_component.py # 组件文件

设置环境变量:

export LANGFLOW_COMPONENTS_PATH='["/app/custom_components"]'

5.1.4 动态字段

可以使用动态字段根据用户选择显示或隐藏配置项。

from langflow import CustomComponent

from langflow.io import TextInput, DropdownInput

class DynamicFieldComponent(CustomComponent):

display_name = "Dynamic Field Component"

inputs = [

DropdownInput(

name="data_type",

display_name="Data Type",

options=["time_series", "static"],

real_time_refresh=True

),

TextInput(

name="timestamp_col",

display_name="Timestamp Column",

dynamic=True

)

]

def update_build_config(self, build_config):

data_type = self.data_type

if data_type == "time_series":

build_config["timestamp_col"]["required"] = True

build_config["timestamp_col"]["advanced"] = False

else:

build_config["timestamp_col"]["required"] = False

build_config["timestamp_col"]["advanced"] = True

return build_config

def build(self, data_type: str, timestamp_col: str = None):

# 处理逻辑

return data_type, timestamp_col

5.1.5 错误处理与日志

from langflow import CustomComponent

from langflow.schema import Message, Data

class RobustComponent(CustomComponent):

def build(self, input_value: str) -> Message:

try:

# 输入验证

if not input_value:

self.status = "Empty input"

return Message(text="Please provide input")

# 记录日志

self.log(f"Processing: {input_value}")

# 处理逻辑

result = self.process(input_value)

self.status = "Success"

return Message(text=result)

except Exception as e:

self.log(f"Error: {str(e)}")

self.status = "Error"

return Data(data={"error": str(e)})

5.1.6 在 Docker 中使用自定义组件

构建自定义镜像:

FROM langflowai/langflow:latest

WORKDIR /app

COPY custom_components /app/custom_components

ENV LANGFLOW_COMPONENTS_PATH=/app/custom_components

# 如果有额外依赖

COPY requirements.txt /app/requirements.txt

RUN pip install -r /app/requirements.txt

构建并运行:

docker build -t my-langflow .

docker run -d -p 7860:7860 my-langflow

挂载卷(无需重新构建):

docker run -d \

-p 7860:7860 \

-v /path/to/custom_components:/app/custom_components \

-e LANGFLOW_COMPONENTS_PATH=/app/custom_components \

langflowai/langflow:latest

5.2 与外部系统集成

5.2.1 连接数据库

Langflow 支持多种数据库集成:

PostgreSQL:

uv pip install "langflow[postgresql]"

Astra DB(DataStax):

使用 Astra DB 组件,需要:

- API Endpoint

- Application Token

- Collection Name

Redis:

使用 Redis 组件作为向量存储或缓存。

5.2.2 调用外部 API

使用 URL 组件:

可以发送 HTTP 请求并获取响应。

创建自定义 API 组件:

import requests

from langflow import CustomComponent

from langflow.schema import Message

class APIRequestComponent(CustomComponent):

display_name = "API Request"

inputs = [

TextInput(name="api_url", display_name="API URL", required=True),

TextInput(name="headers", display_name="Headers (JSON)"),

IntInput(name="timeout", display_name="Timeout", value=10)

]

def build(self, api_url: str, input_text: str, headers: str = None, timeout: int = 10) -> Message:

try:

hdrs = {'Content-Type': 'text/plain'}

if headers:

import json

hdrs.update(json.loads(headers))

response = requests.post(api_url, data=input_text.encode('utf-8'), headers=hdrs, timeout=timeout)

response.raise_for_status()

return Message(text=response.text)

except Exception as e:

return Message(text=f"Error: {str(e)}")

5.2.3 文件处理

Langflow 支持多种文件格式:

支持的格式:

- DOCX

- TXT

- Markdown

- JSON

- CSV

使用 File 组件:

- 添加 File 组件到工作流

- 配置文件上传选项

- 后续组件可以处理文件内容

高级文档解析(1.6+):

使用 Docling 集成进行高级文档解析。

5.2.4 Webhook 集成

创建 Webhook 端点,接收来自外部系统的请求。

- 添加 Webhook Input 组件

- 配置 Webhook 端点

- Langflow 会生成一个 URL

- 外部系统可以向该 URL 发送请求

5.3 批量处理

5.3.1 使用循环组件

Langflow 1.8+ 提供了循环功能,可以批量处理数据。

示例:批量处理多个文档:

- 使用 File 组件上传多个文件

- 使用 Loop 组件遍历文件列表

- 对每个文件执行相同处理

- 收集所有结果

5.3.2 并行处理

通过配置 Agent 或使用多个并行分支,实现并行处理。

5.4 高级调试技巧

5.4.1 使用 Traces(1.8+)

Langflow 1.8 引入了 Traces 功能,可以记录详细的执行轨迹。

启用 Traces:

- 打开工作流

- 点击工具栏的 Traces 按钮

- 运行工作流

- 查看详细的执行日志,包括:

- 组件执行顺序

- 输入输出数据

- 执行时间

- Token 使用量

5.4.2 使用检查面板(1.8+)

检查面板可以实时查看组件的内部状态。

- 运行工作流

- 点击任意组件

- 查看输入、输出、日志和状态

5.4.3 日志查看

组件级日志:

每个组件都会生成日志,可以在组件详情中查看。

项目级日志:

- 点击顶部菜单的项目名称

- 选择 “Logs”

- 查看整个项目的日志

系统级日志:

查看 Langflow 服务器的运行日志,定位系统级问题。

5.4.4 组件单独运行

运行单个组件,查看其输出,帮助调试特定部分。

- 点击组件右上角的运行按钮

- 查看输出结果

- 验证组件逻辑是否正确

5.5 MCP Server(Model Context Protocol)

Langflow 可以作为 MCP Server,将工作流作为工具暴露给 MCP 客户端。

5.5.1 启用 MCP Server

- 打开项目

- 点击 “MCP Server” 标签

- 配置认证(无认证 / API Key / OAuth)

- 启动 MCP Server

5.5.2 使用 OAuth 认证(1.6+)

- 在 MCP Server 设置中选择 OAuth

- 配置 OAuth 提供商

- 输入 Client ID 和 Client Secret

- 设置授权 URL 和 Token URL

- 启动 MCP Composer 服务器

5.5.3 连接 MCP 客户端

Langflow 工作流会作为工具显示在支持 MCP 的客户端中,如:

- Claude Desktop

- Cursor

- Windsurf

5.6 知识库(1.8+)

知识库是存储在 Langflow 内部的本地向量数据库,便于在工作流中直接使用向量数据。

创建知识库:

- 在 Settings 中选择 “Knowledge Bases”

- 点击 “Add New”

- 上传文档或输入文本

- 配置向量化参数

- 创建知识库

使用知识库:

在 Astra DB 或其他向量存储组件中,选择已创建的知识库。

5.7 可观察性集成

Langflow 支持与多个可观察性平台集成:

5.7.1 LangSmith

-

设置环境变量:

export LANGCHAIN_TRACING_V2=true export LANGCHAIN_API_KEY="your-langsmith-api-key" export LANGCHAIN_PROJECT="your-project-name" -

重启 Langflow

5.7.2 Langfuse

-

设置环境变量:

export LANGFUSE_PUBLIC_KEY="your-public-key" export LANGFUSE_SECRET_KEY="your-secret-key" export LANGFUSE_HOST="https://cloud.langfuse.com" -

重启 Langflow

5.7.3 LangWatch

-

设置环境变量:

export LANGWATCH_API_KEY="your-api-key" -

重启 Langflow

5.7.4 Traceloop(1.6+)

-

设置环境变量:

export TRACeloop_API_KEY="your-api-key" -

重启 Langflow

5.8 性能优化

5.8.1 使用缓存

启用组件缓存可以避免重复计算。

- 点击组件菜单

- 选择 “Freeze”

- 组件输出会被缓存

5.8.2 优化向量化

- 使用较小的嵌入模型(如 text-embedding-3-small)

- 调整文档块大小

- 使用本地向量存储

5.8.3 批量处理

使用循环或并行处理提高吞吐量。

5.8.4 使用更快的模型

- 对于简单任务,使用较小的模型(如 gpt-4o-mini)

- 对于复杂任务,使用较大的模型(如 gpt-4o)

5.9 安全最佳实践

5.9.1 使用全局变量

不要在工作流中硬编码 API 密钥,使用全局变量管理敏感信息。

5.9.2 定期更新

及时更新到最新版本,修复安全漏洞。

5.9.3 访问控制

在生产环境中,配置适当的访问控制:

- 使用 Langflow API Keys

- 配置 OAuth 认证

- 使用防火墙和网络隔离

5.9.4 审计日志

启用日志记录,监控工作流的使用情况。

5.10 生产部署

5.10.1 Docker 部署

使用 Docker 部署确保环境一致性。

推荐配置:

version: '3.8'

services:

langflow:

image: langflowai/langflow:latest

container_name: langflow

ports:

- "7860:7860"

environment:

- LANGFLOW_HOST=0.0.0.0

- LANGFLOW_PORT=7860

- LANGFLOW_LOG_LEVEL=INFO

volumes:

- ./data:/app/data

- ./custom_components:/app/custom_components

restart: unless-stopped

healthcheck:

test: ["CMD", "curl", "-f", "http://localhost:7860/health"]

interval: 30s

timeout: 10s

retries: 3

5.10.2 Kubernetes 部署

使用官方 Helm Chart 部署:

helm repo add langflow https://langflow-ai.github.io/langflow-helm-charts

helm install langflow langflow/langflow

5.10.3 负载均衡

使用 Nginx 或云服务负载均衡器分发请求。

5.10.4 数据库配置

在生产环境中,使用外部数据库:

- PostgreSQL(推荐)

- MySQL

设置环境变量:

export LANGFLOW_DATABASE_URL="postgresql://user:password@host:port/database"

5.10.5 备份策略

定期备份:

- 工作流定义(导出 JSON)

- 数据库

- 自定义组件

- 知识库

6. 资源与社区

本节汇总了 Langflow 的官方资源、社区支持和学习资料。

6.1 官方资源

6.1.1 官方网站

- 官方网站:https://www.langflow.org/

- 官方文档:https://docs.langflow.org/

- 官方博客:https://www.langflow.org/blog/

6.1.2 GitHub 仓库

- 主仓库:https://github.com/langflow-ai/langflow

- Stars:146,000+(截至 2026 年 3 月)

- 许可协议:MIT

相关仓库:

- Langflow Helm Charts:https://github.com/langflow-ai/langflow-helm-charts

- Langflow Embedded Chat:https://github.com/langflow-ai/langflow-embedded-chat

- Langflow Client TypeScript:https://github.com/langflow-ai/langflow-client-ts

6.1.3 PyPI 包

- 包名:langflow

- 最新版本:1.8.0(截至 2026 年 3 月 6 日)

- 链接:https://pypi.org/project/langflow/

6.2 社区支持

6.2.1 Discord

- Langflow Discord 服务器:https://discord.gg/EqksyE2EX9

- 用途:实时支持、讨论、展示项目

- 语言:英语为主

6.2.2 GitHub Discussions

- 链接:https://github.com/langflow-ai/langflow/discussions

- 用途:提出问题、分享想法、投票、展示项目

6.2.3 GitHub Issues

- 链接:https://github.com/langflow-ai/langflow/issues

- 用途:报告 Bug、跟踪任务、请求功能

6.2.4 社交媒体

- X (Twitter):https://x.com/langflow_ai

- YouTube:https://www.youtube.com/@Langflow

- LinkedIn:搜索 Langflow

6.3 学习资源

6.3.1 官方文档

快速开始:

概念文档:

API 文档:

高级主题:

6.3.2 视频教程

- LangFlow Full Course For Beginners(Tech With Tim):https://www.youtube.com/watch?v=kBG5dQe394w

- Build a RAG Based LLM App in 20 Minutes!:https://www.youtube.com/watch?v=qaEVUhoKS8M

- Langflow 官方 YouTube 频道:https://www.youtube.com/@Langflow

6.3.3 博客文章

- DataCamp 教程:https://www.datacamp.com/tutorial/langflow

- Medium 文章:Building RAG Systems with Langflow

6.3.4 Langflow Academy

- 链接:https://langflow.academy/

- 用途:官方学习平台,提供结构化的学习路径

6.4 集成与生态

6.4.1 支持的 LLM 提供商

- OpenAI

- Anthropic (Claude)

- Azure OpenAI

- Groq

- HuggingFace

- Mistral

- Ollama

- LiteLLM

6.4.2 支持的向量数据库

- Astra DB(DataStax)

- Pinecone

- Weaviate

- Qdrant

- Milvus

- Chroma

- Redis

- Couchbase

6.4.3 支持的工具集成

- Airbyte(数据集成)

- Composio(工具集成)

- Gmail, Google Drive

- Notion

- Slack

- Wikipedia

- Wolfram Alpha

- Tavily(搜索)

6.5 常见问题解答(FAQ)

6.5.1 安装问题

Q: 安装时遇到 Microsoft C++ Build Tools 错误怎么办?

A: 请按照第 2.8.1 节的解决方案安装 Visual Studio Build Tools。

Q: 端口被占用怎么办?

A: 使用 langflow run --port 7861 指定其他端口。

6.5.2 使用问题

Q: 如何备份我的工作流?

A: 在 Projects 页面点击 “Options” > “Download” 导出项目。

Q: 如何迁移到新版本?

A: 参考官方发布说明(Release Notes),建议先导出工作流,升级后再导入。

6.5.3 技术问题

Q: Langflow 支持哪些 Python 版本?

A: macOS/Linux: 3.10-3.13,Windows: 3.10-3.12。

Q: 如何配置全局变量?

A: Settings > Global Variables > Add New。

6.5.4 安全问题

Q: 如何安全地管理 API 密钥?

A: 使用全局变量存储 API 密钥,不要硬编码在工作流中。

Q: Langflow 的安全公告在哪里?

A: https://github.com/langflow-ai/langflow/security/advisories

6.6 贡献指南

6.6.1 如何贡献

Langflow 欢迎所有类型的贡献:

- 报告 Bug

- 提出新功能建议

- 提交代码(PR)

- 改进文档

- 创建模板

- 分享示例

贡献流程:

- Fork 仓库

- 创建分支

- 提交更改

- 发起 Pull Request

6.6.2 代码规范

- 遵循 PEP 8 Python 代码规范

- 添加适当的测试

- 更新文档

- 遵守向后兼容性原则

6.6.3 行为准则

Langflow 遵守贡献者契约行为准则:

- 尊重他人

- 善于合作

- 关注社区利益

6.7 发布历史

6.7.1 最新版本(1.8.0)

发布日期:2026 年 3 月 6 日

主要更新:

- 全局模型提供商设置

- V2 工作流 API(beta)

- Traces 功能

- 检查面板

- 知识库(本地向量数据库)

- Mustache 模板支持

- 新组件:Agentics、Guardrails、LiteLLM

- 模块化依赖安装(langflow-base)

6.7.2 之前的重要版本

1.6.0(2025 年 10 月 2 日):

- OAuth for MCP

- OpenAI Responses API 兼容

- 高级文档解析(Docling)

- Traceloop 集成

1.5.1(2025 年 8 月):

- 修复 CVE-2025-57760

1.3.0(2025 年 4 月):

- 修复 CVE-2025-3248

完整发布历史:Release Notes

6.8 企业支持

6.8.1 DataStax Langflow Cloud

- 链接:https://www.langflow.org/

- 特点:

- 免费账户可用

- 企业级安全性

- 与 Astra DB 深度集成

- 自动备份和升级

- SLA 支持

6.8.2 培训与咨询

DataStax 提供专业的培训和企业咨询服务。

6.9 案例研究

6.9.1 真实应用案例

- NVIDIA:Langflow Enables Local AI Agents on RTX PCs

- BetterUp:加速产品创意快速落地

- WinWeb:简化 RAG 应用开发

- Athena Intelligence:改变 AI 工作流迭代方式

6.9.2 技术博客

6.10 相关工具对比

| 特性 | Langflow | Flowise | n8n | Make |

|---|---|---|---|---|

| 开源 | ✅ MIT | ✅ MIT | ✅ | ❌ |

| LLM 支持 | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐ | ⭐⭐ |

| RAG 支持 | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐ | ⭐⭐ |

| Agent 支持 | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐ | ⭐⭐ |

| 自定义组件 | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐ |

| API 集成 | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ |

| 学习曲线 | ⭐⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐ | ⭐⭐⭐⭐⭐ |

| 社区活跃度 | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐ |

结语

Langflow 是一个功能强大且不断发展的开源 AI 应用开发框架。通过本指南,你应该已经掌握了:

- Langflow 的核心概念和功能

- 在不同操作系统上的安装方法

- 界面布局和基本操作

- 构建和测试工作流的完整流程

- 高级功能如自定义组件、外部系统集成等

- 官方资源和社区支持渠道

下一步学习建议

-

实践项目:

- 构建一个 RAG 聊天机器人

- 创建一个多智能体应用

- 开发自定义组件

-

深入探索:

- 阅读 Langflow 源代码

- 参与 GitHub 讨论

- 贡献代码或文档

-

社区参与:

- 加入 Discord 服务器

- 分享你的项目

- 帮助其他用户

-

持续学习:

- 关注官方博客和发布说明

- 观看 YouTube 教程

- 阅读社区案例

获取帮助

如果在学习过程中遇到问题,可以通过以下方式获取帮助:

- 查看 官方文档

- 搜索 GitHub Issues

- 加入 Discord 社区

- 发布在 GitHub Discussions

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献19条内容

已为社区贡献19条内容

所有评论(0)