IP验证中跑cases常见问题

1.在本地单独跑某个case常遇到的错误:

搭建仿真环境

选择适合的仿真工具(如 Modelsim、VCS、QuestaSim 等),确保工具链支持目标 IP 的仿真需求。配置仿真环境变量,设置正确的库路径和编译选项。创建仿真工程,导入 IP 核的 RTL 代码和仿真模型(如 FPGA 厂商提供的库或第三方模型)。

编写测试激励

根据 IP 的功能规格设计测试用例,编写测试激励文件(Testbench)。测试激励应覆盖正常功能、边界条件和异常场景。使用 SystemVerilog 或 VHDL 的验证特性(如约束随机、断言)提高测试效率。确保测试激励能够自动检查结果并生成报告。

编译与仿真

编译 RTL 代码和测试激励文件,确保无语法错误。启动仿真工具,加载编译后的设计。设置仿真时间或触发条件(如测试完成标志),运行仿真。监控仿真日志和波形,检查是否符合预期行为。

调试与验证

分析仿真结果,定位设计或测试激励的问题。使用波形工具(如 GTKWave)查看信号时序,验证关键路径。如果发现问题,修改 RTL 或测试激励后重新仿真,直到所有测试用例通过。记录测试覆盖率(行覆盖、状态机覆盖等),确保覆盖率达到要求。

自动化与回归测试

将测试流程脚本化(如 Makefile 或 Python 脚本),实现一键编译、仿真和报告生成。建立回归测试机制,确保修改后的 IP 不影响原有功能。集成持续集成(CI)工具(如 Jenkins),定期运行测试用例并通知结果。

而在这个过程中,常见问题有编译错误,比如RTL代码bug ,位宽错误,文件缺少,命名错误,变量未声明就使用。

待编译成功后,就会进入到仿真阶段,仿真阶段首先是环境中设置的uvm_fatal或者约束条件,如果case中触发了fatal的条件或者约束求解失败(针对约束求解失败,不同的仿真工具报错方式不同,所以出现仿真失败),都会失败。而看似仿真正常运行的测试用例,依旧会有一些情况出现,比如env或者rtl有死循环,或或者一些wait @等语句,等不到期望的结果,会导致仿真超时timeout。

当然以上说的是作为verifier经常遇到的正常情况,除此之外,仿真还会遇到一些特殊情况,比如磁盘满了,提交到服务器的任务被管理员kill掉。

除了以上提到的RTL和env以及工具和磁盘错误,还有golden model出现错误,参考模型里面的打印信息可能没有记录到仿真log里,需要在调用参考模型时,将打印信息记录到log中,并对log检查;

接下来我们看看一些常见的错误以及解决办法:

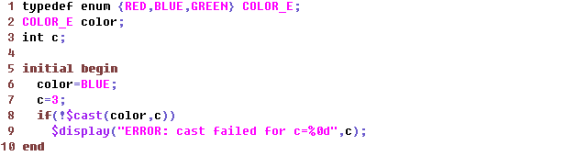

1,排查类型转换错误

(1) 常见问题是将int变量直接复制给一个枚举变量,类型转换失败;

(2) 解决办法:对不同类型赋值时,尽量使用$cast转换;

2.预防DUT空转

(1) 检查激励有效性;

(2) 对monitor和scoreboard内的关键信号或数据检查进行计数,在final_phase里判断这些计数器是否为0;

2。在TB中常用的检测相关错误的方法

(1)最常见的莫过于通过monitor,检查相关信号,如果不符合预期uvm_warning,uvm_fatal和uvm_fatal,打印到log中。

(2)其次通过断言,检查相关行为。

1. 需求理解不透彻

- 问题表现:验证人员没有完全理解设计需求,导致测试用例覆盖不完整,遗漏关键场景。例如,在 IC 验证中,对一些复杂的协议规范理解有误,使得验证环境无法检测到设计在特定协议交互下的错误。

- 解决办法:

- 在项目初期,验证团队与设计团队进行深入沟通,确保对需求文档中的每一个细节都理解清晰。对于模糊或不明确的地方,及时向相关人员提出并确认。

- 验证人员自己梳理需求,将其转化为可测试的条件和场景,并与设计人员进行核对。可以采用需求跟踪矩阵(RTM),将每个需求与对应的测试用例关联起来,确保需求无遗漏。

2. 边界条件和异常情况处理不当

- 问题表现:只关注正常功能的验证,忽略了边界值(如最大值、最小值、极限条件)以及异常情况(如电源故障、数据溢出、非法输入等)的测试。比如在软件测试中,没有对输入框可接受的最大字符数进行边界测试,导致用户输入超长字符时软件崩溃。

- 解决办法:

- 专门针对边界条件设计测试用例。例如,对于一个整数范围为 0 到 100 的变量,测试用例应包括 0、100、 - 1(稍小于下限)、101(稍大于上限)等边界值。

- 系统地分析可能出现的异常情况,并为每种异常设计相应的测试用例。在 IC 验证中,可以通过注入错误信号来模拟异常情况,如在总线上故意发送错误的地址信号,观察设计的响应。

3. 复用代码和组件的问题

- 问题表现:在验证环境中复用已有的代码或组件时,没有充分考虑其适用性和兼容性。例如,复用了一个之前项目中的验证组件,但该组件的接口或功能在新的项目中有细微变化,却未进行相应调整,导致验证结果不准确。

- 解决办法:

- 在复用代码或组件前,对其进行全面审查,确保其功能与新的验证需求完全匹配。如果有部分不匹配,评估修改的可行性和影响范围。

- 对复用的组件进行独立测试,确保其在新环境中的正确性。同时,建立复用组件的版本管理和文档记录,明确其适用范围和已知问题。

4. 验证环境搭建不完善

- 问题表现:验证环境不能准确模拟真实的工作场景,导致一些在实际应用中会出现的问题无法在验证阶段发现。例如,在网络芯片验证中,验证环境未能准确模拟网络拥塞、丢包等复杂的网络状况。

- 解决办法:

- 深入了解设计的实际应用场景,与应用工程师或市场人员沟通,获取更多关于实际使用情况的信息,以此来完善验证环境。

- 在验证环境中添加必要的激励生成模块和监测模块,能够模拟各种复杂的输入情况,并实时监测设计的输出。例如,在模拟网络环境时,可以使用专门的网络仿真工具来生成不同的网络流量模型。

5. 忽视代码质量和可维护性

- 问题表现:为了快速完成验证任务,编写的验证代码结构混乱、缺乏注释,导致后续维护和扩展困难。当需要修改或添加测试用例时,花费大量时间理解代码逻辑。

- 解决办法:

- 遵循良好的编程规范,无论是硬件描述语言(如 Verilog、VHDL)还是软件编程语言(如 Python、C++)。例如,在 Verilog 代码中,使用一致的缩进和命名规则,提高代码可读性。

- 编写详细的注释,解释关键代码段的功能和设计意图。特别是对于复杂的算法、状态机或数据处理逻辑,注释尤为重要。定期对验证代码进行代码审查,及时发现并纠正不良的代码习惯。

6. 缺乏有效的覆盖率分析

- 问题表现:没有对验证的覆盖率进行有效跟踪和分析,无法确定验证工作是否充分。例如,虽然编写了大量测试用例,但某些代码分支或功能点从未被执行到,导致潜在问题未被发现。

- 解决办法:

- 使用专业的覆盖率分析工具,如在 IC 验证中使用代码覆盖率工具(如 NCVerilog 的覆盖率分析功能),在软件测试中使用类似 Gcov 的工具。这些工具可以详细统计代码覆盖率、功能覆盖率等指标。

- 根据覆盖率分析结果,针对性地补充测试用例,确保关键代码和功能都得到充分验证。同时,将覆盖率指标纳入验证计划和报告中,作为衡量验证工作完成度的重要依据。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)