掌握多智能体架构:AI系统设计进阶指南,5种模式详解及实战案例!

本文探讨了在构建复杂AI系统时,何时从单智能体架构转向多智能体架构的必要性,并详细介绍了五种多智能体设计模式:子智能体、移交、技能、路由和自定义工作流。文章强调了上下文管理、分布式开发和任务并行化是引入多智能体架构的核心驱动力,并通过Handoffs模式的实战案例展示了如何实现上下文工程。最后,文章提出了根据不同需求选择合适模式的选型原则,旨在帮助开发者更高效地设计AI系统。

01 前言

在构建复杂的 AI 系统时,架构设计的原则依然适用:如果单智能体(Single Agent)配合合适的提示词和工具就能解决问题,请永远优先选择单智能体。单智能体架构简单、调试容易且 Token 成本更低。

然而,当单Agent达到极限——例如 Agent 需要处理几十个工具导致决策失误,或是在庞大的上下文中迷失方向时,我们才真正需要引入多智能体架构。

02 核心驱动

引入多智能体架构的核心驱动力在于以下三个方面:

1、上下文管理(Context Management):

现实中上下文窗口并非无限,多智能体允许进行上下文隔离,只向特定 Agent 展示其所需的专门知识,避免模型被冗余信息淹没。

2、分布式开发(Distributed Development)

允许不同团队独立开发和维护各自的子智能体(如“搜索 Agent”和“写入 Agent”),最后通过清晰的边界组合成大系统。

3、任务并行化(Parallelization)

可以同时启动多个专门的 worker 并发执行子任务(如并行调研不同主题),大幅提高系统响应速度。

03 多智能体架构

根据 LangChain 官方实践,多智能体设计主要分为以下五种模式。

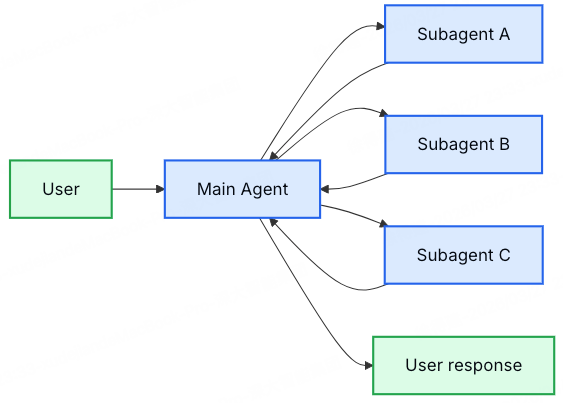

1、子智能体模式 (Subagents)

一个中心化的**主智能体(Supervisor)**通过将子智能体作为“工具”来协调它们。主智能体决定调用哪个子智能体、提供什么输入,并负责汇总结果。

**使用场景:**个人助理系统,主 Agent 根据需求分别调用“日历 Agent”和“邮件 Agent”。

核心特点:

-

中心化控制:所有路由都经过主智能体,由其进行跨轮次的动态调度。

-

上下文隔离:子智能体在干净的窗口运行,完成后仅返回结果,防止主对话历史过于臃肿。

-

并行执行:主智能体可以在单次交互中并行调用多个子智能体执行独立任务。

2、移交模式 (Handoffs)

控制权在 Agent 间动态转移。工具调用会更新状态变量(如 active_agent变量),系统依据该变量切换不同的 Agent 或调整配置。

使用场景:客服流程中,基础客服在验证身份后,将赔偿问题转交给“销售专家”。

核心特点:

-

状态驱动:行为系统的行为和配置根据当前的状态变量动态调整。

-

持久化状态:状态信息在对话轮次之间持久存在,支持复杂的长程对话流。

-

顺序约束:适合强制执行特定阶段的流程,只有满足前置条件(如输入保修 ID)才解锁后续能力。

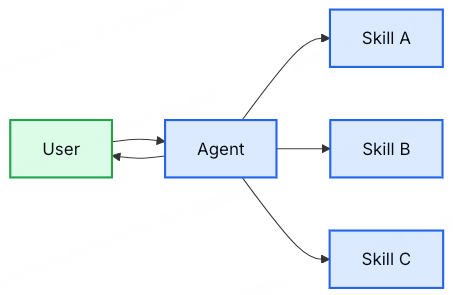

3、技能模式 (Skills)

单一 Agent 保持控制权,但根据上下文按需加载专门的提示词和领域知识(渐进式披露)。

为什么把Skills列为一种架构模式呢?

Skills的渐进式披露机制规避了初始 Prompt 过长导致的注意力涣散,本质是将能力模块化为可组合的工具单元,让 Agent 能按需调用,从而形成“能力编排”的结构,而不是单一流程。

使用场景:全能编程助手,根据用户询问的语言(如 Python 或 Rust)动态加载对应的技术文档。

核心特点:

-

提示词驱动特化:技能本质上是包装好的专门提示词,用于增强 Agent 行为。

-

渐进式披露:技能仅在需要时被检索并加载,保持系统初始运行的轻量化。

-

分形设计支持:技能可以定义嵌套的子技能,形成树状结构的专业知识组织。

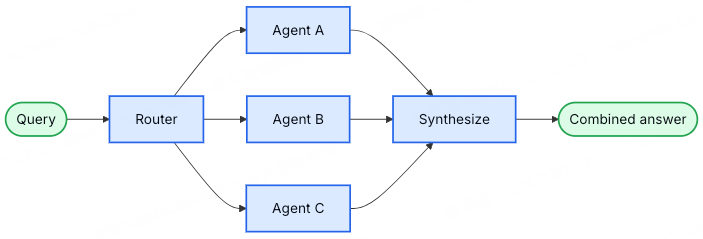

4、路由模式 (Router)

通过分类步骤(通常是单一 LLM 调用)识别用户意图,并将请求引导至零个或多个垂直领域 Agent,最后汇总结果。

**使用场景:**多源知识库查询,同时从 GitHub、Notion 和 Slack 获取信息并合成答案。

核心特点:

-

查询拆解与分发:路由步骤负责将复杂查询分解并分派给最合适的专业节点。

-

并行扇出:支持同时调用多个子 Agent 并行处理,显著降低整体延迟。

-

合成回复:所有并行分支的结果最终由一个节点合成连贯、统一的最终回答。

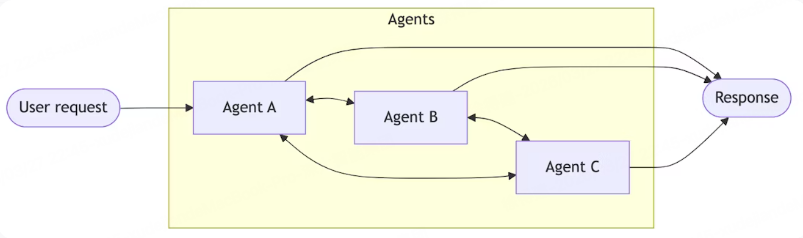

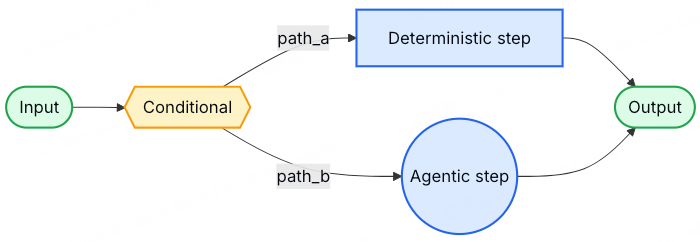

5、自定义工作流 (Custom Workflow)

使用 LangGraph 完全自主定义执行流,混合确定性逻辑(代码)和智能体行为,支持循环和条件分支。

使用场景:评估者-优化者 (Evaluator-Optimizer) 模式,一个节点生成结果,另一个评估其质量,未通过则循环重试。

核心特点:

-

完全的结构控制:开发者拥有对图结构的绝对控制权,可定义任意的循环、分支和并行路径。

-

确定性与动态性结合:能够将严谨的代码步骤与动态的 LLM 推理节点无缝缝合

-

模式组合:支持将上述子智能体、路由等模式作为工作流中的一个节点进行嵌套使用。

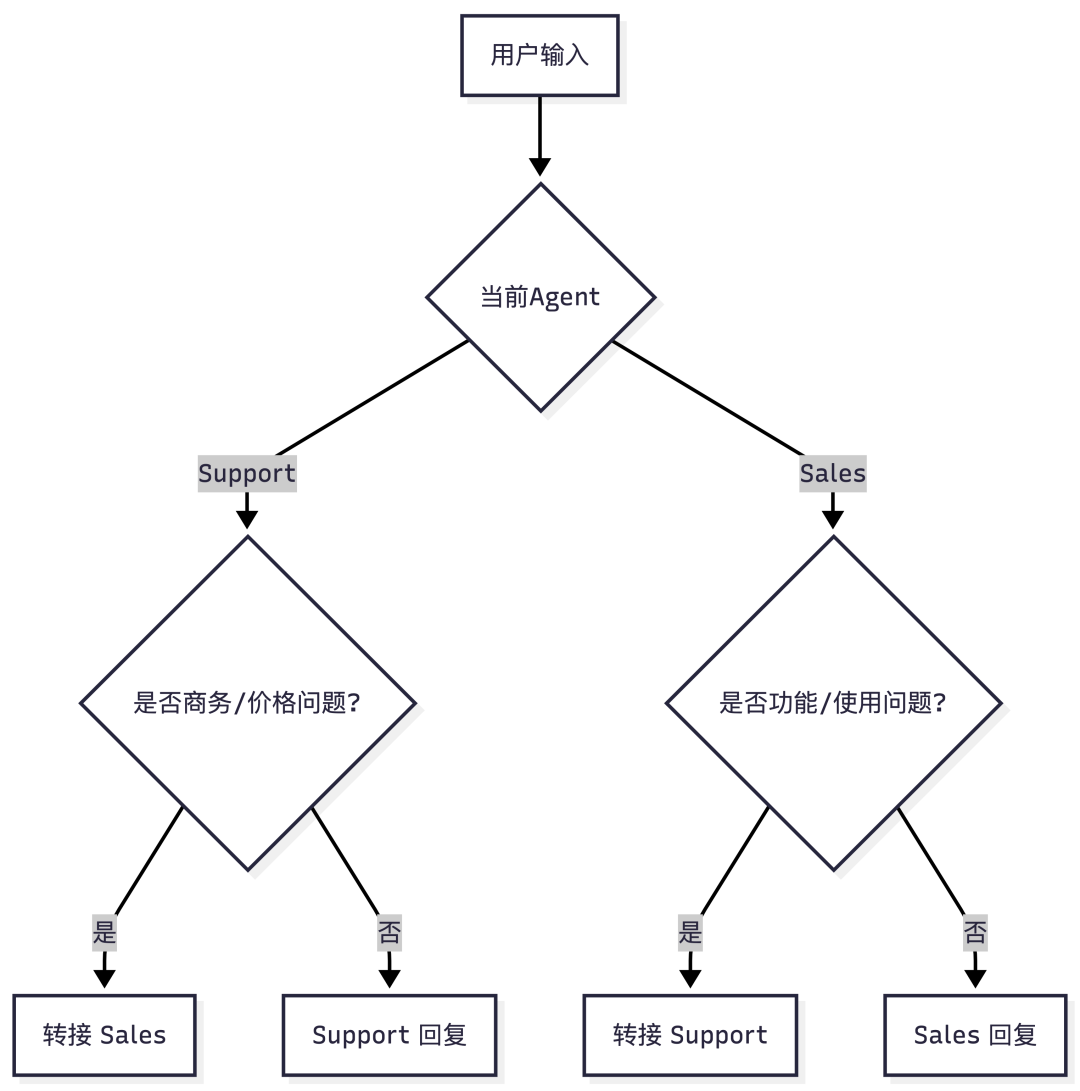

04 实战 - Handoffs模式实现

Handoffs 的核心技术难点在于上下文工程**(****Context Engineering)**。当从 Agent A 切换到 Agent B 时,必须确保对话历史的完整性。

一个示例:

import os

from typing import List, Literal, Optional

from pydantic import BaseModel

from langchain.chat_models import init_chat_model

from langchain_core.messages import HumanMessage, SystemMessage, AIMessage

# =========================

# 1. 定义结构化输出

# =========================

classAgentDecision(BaseModel):

"""

action:

- respond: 直接回复用户

- handoff: 转接给另一个 agent

target:

- Sales / Support(转接目标)

content:

- 回复内容(当 action=respond 时使用)

"""

action: Literal["respond", "handoff"]

target: Optional[Literal["Sales", "Support"]] = None

content: Optional[str] = None

# =========================

# 2. 初始化模型

# =========================

os.environ["DEEPSEEK_API_KEY"] = "sk-..."

base_llm = init_chat_model(

model="deepseek-chat",

temperature=0

)

# 👇 结构化输出模型

decision_llm = base_llm.with_structured_output(AgentDecision)

# =========================

# 3. Support Agent

# =========================

defsupport_agent(messages: List):

"""

客服:

- 普通问题直接回答

- 涉及退款 / 赔偿 / 商务 → 转 Sales

"""

decision = decision_llm.invoke(

[

SystemMessage(

content=(

"你是客服(Support)。\n\n"

"规则:\n"

"1. 普通咨询 → respond\n"

"2. 涉及退款、赔偿、补偿、价格、商务 → handoff 到 Sales\n\n"

"必须严格输出结构化结果。"

)

)

] + messages

)

return decision

# =========================

# 4. Sales Agent(支持转回)

# =========================

defsales_agent(messages: List):

"""

销售:

- 处理赔偿 / 退款 / 商务

- 如果问题变回普通咨询 → 转回 Support

"""

decision = decision_llm.invoke(

[

SystemMessage(

content=(

"你是销售(Sales)。\n\n"

"规则:\n"

"1. 赔偿 / 退款 / 价格 → respond\n"

"2. 普通使用问题 / 技术问题 → handoff 到 Support\n\n"

"必须严格输出结构化结果。"

)

)

] + messages

)

return decision

# =========================

# 5. 会话状态

# =========================

state = {

"messages": [],

"current_agent": "Support"

}

# =========================

# 6. 单轮执行(核心)

# =========================

defrun_turn(user_input: str):

"""

多 Agent 执行流程:

1. 当前 agent 做决策

2. 如果 handoff → 切换 agent

3. 再执行一次(直到得到 respond)

"""

state["messages"].append(HumanMessage(content=user_input))

whileTrue:

# ===== 当前是 Support =====

if state["current_agent"] == "Support":

decision = support_agent(state["messages"])

# ===== 当前是 Sales =====

else:

decision = sales_agent(state["messages"])

# ====== 如果需要转接 ======

if decision.action == "handoff":

print(f"👉 转接到 {decision.target}")

state["current_agent"] = decision.target

# ⚠️ 注意:continue 重新让新 agent 决策

continue

# ====== 如果是正常回复 ======

else:

response = AIMessage(content=decision.content)

state["messages"].append(response)

return response

# =========================

# 7. 运行

# =========================

if __name__ == "__main__":

print("输入 exit 退出\n")

whileTrue:

user_input = input("用户:")

if user_input.lower() in ["exit", "quit"]:

break

resp = run_turn(user_input)

print("AI:", resp.content)

print("当前Agent:", state["current_agent"])

示例首先定义了AgentDecision模型,用于结构化输出;然后初始化LLM,这里用的DeepSeek,并绑定结构化输出;定义两个Agent客户和销售;然后定义state记录会话内容:消息和当前的agent;最后定义执行流程和流转逻辑,并通过模型输出来判断下一步的Agent,这里状态会记录当前Agent,下一轮会默认进入该Agent。

测试输入和输出示例如下,省略了AI输出内容:

用户:你们这个套餐多少钱?

👉 转接到 Sales

AI: 省略AI输出

当前Agent: Sales

用户:这个功能怎么开启?

👉 转接到 Support

AI: 省略AI输出

当前Agent: Support

用户:如果买企业版可以便宜点吗?

👉 转接到 Sales

AI: 省略AI输出

当前Agent: Sales

核心流程图如下:

05 总结

掌握多智能体架构,本质上是学会用代码定义 AI 的思考路径。

在选型时请参考以下选型原则:

- 如果追求重复请求的高效能:选择 Handoffs 或Skills,它们通过持久化状态可节省约 40-50% 的模型调用。

- 如果需要多领域并行研究:选择 Subagents 或Router,它们在处理多语言对比等任务时,能通过上下文隔离节省约 60% 的 Token 消耗。

- 如果流程极其严谨且复杂:选择 Custom Workflow,利用其对确定性步骤(如评估、过滤)的掌控力来确保系统安全可控。

AI行业迎来前所未有的爆发式增长:从DeepSeek百万年薪招聘AI研究员,到百度、阿里、腾讯等大厂疯狂布局AI Agent,再到国家政策大力扶持数字经济和AI人才培养,所有信号都在告诉我们:AI的黄金十年,真的来了!

在行业火爆之下,AI人才争夺战也日趋白热化,其就业前景一片蓝海!

我给大家准备了一份全套的《AI大模型零基础入门+进阶学习资源包》,包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。😝有需要的小伙伴,可以VX扫描下方二维码免费领取🆓

人才缺口巨大

人力资源社会保障部有关报告显示,据测算,当前,****我国人工智能人才缺口超过500万,****供求比例达1∶10。脉脉最新数据也显示:AI新发岗位量较去年初暴增29倍,超1000家AI企业释放7.2万+岗位……

单拿今年的秋招来说,各互联网大厂释放出来的招聘信息中,我们就能感受到AI浪潮,比如百度90%的技术岗都与AI相关!

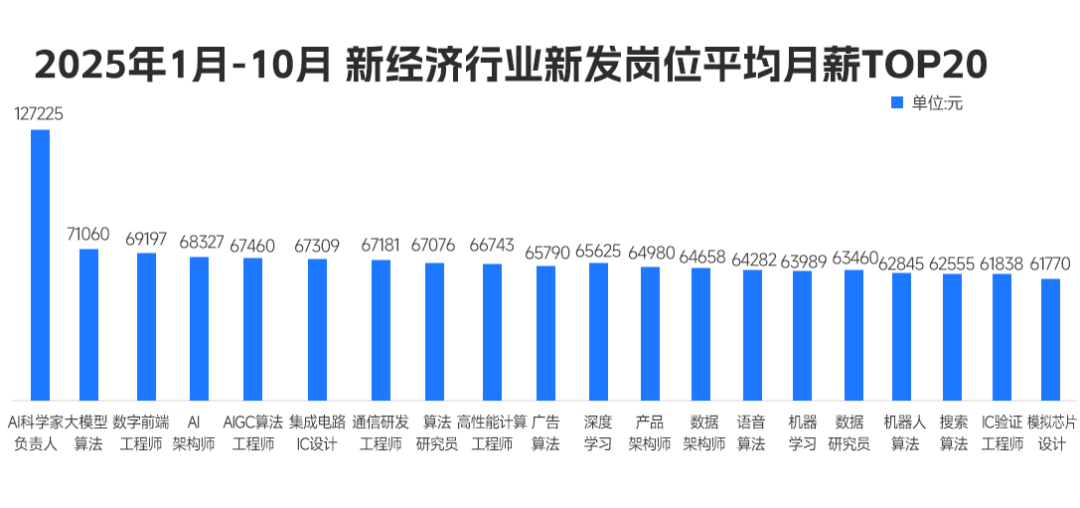

就业薪资超高

在旺盛的市场需求下,AI岗位不仅招聘量大,薪资待遇更是“一骑绝尘”。企业为抢AI核心人才,薪资给的非常慷慨,过去一年,懂AI的人才普遍涨薪40%+!

脉脉高聘发布的《2025年度人才迁徙报告》显示,在2025年1月-10月的高薪岗位Top20排行中,AI相关岗位占了绝大多数,并且平均薪资月薪都超过6w!

在去年的秋招中,小红书给算法相关岗位的薪资为50k起,字节开出228万元的超高年薪,据《2025年秋季校园招聘白皮书》,AI算法类平均年薪达36.9万,遥遥领先其他行业!

总结来说,当前人工智能岗位需求多,薪资高,前景好。在职场里,选对赛道就能赢在起跑线。抓住AI风口,轻松实现高薪就业!

但现实却是,仍有很多同学不知道如何抓住AI机遇,会遇到很多就业难题,比如:

❌ 技术过时:只会CRUD的开发者,在AI浪潮中沦为“职场裸奔者”;

❌ 薪资停滞:初级岗位内卷到白菜价,传统开发3年经验薪资涨幅不足15%;

❌ 转型无门:想学AI却找不到系统路径,83%自学党中途放弃。

他们的就业难题解决问题的关键在于:不仅要选对赛道,更要跟对老师!

我给大家准备了一份全套的《AI大模型零基础入门+进阶学习资源包》,包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。😝有需要的小伙伴,可以VX扫描下方二维码免费领取🆓

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献136条内容

已为社区贡献136条内容

所有评论(0)