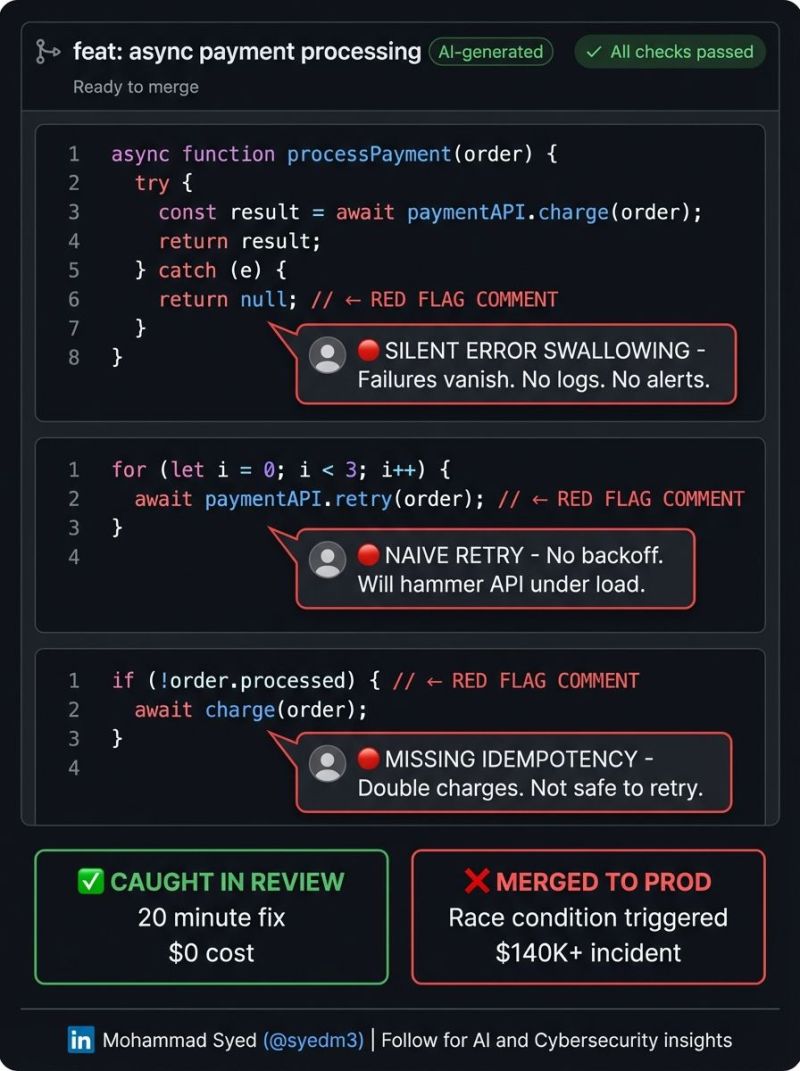

从 14 万美元支付事故看:AI 写的代码过了所有测试,为什么活不过生产?

我审计过的一家科技公司,曾因一段 AI 生成的异步支付处理代码,遭遇了一场灾难性的生产事故。这段代码完美通过了所有自动化检查、单元测试与集成测试,标注着「All checks passed」被顺利合并到生产环境,最终却触发了竞态条件与重复扣款,造成了超 14 万美元的直接资金损失,连带用户投诉、品牌声誉受损与合规风险,后续补救成本更是难以估量。

这绝非孤例。在我的审计生涯中,已经在 6 个完全不同的团队、不同架构的代码库中,见过完全一致的失败模式:AI 生成的业务代码,永远能轻松通过预设的测试用例,却永远在生产环境的真实流量中栽跟头。而修复这些致命问题,往往只需要 20 分钟的代码评审;可一旦漏过,代价就是六位数的真金白银。

很多人说「资深工程师比 AI 慢」,但这从一开始就错了。二者从来不是在比「写代码的速度」,而是在看完全不同的东西:AI 写代码,目标是实现功能、通过测试;资深工程师写代码,目标是让它在复杂、混乱、不可控的生产环境中活下来。

三段致命代码:AI 写的 Happy Path,生产里的定时炸弹

那张标注着「Ready to merge」的 PR 截图,藏着 AI 生成代码最典型的三个致命缺陷,也是绝大多数支付系统事故的直接导火索。每一段代码都语法正确、逻辑通顺,却在生产环境中埋下了必然爆炸的地雷。

静默吞错:让故障彻底隐身的黑盒

javascript

运行

async function processPayment(order) {

try {

const result = await paymentAPI.charge(order);

return result;

} catch (e) {

return null; // ← RED FLAG COMMENT

}

}

这段代码最致命的问题,是SILENT ERROR SWALLOWING(静默异常吞噬)。AI 知道异步支付调用需要异常处理,于是加上了 try/catch 块,让代码不会直接抛出未捕获异常、顺利通过测试;但它完全不懂生产环境的故障追踪逻辑 ——catch 块中没有错误日志、没有监控告警、没有异常上报,只返回了一个 null。

在测试环境中,我们只会验证「支付成功返回正确结果」「支付失败返回异常值」,这段代码完美符合预期。但到了生产环境,灾难就发生了:当支付渠道返回参数错误、风控拦截、网络超时等异常时,错误被完全吞掉,研发团队完全不知道故障发生。用户反馈「扣了钱却没生成订单」,运维人员排查时没有任何日志线索,既不知道错误原因,也不知道有多少用户遭遇了同样的问题,故障持续时间被无限拉长,资金损失与用户投诉持续累积。

更可怕的是,静默吞错会造成上下游数据不一致。上层业务逻辑会把 null 当成「支付失败」处理,可实际情况可能是支付渠道已经扣款、只是回调异常,最终导致「钱扣了,订单却关了」的不可逆事故,而团队连复盘的依据都没有。

天真重试:压垮系统的流量雪崩

javascript

运行

for (let i = 0; i < 3; i++) {

await paymentAPI.retry(order); // ← RED FLAG COMMENT

}

这段代码的问题,是NAIVE RETRY(无策略的天真重试)。AI 知道支付失败需要重试来提升成功率,于是写了一个三次循环的重试逻辑,在测试环境中,API 永远秒响应、无负载,重试逻辑百试百灵。但它完全不懂分布式系统的容错设计,不知道生产环境的超时故障,绝大多数都源于服务过载。

当支付渠道出现短暂抖动、服务响应变慢时,大量支付请求会同时触发超时,进入重试逻辑。这段没有任何退避策略的代码,会瞬间给已经过载的支付 API 发送 3 倍的流量,直接触发服务雪崩:本来只是部分用户支付超时,最终演变成整个支付集群被打垮,全量支付业务彻底不可用。更严重的是,无节制的重试会触发支付渠道的风控限流,甚至导致整个公司的支付商户号被封禁,造成长达数小时甚至数天的业务停摆。

这种故障,在单节点、低负载的测试环境中永远无法复现,只有在生产环境的高并发流量下,才会瞬间引爆。

缺失幂等性:真金白银的双重扣款灾难

javascript

运行

if (!order.processed) { // ← RED FLAG COMMENT

await charge(order);

}

这是整段 PR 中最致命的一行代码,也是 14 万美元事故的直接元凶 ——MISSING IDEMPOTENCY(幂等性缺失)。AI 只做了最简单的状态判断:如果订单未支付,就执行扣款。它默认所有请求都是串行执行的,状态是干净、一致、无并发冲突的,却完全忽略了生产环境最核心的风险:并发竞态条件。

在测试环境中,我们的用例都是串行发起的,永远不会出现两个请求同时处理同一个订单的情况,这段代码永远能正常执行。但在生产环境中,同一个订单的支付请求,可能会因为用户重复点击、webhook 回调重试、异步任务重试、网络重发等场景,同时发起多个并发请求。当两个请求同时读取到order.processed = false时,会同时进入扣款逻辑,发起两次charge调用,最终造成双重扣款。

支付场景中,幂等性是不可逾越的红线。一次双重扣款,损失的是几十到几千美元;而高并发场景下的大规模重复扣款,造成的就是六位数甚至七位数的直接资金损失,还会触发支付合规监管的处罚,甚至直接断送一家公司的生命线。

五个高频致命模式:AI 代码的生产级陷阱

这三段代码暴露的问题,只是冰山一角。在无数次审计与代码评审中,我总结出了 AI 生成业务代码时,必然会踩中的 5 个高频致命模式,它们有一个共同的特点:完美通过测试,必然在生产中爆炸。

1. 异步流中的竞态条件:被 AI 忽略的并发边缘场景

AI 最擅长写同步、串行的 Happy Path,却对异步流程中的并发风险几乎零感知。它生成的异步代码,永远默认异步操作会按书写顺序完成,却完全忽略了生产环境中的网络延迟、GC 停顿、负载波动、调度延迟,都会彻底打乱异步代码的执行顺序,触发竞态条件。

比如订单履约流程中,AI 生成的代码会先异步扣减库存、再异步更新订单状态,却没有做任何并发控制。生产环境中,扣库存的异步操作因为网络延迟变慢,更新订单状态的操作先完成,就会出现「订单已完成,库存却没扣」的超卖事故。

更致命的是,竞态条件是单元测试最难覆盖的风险。测试环境很难模拟生产级的并发场景,绝大多数测试用例都是串行执行的,永远不会触发竞态条件。只有当代码上线后,在高并发流量中才会暴露,而此时已经造成了不可逆的业务损失。

2. 静默异常吞噬:让故障隐身的完美犯罪

AI 生成代码时,有一个根深蒂固的偏好:为了让代码「不报错、能跑通」,会无脑添加 try/catch 块,捕获所有异常,却不做任何日志、告警、上报处理。这就是静默吞错,它是生产环境中最隐蔽的故障杀手。

测试环境中,我们只会验证功能是否正常,很少会覆盖所有异常分支;而 AI 生成的测试用例,也只会聚焦于 Happy Path,不会专门验证异常处理逻辑。这就导致,代码中的静默吞错永远不会被测试发现,直到上线后,故障在生产中持续发生,团队却完全不知情。

在业务系统中,异常不是麻烦,而是我们发现问题、定位故障的唯一线索。吞掉异常,等于蒙住了运维与研发的眼睛,让小故障慢慢发酵成大事故,最终彻底失控。

3. 天真重试逻辑:从容错到灾难的放大器

重试是分布式系统中最基础的容错手段,却也是 AI 生成代码中最容易被滥用的逻辑。AI 只知道「失败了要重试」,却完全不懂重试的核心设计原则:无退避不重试、无熔断不重试、无幂等不重试。

除了无退避重试造成的流量雪崩,AI 还经常写出「无限重试」的逻辑,比如在 while 循环中不停重试,直到成功为止。生产环境中,如果下游服务出现永久性故障,这种无限重试会把所有可用的线程池占满,导致整个服务的其他业务也被阻塞,最终引发全服务宕机。

更可怕的是,无幂等的重试,会直接放大资金损失。比如支付请求已经扣款成功,只是返回超时,AI 生成的重试逻辑会再次发起扣款,每重试一次,就多一次重复扣款,把原本的小故障,放大成大规模的资金事故。

4. 错误的状态假设:AI 的理想世界 vs 生产的脏数据

AI 训练所用的代码,绝大多数都是干净的 Demo、规范的示例,默认数据是规范的、状态是一致的、字段是完整的。但真实的生产环境,从来都不是理想的干净世界 —— 一个运行了 3 年的业务系统,必然存在历史遗留的脏数据、老版本代码生成的不规范记录、异常流程导致的中间状态、字段缺失与格式错误的数据。

AI 生成的代码,永远会假设order.amount一定是数字、user.phone一定是正确的格式、订单状态只有「未支付」和「已支付」两种。但生产环境中,老订单的amount可能是 null,用户手机号可能有特殊字符,订单还有「支付中」「退款中」「异常关闭」「风控拦截」等十几种中间状态。

这些错误的状态假设,会导致代码在测试环境中完美运行,到了生产环境中,遇到脏数据就直接抛出空指针异常、格式错误,导致业务流程崩溃,甚至引发整个服务的连锁故障。

5. 幂等性缺失:支付系统的生死红线

幂等性,是指同一个请求,无论执行多少次,最终的结果都完全一致,不会产生重复处理、重复扣款、重复下单的副作用。这是支付、订单、webhook、API 回调等写操作场景的生死红线,却也是 AI 生成代码最容易忽略的核心设计。

AI 永远不会主动考虑幂等性,除非你在 Prompt 中明确、强制要求。它只会按照需求的字面意思,实现「请求来了就处理」的逻辑,却完全不考虑生产环境中,请求重复、重试、重发是常态。没有幂等性保证的写操作代码,上线就等于埋雷,爆炸只是时间问题。

更危险的是,幂等性缺失导致的故障,测试环境几乎无法发现。只有在生产环境的并发请求、重试场景中才会触发,而一旦触发,就是真金白银的直接损失,很多时候甚至无法挽回 —— 你可以给用户退款,却无法挽回用户的信任,更无法规避支付合规的处罚。

核心真相:AI 过的是测试,工程师守的是生产

为什么 AI 生成的代码,永远能轻松通过测试,却屡屡在生产中翻车?核心原因,是二者的优化目标从一开始就完全不同。

AI 的训练目标,是生成「语法正确、逻辑通顺、符合需求字面意思、能通过预设测试」的代码。它的核心能力是模仿与拼接,是把已有的代码片段,按照你的需求组合起来,实现功能。它不知道什么是生产环境的高并发,不知道什么是分布式系统的雪崩,不知道什么是业务的合规风险,更不知道一行代码写错,会给公司带来多大的损失。它只关心「这段代码能不能跑通,能不能通过测试」。

而资深工程师的核心价值,从来不是写代码的速度,而是风险预判能力。他们写代码的时候,80% 的精力都在想:这段代码在什么情况下会挂?并发请求来了会不会出问题?下游服务超时了怎么办?用户重复点击了怎么处理?脏数据进来了会不会崩溃?异常发生了能不能快速定位?

这就是二者最本质的区别:AI 写的是 Happy Path,工程师写的是故障防御;AI 追求的是「通过测试」,工程师追求的是「活过生产」;AI 解决的是「功能能不能实现」,工程师解决的是「系统会不会炸」。

很多团队陷入了一个误区:AI 写代码太快了,代码评审太耽误时间,反正测试都过了,直接合并就行。但他们没算明白一笔账:20 分钟的代码评审,成本不过是一个资深工程师几十美元的工时;而一次生产级的支付事故,直接损失就是六位数,连带的用户流失、品牌受损、合规处罚,更是无法用金钱衡量。

破局之道:让 AI 成为工具,而不是背锅侠

AI 从来不是洪水猛兽,它是强大的研发提效工具。但我们必须清醒地认识到:提效的前提,是安全。想要让 AI 生成的代码安全落地到生产环境,我们必须建立一套完整的防护体系,守住生产的底线。

第一,把 5 个致命模式,强制加入 PR 评审模板

这是成本最低、效果最好的防护手段。把本文提到的 5 个高频致命模式,做成强制勾选的 PR 评审检查项,每一个 AI 生成的 PR,都必须完成以下检查,才能合并:

- 异步代码是否存在竞态条件?是否有并发控制、执行顺序保障?

- 异常处理是否存在静默吞错?是否有完整的错误日志、监控告警、异常上报?

- 重试逻辑是否有指数退避、抖动、熔断、最大重试次数限制?是否配合幂等性设计?

- 代码是否做了防御性编程?是否处理了空值、脏数据、异常状态、边界场景?

- 所有写操作、支付接口、webhook 回调,是否有完善的幂等性保障?

第二,针对 AI 代码,做专门的生产级测试

单元测试只能验证功能是否实现,无法覆盖生产环境的真实风险。针对 AI 生成的代码,必须补充 4 类专项测试:

- 并发压测:模拟生产级的并发请求,验证代码的竞态条件与幂等性,确保并发场景下不会出现重复处理、数据不一致;

- 混沌测试:主动注入下游服务超时、宕机、网络抖动等故障,验证重试逻辑、异常处理是否合理,会不会引发服务雪崩;

- 脏数据测试:用脱敏后的生产历史数据跑测试,验证代码对异常状态、不规范数据的兼容性,避免上线后触发空指针、格式错误;

- 故障注入测试:主动抛出异常,验证异常是否被正确捕获、日志是否完整输出、告警是否正常触发,杜绝静默吞错。

第三,给 AI 加约束,写 Prompt 时就守住安全底线

想要让 AI 生成安全的代码,就要在 Prompt 中明确、强制地加入生产级约束,而不是只说「实现一个支付处理函数」。一个合格的生产级代码 Prompt,必须包含以下要求:

- 所有异常必须有完整的日志记录、错误分级与告警上报,禁止任何形式的静默吞错;

- 重试逻辑必须带指数退避与随机抖动,设置最大重试次数,配合熔断机制,无幂等性不重试;

- 所有写操作必须保证幂等性,使用唯一幂等键、分布式锁与状态机控制,禁止重复处理;

- 必须做全量的防御性编程,处理所有可能的空值、异常格式、脏数据与边界场景;

- 异步流程必须考虑并发竞态条件,做好并发控制,确保执行顺序与数据一致性。

结尾:过了测试的代码,不代表能上生产

那个 14 万美元的支付事故,给所有用 AI 写代码的团队敲响了警钟:AI 能帮你写代码,却不能帮你承担生产事故的责任。能实现功能的代码,不代表是好代码;过了所有测试的代码,更不代表是能上生产的代码。

AI 时代,资深工程师的价值,从来不是比谁写代码更快。而是他们见过无数次生产爆炸,知道哪里有坑,哪里有雷,知道一行看似不起眼的代码,会引发什么样的灾难性后果。他们不是慢,而是在为整个系统的安全负责。

永远不要为了省 20 分钟的代码评审,去赌公司的生死。AI 写的代码,越是能轻松通过所有测试,你越要警惕 —— 那些没被测试覆盖到的边缘场景,那些被 AI 忽略的生产级风险,就是埋在系统里的定时炸弹。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献45条内容

已为社区贡献45条内容

所有评论(0)