一文搞懂决定AI智能体成败的“驾驭工程” (Harness Engineering)

如果你经常使用 Cursor、Claude Code 或者尝试自己手搓一个 AI 智能体(Agent),你大概率经历过以下令人崩溃的时刻:

AI 信心满满地改了一段代码,结果引发了连环报错;你让它修复,它开始陷入“疯狂重试-继续报错”的死亡循环;或者当项目文件稍微多一点时,它就像个失忆症患者,不仅忘了之前的需求,还把你原本正常的代码改得面目全非。

这时,你的第一反应往往是:“这模型太笨了”,或者“我得去改改我的提示词(Prompt)”。

停下来,你可能全搞错了。

导致 AI 表现糟糕的原因,往往不是模型智商不够,而是你没有为它提供一个正确的“工作环境”。

今天,我们将揭开 2026 年 AI 领域最重要的技术分水岭——Harness Engineering(驾驭工程)。它解释了为什么OpenAI团队能用几个工程师让 AI 写出 100 万行生产级代码,而你却还在为 AI 无法完成一次代码重构而疯狂抓头发。

1. 从“施法者”到“架构师”:AI 范式的三次跃迁

在理解 Harness 之前,我们需要看看 AI 交互方式是如何演变的:

-

2023年 - 提示工程(Prompt Engineering): 我们像个“施法者”,每天都在研究怎么用神奇的词汇(比如“深呼吸”、“一步步思考”)从黑盒子里骗出正确的答案。

-

2025年 - 上下文工程(Context Engineering): 我们变成了“数据策展人”,通过 RAG(检索增强生成)和向量数据库,拼命给 AI 喂资料,解决“模型应该看什么”的问题。

-

2026年 - 驾驭工程(Harness Engineering): 游戏规则变了。我们升级为“系统架构师”,不再只盯着提示词,而是关注整个工作流的编排、内存管理、工具集成和反馈验证。

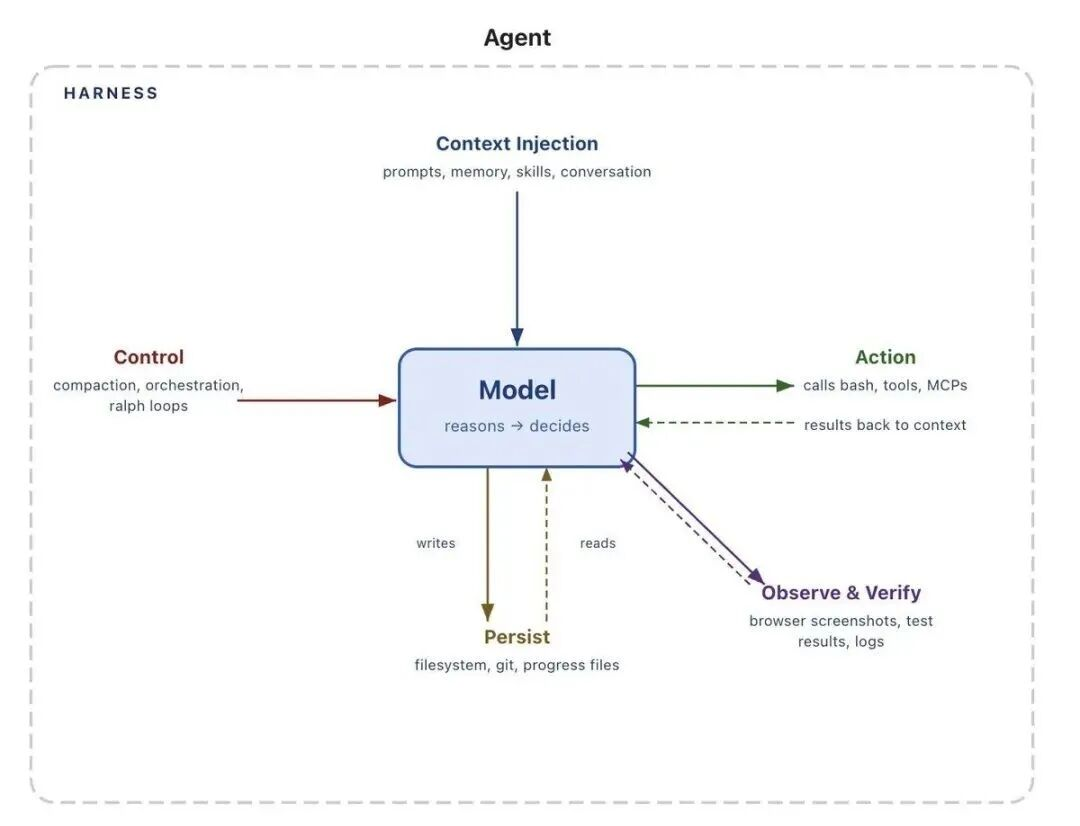

什么是 Harness?借用马具的隐喻:大模型是一匹力大无穷但容易失控的“野马”,而 Harness 就是包含缰绳、马鞍、眼罩的“控制系统”。 一句话定义 Harness(鞍具),就是 AI Agent 的"工作环境和规则手册"。 Harness Engineering(驾驭工程),就是设计这套环境,让 Agent 少犯错、多干活、干好活。 这个概念由 Mitchell Hashimoto(HashiCorp 创始人)和 Viv(LangChain 工程师)在 2026 年初几乎同时提出,随后 OpenAI、Anthropic、Martin Fowler 等都在一周内密集发文响应,成为 AI 工程领域最热门的话题之一。

在智能体时代,决定系统上限的公式已经变成:

Agent=Model(s)+HarnessAgent = Model(s) + HarnessAgent=Model(s)+Harness

模型提供智能,Harness 让这个智能可以用起来。

2. 为什么 AI 会变“笨”?(提示词解决不了的三个惨案)

很多人对 AI 有一个致命的误解:把上下文窗口(Context Window)当成了电脑的内存(RAM)。

你以为资料塞得越多,AI 就越懂你。实际上,上下文更像是 AI 极其有限的“工作注意力”。噪音一旦过多,它的智商就会断崖式下跌。

-

惨案一:被信息“淹死”。 普林斯顿大学的 SWE-agent 研究发现,如果让 AI 用普通的

grep命令去代码库里搜索,一旦返回上万行结果,AI 就会彻底迷失,最终卡死。 -

惨案二:没有即时反馈的“盲写”。 AI 改错了一个标点,但环境没有立刻报错拦截。AI 跑了全套测试后发现不通过,它根本不知道是刚才那个标点的问题,于是开始胡乱修改其他正确的代码,越改越错。(来源:Mitchell Hashimoto)

-

惨案三:跨会话的“假装完工”。 跑了几个会话后,后来的 Agent 看到已经有一些代码了,就宣布"这个项目已经完成了”,然后停止工作。实际上只完成了 30%。(来源:Anthropic)。

3. Harness Engineering 到底解决了什么?

Harness 工程的核心,就是为 AI 戴上“防呆眼镜”和“安全护具”。最前沿的团队(如 OpenAI 和 Anthropic)是这样做的:

💡 技巧一:渐进式披露(拒绝给 AI 塞整本说明书)

千万别弄一个长达几万字的 AGENTS.md 文件让 AI 一次性读完。好的 Harness 设计是提供一个类似目录的“小地图”。AI 一开始只看大纲,遇到具体任务时,系统才动态把特定模块的文档喂给它。这就好比给人指路,你只需要告诉他“前面路口左转”,而不是把整个城市的地图拍在他脸上。

💡 技巧二:构建“沉默”的验证护栏

Anthropic 的 SWE-agent 论文证实,给 AI 提供一个带有“自动格式检查(Linting)”的编辑器极其关键。

在 Harness 系统中,AI 每次修改代码,后台会立刻静默运行类型检查。成功了就保持沉默;失败了才把具体的报错行扔回给 AI。 这种“立刻被打脸”的极速反馈循环,能把低级错误掐死在摇篮里。

💡 技巧三:强制的“状态锚点”

为了解决 AI “装死”和跨进度协作的问题,Anthropic 的设计非常精妙:他们引入了一个 JSON 格式的“功能清单”(Feature List)和一个进度记录文件(Progress File)。

AI 每次上工第一件事,不是去读代码,而是去读这个进度表;下班前最后一件事,必须是提交干净的 Git 代码,并把进度表里的“Pass(通过)”状态改为 True。没有任何推理和猜想,只有白纸黑字的机械化交接。

4. 你的代码护城河,已经不再是“写代码”了

普林斯顿大学的实验给出了一个震撼的数据:在完全不改变大模型本身的前提下,仅仅通过重构这套交互环境(Harness),AI 解决真实 GitHub Issue 的成功率相对提升了 64%。

而 OpenAI 更是靠着不到 7 个人的工程师团队,利用极致的 Harness 设计,在 5 个月内让 AI 自动生成了超过 100 万行生产级代码,合并了 1500 个 PR,期间没有一行代码是人类手写的。

这对普通开发者和技术 Leader 意味着什么?

-

岗位重塑: 你的主要工作不再是写代码(执行层已经是廉价的大宗商品),重心应该是设计环境。

-

思维转换: 当 AI 出错时,不要再问“我该怎么改提示词?”,而是问“这个工作环境里缺失了什么机制,才导致 AI 犯了这个错?”。

-

商业护城河: 最强大的基础大模型正在快速同质化和降价。真正的壁垒在于你能否构建出一套深度整合“模型+Harness”的系统。谁掌握了 Harness 工程,谁就掌握了 AI 时代的“全自动工厂”。

5. 现在就行动:给你自己做一个“极简版 Harness”

你不需要马上搞一套极其复杂的架构。如果你正在开发自己的 AI 智能体,或者用 AI 辅助写一个大项目,今天就可以加上这两个设定:

-

在工作区根目录建一个

AGENTS.md。在系统提示词里规定:“每次对话开始前先阅读它,结束前必须总结你做了什么并更新它。” -

建一个包含验收标准的

feature_list.json,强迫 AI 用结构化的状态(True/False)来判断任务是否做完,而不是靠看代码“脑补”。

模型负责“思考(Reasoning)”,但 Harness 决定了它能“想清楚什么(What to reason about)”。

别再抱怨你的 AI 太笨了,先给它配一副好马鞍吧。

👇欢迎加入智能体老王的AI群,共同探讨AI话题和技术

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)