把它当Claude用,放进“龙虾”里干活到底行不行?实测报告来了!

文章目录

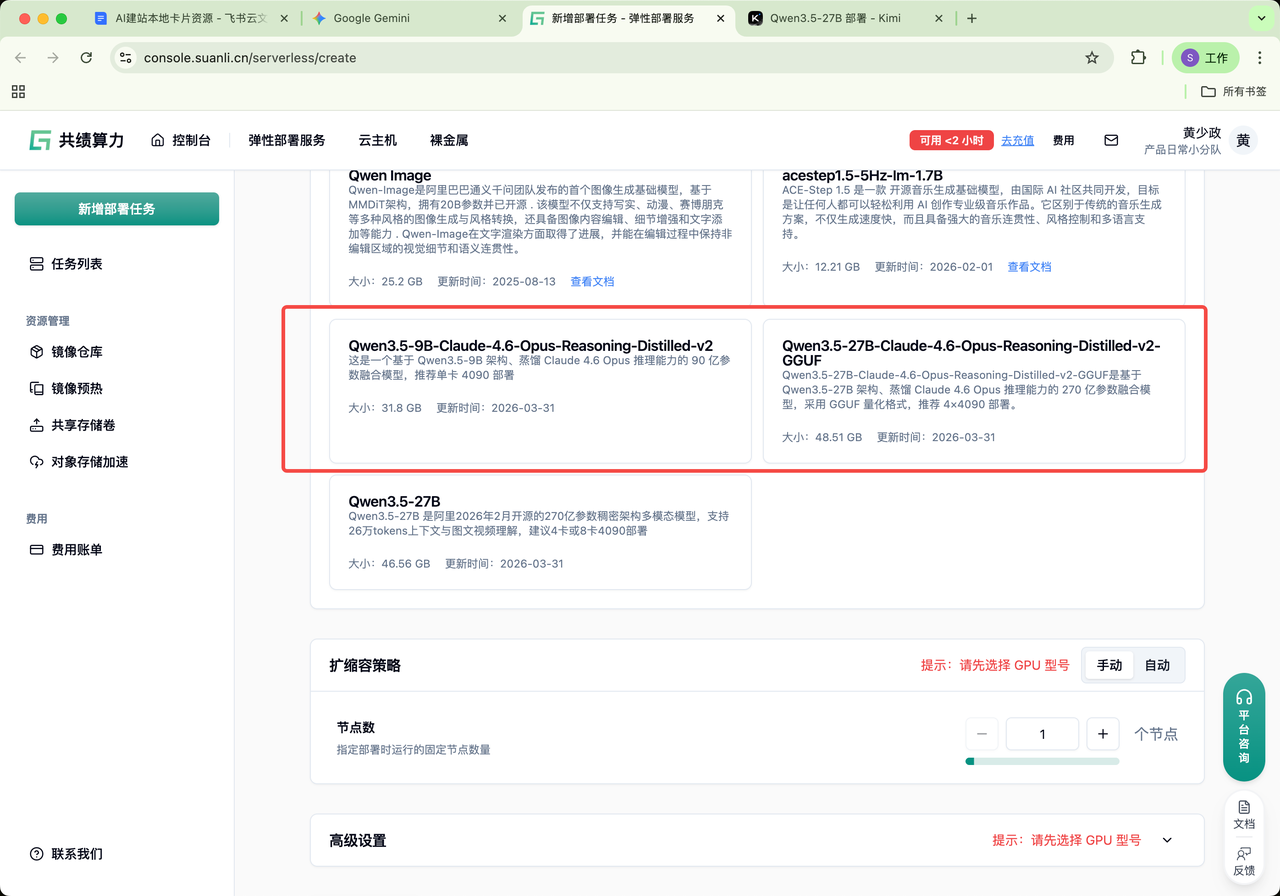

最近,我们团队干了一件事:将两款号称“Claude风格”的推理蒸馏模型——Qwopus 9B 和 Qwopus 27B,塞进了OpenClaw(龙虾)这个能跑工具、能执行工作流的Agent框架里。

我们想回答一个最实际的问题:

它到底是不是个合格的“Claude平替”?能不能在我们自己的自动化流程里,像Claude一样拆解任务、调用工具、稳定输出?

经过一系列真实场景的调用测试,我们发现:

如果你想要一个便宜的聊天机器人,它可能不是首选;但如果你需要一个能集成到内部工作流、专注任务拆解与执行的“主脑”,那它在共绩算力上的表现,会给你惊喜。

01 它是什么?一句话说清楚

一句话概括:这类模型的核心价值,不是模仿Claude的聊天语气,而是学习它的“思考方式”。

这意味着,它最擅长的是那些需要“先想清楚,再动手”的场景:

-

复杂任务拆解:面对一个大目标,能自动规划出可行步骤。

-

结构化推理:输出有逻辑层次,而不是天马行空的散文。

-

工具调用判断:在调用API或执行命令前,能先判断“该不该调用”、“怎么调用更好”。

-

分析与规划:在代码生成、流程设计、风险评估等场景,表现更接近工程师的思维方式。

所以,别把它当成普通的聊天模型。它更像一个专为“工作流”打造的智能引擎,尤其适合嵌入像OpenClaw这样的Agent框架中,成为驱动整个自动化流程的“决策中枢”。

02 为什么它天生适合“龙虾”(OpenClaw)?

因为OpenClaw这类Agent框架,考验的从来不是“一句话回答得多漂亮”,而是模型能否胜任一整套“感知-思考-行动”的循环:

-

理解:准确理解用户的最终意图。

-

规划:将意图拆解为可执行的具体步骤。

-

决策:判断何时、如何调用工具(如搜索、计算、读写文件)。

-

整合:将工具返回的结果整理成用户需要的最终输出。

而这,恰好是Qwopus这类“推理蒸馏模型”被训练出的强项。当它成为OpenClaw的“主模型”时,价值就凸显出来了:

-

更像“主脑”:在多步骤任务中,它的输出更像一份可执行的项目计划,而非一次性回答。

-

工具调用更“聪明”:在调用工具前,能进行更合理的前置判断。

-

输出更“工程化”:在代码、分析、方案设计等任务中,给出的结果更结构化、更可用。

当然,接入时有个关键细节需要注意:这类模型有时会将主要输出放在 message.reasoning(推理过程)字段,而非 message.content(最终内容)字段。因此,在OpenClaw中适配时,需要额外处理,优先读取 content,如果为空则兼容读取 reasoning。只要做好这层适配,它就能在框架中流畅运行。

03 实战测试:它在OpenClaw里到底怎么“思考”的?

光说不练假把式。我们设计了一个真实工作流任务来考验它(以27B版本为例):

任务:请设计一个“抓取文章 -> 生成摘要 -> 提炼行动项 -> 发送到飞书”的4步OpenClaw工作流方案,并补充一句最关键的工程提醒。

模型的输出不仅有清晰的4步方案,其内部的reasoning字段更揭示了它的“思考过程”:

1. 分析需求:明确目标、功能、约束、角色

2. 拆解步骤:抓取 -> 摘要 -> 提炼行动项 -> 发送飞书

3. 草拟方案:先给出一版工作流结构

4. 优化与精简:为了满足“4 步方案”的要求再次修正输出

这种“先规划,后输出”的模式,正是优秀Agent主脑的核心特质。

我们还测试了它的工程风险嗅觉。当问及“用户上传PDF->抽文本->摘要->入库->通知”这个流程中最易忽略的风险时,它给出的不是“注意稳定性”这样的空话,而是:

-

任务幂等性与状态机缺失

-

第三方服务(LLM/OCR)的不可靠性

-

数据隐私与合规风险

-

长耗时任务的用户反馈缺失

这种能输出可落地风险清单的能力,让它在集成到生产流程时,价值远超一个聊天伙伴。

04 9B vs 27B,该怎么选?(保姆级选择指南)

不谈复杂参数,只讲最直白的应用场景。

选 9B 版本,如果你:

-

想快速试水:低成本验证模型在自家流程中的可行性。

-

资源敏感:希望用最少的算力成本先把API和基础功能跑通。

-

需要轻量入口:为OpenClaw接入一个基础的、稳定的推理模型,用于不太复杂的任务调度。

一句话:9B是性价比极高的“先锋部队”,适合快速验证和轻量级集成。

选 27B 版本,如果你:

-

追求“主脑”体验:希望它在OpenClaw中承担核心的复杂任务规划和决策角色。

-

处理长链路工作:工作流步骤繁多,需要模型有更强的逻辑梳理和状态维持能力。

-

需要深度分析与编码:任务涉及复杂的代码生成、架构分析或方案设计。

一句话:27B是能力更强的“中军主帅”,当你想在Agent中复现接近Claude的深度工作体验时,选它。

核心选择建议:

-

目标“先用起来”:无脑选 Qwopus 9B,在共绩算力上成本极低,部署简单。

-

目标“像Claude一样干活”:直接上 Qwopus 27B,它在复杂任务拆解和规划上的表现,更能满足你对“智能主脑”的期待。

05 为什么说它是“Claude平替”?关键在这3点

“平替”不是全能替代,而是在特定场景下的高性价比选择。

-

成本结构更优:相较于持续为Claude API调用付费,在共绩算力上部署自有模型,可将成本转化为可预测的算力资源支出。这对于高频的内部自动化、代码辅助、Agent调度场景至关重要。

-

数据与流程可控:模型跑在自己的服务器上,无需担忧数据出境、API配额限制或服务商波动,尤其适合内部系统和敏感工作流。

-

工作模式神似:在处理需要多步推理、工具调用和结构化输出的任务时,它的行为模式与Claude高度相似,能很好地融入既定工程框架。

所以,更准确的定义是:它不是通用聊天的替代品,而是企业内部工作流、研发助手、自动化Agent中的“Claude风格决策引擎”。

06 立即行动:在共绩算力上快速体验

理论结束,实战开始!在共绩算力上体验它,前所未有的简单:

第一步:一键拉起模型服务

无需从零配置环境!共绩算力平台已为您预置了包含Qwopus等热门模型的预制镜像。登录控制台,选择对应镜像创建云主机或Serverless服务,分钟级即可获得一个标准的OpenAI兼容API端点。

第二步:接入你的OpenClaw

将上一步获取的API地址和模型名称(如qwopus_27b)配置到你的OpenClaw项目中。记得处理好content与reasoning字段的兼容读取哦。

快速调用示例(在服务器上执行):

9B:

curl "https://deployment-452-uqtednya-8000.550w.link/v1/chat/completions" -H "Content-Type: application/json" -d '{

"model":"qwopus_9b",

"messages":[{"role":"user","content":"你好"}],

"max_tokens":256

}'

27B:

curl "https://deployment-452-kqiifoh5-8000.550w.link/v1/chat/completions" -H "Content-Type: application/json" -d '{

"model":"qwopus_27b",

"messages":[{"role":"user","content":"你好"}],

"max_tokens":512

}'

07 写在最后

这次在共绩算力上的深度实践,让我们确信了一件事:

Qwopus这类模型的价值,不在于榜单分数,而在于它能否被你轻松地“用起来”,并真正提升工作流的智能化水平。

共绩算力提供的,正是这样一条“捷径”——免去繁琐的环境配置,直接提供开箱即用的算力与模型,让你能跳过“从零拼装”的泥沼,直奔“用AI干活”的主题。

如果你也受困于:

-

外部API成本高、调用不稳定

-

想要一个私有化、可深度定制的工作流“大脑”

-

希望将复杂的Claude风格推理能力,嵌入自己的产品或流程中

那么,是时候在共绩算力上,启动你的专属“Claude风格智能引擎”了。

让好用的模型,真正开始为你干活。

闲时算力上共绩,弹性算力找共绩

立即体验共绩算力:www.suanli.cn

本次实测涉及的两款模型,直接给大家放全公开地址,复制就能用:

- 9B 版本:Jackrong/Qwen3.5-9B-Claude-4.6-Opus-Reasoning-Distilled

- Hugging Face:https://huggingface.co/Jackrong/Qwen3.5-9B-Claude-4.6-Opus-Reasoning-Distilled

- 魔搭(v2):https://www.modelscope.cn/models/Jackrong/Qwen3.5-9B-Claude-4.6-Opus-Reasoning-Distilled-v2

- 27B 版本:Jackrong/Qwen3.5-27B-Claude-4.6-Opus-Reasoning-Distilled-v2

- Hugging Face:https://huggingface.co/Jackrong/Qwen3.5-27B-Claude-4.6-Opus-Reasoning-Distilled-v2

- 魔搭:https://modelscope.cn/models/Jackrong/Qwen3.5-27B-Claude-4.6-Opus-Reasoning-Distilled模型地址

-

Qwopus 9B: ModelScope| Hugging Face

-

Qwopus 27B: ModelScope| Hugging Face

遇到问题?

部署或使用中有任何疑问,欢迎在评论区留言,我们第一时间为你解答!

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)