【AI赋能测试】入门准备工作

技术栈:Agent+RAG+MCP+Skills+Tools

RAG(Retrieval-Augmented Generation,检索增强生成)是一种将信息检索与文本生成结合的 AI 技术,核心是在生成前从外部知识库检索相关信息并融入上下文,以此提升大语言模型(LLM)输出的准确性、时效性与可解释性,同时缓解幻觉、知识陈旧等问题。

模型上下文协议(Model Context Protocol)

定义:Anthropic 开源的跨模型交互协议,统一 LLM 与外部工具 / 数据源的通信标准(如 JSON-RPC 2.0),被称为 “AI 领域的 USB-C 接口”。

价值:解决模型与外部系统集成碎片化问题,支持本地 / 远程部署,适配数据库、API、代码仓库等场景,降低多模型适配成本。

Agent(智能体 / AI 代理)

- 普通大模型:你问一句,它答一句,被动响应。

- Agent:它会自己想步骤、自己查资料、自己调用工具、自己修正错误,直到完成任务。

Tools(工具)

- Agent 能调用的外部能力,用来弥补大模型本身做不到的事

Skills(技能)

- “固定能力包”,比单个 Tool 更复杂,更高层的封装

- Skill = 固定任务流程 + 一组工具 + 提示词模板

uv = Python 世界最快的包管理器 / 虚拟环境工具

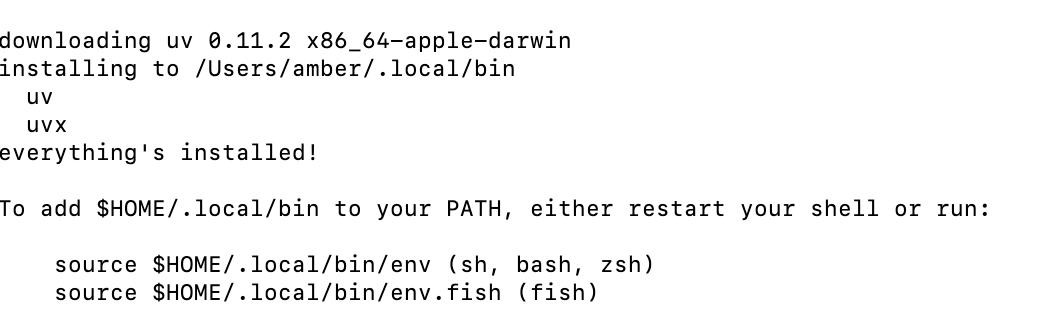

一、Mac 安装 uv(最推荐方式)

打开 终端(Terminal),输入下面这行命令并回车:

curl -LsSf https://astral.sh/uv/install.sh | sh

等待安装完成即可。

验证是否安装成功:

source $HOME/.local/bin/env

# 刚才安装把工具放到了一个隐藏文件夹里,

# 但新打开的终端还不知道这个路径,所以找不到 uv。

# 执行上面的命令,就是临时刷新一下路径

uv --version

如果显示版本号,就说明装好了!

二、在 PyCharm 里使用 uv 虚拟环境

在 PyCharm 里建了项目 ,直接按下面步骤做:

1. 打开 PyCharm 终端

点击底部工具栏的 Terminal。

2. 创建 uv 虚拟环境(在项目根目录)

在终端里执行:

uv venv

这会在项目根目录生成一个 .venv 文件夹。

3. 激活环境(Mac 关键步骤)

执行:

source .venv/bin/activate

激活成功后,你会看到终端前面变成:

(.venv) amber@amberdeMacBook-Pro ai-test-agent-system %

4. 安装库(比 pip 快 10 倍)

uv install openai langchain chromadb

5. 运行代码

uv run agent.py

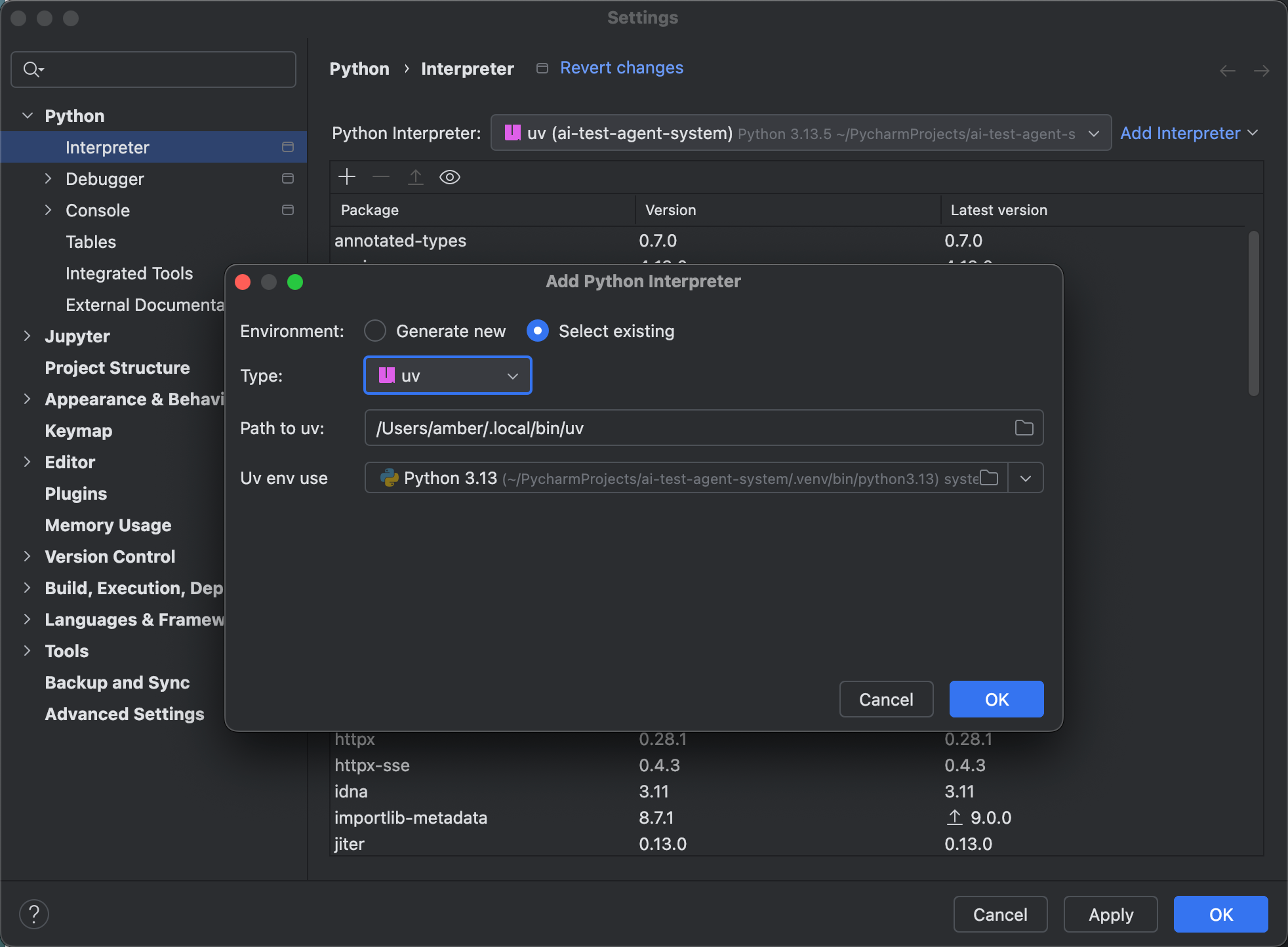

三、让 PyCharm 自动识别 uv 环境(可选,但推荐)

为了让 PyCharm 自动识别你刚创建的 .venv 环境:

- 打开:

File→Settings(快捷键Cmd + ,) - 进入:

Project: ai-test-agent-system→Python Interpreter - 点击右上角的 Add Interpreter → Add Local Interpreter

- 选择:Virtualenv Environment

- 选择:Existing

- 指向你项目里的

.venv/bin/python - 点 OK

这样 PyCharm 就会自动使用你用 uv 装好的环境。

四、超简总结(Mac 版)

- uv 要单独装:终端一行命令搞定

- 激活环境:

source .venv/bin/activate

uv是包管理和虚拟环境工具,其核心的包安装逻辑是封装了pip,所以所有pip的安装、卸载、更新操作,都需要在uv后加pip子命令,比如:

- 卸载包:

uv pip uninstall langchain - 查看已装包:

uv pip list - 导出依赖:

uv pip freeze > requirements.txt

安装包:

uv pip install langchain

如果需要安装指定版本,可加版本号:

uv pip install langchain==0.1.0

uv pip install langchain

uv pip install langchain-deepseek

uv pip install langchain-mcp-adapters

uv pip install 'langgraph-cli[inmem]'

这 4 个库分别是干嘛的,你一看就懂👇

1. langchain

大模型开发的“万能工具箱”

- 最核心、最基础的库

- 帮你快速调用大模型(GPT、DeepSeek、通义千问等)

- 提供:对话管理、文档读取、工具调用、记忆功能

- 相当于AI 应用的骨架

一句话:做 AI 项目必须装它。

2. langchain-deepseek

DeepSeek 大模型专用对接包

- 专门让 LangChain 能调用 DeepSeek 系列模型

- 比如 deepseek-chat、deepseek-coder

- 没有它,你就没法在 LangChain 里用 DeepSeek

一句话:你要用 DeepSeek,就必须装它。

3. langchain-mcp-adapters

MCP 工具适配器(多模型协作工具)

MCP = Model Control Protocol

- 让大模型能调用外部工具

- 让不同模型之间互相通信、协作

- 属于进阶功能,一般做复杂 AI 系统才用

一句话:让 AI 能调用工具、能和别的 AI 对话。

4. langgraph-cli[inmem]

LangGraph 工作流命令行工具

- LangGraph 是做 AI 智能体、工作流、多步骤任务 的框架

[inmem]是内存存储模式(轻量、不用数据库)- 用来构建:AI 助手、自动化工作流、自主思考的 Agent

一句话:做 AI 智能体(Agent)必须用它。

超级总结

langchain→ AI 基础框架langchain-deepseek→ 对接 DeepSeek 大模型langchain-mcp-adapters→ AI 调用外部工具langgraph-cli[inmem]→ 做 AI 智能体/自动化工作流

这四个一起装,说明你正在做:

基于 DeepSeek 的 AI 智能体 / 自动化工作流项目 ✅

langchain的GitHub地址https://github.com/langchain-ai

-

LangChain Python 官方主文档

https://python.langchain.com/(最新英文教程、概念、实战指南) -

LangChain API 参考文档

https://python.langchain.com/api_reference/(所有类、方法的详细参数说明) -

LangChain 中文文档

https://www.langchain.com.cn/(国内社区维护,适合快速理解核心概念)

https://python.langchain.ac.cn/(官方中文镜像,内容同步更及时) -

LangGraph 专属文档(

langgraph-cli配套)

https://langgraph.langchain.com/

deepseekAPI 开放平台

-

官方平台入口:https://platform.deepseek.com/

用于注册/登录、创建/管理 API Key、查看用量、充值、查看模型价格。 -

API 文档(英文):https://api-docs.deepseek.com/

kimi

- API 管理平台: https://platform.moonshot.cn/

docling-mcp 文档解析工具

(https://github.com/docling-project/docling-mcp)

前端界面

https://github.com/langchain-ai/agent-chat-ui

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)