大模型预训练与微调核心概念详解

本文档系统讲解大语言模型(LLM)训练流程中的核心概念,从预训练到微调,从理论到实践。

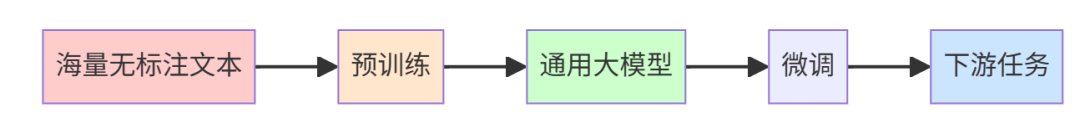

一、预训练(Pre-training)——让模型"读万卷书"

1.1 什么是预训练?

预训练(Pre-training) 是大模型在大规模通用数据集上进行的初始训练阶段。目标是让模型学习语言的基本结构、常识知识、语法、语义关系等通用能力,而不是针对某个特定任务。

1.2 预训练的核心特点

| 特点 | 说明 |

|---|---|

| 数据规模 | 使用数千亿甚至数万亿词的海量文本 |

| 学习方式 | 自监督学习(无需人工标注) |

| 训练目标 | 学习语言的通用规律和知识 |

| 输出结果 | 具备通用能力的基座模型 |

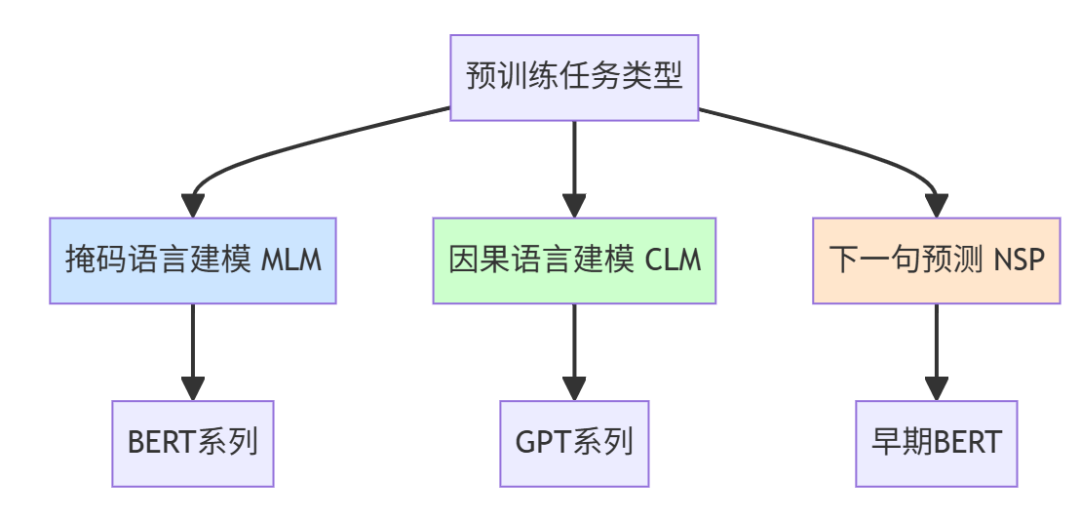

1.3 常见的预训练任务

1.4 通俗理解

预训练就是让大模型"读万卷书",先成为通才,再通过后续步骤成为专才。

- GPT-3 先在数千亿词语料上预训练,学会"像人类一样"生成连贯文本

- 之后可通过少量标注数据微调,用于客服对话、代码生成等具体场景

二、Embeddings——将文字变成数字向量

2.1 什么是 Embeddings?

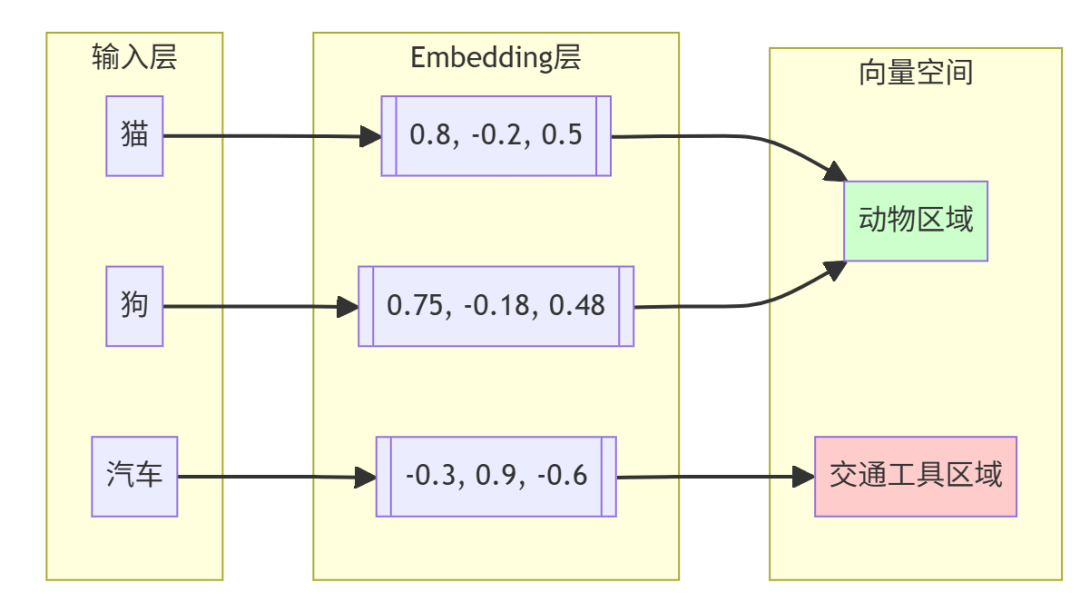

Embeddings(嵌入) 是将离散的符号(如单词、句子)转换为连续的、低维的实数向量的技术。这些向量能捕捉语义、语法或上下文信息,让计算机可以"理解"人类语言。

2.2 直观示例

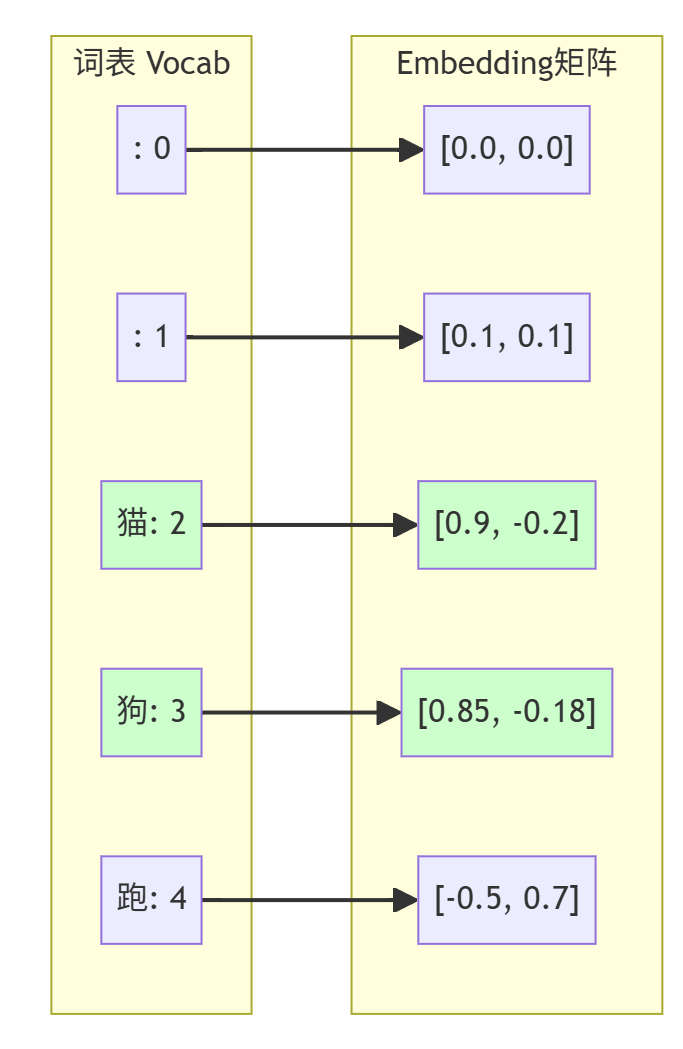

假设三个词经过 Embedding 后:

| 词语 | 向量表示(简化) | 说明 |

|---|---|---|

| 猫 | [0.8, -0.2, 0.5] | |

| 狗 | [0.75, -0.18, 0.48] | 与"猫"向量接近(都是宠物) |

| 汽车 | [-0.3, 0.9, -0.6] | 与"猫"向量差别大(不同类别) |

2.3 Embeddings 的关键特点

| 特点 | 说明 |

|---|---|

| 离散转连续 | 文字符号变成可计算的数值向量 |

| 语义编码 | 向量间的距离反映语义相似度 |

| 支持推理 | 国王 - 男人 + 女人 ≈ 女王 |

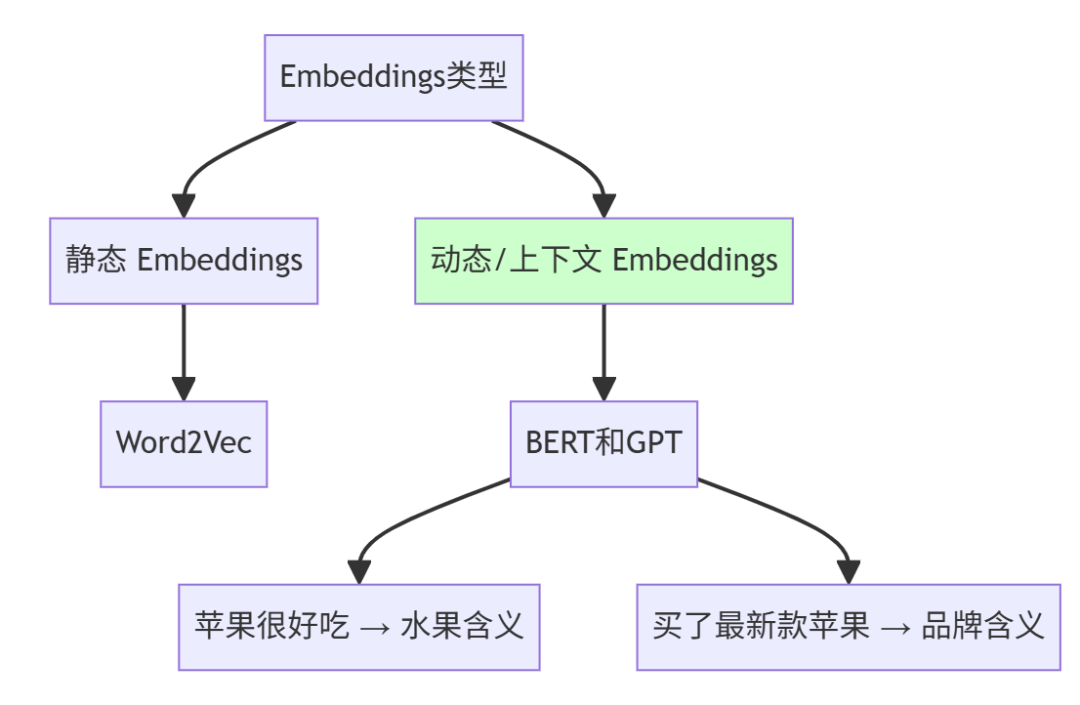

2.4 静态 vs 动态 Embeddings

2.5 应用场景

- 自然语言处理:文本分类、语义搜索、机器翻译

- 推荐系统:用户和商品的向量化表示

- 多模态:CLIP 将图像和文本映射到同一向量空间

三、词表与向量的关系——字典与语义地图

3.1 核心概念

| 概念 | 作用 | 类比 |

|---|---|---|

| 词表(Vocabulary) | 定义模型能"认识"的基本语言单元 | 字典的词条列表 |

| Embedding | 为每个词表项提供语义向量表示 | 每个词条的详细解释 |

3.2 两者的紧密关系

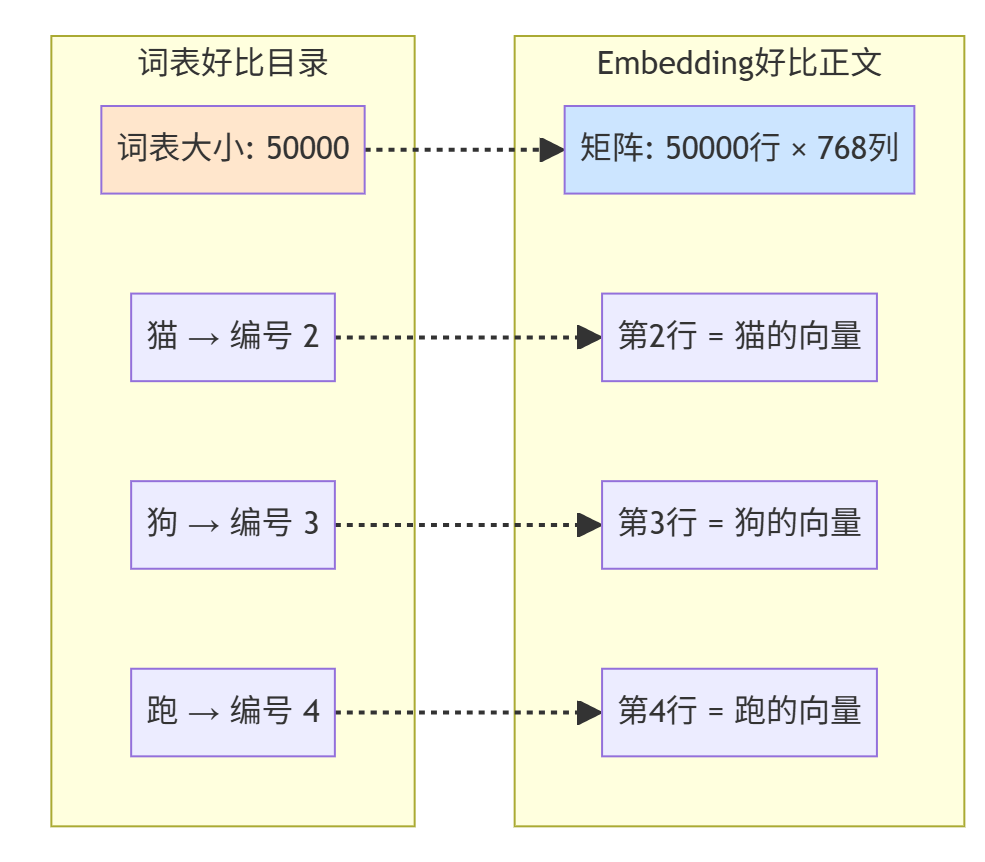

词表和 Embedding 就像字典的"目录页"和"正文页"——目录告诉你词在第几页,正文给你详细解释。

关系一:一一对应(数量绑定)

词表中有多少个词,Embedding 矩阵就有多少行。

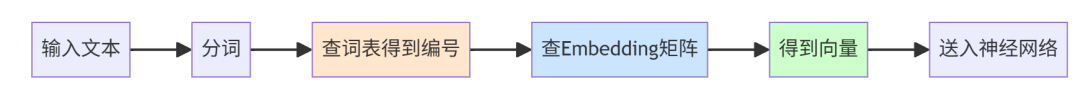

关系二:查表流程(使用绑定)

模型处理文本时,必须先用词表找到编号,再用编号去 Embedding 矩阵查向量。

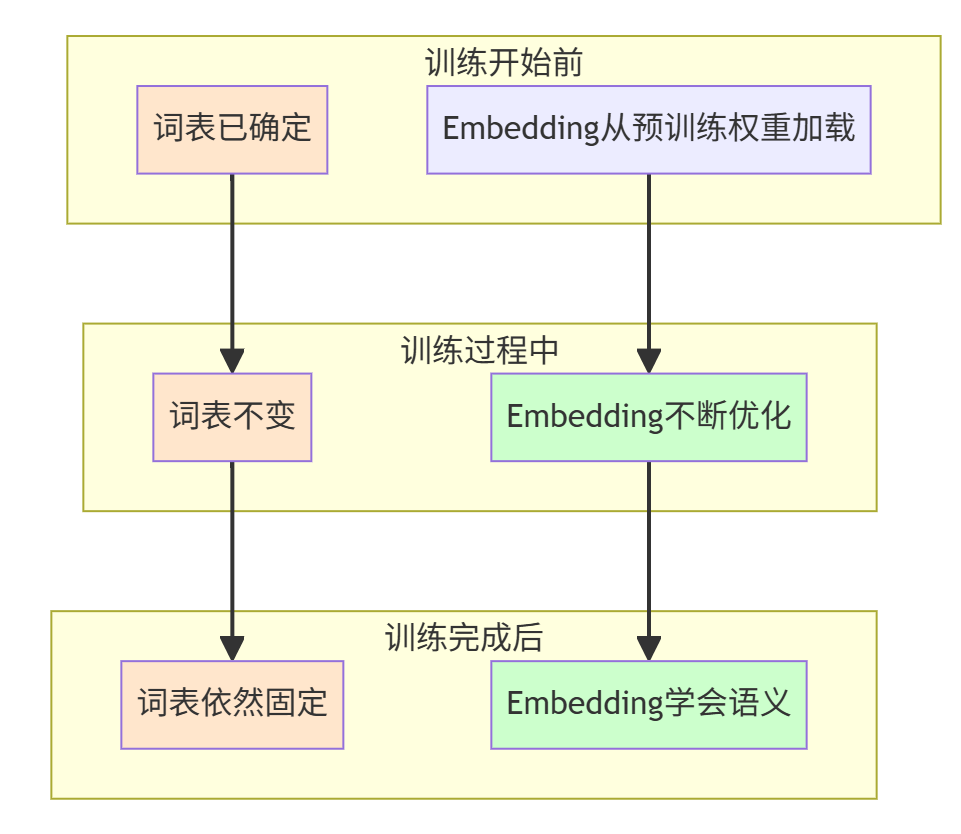

关系三:训练中的角色分工

| 组件 | 训练前 | 训练中 | 作用 |

|---|---|---|---|

| 词表 | 固定不变 | 始终不变 | 提供"索引系统" |

| Embedding | 预训练权重加载 | 不断调整优化 | 学习"语义含义" |

3.3 Embedding 矩阵结构

3.4 关键要点

- 一一对应

:词表中每个 token 对应 Embedding 矩阵的一行

- 查表机制

:输入文本 → 分词 → 获取 ID → 从矩阵中取出对应向量

- 覆盖范围

:词表决定了模型能处理哪些词,超出词表的词需要子词切分

- 共同演化

:词表通常固定,Embedding 向量在训练中不断优化

3.5 总结

没有词表,Embedding 无从索引;没有 Embedding,词表只是符号,无法被模型计算。

二者共同构成了大模型理解语言的"字典 + 语义地图"。

四、前向传播与反向传播——模型如何学习

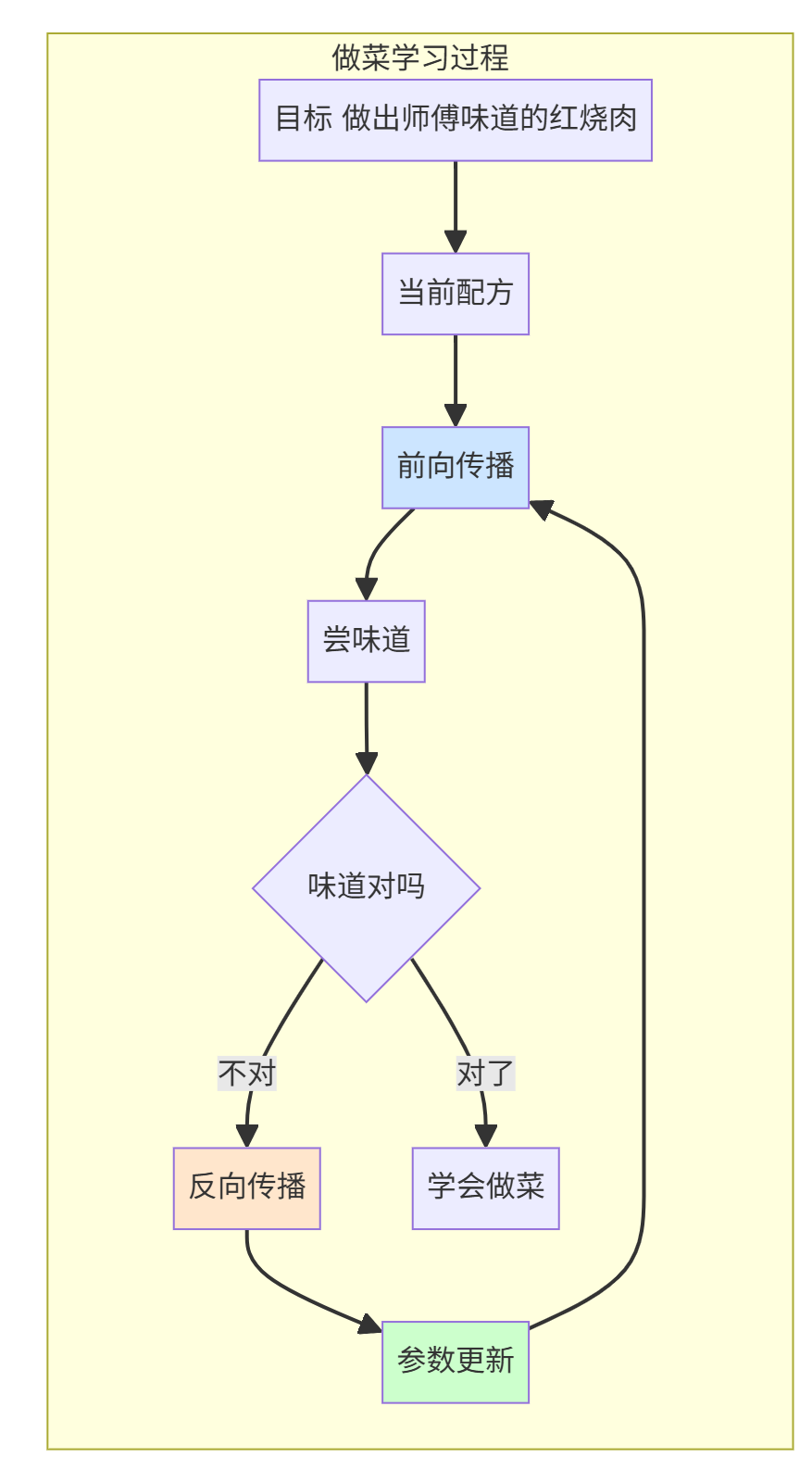

4.1 用做菜比喻理解

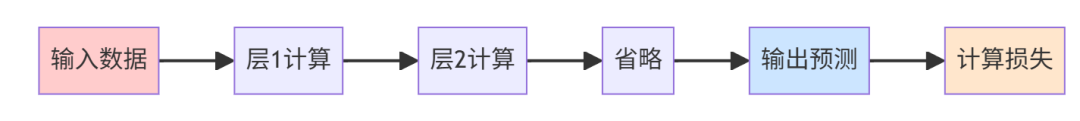

4.2 前向传播(Forward Propagation)

“先做一遍,看看味道怎么样”

关键点:

- 数据从输入层 → 隐藏层 → 输出层,单向流动

- 目的是得到预测值,并计算损失

- 不改变模型参数

,只是"试做"

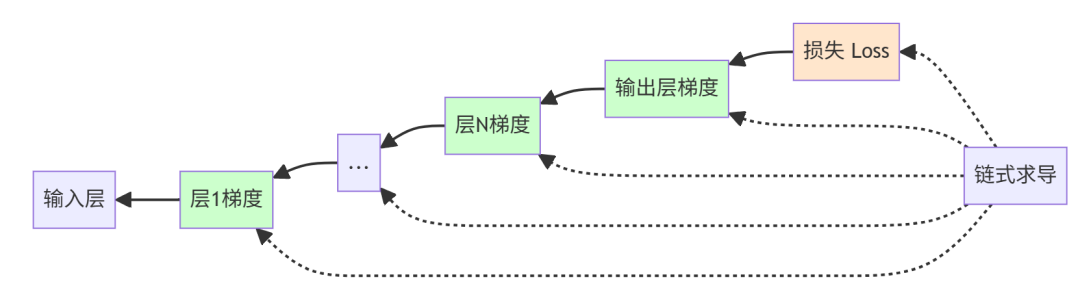

4.3 反向传播(Backpropagation)

“分析哪里调料放多了/少了,然后调整”

关键点:

- 信息从输出层 → 隐藏层 → 输入层,反向流动

- 目的是计算每个参数的梯度(即该参数对损失的"责任")

- 梯度用于更新参数(优化器如 SGD、Adam)

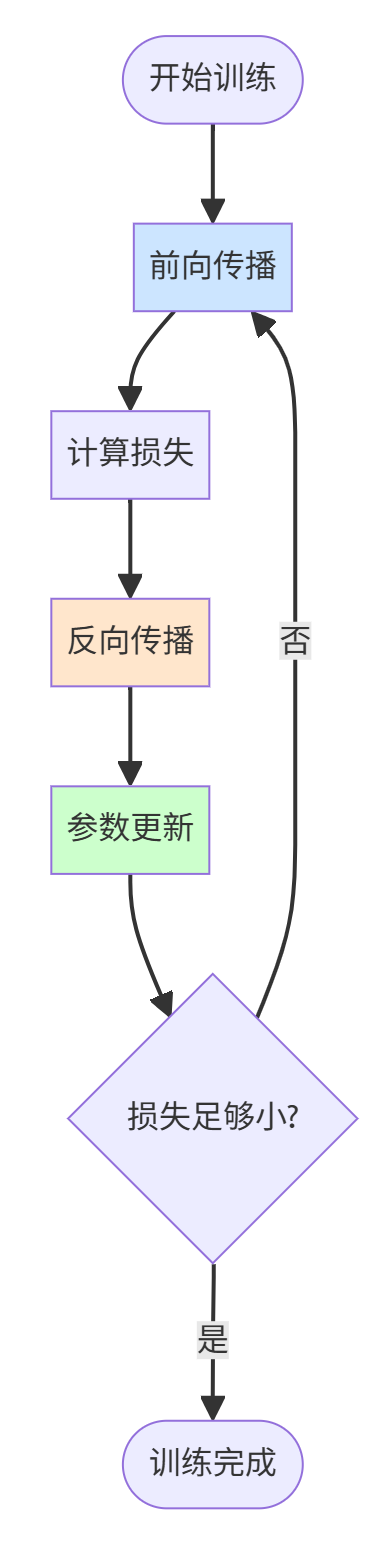

4.4 完整的训练循环

4.5 一句话总结

| 过程 | 核心作用 | 通俗理解 |

|---|---|---|

| 前向传播 | 计算预测和损失 | “跑一遍模型,看看错在哪” |

| 反向传播 | 计算参数梯度 | “搞清楚谁该为错误负责” |

| 参数更新 | 调整模型权重 | “告诉它怎么改” |

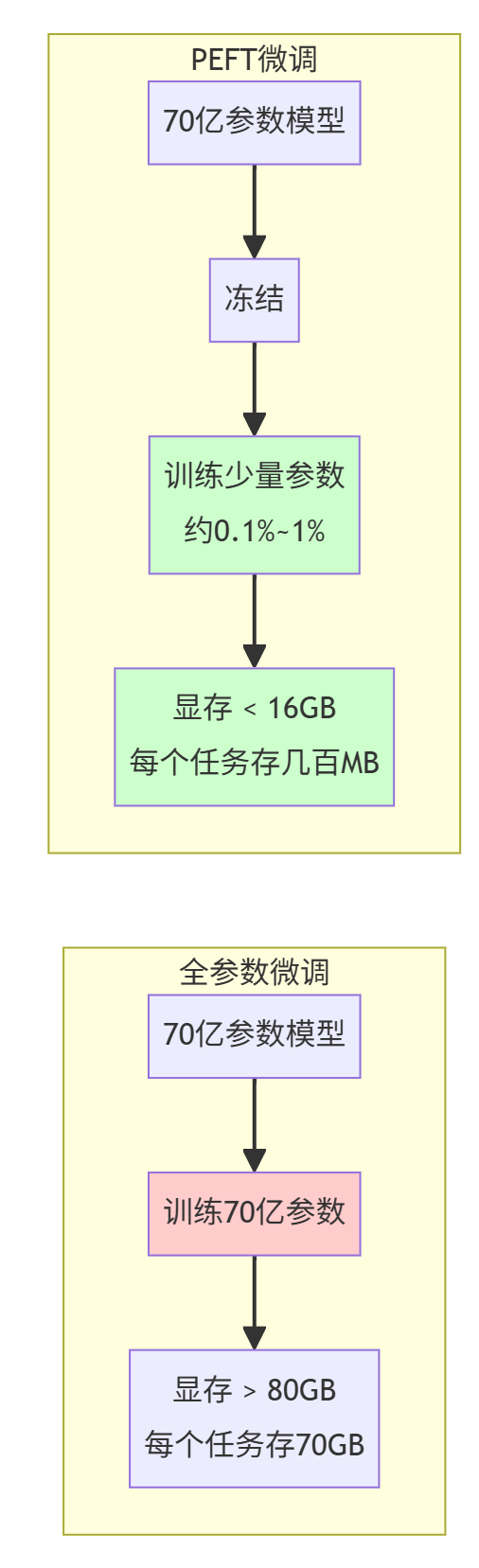

五、PEFT——参数高效微调

5.1 什么是 PEFT?

PEFT(Parameter-Efficient Fine-Tuning) 是一类微调技术,核心思想是:

保持预训练模型大部分参数冻结,仅训练少量额外参数,实现高效、低成本的模型适配。

5.2 为什么需要 PEFT?

全参数微调的痛点:

| 问题 | 说明 |

|---|---|

| 显存消耗巨大 | 需存储所有参数的梯度和优化器状态 |

| 计算成本高 | 训练时间长,算力开销大 |

| 存储成本高 | 每个任务都要保存完整模型副本 |

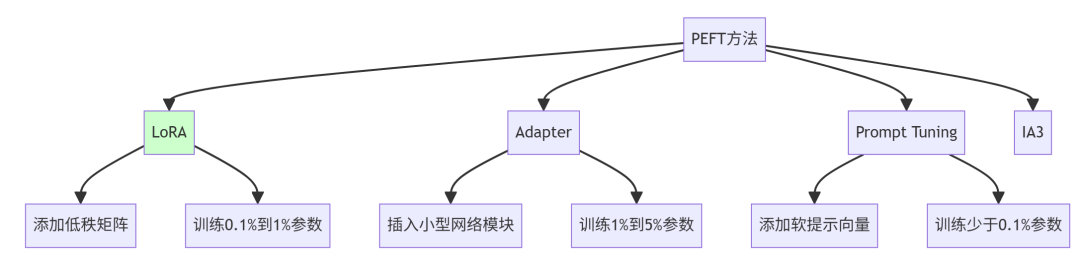

5.3 常见的 PEFT 方法

5.4 PEFT 的核心优势

| 优势 | 说明 |

|---|---|

| 节省资源 | 消费级 GPU 可微调百亿模型 |

| 避免灾难性遗忘 | 主干参数冻结,保留预训练知识 |

| 便于部署 | 每个任务只存几百 MB 增量文件 |

| 多任务切换 | 加载不同 PEFT 权重即可切换功能 |

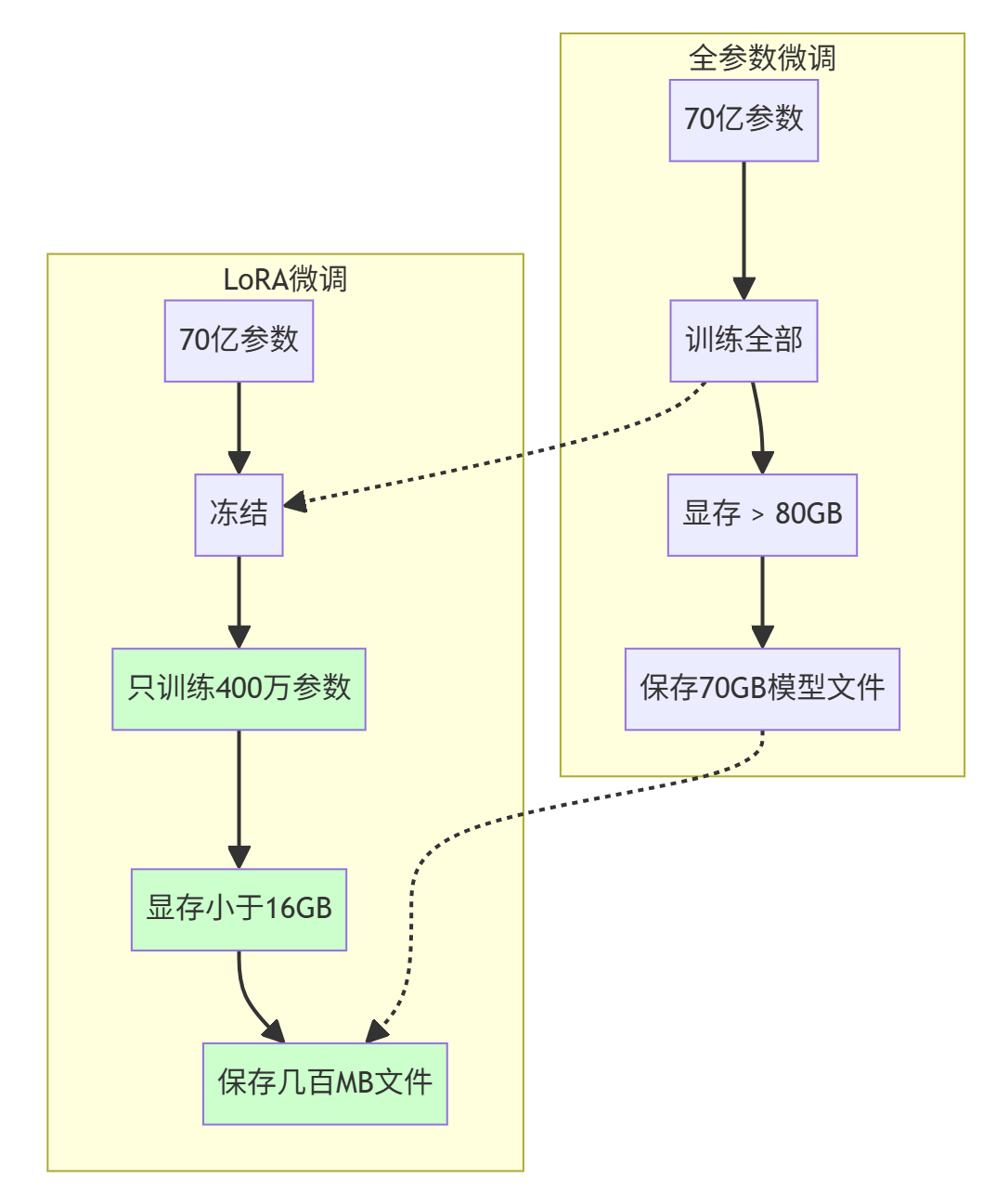

5.5 实际案例(LoRA)

7B 参数的 LLaMA 模型:

5.6 总结

PEFT 是"四两拨千斤"的微调策略——不动大模型主体,只训练一小撮聪明的附加参数,就能让大模型快速适应新任务。

如今,PEFT(尤其是 LoRA)已成为大模型应用落地的标配技术。

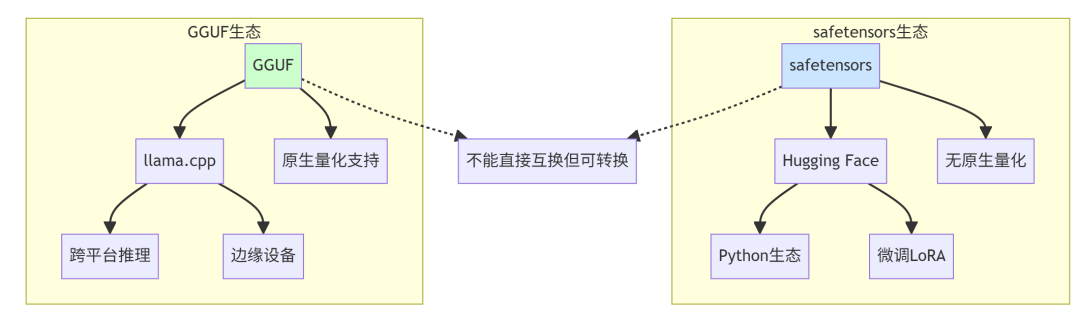

六、模型格式对比——safetensors vs GGUF

6.1 两种格式概述

| 格式 | 开发者 | 主要用途 |

|---|---|---|

| safetensors | Hugging Face | 训练、微调、Python 推理 |

| GGUF | llama.cpp (Georgi Gerganov) | CPU/GPU 本地推理(含量化) |

6.2 核心区别对比

6.3 详细对比

| 特性 | safetensors | GGUF |

|---|---|---|

| 是否包含量化 | ❌ 原生不支持 ✅ 可配合 bitsandbytes | ✅ 原生支持多种量化 |

| 依赖环境 | Python + safetensors 库 | 无需 Python,C/C++ 友好 |

| 文件内容 | 纯权重张量(需配合 config.json) | 自包含 :架构 + 权重 + 分词器 |

| 典型文件 | model-00001.safetensors adapter_model.safetensors |

llama-3-8b.Q4_K_M.gguf |

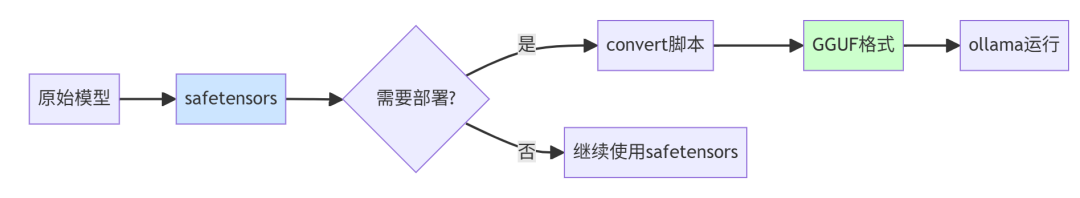

6.4 格式转换关系

6.5 使用场景

| 场景 | 推荐格式 |

|---|---|

| 用 LoRA 微调 LLaMA | safetensors(输出 adapter) |

| 在 Mac 上用 LM Studio 运行 | GGUF |

| 手机/树莓派本地推理 | GGUF(量化版本) |

| 服务器端 Python 推理 | safetensors |

6.6 总结

safetensors 和 GGUF 是"兄弟",不是"父子"。

它们分别服务于两个主流技术栈:

- safetensors → Hugging Face 生态

(训练/微调/Python 推理)

- GGUF → llama.cpp 生态

(本地/边缘设备/C++ 推理 + 量化)

在实际工作中,两者经常前后衔接使用:先用 safetensors 训练,再转为 GGUF 部署。

这里给大家精心整理了一份全面的AI大模型学习资源,包括:AI大模型全套学习路线图(从入门到实战)、精品AI大模型学习书籍手册、视频教程、实战学习、面试题等,资料免费分享!

👇👇扫码免费领取全部内容👇👇

1. 成长路线图&学习规划

要学习一门新的技术,作为新手一定要先学习成长路线图,方向不对,努力白费。

这里,我们为新手和想要进一步提升的专业人士准备了一份详细的学习成长路线图和规划。可以说是最科学最系统的学习成长路线。

2. 大模型经典PDF书籍

书籍和学习文档资料是学习大模型过程中必不可少的,我们精选了一系列深入探讨大模型技术的书籍和学习文档,它们由领域内的顶尖专家撰写,内容全面、深入、详尽,为你学习大模型提供坚实的理论基础。(书籍含电子版PDF)

3. 大模型视频教程

对于很多自学或者没有基础的同学来说,书籍这些纯文字类的学习教材会觉得比较晦涩难以理解,因此,我们提供了丰富的大模型视频教程,以动态、形象的方式展示技术概念,帮助你更快、更轻松地掌握核心知识。

4. 2026行业报告

行业分析主要包括对不同行业的现状、趋势、问题、机会等进行系统地调研和评估,以了解哪些行业更适合引入大模型的技术和应用,以及在哪些方面可以发挥大模型的优势。

5. 大模型项目实战

学以致用 ,当你的理论知识积累到一定程度,就需要通过项目实战,在实际操作中检验和巩固你所学到的知识,同时为你找工作和职业发展打下坚实的基础。

6. 大模型面试题

面试不仅是技术的较量,更需要充分的准备。

在你已经掌握了大模型技术之后,就需要开始准备面试,我们将提供精心整理的大模型面试题库,涵盖当前面试中可能遇到的各种技术问题,让你在面试中游刃有余。

7. 资料领取:全套内容免费抱走,学 AI 不用再找第二份

不管你是 0 基础想入门 AI 大模型,还是有基础想冲刺大厂、了解行业趋势,这份资料都能满足你!

现在只需按照提示操作,就能免费领取:

👇👇扫码免费领取全部内容👇👇

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献68条内容

已为社区贡献68条内容

所有评论(0)