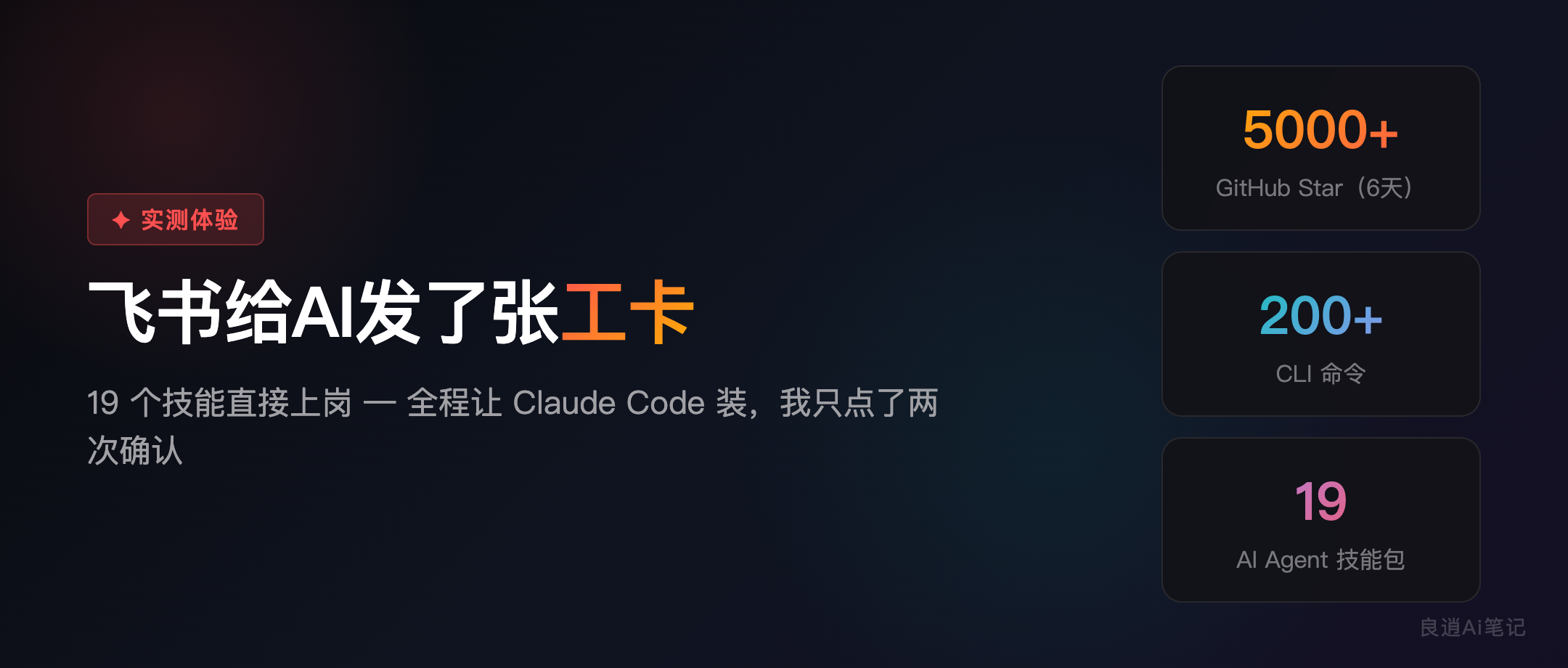

飞书CLI:飞书给AI发了张工卡,19个技能直接上岗

飞书官方团队开源了一个 CLI 工具,6 天 5000 star,200+ 命令,19 个 AI 技能包。我全程让 Claude Code 来装,自己只点了两次确认。

为什么你应该关注这个

如果你在用飞书,又在用 Claude Code、Cursor 这些 AI 编程工具,那这个东西跟你直接相关。

飞书官方团队做了一个命令行工具叫 lark-cli,MIT 开源,上线 6 天就拿了 5000+ star。

但它不是一个普通的 CLI。

普通 CLI 是给人用的——你需要记命令、查参数、翻文档。而 lark-cli 做了一件不一样的事:它把飞书的所有能力打包成了 19 个 AI Agent 技能包,直接注入到你电脑上的 AI 工具里。

装完之后,你的 Claude Code / Cursor / Windsurf 就像多了一个会操作飞书的同事。你说一句"帮我查今天有什么会议",它不是去搜网页,而是直接调飞书 API,用你的身份查你的日历。

我决定亲自装一下,但用一种特别的方式——全程让 AI 来装,我不敲一行命令。

全程让 Claude Code 装,我只点了两次确认

我在终端里跟 Claude Code 说了一句:“帮我把飞书 CLI 装一下。”

然后我就看着它自己干。

第一步:装 CLI 本体

AI 执行了:

npm install -g @larksuite/cli

跑了 33 秒,下载大约 15MB。前置条件只需要 Node.js,不需要 Python,不需要什么 SDK。

第二步:装 19 个 AI 技能包

npx skills add larksuite/cli -y -g

这步只有 1.3MB,但发生了两件让我印象深刻的事:

自动发现 AI 工具。 它扫了一遍我的电脑,自己找到了 Claude Code、Cursor、Windsurf、Kiro CLI、Codex 等所有已安装的 AI 工具,然后把 19 个技能包全部注入进去了。我没有指定任何路径。

自动安全评估。 安装完自动跑了三项安全扫描(Gen / Socket / Snyk),每个技能都有独立评分。这个细节说明这不是随便糊的项目。

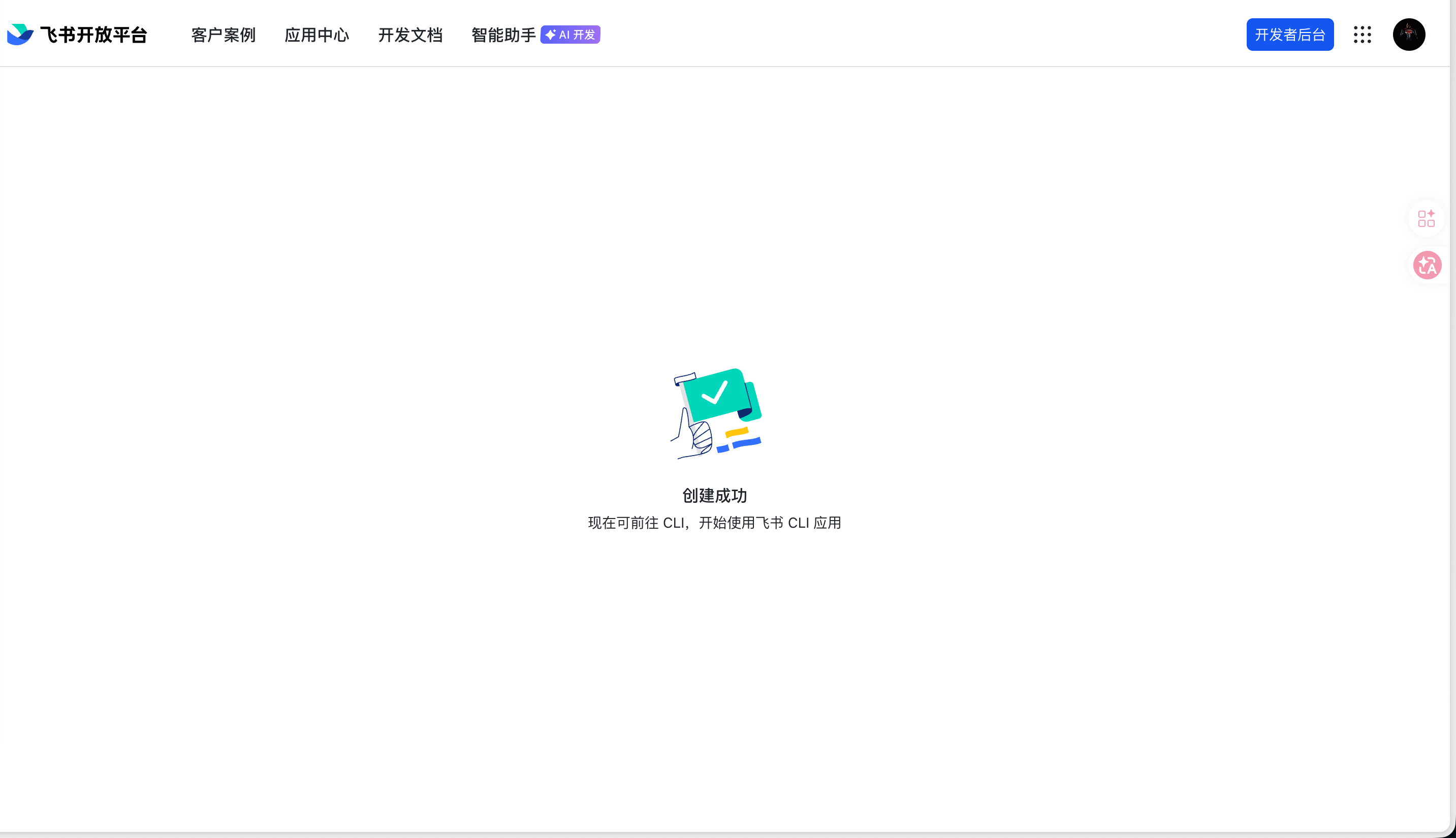

第三步:创建飞书应用

AI 执行了 lark-cli config init --new,终端里弹出一个二维码和链接。

我打开链接,跳到飞书开发者控制台,一键创建应用——不需要手动填 App ID、App Secret、配置权限。

页面提示"创建成功"。这是我第一次点确认。

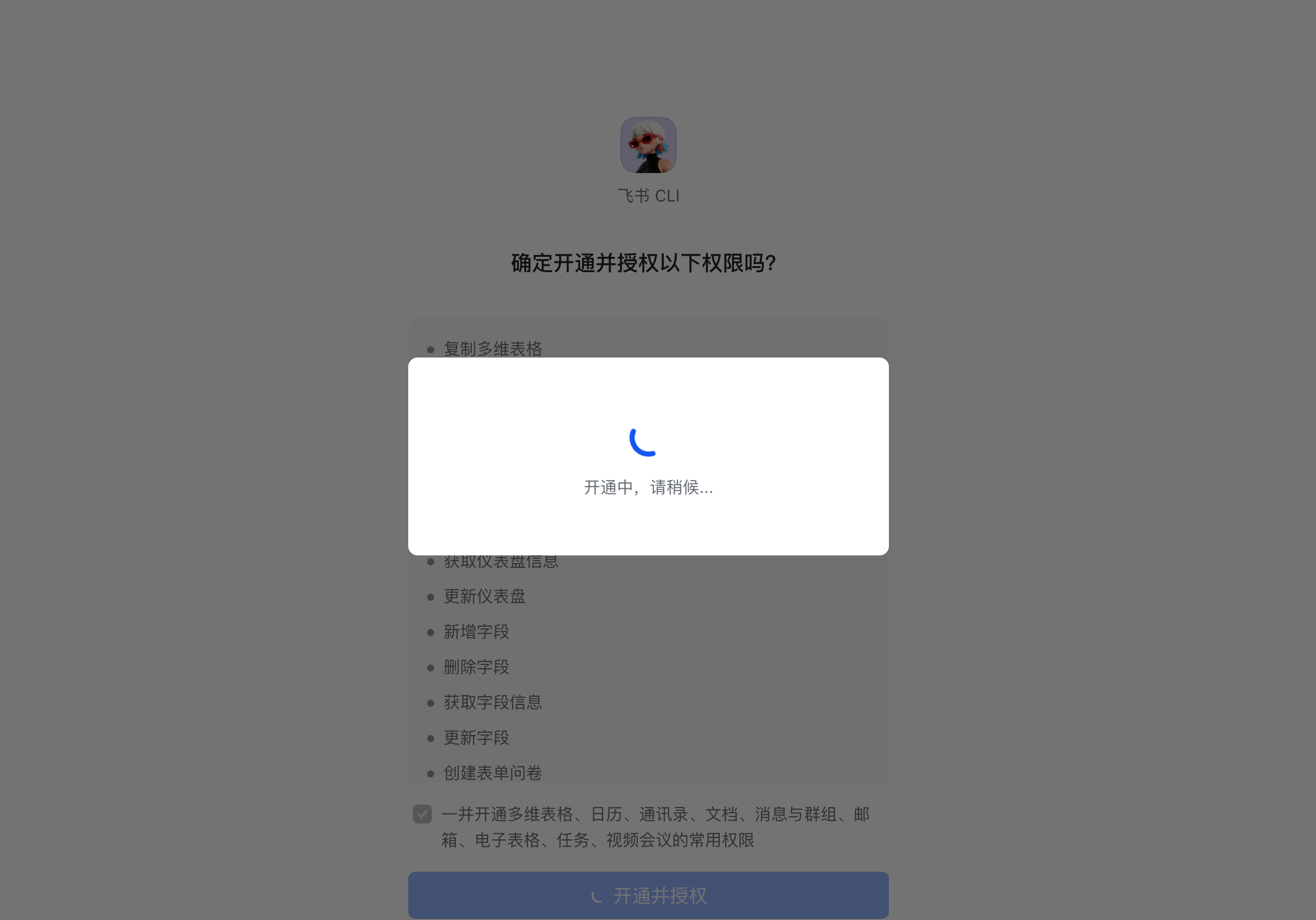

第四步:授权登录

AI 执行了 lark-cli auth login --recommend,又弹出一个浏览器链接。

注意这个授权页面——--recommend 自动勾选了多维表格、日历、通讯录、文档、消息与群组、邮箱、电子表格、任务、视频会议的常用权限。不需要你一个一个挑。

我点了"开通并授权"。这是我第二次点确认。

CLI 立刻收到确认:OK: 登录成功! 用户: Mrliang

一个真实的踩坑

授权这步其实没有一次成功。AI 执行 auth login --recommend 后,浏览器链接弹出来了,但我还没操作完,CLI 那边就超时报了 EOF 错误。

结果 AI 自己想了个办法:先用 --no-wait 拿到 device code 但不阻塞等待,等我在浏览器里完成授权后,它再用 --device-code 手动恢复轮询。

AI 在遇到问题时自己调整了策略,不是傻等或者报错退出。 这个细节让我觉得"AI Agent"不是一个营销概念,它真的在以 Agent 的方式工作。

安装小结

整个安装下来:2 条命令装软件,2 次浏览器点击,约 16MB 存储空间。

我做的事情:打开两个链接,点了两次确认。仅此而已。

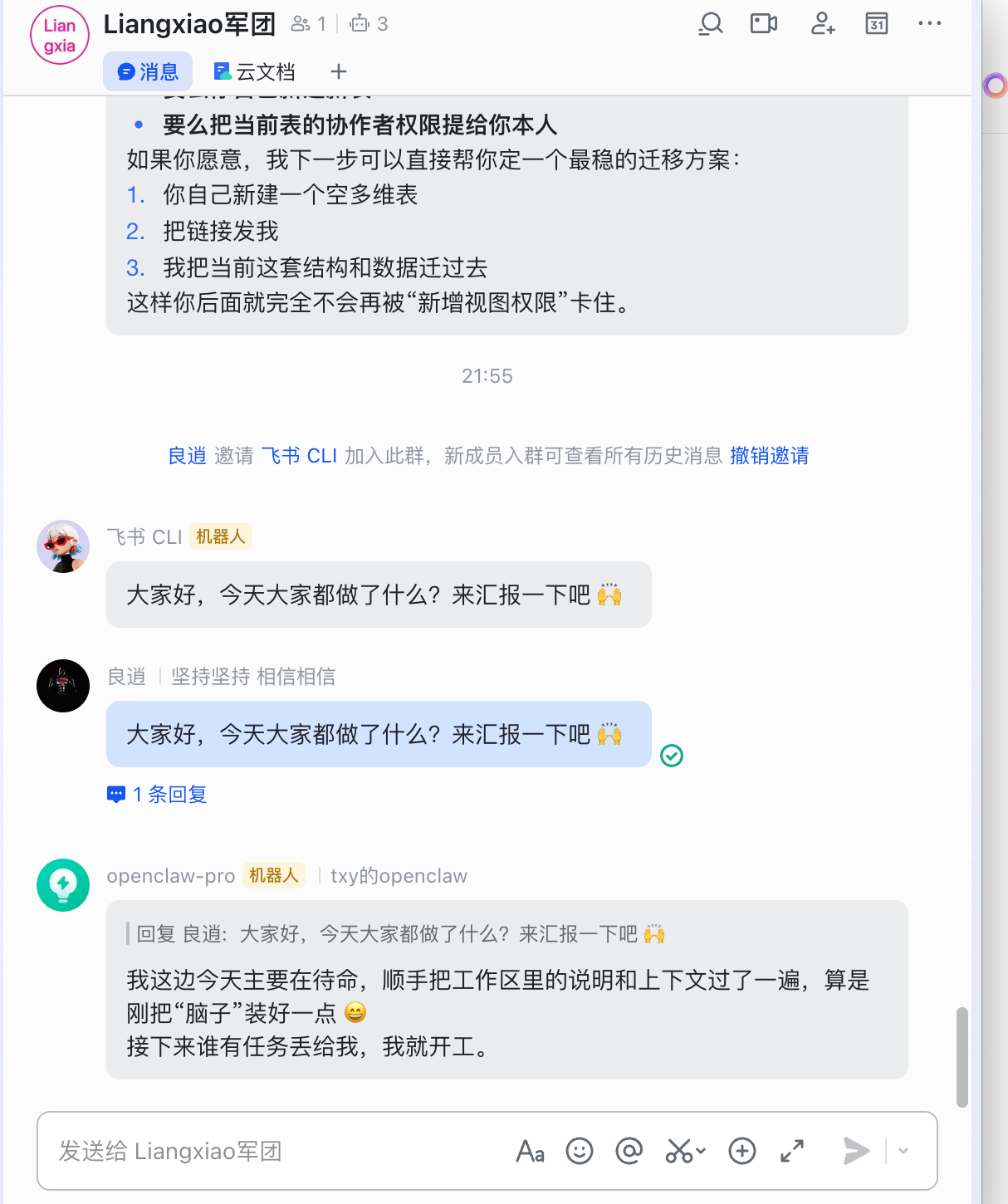

装完第一件事:给飞书群发消息

装好之后我没有翻文档,直接跟 Claude Code 说:“帮我给 openclaw 军团群发条消息,问问大家今天做了什么。”

AI 自己做了三件事:

- 用

+chat-search搜群(搜"军团",找到了"Liangxiao军团") - 用

--dry-run预览了一遍要发的内容 - 确认无误后去掉 dry-run,消息发出

我全程没有查过任何文档,没有手动拼过任何命令参数。

但这个过程踩了两个坑:

坑一:Bot 必须先加入群聊。 发消息前报了 Bot/User can NOT be out of the chat。你需要去飞书群设置里手动把 CLI 机器人加进去才能发消息。这步没法自动化。

坑二:Bot 发的消息不触发其他机器人。 我群里有个 OpenClaw 的 AI 机器人,平时 @ 它会回复。但 lark-cli bot 发出去的消息,OpenClaw 完全无视了。

原因是飞书的事件订阅机制会区分消息来源——bot 的消息不会推送给另一个 bot 的事件回调。这是平台层面防止机器人之间无限循环的安全设计。如果你想用 CLI 跟其他 bot 交互,这条路走不通。

第二件事:让 AI 写文章,直接存进飞书文档

这个才是让我觉得"这东西真的有用"的时刻。

我跟 Claude Code 说了一句话:“帮我写一篇关于 lark-cli 的文章,写完直接发到飞书文档里。”

注意,这是一句自然语言指令,不是两条命令。但 AI 自己把它拆成了两步:

- 先调用自己的写作能力,生成了一篇完整的 Markdown 文章

- 然后直接调用 lark-cli 把文章存进飞书

它执行的命令:

lark-cli docs +create \

--title "文章标题" \

--markdown "$(cat article.md)"

打开返回的链接,飞书文档里已经有了完整的文章,格式完好,代码块、引用、表格全都正常渲染:

后来我让它更新文档内容,它用 docs +update --mode overwrite 直接覆盖了旧版本。

从"写文章"到"存进飞书",我只说了一句话。飞书文档变成了 AI 可以随时读写的存储空间。

200+ 命令背后的架构设计

试完这两个场景后,我开始认真看它的命令体系,发现架构设计是有讲究的。

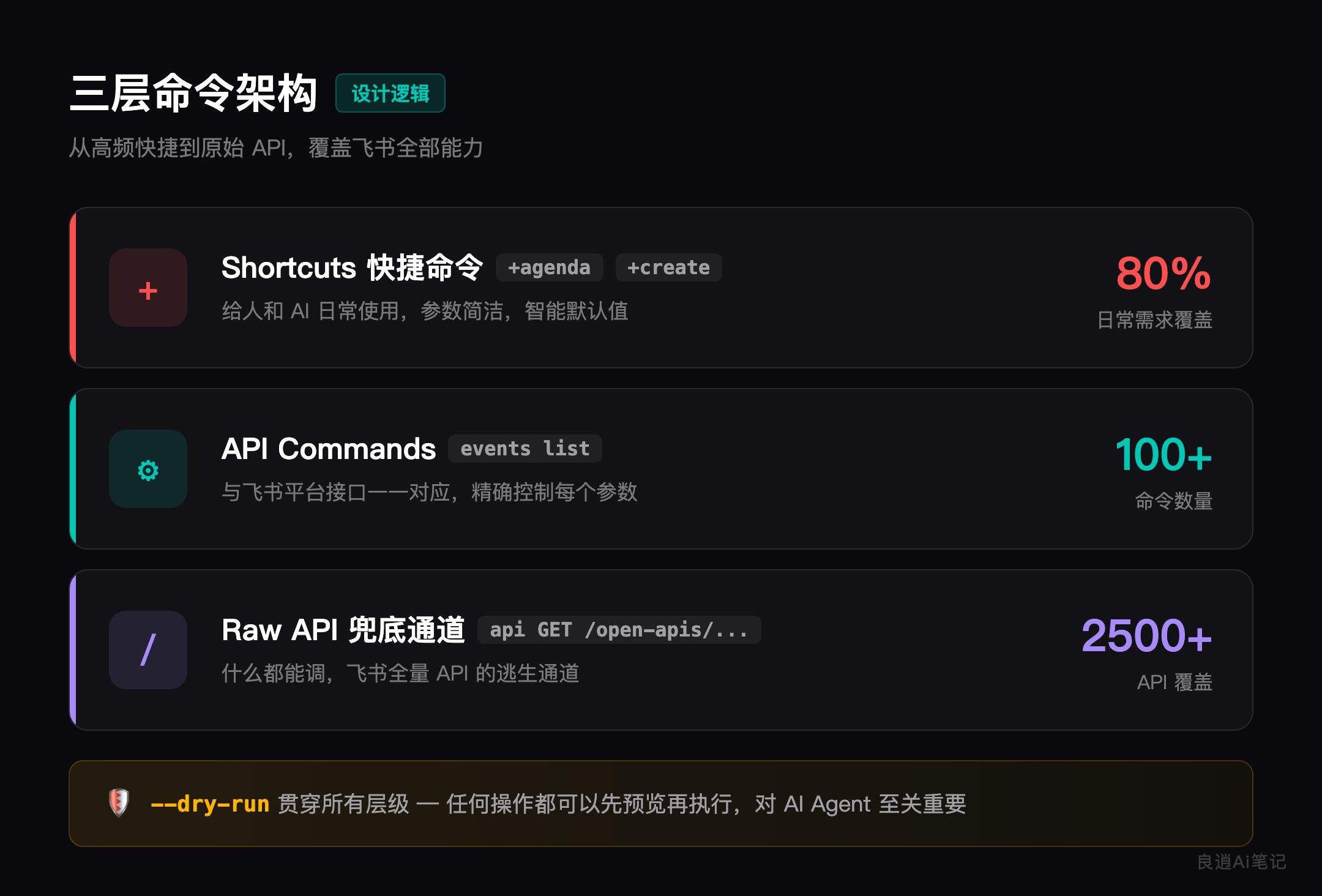

它分三层:

第一层:Shortcuts(快捷命令)

用 + 前缀标记,给人和 AI 日常使用。参数简洁,有智能默认值。

lark-cli calendar +agenda # 查今天日程

lark-cli im +chat-search --query "xxx" # 搜群

lark-cli docs +create --title "xxx" # 建文档

lark-cli task +create --title "xxx" # 建任务

lark-cli mail +triage # 看收件箱

80% 的日常需求,这一层够用了。

第二层:API Commands

100+ 个命令,和飞书平台接口一一对应。Shortcuts 满足不了的,这一层精确控制每个参数。

lark-cli calendar events list --params '{"calendar_id":"primary"}'

第三层:Raw API

覆盖飞书 2500+ 个 API 的兜底通道。什么都能调。

lark-cli api GET /open-apis/calendar/v4/calendars

这三层的设计思路很成熟:快捷入口处理高频场景,API 层给进阶用户,Raw API 作为逃生通道。

--dry-run 贯穿所有层级——任何可能有副作用的操作都可以先预览再执行。对 AI Agent 来说,这个机制至关重要。

它到底能做什么?完整能力一览

我把所有 Shortcut 命令过了一遍,按场景整理如下:

日历

| 命令 | 能力 |

|---|---|

+agenda |

查看今天/本周日程 |

+create |

创建会议、邀请参会人 |

+freebusy |

查某人是否有空 |

+suggestion |

AI 推荐可用的会议时间 |

消息

| 命令 | 能力 |

|---|---|

+messages-send |

发消息(需 bot 身份) |

+messages-search |

全局搜索聊天记录 |

+messages-reply |

回复消息 / 话题回复 |

+chat-search |

搜索群聊 |

+chat-create |

创建群聊 |

+chat-messages-list |

查看群聊历史消息 |

文档

| 命令 | 能力 |

|---|---|

+create |

创建文档 |

+fetch |

读取文档内容 |

+update |

编辑文档 |

+search |

搜索文档 / Wiki |

+media-insert |

往文档里插图片 |

邮件

| 命令 | 能力 |

|---|---|

+triage |

看收件箱摘要 |

+message |

读邮件全文 |

+send |

写邮件发送 |

+reply / +forward |

回复 / 转发 |

+watch |

实时监听新邮件 |

表格 / 多维表格

| 命令 | 能力 |

|---|---|

+read / +write / +append |

读写电子表格 |

+record-upsert / +record-list |

多维表格增删改查 |

+data-query |

数据聚合分析(JSON DSL) |

+dashboard-create |

创建仪表盘 |

任务

| 命令 | 能力 |

|---|---|

+create |

创建任务 |

+assign |

分配任务 |

+complete / +reopen |

完成 / 重开 |

+get-my-tasks |

查看我的待办 |

其他

| 场景 | 能力 |

|---|---|

| 云盘 | 上传 / 下载文件 |

| 通讯录 | 搜索用户 |

| 知识库 | 管理 Wiki 空间和节点 |

| 会议 | 搜索会议记录、查看纪要 |

真正的重点:19 个 AI 技能包

命令本身只是表层,真正有意思的是那 19 个 AI Agent 技能包。

安装完之后,你的 AI 工具自动获得了这些能力:

| 技能 | 覆盖能力 |

|---|---|

| lark-shared | 认证、配置、身份切换(所有技能自动加载) |

| lark-calendar | 日历、日程、空闲查询、时间建议 |

| lark-im | 消息、群聊、搜索、上传下载、表情回复 |

| lark-doc | 文档创建、读取、更新、搜索(Markdown) |

| lark-drive | 文件上传下载、权限管理 |

| lark-sheets | 电子表格读写、查找、导出 |

| lark-base | 多维表格全能力(字段、记录、视图、仪表盘、工作流) |

| lark-task | 任务、任务列表、子任务、提醒 |

| lark-mail | 邮件收发、草稿、搜索、实时监听 |

| lark-contact | 通讯录搜索 |

| lark-wiki | 知识库空间和节点管理 |

| lark-event | WebSocket 实时事件订阅 |

| lark-vc | 视频会议记录、会议纪要 |

| lark-whiteboard | 白板 DSL 渲染 |

| lark-minutes | 妙记(AI 摘要、待办、章节) |

| lark-openapi-explorer | API 文档探索 |

| lark-skill-maker | 自定义技能创建框架 |

| lark-workflow-meeting-summary | 会议纪要聚合工作流 |

| lark-workflow-standup-report | 日报/周报汇总工作流 |

装完这些,你在 Claude Code 里说一句"帮我查一下今天有什么会议",AI 不是去搜网页,而是直接调飞书 API,用你的身份查你的日历,然后把结果告诉你。

你的 AI 现在像一个真正的飞书用户一样在工作了。

一个很现实的问题:企业版用不了

我实测发现,企业版飞书账号目前无法激活 lark-cli,只有个人版飞书可以用。

这带来一个尴尬的问题:lark-cli 覆盖的能力——日历、消息、文档、多维表格、任务、邮件——恰恰是企业场景里才有价值的。个人用户的飞书里没有团队协作、没有项目群、没有共享文档库,很多能力发挥不出来。

你一个人用飞书查查日历、写写文档,AI 能帮上的忙有限。但如果是在一个 50 人的团队里,AI 能帮你自动汇总站会纪要、批量更新项目表格、定时发周报到群里——那才是这个工具真正该发光的地方。

B 端才是这个工具的主战场

我觉得这个工具的意义不在当下,而在接下来半年到一年。

想象一下企业版开放之后的场景:

项目经理:让 AI 每天早上自动查所有人的日历,汇总成一份"今日团队日程概览",发到项目群里。

运营团队:AI 自动从多维表格读取数据,生成周报文档,存进知识库。

技术 Leader:AI 监听群里的技术讨论,自动提取 action items,创建飞书任务并分配给对应的人。

HR:AI 自动整理面试反馈邮件,汇总到候选人跟踪表里。

这些场景在技术上 lark-cli 都已经能做了——命令和 API 都在,差的只是企业版权限的打通。

飞书出这个 CLI,不是给个人做一个好玩的小工具。它是在为企业级 AI Agent 铺路。

今天的 lark-cli 像一个预告片:能力已经 ready,生态已经搭好(19 个技能包自动注入所有主流 AI 工具),就等企业版的闸门打开。到那一天,每个企业的 AI Agent 都可以像一个真正的员工一样在飞书里工作——查日程、发消息、写文档、更新表格、跟进任务。

钉钉和企业微信应该已经在看这件事了。

安全这件事,必须认真说

既然 AI 可以直接操作你的飞书,安全问题就不是可选项了。

lark-cli 官方的安全设计:

--dry-run预览模式:执行前确认,不会真正触发操作- 输入注入防护:防止 Prompt Injection 攻击

- OS 原生密钥链存储:凭证不是明文存在配置文件里

- 终端输出净化:防止输出内容被恶意利用

但更重要的是官方给出的一条建议:

把它作为你个人的私人助手,不要把 Bot 加入到别人也在用的群聊里。

原因很简单:AI Agent 以你的身份、用你的权限在操作。如果 Agent 出现幻觉,后果由你承担。

想象一个场景:你在一个 200 人的项目群里,Agent 因为理解偏差,把一条本该私发的消息广播给了全群。这不是 bug,这是 AI Agent 本身的风险特性。

默认的安全保护机制不要随意关闭。

我的判断

我装这个工具用了不到 10 分钟,但花了更多时间在想它背后的意义。

从工具本身来说:

- 安装很顺滑,16MB,3 步搞定

- 三层命令架构设计合理,

--dry-run让人放心 - 19 个技能包自动注入所有主流 AI 工具,自动发现机制做得好

- 实测发消息、创建文档都没问题,能力是实打实的

从趋势来说:

- 这是企业级 SaaS 厂商主动适配 AI Agent 生态的先手棋

- 现在只支持个人版,但能力是按企业场景设计的——它在等 B 端的闸门打开

- 飞书之后,钉钉和企业微信大概率会跟进

- "AI Agent 的权限边界"这个问题,会越来越重要

如果你在用飞书个人版,可以花 10 分钟装一下体验。如果你是企业用户,现在还用不了,但值得关注——一旦企业版开放,这可能会改变你团队的工作方式。

快速上手

# 1. 装 CLI(需要 Node.js)

npm install -g @larksuite/cli

# 2. 装 19 个 AI 技能包(自动注入所有检测到的 AI 工具)

npx skills add larksuite/cli -y -g

# 3. 初始化(打开浏览器,一键创建飞书应用)

lark-cli config init --new

# 4. 授权登录(--recommend 自动勾选常用权限)

lark-cli auth login --recommend

# 5. 检查是否正常

lark-cli doctor

几个实用命令速查:

# 查看今日日程

lark-cli calendar +agenda

# 搜索群聊

lark-cli im +chat-search --query "群名关键词"

# 给群发消息(先确保 Bot 已在群里)

lark-cli im +messages-send --chat-id "oc_xxx" --text "消息内容" --as bot

# 创建飞书文档

lark-cli docs +create --title "文档标题" --markdown "# 内容"

# 查看我的待办

lark-cli task +get-my-tasks

# 看收件箱

lark-cli mail +triage

# 任何命令都可以加 --dry-run 预览

lark-cli im +messages-send --chat-id "oc_xxx" --text "测试" --as bot --dry-run

GitHub 仓库:https://github.com/larksuite/cli

如果你装了之后有什么有意思的玩法,或者踩了什么坑,评论区聊聊?

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)