CoPaw 安装部署教程-并配置 DashScope 与本地 Ollama

CoPaw 使用 PowerShell 安装、启动,并配置 DashScope 与本地 Ollama

一、准备工作

在开始前,先确认这几项:

- 系统是 Windows

- 能正常打开 PowerShell

- 网络可以访问 CoPaw 官网、阿里云百炼、Ollama 官网

- 如果要接入 DashScope,需要先准备好阿里云百炼 API Key

- 如果要接入本地模型,需要先安装 Ollama,并拉取至少一个本地模型

二、使用 PowerShell 安装 CoPaw

1. 打开 PowerShell

建议使用普通 PowerShell

2. 执行安装命令

直接运行:

irm https://copaw.agentscope.io/install.ps1 | iex

这是官方推荐的 Windows 一键安装方式。

三、初始化 CoPaw

安装完成后,在新终端里运行:

copaw init --defaults

四、启动 CoPaw

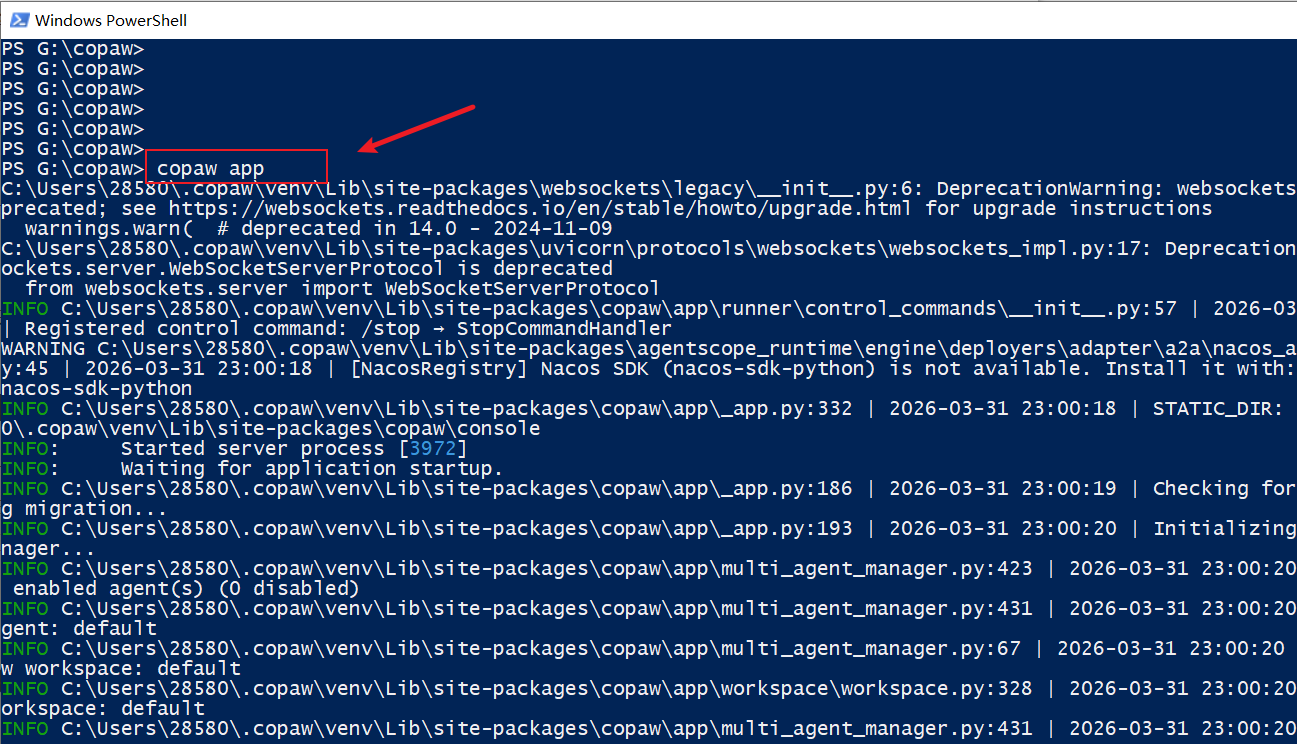

运行下面命令启动:

copaw app

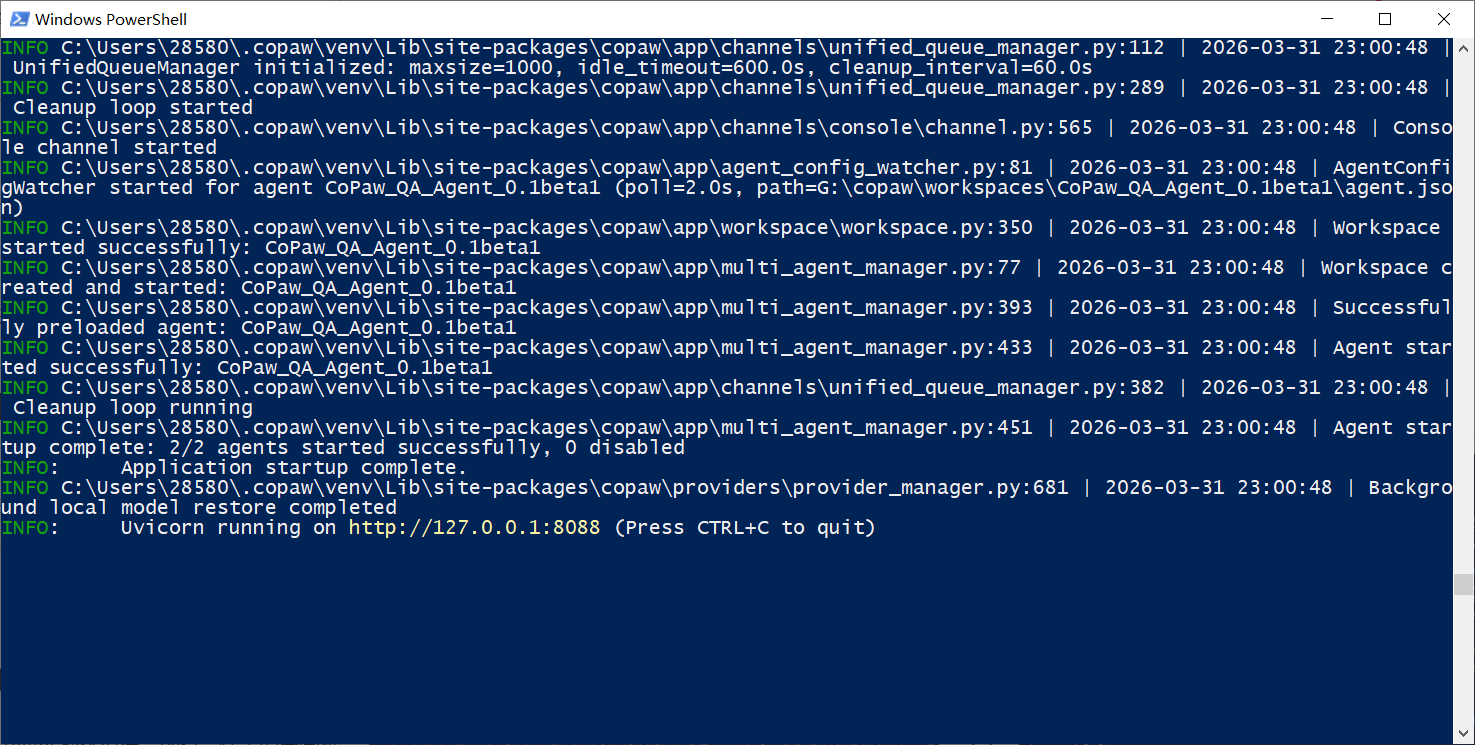

启动后,默认会监听本地地址:

http://127.0.0.1:8088

然后用浏览器打开这个地址,进入 CoPaw 控制台。

五、配置 DashScope

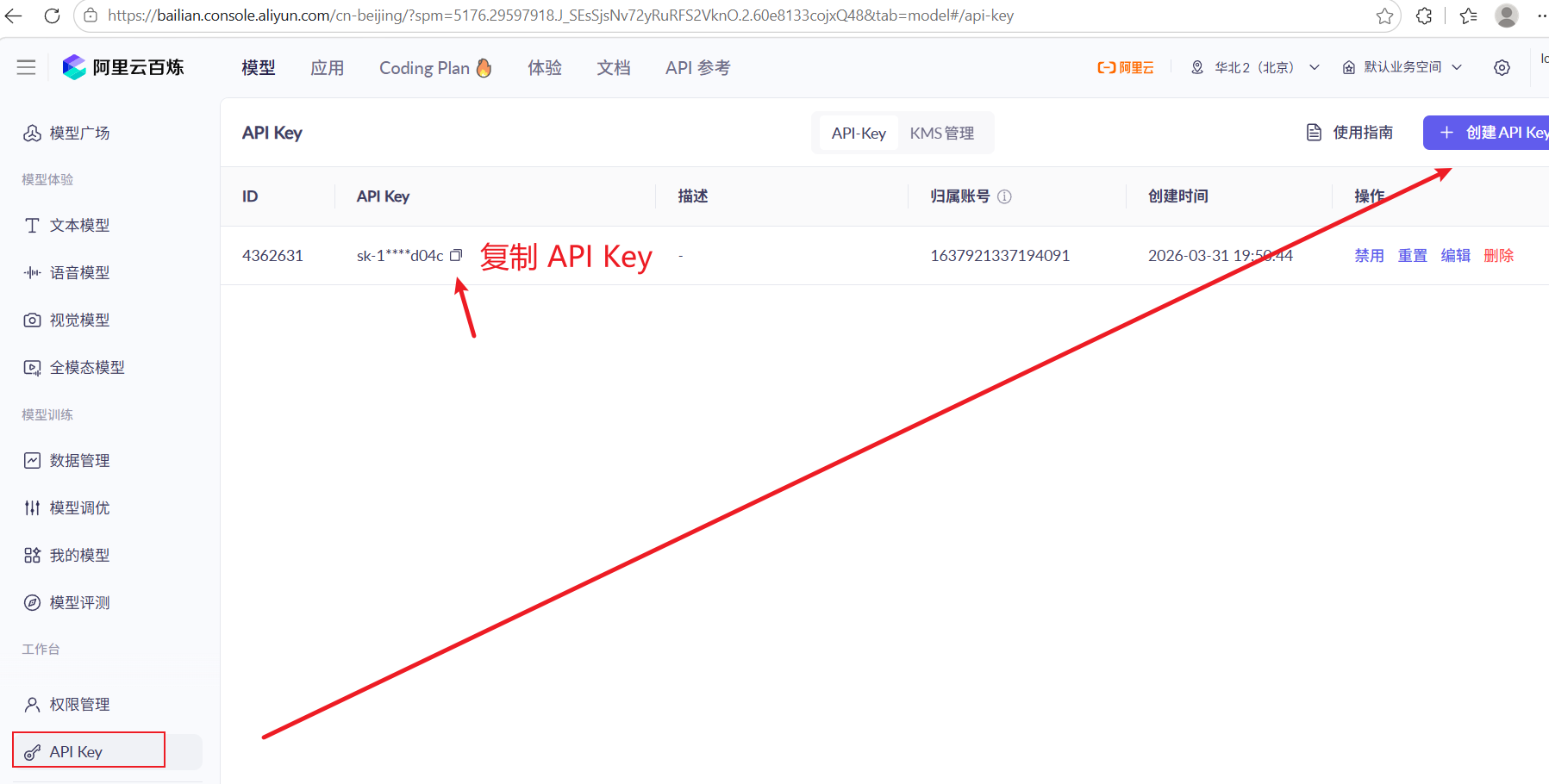

1. 获取 DashScope API Key

操作路径:

- 登录阿里云百炼控制台

https://bailian.console.aliyun.com/cn-beijing/?spm=5176.29597918.J_SEsSjsNv72yRuRFS2VknO.2.71fc133cYCeg6E&tab=model#/model-market - 进入 API Key 管理

- 创建一个新的 API Key

- 复制保存

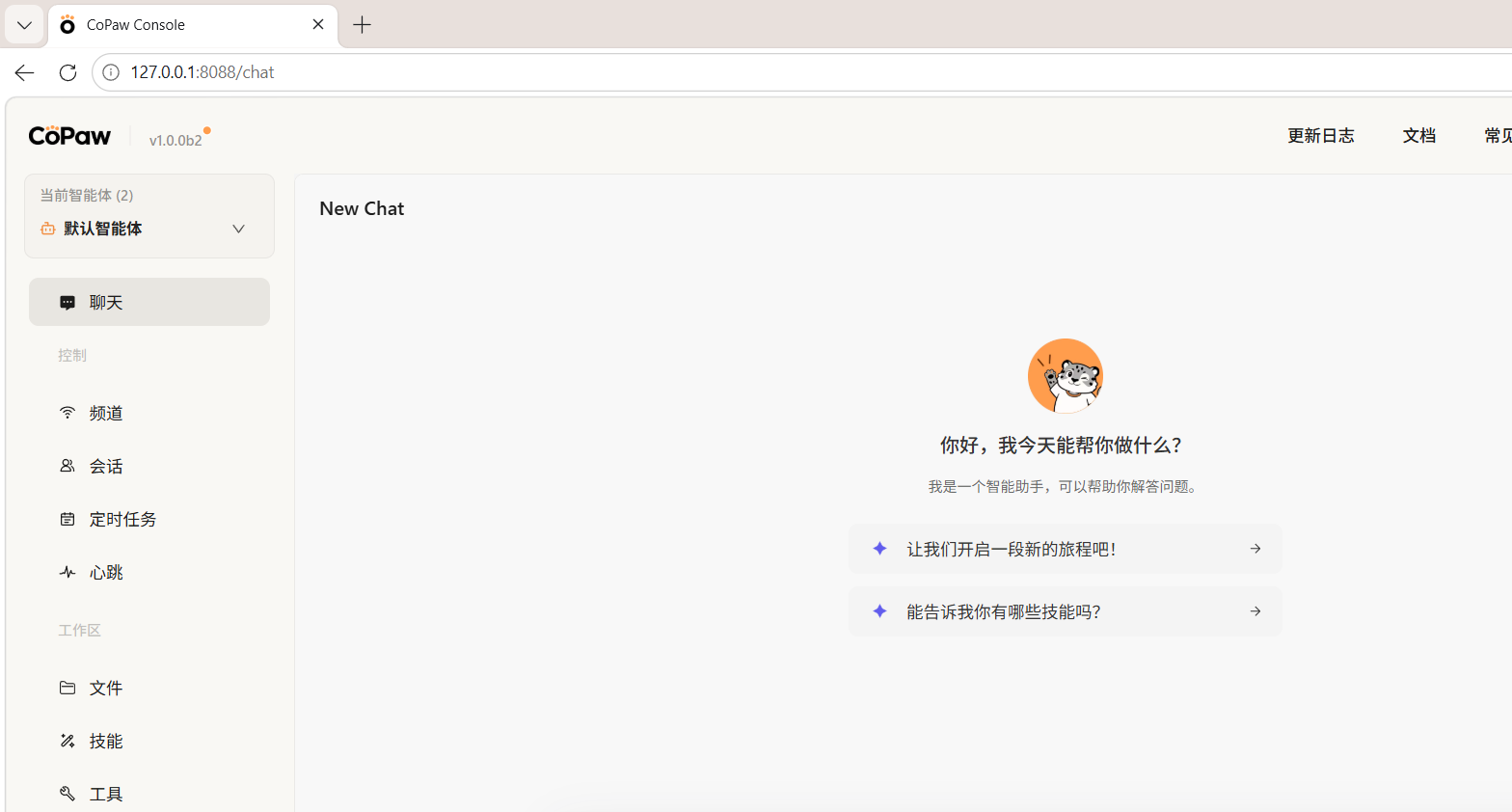

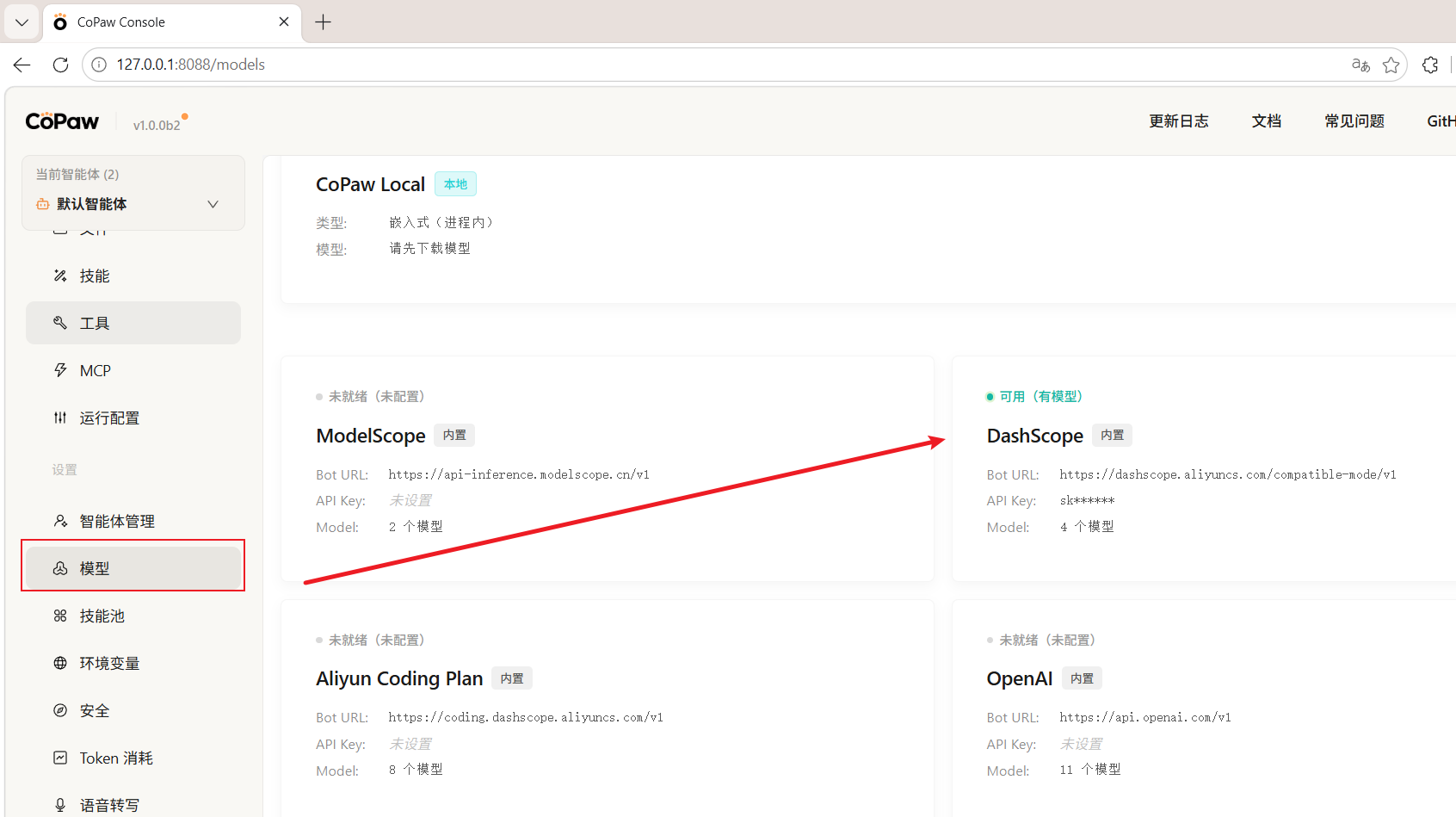

2. 打开 CoPaw 控制台的模型设置

浏览器打开:

http://127.0.0.1:8088

然后选择 “模型”:

3. 选择 DashScope 提供商

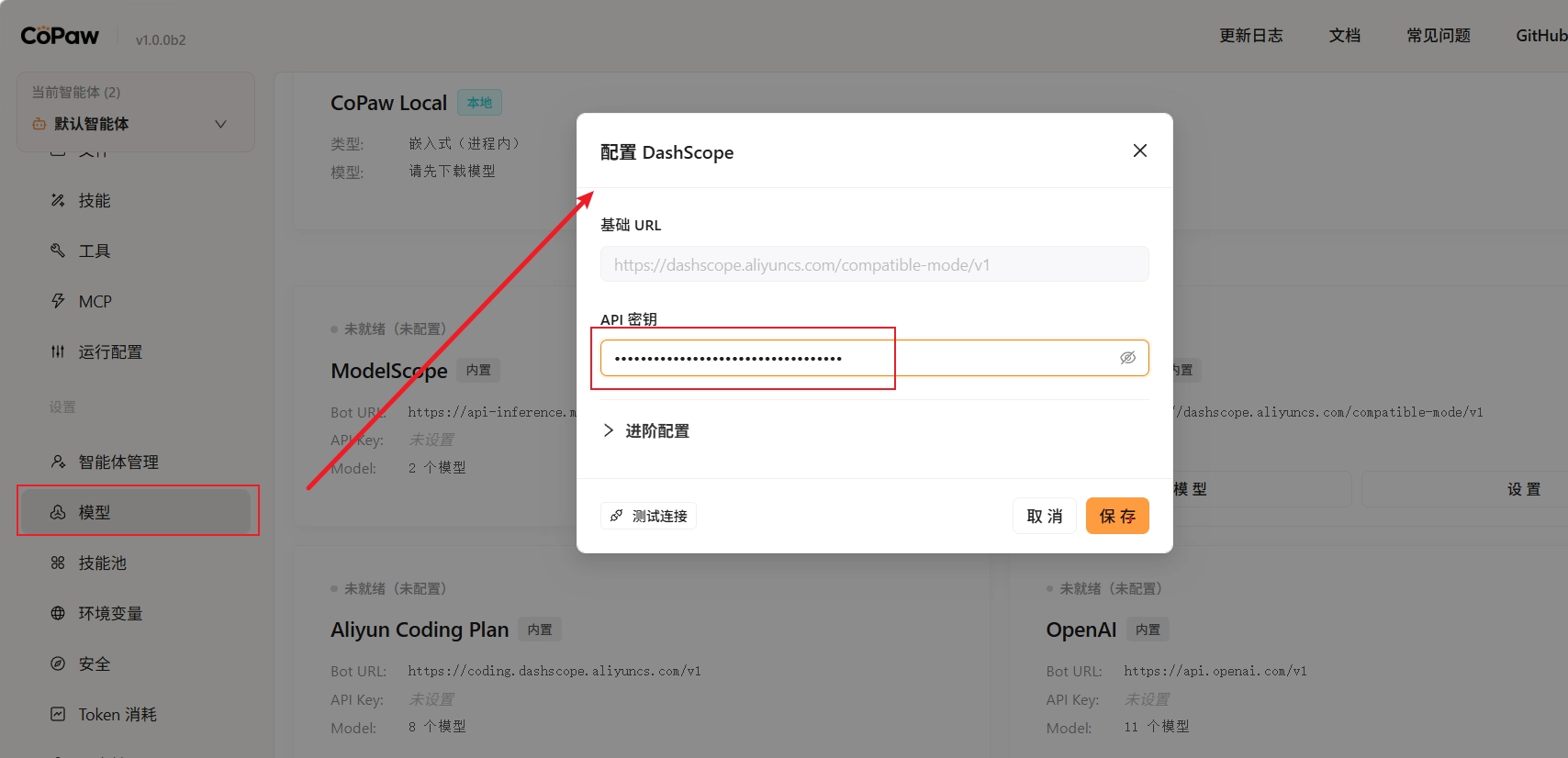

在模型提供商里选择 DashScope,然后:

-

填入 API Key

-

启用该提供商

-

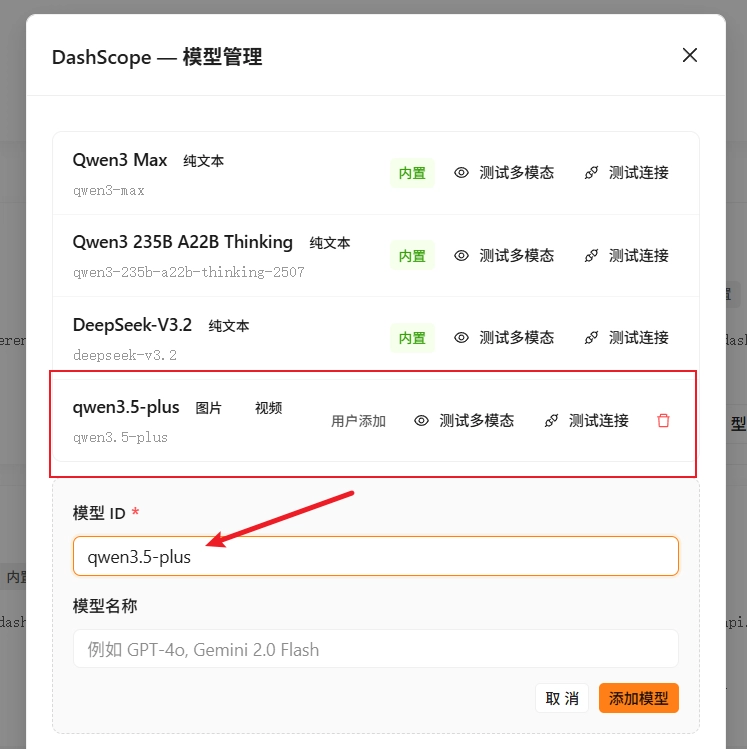

除了默认内置的模型,还支持手动添加模型,例如 在模型ID那 输入 “qwen3.5-plus” 搜索添加

-

保存配置

-

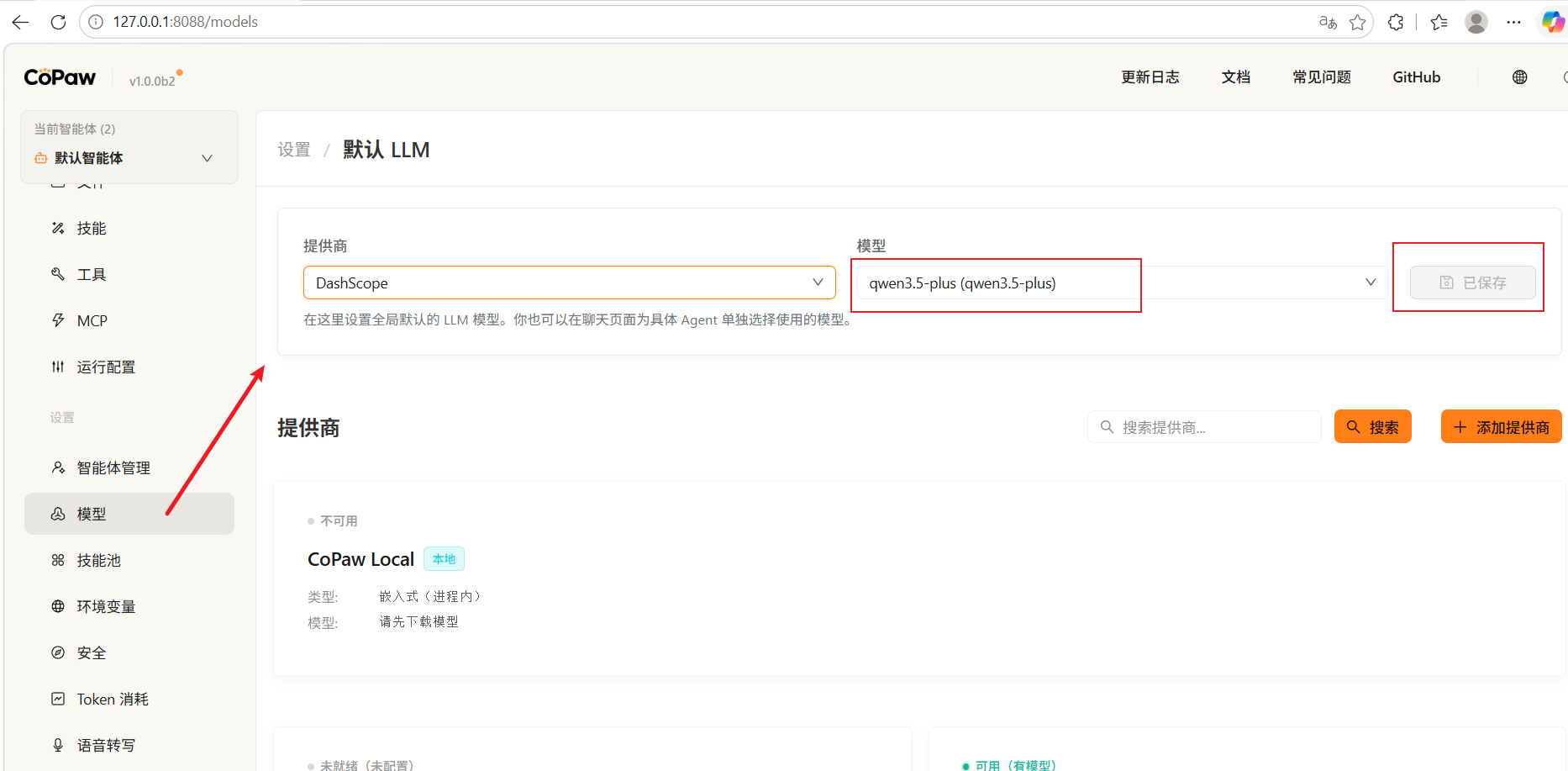

选择,设置,刚刚添加的模型,并保存

4. 测试是否生效

保存后,回到聊天界面,输入一句简单测试话,例如:

你好,做个自我介绍

如果能正常返回内容,说明 DashScope 已经配置成功。

5. qwen-3.5-plus 模型

- 该模型是 思考模型

- 该模型 支持 纯文本交流

- 该模型支持 图片、音频、视频

六、配置本地 Ollama 模型

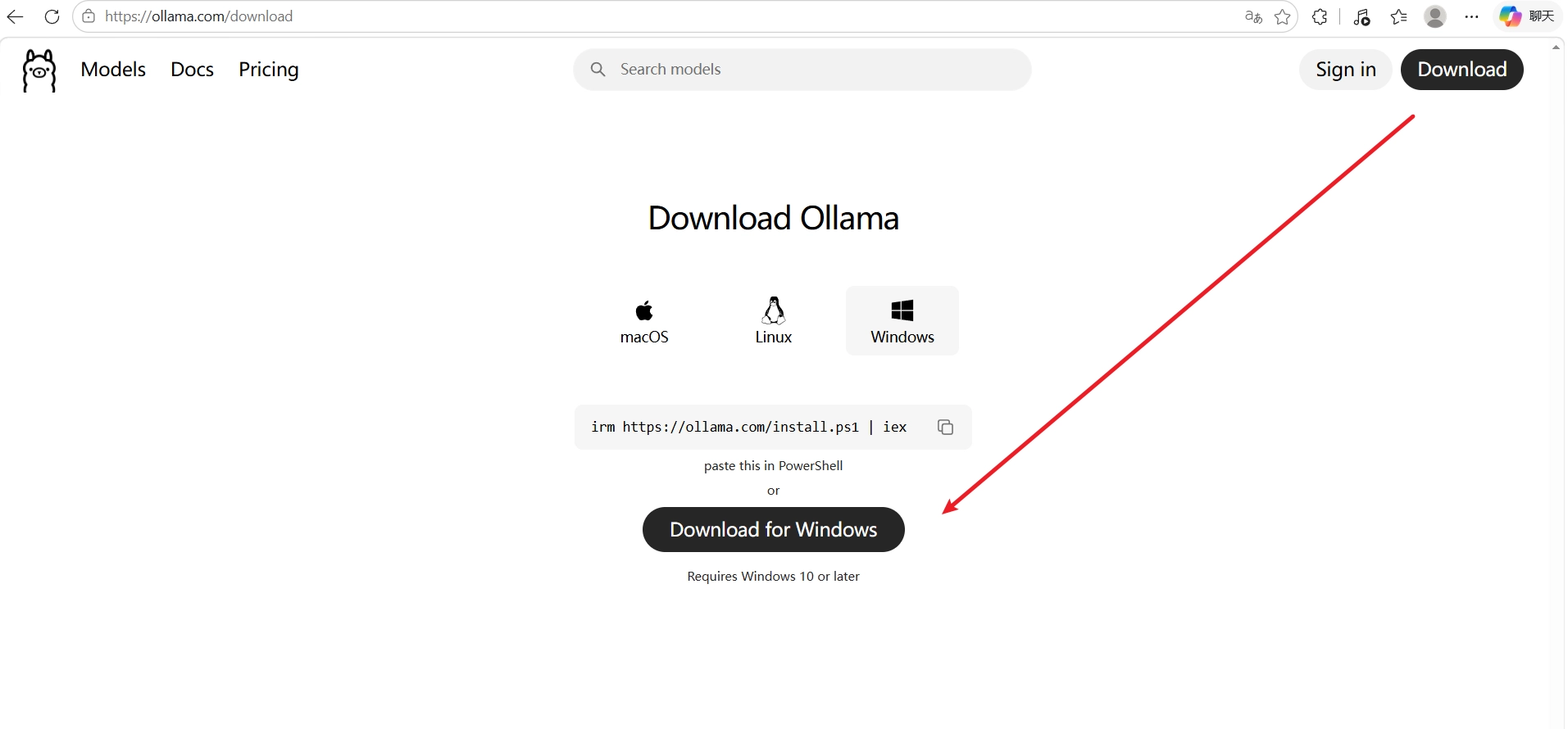

1. 先安装 Ollama

从官网下载安装:

https://ollama.com/

2. 拉取一个本地模型

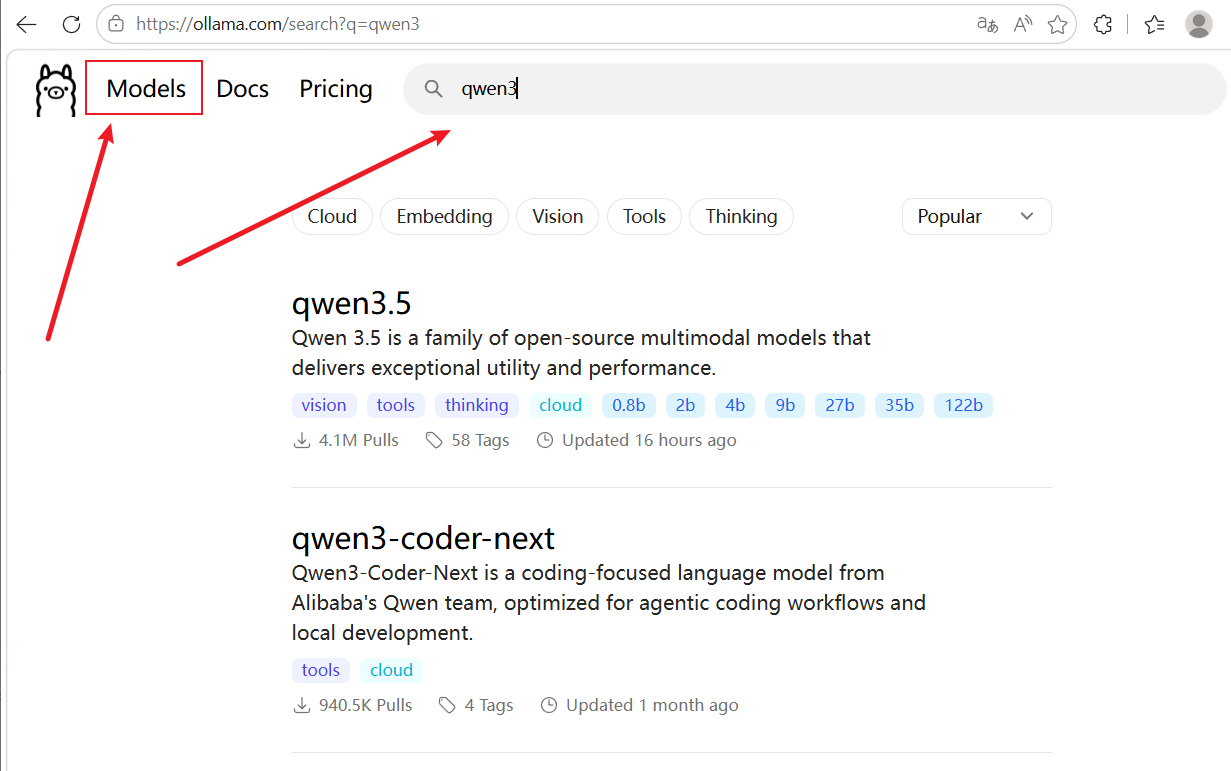

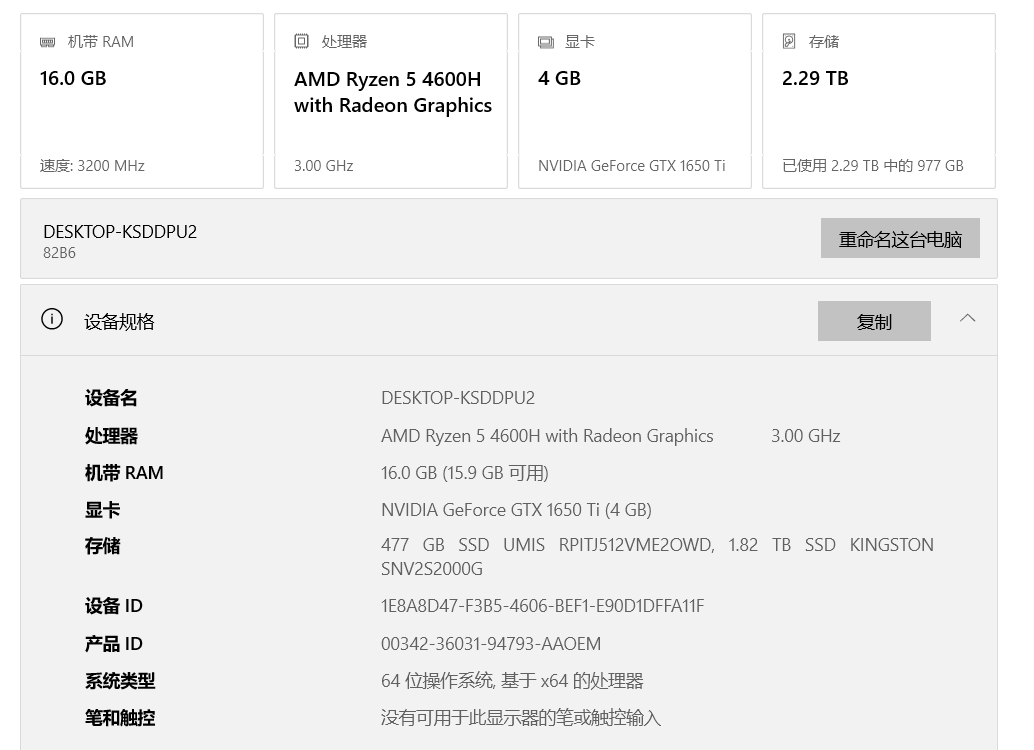

如何知道 ollama 支持哪些本地模型呢,打开 ollama 的官网,点击“模型”,找一个喜欢的模型下载即可,根据电脑配置下载2b、4b模型即可,带 ‘cloud’ 字眼的模型 看网上说是要花钱的,咱们选择免费模型,主打白嫖。

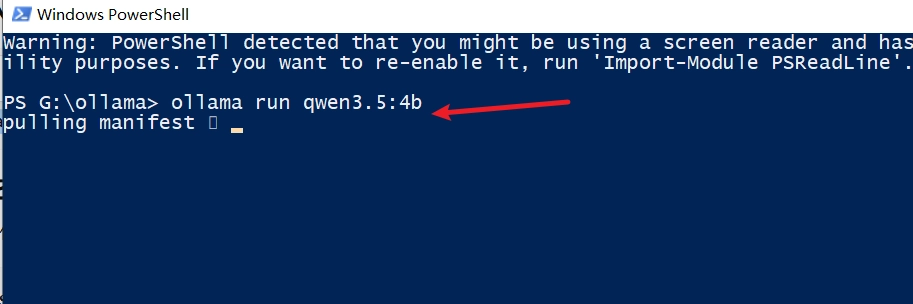

例如 在powershell中执行下面指令,拉取模型:

ollama run qwen3.5:4b

//对显卡、内存、要求较高

或 在powershell中执行下面指令,拉取模型::

ollama run sorc/qwen3.5-claude-4.6-opus:2b

//这是2b模型,对电脑配置比较低

3. 验证 Ollama 是否正常

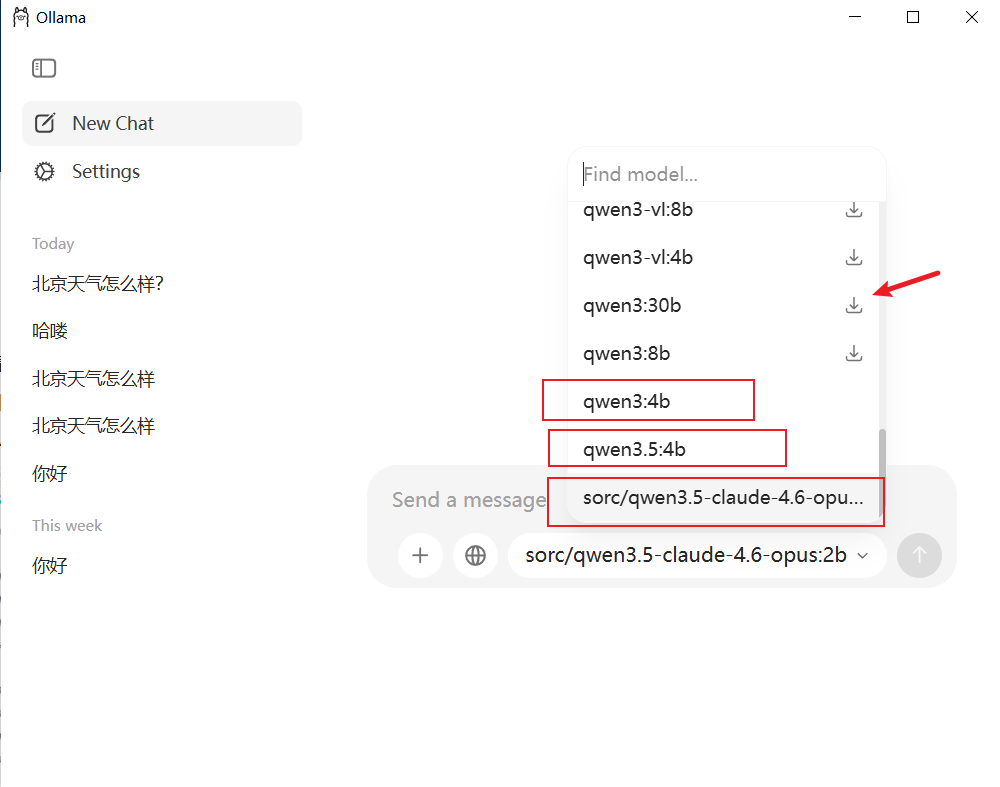

直接打开 ollama 软件,可选模型那 会自动显示本地的模型。也可以点击 模型旁边的箭头,下载。

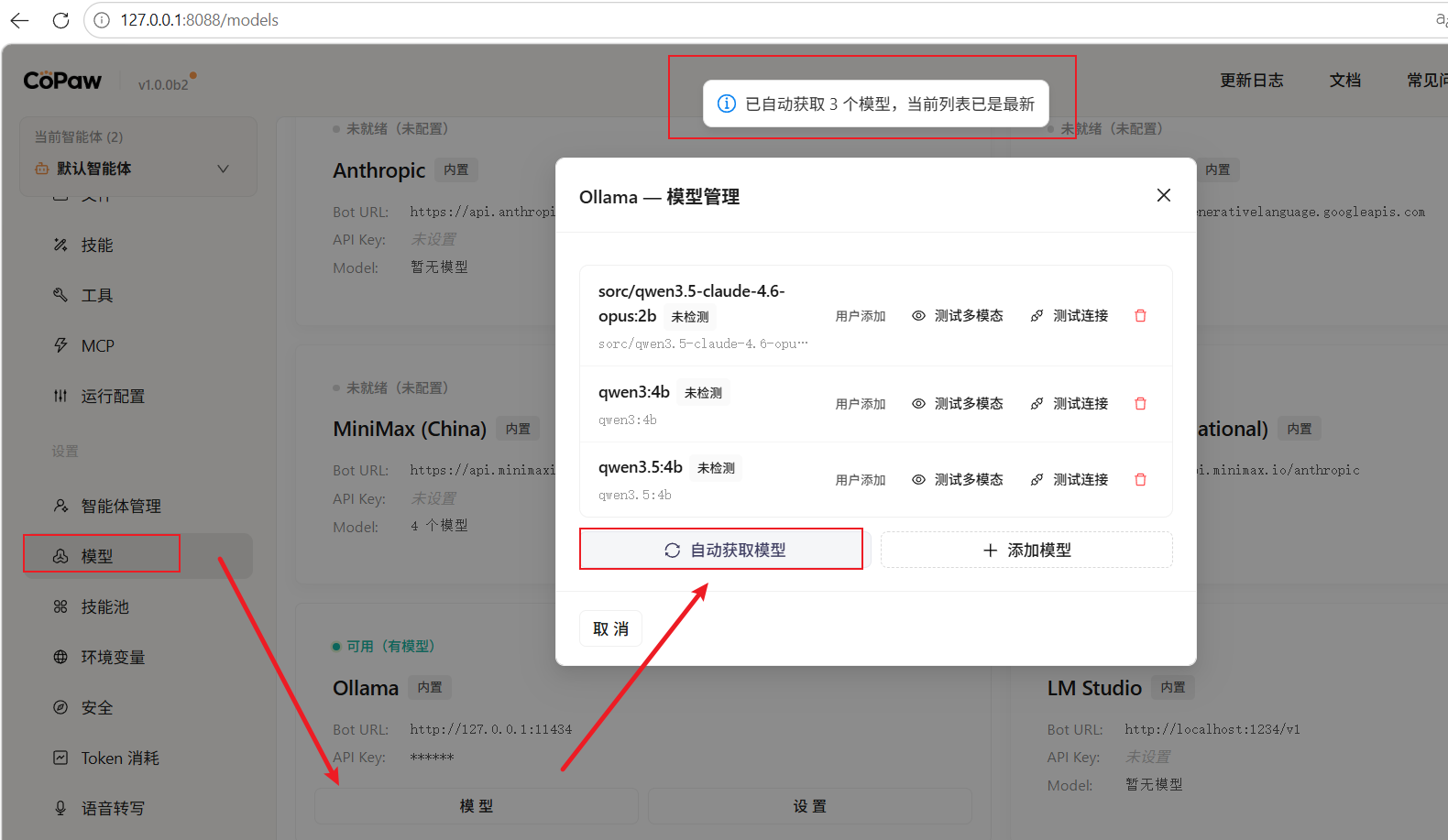

七、Ollama 接入 CoPaw

在网页的 copaw 控制页面中,选择 模型 -》Ollama 模型管理 -》自动获取模型 -》提示 “已自动获取最新模型” ,, 这就表示 copaw ,可以识别到本地的模型。

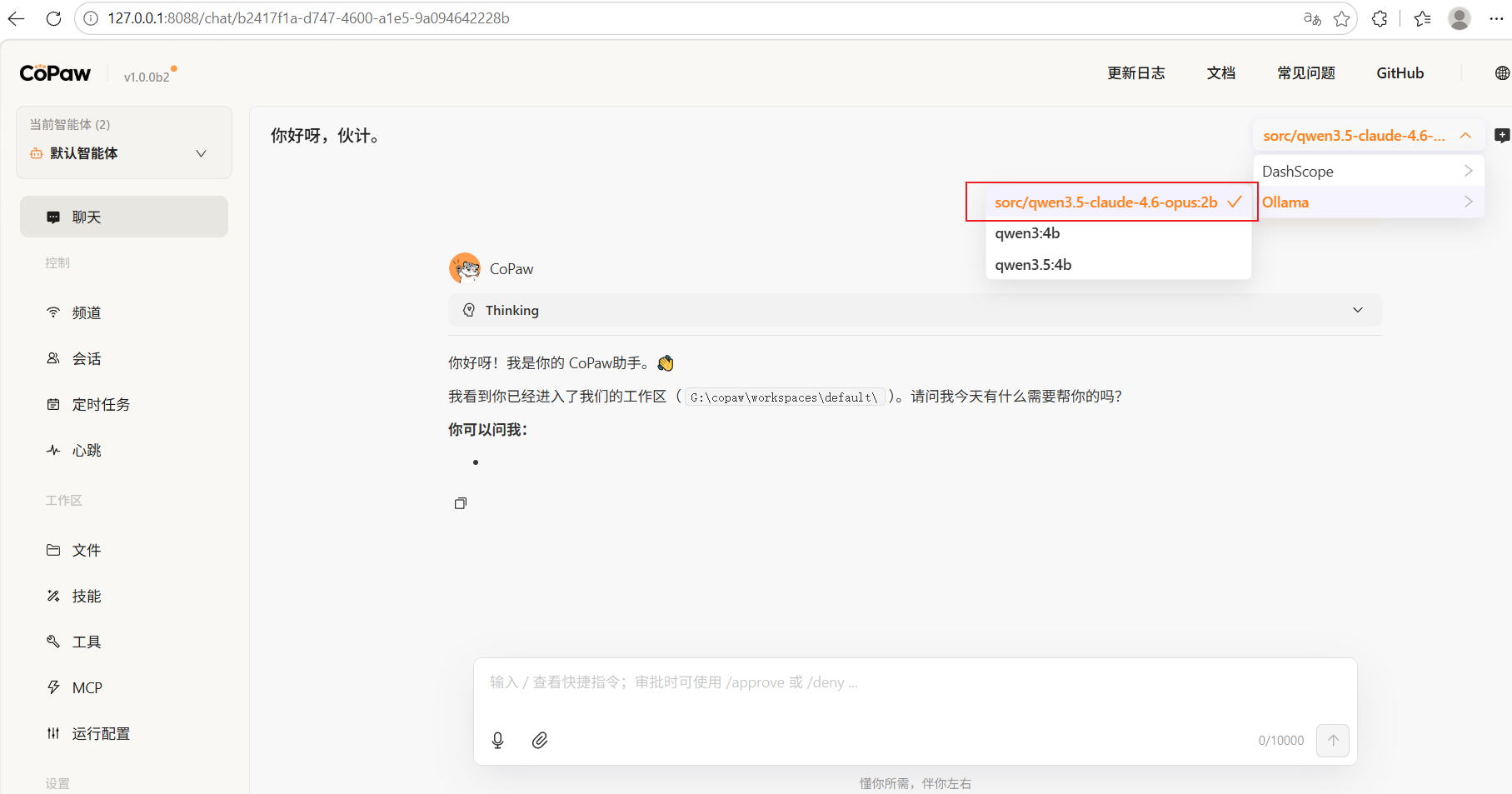

在 copaw 的聊天对话框当中,选择本地模型聊天即可,如下示例选择 “sorc/qwen3.5-claude-4.6-opus:2b” 模型进行对话,该模型是蒸馏模型,只支持文本交互,不是多模态大模型。

- 感觉下载这几个本地模型 2b,4b,在本地运行还是有些卡顿,有些慢的

八、本人电脑配置如下

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)