langchain AI应用框架研究【核心概念-篇一】

引言

langchain新版本1.1.0 出来了,老版的api看了一些,api写法看起来有些凌乱,感觉还是SpringAI相对好好记忆一些。不知到1.x版本的会好使一些不。我们先来看看新版的langchain、langgraph、deepagents。

python vscode安装了一个backformater插件,这玩意没卵用,格式化不了。python这个玩意使用缩进表达代码块,实际上没法判断你的代码在块,选中代码格式化完全没反应。即使因为缩进出现了错误(IDE都发现了),这家伙还是不会格式化。python用缩进体现代码块出这个幺蛾子不好解决了,要是它有动作,也有可能把逻辑搞乱。python用缩进做代码块,鼓吹的就是简洁优雅,实际上优雅个毛线,真的是很智障,经常手动补空格。语言充满陷阱,这玩意就只适合用来打草稿,感觉不太好,每次提到python都要吐槽😂,如果对python感兴趣可以看看我另外一篇文章,内容看起来有点多,但是都是核心部分,python不是表面上的简单。

typescript也是因为javascript这玩意也是动态类型语言,可读性和ide支持都不好,写大型AI应用或者后台服务不太好使,因为要兼容javascript,所以语法上还是有些怪。python加了个类型提示,稍微再可读性上好一点,但是需要鼠标移动到函数上从IDE提示上才能看出来。搞不好以后可能出现一个TypePython。

感兴趣的朋友可以订阅、关注和转发。你们的关注会成为我会更有动力,写得可能会更仔细一些,更新可能也会更快。

在实战中了解框架,所以内容会很多,算的上一部免费电子书了,分享一个也发发自己的光和热😘,所有内容都要经过一定验证才会写出来,不是ppt风格,只是想了解一下技术,这个就可能不太适合,因为内容会越来越多,因为篇幅较大,本文主要讲langchain。

LangChain:基础开发框架

LangChain 是一个用于开发由大语言模型(LLM)驱动的应用程序的开源框架。它的核心目标是提供一个统一的抽象层,让开发者可以方便地组合各种组件,而无需关心底层与不同模型API对接的细节。

- 核心定位:Agent 与 LLM 应用的开发框架(DSL)。它解决了“从零到一”的构建问题。

- 主要能力:

- 标准化模型接口:统一封装不同厂商(如 OpenAI、Anthropic)的模型,支持流式输出、工具调用等,避免供应商锁定。

- 结构化提示词:提供

PromptTemplate等工具,将提示词工程化、可维护。 - 工具抽象:将函数封装成 LLM 可以理解和调用的“工具”(Tool),赋予智能体行动能力。

- 预构建的智能体循环:内置了 ReAct 等经典智能体模式,可以快速搭建一个能与工具交互的智能体。

总而言之,LangChain 提供了构建智能体所需的基础组件,但它本身并不解决智能体在长时间运行中的可靠性、状态持久化等问题。

LangGraph:状态化执行引擎

LangGraph 是一个低级别的编排框架,可以看作是 LangChain 的扩展,专门用于构建和管理长期运行、有状态的智能体。它将智能体的执行过程建模为一个图(Graph),从而实现对复杂工作流的精确控制。

- 核心定位:面向智能体的状态化执行引擎(Stateful Runtime)。它解决了智能体“如何跑得稳”的问题。

- 主要能力:

- 基于图的执行模型:将智能体的工作流建模为有向图,节点(Node)代表功能模块(如 LLM 调用、工具执行),边(Edge)代表控制流。这使得支持循环、条件分支等复杂逻辑变得非常简单。

- 显式状态管理:维护一个中央状态对象(State),图中的每个节点都可以读写这个状态。这让智能体的行为变得可观测、可解释。

- 持久化执行(Durable Execution):能够自动保存执行过程中的检查点(Checkpoint)。即使任务因故障中断,也能从断点处恢复,保证了长时间运行任务的工程级可靠性。

- 人在循环(Human-in-the-loop):支持在执行过程中暂停,等待人工审核或干预,修改状态后再继续执行,这对于需要人类监督的关键任务至关重要。

LangGraph 将 LangChain 的组件作为“砖瓦”,并提供了让它们稳定、可靠、有序运行的“地基”和“脚手架”。

DeepAgents:高级智能体应用框架

DeepAgents 是一个构建在 LangChain 和 LangGraph 之上的高级智能体开发库,旨在快速构建具备自主规划、长期记忆等高级能力的复杂智能体。它不是一个从零开始的框架,而是一个“开箱即用”的智能体脚手架(Harness)。

- 核心定位:面向长期自治任务的智能体能力整合层(Harness)。它解决了如何让智能体从“稳定运行”到“高度自主”的问题。

- 主要能力:

- 任务规划与拆解:内置

write_todos等规划工具,智能体可以自动将复杂目标拆解为一系列离散的步骤,并跟踪进度。 - 上下文管理(文件系统):提供

ls,read_file,write_file等类操作系统工具,允许智能体将大量上下文信息外置到文件系统中,有效避免了上下文窗口溢出的问题。 - 子智能体生成(Subagent Spawning):主智能体可以动态创建并委派任务给专门的子智能体,实现上下文隔离和任务的并行或专注处理。

- 长期记忆:依托 LangGraph 的存储能力,实现跨会话的持久化记忆,使智能体能够记住历史交互信息,适用于个人助理、客服等场景。

- 任务规划与拆解:内置

| 组件 | 类比 | 核心职责 | 解决的问题 |

|---|---|---|---|

| LangChain | 标准零件库 | 提供电机、传感器、机械臂等通用组件。 | 解决“从零到一”的构建问题。 |

| LangGraph | 工厂控制系统 | 负责零件的组装流程、状态监控、故障恢复和人工干预。 | 解决“从一到稳定”的运行问题。 |

| DeepAgents | 高级自动化生产线 | 在控制系统之上,实现自主排产、物料管理、任务分发等高级功能。 | 解决“从稳定到自主”的智能问题。 |

1 三者关系

这三者并非相互独立的三个选项,而是一个层层递进、相互依赖的技术栈。你可以把它们看作是一个从底层到顶层的完整生态系统。为了让你一目了然,我们可以用“建造和运营一座自动化工厂”来类比它们的关系:

🧱 LangChain:基础开发框架(标准零件库)

- 角色:“提供砖瓦”

- 关系:它是整个体系的基础。LangGraph 和 DeepAgents 都构建在 LangChain 提供的抽象之上。

- 类比:它就像一个巨大的标准零件库,里面装满了电机、传感器、机械臂(即:模型接口、提示词模板、工具抽象)。它解决了“从零到一”的构建问题,让你不用自己去造轮子(比如不用自己去写连接 OpenAI 的底层代码)。

⚙️ LangGraph:状态化执行引擎(工厂控制系统)

- 角色:“提供地基与骨架”

- 关系:它是 LangChain 的扩展与核心运行时。实际上,最新版的 LangChain(1.0+)底层就是基于 LangGraph 构建的。

- 类比:它就像工厂的控制系统和地基。它负责把 LangChain 提供的零件组装起来,并确保流水线能稳定运行。它解决了“从一到稳”的问题,比如处理循环逻辑、故障恢复(持久化执行)和人工干预。

🚀 DeepAgents:高级智能体应用框架(精装生产线)

- 角色:“提供精装房”

- 关系:它构建在 LangChain 之上,并利用 LangGraph 的运行能力。它是这个技术栈的顶层应用。

- 类比:它就像一条开箱即用的精装生产线。它不仅仅是给你零件,而是直接给了你一个具备“自主规划”、“文件读写”、“长期记忆”等高级能力的智能体脚手架。它解决了“从稳到智”的问题,让你快速拥有一个像“数字员工”一样的智能体。

2 选择

简单流程:LangChain

你可以把一个简单的线性流程(A → B → C)看作是 LangGraph 图结构中最基础的一种形态。

- 如何实现:在 LangGraph 中,你只需要定义几个节点(Node),然后用普通的边(Edge)把它们按顺序连接起来即可。

- 是否必要:对于一个纯粹的、没有任何分支和循环的简单任务,直接使用 LangChain 的 LCEL 表达式会更简洁、更高效。用 LangGraph 来做,虽然完全可以,但有点像“杀鸡用牛刀”,会引入一些不必要的图结构定义代码。

复杂流程:LangGraph

LangGraph 的真正价值在于它原生支持复杂流程,这是传统线性框架的短板。

- 循环 (Loops):可以轻松实现“生成 → 审核 → 不满意则返回重新生成”的循环逻辑。

- 分支 (Branching):可以根据上一步的结果,动态决定下一步走向哪个节点。例如,根据用户意图,将流程路由到“客服节点”或“技术支持节点”。

- 状态管理 (State):在整个复杂流程中,有一个全局共享的状态对象,所有节点都可以读写,确保数据在不同步骤间无缝传递。

- 持久化 (Persistence):支持“时间旅行”功能,可以将流程的每一步状态保存下来。即使程序中断,也能从断点恢复,这对于长时间运行的复杂任务至关重要。

进阶:DeepAgents

这是你的加速器。 当你发现 LangChain 写起来太累,或者你需要一个能“自己干活”的智能体时,选它。

- 适用场景:

- 需要智能体自主规划任务(比如:“帮我调研一下竞品,写个报告”)。

- 任务非常长,需要跨会话记忆(比如:个人助理,需要记住你上周的偏好)。

- 需要处理大量文件(利用其内置的文件系统工具)。

- 理由:

- 开箱即用:它帮你把规划、记忆、文件读写这些复杂功能都写好了,你直接配置一下就能用,不用自己造轮子。

📜 官方建议翻译

LangChain 对比 LangGraph 对比 Deep Agents

如果你打算构建一个智能体,我们建议你从 Deep Agents 开始。它采用了“开箱即用”的模式,内置了各种现代特性,例如:长对话的自动压缩、虚拟文件系统,以及用于管理和隔离上下文的子智能体生成能力。

Deep Agents 本质上是 LangChain 智能体的具体实现。如果你不需要上述这些高级能力,或者希望为自己的智能体和自主应用进行深度定制,那么请从 LangChain 开始。

当你有更高级的需求,需要结合“确定性工作流”与“智能体工作流”,并且需要进行大量定制化开发时,请使用 LangGraph —— 这是我们底层的智能体编排框架和运行时引擎。

说了这么多,基本上有一定的认识,具体也要用了之后应该就能体会更深刻,下面主要针对1.1.0最新稳定的版本

官方哲学

LangChain 的核心信念可以概括为以下几点:

- 大型语言模型(LLM)是一项强大且极具潜力的新技术。

- 当 LLM 与外部数据源相结合时,其能力将得到更进一步的提升。

- LLM 将重塑未来应用的形态。具体而言,未来的应用将越来越趋向于“智能体化”(agentic)。

- 目前,这场变革仍处于非常早期的阶段。

- 尽管构建此类智能体化应用的原型相对容易,但要开发出足够可靠、能够投入生产环境的智能体,仍然极具挑战。

所以这个还处于迅速发展阶段,工程化要有所选择,不然就是你都还没有投产,新的又来了,搞得你无所适从。

3 quick start

本地python版本使用的是3.13.5 官方推荐是3.10+

3.1 安装langchain

使用命令:poetry add langchain 安装

Using version ^1.2.14 for langchain

Updating dependencies

Resolving dependencies... (7.9s)

Package operations: 32 installs, 0 updates, 0 removals

- Installing certifi (2026.2.25)

- Installing charset-normalizer (3.4.6)

- Installing h11 (0.16.0)

- Installing idna (3.11)

- Installing typing-extensions (4.15.0)

- Installing urllib3 (2.6.3)

- Installing annotated-types (0.7.0)

- Installing anyio (4.13.0)

- Installing requests (2.33.1)

- Installing pydantic-core (2.41.5)

- Installing typing-inspection (0.4.2)

- Installing httpcore (1.0.9)

- Installing orjson (3.11.8)

- Installing packaging (26.0)

- Installing requests-toolbelt (1.0.0)

- Installing pydantic (2.12.5)

- Installing jsonpointer (3.1.1)

- Installing uuid-utils (0.14.1)

- Installing httpx (0.28.1)

- Installing xxhash (3.6.0)

- Installing zstandard (0.25.0)

- Installing jsonpatch (1.33)

- Installing langsmith (0.7.23)

- Installing tenacity (9.1.4)

- Installing pyyaml (6.0.3)

- Installing langchain-core (1.2.23)

- Installing ormsgpack (1.12.2)

- Installing langgraph-checkpoint (4.0.1)

- Installing langgraph-prebuilt (1.0.8)

- Installing langgraph-sdk (0.3.12)

- Installing langgraph (1.1.4)

- Installing langchain (1.2.14)看上面的版本,已经到了1.2.14,发展很快,AI应用API是在快速发展中,这玩意要是重度使用,每次迁移成本都很高。python语言和其生态兼容性都比较差,大家都是图块,没人会管你,有些人搞烂了,就开始想找工程师做工程化收拾烂摊子,实际上只有自己搞的人才是最适合收拾烂摊子的,图快总得付出点代价😊。python本身工程化能力就很弱,现在各种标准和最佳实践还在演进。

安装langchain的同时也安装了langgraph,版本是1.1.4,没有看见deepagents

3.2 安装langchain-ollama

这里我使用ollama安装本地模型,所以安装这个模型依赖,其他的可以根据具体需求安装

poetry add langchain-ollama

# Installing the OpenAI integration

pip install -U langchain-openai

# Installing the Anthropic integration

pip install -U langchain-anthropic3.3 简单聊天测试

3.3.1 模型直接调用

from langchain_ollama import ChatOllama

def test_chat_model():

# 初始化模型,默认连接 http://localhost:11434

llm = ChatOllama(

model="qwen3:8b", # 替换为你通过 `ollama pull` 下载的模型名

temperature=0.7,

base_url="http://localhost:11434",

)

response = llm.invoke("你好,请介绍一下自己")

print(response)

test_chat_model()

print('finish')输出是一个AIMessage 对象,这玩意一点都不好跟踪代码,点击进去看源码,感觉就是一团糟。不先写个response.content,你直接在response对象上还跳不到AIMessage,IDE提示不了。要么通过invoke跳过去,再通过类型提示跳到源码。我也是醉了。

content='你好!我是通义千问,由通义实验室研发的超大规模语言模型。我具备广泛的知识和强大的语言理解能力,可以回答各种问题、创作文字、编程、逻辑推理等。我的目标是成为您可靠的助手,帮助您解决各种问题和完成任务。有什么我可以帮您的吗?' additional_kwargs={} response_metadata={'model': 'qwen3:8b', 'created_at': '2026-04-01T03:41:06.349658Z', 'done': True, 'done_reason': 'stop', 'total_duration': 88827315600, 'load_duration': 76283938800, 'prompt_eval_count': 14, 'prompt_eval_duration': 417483900, 'eval_count': 377, 'eval_duration': 12089060800, 'logprobs': None, 'model_name': 'qwen3:8b', 'model_provider': 'ollama'} id='lc_run--019d4720-0aba-7cc3-9c23-9f3ef121dcea-0' tool_calls=[] invalid_tool_calls=[] usage_metadata={'input_tokens': 14, 'output_tokens': 377, 'total_tokens': 391}实际上需要用的是content,我也看过别人写热文章,也是慢慢分析返回的字段内容来找想要的而结果。我这里用的是本地模型,如果要用网上的,需要到对应官网开通权限,拿到访问的API_KEY,设置环境变量,才可以访问。如果是像java这种强静态类型语言,直接看response结构,基本上能知道会拿到什么结果,那些字段是自己想要的。

3.2.2 模型参数

原始模型参数,这玩意参数,多

pip install -U langchain

# Requires Python 3.10+

class ChatOllama(

name: str | None,

cache: BaseCache | bool | None,

verbose: bool,

callbacks: Callbacks,

tags: list[str] | None,

metadata: dict[str, Any] | None,

custom_get_token_ids: ((str) -> list[int]) | None,

rate_limiter: BaseRateLimiter | None,

disable_streaming: bool | Literal['tool_calling'],

output_version: str | None,

profile: ModelProfile | None,

model: str,

reasoning: bool | str | None,

validate_model_on_init: bool,

mirostat: int | None,

mirostat_eta: float | None,

mirostat_tau: float | None,

num_ctx: int | None,

num_gpu: int | None,

num_thread: int | None,

num_predict: int | None,

repeat_last_n: int | None,

repeat_penalty: float | None,

temperature: float | None,

seed: int | None,

stop: list[str] | None,

tfs_z: float | None,

top_k: int | None,

top_p: float | None,

format: JsonSchemaValue | Literal['', 'json'] | None,

keep_alive: int | str | None,

base_url: str | None,

client_kwargs: dict | None,

async_client_kwargs: dict | None,

sync_client_kwargs: dict | None

)网上查了一些解释

# Requires Python 3.10+

class ChatOllama(

# === 核心基础参数 ===

model: str, # [必填] 模型名称,例如 "qwen2.5:7b" 或 "llama3"。必须与 Ollama 本地运行的模型名称匹配。

# === 核心推理参数 (最常用) ===

temperature: float | None, # [推荐] 采样温度 (0.0 - 1.0)。值越低越确定(适合逻辑/代码),值越高越随机(适合创意写作)。

top_p: float | None, # [推荐] 核采样阈值。与 temperature 配合使用,通常建议二选一,不要同时调整。

top_k: int | None, # [推荐] 限制采样时考虑的 top-k 个 token 数量。

num_predict: int | None, # [推荐] 模型生成的最大 token 数量(即回答的长度)。

stop: list[str] | None, # [推荐] 停止生成的词元列表。遇到列表中的任何一个词元,生成即停止。

# === 上下文与窗口 ===

num_ctx: int | None, # [重要] 上下文窗口大小(最大 token 数)。默认通常为 2048。如果对话变长或输入文本很大,需要调大此值。

# === 高级推理控制 ===

repeat_penalty: float | None, # 重复惩罚系数。值越大,模型越不容易重复生成相同的短语。

repeat_last_n: int | None, # 考虑重复惩罚的最近 n 个 token 数量。

seed: int | None, # 随机种子。设置固定的种子可以保证生成的确定性(如果其他参数也固定)。

tfs_z: float | None, # 尾部自由采样 (Tail-Free Sampling)。用于减少低概率 token 的长尾影响。

mirostat: int | None, # 启用 Mirostat 采样算法 (1 或 2)。这是一种控制生成文本惊喜度的算法。

mirostat_tau: float | None, # Mirostat 算法的目标熵值(控制输出的随机性)。

mirostat_eta: float | None, # Mirostat 算法的学习率。

# === 硬件与性能 ===

num_thread: int | None, # 运行时使用的 CPU 线程数。

num_gpu: int | None, # 指定使用的 GPU 层数(用于控制显存占用)。

# === 连接与客户端配置 ===

base_url: str | None, # Ollama API 的基础 URL。默认为 "http://localhost:11434"。

keep_alive: int | str | None, # 模型在 Ollama 中保持加载状态的时间(例如 "5m" 或 300 秒)。

client_kwargs: dict | None, # 传递给同步 HTTP 客户端的额外参数。

async_client_kwargs: dict | None, # 传递给异步 HTTP 客户端的额外参数。

sync_client_kwargs: dict | None, # 传递给同步客户端的特定参数。

# === 输出格式控制 ===

format: JsonSchemaValue | Literal['', 'json'] | None, # 强制输出格式。设置为 "json" 可强制模型返回 JSON 格式,或传入 JSON Schema 进行结构化输出。

# === LangChain 集成与内部参数 (通常无需手动修改) ===

name: str | None, # 此 LLM 实例在 LangChain 链中的名称。

cache: BaseCache | bool | None, # 是否启用响应缓存。

verbose: bool, # 是否打印详细的调试信息。

callbacks: Callbacks, # LangChain 的回调函数列表。

tags: list[str] | None, # 用于标记此 LLM 实例的标签。

metadata: dict[str, Any] | None, # 附加的元数据。

custom_get_token_ids: ((str) -> list[int]) | None, # 自定义的 Tokenizer 函数。

rate_limiter: BaseRateLimiter | None, # 速率限制器,防止请求过快。

disable_streaming: bool | Literal['tool_calling'], # 是否禁用流式输出。

output_version: str | None, # 输出消息的版本格式。

profile: ModelProfile | None, # 模型配置文件,用于自动调整参数。

reasoning: bool | str | None, # 是否启用推理模式(针对特定模型)。

validate_model_on_init: bool # 初始化时是否验证模型是否存在。

)搞了一个表格

| 参数名称 | 类型 | 说明 |

|---|---|---|

| 核心基础 | ||

model |

str |

[必填] 模型名称,如 "qwen2.5:7b"。需与本地 Ollama 运行的模型一致。 |

| 推理控制 | ||

temperature |

float |

[常用] 采样温度 (0.0 - 1.0)。越低越确定(逻辑/代码),越高越随机(创意)。 |

top_p |

float |

[常用] 核采样阈值。通常与 temperature 二选一调整。 |

top_k |

int |

[常用] 限制采样时考虑的 top-k 个 token 数量。 |

num_predict |

int |

[常用] 模型生成的最大 token 数量(回答长度)。 |

stop |

list[str] |

[常用] 停止词元列表。遇到任意一个即停止生成。 |

repeat_penalty |

float |

重复惩罚系数。值越大,越不容易重复生成相同的短语。 |

repeat_last_n |

int |

考虑重复惩罚的最近 n 个 token 数量。 |

seed |

int |

随机种子。固定种子可保证生成的确定性。 |

tfs_z |

float |

尾部自由采样。用于减少低概率 token 的长尾影响。 |

mirostat |

int |

启用 Mirostat 采样算法 (1 或 2),用于控制生成文本的惊喜度。 |

mirostat_tau |

float |

Mirostat 算法的目标熵值(控制输出的随机性)。 |

mirostat_eta |

float |

Mirostat 算法的学习率。 |

| 上下文与硬件 | ||

num_ctx |

int |

[重要] 上下文窗口大小(最大 token 数)。默认通常 2048,长文本需调大。 |

num_thread |

int |

运行时使用的 CPU 线程数。 |

num_gpu |

int |

指定使用的 GPU 层数(用于控制显存占用)。 |

| 连接与配置 | ||

base_url |

str |

Ollama API 地址。默认 "http://localhost:11434"。 |

keep_alive |

int/str |

模型在 Ollama 中保持加载状态的时间(如 "5m" 或 300)。 |

client_kwargs |

dict |

传递给同步 HTTP 客户端的额外参数。 |

async_client_kwargs |

dict |

传递给异步 HTTP 客户端的额外参数。 |

sync_client_kwargs |

dict |

传递给同步客户端的特定参数。 |

| 输出格式 | ||

format |

str/dict |

强制输出格式。设为 "json" 强制返回 JSON,或传入 JSON Schema。 |

| LangChain 集成 | ||

name |

str |

此 LLM 实例在 LangChain 链中的名称。 |

cache |

bool |

是否启用响应缓存。 |

verbose |

bool |

是否打印详细的调试信息。 |

callbacks |

Callbacks |

LangChain 的回调函数列表。 |

tags |

list[str] |

用于标记此 LLM 实例的标签。 |

metadata |

dict |

附加的元数据。 |

custom_get_token_ids |

func |

自定义的 Tokenizer 函数。 |

rate_limiter |

BaseRateLimiter |

速率限制器,防止请求过快。 |

disable_streaming |

bool |

是否禁用流式输出。 |

output_version |

str |

输出消息的版本格式。 |

profile |

ModelProfile |

模型配置文件,用于自动调整参数。 |

reasoning |

bool/str |

是否启用推理模式(针对特定模型)。 |

validate_model_on_init |

bool |

初始化时是否验证模型是否存在。 |

基本的都加粗了。

3.4 工具调用

这里演示一个直接注册工具的一个官方例子

3.4.1 调用工具代码

from langchain.agents import create_agent

from langchain_ollama import ChatOllama

def get_weather(city: str) -> str:

"""Get weather for a given city."""

return f"It's always sunny in {city}!"

def test_tool_call_by_agents():

modelStr = "qwen3:8b";

chatModel = ChatOllama(

model=modelStr,

temperature=0.7,

base_url="http://localhost:11434",

)

agent = create_agent(

# model=modelStr,

model=chatModel,

tools=[get_weather],

system_prompt="You are a helpful assistant",

)

# Run the agent

result = agent.invoke(

{"messages": [{"role": "user", "content": "what is the weather in sf"}]}

)

print(result)

test_tool_call_by_agents()

3.4.2 返回值

result是个字典,草这玩意真是,就像看见一个java程序员,所有入参和返回值都用Ojbect一样。

{

"messages": [

{

"role": "user",

"type": "HumanMessage",

"content": "what is the weather in sf",

"id": "a1261883-6677-4082-84d9-cbd9a2f24209"

},

{

"role": "assistant",

"type": "AIMessage",

"content": "",

"id": "lc_run--019d47cc-9c2b-7433-ab56-ecb9909de0a5-0",

"tool_calls": [

{

"id": "36886be6-6441-49d5-b364-cab6137452b0",

"name": "get_weather",

"args": {

"city": "San Francisco"

},

"type": "tool_call"

}

],

"usage_metadata": {

"input_tokens": 148,

"output_tokens": 105,

"total_tokens": 253

},

"response_metadata": {

"model": "qwen3:8b",

"created_at": "2026-04-01T06:48:11.9092517Z",

"model_provider": "ollama"

}

},

{

"role": "tool",

"type": "ToolMessage",

"name": "get_weather",

"content": "It's always sunny in San Francisco!",

"id": "0c827960-37e2-4c37-b37a-4d76ed4f3321",

"tool_call_id": "36886be6-6441-49d5-b364-cab6137452b0"

},

{

"role": "assistant",

"type": "AIMessage",

"content": "The weather in San Francisco is sunny! ☀️ It's one of the best things about the city—always a bright day ahead. Let me know if you need more details!",

"id": "lc_run--019d47cc-b789-78b1-9a0a-dad8552c7eef-0",

"tool_calls": [],

"usage_metadata": {

"input_tokens": 188,

"output_tokens": 136,

"total_tokens": 324

},

"response_metadata": {

"model": "qwen3:8b",

"created_at": "2026-04-01T06:48:16.6699577Z",

"model_provider": "ollama"

}

}

],

"finish": "finish"

}这一条是调用工具返回的信息

{

"role": "tool",

"type": "ToolMessage",

"name": "get_weather",

"content": "It's always sunny in San Francisco!",

"id": "0c827960-37e2-4c37-b37a-4d76ed4f3321",

"tool_call_id": "36886be6-6441-49d5-b364-cab6137452b0"

}

下面这一条是模型拿到工具返回信息后,优化的内容

{

"role": "assistant",

"type": "AIMessage",

"content": "The weather in San Francisco is sunny! ☀️ It's one of the best things about the city—always a bright day ahead. Let me know if you need more details!",

"id": "lc_run--019d47cc-b789-78b1-9a0a-dad8552c7eef-0",

"tool_calls": [],

"usage_metadata": {

"input_tokens": 188,

"output_tokens": 136,

"total_tokens": 324

},

"response_metadata": {

"model": "qwen3:8b",

"created_at": "2026-04-01T06:48:16.6699577Z",

"model_provider": "ollama"

}

}这家伙这又返回一个字典,内部带数组,取内容都不好取,这玩意写多了,这屁股有点难擦,写代码通常都不是一个人写,烂代码会传染,有很多人都会复制以前的代码,或者写得更乱,没有强限制很难搞。难怪有些公司想找个搞工程化的,他又不知道问题出在哪里,出问题的人一般是不知道问题就出在自己身上,所以总是找不到适合的人处理这个问题,一上来就问题有没有深入研究、算法,有没有看过源码,有点搞笑哈。学习研究,个人玩python这玩意可以,但是供工程化最好是结合其他更适合的语言,可以先查查工程化的含义,在看看你选则的技术栈是否符合工程化要求。最简单的一条就是傻瓜都能轻易看懂你的套路,按你的套路干,不会跳出你套路破坏可维护性。

函数最重要的两个信息就是入参和返回值,很多时候不需要去看源码的,看源码一般只是抽样的看,python类型提示稍微在这方面起到了一些作用。

3.5 一个更真实的Agent

下面是一个官方说的更接近真实世界的例子,看看是不是更好使用

3.5.1 定义提示词

SYSTEM_PROMPT = """You are an expert weather forecaster, who speaks in puns.

You have access to two tools:

- get_weather_for_location: use this to get the weather for a specific location

- get_user_location: use this to get the user's location

If a user asks you for the weather, make sure you know the location. If you can tell from the question that they mean wherever they are, use the get_user_location tool to find their location."""这个提示词涉及两个工具调用,获取天气和获取用户位置,看这个提示词的意图是想让大模型根据提示词,先获得用户位置,再通过用户位置获得天气信息。这个已经又一个简单的有先后顺序的任务流了。

3.5.2 创建工具

from dataclasses import dataclass

from langchain.tools import tool, ToolRuntime

@dataclass

class Context:

"""Custom runtime context schema."""

user_id: str

@tool

def get_weather_for_location(city: str) -> str:

"""Get weather for a given city."""

return f"It's always sunny in {city}!"

@tool

def get_user_location(runtime: ToolRuntime[Context]) -> str:

"""Retrieve user information based on user ID."""

user_id = runtime.context.user_id

return "Florida" if user_id == "1" else "SF"

我们解读一下这段代码,定义了两个工具,和一个上下文容器,这个容器封装了一个用户ID。代码用到了两个装饰器看起啦有点像java注解,其实机制不太一样,装饰器是一个高阶函数,以后都叫装饰器,不要叫注解哈,下面解释一下@tool和@dataclass。

1. @tool 的作用

核心功能:将普通 Python 函数“包装”成 AI 可以理解和调用的工具。

在你的代码中,@tool 装饰器(来自 langchain.tools)起到了以下关键作用:

- 注册工具:它告诉 LangChain 框架,

get_weather_for_location和get_user_location不仅仅是普通函数,而是 Agent 可以使用的“技能”。 - 生成元数据:它会自动读取函数的名称、类型提示(如

city: str)和文档字符串(即"""Get weather..."""这部分)。- AI 模型会根据文档字符串来判断这个工具是做什么的。

- AI 会根据类型提示来构建正确的参数。

- 标准化调用:它将函数转换为 LangChain 内部通用的

BaseTool格式,使其能被 Agent 在运行时动态调用。

2. @dataclass 的作用

核心功能:自动生成“样板代码”,简化数据类的定义。

在你的代码中,@dataclass(来自 Python 标准库 dataclasses)主要用于定义 Context 类,这玩意感觉有点像java record类,不知道是谁在学谁,或者说只是个巧合:

- 自动生成方法:它自动为

Context类生成了__init__(构造函数)、__repr__(打印信息)和__eq__(比较相等)等方法。 - 简化代码:如果没有它,你需要手动写很多代码来定义

user_id的初始化和属性存储。用了它,你只需要声明user_id: str,Python 就会自动帮你处理好底层的存储逻辑。 - 数据结构化:在这里,它定义了一个结构清晰的数据容器,专门用来存放运行时上下文(如用户 ID),供工具函数读取。

| 装饰器 | 来源 | 作用对象 | 核心目的 | 你的代码中的体现 |

|---|---|---|---|---|

@tool |

LangChain 库 | 函数 | 让 AI 能调用函数 | 把 get_weather... 变成 AI 可调用的技能,AI 知道它的描述和参数。 |

@dataclass |

Python 标准库 | 类 | 减少写类的重复代码 | 把 Context 变成一个轻量级的数据容器,自动处理 user_id 的初始化。 |

3.有无@tool差异

细心的朋友可能已经发现了,前面没加这玩意也能被工具调用,我查了一下AI,看看AI是怎么解释的:

不加 @tool(隐式包装)

省事:写个函数就能用,适合快速写脚本。

完全依赖代码推断:Agent 对工具的理解完全取决于你的函数名和文档字符串。你没法在不改函数源码的情况下,修改 Agent 看到的“说明书”。

加上 @tool(显式包装)

解耦:你可以把工具的“定义”和“实现”分开。

定制元数据:你可以手动指定 name、description 或 args_schema

| 特性 | 不加 @tool (普通函数) |

加上 @tool (Tool 对象) |

|---|---|---|

| 对象类型 | function |

Tool (继承自 BaseTool) |

| Agent 可见性 | 不可见,无法调用 | 可见,可以被理解和调用 |

| 包含元数据 | 无 (只有代码逻辑) | 有 (名称、描述、参数模式) |

| 主要作用 | 供 Python 代码直接调用 | 供 AI Agent 在推理时自主调用 |

3.5.3 定义模型

1 代码

from langchain.chat_models import init_chat_model

model = init_chat_model(

model='qwen3:8b',

model_provider="ollama",

temperature=0.7,

base_url="http://localhost:11434",

)这个定义模型使用了一个init_chat_model方法,看起来抽象程度更好一些,下面是老模式

chatModel = ChatOllama(

model=modelStr,

temperature=0.7,

base_url="http://localhost:11434",

)AI应用api目前都是在高速发展中,pyhon ai这体系是真的更新很快,老代码要升级会做出很多改动。

2 init_chat_model参数

(function) def init_chat_model(

model: str,

*,

model_provider: str | None = None,

configurable_fields: None = None,

config_prefix: str | None = None,

**kwargs: Any

) -> BaseChatModelmodel参数类型提示是个字符串,和create_agent 不太一样model: str | BaseChatModel,如果需要更多参数,可能需要分析*号后面的字典参数够不够用,不够用的化可能还是需要使用模型参数形式,很多人看见方法定义中的*参数有点懵逼哈(这个其实是个分割符,要求后面的参数都按字典形式传值)

3.5.4 定义格式化输出

前面不是吐槽这个家伙给我返回一个字典对象吗,我自己需要格式化去分析他的输出。现在它自己觉得过意不去,搞了一些解析办法,我们来看看代码

from dataclasses import dataclass

# We use a dataclass here, but Pydantic models are also supported.

@dataclass

class ResponseFormat:

"""Response schema for the agent."""

# A punny response (always required)

punny_response: str

# Any interesting information about the weather if available

weather_conditions: str | None = None3.5.5 内存记忆

from langgraph.checkpoint.memory import InMemorySaver

checkpointer = InMemorySaver()这玩意有点经验一样就看出来有问题哈,可能会撑爆内存,没有任何参数明显只能用于快速学习研究,有些无脑的就直接搞到生产哈,这种事情不是没有。

3.5.6 创建和运行agents

from langchain.agents.structured_output import ToolStrategy

agent = create_agent(

model=model,

system_prompt=SYSTEM_PROMPT,

tools=[get_user_location, get_weather_for_location],

context_schema=Context,

response_format=ToolStrategy(ResponseFormat),

checkpointer=checkpointer

)

# `thread_id` is a unique identifier for a given conversation.

config = {"configurable": {"thread_id": "1"}}

response = agent.invoke(

{"messages": [{"role": "user", "content": "what is the weather outside?"}]},

config=config,

context=Context(user_id="1")

)

print(response)

# ResponseFormat(

# punny_response="Florida is still having a 'sun-derful' day! The sunshine is playing 'ray-dio' hits all day long! I'd say it's the perfect weather for some 'solar-bration'! If you were hoping for rain, I'm afraid that idea is all 'washed up' - the forecast remains 'clear-ly' brilliant!",

# weather_conditions="It's always sunny in Florida!"

# )

# Note that we can continue the conversation using the same `thread_id`.

response = agent.invoke(

{"messages": [{"role": "user", "content": "thank you!"}]},

config=config,

context=Context(user_id="1")

)

print(response)

# ResponseFormat(

# punny_response="You're 'thund-erfully' welcome! It's always a 'breeze' to help you stay 'current' with the weather. I'm just 'cloud'-ing around waiting to 'shower' you with more forecasts whenever you need them. Have a 'sun-sational' day in the Florida sunshine!",

# weather_conditions=None

# )这个代码简单解释一下,关键的地方在于create_agent传入了模型、工具注册和模型上下文、格式化提示类。看起来比较奇葩的地方是print(response['structured_response']),这玩意怎么知道structured_response这个key是我们想要的输出的。我看看看response类型是个字典dict[str, Any]🤣。上下文使用user_id="1"来获取历史对话记录。我们来实际运行一下看看实际效果,我使用的是qwen,所以可能输出会有一些区别。

第一个完整输出

{

"messages": [

{

"type": "HumanMessage",

"content": "what is the weather outside?",

"additional_kwargs": {},

"response_metadata": {},

"id": "86e4ec1b-a773-4fe9-be3a-12d6794f2462"

},

{

"type": "AIMessage",

"content": "",

"additional_kwargs": {},

"response_metadata": {

"model": "qwen3:8b",

"created_at": "2026-04-02T03:12:23.4085592Z",

"done": true,

"done_reason": "stop",

"total_duration": 8523581900,

"load_duration": 79723300,

"prompt_eval_count": 326,

"prompt_eval_duration": 282148600,

"eval_count": 250,

"eval_duration": 8151050400,

"logprobs": null,

"model_name": "qwen3:8b",

"model_provider": "ollama"

},

"id": "lc_run--019d4c2d-5632-7642-9dc0-804526a970e9-0",

"tool_calls": [

{

"name": "get_user_location",

"args": {},

"id": "a85dc12d-f1e2-4654-87dc-3a24cfaa8f30",

"type": "tool_call"

}

],

"invalid_tool_calls": [],

"usage_metadata": {

"input_tokens": 326,

"output_tokens": 250,

"total_tokens": 576

}

},

{

"type": "ToolMessage",

"content": "Florida",

"name": "get_user_location",

"id": "1018185d-0141-4461-9d55-c3bc4ff4ce72",

"tool_call_id": "a85dc12d-f1e2-4654-87dc-3a24cfaa8f30"

},

{

"type": "AIMessage",

"content": "",

"additional_kwargs": {},

"response_metadata": {

"model": "qwen3:8b",

"created_at": "2026-04-02T03:12:45.485162Z",

"done": true,

"done_reason": "stop",

"total_duration": 22070023700,

"load_duration": 75188700,

"prompt_eval_count": 357,

"prompt_eval_duration": 269243700,

"eval_count": 659,

"eval_duration": 21710923700,

"logprobs": null,

"model_name": "qwen3:8b",

"model_provider": "ollama"

},

"id": "lc_run--019d4c2d-7f76-7cb3-9a0f-9e7eac23e5c6-0",

"tool_calls": [

{

"name": "get_weather_for_location",

"args": {

"city": "Miami"

},

"id": "53b2260a-120e-4f28-a705-3343cbf36805",

"type": "tool_call"

}

],

"invalid_tool_calls": [],

"usage_metadata": {

"input_tokens": 357,

"output_tokens": 659,

"total_tokens": 1016

}

},

{

"type": "ToolMessage",

"content": "It's always sunny in Miami!",

"name": "get_weather_for_location",

"id": "d4c98d34-a635-4959-a202-c2955dfdfcfc",

"tool_call_id": "53b2260a-120e-4f28-a705-3343cbf36805"

},

{

"type": "AIMessage",

"content": "",

"additional_kwargs": {},

"response_metadata": {

"model": "qwen3:8b",

"created_at": "2026-04-02T03:12:58.7350557Z",

"done": true,

"done_reason": "stop",

"total_duration": 13244458600,

"load_duration": 71120600,

"prompt_eval_count": 397,

"prompt_eval_duration": 323181100,

"eval_count": 391,

"eval_duration": 12837693300,

"logprobs": null,

"model_name": "qwen3:8b",

"model_provider": "ollama"

},

"id": "lc_run--019d4c2d-d5b1-7321-a459-c17c99302ae0-0",

"tool_calls": [

{

"name": "ResponseFormat",

"args": {

"punny_response": "Why don't skeletons ever get cold in Miami? Because they're always sun-kissed!",

"weather_conditions": "It's always sunny in Miami!"

},

"id": "1661d4ad-51b8-4ce7-8839-ad53533af1bb",

"type": "tool_call"

}

],

"invalid_tool_calls": [],

"usage_metadata": {

"input_tokens": 397,

"output_tokens": 391,

"total_tokens": 788

}

},

{

"type": "ToolMessage",

"content": "Returning structured response: ResponseFormat(punny_response=\"Why don't skeletons ever get cold in Miami? Because they're always sun-kissed!\", weather_conditions=\"It's always sunny in Miami!\")",

"name": "ResponseFormat",

"id": "3fe7f79f-7e2a-480b-91a6-e245297b4331",

"tool_call_id": "1661d4ad-51b8-4ce7-8839-ad53533af1bb"

}

],

"structured_response": {

"type": "ResponseFormat",

"punny_response": "Why don't skeletons ever get cold in Miami? Because they're always sun-kissed!",

"weather_conditions": "It's always sunny in Miami!"

}

}经过仔细分析这个执行流程和输出都是对的哈,qwen3输出有点不稳,有时候没有structured_response,导致print(response['structured_response']) 报错)

"structured_response": {

"type": "ResponseFormat",

"punny_response": "Why don't skeletons ever get cold in Miami? Because they're always sun-kissed!",

"weather_conditions": "It's always sunny in Miami!"

}输出也和官方不太一样使用的是Miami,不是Florida,因为qwen认为Florida是一个州,参数是城市,传一个城市更适合,这个看起比官方解释更牛逼一点。但是行为有点水机,并不是每次都是这样。

第二个完整输出

{

"messages": [

{

"type": "HumanMessage",

"content": "what is the weather outside?",

"additional_kwargs": {},

"response_metadata": {},

"id": "86e4ec1b-a773-4fe9-be3a-12d6794f2462"

},

{

"type": "AIMessage",

"content": "",

"additional_kwargs": {},

"response_metadata": {

"model": "qwen3:8b",

"created_at": "2026-04-02T03:12:23.4085592Z",

"done": true,

"done_reason": "stop",

"total_duration": 8523581900,

"load_duration": 79723300,

"prompt_eval_count": 326,

"prompt_eval_duration": 282148600,

"eval_count": 250,

"eval_duration": 8151050400,

"logprobs": null,

"model_name": "qwen3:8b",

"model_provider": "ollama"

},

"id": "lc_run--019d4c2d-5632-7642-9dc0-804526a970e9-0",

"tool_calls": [

{

"name": "get_user_location",

"args": {},

"id": "a85dc12d-f1e2-4654-87dc-3a24cfaa8f30",

"type": "tool_call"

}

],

"invalid_tool_calls": [],

"usage_metadata": {

"input_tokens": 326,

"output_tokens": 250,

"total_tokens": 576

}

},

{

"type": "ToolMessage",

"content": "Florida",

"name": "get_user_location",

"id": "1018185d-0141-4461-9d55-c3bc4ff4ce72",

"tool_call_id": "a85dc12d-f1e2-4654-87dc-3a24cfaa8f30"

},

{

"type": "AIMessage",

"content": "",

"additional_kwargs": {},

"response_metadata": {

"model": "qwen3:8b",

"created_at": "2026-04-02T03:12:45.485162Z",

"done": true,

"done_reason": "stop",

"total_duration": 22070023700,

"load_duration": 75188700,

"prompt_eval_count": 357,

"prompt_eval_duration": 269243700,

"eval_count": 659,

"eval_duration": 21710923700,

"logprobs": null,

"model_name": "qwen3:8b",

"model_provider": "ollama"

},

"id": "lc_run--019d4c2d-7f76-7cb3-9a0f-9e7eac23e5c6-0",

"tool_calls": [

{

"name": "get_weather_for_location",

"args": {

"city": "Miami"

},

"id": "53b2260a-120e-4f28-a705-3343cbf36805",

"type": "tool_call"

}

],

"invalid_tool_calls": [],

"usage_metadata": {

"input_tokens": 357,

"output_tokens": 659,

"total_tokens": 1016

}

},

{

"type": "ToolMessage",

"content": "It's always sunny in Miami!",

"name": "get_weather_for_location",

"id": "d4c98d34-a635-4959-a202-c2955dfdfcfc",

"tool_call_id": "53b2260a-120e-4f28-a705-3343cbf36805"

},

{

"type": "AIMessage",

"content": "",

"additional_kwargs": {},

"response_metadata": {

"model": "qwen3:8b",

"created_at": "2026-04-02T03:12:58.7350557Z",

"done": true,

"done_reason": "stop",

"total_duration": 13244458600,

"load_duration": 71120600,

"prompt_eval_count": 397,

"prompt_eval_duration": 323181100,

"eval_count": 391,

"eval_duration": 12837693300,

"logprobs": null,

"model_name": "qwen3:8b",

"model_provider": "ollama"

},

"id": "lc_run--019d4c2d-d5b1-7321-a459-c17c99302ae0-0",

"tool_calls": [

{

"name": "ResponseFormat",

"args": {

"punny_response": "Why don't skeletons ever get cold in Miami? Because they're always sun-kissed!",

"weather_conditions": "It's always sunny in Miami!"

},

"id": "1661d4ad-51b8-4ce7-8839-ad53533af1bb",

"type": "tool_call"

}

],

"invalid_tool_calls": [],

"usage_metadata": {

"input_tokens": 397,

"output_tokens": 391,

"total_tokens": 788

}

},

{

"type": "ToolMessage",

"content": "Returning structured response: ResponseFormat(punny_response=\"Why don't skeletons ever get cold in Miami? Because they're always sun-kissed!\", weather_conditions=\"It's always sunny in Miami!\")",

"name": "ResponseFormat",

"id": "3fe7f79f-7e2a-480b-91a6-e245297b4331",

"tool_call_id": "1661d4ad-51b8-4ce7-8839-ad53533af1bb"

},

{

"type": "HumanMessage",

"content": "thank you!",

"additional_kwargs": {},

"response_metadata": {},

"id": "9e5429db-47e0-4057-b6d2-1f0b8a7cd8b3"

},

{

"type": "AIMessage",

"content": "You're welcome! Stay sun-kissed! 😊",

"additional_kwargs": {},

"response_metadata": {

"model": "qwen3:8b",

"created_at": "2026-04-02T03:13:04.2339338Z",

"done": true,

"done_reason": "stop",

"total_duration": 5491461700,

"load_duration": 75473000,

"prompt_eval_count": 506,

"prompt_eval_duration": 1476569700,

"eval_count": 120,

"eval_duration": 3930683300,

"logprobs": null,

"model_name": "qwen3:8b",

"model_provider": "ollama"

},

"id": "lc_run--019d4c2e-0976-70f2-a43b-bcb1a7d5de91-0",

"tool_calls": [],

"invalid_tool_calls": [],

"usage_metadata": {

"input_tokens": 506,

"output_tokens": 120,

"total_tokens": 626

}

}

],

"structured_response": {

"type": "ResponseFormat",

"punny_response": "Why don't skeletons ever get cold in Miami? Because they're always sun-kissed!",

"weather_conditions": "It's always sunny in Miami!"

}

}这轮整体输出整体上还是对的,就是响应有点问题用的还是structured_respons第一轮对话的结果,可以使用官网的模型验证一下,官网的是不是和它说的输出一致。

"structured_response": {

"type": "ResponseFormat",

"punny_response": "Why don't skeletons ever get cold in Miami? Because they're always sun-kissed!",

"weather_conditions": "It's always sunny in Miami!"

}qwenAI是这样解释的,步知道实际模型是不是这样干的,这里没法验证:

虽然你输入了 "thank you!",但 invoke 函数运行结束后,它把 response 变量指向了当前内存中保存的最新状态对象。由于你的 Agent 定义了 response_format=ToolStrategy(ResponseFormat),LangGraph 会始终尝试将最后一次成功的结构化输出映射到这个对象上,并将其作为返回值。第二轮对话并没有生成新的 ResponseFormat

请仔细看第一轮和第二轮的区别:

第一轮(问天气):

模型必须执行工具 -> 获取数据 -> 最终调用 ResponseFormat 工具来输出符合你要求的 JSON 结构。因此,状态中产生了一个新的 ResponseFormat 对象。

第二轮(说谢谢):

用户说 "thank you!"。

模型回复:"You're welcome! Stay sun-kissed! 😊"。

关键点: 模型认为这只是一个普通的闲聊,它并没有再次调用 ResponseFormat 工具。它只是输出了普通的文本(AIMessage 的 content 字段)。

预期的输出应该类似如下内容,不统一的化就不好解析,要是换个模型格式搞得不一样,那么和模型无关就是一个屁话。有时候语言或者框架开发这都只说好的,程序员其实很多也不老实🤣🤣,理想的输出应该类似如下:

"structured_response": {

"type": "ResponseFormat",

"punny_response": "You're welcome! Stay sun-kissed! 😊",

"weather_conditions": ""

}到这里基本这个完整的示例就讲结束了,后面才开始进入专题

4 agents

4.1 agents

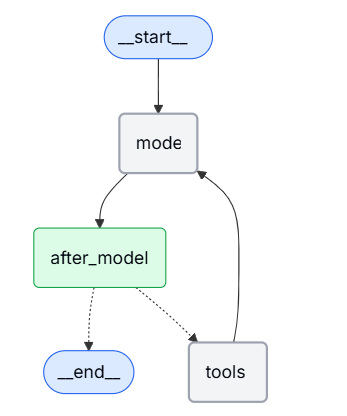

通过前面的代码,已经发现了agents的身影,我们来看看官方的解释:

- 智能体将语言模型与工具相结合,从而构建出能够对任务进行推理、决定使用哪些工具,并迭代式地朝着解决方案推进的系统。

- create_agent 提供了一个可用于生产环境的智能体实现方案。

- 一个 LLM 智能体通过循环运行工具来达成目标。智能体会一直运行,直到满足停止条件——即当模型输出最终结果,或达到迭代次数限制时为止

我们一点一点来解读一下这三条:

1. 智能体的集合模型和工具才能做出推理和行动,模型像神经中枢,其他器官像工具。神经指挥工具,agents就是这样的一个存在。只能体能够进行一些逻辑推理,如果你有多个工具他会根据提示信息和你的要求决定调用的先后顺序,处理结果和传参。

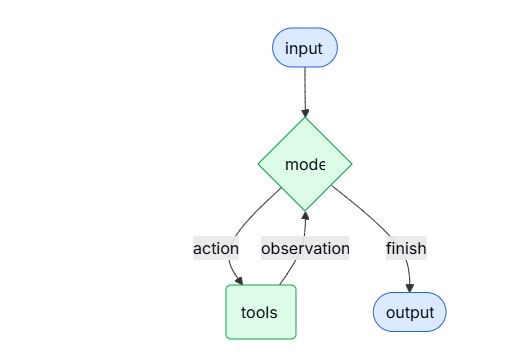

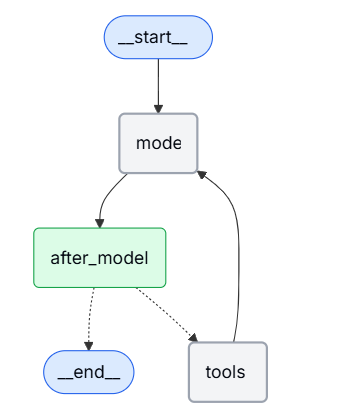

2 create_agent提供了一个创建agents的方法。这个上面的代码中已经有所说明,langchain的执行流程底层已经架设在langgraph上,agents的执行流程构成了一个图结构,图由节点(步骤)和边(连接)组成,它们定义了智能体处理信息的方式。智能体在图中流转,依次执行各类节点,例如模型节点(负责调用模型)、工具节点(负责执行工具)或中间件

3 只能体会不断的调用工具来处理你的任务,知道满足要求为止。但是这个一般是设置上限,不然容易出现死循环。

4.2 models

模型是智能体的推理引擎。它支持多种指定方式,包括静态和动态的模型选择。

静态模型

静态模型在创建智能体时配置一次,并在整个执行过程中保持不变。这是最常见且最直接的方法。静态模型的创建在前面已经介绍过代码了,这里就不介绍了。

动态模型

动态模型是根据当前状态和上下文在运行时进行选择的。这种方式能够实现复杂的路由逻辑和成本优化,我们就拿官网的这个代码来看看

from langchain_openai import ChatOpenAI

from langchain.agents import create_agent

from langchain.agents.middleware import wrap_model_call, ModelRequest, ModelResponse

basic_model = ChatOpenAI(model="gpt-4.1-mini")

advanced_model = ChatOpenAI(model="gpt-4.1")

@wrap_model_call

def dynamic_model_selection(request: ModelRequest, handler) -> ModelResponse:

"""Choose model based on conversation complexity."""

message_count = len(request.state["messages"])

if message_count > 10:

# Use an advanced model for longer conversations

model = advanced_model

else:

model = basic_model

return handler(request.override(model=model))

agent = create_agent(

model=basic_model, # Default model

tools=tools,

middleware=[dynamic_model_selection]

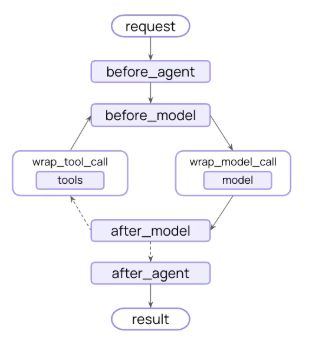

)这里有个关键参数,middlware。这玩意Django框架中也有,叫中间件,换个名字可能你就好理解了,就像java中的切面,最典型的用户就是拦截器。我们在来看看@wrap_model_call的作用

| 钩子类型 | 作用时机 | 能力限制 | 典型用途 |

|---|---|---|---|

@before_model |

调用前 | 只能修改输入或中断,无法捕获调用异常 | 修改提示词、检查 Token 限额 |

@after_model |

调用后 | 只能处理输出结果 | 记录日志、审查输出内容 |

@wrap_model_call |

包裹全程 | 最高权限:可控制调用次数、捕获异常、替换模型 | 重试、缓存、动态路由、限流 |

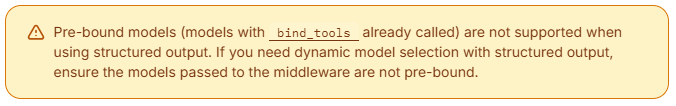

这里最大的作用就是做模型选择,因为不同的模型有不同的转场,生产上可能部署具有不同转场的小模型,用这个做路由。这里官网有个黄色警告

就是说你创建agents的时候,传的模型不要提前绑定工具

# ❌ 错误:传入了预绑定模型的函数

def get_model():

return model.bind_tools([my_tool]) # 不要在这里 bind_tools

#下面的basic_model就不能像绑定工具,这个理解应该是没啥问题的

agent = create_agent(

model=basic_model, # Default model

tools=tools,

middleware=[dynamic_model_selection]

)4.3 tools

Agent(智能体) 相比于简单的模型工具绑定(Tool Binding)到底强在哪里。简单来说,工具赋予了 Agent “行动”的能力,而 Agent 的核心价值在于它能更聪明、更自主地驾驭这些工具。

具体来看,它通过以下几个方面实现了超越:

- 序列化工具调用:能够根据用户的单次提示,自动规划并连续调用多个工具(比如先搜索信息,再根据结果调用计算器)。

- 并行工具调用:在合适的情况下,能够同时执行多个任务以提高效率。

- 动态工具选择:能够根据上一步工具返回的结果,灵活决定下一步该用哪个工具。

- 容错与重试机制:具备处理错误和自动重试的逻辑,不会因为一点小报错就“罢工”。

- 跨调用状态持久化:在多次工具调用的过程中,能够“记住”之前的上下文和状态,保持连贯性

静态工具

静态工具是在创建 Agent 时定义的,并且在执行过程中保持不变。这是最常见且最直接的方法。前面的例子中就是静态工具用法。

动态工具

使用动态工具时,智能体可用的工具集是在运行时进行修改的,而不是一开始就全部定义好。

并非每个工具都适用于每种情况。过多的工具可能会让模型不堪重负(导致上下文过载)并增加错误率;而工具太少则会限制智能体的能力。动态工具选择使得能够根据认证状态、用户权限、功能开关或对话阶段来调整可用的工具集。

这上面有个很关键的信息,工具注册会增大模型上下文信息。你想一下,如果模型不知道工具信息,它怎么知道调用那个工具。

有两种定义动态工具方式:

- 过滤预注册的工具:你先把所有可能用到的工具都定义好(预注册),然后在运行时根据情况(比如用户权限)从中筛选出一部分给模型用。

- 运行时工具注册:你不需要提前把所有工具都定死,而是在程序跑起来之后,根据当时的具体情况,临时添加或注册新的工具。

如果在创建智能体的时候,就已经确定了所有可能用到的工具,那么你可以先把它们全部预注册进去。随后,根据当前的状态、权限或上下文,动态地过滤(筛选)出具体哪些工具需要暴露给模型使用

状态过滤的例子

from langchain.agents import create_agent

from langchain.agents.middleware import wrap_model_call, ModelRequest, ModelResponse

from typing import Callable

@wrap_model_call

def state_based_tools(

request: ModelRequest,

handler: Callable[[ModelRequest], ModelResponse]

) -> ModelResponse:

"""Filter tools based on conversation State."""

# Read from State: check if user has authenticated

state = request.state

is_authenticated = state.get("authenticated", False)

message_count = len(state["messages"])

# Only enable sensitive tools after authentication

if not is_authenticated:

tools = [t for t in request.tools if t.name.startswith("public_")]

request = request.override(tools=tools)

elif message_count < 5:

# Limit tools early in conversation

tools = [t for t in request.tools if t.name != "advanced_search"]

request = request.override(tools=tools)

return handler(request)

agent = create_agent(

model="gpt-4.1",

tools=[public_search, private_search, advanced_search],

middleware=[state_based_tools]

)基于store过滤

from dataclasses import dataclass

from langchain.agents import create_agent

from langchain.agents.middleware import wrap_model_call, ModelRequest, ModelResponse

from typing import Callable

from langgraph.store.memory import InMemoryStore

@dataclass

class Context:

user_id: str

@wrap_model_call

def store_based_tools(

request: ModelRequest,

handler: Callable[[ModelRequest], ModelResponse]

) -> ModelResponse:

"""Filter tools based on Store preferences."""

user_id = request.runtime.context.user_id

# Read from Store: get user's enabled features

store = request.runtime.store

feature_flags = store.get(("features",), user_id)

if feature_flags:

enabled_features = feature_flags.value.get("enabled_tools", [])

# Only include tools that are enabled for this user

tools = [t for t in request.tools if t.name in enabled_features]

request = request.override(tools=tools)

return handler(request)

agent = create_agent(

model="gpt-4.1",

tools=[search_tool, analysis_tool, export_tool],

middleware=[store_based_tools],

context_schema=Context,

store=InMemoryStore()

)基于上下文的过滤

from dataclasses import dataclass

from langchain.agents import create_agent

from langchain.agents.middleware import wrap_model_call, ModelRequest, ModelResponse

from typing import Callable

@dataclass

class Context:

user_role: str

@wrap_model_call

def context_based_tools(

request: ModelRequest,

handler: Callable[[ModelRequest], ModelResponse]

) -> ModelResponse:

"""Filter tools based on Runtime Context permissions."""

# Read from Runtime Context: get user role

if request.runtime is None or request.runtime.context is None:

# If no context provided, default to viewer (most restrictive)

user_role = "viewer"

else:

user_role = request.runtime.context.user_role

if user_role == "admin":

# Admins get all tools

pass

elif user_role == "editor":

# Editors can't delete

tools = [t for t in request.tools if t.name != "delete_data"]

request = request.override(tools=tools)

else:

# Viewers get read-only tools

tools = [t for t in request.tools if t.name.startswith("read_")]

request = request.override(tools=tools)

return handler(request)

agent = create_agent(

model="gpt-4.1",

tools=[read_data, write_data, delete_data],

middleware=[context_based_tools],

context_schema=Context

)上面接种过滤方式,最后的本质都是一样的,最适用于以下场景:

- 在编译或启动时,就已经明确了所有可能的工具;

- 你需要根据权限、功能开关(feature flags)或对话状态来进行筛选;

- 工具集本身是静态固定的,但它们的可用性是动态变化的。

运行时工具注册例子

当工具是在运行时被发现或创建时(比如从 MCP 服务器加载、根据用户数据生成,或者从远程注册表获取),你不仅需要注册这些工具,还必须能够动态地处理它们的执行。

这需要用到两个中间件钩子:

- wrap_model_call:用于在请求中注入动态工具;

- wrap_tool_call:用于处理那些动态添加工具的执行逻辑。

from langchain.tools import tool

from langchain.agents import create_agent

from langchain.agents.middleware import AgentMiddleware, ModelRequest, ToolCallRequest

# A tool that will be added dynamically at runtime

@tool

def calculate_tip(bill_amount: float, tip_percentage: float = 20.0) -> str:

"""Calculate the tip amount for a bill."""

tip = bill_amount * (tip_percentage / 100)

return f"Tip: ${tip:.2f}, Total: ${bill_amount + tip:.2f}"

class DynamicToolMiddleware(AgentMiddleware):

"""Middleware that registers and handles dynamic tools."""

def wrap_model_call(self, request: ModelRequest, handler):

# Add dynamic tool to the request

# This could be loaded from an MCP server, database, etc.

updated = request.override(tools=[*request.tools, calculate_tip])

return handler(updated)

def wrap_tool_call(self, request: ToolCallRequest, handler):

# Handle execution of the dynamic tool

if request.tool_call["name"] == "calculate_tip":

return handler(request.override(tool=calculate_tip))

return handler(request)

agent = create_agent(

model="gpt-4o",

tools=[get_weather], # Only static tools registered here

middleware=[DynamicToolMiddleware()],

)

# The agent can now use both get_weather AND calculate_tip

result = agent.invoke({

"messages": [{"role": "user", "content": "Calculate a 20% tip on $85"}]

})这段代码本质也是一个中间件,只是第一个方式用@wrap_model_call装饰器转成了MiddleWare(非常隐晦),第二个直接继承了AgentMiddleWare。

前面的例子,动态工具和动态模型本质上都是基于MiddleWare来实现。

4.4 工具错误处理

工具错误处理使用了@wrap_tool_call 装饰器包装成了MiddleWare

from langchain.agents import create_agent

from langchain.agents.middleware import wrap_tool_call

from langchain.messages import ToolMessage

@wrap_tool_call

def handle_tool_errors(request, handler):

"""Handle tool execution errors with custom messages."""

try:

return handler(request)

except Exception as e:

# Return a custom error message to the model

return ToolMessage(

content=f"Tool error: Please check your input and try again. ({str(e)})",

tool_call_id=request.tool_call["id"]

)

agent = create_agent(

model="gpt-4.1",

tools=[search, get_weather],

middleware=[handle_tool_errors]

)4.5 ReAct loop

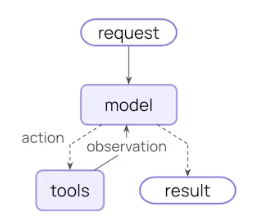

AI 代理遵循 ReAct(“推理 + 行动”)模式,它们在“简短的推理步骤”与“针对性的工具调用”之间交替循环,并将产生的观察结果作为输入反馈给后续的决策过程,如此反复,直到最终给出答案。

这段话揭示了 Agent 并不是一步到位的,而是一个循环迭代的过程:

- Reasoning (推理):Agent 先想一下“我现在该干嘛?”(思考)。

- Acting (行动):Agent 决定调用一个工具(比如搜索或查数据库)。

- Observation (观察):工具返回结果(比如搜索到了某条新闻)。

- Loop (循环):Agent 拿着这个结果,回到第一步,再次思考“根据这个新信息,我下一步该干嘛?”。

这个过程一直持续,直到 Agent 觉得信息够了,才会输出 Final Answer (最终答案)。

4.6 系统提示词

静态工具是在创建 Agent 时定义的,并且在执行过程中保持不变。这是最常见且最直接的方法,如果没有提供系统提示词,代理将直接根据对话消息来推断其任务。如果没有提供系统提示词,代理将直接根据对话消息来推断其任务。

agent = create_agent(

model,

tools,

system_prompt="You are a helpful assistant. Be concise and accurate."

)system_prompt 参数既接受字符串(str),也接受 SystemMessage 对象。使用 SystemMessage 能让你更精细地掌控提示词的结构,这对于利用特定服务商的特性(比如 Anthropic 的提示词缓存)非常有用。

from langchain.agents import create_agent

from langchain.messages import SystemMessage, HumanMessage

literary_agent = create_agent(

model="anthropic:claude-sonnet-4-5",

system_prompt=SystemMessage(

content=[

{

"type": "text",

"text": "You are an AI assistant tasked with analyzing literary works.",

},

{

"type": "text",

"text": "<the entire contents of 'Pride and Prejudice'>",

"cache_control": {"type": "ephemeral"}

}

]

)

)

result = literary_agent.invoke(

{"messages": [HumanMessage("Analyze the major themes in 'Pride and Prejudice'.")]}

)"cache_control": {"type": "ephemeral"} 做临时缓存,这会告诉 Anthropic 缓存该内容块,从而减少重复请求(在使用相同系统提示词时)的延迟和成本。下面是查到的一些信息,其他的服务商还得看具体情况。

Anthropic 的缓存机制是基于时间窗口的。

- 有效期:当你发送第一段包含长提示词的请求后,该内容会被缓存在内存中,有效期通常为 5 分钟。

- 续期:如果你在这 5 分钟内发送了新的请求,并且该请求再次使用了相同的缓存内容(通过

SystemMessage或特定的cache_control标记),缓存的计时器会重置,内容会继续保留。 - 过期:如果超过 5 分钟没有任何请求使用这段缓存内容,它就会被自动清除。下次再想用,就得重新“预热”(即重新发送完整内容以建立新的缓存)。

动态提示词

from typing import TypedDict

from langchain.agents import create_agent

from langchain.agents.middleware import dynamic_prompt, ModelRequest

class Context(TypedDict):

user_role: str

@dynamic_prompt

def user_role_prompt(request: ModelRequest) -> str:

"""Generate system prompt based on user role."""

user_role = request.runtime.context.get("user_role", "user")

base_prompt = "You are a helpful assistant."

if user_role == "expert":

return f"{base_prompt} Provide detailed technical responses."

elif user_role == "beginner":

return f"{base_prompt} Explain concepts simply and avoid jargon."

return base_prompt

agent = create_agent(

model="gpt-4.1",

tools=[web_search],

middleware=[user_role_prompt],

context_schema=Context

)

# The system prompt will be set dynamically based on context

result = agent.invoke(

{"messages": [{"role": "user", "content": "Explain machine learning"}]},

context={"user_role": "expert"}

)@dynamic_prompt 这个玩意把函数转化成了中间件,通过中间件实现。

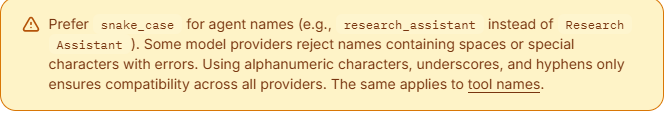

4.7 agent取名

前面示例都只涉及一个agent,所以不用区分,如果涉及多agent,比如agent是多agent系统子图中的一员时,可以加一个名字标示agent。

agent = create_agent(

model,

tools,

name="research_assistant"

)注意名字规范

4.8 agent调用

你可以通过向 Agent 的状态(State)传递更新来调用它。所有的 Agent 在其状态中都包含一系列消息;要调用 Agent,只需传入一条新消息即可。

result = agent.invoke(

{"messages": [{"role": "user", "content": "What's the weather in San Francisco?"}]}

)4.9 结构化输出

langchain agents通过 response_format参数控制工具调用格式化输出。

ToolStrategy 利用“人工工具调用”来生成结构化输出。它适用于任何支持工具调用的模型。当无法使用或不信任服务商原生的结构化输出功能(即 ProviderStrategy)时,就应该使用 ToolStrategy

from pydantic import BaseModel

from langchain.agents import create_agent

from langchain.agents.structured_output import ToolStrategy

from langchain.chat_models import init_chat_model

class ContactInfo(BaseModel):

name: str

email: str

phone: str

qwen3Ollama = init_chat_model(

model="qwen3:8b", # 1. 你本地 Ollama 中的模型名称

model_provider="ollama", # 2. 【关键】明确指定提供商为 ollama

base_url="http://localhost:11434", # 3. Ollama 的默认服务地址

temperature=0.7, # 4. 通用参数:温度

)

agent = create_agent(

model=qwen3Ollama,

tools=[],

response_format=ToolStrategy(ContactInfo)

)

result = agent.invoke({

"messages": [{"role": "user", "content": "Extract contact info from: John Doe, john@example.com, (555) 123-4567"}]

})

print(result)

print(result["structured_response"])

# ContactInfo(name='John Doe', email='john@example.com', phone='(555) 123-4567')完整输出:

{

"messages": [

{

"content": "Extract contact info from: John Doe, john@example.com, (555) 123-4567",

"additional_kwargs": {},

"response_metadata": {},

"id": "65898ed0-66b1-48de-bc00-2eb150c9b7db"

},

{

"content": "",

"additional_kwargs": {},

"response_metadata": {

"model": "qwen3:8b",

"created_at": "2026-04-03T03:07:10.8559514Z",

"done": true,

"done_reason": "stop",

"total_duration": 9117973800,

"load_duration": 77158200,

"prompt_eval_count": 169,

"prompt_eval_duration": 201344200,

"eval_count": 273,

"eval_duration": 8814552300,

"logprobs": null,

"model_name": "qwen3:8b",

"model_provider": "ollama"

},

"id": "lc_run--019d514e-eaef-7cd0-95f8-4fbf11ea997a-0",

"tool_calls": [

{

"name": "ContactInfo",

"args": {

"email": "john@example.com",

"name": "John Doe",

"phone": "(555) 123-4567"

},

"id": "9fe76cca-c585-4022-9a39-50d5ac47e16d",

"type": "tool_call"

}

],

"invalid_tool_calls": [],

"usage_metadata": {

"input_tokens": 169,

"output_tokens": 273,

"total_tokens": 442

}

},

{

"content": "Returning structured response: name='John Doe' email='john@example.com' phone='(555) 123-4567'",

"name": "ContactInfo",

"id": "9afaabe3-0174-4f74-8ce3-ba6143094f93",

"tool_call_id": "9fe76cca-c585-4022-9a39-50d5ac47e16d"

}

],

"structured_response": {

"name": "John Doe",

"email": "john@example.com",

"phone": "(555) 123-4567"

}

} 信息中出现了工具调用,ToolStrategy 的工作机制导致的。虽然你在 create_agent 时传入了空的 tools=[],但 ToolStrategy 为了实现结构化输出,会在内部自动生成并注入一个“隐式工具”。

简单来说,ToolStrategy 把你的 Pydantic 模型(ContactInfo)自动转换成了一个工具定义。

但是,ToolStrategy 注入的工具属于系统级/策略级工具。在 LangChain 的底层实现中,策略定义的“输出工具”通常会与用户定义的 tools 合并。

- 用户工具:空列表 []。

- 策略工具:[ContactInfo (自动生成的工具定义)]。

- 最终发送给模型的工具列表:[ContactInfo]

name='John Doe' email='john@example.com' phone='(555) 123-4567'ProviderStrategy 利用模型提供商(如 OpenAI、Anthropic)原生的结构化输出生成功能。这种方式更加可靠,但仅适用于那些支持原生结构化输出的提供商ProviderStrategy 利用模型提供商(如 OpenAI、Anthropic)原生的结构化输出生成功能。这种方式更加可靠,但仅适用于那些支持原生结构化输出的提供商

from langchain.agents.structured_output import ProviderStrategy

agent = create_agent(

model="gpt-4.1",

response_format=ProviderStrategy(ContactInfo)

) langchain 1.0, 简单传模式 (e.g., response_format=ContactInfo) ,如果模型支持本地化结构输出,将会用 ProviderStrategy 否则就会退回到ToolStrategy 。

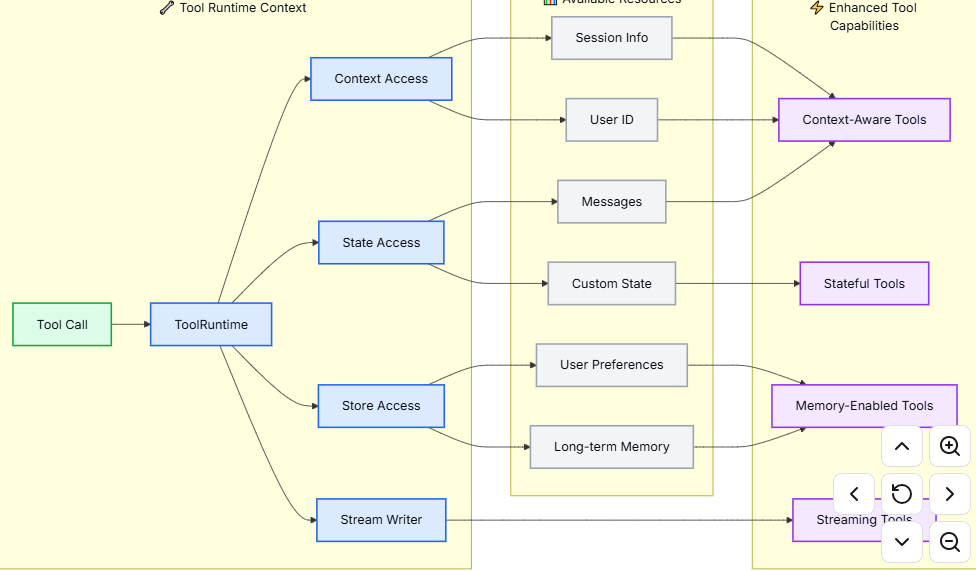

4.10 记忆

智能体默认会自动记录对话历史(通过消息列表,生产不可能这么做),但你也可以自定义一个“状态结构”,让智能体在对话过程中记住更多特定的信息。存在状态里面的信息,对agent来说类似于短期记忆功能。

自定义状态模式(Schema)必须以 TypedDict 的形式继承 AgentState,有两种方式自定义状态:1 通过MiddleWare。2 通过agent的state_schema

1 通过MiddleWare

当你的自定义状态(Custom State)需要被特定的中间件钩子(Hooks)或者绑定在该中间件上的工具访问时,请使用中间件(Middleware)来定义这个状态

from langchain.agents import AgentState

from langchain.agents.middleware import AgentMiddleware

from typing import Any

class CustomState(AgentState):

user_preferences: dict

class CustomMiddleware(AgentMiddleware):

state_schema = CustomState

tools = [tool1, tool2]

def before_model(self, state: CustomState, runtime) -> dict[str, Any] | None:

...

agent = create_agent(

model,

tools=tools,

middleware=[CustomMiddleware()]

)

# The agent can now track additional state beyond messages

result = agent.invoke({

"messages": [{"role": "user", "content": "I prefer technical explanations"}],

"user_preferences": {"style": "technical", "verbosity": "detailed"},

})还是通过中间见实现。agent.invoke调用时,要和CustomState的user_preferences一样才能对应,通过before_model钩子函数实现访问状态的行为

2 通过state_schema

状态只有工具访问时就用state_schema

from langchain.agents import AgentState

class CustomState(AgentState):

user_preferences: dict

agent = create_agent(

model,

tools=[tool1, tool2],

state_schema=CustomState

)

# The agent can now track additional state beyond messages

result = agent.invoke({

"messages": [{"role": "user", "content": "I prefer technical explanations"}],

"user_preferences": {"style": "technical", "verbosity": "detailed"},

})3 与context对比

前面3.5例子中我们涉及用context传数据,在tools工具中访问,这个似乎和这里的状态功能有些重复,我们看看区别:

| 特性 | 使用 Context | 使用 State |

|---|---|---|

| 数据性质 | 配置/元数据 (User ID, API Key, 权限等级) | 业务数据 (聊天记录, 搜索结果, 中间变量) |

| 读写权限 | 只读 (工具只能看,不能改) | 读写 (工具可以修改、追加) |

| 持久化 | 不持久化 (用完即弃,下次重传) | 持久化 (存入 Checkpointer,长期记忆) |

| 可见性 | 仅工具/代码可见 (LLM 看不到) | LLM 可见 (作为 Prompt 的一部分) |

| 例子 | “当前用户是 VIP” | “用户刚才问了天气” |

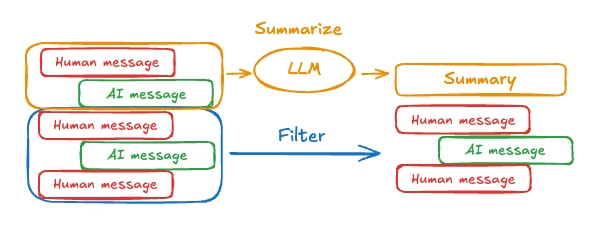

4.11 流式输出

当你的自定义状态(Custom State)需要被特定的中间件钩子(Hooks)或者绑定在该中间件上的工具访问时,请使用中间件(Middleware)来定义这个状态我们已经见识过如何用 invoke 来调用 Agent 并获取最终回复了。但如果 Agent 需要执行多个步骤(比如反复思考、调用工具),这可能会花上一阵子。为了展示中间的进度,我们可以采用‘流式’的方式,让消息一产生就实时回传出来

from langchain.messages import AIMessage, HumanMessage

for chunk in agent.stream({

"messages": [{"role": "user", "content": "Search for AI news and summarize the findings"}]

}, stream_mode="values"):

# Each chunk contains the full state at that point

latest_message = chunk["messages"][-1]

if latest_message.content:

if isinstance(latest_message, HumanMessage):

print(f"User: {latest_message.content}")

elif isinstance(latest_message, AIMessage):

print(f"Agent: {latest_message.content}")

elif latest_message.tool_calls:

print(f"Calling tools: {[tc['name'] for tc in latest_message.tool_calls]}")agent.stream:这是核心。它告诉 Agent:“别等全做完了再给我结果,做一步就吐出来一步。”stream_mode="values":这个参数非常关键。它的意思是“每次给我完整的状态快照”。- 如果不加这个,你可能只能看到“新增了什么”。

- 加了

values,每次循环里的chunk都是当前这一刻 Agent 的全部记忆和状态

4.12 中间件

Middleware(中间件,就像拦截器功能,AOP)为定制 Agent 的执行行为提供了强大的扩展能力,允许你在执行流程的不同阶段进行干预。你可以利用中间件实现以下功能:

- 在模型调用前处理状态(例如:消息修剪、上下文注入)

- 修改或校验模型的响应(例如:安全护栏、内容过滤)

- 使用自定义逻辑处理工具执行错误

- 基于状态或上下文实现动态模型选择

- 添加自定义日志、监控或分析功能

到此官网agents解读结束

5 models

LLM(大语言模型) 是强大的人工智能工具,能够像人类一样理解和生成文本。它们非常全能,无需针对每个任务进行专门训练,就能撰写内容、翻译语言、进行摘要和回答问题。

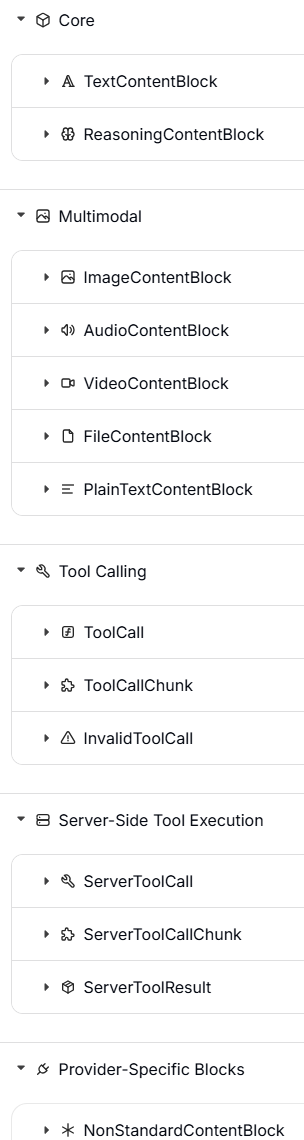

除了文本生成,许多模型还支持:

- 工具调用:调用外部工具(如数据库查询或 API 请求),并在回复中使用结果。

- 结构化输出:将模型的响应限制为遵循定义的格式。

- 多模态:处理和返回文本以外的数据,如图像、音频和视频。

- 推理:模型执行多步推理以得出结论。

模型是 Agent 的“推理引擎”。 它们驱动着 Agent 的决策过程,决定调用哪些工具、如何解释结果,以及何时给出最终答案。你选择的模型的质量和能力,直接决定了 Agent 的基准可靠性和性能。不同的模型擅长不同的任务——有些更擅长遵循复杂的指令,有些擅长结构化推理,还有一些支持更大的上下文窗口以处理更多信息。LangChain 的标准化模型接口让你能够接入许多不同的提供商集成,这使得尝试和切换模型变得非常容易,从而为你的用例找到最合适的选择。

5.1 基本使用

模型有两种使用方式:

- 独立使用:模型可以不依赖agent,独立用于文本生成、分类、或者提取

- 和agent一起使用:创建agent的时候指定模型

5.2 初始模型

最简单的初始化模型,先安装依赖(pip install -U "langchain[openai]")然后使用init_chat_model或者类构造器

import os

#init_chat_model

from langchain.chat_models import init_chat_model

os.environ["OPENAI_API_KEY"] = "sk-..."

model = init_chat_model("gpt-5.2")import os

# 类构造器

from langchain_openai import ChatOpenAI

os.environ["OPENAI_API_KEY"] = "sk-..."

model = ChatOpenAI(model="gpt-5.2")实际应用中,可能会涉及连接多个模型,设置相应的API_KEY和创建多个模型就行了。各个模型厂商的写法需要的时候查一下文档就行了。初始话的时候能用init_chat_model就用这个,这个封装性更好一些。

模型有三个关键方法:invoke、stream、batch

5.3 init_chat_model参数

聊天模型接收用于配置其行为的参数。支持的完整参数集因模型和提供商而异,但标准参数包括:

| 参数名 | 类型 | 必需/默认 | 说明 |

|---|---|---|---|

| model | 字符串 | 必需 | 你想要使用的模型的名称或标识符。你也可以使用 : 格式在单个参数中同时指定模型及其提供商,例如 openai:o1。 |

| api_key | 字符串 | 可选 | 用于与模型提供商进行身份验证的密钥。这通常在你注册模型访问权限时获得。通常通过设置环境变量来访问。 |

| temperature | 数字 | 可选 | 控制模型输出的随机性。数值越高,回复越有创造性;数值越低,回复越确定。 |

| max_tokens | 数字 | 可选 | 限制响应中的总 token 数量,从而有效地控制输出的长度。 |

| timeout | 数字 | 可选 | 在取消请求之前,等待模型响应的最长时间(以秒为单位)。 |

| max_retries | 数字 | 默认: 6 |

如果请求因网络超时或速率限制等问题而失败,系统将尝试重新发送请求的最大次数。重试会使用带有抖动的指数退避策略。网络错误、速率限制 (429) 和服务器错误 (5xx) 会自动重试。客户端错误(如 401 未授权或 404 未找到)不会被重试。对于在不可靠网络上运行的长时间代理任务,可以考虑将此值增加到 10-15。 |

5.4 调用

调用有三种模式:

5.4.1 Invoke

使用单个消息或者列表消息调用模型是最简单直接的方式

#单个消息

response = model.invoke("Why do parrots have colorful feathers?")

print(response)#字典形式消息列表

#消息列表可以包含历史会话信息,每条消息的角色能告诉模型是谁发出的消息

conversation = [

{"role": "system", "content": "You are a helpful assistant that translates English to French."},

{"role": "user", "content": "Translate: I love programming."},

{"role": "assistant", "content": "J'adore la programmation."},

{"role": "user", "content": "Translate: I love building applications."}

]

response = model.invoke(conversation)

print(response) # AIMessage("J'adore créer des applications.")#对象形式消息列表,用起来更方便,更易于维护

from langchain.messages import HumanMessage, AIMessage, SystemMessage

conversation = [

SystemMessage("You are a helpful assistant that translates English to French."),

HumanMessage("Translate: I love programming."),

AIMessage("J'adore la programmation."),

HumanMessage("Translate: I love building applications.")

]

response = model.invoke(conversation)

print(response) # AIMessage("J'adore créer des applications.")提示:

如果你的调用返回类型是字符串,请确保你使用的是聊天模型,而不是 LLM。传统的文本补全 LLM 会直接返回字符串。LangChain 的聊天模型以“Chat”为前缀,例如 ChatOpenAI。这里可能有点抽象,我们搞个例子看看

#传统 这是旧式的文本补全模型。当你调用它时,它直接给你一个字符串。

from langchain_community.llms import OpenAI

# 注意这里使用的是 langchain_community.llms 下的 OpenAI,不是 ChatOpenAI

llm = OpenAI(temperature=0)

# 调用

response = llm.invoke("讲个笑话")

# 验证类型

print(type(response))

# 输出: <class 'str'> (直接就是字符串)

print(response)

# 输出: 有一天,0碰到了8,0不屑地看了8一眼说:“胖就胖呗,还系什么腰带啊!”

#这是现代的标准。当你调用它时,它返回一个包含文本和其他元数据(如响应元数据、使用量等)的对象

from langchain_openai import ChatOpenAI

# 注意这里使用的是 ChatOpenAI

chat_model = ChatOpenAI(temperature=0)

# 调用

response = chat_model.invoke("讲个笑话")

# 验证类型

print(type(response))

# 输出: <class 'langchain_core.messages.ai.AIMessage'> (是一个消息对象)

# 如果你想获取里面的字符串内容,需要访问 .content 属性

print(response.content)

# 输出: 有一天,0碰到了8,0不屑地看了8一眼说:“胖就胖呗,还系什么腰带啊!”5.4.2 stream

大多数模型能够在生成内容的同时进行流式输出。通过逐步显示输出结果,流式传输能够显著改善用户体验,尤其是对于较长的回复。能实现打字机效果,刚开始的时候会觉得新奇,后面的你应该都不会看它在哪里一个一个输出,所以这玩意不能滥用。

调用 stream() 方法会返回一个迭代器,该迭代器会在生成输出时逐步产出内容块。你可以使用循环来实时处理每一个内容块。下面看看两种写法例子

#基本文本流

for chunk in model.stream("Why do parrots have colorful feathers?"):

print(chunk.text, end="|", flush=True)#响应内容通过类型区分是谁输出的

for chunk in model.stream("What color is the sky?"):

for block in chunk.content_blocks:

if block["type"] == "reasoning" and (reasoning := block.get("reasoning")):

print(f"Reasoning: {reasoning}")

elif block["type"] == "tool_call_chunk":

print(f"Tool call chunk: {block}")

elif block["type"] == "text":

print(block["text"])

else:

... 与 invoke() 不同,invoke() 是在模型完成整个响应生成后才返回单个 AIMessage,而 stream() 则返回多个 AIMessageChunk 对象,每个对象包含输出文本的一部分。重要的是,流中的每个分块都设计为可以通过累加汇总成一条完整的消息:

full = None # None | AIMessageChunk

for chunk in model.stream("What color is the sky?"):

full = chunk if full is None else full + chunk

print(full.text)

# The

# The sky

# The sky is

# The sky is typically

# The sky is typically blue

# ...

print(full.content_blocks)

# [{"type": "text", "text": "The sky is typically blue..."}] 生成的消息可以与使用 invoke() 生成的消息一样处理——例如,它可以被聚合到消息历史中,并作为对话上下文传回给模型。

只有当程序中的所有步骤都知道如何处理数据块流时,流式传输才能正常工作。例如,一个不具备流式处理能力的应用程序,可能是那种需要先将整个输出内容存储在内存中,然后才能进行处理的应用。

上面这段话其实要说的就是假如你的下游需要接收一个完整的内容,但是你的产出是一个流,下游是没有办法用的。如果你真要这样干,你就需要像上面一样等汇总所有数据成一个完整内容。

高级流主题

1 流事件

LangChain 聊天模型还可以使用 astream_events() 来流式传输语义事件。

这简化了基于事件类型和其他元数据的过滤过程,并会在后台自动聚合完整的消息。请参见下方的示例:

async for event in model.astream_events("Hello"):

if event["event"] == "on_chat_model_start":

print(f"Input: {event['data']['input']}")

elif event["event"] == "on_chat_model_stream":

print(f"Token: {event['data']['chunk'].text}")

elif event["event"] == "on_chat_model_end":

print(f"Full message: {event['data']['output'].text}")

else:

pass输出

| Input: Hello Token: Hi Token: there Token: ! Token: How Token: can Token: I ... Full message: Hi there! How can I help today? |

2 自动流聊天模型

LangChain 简化了聊天模型的流式传输,它会在特定情况下自动启用流式模式,即使你没有显式调用流式方法。当你使用非流式的 invoke 方法,但仍希望流式传输整个应用程序(包括聊天模型的中间结果)时,这一点特别有用。例如,在 LangGraph 代理中,你可以在节点内调用 model.invoke(),但如果在流式模式下运行,LangChain 会自动委托给流式处理。

🛠️ 工作原理

当你调用 invoke() 时,如果 LangChain 检测到你要流式传输整个应用程序,它会自动切换到内部流式模式。对于使用 invoke 的代码而言,调用的结果是一样的;然而,在聊天模型进行流式传输时,LangChain 会负责在其回调系统中触发 on_llm_new_token 事件。回调事件允许 LangGraph 的 stream() 和 astream_events() 实时呈现聊天模型的输出。

5.4.3 批调用

对模型的多个独立请求进行批处理可以显著提高性能并降低成本,因为处理过程可以并行进行

responses = model.batch([

"Why do parrots have colorful feathers?",

"How do airplanes fly?",

"What is quantum computing?"

])

for response in responses:

print(response) 本节介绍聊天模型的 batch() 方法,该方法在客户端并行执行模型调用。它与 OpenAI 或 Anthropic 等推理服务商提供的批处理 API 不同

默认情况下,batch() 只会返回整个批次的最终输出。如果你希望在每个输入生成完成后就立即收到其输出,可以使用 batch_as_completed() 来流式获取结果。

for response in model.batch_as_completed([

"Why do parrots have colorful feathers?",

"How do airplanes fly?",

"What is quantum computing?"

]):

print(response)

#使用这种模式可能会乱序,输出中有index可以和原始顺序对应当调用batch,需要处理大量输出时,需要传入最大并行度参数

model.batch(

list_of_inputs,

config={

'max_concurrency': 5, # Limit to 5 parallel calls

}

)5.5 工具调用

模型可以请求调用工具来执行各种任务,例如从数据库获取数据、搜索网页或运行代码。工具由以下两部分组成:

- 模式:包括工具的名称、描述和/或参数定义(通常是 JSON Schema)。

- 要执行的函数或协程

下面是用户与模型之间基本的工具调用流程:

为了使模型能够使用你定义的工具,必须使用 bind_tools 将它们绑定。在后续的调用中,模型可以根据需要选择调用任何已绑定的工具。某些模型提供商提供了内置工具,可以通过模型参数或调用参数来启用(例如 ChatOpenAI、ChatAnthropic)。有关详情,请查阅相应提供商的参考文档。前面提到如果使用agent,提前绑定会和结构化冲突,这点要注意。

from langchain.tools import tool

@tool

def get_weather(location: str) -> str:

"""Get the weather at a location."""

return f"It's sunny in {location}."

model_with_tools = model.bind_tools([get_weather])

response = model_with_tools.invoke("What's the weather like in Boston?")

for tool_call in response.tool_calls:

# View tool calls made by the model

print(f"Tool: {tool_call['name']}")

print(f"Args: {tool_call['args']}")当绑定用户定义的工具时,模型的响应会包含执行工具的请求,如果你是在不配合智能体(Agent)的情况下单独使用模型,那么你需要负责执行所请求的工具(如果不结合agent使用,模型只会思考,根据提问会推理到要调用工具,但是不会实际调用,也就是不会真正触发get_weather执行),并将结果返回给模型,以便其在后续的推理中使用,而如果你使用的是智能体,那么智能体循环会自动为你处理工具的整个执行流程。

工具执行循环

当模型返回工具调用请求时,你需要执行相应的工具,并将结果回传给模型。

这就形成了一个对话循环,模型可以利用工具的返回结果来生成最终的回答。LangChain 提供的智能体(Agent)抽象封装可以替你自动处理这种编排工作

# Bind (potentially multiple) tools to the model

model_with_tools = model.bind_tools([get_weather])

# Step 1: Model generates tool calls

messages = [{"role": "user", "content": "What's the weather in Boston?"}]

ai_msg = model_with_tools.invoke(messages)

messages.append(ai_msg)

# Step 2: Execute tools and collect results

for tool_call in ai_msg.tool_calls:

# Execute the tool with the generated arguments

tool_result = get_weather.invoke(tool_call)

messages.append(tool_result)

# Step 3: Pass results back to model for final response

final_response = model_with_tools.invoke(messages)

print(final_response.text)

# "The current weather in Boston is 72°F and sunny." 工具返回的每个 ToolMessage 都包含一个 tool_call_id,它与最初的工具调用相匹配,帮助模型将结果与请求关联起来。

强制调用工具

默认情况下,模型可以根据用户的输入自由选择使用哪个已绑定的工具。不过,你可能想要强制指定工具的选择,确保模型使用某个特定的工具,或者只能从给定的列表中选用工具

#强制使用工具

model_with_tools = model.bind_tools([tool_1], tool_choice="any")

#强制使用指定的工具

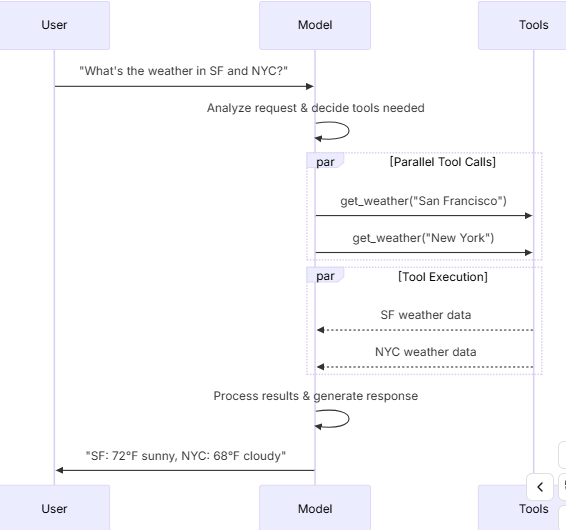

model_with_tools = model.bind_tools([tool_1], tool_choice="tool_1")并行工具调用

许多模型都支持在适当的时候并行调用多个工具。这使得模型能够同时从不同来源收集信息

model_with_tools = model.bind_tools([get_weather])

response = model_with_tools.invoke(

"What's the weather in Boston and Tokyo?"

)

# The model may generate multiple tool calls

print(response.tool_calls)

# [

# {'name': 'get_weather', 'args': {'location': 'Boston'}, 'id': 'call_1'},

# {'name': 'get_weather', 'args': {'location': 'Tokyo'}, 'id': 'call_2'},

# ]

# Execute all tools (can be done in parallel with async)

results = []

for tool_call in response.tool_calls:

if tool_call['name'] == 'get_weather':

result = get_weather.invoke(tool_call)

...

results.append(result)上面这段代码的意思模型给你了解析了入参,自己拿去做并行调用,一般不会这么干,后面都应该会用agent代理。模型会根据所请求操作之间的独立性,智能地判断何时适合进行并行执行。

大多数支持工具调用的模型默认都开启了并行工具调用功能。有些模型(包括 OpenAI 和 Anthropic)允许你禁用此功能。若要禁用,请设置 parallel_tool_calls=False。

model.bind_tools([get_weather], parallel_tool_calls=False)流式工具调用

在流式响应中,工具调用是通过 ToolCallChunk 逐步构建的。这让你能够在工具调用生成时就实时看到,而无需等待完整的响应结束。

for chunk in model_with_tools.stream(

"What's the weather in Boston and Tokyo?"

):

# Tool call chunks arrive progressively

for tool_chunk in chunk.tool_call_chunks:

if name := tool_chunk.get("name"):

print(f"Tool: {name}")

if id_ := tool_chunk.get("id"):

print(f"ID: {id_}")

if args := tool_chunk.get("args"):

print(f"Args: {args}")

# Output:

# Tool: get_weather

# ID: call_SvMlU1TVIZugrFLckFE2ceRE

# Args: {"lo

# Args: catio

# Args: n": "B

# Args: osto

# Args: n"}

# Tool: get_weather

# ID: call_QMZdy6qInx13oWKE7KhuhOLR

# Args: {"lo

# Args: catio

# Args: n": "T

# Args: okyo

# Args: "}5.6 结构化输出

我们可以要求模型按照给定的模式(Schema)来提供响应。这样做的好处是,能确保输出结果很容易被解析,方便后续的处理流程。LangChain 支持多种模式类型,也提供了多种方法来强制实施结构化输出

#pydantic 属于第三方库,要安装,看起来还行

from pydantic import BaseModel, Field

class Movie(BaseModel):

"""A movie with details."""

title: str = Field(description="The title of the movie")

year: int = Field(description="The year the movie was released")

director: str = Field(description="The director of the movie")

rating: float = Field(description="The movie's rating out of 10")

model_with_structure = model.with_structured_output(Movie)

response = model_with_structure.invoke("Provide details about the movie Inception")

print(response) # Movie(title="Inception", year=2010, director="Christopher Nolan", rating=8.8)

#typing_extensions 这玩意也需要安装,语法看起来怪怪的,还有省略号

#这该死的玩意连AI都费解,不行就叫黑魔法哈哈🤣

from typing_extensions import TypedDict, Annotated

class MovieDict(TypedDict):

"""A movie with details."""

title: Annotated[str, ..., "The title of the movie"]

year: Annotated[int, ..., "The year the movie was released"]

director: Annotated[str, ..., "The director of the movie"]

rating: Annotated[float, ..., "The movie's rating out of 10"]

model_with_structure = model.with_structured_output(MovieDict)

response = model_with_structure.invoke("Provide details about the movie Inception")

print(response) # {'title': 'Inception', 'year': 2010, 'director': 'Christopher Nolan', 'rating': 8.8}import json

json_schema = {

"title": "Movie",

"description": "A movie with details",

"type": "object",

"properties": {

"title": {

"type": "string",

"description": "The title of the movie"

},

"year": {

"type": "integer",

"description": "The year the movie was released"

},

"director": {

"type": "string",

"description": "The director of the movie"

},

"rating": {

"type": "number",

"description": "The movie's rating out of 10"

}

},

"required": ["title", "year", "director", "rating"]

}

model_with_structure = model.with_structured_output(

json_schema,

method="json_schema",

)

response = model_with_structure.invoke("Provide details about the movie Inception")

print(response) # {'title': 'Inception', 'year': 2010, ...}看来第一个写法更好看(实际上用了和第二个类似的黑魔法,去它娘的黑魔法🤣),第二个也是黑魔法,不过把黑魔法暴露出来了,第三个看起来有不简洁。

我们来看看第一个的黑魔法:

#Field 能同时满足int,或者str Field返回...作为占位符,

#类定义阶段赋的值(Field),是用来定义规则的;而你在实例化阶段传的值("星际穿越")

title: str = Field(description="The title of the movie")

year: int = Field(description="The year the movie was released")方法参数

不同的 AI 提供商支持不同的结构化输出方法。你可以通过 method 参数来指定使用哪种方式:

'json_schema':- 含义:使用提供商提供的专用结构化输出功能。

- 特点:这是目前最先进、最可靠的方法。模型会严格遵循你定义的 JSON 结构,甚至会在生成时进行强制约束。

'function_calling':- 含义:通过强制调用工具来实现结构化输出。

- 特点:这其实是个“障眼法”。你把想要的结构伪装成一个“工具/函数”,强制 AI 调用这个工具。AI 返回的工具参数就是你要的结构化数据。

'json_mode':- 含义:这是

'json_schema'的前身(较旧的方法)。 - 特点:它只能保证 AI 输出的是合法的 JSON 格式,但不能保证 JSON 里的内容完全符合你的字段要求。你需要自己在提示词里反复强调“必须包含这些字段”,否则模型可能会漏掉字段。

- 含义:这是

包含原始数据

- 设置

include_raw=True:- 如果你需要同时获取解析后的数据(比如 Python 字典)和原始的 AI 消息对象(包含 token 用量、原始文本等元数据),可以开启这个选项。

数据验证

- Pydantic 模型:

- 自带验证。如果 AI 输出的数据格式不对(比如该填数字的地方填了文字),Pydantic 会自动报错或尝试修正,非常省心。

- TypedDict 和 JSON Schema:

- 需要手动验证。LangChain 拿到数据后,不会自动检查数据对不对,你需要自己写代码去校验。

时返回原始的 AIMessage 对象和解析后的数据往往非常有用,因为这样你就能获取到像 Token 用量这类的响应元数据。想要实现这一点,只需在调用 with_structured_output 时设置 include_raw=True 即可

from pydantic import BaseModel, Field

class Movie(BaseModel):

"""A movie with details."""

title: str = Field(description="The title of the movie")

year: int = Field(description="The year the movie was released")

director: str = Field(description="The director of the movie")

rating: float = Field(description="The movie's rating out of 10")

model_with_structure = model.with_structured_output(Movie, include_raw=True)

response = model_with_structure.invoke("Provide details about the movie Inception")

response

# {

# "raw": AIMessage(...),

# "parsed": Movie(title=..., year=..., ...),

# "parsing_error": None,

# }模式能被内嵌

#pydantic

from pydantic import BaseModel, Field

class Actor(BaseModel):

name: str

role: str

class MovieDetails(BaseModel):

title: str

year: int

cast: list[Actor]

genres: list[str]

budget: float | None = Field(None, description="Budget in millions USD")

model_with_structure = model.with_structured_output(MovieDetails)#TypedDict

from typing_extensions import Annotated, TypedDict

class Actor(TypedDict):

name: str

role: str

class MovieDetails(TypedDict):

title: str

year: int

cast: list[Actor]

genres: list[str]

budget: Annotated[float | None, ..., "Budget in millions USD"]

model_with_structure = model.with_structured_output(MovieDetails)5.7 高级主题

5.7.1 模型档案

LangChain 聊天模型可以通过一个 profile 属性来展示其支持的功能和能力的字典

model.profile

# {

# "max_input_tokens": 400000,

# "image_inputs": True,

# "reasoning_output": True,

# "tool_calling": True,

# ...

# }

#这里只是一个例子,更多的设置参考API文档大部分模型档案数据由 models.dev 项目提供支持,这是一个提供模型能力数据的开源项目。为了适配 LangChain 的使用场景,这些数据被增加了额外的字段。随着上游项目的演进,这些增补内容也会保持同步更新。模型档案数据使得应用程序能够动态地适应模型的能力(或绕过其限制)。例如:

- 摘要中间件可以根据模型的上下文窗口大小来触发摘要操作。

- create_agent 中的结构化输出策略可以被自动推断(例如,通过检查是否支持原生的结构化输出功能)。

- 可以根据支持的模态(如文本、图像)和最大输入令牌数,对模型输入进行门控控制。

- Deep Agents CLI 会过滤交互式模型切换器,仅显示那些档案中报告支持

tool_calling(工具调用)和文本 I/O 的模型,并在选择器的详情视图中显示上下文窗口大小和能力标志。

模型档案目前还是测试版功能,其格式可能会发生变化。如果模型档案数据缺失、过时或不正确,可以对其进行更改

选择1(快速修复)

你可以使用任何有效的档案(profile)来实例化一个聊天模型

custom_profile = {

"max_input_tokens": 100_000,

"tool_calling": True,

"structured_output": True,

# ...

}

model = init_chat_model("...", profile=custom_profile) 该档案(profile)也是一个普通的字典,可以直接进行原地更新。如果模型实例是共享的,请考虑使用 model_copy 来避免修改共享状态。

new_profile = model.profile | {"key": "value"}

model.model_copy(update={"profile": new_profile})选择2(上游修复数据)

数据的主要来源是 models.dev 项目。这些数据会与 LangChain 集成包中的额外字段和覆盖配置进行合并,并随这些包一起发布。

可以通过以下流程更新模型档案数据:

- (如有需要)通过向 GitHub 上的仓库提交 Pull Request,更新

models.dev的源数据。 - (如有需要)通过向 LangChain 集成包提交 Pull Request,更新

langchain_<package>/data/profile_augmentations.toml中的额外字段和覆盖配置。 - 使用

langchain-model-profiles命令行工具从models.dev拉取最新数据,合并增强配置,并更新档案数据。

pip install langchain-model-profiles

langchain-profiles refresh --provider <provider> --data-dir <data_dir>该命令会执行以下操作:

- 从

models.dev下载<provider>(提供商)的最新数据 - 合并

<data_dir>(数据目录)中profile_augmentations.toml文件里的增强配置 - 将合并后的档案写入

<data_dir>目录下的profiles.py文件中

例如

uv run --with langchain-model-profiles --provider anthropic --data-dir langchain_anthropic/data5.7.2 多模态

某些模型能够处理并返回图像、音频和视频等非文本数据。你可以通过提供内容块,将非文本数据传递给模型。所有具备底层多模态能力的 LangChain 聊天模型均支持以下格式:

- 跨提供商标准格式的数据(请参阅我们的消息指南)

- OpenAI 聊天补全格式

- 特定提供商的原生格式(例如,Anthropic 模型接受 Anthropic 原生格式)

有些模型能够在响应中返回多模态数据。如果被调用执行此操作,生成的 AI 消息将包含具有多模态类型的内容块

response = model.invoke("Create a picture of a cat")

print(response.content_blocks)

# [

# {"type": "text", "text": "Here's a picture of a cat"},

# {"type": "image", "base64": "...", "mime_type": "image/jpeg"},

# ]5.7.3 推理

许多模型都能够执行多步推理来得出结论。这涉及将复杂的问题分解为更小、更易于管理的步骤。如果底层模型支持,你可以将这一推理过程展示出来,以便更好地理解模型是如何得出最终答案的。

#流式

for chunk in model.stream("Why do parrots have colorful feathers?"):

reasoning_steps = [r for r in chunk.content_blocks if r["type"] == "reasoning"]

print(reasoning_steps if reasoning_steps else chunk.text)

#一次给出结果

response = model.invoke("Why do parrots have colorful feathers?")

reasoning_steps = [b for b in response.content_blocks if b["type"] == "reasoning"]

print(" ".join(step["reasoning"] for step in reasoning_steps))根据模型的不同,你有时可以指定它在推理上投入的精力水平。同样,你也可以要求模型完全关闭推理功能。这种设置的形式可能是分类式的“层级”(例如“低”或“高”),也可能是以整数表示的 Token 预算

5.7.4 本地模型

LangChain 支持在你自己的硬件上本地运行模型。这在数据隐私至关重要、你想要调用自定义模型,或者希望避免使用云端模型所产生的费用时,非常有用。Ollama 是在本地运行聊天和嵌入模型的最简单方法之一。

5.7.5 提示词缓存

许多服务提供商都提供提示词缓存功能,以减少重复处理相同 Token 时的延迟和成本。这些功能可以分为隐式和显式两种:

- 隐式提示词缓存: 当请求命中缓存时,服务提供商会自动给予成本优惠。例如:OpenAI 和 Gemini。

- 显式缓存: 服务提供商允许你手动指定缓存点,从而获得更大的控制权或确保成本节省。例如:

ChatOpenAI(通过 prompt_cache_key 参数)

Anthropic 的 AnthropicPromptCachingMiddleware

Gemini

AWS Bedrock

5.7.6 服务端工具使用

某些服务提供商支持服务端工具调用循环:模型可以在单次对话回合中,与网络搜索、代码解释器和其他工具进行交互,并分析结果。如果模型在服务端调用了工具,响应消息的内容将包含代表该工具调用及其结果的内容。访问响应消息的内容块,将以一种与提供商无关的格式返回服务端工具调用和结果:

#Invoke with server-side tool use

from langchain.chat_models import init_chat_model

model = init_chat_model("gpt-4.1-mini")

tool = {"type": "web_search"}

model_with_tools = model.bind_tools([tool])

response = model_with_tools.invoke("What was a positive news story from today?")

print(response.content_blocks)这段话其实是在告诉你,现在的模型不仅能“陪聊”,还能“干活”,而且这个“干活”的过程是全自动的:

- 单次对话回合: 以前可能需要你问一句,模型调个工具,你再问一句,模型分析结果。现在,你只需要问一句,模型自己就能完成“调用工具 -> 获取结果 -> 分析结果”这一整套流程。

- 内容块: 模型在返回最终答案的同时,也会把“我调用了什么工具”以及“工具返回了什么结果”这些信息,打包在“内容块”里一起给你。

- 与提供商无关的格式: 不管你是用的 OpenAI、Anthropic 还是其他家的模型,LangChain 都会把这些工具调用的信息,统一转换成一种标准的格式,让你不用去管不同服务商之间的差异。

[

{

"type": "server_tool_call",

"name": "web_search",

"args": {

"query": "positive news stories today",

"type": "search"

},

"id": "ws_abc123"

},

{

"type": "server_tool_result",

"tool_call_id": "ws_abc123",

"status": "success"

},

{

"type": "text",

"text": "Here are some positive news stories from today...",

"annotations": [

{

"end_index": 410,

"start_index": 337,

"title": "article title",

"type": "citation",

"url": "..."

}

]