AI知识库答非所问?别怪模型弱!Azure AI Search带你搞定精准检索,让你的RAG知识库不再“答非所问”!

读完本文,你能弄明白为什么你的 RAG 知识库总是"答非所问",以及 Azure AI Search 作为检索底座到底解决了什么问题——这是所有做企业 AI 应用的人迟早要面对的一课。

一、2 万份文档,翻了 40 分钟,还是没找到

上个月有个做制造业的客户跟我抱怨。他们厂里有 2 万多份技术手册和维修指南,全在 SharePoint 上。

一线工程师遇到问题的时候,标准流程是:打开 SharePoint → 点进"技术资料"文件夹 → 按年份找 → 按产品线找 → 打开 PDF 搜关键词 → 发现不是这一份 → 退出,再找下一份。

一趟下来平均 40 分钟。

后来他们上了一个 AI 知识问答系统,底层用的 Azure OpenAI,接了一个 Blob 存储,里面丢了一堆 PDF。工程师在对话框提问,模型"尝试"回答。

结果更糟。

工程师问:“X 型号电机过热的排查步骤是什么?” 模型回答了一段听起来很专业的话——但那段话是通用知识,不是公司内部文档里的操作规程。有人照着做了,拆错了线序,差点造成安全事故。

老板震怒:“AI 乱说的比不说的更危险。”

二、模型不是"不会答",是"没看到"

很多人以为知识问答做得不好,是模型不够强——“换 GPT-4o 试试?换 Claude 试试?”

这是一个致命的误解。

GPT-4o 再强,它也不知道你公司内部那份 X 型号电机维修手册第 47 页写了什么。

LLM 的知识来自它的训练数据,不来自你的企业文档。如果你不把相关文档片段"喂"给它,它只能靠猜——而猜出来的东西叫"幻觉"。

正确的做法是 RAG(Retrieval-Augmented Generation):用户提问时,先从企业文档中检索出最相关的片段,再把这些片段连同问题一起交给模型,让模型基于这些真实内容生成回答。

所以问题的关键不在"生成",在"检索"——你的检索层能不能找到对的文档片段,决定了模型能不能给出对的回答。

Azure AI Search 就是干这个的。

三、你真正需要知道的四件事

3.1 不只是搜关键词——四种搜索模式

传统搜索:用户搜"电机过热",只能匹配到写了"电机过热"这四个字的文档。但如果文档里写的是"马达温升异常"呢?

Azure AI Search 提供四种搜索模式,像四层滤网逐层过滤:

-

- 全文搜索(BM25):经典关键词匹配,精确但召回率有限

-

- 向量搜索(HNSW):把文本转成向量,按语义相似度匹配——"电机过热"和"马达温升异常"在向量空间里是邻居

-

- 混合搜索:全文 + 向量同时跑,用 RRF 算法融合排名——微软的基准测试表明这是效果最好的方式

-

- 语义排序:在混合搜索结果上再加一层 L2 重排,用阅读理解模型判断"这条结果到底跟问题有多相关"

实际工作中你应该这样做:RAG 场景直接上"混合搜索 + 语义排序",不要只用向量搜索——纯向量搜索在精确术语匹配上反而不如关键词。

3.2 不用自己写 Embedding 代码——集成向量化

以前做向量搜索,你需要自己写一整条管道:读文档 → 切分 chunk → 调 OpenAI Embedding API → 把向量存进数据库。

现在 Azure AI Search 把这条管道内置了,叫 Integrated Vectorization(集成向量化):

- • 索引时:在 Skillset 中配一个 Text Split Skill(切分文档)+ Azure OpenAI Embedding Skill(生成向量),Indexer 自动执行

- • 查询时:在索引上配一个 Vectorizer,用户输入文本自动转向量——你只需要传

search_text,不用自己调 Embedding API

这省去了大量胶水代码,也省去了"索引用了 ada-002 但查询用了 text-embedding-3-large 导致向量空间不匹配"这种隐蔽 bug。

3.3 扫描件、PDF、图片也能搜——AI 增强

企业里最头疼的不是文本文档,而是那些"不可搜索的内容"——扫描件 PDF、手写笔记照片、CAD 图纸截图。

Azure AI Search 的 AI Enrichment(AI 增强) 通过 Skillset 管道,在索引阶段自动处理:

- • OCR:把扫描件里的文字提取出来

- • 实体识别:自动标注人名、公司名、日期、金额

- • 关键短语提取:自动提炼文档核心内容

- • 图像分析:描述图片内容并转为可搜索文本

也就是说,那份躺在 SharePoint 里的扫描版维修手册,经过 AI 增强之后也能被搜到了。

3.4 Agent 的"眼睛"——Agentic Retrieval

昨天那篇文章讲了 Azure AI Foundry 的 Agent 能力。今天要补一个关键拼图:Agent 之所以能"言之有据",是因为它的背后接了 AI Search。

新出的 Agentic Retrieval(预览版)更进一步:

用户问了一个复杂问题,比如"2025 年 Q4 亚太区销售额同比变化以及主要原因"——这个问题不是搜一次就能回答的。Agentic Retrieval 会让 LLM 把问题拆成多个子查询(“2025 Q4 亚太销售额”、“2024 Q4 亚太销售额”、“亚太区业务变动分析”),并行检索,再把结果融合。

实际工作中你应该这样做:如果你在用 Azure AI Foundry 的 Agent,把 AI Search 作为 AzureAISearchTool 挂进去,配置为 VECTOR_SEMANTIC_HYBRID 查询类型——这是当前检索质量最高的组合。

四、直接可用的代码

混合搜索 + 语义排序(Python,最常用的 RAG 查询方式)

from azure.identity import DefaultAzureCredentialfrom azure.search.documents import SearchClientfrom azure.search.documents.models import VectorizedQueryclient = SearchClient( endpoint="https://<your-service>.search.windows.net", index_name="enterprise-knowledge-index", credential=DefaultAzureCredential(), # 别用 API Key,用 Managed Identity)vector_query = VectorizedQuery( vector=query_embedding, # 你的 Embedding 模型生成的向量 k_nearest_neighbors=10, fields="chunk_vector",)# 一次请求同时做关键词搜索 + 向量搜索 + 语义重排results = client.search( search_text="员工出差报销流程是什么", vector_queries=[vector_query], query_type="semantic", # 开启语义排序 semantic_configuration_name="my-semantic-config", query_caption="extractive", # 返回语义摘要 select=["title", "chunk", "source"], top=5,)for r in results: print(f"{r['title']} — {r['source']}")

这段代码做了三件事:关键词搜"出差报销"、向量搜语义相近的内容、语义排序把最相关的排最前面。三层过滤,命中率比纯关键词搜索高一个量级。

五、避坑清单

❌ RAG 效果差就换更强的模型

✅ 先看检索层有没有命中——80% 的 RAG 问题出在检索,不在生成

💡 开启 AI Search 的 Tracing,每次看看 Retrieval 到底返回了什么

❌ 只用向量搜索做 RAG

✅ 用混合搜索(全文 + 向量)+ 语义排序

💡 纯向量搜索在精确术语(型号、编号、人名)上不如关键词;混合搜索兼顾语义和精确

❌ 生产环境用 API Key 访问 AI Search

✅ 用 Managed Identity + RBAC,废掉所有手工管理的 Key

💡 Key 散落在多个团队手里,早晚有一个 Key 出现在不该出现的地方

❌ 文档切分太随意——按固定 500 字符一刀切

✅ 按语义段落切分,chunk 1000-2000 字符,overlap 100-200 字符,每个 chunk 带元数据

💡 切太碎模型拿不到完整上下文,切太大又塞不进 prompt。元数据(来源、标题、日期)是溯源的生命线

六、结尾

做 RAG 知识库这件事,大多数人把 90% 的精力花在模型选择和 Prompt 调优上。

但如果检索层命中率只有 60%,你的模型有 40% 的概率在"基于错误的上下文编造看起来正确的答案"——这比不回答更危险。

RAG 的第一个 R 是 Retrieval,不是 Random。把检索做对,比把模型调强重要十倍。

明天聊 Azure AI Vision——当你的业务不只有文本,还有图片和视频的时候,AI 怎么"看懂"它们。

💡觉得有用就转发给正在搭 RAG 知识库的朋友,也许刚好帮他省了三个月的弯路 🙌

2026年AI行业最大的机会,毫无疑问就在应用层!

字节跳动已有7个团队全速布局Agent

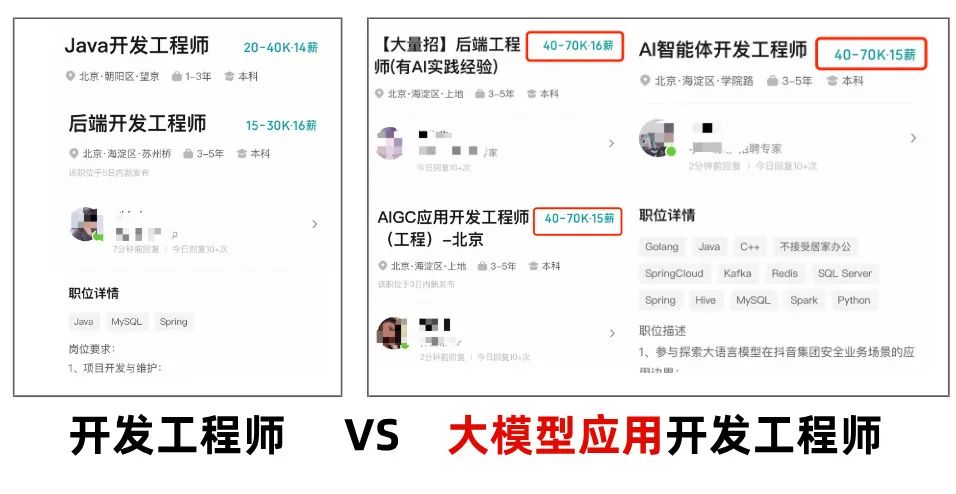

大模型岗位暴增69%,年薪破百万!

腾讯、京东、百度开放招聘技术岗,80%与AI相关……

如今,超过60%的企业都在推进AI产品落地,而真正能交付项目的 大模型应用开发工程师 **,**却极度稀缺!

落地AI应用绝对不是写几个prompt,调几个API就能搞定的,企业真正需要的,是能搞定这三项核心能力的人:

✅RAG:融入外部信息,修正模型输出,给模型装靠谱大脑

✅Agent智能体:让AI自主干活,通过工具调用(Tools)环境交互,多步推理完成复杂任务。比如做智能客服等等……

✅微调:针对特定任务优化,让模型适配业务

目前,脉脉上有超过1000家企业发布大模型相关岗位,人工智能岗平均月薪7.8w!实习生日薪高达4000!远超其他行业收入水平!

技术的稀缺性,才是你「值钱」的关键!

具备AI能力的程序员,比传统开发高出不止一截!有的人早就转行AI方向,拿到百万年薪!👇🏻👇🏻

AI浪潮,正在重构程序员的核心竞争力!现在入场,仍是最佳时机!

我把大模型的学习全流程已经整理📚好了!抓住AI时代风口,轻松解锁职业新可能,希望大家都能把握机遇,实现薪资/职业跃迁~

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

⭐️从大模型微调到AI Agent智能体搭建

剖析AI技术的应用场景,用实战经验落地AI技术。从GPT到最火的开源模型,让你从容面对AI技术革新!

大模型微调

-

掌握主流大模型(如DeepSeek、Qwen等)的微调技术,针对特定场景优化模型性能。

-

学习如何利用领域数据(如制造、医药、金融等)进行模型定制,提升任务准确性和效率。

RAG应用开发

- 深入理解检索增强生成(Retrieval-Augmented Generation, RAG)技术,构建高效的知识检索与生成系统。

- 应用于垂类场景(如法律文档分析、医疗诊断辅助、金融报告生成等),实现精准信息提取与内容生成。

AI Agent智能体搭建

- 学习如何设计和开发AI Agent,实现多任务协同、自主决策和复杂问题解决。

- 构建垂类场景下的智能助手(如制造业中的设备故障诊断Agent、金融领域的投资分析Agent等)。

如果你也有以下诉求:

快速链接产品/业务团队,参与前沿项目

构建技术壁垒,从竞争者中脱颖而出

避开35岁裁员危险期,顺利拿下高薪岗

迭代技术水平,延长未来20年的新职业发展!

……

那这节课你一定要来听!

因为,留给普通程序员的时间真的不多了!

立即扫码,即可免费预约

「AI技术原理 + 实战应用 + 职业发展」

「大模型应用开发实战公开课」

👇👇

👍🏻还有靠谱的内推机会+直聘权益!!

完课后赠送:大模型应用案例集、AI商业落地白皮书

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献115条内容

已为社区贡献115条内容

所有评论(0)