用 AI 生成 n8n 工作流,15 分钟搭完我手动要搞半天的东西

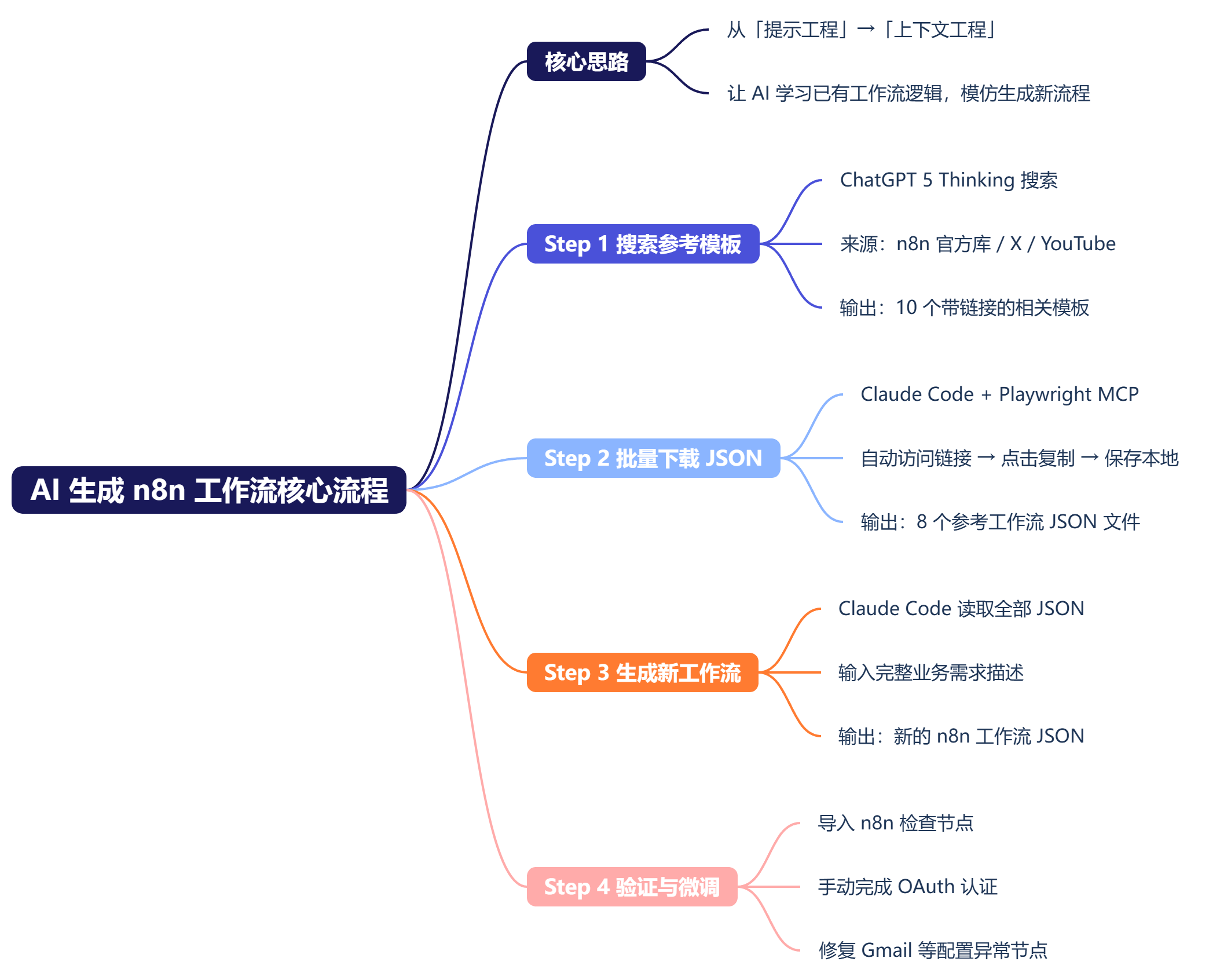

核心逻辑一句话概括:不让 AI 凭空造,而是先找同类工作流 JSON 作为上下文,再让 AI 照葫芦画瓢生成新流程。四步走:ChatGPT 搜模板 → Claude Code 批量下载 JSON → 喂需求生成新工作流 → 导入 n8n 微调验证。全程 15 分钟,人只需要做 OAuth 认证和少量节点修复。

最近折腾了一个思路,用来解决 n8n-MCP 的一个根本性缺陷——然后顺手在 15 分钟内搭出了一个 Reddit 舆情监控工作流。先说结论:这个方案目前是我用过效率最高的。

问题出在哪?

n8n-MCP 的逻辑是:根据用户需求去 n8n 节点库里查找节点,然后按 AI 自己的判断把节点连起来。

听起来没问题,但问题恰恰就在这里——整个过程都是 AI 自己的判断,没有业务逻辑的介入。AI 会选择"最理性"的路径,也就是最短路径。但真实的业务逻辑往往需要大量的合并、循环、条件分支,才能处理复杂需求。

所以,让 AI 凭空生成工作流,结果往往是一个"看起来合理但跑不通"的东西。

解法是什么?把「提示工程」转成「上下文工程」。

不让 AI 自己发明,而是让 AI 去学习已有的复杂工作流的逻辑,再模仿着完成新需求。核心问题就变成了:如何让 AI 根据你的需求,自动找到合适的几个 n8n 工作流,然后参考它们来搭建你的新工作流?

实操流程:4 步走

Step 1:找到需求相关的 JSON

n8n 官方模板库(n8n.io/workflows/)有 6000 多个模板,几乎任何需求都能找到接近的参考。

这一步用 ChatGPT 5 Thinking 来做搜索效果最好。把你的需求描述清楚,让它去官方模板库、X(推特)、YouTube 等地方找 10 个最相关的现成工作流,全部附上来源链接。

比如这次的需求是搭一个 Reddit 舆情监控工作流,用于品牌竞品分析、负面舆情预警、用户痛点洞察。ChatGPT 5 Thinking 思考了 1 分 41 秒,给出了 10 个带链接的模板推荐,包括:

- Analyze Reddit Posts with AI to Identify Business Opportunities — 用 GPT-4 分析热帖,写入 Google Sheets,可加 Slack 告警

- Reddit Brand Engagement with AI Comment Generation & Slack Notifications — 自动找品牌相关讨论,生成 AI 回复建议

- Reddit AI Digest — 每周汇总 Reddit 提及,OpenAI 分类摘要,输出到邮件或 Slack

- Social Media Sentiment Analysis Dashboard — 跨 Twitter + Reddit + LinkedIn 多平台情感分析看板

不得不说,ChatGPT 5 Thinking 的搜索能力是目前用过最强的。

Step 2:一键批量下载 JSON

有了链接,下一步是把这些模板的 JSON 文件全部下载到本地,作为 AI 生成新工作流的"参考素材"。

这种重复性操作交给 Claude Code 来做。提示词大概是这样:

调用 Playwright MCP 工具,逐个访问以下 8 个 N8N 模板链接,在每个链接的页面找到"Use for free"按钮点击,在弹窗点"Copy template to clipboard [JSON]",然后在本地文件夹创建一个 JSON 文件把复制的内容粘贴进去。总共生成 8 个 JSON。

Claude Code 会自动调用浏览器完成整个操作。中途遇到了 token 超限的问题(browser_evaluate 返回了 29755 tokens,超过了 25080 的上限),Claude Code 自动切换策略,改为直接调用 n8n API 获取模板数据,最终成功生成了 8 个 JSON 文件:

analyze-reddit-posts-with-ai.json 72.7 KB

reddit-brand-engagement.json 15.9 KB

reddit-ai-digest.json 12.0 KB

automated-reddit-lead-generation.json 25.7 KB

social-media-sentiment-analysis.json 35.8 KB

reddit-api-hub.json 47.7 KB

sentiment-analytics-visualizer.json 13.8 KB

reddit-bot-automation.json 8.2 KB

Step 3:生成新工作流

现在文件夹里有了 8 个参考 JSON,回到 Claude Code,给它一个完整的需求描述,让它读完所有文件后生成新的工作流 JSON。

提示词的关键结构是这样的:

当前文件夹是 Reddit 相关的 n8n 工作流 JSON 文件,

你务必要每个文件都完整浏览一遍后,完成以下需求:

[需求描述]

大疆(DJI)Reddit 舆情监控流程

目标:自动监控 Reddit 上关于大疆及其竞品的讨论,及时发现问题和机会。

第一步:设定监控指令(Inputs)

关键词列表:

- 品牌词:DJI、大疆

- 产品词:Mavic, Air, Mini, Inspire, Phantom, Avata, Osmo, Ronin

- 痛点词:flyaway(炸机)、GPS lost、battery drain、firmware update...

- 竞品词:Autel, Parrot, Skydio, Yuneec, Hubsan, PowerVision

社区列表:r/dji、r/drones、r/Multicopter、r/UAV、r/Quadcopter、r/DronePhotography

第二步:N8N 自动化流程

- 定时启动:每周自动运行一次

- 抓取内容:包含关键词的最新帖子和评论

- AI 分析:情感标签(好评/差评/中性)+ 主题分类 + 是否紧急

- 自动处理:紧急情况发 Gmail 警报,所有结果存入 Google Sheets

第三步:最终成果(Output)

- 数据看板:过去 7 天总提及量、差评占比

- 竞品对比图:大疆 vs Autel vs Parrot 每日讨论量

- 痛点排行榜:用户抱怨最多的问题

- 最新差评列表:含原文链接

注意:AI 相关任务通过 AI Agent 节点搭配 OpenAI 的 model 来完成。

稍等片刻,文件夹里就新增了一个完整的工作流 JSON,Claude Code 还会主动提示哪些节点需要手动配置。

Step 4:验证工作流

生成的工作流分五步:

- 定时触发 — 每 7 天执行一次,持续监控 DJI 相关讨论

- 多社区数据收集 — 同时搜索 6 个 Subreddit,按品牌词/产品词/痛点词/竞品词分别检索

- AI 智能分析 — 情感分析 + 主题分类

- 智能警报系统 — 严重负面情况触发 Gmail 即时告警

- 周报生成 — 数据汇总 + 竞品对比 + 痛点排行,邮件发送

验证结果:

- 第一步(定时触发):完全没问题,按周监控逻辑正确

- 第二步(多社区数据收集):只做了 Reddit 节点的 OAuth 认证,然后——全!跑!通!了!

- 第四步(Gmail 节点):节点配置有误,这算是 AI 生成工作流的一个小败笔。不过手动配置一下邮件内容,问题不大

- Google Sheets 部分:需要自己新建文档并设置好列名

整个工作流,从第一步到跑通,总共用了 15 分钟。

那么,还需要学 n8n 吗?

这是最近很多人问的问题:既然 AI 能生成工作流了,是不是不用学 n8n 了?Claude Code 这种 Agentic Code 能完成很多工作流场景,是不是 n8n 也没必要搞了?

答案是:我们不再需要学的,是过去那种逐个节点拖拽、配置、连线的"体力活"。

但我们必须开始学的,是一种更高维度的业务架构能力——你得知道一个复杂业务流程应该拆成哪几步,每步的输入输出是什么,异常情况怎么处理。这些判断,AI 替代不了。

n8n 最近刚完成 1.8 亿美金融资,英伟达也在投资方之列,估值飙到 25 亿。这说明市场已经给出了答案:AI 需要一个稳定可靠的底层框架来执行任务,n8n 正是这个框架的最佳选择之一。

得益于 AI 的发展,n8n 的大部分繁琐操作可以自动化了。但永远有最后一公里,需要人去探索和打磨。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献47条内容

已为社区贡献47条内容

所有评论(0)