RAG 技术全详解:大模型应用落地保姆级从零到一实现教程

大模型应用落地核心方案:RAG技术全详解+保姆级从零到一实现教程

本文面向所有大模型应用开发者,从基础原理、架构拆解,到可直接运行的完整代码实现,再到生产级优化方案与避坑指南,一站式讲透RAG技术。哪怕你是零基础的新手,也能跟着本文从零搭建一套属于自己的RAG系统;如果你是有经验的开发者,也能从进阶优化方案中获得新的思路。

引言:为什么90%的大模型应用落地,都离不开RAG?

你是否在大模型应用开发中,遇到过这些直击痛点的难题:

- 调用GPT、通义千问、GLM等大模型API做应用,回答经常一本正经地胡说八道,幻觉问题屡禁不止,专业场景完全不敢用?

- 想要大模型用上企业内部的最新文档、产品手册、专属业务数据,但是微调大模型成本高、周期长,数据更新还要重新微调,完全跟不上业务迭代速度?

- 担心把企业内部敏感数据、用户隐私数据上传给大模型厂商,数据安全和合规性根本无法保障?

- 做了无数轮Prompt工程优化,但是效果依然不稳定,面对垂直领域的专业问题,大模型还是答非所问?

如果你有以上困扰,那么检索增强生成(Retrieval-Augmented Generation,简称RAG) 技术,就是你解决这些问题的最优解,也是当前大模型应用落地最主流、性价比最高的方案。

2020年Meta首次提出RAG技术以来,它已经从一个简单的学术方案,发展成了一套完整的大模型应用落地技术体系。它不需要你有海量的GPU算力,不需要你懂复杂的大模型训练,哪怕是个人开发者,也能用几十行代码,让大模型完全基于你的专属数据生成精准、可溯源、无幻觉的回答。

本文将带你从零到一,彻底搞懂RAG,实现一套可直接用于生产的RAG系统。

一、RAG到底是什么?和微调比,核心优势在哪里?

1.1 RAG的核心定义

检索增强生成(RAG),是一种结合信息检索与大语言模型生成的技术框架。它的核心逻辑非常简单:

让大模型在回答用户问题之前,先从你的专属知识库中,检索出与问题最相关的内容,再把这些内容作为上下文,和用户的问题一起交给大模型,强制大模型仅基于检索到的真实内容生成回答,从根源上减少幻觉,实现专属知识的精准注入。

简单来说,RAG就像给大模型配了一个「专属图书馆+严格的监考老师」:大模型回答问题前,必须先去图书馆里找到对应的参考资料,只能基于资料里的内容答题,不能自己瞎编,答完还要标注引用来源,确保每一句话都有据可查。

1.2 RAG vs 大模型微调:到底该怎么选?

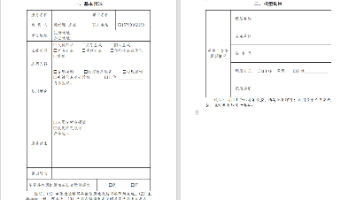

很多开发者都会问:想要给大模型注入专属知识,到底是用RAG还是微调?这里我用一张表给你讲透两者的核心差异与适用场景,帮你彻底做对选择。

| 对比维度 | 检索增强生成(RAG) | 大模型微调(Fine-tuning) |

|---|---|---|

| 核心解决问题 | 知识注入、幻觉抑制、实时数据更新 | 模型风格对齐、特定任务能力优化、行为模式固化 |

| 数据更新成本 | 极低,新增文档只需重新索引,分钟级完成 | 极高,需要重新准备数据集、训练、评估,周期数天到数周 |

| 算力成本 | 极低,仅需Embedding和检索的算力,CPU即可跑通基础版 | 极高,需要GPU/TPU训练,开源7B模型微调也要数千元算力成本 |

| 数据安全 | 极高,敏感数据可完全本地部署,无需上传给大模型厂商 | 中低,微调数据需要上传,存在数据泄露与合规风险 |

| 幻觉抑制 | 优秀,所有回答基于检索到的真实文档,可溯源、可校验 | 一般,微调无法彻底解决幻觉问题,甚至会把错误知识固化到模型中 |

| 可解释性 | 极强,回答的每一句话都可以追溯到原始文档 | 极差,黑箱模型,无法解释回答的来源与逻辑 |

| 适用场景 | 企业知识库、智能客服、文档问答、实时数据更新场景、垂直领域专业问答 | 风格定制、特定任务(如代码生成、文案创作)、大规模通用能力优化 |

核心结论:

- 只要你的需求是「让大模型用上专属的、会更新的知识,解决幻觉问题」,优先选RAG,它是性价比最高、落地最快的方案;

- 只有当你的需求是「改变大模型的行为模式、风格,或者优化特定任务的通用能力」,才需要考虑微调。

- 生产级场景中,最优方案往往是「RAG为主,微调为辅」:用RAG解决知识注入问题,用微调让大模型更好地适配你的业务场景与输出格式。

二、RAG的核心原理与完整技术架构拆解

很多人学RAG,只知道简单的「分块→检索→生成」,但想要做出真正好用的RAG系统,必须彻底搞懂它的完整架构与每个环节的核心逻辑。

2.1 RAG的完整工作流

RAG的全流程分为两大核心阶段,离线索引构建阶段和在线问答生成阶段,缺一不可。

简单来说,离线阶段就是给你的专属图书馆「整理藏书、做索引、贴标签」,让后续能快速找到对应的书;在线阶段就是用户提问时,「快速找到相关的书→提取核心内容→交给大模型生成精准回答」。

2.2 核心环节逐一审视:每个环节都决定最终效果

2.2.1 离线索引阶段:RAG效果的地基

离线阶段是RAG系统的地基,这个阶段做不好,后续再怎么优化检索和Prompt都没用。

① 数据采集与文档加载

这是RAG的第一步,核心目标是把你的所有数据源,转换成大模型能处理的文本格式。

- 支持的数据源:TXT、Markdown、PDF、Word、Excel、PPT、图片OCR结果、网页内容、企业内部API数据、数据库内容等;

- 核心工具:LangChain/LLamaIndex提供了上百种文档加载器,覆盖绝大多数数据源,新手可以直接使用;

- 关键注意点:一定要保留文档的元数据(文件名、页码、章节、作者、更新时间等),后续可以用于检索过滤、溯源、权限控制。

② 文档清洗与预处理

原始文档里往往有大量的噪音内容,会严重影响检索效果,必须提前清洗。

- 核心清洗操作:去除页眉页脚、页码、重复内容、无效符号、乱码、超链接、广告内容;

- 结构化处理:把表格、列表、标题层级等结构化信息保留下来,避免把表格拆成零散的文本,丢失语义;

- 中文专属优化:去除多余的空格、换行,统一全角/半角符号,修正OCR识别错误。

③ 文档分块(Chunking):RAG最核心的环节之一

这是决定RAG检索效果最关键的环节,90%的检索效果差的问题,都源于分块不合理。

- 核心原则:一个分块必须是一个完整的语义单元,同时不能超过大模型的上下文窗口限制。分块太大,会引入大量噪音;分块太小,会丢失上下文,语义不完整。

- 主流分块策略与适用场景:

| 分块策略 | 核心原理 | 适用场景 | 优势 | 劣势 |

|---|---|---|---|---|

| 固定大小分块 | 设置固定的字符/token数,配合重叠量避免语义截断 | 通用场景、无结构文档 | 实现简单、速度快、可控性强 | 容易截断语义,不适合结构化文档 |

| 递归字符分块 | 按照「段落→换行→句子→字符」的优先级递归拆分,优先保留语义完整性 | 绝大多数通用文档、Markdown/Word结构化文档 | 语义完整性好,实现简单,LangChain默认方案 | 对格式混乱的文档效果一般 |

| 语义分块 | 基于Embedding相似度,把语义相近的句子合并为一个分块 | 专业文档、论文、法律条文 | 最大化语义完整性,检索准确率高 | 计算成本高,速度慢,需要本地Embedding模型 |

| 文档结构分块 | 基于文档原生结构(标题、章节、页码、表格)拆分 | 格式规范的书籍、报告、产品手册 | 完全保留文档的层级结构,检索精度极高 | 对文档格式要求高,适配成本高 |

- 保姆级参数建议:

- 中文通用场景:

chunk_size=500-800字符,chunk_overlap=chunk_size的10%(比如600字符的块,重叠60字符); - 专业文档(法律/医疗/论文):

chunk_size=300-500字符,保证语义精准; - 长文本对话/聊天记录:

chunk_size=200-300字符,按对话轮次拆分。

- 中文通用场景:

④ 文本向量化(Embedding)

文本向量化,就是把人类能读懂的文本,转换成大模型能处理的高维数值向量。它的核心特性是:语义越相近的文本,向量之间的余弦相似度越高。

- 核心作用:只有把文档块和用户的Query都转换成向量,才能在向量数据库中做相似度检索,找到最相关的内容。

- 保姆级模型选型指南:

- 中文场景优先选择:智源开源的BGE系列(bge-large-zh-v1.5,中文效果顶尖,开源免费)、m3e、gte系列;

- 通用英文场景:OpenAI的text-embedding-3-small/large、Cohere Embed;

- 国内商用API:智谱AI Embedding、通义千问Embedding、百度千帆Embedding;

- 本地部署/低资源场景:BGE-small、m3e-small,CPU即可流畅运行,效果完全满足基础需求。

- 关键注意点:文档块和用户Query,必须使用同一个Embedding模型,否则向量空间不统一,检索结果完全无效。

⑤ 向量数据库存储与索引构建

向量数据库是专门用来存储高维向量、支持快速相似度检索的数据库,是RAG系统的核心存储组件。

- 核心能力:快速的余弦相似度检索、元数据过滤、混合检索、分布式存储、持久化;

- 保姆级选型指南:

- 个人开发/原型验证:Chroma(轻量,本地文件存储,无需部署,Python一键集成)、FAISS(Facebook开源,高性能轻量);

- 中小企业/生产环境:Qdrant、Milvus、Weaviate,开源可本地部署,支持分布式,性能强;

- 企业级/云端托管:Pinecone、Zilliz Cloud、阿里云向量检索服务,开箱即用,免运维,高可用。

2.2.2 在线问答阶段:用户体验的核心

离线阶段打好地基后,在线阶段决定了用户的最终体验,核心目标是:快速、精准地找到最相关的内容,让大模型生成高质量、无幻觉的回答。

① Query预处理与向量化

用户的原始提问往往有很多问题,比如表述不完整、有歧义、有错别字、口语化严重,直接检索会导致效果极差。

- 核心预处理操作:

- 纠错:修正错别字、口语化表述,转换成规范的书面语;

- 补全:多轮对话场景中,补全Query的上下文(比如用户上一轮问了「RAG的优势是什么」,这一轮问「它怎么实现」,需要补全为「RAG技术是怎么实现的」);

- 拆解:把复杂的多跳问题,拆解成多个子问题(比如「XX公司的CEO是谁,他的教育背景是什么」,拆解成两个子问题分别检索)。

- 向量化:使用和离线阶段完全相同的Embedding模型,把预处理后的Query转换成向量。

② 向量数据库粗排检索

这一步的核心目标是:从海量的文档块中,快速召回一批和Query语义相关的候选集,也就是「粗排」。

- 主流检索方式:

- 相似度检索(Top-K):最基础的方式,返回和Query向量余弦相似度最高的前K个文档块;

- MMR最大边际相关性检索:平衡相关性和多样性,避免检索结果高度重复,适合长文本、多主题文档;

- 混合检索(Hybrid Search):结合向量检索(语义匹配)和BM25关键词检索(关键词匹配),兼顾语义和专有名词的匹配,是生产级场景的首选;

- 保姆级参数建议:粗排阶段的

fetch_k设置为20-50,先召回足够多的候选集,交给后续的重排序环节筛选。

③ 检索结果重排序与上下文压缩

粗排召回的候选集里,有很多语义相近但实际不相关的内容,这一步的核心目标是「精排」,只保留最相关的内容,减少上下文噪音。

- 重排序(Rerank):使用专门的交叉编码器模型,给每个候选文档块和Query的相关性打分,重新排序,只保留Top-N个最相关的结果。中文场景首选BGE-Reranker系列模型,效果远超通用方案。

- 上下文压缩:去除文档块里和Query无关的内容,只保留核心的相关片段,进一步减少噪音,节省大模型的上下文窗口。

- 核心价值:重排序是提升RAG效果性价比最高的优化手段,往往能让检索准确率提升30%以上,强烈建议所有生产级RAG系统都加入。

④ Prompt模板拼装

这是连接检索和生成的核心环节,Prompt的好坏,直接决定了大模型会不会出现幻觉,回答质量高不高。

- RAG Prompt的核心设计原则:

- 严格约束大模型的行为:明确要求大模型仅使用提供的上下文内容回答,绝对不能编造信息;

- 兜底规则:如果上下文中没有相关信息,必须明确告知用户,不能瞎编;

- 溯源要求:要求大模型标注回答的引用来源,强制其基于上下文回答;

- 格式约束:明确回答的格式、语气、专业度,适配你的业务场景。

- 标准的RAG Prompt模板会在后续的代码实现中提供,可直接复用。

⑤ 大模型生成与事实校验

最后一步,把拼装好的Prompt交给大模型,生成最终的回答。

- 模型选型建议:

- 通用场景:GPT-3.5-turbo、GLM-4-Flash、通义千问4,成本低,效果好,响应快;

- 专业场景:GPT-4o、GLM-4-Plus、Claude 3,逻辑推理能力强,长文本处理效果好;

- 本地部署/数据安全场景:Llama 3、Qwen 2、GLM-4-9B,开源可本地部署,完全保障数据安全。

- 参数设置:问答场景中,

temperature建议设置为0-0.3,最小化随机性,减少幻觉; - 可选优化:加入事实校验环节,让大模型自己检查生成的回答,是否每一句话都能在上下文中找到对应的依据,进一步消除幻觉。

2.3 RAG技术的三代发展历程

RAG技术从提出到现在,已经经历了三代的演进,从简单的检索增强,发展成了完整的模块化技术体系。

-

第一代:Naive RAG(朴素RAG,2020-2022)

就是上面讲的基础架构,「离线分块→向量化存储→在线检索→Prompt生成」的标准流程,解决了基础的知识注入问题,但是存在检索准确率低、无法处理复杂问题、幻觉抑制效果有限等问题,只能满足简单的问答场景。 -

第二代:Advanced RAG(进阶RAG,2023)

针对Naive RAG的局限性,在全流程做了优化,比如优化分块策略、混合检索、Multi-Query、HyDE、重排序、上下文压缩、事实校验等。现在绝大多数企业落地的RAG系统,都是Advanced RAG的架构,能满足绝大多数生产场景的需求。 -

第三代:Modular RAG(模块化RAG,2024至今)

把RAG的各个环节拆分成独立的模块,大模型可以自主调度这些模块,实现自适应的检索和生成。代表技术有Self-RAG、CRAG、Graph RAG、Agent RAG等,能处理更复杂的多跳推理、多文档融合等问题,是未来RAG技术的核心发展方向。

三、保姆级实战:从零到一搭建完整的RAG系统

接下来,我们用Python+LangChain,搭建一套完整可运行的RAG系统,代码全量开源,带详细注释,新手可以直接复制运行。

3.1 技术栈选型

我们选择最主流、最易上手的技术栈,兼顾新手友好度和生产级可用性:

- 核心框架:LangChain(最成熟的RAG框架,生态完善,文档丰富)

- 大模型:OpenAI GPT-3.5-turbo(同时提供国内大模型/开源模型替换方案)

- Embedding模型:OpenAI text-embedding-3-small(同时提供开源中文BGE模型替换方案)

- 向量数据库:Chroma(轻量本地部署,无需额外服务,一键集成)

- 文档支持:TXT、Markdown、PDF、Word等主流格式

3.2 环境准备

第一步:安装依赖包

打开终端,执行以下命令,安装所有需要的依赖:

# 安装核心依赖

pip install langchain langchain-openai langchain-chroma langchain-community

# 安装文档加载、环境变量相关依赖

pip install pypdf python-dotenv

# 可选:安装开源Embedding、重排序模型依赖

pip install sentence-transformers

# 可选:安装中文分词优化依赖

pip install jieba

第二步:配置环境变量

在项目根目录创建.env文件,把你的API Key配置进去,避免硬编码到代码中,防止密钥泄露:

# OpenAI API配置(如果用国内模型,可注释掉)

OPENAI_API_KEY=你的OpenAI API Key

OPENAI_BASE_URL=https://api.openai.com/v1 # 如有中转地址可替换

# 可选:智谱AI API配置(国内用户首选,无需翻墙)

# ZHIPUAI_API_KEY=你的智谱AI API Key

第三步:准备知识库文档

在项目根目录创建data文件夹,把你想要加载的知识库文档(TXT、PDF、Markdown等)都放进去,代码会自动批量加载。

3.3 完整代码实现

我们把RAG系统拆分为6个核心模块,每个模块都有详细注释,可直接复用。

第一步:导入依赖,加载环境变量

import os

from dotenv import load_dotenv

# 加载环境变量,从.env文件读取API Key

load_dotenv()

# 大模型与Embedding相关

from langchain_openai import ChatOpenAI, OpenAIEmbeddings

# 文档加载相关

from langchain_community.document_loaders import TextLoader, PyPDFLoader, DirectoryLoader

# 文档分块相关

from langchain_text_splitters import RecursiveCharacterTextSplitter

# 向量数据库相关

from langchain_chroma import Chroma

# Prompt与链相关

from langchain_core.prompts import ChatPromptTemplate

from langchain_core.runnables import RunnablePassthrough

from langchain_core.output_parsers import StrOutputParser

第二步:文档加载模块:批量加载知识库文档

支持批量加载data目录下的TXT、PDF、Markdown文档,自动识别格式,无需手动配置。

def load_documents(data_dir: str = "./data"):

"""

批量加载指定目录下的所有文档

:param data_dir: 知识库文档存放的目录

:return: 加载完成的文档列表

"""

# 加载TXT文档

txt_loader = DirectoryLoader(

data_dir,

glob="**/*.txt", # 匹配所有子目录下的txt文件

loader_cls=TextLoader,

loader_kwargs={"encoding": "utf-8"} # 中文编码设置

)

# 加载PDF文档

pdf_loader = DirectoryLoader(

data_dir,

glob="**/*.pdf",

loader_cls=PyPDFLoader

)

# 加载Markdown文档

md_loader = DirectoryLoader(

data_dir,

glob="**/*.md",

loader_cls=TextLoader,

loader_kwargs={"encoding": "utf-8"}

)

# 合并所有加载的文档

documents = []

documents.extend(txt_loader.load())

documents.extend(pdf_loader.load())

documents.extend(md_loader.load())

# 打印加载结果

print(f"✅ 文档加载完成,共加载 {len(documents)} 个文档")

for doc in documents:

print(f" - 来源:{doc.metadata.get('source', '未知文档')}")

return documents

# 执行文档加载

raw_documents = load_documents()

第三步:文档分块模块:递归分块,保证语义完整

使用LangChain推荐的递归字符分块器,优先保证语义完整性,适配中文场景。

def split_documents(documents):

"""

将原始文档拆分为合适大小的语义块

:param documents: 原始文档列表

:return: 拆分后的文档块列表

"""

# 初始化中文场景优化的递归分块器

text_splitter = RecursiveCharacterTextSplitter(

# 每个块的大小,中文场景建议500-800字符

chunk_size=600,

# 块之间的重叠量,避免语义截断,建议为chunk_size的10%

chunk_overlap=60,

# 中文场景的分隔符优先级:先按段落,再按句子,最后按字符

separators=["\n\n", "\n", "。", "!", "?", ",", " ", ""]

)

# 执行文档分块

chunks = text_splitter.split_documents(documents)

# 打印分块结果

print(f"✅ 文档分块完成,共生成 {len(chunks)} 个文档块")

print(f" - 第一个块的长度:{len(chunks[0].page_content)} 字符")

return chunks

# 执行文档分块

document_chunks = split_documents(raw_documents)

第四步:向量数据库构建模块:向量化+持久化存储

把分块后的文档向量化,存入Chroma向量数据库,持久化到本地,后续无需重复构建。

def init_vector_db(chunks, persist_directory: str = "./chroma_db"):

"""

初始化向量数据库,将文档块向量化并持久化存储

:param chunks: 文档块列表

:param persist_directory: 向量数据库本地持久化目录

:return: 初始化完成的向量数据库实例

"""

# 方案1:使用OpenAI的Embedding模型

embeddings = OpenAIEmbeddings(model="text-embedding-3-small")

# 方案2:使用开源中文Embedding模型BGE,无需API Key,本地运行

# from langchain_community.embeddings import HuggingFaceEmbeddings

# embeddings = HuggingFaceEmbeddings(

# model_name="BAAI/bge-large-zh-v1.5",

# model_kwargs={"device": "cpu"}, # 有NVIDIA GPU可改为"cuda"

# encode_kwargs={"normalize_embeddings": True}

# )

# 创建Chroma向量数据库,持久化到本地磁盘

vector_db = Chroma.from_documents(

documents=chunks,

embedding=embeddings,

persist_directory=persist_directory

)

print(f"✅ 向量数据库构建完成,已持久化到 {persist_directory}")

print(f" - 向量数据库中的文档块数量:{vector_db._collection.count()}")

return vector_db

# 执行向量数据库构建

vector_db = init_vector_db(document_chunks)

第五步:检索器构建模块:配置检索策略

构建向量检索器,配置检索参数,平衡召回率和准确率。

def build_retriever(vector_db, top_k: int = 4):

"""

构建向量检索器

:param vector_db: 向量数据库实例

:param top_k: 检索返回的文档块数量

:return: 配置完成的检索器

"""

# 基础方案:相似度检索,适合简单场景

retriever = vector_db.as_retriever(

search_type="similarity",

search_kwargs={"k": top_k}

)

# 进阶方案:MMR最大边际相关性检索,平衡相关性和多样性,避免结果重复

# retriever = vector_db.as_retriever(

# search_type="mmr",

# search_kwargs={"k": top_k, "fetch_k": 20, "lambda_mult": 0.7}

# )

return retriever

# 初始化检索器

retriever = build_retriever(vector_db)

第六步:RAG问答链构建模块:核心Prompt+完整链路

这是RAG系统的核心,配置严格的Prompt模板,构建完整的检索-生成链路。

def build_rag_chain(retriever):

"""

构建完整的RAG问答链

:param retriever: 检索器实例

:return: 可直接调用的RAG问答链

"""

# 初始化大模型

# 方案1:OpenAI GPT-3.5-turbo,通用场景首选

llm = ChatOpenAI(model="gpt-3.5-turbo", temperature=0)

# 方案2:国内大模型-智谱AI GLM-4,国内用户首选,无需翻墙

# from langchain_community.chat_models import ChatZhipuAI

# llm = ChatZhipuAI(

# model="glm-4-flash",

# temperature=0,

# api_key=os.getenv("ZHIPUAI_API_KEY")

# )

# RAG核心Prompt模板,严格约束大模型行为,从根源减少幻觉

prompt_template = """

你是一个专业、严谨、负责任的智能问答助手,必须严格遵守以下规则回答用户的问题:

1. 仅使用下方提供的【上下文内容】中的信息进行回答,绝对不可以编造、杜撰上下文中没有的信息,不可以使用你的预训练知识。

2. 如果【上下文内容】中没有与问题相关的信息,或者无法从上下文中得到准确答案,请直接回答:"抱歉,我无法基于提供的知识库内容回答这个问题,请您补充相关文档后再尝试。",绝对不可以编造答案。

3. 回答要条理清晰、逻辑通顺,专业内容要准确无误,优先使用上下文中的原文表述,避免二次加工带来的错误。

4. 回答完成后,必须在末尾标注答案引用的文档来源,格式为:【引用来源:文件名 第X页】,方便用户溯源校验。

【上下文内容】:

{context}

【用户的问题】:

{question}

"""

# 构建Prompt实例

prompt = ChatPromptTemplate.from_template(prompt_template)

# 文档格式化函数:把检索到的文档块拼接成规范的上下文

def format_docs(docs):

context = ""

for idx, doc in enumerate(docs):

context += f"【文档{idx+1}】\n"

context += f"来源:{doc.metadata.get('source', '未知文档')} 第{doc.metadata.get('page', '未知')}页\n"

context += f"内容:{doc.page_content}\n\n"

return context

# 构建完整的RAG链:检索→格式化上下文→Prompt→大模型→输出解析

rag_chain = (

# 并行执行:检索上下文 + 透传用户问题

{"context": retriever | format_docs, "question": RunnablePassthrough()}

| prompt # 拼装Prompt

| llm # 大模型生成

| StrOutputParser() # 解析输出为字符串

)

return rag_chain

# 构建完整的RAG问答链

rag_chain = build_rag_chain(retriever)

第七步:测试RAG系统,对比效果

编写测试代码,验证RAG系统的效果,对比直接调用大模型的差异。

if __name__ == "__main__":

# 测试问题:替换为你的知识库相关的问题

test_question = "请介绍一下RAG技术的核心优势是什么?"

print("="*60)

print(f"📝 用户问题:{test_question}")

print("="*60)

# 调用RAG链获取回答

print("🤖 RAG系统回答结果:")

rag_answer = rag_chain.invoke(test_question)

print(rag_answer)

print("="*60)

# 对比:直接调用大模型的回答

print("📊 直接调用大模型的回答结果:")

direct_llm = ChatOpenAI(model="gpt-3.5-turbo", temperature=0)

direct_answer = direct_llm.invoke(test_question).content

print(direct_answer)

额外工具:加载已持久化的向量数据库

后续使用时,无需重新处理文档,直接加载已构建好的向量数据库即可:

def load_exist_vector_db(persist_directory: str = "./chroma_db"):

"""

加载已持久化到本地的向量数据库

:param persist_directory: 向量数据库持久化目录

:return: 向量数据库实例

"""

# 必须使用和构建时完全相同的Embedding模型

embeddings = OpenAIEmbeddings(model="text-embedding-3-small")

# 加载本地向量数据库

vector_db = Chroma(

persist_directory=persist_directory,

embedding_function=embeddings

)

print(f"✅ 成功加载已存在的向量数据库")

print(f" - 文档块数量:{vector_db._collection.count()}")

return vector_db

# 调用示例

# vector_db = load_exist_vector_db()

# retriever = build_retriever(vector_db)

# rag_chain = build_rag_chain(retriever)

3.4 进阶优化:生产级RAG的核心优化代码

上面的基础版已经能满足绝大多数场景的需求,想要进一步提升效果,可以加入以下生产级优化方案。

优化1:加入重排序(Rerank),大幅提升检索精度

重排序是提升RAG效果性价比最高的手段,中文场景首选BGE-Reranker模型。

# 导入重排序相关模块

from langchain.retrievers import ContextualCompressionRetriever

from langchain_community.document_compressors import BGERerank

# 初始化BGE中文重排序模型

compressor = BGERerank(

model_name="BAAI/bge-reranker-large",

top_n=3, # 重排序后只保留最相关的3个结果

device="cpu" # 有GPU可改为"cuda"

)

# 构建带重排序的压缩检索器

compression_retriever = ContextualCompressionRetriever(

base_compressor=compressor,

base_retriever=retriever

)

# 用带重排序的检索器重构RAG链

rag_chain_rerank = build_rag_chain(compression_retriever)

# 测试效果

# rag_chain_rerank.invoke("你的问题")

优化2:Multi-Query多查询检索,解决用户Query表述不清的问题

用户的提问往往表述不完整、有歧义,Multi-Query会用大模型生成多个不同角度的查询语句,分别检索,大幅提升召回率。

# 导入多查询检索模块

from langchain.retrievers.multi_query import MultiQueryRetriever

# 初始化大模型,用于生成多查询

llm_for_query = ChatOpenAI(model="gpt-3.5-turbo", temperature=0)

# 构建多查询检索器

multi_query_retriever = MultiQueryRetriever.from_llm(

retriever=retriever,

llm=llm_for_query,

include_original=True # 保留用户的原始查询

)

# 用多查询检索器重构RAG链

rag_chain_multi_query = build_rag_chain(multi_query_retriever)

# 测试效果

# rag_chain_multi_query.invoke("你的问题")

四、RAG落地常见踩坑指南:90%的开发者都遇到过

我总结了上百个RAG项目落地的常见坑,以及对应的解决方案,帮你少走90%的弯路。

坑1:文档分块不合理,检索效果极差

现象:用户的问题明明文档里有,但是检索不到,或者检索出来的内容完全不相关。

核心原因:chunk_size设置不合理,要么太大引入太多噪音,要么太小丢失语义,没有设置重叠量导致关键内容被截断。

解决方案:

- 严格按照前文的参数建议设置chunk_size和overlap,中文场景绝对不要超过1000字符;

- 分块后一定要人工抽检5-10个块,确保每个块都是一个完整的语义单元;

- 格式规范的文档,优先使用基于结构的分块,保留章节信息。

坑2:Embedding模型和场景不匹配,检索准确率低

现象:用英文Embedding模型处理中文文档,或者用通用模型处理垂直领域文档,导致语义匹配错误。

解决方案:

- 中文场景必须使用中文原生的Embedding模型,绝对不要用纯英文模型;

- 垂直领域(法律/医疗/金融),优先使用领域微调后的Embedding模型;

- 有条件的话,用自己的业务数据做小样本微调,效果会有质的提升。

坑3:Prompt约束不到位,幻觉问题依然严重

现象:明明加了RAG,大模型还是会编造上下文中没有的信息。

核心原因:Prompt没有严格约束大模型的行为,temperature设置太高,没有强制溯源。

解决方案:

- 严格使用本文提供的Prompt模板,明确禁止编造信息,设置兜底规则;

- 问答场景temperature必须设置为0-0.3,最小化随机性;

- 强制要求大模型标注引用来源,从根源上约束其行为;

- 加入事实校验环节,让大模型自己检查回答是否都来自上下文。

坑4:只使用向量检索,忽略关键词匹配

现象:用户用产品型号、专业术语、人名等专有名词提问,明明文档里有,但是检索不到。

核心原因:向量检索是语义匹配,对于专有名词的精准匹配能力,远不如传统的关键词检索。

解决方案:

- 生产级场景必须使用混合检索,结合向量检索和BM25关键词检索;

- Milvus、Qdrant、Elasticsearch等都原生支持混合检索,可直接使用。

坑5:检索的Top-K设置不合理,上下文溢出或信息不足

现象:要么回答不完整,关键信息缺失;要么提示词太长,超过大模型的上下文窗口,报错。

解决方案:

- 基础场景Top-K设置为3-5,复杂场景配合重排序,粗排fetch_k=20,精排保留3-5个;

- 严格控制上下文总长度,不要超过大模型上下文窗口的30%,预留足够的生成空间;

- 加入上下文压缩,只保留和问题相关的核心内容。

五、RAG的行业落地场景与未来发展趋势

5.1 RAG的主流落地场景

RAG技术已经在各行各业得到了广泛应用,是当前大模型落地最成熟的方案:

- 企业内部知识库与智能客服:最主流的场景,把企业的产品手册、规章制度、培训资料、历史工单做成RAG,智能客服可以7×24小时精准回答员工和客户的问题,减少80%以上的人工成本。

- 法律与金融合规问答:把法律条文、司法解释、监管政策、合同范本做成RAG,辅助律师、金融从业者快速检索相关内容,生成合规的文书,规避合规风险。

- 医疗健康辅助:把医学指南、药品说明书、临床路径做成RAG,辅助医生快速查阅资料,给患者提供精准的健康咨询(医疗场景需严格合规,仅用于辅助,不能替代执业医师)。

- 教育与个性化学习:把教材、课件、题库做成RAG,打造个性化的学习助手,给学生答疑解惑,生成定制化的学习计划和习题。

- 个人知识管理:把个人的笔记、书籍、文章、邮件做成RAG,打造专属的第二大脑,快速检索自己的知识,生成内容,提升效率。

5.2 RAG的未来发展趋势

- 与Agent深度融合:RAG是智能体(Agent)的核心记忆模块,未来的智能体都会基于RAG来获取外部知识,实现更复杂的任务,比如自动化办公、业务流程自动化。

- 多模态RAG:从纯文本RAG,扩展到支持图片、音频、视频、3D模型的多模态RAG,比如检索PPT里的图表、视频里的语音内容、设计图纸里的信息。

- Graph RAG:把文档里的实体和关系提取出来,构建知识图谱,结合知识图谱和向量检索,解决复杂的多跳推理问题,是当前RAG领域最热门的研究方向。

- Self-RAG与自适应RAG:大模型自己判断什么时候需要检索、检索什么内容,自己校验回答的准确性,实现端到端的自适应优化,大幅减少人工调优的成本。

- 端侧轻量化RAG:把Embedding模型、向量检索、小参数大模型都部署在端侧(手机、电脑、边缘设备),实现完全本地化的RAG,无需联网,彻底保障数据安全。

六、写在最后

RAG技术之所以能成为大模型应用落地的第一选择,核心在于它用极低的成本,解决了大模型最核心的痛点:幻觉、知识更新、数据安全。它不需要你有海量的算力,不需要你懂复杂的大模型训练,哪怕是个人开发者,也能跟着这篇教程,用几十行代码,搭建一个属于自己的RAG系统。

当然,RAG不是银弹,它是一个系统工程,从文档处理、分块、Embedding、检索、Prompt到生成,每一个环节都需要优化,才能从「能用」变成「好用」。这篇教程给你搭建了完整的框架,而真正的效果提升,需要你结合自己的业务场景,不断地调优和迭代。

互动环节

欢迎大家在评论区留言,分享你在RAG落地过程中遇到的问题,或者你想要了解的进阶内容(比如Graph RAG、多模态RAG、本地全流程部署、企业级RAG架构设计等),我会一一回复,和大家一起交流学习。

如果本文对你有帮助,欢迎点赞、收藏、转发,让更多的开发者少走弯路。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)