年薪百万AI科学家养成计划:顶级实验室生存手册

当测试思维遇见AI科学

在AI浪潮席卷全球技术领域的今天,一个深刻的变化正在发生:软件质量保障的边界正在被重新定义。曾经专注于发现缺陷、验证功能的测试工程师,正站在一个前所未有的职业跃迁窗口前。那些能够将严谨的测试思维、系统化的验证方法论与前沿人工智能技术深度融合的从业者,正在成为顶尖AI实验室竞相争夺的“独角兽”人才。这不再是一个遥远的愿景,而是一条清晰可见、充满挑战与机遇的进化路径。

第一部分:重塑认知——测试经验是AI科研的“超能力”

许多测试从业者对转型AI存在认知误区,认为自己的经验仅限于“点点点”或脚本维护。事实上,一套成熟的测试思维体系,正是攻克AI系统不确定性这一核心难题的宝贵资产。

1. 系统化思维与实验设计测试工程师擅长设计覆盖各种场景的用例,以穷尽系统可能的行为。这种能力直接对应AI科研中的实验设计。在机器学习领域,每一个模型训练都是一次复杂的实验:需要控制变量(如超参数、数据分布)、设计评估指标(替代传统测试的通过/失败标准)、并规划消融实验以验证每个模块的有效性。测试人员对“边界条件”和“异常路径”的敏感度,能帮助AI科学家设计出更鲁棒、更能发现模型脆弱性的评估方案,避免论文中漂亮但脆弱的“实验室精度”。

2. 对数据质量的极致苛求测试工作的核心之一是数据验证——输入是否合规,输出是否准确。在AI时代,数据是模型的“燃料”,其质量直接决定天花板。测试工程师对数据一致性、完整性、代表性的深刻理解,使其在数据清洗、标注质量评估、偏见检测等关键环节具有天然优势。例如,将测试中的等价类划分思想应用于训练数据采样,能有效提升数据集的代表性和训练效率。

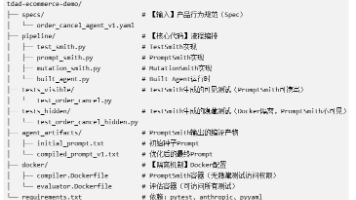

3. 自动化与工程化能力现代测试早已离不开自动化框架和持续集成。这份构建可靠、可重复流水线的经验,是AI模型从研究走向生产(MLOps)的核心。AI模型的训练、评估、部署同样需要高度工程化。测试人员熟悉的版本控制、环境隔离、流水线编排(如Jenkins, GitLab CI)技能,可以无缝迁移到管理复杂的模型训练流水线、实验追踪(如MLflow)和自动化部署中,确保研究可复现、过程可追溯。

第二部分:生存地图——顶级实验室的四大核心挑战与破解之道

进入顶级AI实验室(无论是高校研究院如FAIR、DeepMind,还是企业实验室如Google Brain、微软研究院),意味着进入一个高强度、快节奏、精英云集的环境。测试背景的工程师需有策略地跨越以下生存关卡。

挑战一:从“验证者”到“构建者”的身份转变在传统研发流程中,测试位于下游,职责是验证他人构建的系统。而在AI实验室,你需要直接参与甚至主导模型的构建。这要求思维从“找错”转向“创优”。

-

破解策略:主动参与研究讨论的早期阶段。不要等到模型训练完才介入评估,而应在问题定义、数据策略讨论时就提出基于测试经验的见解:例如,“这个任务定义是否存在歧义,可能导致模型学习到错误的特征?”“我们准备的数据集,是否涵盖了目标场景中所有关键的边缘情况?” 将自己的角色重新定位为“质量架构师”,从源头塑造研究的严谨性。

挑战二:掌握AI核心技术栈的深度与广度仅会调用几个深度学习API远远不够。需要建立坚实的数理基础(线性代数、概率论、优化理论)和对主流模型架构(Transformer, CNN, GAN等)的深刻理解。同时,工程上要精通PyTorch/TensorFlow、分布式训练、GPU优化等。

-

破解策略:制定体系化学习路径,结合项目驱动。例如,可以从一个具体的实验室项目出发,比如一个视觉缺陷检测模型。为了提升其性能,你需要深入理解卷积神经网络的底层原理、数据增强策略、损失函数设计,并动手优化训练脚本。利用测试人员擅长的“分解”能力,将庞大的AI知识体系拆解为可验证、可实践的小模块,逐个攻克。积极参与代码审查和模型复现工作,这是快速学习内部技术的最佳途径。

挑战三:在“发表导向”的研究文化中体现价值学术界和顶级工业实验室往往有强烈的论文发表压力。纯工程或质量保障工作可能被视为“支持性”而非“创新性”。

-

破解策略:将质量工作“研究化”。不要只报告模型的准确率下降了,而要深入研究下降的原因——是数据漂移?是过拟合?还是对抗性样本?利用你的分析能力,将问题转化为一个可研究的小课题,例如“设计一种新的测试集来评估模型在对抗扰动下的鲁棒性”,并尝试提出量化的评估指标或改进方法。这样产出的不仅是测试报告,更是可能构成论文实验部分或独立短文的创新内容。你的工作就从成本中心变成了价值创造点。

挑战四:跨领域沟通与影响力建设你需要与专注于理论算法的研究员、专注于系统实现的工程师、以及可能完全不懂技术的领域专家(如生物学家、金融分析师)协作。

-

破解策略:发挥测试人员作为“用户代言人”和“系统解释者”的桥梁作用。用清晰的逻辑、可视化的结果(如混淆矩阵、特征可视化图)和扎实的数据,向研究员解释模型在真实场景中可能失败的模式;同时,用非技术语言向领域专家说明AI模型的局限性和可靠性边界。建立个人技术品牌,定期在组内分享关于模型评估、测试工具或工程最佳实践的经验,逐渐成为团队在“AI系统可靠性”问题上的权威。

第三部分:养成路径——从入门到主导的四阶跃迁

基于软件测试的起点,规划一条循序渐进的进化路线。

阶段一:AI赋能的质量工程师(0-1年)

-

目标:将AI工具引入现有测试工作,证明价值。

-

行动:在团队内推动试点项目。例如,利用开源模型或API,开发智能测试用例生成工具,根据代码变更和历史缺陷数据推荐高风险的测试路径;或构建一个简单的缺陷日志自动分类与归因模型,减少人工分析时间。用数据说话(如“自动化生成覆盖了80%的核心场景,设计时间减少70%”),赢得初步信任和资源。

阶段二:AI系统测试专家(1-3年)

-

目标:深入AI系统内部,专精于模型评估与验证。

-

行动:系统学习机器学习模型测试专项技能。包括但不限于:对抗性测试、公平性/偏见检测、可解释性评估、模型健壮性测试(针对噪声、失真等)、持续监控模型性能衰减(概念漂移)。你可以主导建立实验室的模型测试基准和自动化评估流水线,成为确保模型出厂质量的“守门人”。此时,你的薪资将开始显著拉开与传统测试的差距。

阶段三:AI研发工程师/应用科学家(3-5年)

-

目标:从测试模型转向参与构建更可靠的模型。

-

行动:你的核心职责不再仅是事后评估,而是将可靠性、鲁棒性等“质量属性”内建于模型设计阶段。例如,参与研究新的训练算法以提高模型对抗攻击的免疫力,或设计新的网络架构使其决策过程更透明、更易于验证。你需要具备扎实的算法实现和模型调优能力。你的测试背景让你在思考“这个模型可能会怎样失败”时独具慧眼,从而设计出天生更强的模型。

阶段四:AI质量架构师/首席科学家(5年以上)

-

目标:制定战略,领导方向,跨界创新。

-

行动:站在更高层面,为整个实验室或产品线的AI系统质量负责。你需要规划长期的技术路线图,例如如何将形式化验证思想引入神经网络的保障中,或如何构建面向自动驾驶等安全关键领域的全生命周期质量保障体系。你需要跨界融合知识,可能涉及AI伦理、政策法规、硬件协同等。此时,深度技术能力、宏观视野、领导力和影响力共同作用,年薪百万乃至更高已成为水到渠成的结果。

结语:以测试之严谨,铸AI之可靠

从软件测试到AI科学家的旅程,并非抛弃过去,而是将过往沉淀的宝贵思维模式——对细节的洞察、对逻辑的执着、对风险的敬畏、对系统全面的理解——在人工智能这个更宏大、更复杂的舞台上进行升华和重铸。顶级实验室是残酷的竞技场,也是最好的锻造炉。对于那些敢于走出舒适区,将“保障质量”的使命从软件代码延伸到智能模型的测试从业者而言,这条道路虽然充满挑战,但回报也无比丰厚:不仅是物质上的,更是参与塑造未来智能世界核心规则的成就感与影响力。现在,是时候将你的测试用例,改写为AI时代的科学发现了。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献49条内容

已为社区贡献49条内容

所有评论(0)