GPT-5.4 进阶思考模式全面解析:从推理等级到实战提示词,代码、论文、数据处理一站通

摘要:2026年3月5日,OpenAI正式发布GPT-5.4系列模型,其中最受瞩目的便是全新的进阶思考模式(Extended Thinking Mode)。该模式在原有推理模型的基础上,引入了五档可配置推理力度(none / low / medium / high / xhigh),让开发者与研究人员能够根据任务复杂度精准调控模型的"思考深度"。本文将从进阶思考与普通思考的核心区别出发,结合代码修改、论文撰写、实验数据处理三大典型场景,提供可直接复用的提示词模板与API调用示例,帮助读者快速上手GPT-5.4的进阶推理能力。

⚠️ 特别提醒:翻墙(使用VPN等工具绕过国家网络防火墙访问境外网站)属于违法行为,违反《中华人民共和国计算机信息网络国际联网管理暂行规定》等相关法律法规,可能面临行政处罚甚至刑事责任。国内镜像站是合法合规的使用途径,无需翻墙即可正常访问和使用GPT-5.4等最新模型,安全、稳定、高效。强烈建议大家通过正规渠道使用AI服务,切勿因小失大。由于国内无法直接访问OpenAI官网,推荐使用国内合规镜像站注册使用GPT-5.4最新模型。注册入口:AIGCBAR镜像站。如需调用API接口进行开发,请通过API独立站注册获取API Key。

1 GPT-5.4 进阶思考模式概述

1.1 什么是进阶思考模式?

GPT-5.4 Thinking是OpenAI于2026年3月5日发布的旗舰推理模型,直接取代了此前的GPT-5.2 Thinking,面向ChatGPT Plus、Team和Pro用户全面开放。与传统的"即时响应"模型不同,GPT-5.4 Thinking的核心设计理念是**“先规划,再执行”——在处理复杂查询时,模型会先生成一份前端思考计划(Upfront Plan),向用户展示其推理路径,并允许用户在生成过程中进行中途干预和方向调整。这种被称为"可操控性(Steerability)"**的特性,使得AI不再是黑箱,而是变成了一个可以实时协作的智能伙伴。

进阶思考模式(Extended Thinking)是GPT-5.4 Thinking中最具突破性的功能。它指示模型在给出最终答案之前,花费显著更多的时间进行规划、验证和多步推理。如果说普通思考模式(Standard Thinking)是"快速而准确地回答问题",那么进阶思考模式就是"深思熟虑后再给出最优解"。这种模式特别适合那些需要最大精度、多步骤逻辑链、深度分析的专业场景,例如复杂的算法设计、学术论文的严谨论证、大规模实验数据的统计推断等。

从技术实现角度看,进阶思考模式通过调整reasoning_effort参数来实现。当该参数设置为high或xhigh时,模型会生成更多的推理Token(Reasoning Tokens),这些Token虽然不会直接展示给用户,但它们代表了模型在"内部思考"过程中消耗的计算资源。推理Token按输出Token费率计费,因此更高的推理力度意味着更精确的结果,同时也意味着更高的成本和更长的响应时间。

1.2 GPT-5.4 的三大版本

GPT-5.4系列共包含三个版本,各自面向不同的使用场景和用户需求:

| 版本名称 | 模型ID | 核心定位 | 推理力度支持 | 适用场景 |

|---|---|---|---|---|

| GPT-5.4 | gpt-5.4 |

通用旗舰模型 | none | 日常对话、内容生成、快速问答 |

| GPT-5.4 Thinking | gpt-5.4-thinking |

推理增强模型 | none / low / medium / high / xhigh | 复杂推理、深度分析、专业工作 |

| GPT-5.4 Pro | gpt-5.4-pro |

顶级专业模型 | none / low / medium / high / xhigh | 最复杂的专业任务、Agent开发 |

其中,GPT-5.4 Thinking是大多数专业用户的首选,它在推理能力和成本之间取得了最佳平衡。而GPT-5.4 Pro则面向需要极致性能的企业级用户,在编程、数学推理、文档处理等方面表现更为出色,但API调用成本也更高。

1.3 发布背景与核心升级

GPT-5.4的发布标志着OpenAI在推理模型领域的又一次重大跃迁。相比前代GPT-5.2 Thinking,GPT-5.4 Thinking在多个关键基准上实现了显著提升:

| 基准测试 | GPT-5.4 Thinking | GPT-5.2 Thinking | 提升幅度 |

|---|---|---|---|

| GDPval(知识工作) | 83.0% | 70.9% | +12.1% |

| BrowseComp(网络搜索) | 82.7% | 65.8% | +16.9% |

| 事实准确性 | 虚假声明减少33% | 基线水平 | 大幅降低幻觉 |

| Token效率 | 显著减少推理Token消耗 | 基线水平 | 更快、更低成本 |

除了基准测试的提升,GPT-5.4 Thinking还引入了以下核心升级:

- 可操控性(Steerability):模型在处理复杂查询时会先展示推理计划,用户可中途调整方向,无需多轮对话纠偏。

- 深度网络研究(Deep Web Research):针对"大海捞针"式的信息检索任务进行了专项优化,能够跨多轮搜索持续追踪,显著提升长程任务的上下文保持能力。

- 思维链透明性(CoT Monitorability):OpenAI引入了CoT可控性评估,测试表明GPT-5.4 Thinking刻意隐藏推理过程的能力极低,这意味着模型的推理过程对安全系统完全透明,降低了被绕过的风险。

- 原生电脑操控(Computer Use):支持直接操控计算机界面,在SWE-bench等基准测试中达到75%的通过率。

2 进阶思考 vs 普通思考:核心区别详解

2.1 五档推理力度一览

GPT-5.4 Thinking最核心的创新之一,就是将推理力度细分为五个离散等级,让用户可以像调节音量旋钮一样精确控制模型的"思考深度"。这五个等级分别是:none、low、medium、high和xhigh。

| 推理等级 | reasoning_effort值 | 思考深度 | 响应速度 | Token消耗 | 典型适用场景 |

|---|---|---|---|---|---|

| 无推理 | none |

无内部推理 | 最快 | 最低 | 简单翻译、格式转换、模板填充 |

| 轻度推理 | low |

基础逻辑分析 | 快 | 低 | 文本摘要、简单问答、数据提取 |

| 中度推理 | medium |

均衡推理 | 中等 | 中等 | 内容生成、标准编程、常规分析 |

| 深度推理 | high |

深度多步推理 | 较慢 | 较高 | 复杂逻辑、架构设计、论文论证 |

| 极限推理 | xhigh |

最大深度推理 | 最慢 | 最高 | 极端复杂任务、 exhaustive研究、精密数学证明 |

普通思考模式通常对应low到medium等级,适用于日常知识工作和一般性编程任务。而进阶思考模式则对应high和xhigh等级,专为那些需要极致精度的专业场景设计。

2.2 普通思考模式(Standard Thinking)详解

普通思考模式是GPT-5.4 Thinking的默认工作状态,追求的是思考深度与响应速度之间的最佳平衡。在这种模式下,模型会进行适度的内部推理,但不会过度"纠结"于每一个细节。它的核心特征包括:

响应速度优先:普通思考模式下,模型通常在几秒到十几秒内给出响应,适合需要快速迭代的日常工作流。例如,当你需要快速生成一段代码、获取一个概念的解释、或者对一篇文章进行初步润色时,普通思考模式就能很好地完成任务。

适度推理深度:模型会进行基本的逻辑分析和事实核查,但对于特别复杂的多步推理问题,可能不会穷尽所有可能性。例如,在处理一个中等复杂度的编程Bug时,普通思考模式能够快速定位常见问题并给出修复建议,但可能不会深入分析底层架构层面的根因。

成本可控:由于推理Token消耗较少,普通思考模式的API调用成本相对较低。对于需要大量调用API的批量处理任务(如批量文本分类、大规模数据清洗等),普通思考模式是更经济的选择。

典型适用场景:

- 日常知识问答和概念解释

- 快速代码补全和简单Bug修复

- 文本摘要和格式转换

- 常规数据分析和可视化建议

- 邮件撰写和文档编辑

2.3 进阶思考模式(Extended Thinking)详解

进阶思考模式是GPT-5.4 Thinking的"火力全开"状态,对应high和xhigh两个推理等级。在这种模式下,模型会投入显著更多的计算资源进行深度推理,其核心特征包括:

深度规划与验证:模型会在给出最终答案之前,生成详细的推理计划,并对每一步进行交叉验证。例如,在处理一个复杂的算法设计问题时,进阶思考模式会先分析问题约束,再评估多种可能的解决方案,接着比较各方案的优劣,最后选择最优方案并给出完整实现。

多步逻辑链推理:对于需要多步推理的复杂问题,进阶思考模式能够维护长程的逻辑一致性。例如,在数学证明中,模型能够从公理出发,经过多步推导,最终得出严谨的结论,每一步都经过验证。

中途可干预:这是进阶思考模式最独特的特性。模型在思考过程中会展示其推理计划,用户可以在任何时候中断并调整方向。例如,当模型正在分析一个数据集时,用户可以中途要求它换一种统计方法,模型会立即调整推理路径,而不会浪费之前的上下文。

成本与时间权衡:进阶思考模式会生成大量的推理Token,导致响应时间显著延长(可能需要数十秒到数分钟)和API成本大幅增加。因此,它应该被谨慎使用,仅在真正需要极致精度的场景下启用。

典型适用场景:

- 复杂系统架构设计和算法优化

- 学术论文的深度论证和逻辑审查

- 大规模实验数据的统计分析和假设检验

- 数学证明和形式化验证

- 多步骤的复杂工作流自动化

2.4 普通思考 vs 进阶思考对比总结

| 对比维度 | 普通思考(low/medium) | 进阶思考(high/xhigh) |

|---|---|---|

| 推理深度 | 适度,覆盖常见场景 | 极深,穷尽多种可能性 |

| 响应时间 | 5-15秒 | 30秒-数分钟 |

| 推理Token | 较少 | 大量(可能数倍于输出Token) |

| API成本 | 较低 | 较高(xhigh可能比medium贵5-10倍) |

| 准确性 | 高(日常任务) | 极高(复杂任务) |

| 幻觉率 | 低 | 极低 |

| 可操控性 | 有限 | 完全可中途干预 |

| 适用任务 | 日常知识工作 | 专业级复杂任务 |

| 推荐用户 | 所有用户 | 研究人员、高级开发者、专业分析师 |

3 API调用与参数配置

3.1 reasoning_effort 参数详解

在GPT-5.4的API中,reasoning_effort是控制推理深度的核心参数。该参数仅对GPT-5.4 Thinking和GPT-5.4 Pro模型生效,对标准版GPT-5.4无效。以下是各参数值的详细说明:

none:完全禁用推理过程,模型直接生成响应,不进行任何内部思考。适用于纯文本生成任务,如翻译、格式化等。响应最快,成本最低。low:启用最小化推理,模型会进行基本的逻辑检查但不会深入分析。适用于简单问答、文本摘要、数据提取等任务。medium:均衡推理模式,是大多数通用场景的推荐选择。模型会进行适度的多步推理,在质量和速度之间取得平衡。适用于内容生成、标准编程、常规分析等。high:深度推理模式,模型会投入大量计算资源进行多步推理和交叉验证。适用于复杂的编程任务、论文论证、数据分析等需要高精度的场景。xhigh:极限推理模式,模型的"最强思考"状态。会穷尽所有可能的推理路径,进行最全面的验证。适用于极端复杂的任务,如数学证明、大规模系统设计等。响应时间最长,成本最高。

3.2 API调用代码示例

以下是通过OpenAI API调用GPT-5.4 Thinking并设置不同推理等级的完整代码示例:

from openai import OpenAI

client = OpenAI(api_key="your-api-key", base_url="https://api.aigc.bar/v1")

# ===== 示例1:使用 high 推理等级进行复杂代码审查 =====

response = client.chat.completions.create(

model="gpt-5.4-thinking",

messages=[

{"role": "system", "content": "你是一位资深软件架构师,擅长代码审查和性能优化。"},

{"role": "user", "content": "请审查以下Python代码的性能瓶颈,并给出优化方案:\n\ndef process_data(items):\n result = []\n for item in items:\n if item['status'] == 'active':\n for sub in item['subitems']:\n if sub['score'] > 50:\n result.append(sub['name'])\n return result"}

],

reasoning_effort="high" # 进阶思考模式

)

print("思考过程:", response.choices[0].message.reasoning_content)

print("最终回答:", response.choices[0].message.content)

# ===== 示例2:使用 xhigh 推理等级进行学术论文深度分析 =====

response = client.chat.completions.create(

model="gpt-5.4-thinking",

messages=[

{"role": "system", "content": "你是一位人工智能领域的学术专家,精通论文写作和学术规范。"},

{"role": "user", "content": "请对以下论文摘要进行深度评审,指出逻辑漏洞、方法论缺陷,并给出改进建议:\n\n[在此粘贴论文摘要]"}

],

reasoning_effort="xhigh" # 极限推理模式

)

print("最终回答:", response.choices[0].message.content)

# ===== 示例3:使用 medium 推理等级进行常规数据处理 =====

response = client.chat.completions.create(

model="gpt-5.4-thinking",

messages=[

{"role": "system", "content": "你是一位数据分析师,擅长使用Python进行数据处理和统计分析。"},

{"role": "user", "content": "我有一份CSV格式的实验数据,包含温度、压力、反应时间、产率四列数据。请帮我编写数据清洗和描述性统计分析的Python代码。"}

],

reasoning_effort="medium" # 中度推理,适合常规任务

)

print("最终回答:", response.choices[0].message.content)

3.3 API定价参考

GPT-5.4 Thinking的API定价与推理力度直接相关。更高的推理等级会生成更多的推理Token,从而增加成本。以下是定价详情:

| 定价项 | 标准上下文(≤272K Token) | 扩展上下文(>272K Token) |

|---|---|---|

| 输入Token | $2.50 / 百万Token | $5.00 / 百万Token |

| 输出Token | $15.00 / 百万Token | $22.50 / 百万Token |

| 推理Token | 按输出Token费率计费 | 按输出Token费率计费 |

💡 成本优化建议:对于日常任务使用

medium等级即可满足需求,仅在真正需要深度推理的复杂任务上使用high或xhigh。一个xhigh请求的推理Token消耗可能是medium的5-10倍,请根据实际需求合理选择。

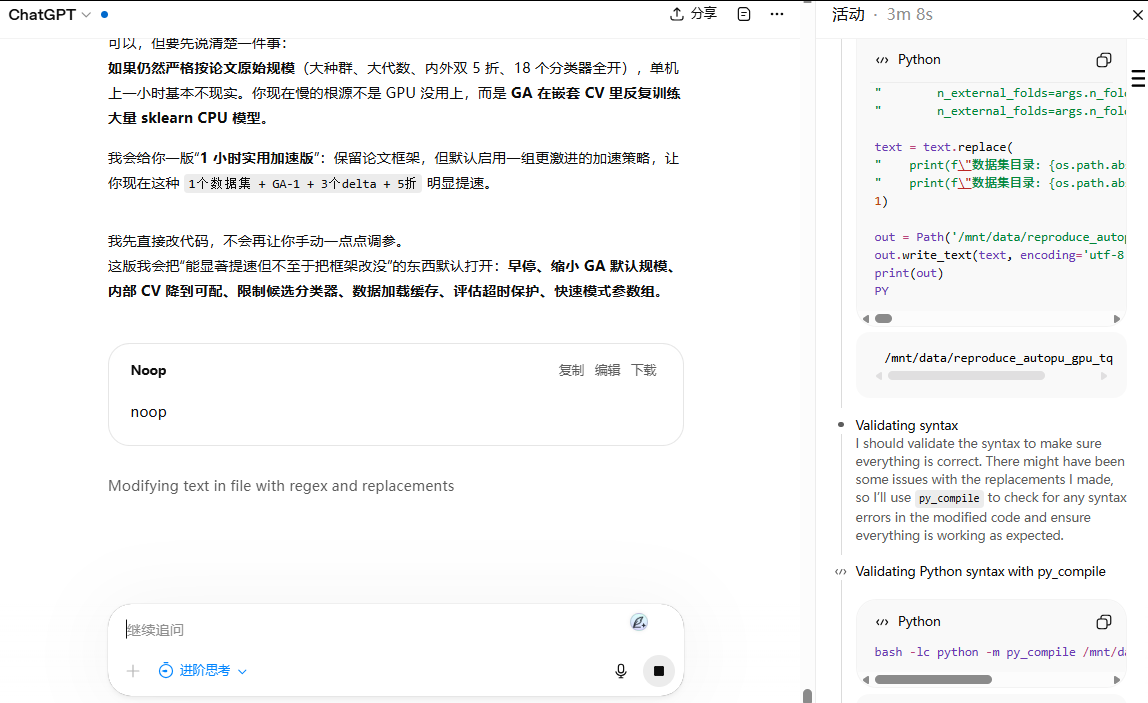

4 进阶思考模式实战:代码修改

4.1 为什么代码修改需要进阶思考?

代码修改看似简单,实则是一项高度复杂的认知任务。一个优秀的代码审查不仅需要理解代码的字面含义,还需要分析其上下文依赖、性能特征、安全风险、可维护性等多个维度。普通思考模式在处理简单的语法错误或格式问题时表现良好,但当面对以下复杂场景时,进阶思考模式的优势就凸显出来了:

- 性能优化:需要分析算法时间复杂度、内存使用模式、I/O瓶颈等多个因素,并在多种优化方案之间进行权衡。

- 架构重构:需要理解系统的整体架构,评估重构的影响范围,确保不引入新的Bug。

- 安全漏洞修复:需要深入理解安全原理,分析攻击向量,确保修复方案不会引入新的安全风险。

- 并发问题调试:需要分析竞态条件、死锁、内存可见性等复杂的并发问题。

4.2 代码审查与优化提示词模板

以下提示词模板专为进阶思考模式设计,利用high或xhigh推理等级来获得最深度的代码分析:

你是一位拥有15年经验的资深软件架构师,精通系统设计、性能优化和安全审计。

请对以下代码进行全面深度审查,按以下维度逐一分析:

1. **性能分析**:评估时间复杂度和空间复杂度,识别性能瓶颈,提出至少3种优化方案并比较优劣。

2. **安全审计**:检查是否存在SQL注入、XSS、CSRF等安全漏洞,评估输入验证的完备性。

3. **可维护性**:评估代码的可读性、模块化程度、命名规范,提出重构建议。

4. **边界条件**:分析所有可能的边界情况和异常输入,检查错误处理的完备性。

5. **并发安全**:如果涉及多线程/异步操作,分析竞态条件和线程安全性。

请先给出你的分析计划,然后逐一深入分析每个维度,最后给出完整的优化后代码。

待审查代码:

# 在此粘贴你的代码

4.3 复杂Bug定位提示词模板

当遇到难以复现或根因不明的Bug时,进阶思考模式能够通过深度推理帮助定位问题:

我遇到了一个难以定位的Bug,请帮我深度分析可能的原因。

**Bug描述**:

[详细描述Bug的表现、复现步骤、预期行为与实际行为的差异]

**相关代码**:

# 粘贴相关代码片段

**环境信息**:

- 语言/框架版本:

- 操作系统:

- 并发模型(单线程/多线程/异步):

请按以下步骤分析:

1. 根据Bug描述,列出所有可能的原因假设(至少5个)

2. 对每个假设进行推理分析,评估其可能性

3. 按可能性从高到低排序

4. 对最可能的2-3个原因给出具体的验证步骤和修复方案

5. 如果需要,给出调试用的日志添加建议

4.4 实际案例:使用进阶思考优化数据库查询

以下是一个真实的代码优化案例,展示了进阶思考模式与普通思考模式的差异:

原始代码(存在N+1查询问题):

def get_user_orders(user_ids):

users = []

for uid in user_ids:

user = db.query(User).filter(User.id == uid).first()

orders = db.query(Order).filter(Order.user_id == uid).all()

users.append({

'user': user,

'orders': orders

})

return users

使用进阶思考模式(reasoning_effort=“high”)的优化结果:

模型不仅识别出了经典的N+1查询问题,还进一步分析了以下维度:

- 指出N+1查询会导致N+1次数据库往返,当

user_ids数量较大时性能急剧下降 - 建议使用

JOIN查询或IN子查询一次性获取所有数据 - 考虑了内存使用问题——当数据量极大时建议使用分批处理

- 提供了使用SQLAlchemy的

joinedload和contains_eager的两种优化方案 - 给出了优化前后的性能对比估算

# 优化方案1:使用JOIN查询(推荐)

from sqlalchemy.orm import joinedload

def get_user_orders_optimized(user_ids):

users = (db.query(User)

.options(joinedload(User.orders))

.filter(User.id.in_(user_ids))

.all())

return [{'user': u, 'orders': u.orders} for u in users]

# 优化方案2:分批处理(适用于超大数据集)

from itertools import islice

def get_user_orders_batched(user_ids, batch_size=500):

result = []

iterator = iter(user_ids)

while batch := list(islice(iterator, batch_size)):

users = (db.query(User)

.options(joinedload(User.orders))

.filter(User.id.in_(batch))

.all())

result.extend([{'user': u, 'orders': u.orders} for u in users])

return result

5 进阶思考模式实战:论文撰写

5.1 学术写作中的进阶思考优势

学术论文撰写是一项对逻辑严密性、论证深度和表达精确性要求极高的工作。GPT-5.4的进阶思考模式在以下学术写作环节中展现出显著优势:

- 文献综述构建:进阶思考模式能够深入分析多篇文献之间的关联,识别研究脉络中的空白和争议点,构建有逻辑层次的综述框架。

- 研究方法论证:在选择研究方法时,进阶思考模式会比较多种方法的优劣,分析每种方法的适用条件和局限性,帮助研究者做出最有说服力的方法论选择。

- 实验设计审查:进阶思考模式能够识别实验设计中的混淆变量、样本量不足、对照组设置不当等问题,确保实验的科学严谨性。

- 逻辑链条验证:对于论文中的核心论证,进阶思考模式会逐步验证每个推理环节的有效性,确保从前提假设到最终结论的每一步都经得起推敲。

5.2 论文各部分撰写提示词模板

5.2.1 摘要撰写提示词

你是一位在[你的研究领域]领域有深厚学术背景的研究者,拥有丰富的SCI论文写作经验。

请根据以下信息撰写一篇高质量的学术论文摘要(300-500字):

**论文标题**:[你的论文标题]

**研究领域**:[具体领域]

**核心问题**:[研究要解决的核心问题]

**研究方法**:[使用的主要方法]

**主要发现**:[关键发现和结果]

**创新点**:[与现有研究的区别和创新之处]

摘要要求:

1. 结构完整:背景→问题→方法→结果→结论,五要素缺一不可

2. 语言精炼:避免冗余表述,每个句子都承载有效信息

3. 学术规范:使用第三人称,避免主观评价词(如" groundbreaking")

4. 数据支撑:关键结论必须有具体数据或指标支撑

5. 逻辑连贯:前后句之间有明确的逻辑关系

请先给出摘要的结构规划,然后撰写完整摘要,最后进行自我审查。

5.2.2 相关工作撰写提示词

请帮我撰写论文的"相关工作"(Related Work)部分。

**我的研究主题**:[描述你的研究主题和核心贡献]

**已有文献列表**(请按以下格式提供):

1. [作者, 年份] [标题] - [核心观点/方法/结论]

2. [作者, 年份] [标题] - [核心观点/方法/结论]

...

撰写要求:

1. 不要简单罗列文献,要按照主题或方法流派进行分类组织

2. 每个类别内部要体现文献之间的演进关系和学术对话

3. 明确指出每篇文献与我的研究之间的关系(启发、对比、补充)

4. 在每个类别的末尾,总结该方向的研究现状和不足

5. 最后用一个过渡段落,自然引出我的研究如何填补现有空白

6. 引用格式统一使用[编号]形式

请先给出相关工作部分的章节结构大纲,然后逐节撰写。

5.2.3 论文深度评审提示词

请对以下论文段落进行深度学术评审。

**评审维度**:

1. **逻辑严密性**:论证链条是否完整?是否存在逻辑跳跃或循环论证?

2. **证据充分性**:每个论点是否有充分的证据支撑?是否存在以偏概全?

3. **方法论合理性**:研究方法的选择是否有充分理由?是否存在更优替代方案?

4. **创新性评估**:与现有研究相比,真正的创新点在哪里?创新程度如何?

5. **表达精确性**:是否存在模糊表述?术语使用是否准确一致?

6. **反驳预判**:审稿人可能会从哪些角度质疑?如何提前回应?

**待评审内容**:

[粘贴论文段落]

请逐一分析以上维度,对发现的问题给出具体的修改建议和改写示例。

5.3 实际案例:论文Introduction优化

原始Introduction片段:

深度学习在自然语言处理领域取得了很大成功。Transformer模型被提出来之后,很多任务都得到了提升。但是现有的方法还有一些问题,比如计算量太大、需要很多数据。我们的方法解决了这些问题。

使用进阶思考模式(reasoning_effort=“high”)优化后:

模型不仅重写了文本,还提供了完整的优化分析:

- 问题诊断:指出原文存在"表述模糊"(“很大成功”、“很多任务”、“一些问题”)、“缺乏具体数据支撑”、“逻辑跳跃”(直接从问题跳到解决方案,缺少研究空白的论证)三大问题。

- 结构建议:建议按照"领域背景→技术发展→现有方法的局限性→具体研究空白→本文贡献"的五段式结构重写。

- 优化后文本(节选):

自2017年Transformer架构提出以来,基于自注意力机制的深度学习模型在自然语言处理领域取得了突破性进展。Vaswani等人提出的原始Transformer在机器翻译任务上将BLEU分数提升了2.0个点以上,随后BERT、GPT系列等预训练语言模型在GLUE、SuperGLUE等标准基准上持续刷新记录。然而,随着模型规模的指数级增长,现有方法面临两大核心挑战:其一,GPT-3级别的模型参数量已达1750亿,推理延迟超过500ms/请求,难以满足实时应用需求;其二,模型性能高度依赖大规模标注数据,在低资源场景下性能下降超过30%。针对上述挑战,本文提出了一种……

6 进阶思考模式实战:实验数据处理

6.1 数据处理中的进阶思考价值

实验数据处理是科研工作中最耗时但也最关键的环节之一。数据处理的质量直接决定了分析结果的可靠性和结论的有效性。GPT-5.4的进阶思考模式在以下数据处理场景中具有独特价值:

- 数据清洗策略制定:进阶思考模式能够综合考虑数据特征、缺失模式、分布特征等因素,制定最优的数据清洗策略,而不是简单地删除缺失值或填充均值。

- 统计方法选择:面对不同的数据分布特征和研究问题,进阶思考模式能够分析各种统计方法的适用条件,帮助研究者选择最合适的分析方法。

- 异常值检测与处理:进阶思考模式能够区分"真实的极端值"和"需要处理的异常值",避免误删有价值的数据点。

- 实验设计优化:在实验开始之前,进阶思考模式可以帮助评估样本量是否充足、实验设计是否存在混淆变量等问题。

6.2 数据清洗提示词模板

你是一位资深的数据科学家,精通统计学和实验设计。

我有一份实验数据需要进行清洗和预处理,请帮我制定详细的清洗方案。

**数据描述**:

- 数据来源:[实验/调查/传感器等]

- 样本量:[数量]

- 变量列表:[列出所有变量名和类型]

- 已知问题:[缺失值比例、异常值、重复数据等]

**分析目标**:

[描述你最终要进行的分析,例如:比较两组之间的差异、建立预测模型等]

请按以下步骤制定方案:

1. **数据概览**:建议进行哪些描述性统计和可视化来了解数据全貌

2. **缺失值处理**:分析缺失机制(MCAR/MAR/MNAR),针对每种缺失模式给出处理建议

3. **异常值检测**:推荐适合的异常值检测方法(IQR/Z-score/Isolation Forest等),说明选择理由

4. **数据变换**:是否需要进行标准化/归一化/对数变换?为什么?

5. **特征工程**:是否有必要创建衍生变量?建议创建哪些?

6. **验证方案**:清洗后如何验证数据质量?

请给出完整的Python代码实现(使用pandas/numpy/scipy)。

6.3 统计分析提示词模板

请帮我设计完整的统计分析方案。

**研究问题**:[例如:新药A与对照组B在治疗效果上是否存在显著差异?]

**数据特征**:

- 因变量:[变量名](类型:连续/分类/有序,分布特征:正态/偏态)

- 自变量:[变量名](类型:连续/分类/有序)

- 控制变量:[列出控制变量]

- 样本量:[各组样本量]

- 数据分布:[是否正态,方差是否齐性]

请提供:

1. **假设设定**:清晰的原假设和备择假设

2. **检验方法选择**:推荐具体的统计检验方法,说明选择理由和前提假设

3. **效应量计算**:推荐合适的效应量指标

4. **功效分析**:当前样本量是否足够?如果不够,需要多少?

5. **多重比较校正**:如果涉及多重比较,使用哪种校正方法?

6. **结果报告模板**:按照APA格式给出结果报告的模板

请给出完整的Python代码实现(使用scipy/statsmodels/pingouin)。

6.4 实际案例:实验数据的完整分析流程

以下展示一个使用进阶思考模式处理实验数据的完整案例:

场景描述:一位生物学研究者需要分析两组实验数据(实验组和对照组),比较某种药物对细胞存活率的影响。

使用的提示词:

我进行了药物对细胞存活率影响的实验,需要完整的统计分析。

实验设计:

- 实验组(药物处理):n=30,测量细胞存活率(%)

- 对照组(安慰剂):n=30,测量细胞存活率(%)

- 每组有3个生物学重复,每个重复测量10个技术重复

数据特点(初步观察):

- 实验组均值约78%,对照组均值约65%

- 数据可能不完全正态分布

- 可能存在少量异常值

请提供:

1. 完整的数据预处理方案

2. 合适的统计检验方法(考虑非正态的可能性)

3. 效应量计算和置信区间

4. 结果可视化方案(使用matplotlib/seaborn)

5. 按照学术论文标准的结果报告文本

请给出完整的Python代码。

进阶思考模式(xhigh)的输出亮点:

进阶思考模式不仅给出了常规的t检验和Mann-Whitney U检验代码,还额外提供了以下深度分析:

- 实验结构分析:识别出"3个生物学重复 × 10个技术重复"的嵌套设计结构,建议使用混合效应模型(Mixed Effects Model)而非简单的t检验,以正确处理技术重复和生物学重复的层次关系。

- 多重比较考量:指出如果后续需要比较多个时间点或多个剂量组,需要提前规划多重比较校正策略(如Bonferroni或Benjamini-Hochberg)。

- 异常值处理策略:建议使用Grubbs检验而非简单的IQR方法来检测异常值,因为实验数据的异常值可能具有生物学意义。

- 可视化建议:推荐使用箱线图叠加散点图(strip plot)的组合可视化,而非简单的柱状图,以更完整地展示数据分布。

# 进阶思考模式建议的混合效应模型代码(节选)

import pandas as pd

import numpy as np

import statsmodels.api as sm

import statsmodels.formula.api as smf

import matplotlib.pyplot as plt

import seaborn as sns

# 混合效应模型:正确处理嵌套设计

model = smf.mixedlm("survival_rate ~ treatment",

data=df,

groups=df["bio_replicate"])

result = model.fit()

print(result.summary())

# 效应量计算(Cohen's d)

def cohens_d(group1, group2):

n1, n2 = len(group1), len(group2)

var1, var2 = np.var(group1, ddof=1), np.var(group2, ddof=1)

pooled_std = np.sqrt(((n1-1)*var1 + (n2-1)*var2) / (n1+n2-2))

return (np.mean(group1) - np.mean(group2)) / pooled_std

d = cohens_d(df[df['treatment']=='drug']['survival_rate'],

df[df['treatment']=='control']['survival_rate'])

print(f"Cohen's d = {d:.3f}")

# 学术级可视化

fig, ax = plt.subplots(figsize=(8, 6))

sns.boxplot(x='treatment', y='survival_rate', data=df,

palette=['#4C72B0', '#DD8452'], width=0.5, ax=ax)

sns.stripplot(x='treatment', y='survival_rate', data=df,

color='black', alpha=0.5, size=4, ax=ax)

ax.set_xlabel('Treatment Group', fontsize=12)

ax.set_ylabel('Cell Survival Rate (%)', fontsize=12)

ax.set_title('Drug Effect on Cell Survival Rate', fontsize=14)

plt.tight_layout()

plt.savefig('survival_rate_analysis.png', dpi=300)

7 进阶思考模式使用建议与最佳实践

7.1 如何选择合适的推理等级

选择合适的推理等级是在质量和效率之间取得平衡的关键。以下决策流程图可以帮助你快速做出选择:

| 任务复杂度 | 推荐等级 | 判断标准 |

|---|---|---|

| 简单(翻译、格式化、模板填充) | none |

不需要推理,纯文本处理 |

| 基础(摘要、问答、数据提取) | low |

需要基本理解但不需要深度分析 |

| 中等(内容生成、标准编程、常规分析) | medium |

需要多步推理但问题结构清晰 |

| 复杂(架构设计、论文论证、Bug定位) | high |

需要深度推理和多方案比较 |

| 极端复杂(数学证明、系统设计、exhaustive研究) | xhigh |

需要穷尽推理和最大精度 |

7.2 进阶思考模式的最佳实践

实践一:先规划再执行

在提交复杂任务之前,先让模型以medium等级生成一个任务规划,确认规划合理后再切换到high或xhigh执行。这样可以避免在高推理等级下浪费Token。

请先为以下任务制定一个详细的执行计划(不需要执行,只需要规划):

任务:[描述你的复杂任务]

计划要求:

1. 将任务分解为具体的子任务

2. 标注每个子任务的复杂度和预计难度

3. 标注哪些子任务需要深度推理(high/xhigh),哪些用medium即可

4. 估算整体的Token消耗和响应时间

实践二:利用中途干预功能

GPT-5.4 Thinking的可操控性允许你在模型思考过程中进行干预。当模型展示其推理计划后,你可以:

- 调整优先级:“请优先分析性能问题,安全审计可以简化处理”

- 补充约束:“补充一个约束条件:代码必须兼容Python 3.8”

- 切换方向:“不要用动态规划了,请改用贪心算法分析”

- 要求深入:“第3点的分析太浅了,请展开详细讨论”

实践三:分而治之

对于特别复杂的任务,将其拆分为多个子任务,分别使用不同推理等级处理。例如:

- 论文写作:Introduction用

medium,Method用high,实验分析用xhigh - 代码重构:整体架构设计用

xhigh,具体函数实现用medium - 数据分析:数据清洗用

medium,统计检验用high,结果解读用medium

7.3 常见问题与注意事项

| 问题 | 原因 | 解决方案 |

|---|---|---|

| 响应时间过长 | 推理等级过高或任务过于复杂 | 降低推理等级,或将任务拆分为子任务 |

| API成本过高 | xhigh等级生成大量推理Token | 仅在关键任务上使用xhigh,其余用medium |

| 输出质量未达预期 | 提示词不够具体 | 提供更多上下文、约束条件和示例 |

| 推理过程不可见 | reasoning_content未正确获取 | 确保API版本支持,检查response结构 |

| 模型"过度思考" | 简单任务使用了过高推理等级 | 根据任务复杂度匹配推理等级 |

8 总结与展望

GPT-5.4的进阶思考模式标志着AI推理能力的一次重要进化。通过五档可配置的推理力度(none / low / medium / high / xhigh),用户可以像调节精密仪器一样精准控制AI的"思考深度",在响应速度和推理质量之间找到最佳平衡点。

从实际应用来看,进阶思考模式在代码修改、论文撰写和实验数据处理三大场景中展现出了显著优势。在代码审查中,它能够进行多维度的深度分析,不仅发现表面问题,还能识别架构层面的隐患;在论文写作中,它能够构建严密的论证链条,确保每个观点都有充分的逻辑支撑;在实验数据处理中,它能够综合考虑统计原理和实验设计规范,提供科学严谨的分析方案。

展望未来,随着推理模型的持续进化,我们可以期待以下几个方向的发展:推理效率的进一步提升(在保持精度的同时降低Token消耗)、更细粒度的推理控制(如针对特定推理步骤进行调整)、以及与Agent能力的深度融合(让AI能够自主决定何时需要深度推理)。对于研究者和开发者而言,掌握进阶思考模式的使用技巧,将成为充分发挥AI能力的关键竞争力。

⚠️ 再次提醒:翻墙属于违法行为,违反中国相关法律法规。国内镜像站完全合法合规,是使用GPT-5.4等国际先进AI模型的正规渠道。请大家务必通过合法途径使用AI服务。注册入口:AIGCBAR镜像站。如需API开发,请通过API独立站注册。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献132条内容

已为社区贡献132条内容

所有评论(0)