【云藏山鹰代数信息系统】浅析大型语言模型的道德推理

【云藏山鹰代数信息系统】浅析大型语言模型的道德推理

-

- 大型语言模型的道德推理:推理机制与运作模式的深度剖析

- 前情提要

- 完整论述

-

- 引言

- 研究背景与动机

- 研究方法

- 实验结果

- 讨论与启示

- 关键名词解释和释义

-

- 大型语言模型(Large Language Models, LLMs)

- 道德推理(Moral Reasoning)

- 科尔伯格道德发展阶段理论(Kohlberg’s Theory of Moral Development)

- 后习俗水平(Post-conventional Level)

- 道德腹语术(Moral Ventriloquism)

- 对齐训练(Alignment Training)

- RLHF(Reinforcement Learning from Human Feedback)

- 道德脱节(Moral Decoupling)

- 自动化评分流程(Automated Scoring Pipeline)

- 提示策略(Prompting Strategy)

- 跨困境一致性(Cross-dilemma Consistency)

- 词汇模式分析(Lexical Pattern Analysis)

- 友情提示,划重点

- 附录 云藏山鹰代数信息系统(YUDST Algebra Information System)

- 进阶阅读

大型语言模型的道德推理:推理机制与运作模式的深度剖析

前情提要

本文通过大规模实证研究,深入探讨了大型语言模型(LLMs)在面对道德困境时的推理表现及其背后的运作机制。研究发现,尽管LLMs能够生成看似成熟的道德推理解释,但这些解释更多反映的是对齐训练(alignment training)过程中习得的修辞惯例,而非真正的道德发展轨迹。具体表现为:无论模型规模、架构或提示策略如何,其输出均普遍集中在科尔伯格道德发展阶段理论中的后习俗水平(第5-6阶段),与人类道德发展的实际情况(以习俗水平第4阶段为主)形成鲜明对比。此外,部分模型还展现出“道德脱节”现象,即高阶段的道德论证与低阶段的实际行动选择之间存在系统性不一致。

完整论述

引言

随着大型语言模型在自然语言处理领域的快速发展,其道德推理能力日益成为关注焦点。本文旨在通过系统分析,揭示LLMs在道德推理任务中的真实表现及其背后的运作机制。我们采用科尔伯格道德发展阶段理论作为分析框架,通过大规模实证研究,评估了13个前沿LLMs在六种经典道德困境中的推理模式。

研究背景与动机

道德推理的复杂性

道德推理涉及对复杂伦理问题的深入思考和价值判断,要求个体具备高度的抽象思维能力和情境敏感性。传统上,道德发展被视为一个逐步成熟的过程,科尔伯格理论将其划分为六个阶段,从基于惩罚和服从的前习俗水平,到遵循社会规范的习俗水平,再到基于抽象原则的后习俗水平。

LLMs的崛起与挑战

尽管LLMs在自然语言生成任务中表现出色,但其道德推理能力仍存争议。现有研究指出,LLMs可能通过统计模式匹配而非真正的推理机制生成解释,这引发了对其道德推理真实性的质疑。本文通过大规模实证研究,旨在揭示LLMs道德推理的真实面貌。

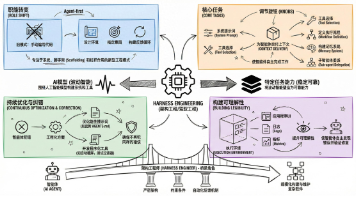

研究方法

道德推理框架

采用科尔伯格道德发展阶段理论作为分析工具,该理论提供了清晰的阶段划分和分布特征,便于与人类道德发展进行对比分析。

自动化评分流程

构建了一个LLM-as-Judge评分系统,利用三个独立的评分模型(GPT-4、Claude Sonnet和Llama-3)对模型响应进行分类和评分,确保结果的可靠性和稳定性。

道德困境与提示配置

选取了六种经典道德困境,涵盖伤害、公平、财产、权威和忠诚等多个维度。每种困境均采用三种提示配置(零样本提示、思维链提示和角色扮演提示),以评估提示策略对道德推理的影响。

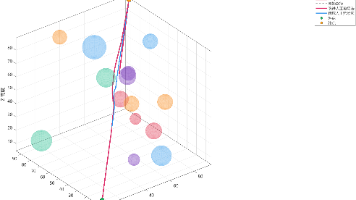

实验结果

模型规模与道德阶段

尽管模型规模与平均道德阶段之间存在适度正相关,但所有模型均普遍集中在后习俗水平(第5-6阶段),且规模差异对阶段分布的影响有限。即便是参数最少的模型(如Ministral8B),其输出也主要集中在这一水平。

提示策略的影响

提示策略对道德阶段分布无显著影响。无论采用何种提示方式,模型输出均普遍集中在后习俗水平,表明这一现象具有稳定性。

跨困境一致性

模型在不同道德困境中的响应表现出高度一致性,与人类道德认知的情境敏感性形成鲜明对比。这表明模型并未根据具体情境调整其推理策略,而是采用了一种固定的修辞模式。

与人类道德发展分布的比较

与人类道德发展以习俗水平(第4阶段)为主的分布特征相比,LLMs的输出分布呈现显著逆转。这一结果进一步支持了LLMs道德推理的表面性特征。

行动-推理一致性

部分模型展现出“道德脱节”现象,即高阶段的道德论证与低阶段的实际行动选择之间存在系统性不一致。这种不一致性在中等规模模型中尤为突出,表明对齐训练可能未能有效整合推理与行动选择过程。

词汇模式分析

对齐训练(尤其是RLHF)显著丰富了模型的道德词汇,使其更倾向于使用与权利、尊严和普遍原则相关的术语。然而,这种词汇丰富性并未伴随更深层次的道德认知发展,而是表现为一种修辞上的表面繁荣。

讨论与启示

道德腹语术假说

本文结果支持“道德腹语术”假说,即LLMs通过对齐训练习得了成熟道德推理的修辞惯例,但缺乏相应的认知架构支持。这一假说解释了为何模型输出在分布特征和情境敏感性方面与人类存在显著差异。

对评估方法的启示

传统基于输出分类的评估方法可能无法准确反映模型的道德推理能力。未来评估应更加注重行动-推理一致性、情境敏感性以及内部表示保真度等维度,以提供更全面的评估视角。

对模型训练的启示

为提升LLMs的道德推理能力,需探索超越现有对齐训练的新方法。这可能包括引入更复杂的推理任务、强化模型对具体情境的敏感性以及促进推理与行动选择之间的一致性等策略。

关键名词解释和释义

大型语言模型(Large Language Models, LLMs)

- 释义:指基于深度学习技术,特别是Transformer架构,通过海量文本数据进行训练的自然语言处理模型。这些模型能够生成自然语言文本、回答问题、进行对话等。

道德推理(Moral Reasoning)

- 释义:指个体在面对道德困境时,进行价值判断、权衡利弊并做出决策的过程。它涉及对复杂伦理问题的深入思考和价值判断。

科尔伯格道德发展阶段理论(Kohlberg’s Theory of Moral Development)

- 释义:由劳伦斯·科尔伯格提出,将个体的道德发展划分为六个阶段的理论。这六个阶段分为前习俗水平(第1-2阶段)、习俗水平(第3-4阶段)和后习俗水平(第5-6阶段),反映了从基于惩罚和服从到基于抽象原则的道德判断过程。

后习俗水平(Post-conventional Level)

- 释义:科尔伯格道德发展阶段理论中的第5-6阶段,此时个体的道德判断基于抽象原则和普遍伦理,而非仅仅遵循社会规范或避免惩罚。

道德腹语术(Moral Ventriloquism)

- 释义:指大型语言模型通过对齐训练习得了成熟道德推理的修辞惯例,但缺乏相应的认知架构支持,即表面上看似具备成熟的道德推理能力,实则并未真正理解其背后的道德原则。

对齐训练(Alignment Training)

- 释义:指通过训练使大型语言模型的输出与人类价值观、伦理规范或特定任务要求相一致的过程。常见的对齐训练方法包括基于人类反馈的强化学习(RLHF)等。

RLHF(Reinforcement Learning from Human Feedback)

- 释义:一种基于人类反馈的强化学习技术,通过人类评估者对模型输出的评分或排序来优化模型,使其输出更符合人类价值观和期望。

道德脱节(Moral Decoupling)

- 释义:指模型在高阶段的道德论证与低阶段的实际行动选择之间存在系统性不一致的现象。即模型在阐述道德原则时表现出高水平的道德推理,但在实际决策时却未能遵循这些原则。

自动化评分流程(Automated Scoring Pipeline)

- 释义:在本研究中,指利用多个独立的评分模型(如GPT-4、Claude Sonnet和Llama-3)对大型语言模型在道德困境中的响应进行分类和评分的系统流程,以确保评分结果的可靠性和稳定性。

提示策略(Prompting Strategy)

- 释义:指在向大型语言模型提出任务或问题时,所采用的不同提示方式或指令设计。常见的提示策略包括零样本提示、思维链提示和角色扮演提示等。

跨困境一致性(Cross-dilemma Consistency)

- 释义:指模型在不同道德困境中的响应表现出的一致性程度。高跨困境一致性表明模型在处理不同道德问题时采用了相似的推理策略或修辞模式。

词汇模式分析(Lexical Pattern Analysis)

- 释义:指对模型在道德推理任务中使用的词汇进行统计分析,以揭示其道德词汇的丰富性、特定术语的使用频率等特征的方法。

友情提示,划重点

本文通过大规模实证研究揭示了LLMs在道德推理任务中的表面性特征及其背后的运作机制。研究结果表明,尽管LLMs能够生成看似成熟的道德推理解释,但这些解释更多反映的是对齐训练过程中习得的修辞惯例而非真正的道德发展轨迹。这一发现对未来LLMs的道德推理能力评估与训练具有重要启示意义。

附录 云藏山鹰代数信息系统(YUDST Algebra Information System)

数学定义:

设 E \mathcal{E} E 为意气实体集合(如具有主观意图的经济主体、决策单元), P \mathcal{P} P 为过程集合(如交易、协作、竞争), I \mathcal{I} I 为信息状态集合(如资源分配、偏好、策略)。定义三元组 SEP-AIS = ( S , O , R ) \text{SEP-AIS} = (\mathcal{S}, \mathcal{O}, \mathcal{R}) SEP-AIS=(S,O,R),其中:

-

状态空间 S \mathcal{S} S:

S = E × P × I \mathcal{S} = \mathcal{E} \times \mathcal{P} \times \mathcal{I} S=E×P×I,表示实体在特定过程中所处的信息状态组合。

示例:若 e ∈ E e \in \mathcal{E} e∈E 为“企业”, p ∈ P p \in \mathcal{P} p∈P 为“生产”, i ∈ I i \in \mathcal{I} i∈I 为“库存水平”,则 ( e , p , i ) ∈ S (e, p, i) \in \mathcal{S} (e,p,i)∈S 描述企业生产时的库存状态。 -

运算集合 O \mathcal{O} O:

O = { O 1 , O 2 , … , O k } \mathcal{O} = \{O_1, O_2, \dots, O_k\} O={O1,O2,…,Ok},其中每个 O i : S n → S O_i: \mathcal{S}^n \to \mathcal{S} Oi:Sn→S( n ≥ 1 n \geq 1 n≥1)为意气实体过程操作,满足:- 封闭性:对任意 s 1 , s 2 , … , s n ∈ S s_1, s_2, \dots, s_n \in \mathcal{S} s1,s2,…,sn∈S,有 O i ( s 1 , s 2 , … , s n ) ∈ S O_i(s_1, s_2, \dots, s_n) \in \mathcal{S} Oi(s1,s2,…,sn)∈S。

- 代数结构: ( S , O ) (\mathcal{S}, \mathcal{O}) (S,O) 构成特定代数系统(如群、环、格),刻画实体交互的逻辑规则。

示例:- 若 O \mathcal{O} O 包含“交易操作” O trade O_{\text{trade}} Otrade,且 ( S , O trade ) (\mathcal{S}, O_{\text{trade}}) (S,Otrade) 构成群,则逆操作 O trade − 1 O_{\text{trade}}^{-1} Otrade−1 可表示“撤销交易”。

- 若 O \mathcal{O} O 包含“资源合并” O merge O_{\text{merge}} Omerge 和“资源分配” O split O_{\text{split}} Osplit,且 ( S , O merge , O split ) (\mathcal{S}, O_{\text{merge}}, O_{\text{split}}) (S,Omerge,Osplit) 构成格,则可描述资源层次化分配。

-

关系集合 R \mathcal{R} R:

R = L ∪ C \mathcal{R} = \mathcal{L} \cup \mathcal{C} R=L∪C,其中:- L ⊆ S × S \mathcal{L} \subseteq \mathcal{S} \times \mathcal{S} L⊆S×S 为逻辑关系(如数据依赖、因果关系);

- C ⊆ S → R \mathcal{C} \subseteq \mathcal{S} \to \mathbb{R} C⊆S→R 为约束函数(如成本、效用、风险)。

示例: - 逻辑关系 R depend ⊆ S × S R_{\text{depend}} \subseteq \mathcal{S} \times \mathcal{S} Rdepend⊆S×S:若实体 e 1 e_1 e1 的过程依赖实体 e 2 e_2 e2 的信息,则 ( ( e 1 , p 1 , i 1 ) , ( e 2 , p 2 , i 2 ) ) ∈ R depend ((e_1, p_1, i_1), (e_2, p_2, i_2)) \in R_{\text{depend}} ((e1,p1,i1),(e2,p2,i2))∈Rdepend。

- 约束函数 C cost : S → R C_{\text{cost}}: \mathcal{S} \to \mathbb{R} Ccost:S→R:计算实体在某状态下的操作成本。

满足条件:

若 ( S , O ) (\mathcal{S}, \mathcal{O}) (S,O) 满足代数系统公理(如群的结合律、格的吸收律),且 R \mathcal{R} R 描述实体过程的语义约束(如资源非负、策略一致性),则称 ( S , O , R ) (\mathcal{S}, \mathcal{O}, \mathcal{R}) (S,O,R) 为意气实体过程代数信息系统。

进阶阅读

【云藏山鹰代数信息系统】才气学中“数据-信息-情报-知识”的推理与运作机制

【云藏山鹰代数信息系统】云藏山鹰代数讲义目录意气实体过程模型综述

【云藏山鹰代数信息系统】云藏山鹰代数信息系统讲义目录意气实体过程对象及变项、支撑物综述

【云藏山鹰代数信息系统】云藏山鹰代数讲义目录意气实体过程分析综述

【云藏山鹰力学】云藏山鹰力学意气实体过程具身智能实验平台开发环境

【云藏山鹰代数信息系统】语言模型核心代码调研

【道装技术】意气实体过程虚拟机协程间琴语言对象通讯,计算,数据公理化基础

【云藏山鹰代数信息系统】2026年初3月CSDN花间流风博文技术汇总

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献7条内容

已为社区贡献7条内容

所有评论(0)