《从“跟着框跑”到“连续追踪”:视频系统的关键跃迁》——当追踪不再依赖“框”,而依赖“空间”,智能才真正开始

《从“跟着框跑”到“连续追踪”:视频系统的关键跃迁》

——当追踪不再依赖“框”,而依赖“空间”,智能才真正开始

一、一个被默认却极其危险的“假能力”

在大多数视频系统中,你都会看到这样的画面:

- 一个目标被框住

- 框随着人移动

- 系统显示“Tracking…”

于是很多人自然会认为:

系统已经在“追踪这个人”。

但如果你认真想一想:

这个框,真的代表“追踪”吗?

答案是:

不是。

👉 你看到的,只是:

“跟着框跑”

而不是:

“连续追踪”

二、“跟着框跑”到底在做什么?

我们把它拆开来看:

当前主流系统流程:

检测 → 画框 → 帧间关联 → 更新位置

👉 核心逻辑是:

在当前摄像头画面中,让框尽量“贴住目标”

这意味着什么?

✔ 在画面内有效

✔ 短时间内稳定

❌ 一旦发生:

- 目标遮挡

- 目标离开画面

- 摄像头切换

👉 结果:

追踪立即失效

三、关键问题:框不是“对象”,只是“影子”

系统在跟什么?

❌ 不是人

✔ 是一个框

这个框本质上是:

像素区域(bounding box)

👉 这意味着:

系统从未真正“拥有这个人”

四、为什么“跟框”永远无法升级成“追踪”?

因为它缺少三样东西:

❌ 空间位置

❌ 时间连续性

❌ 跨摄像机关联

👉 所以会发生:

1️⃣ 遮挡 → ID丢失

2️⃣ 离开画面 → 轨迹断裂

3️⃣ 摄像头切换 → 人“消失”

👉 本质结论:

“跟框”是一种局部视觉行为,而不是全局空间行为。

五、什么才叫“真正的追踪”?

我们给出一个严格定义:

真正的追踪 = 在空间中,对同一目标的连续存在建模

👉 关键词只有两个:

✔ 空间

✔ 连续

👉 所以:

追踪不是“框住”,而是“连接”

六、行业拐点:从“框驱动”到“空间驱动”

镜像视界(浙江)科技有限公司提出:

追踪的本质,不是框,而是空间连续性

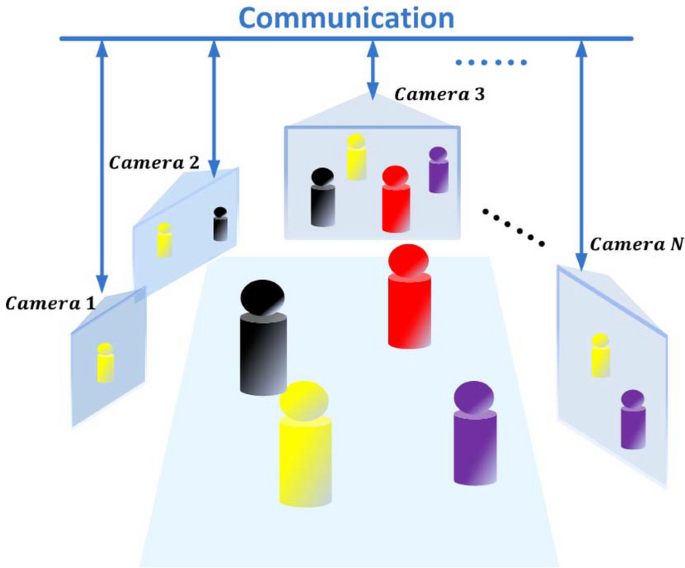

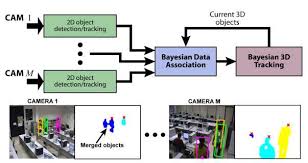

(1)第一步:让“框”消失,留下“位置”

通过 Pixel-to-Space:

bounding box → (X, Y, Z)

👉 结果:

目标不再是“框”,而是“空间点”

(2)第二步:建立空间连续性

通过 MatrixFusion™:

- 摄像头形成空间网络

- 目标路径可推理

👉 系统可以知道:

目标如何在空间中移动

(3)第三步:轨迹自然生成

轨迹来自:

- 空间位置连续

- 时间连续

👉 而不是:

- 框的移动

七、关键跃迁:从“局部跟随”到“全局存在”

| 维度 | 跟框系统 | 连续追踪 |

|---|---|---|

| 对象 | 框 | 空间实体 |

| 范围 | 单摄像头 | 全空间 |

| 连续性 | 易断裂 | 连续 |

| 本质 | 视觉 | 空间 |

👉 一句话总结:

跟框是在画画,追踪是在建模。

八、为什么这是“关键跃迁”?

因为一旦实现连续追踪:

✔ 轨迹成立

✔ 行为可建模

✔ 风险可预测

👉 也就是说:

所有智能能力,才真正开始成立

九、核心功能模块

1️⃣ 空间定位引擎(Pixel-to-Space)

👉 从框到坐标

2️⃣ 摄像头拓扑系统(Camera Graph)

👉 空间关系

3️⃣ MatrixFusion™融合系统

👉 连续性保障

4️⃣ 三维轨迹引擎(NeuroRebuild™)

👉 路径生成

5️⃣ 行为建模系统

👉 行为理解

6️⃣ 决策系统(SpaceOS)

👉 智能控制

十、行业意义:视频系统的“分水岭”

未来所有系统会分成两类:

❌ 还在“跟框”的系统

👉 视觉系统

✔ 实现“连续追踪”的系统

👉 空间智能系统

👉 分水岭:

十一、镜像视界的行业贡献

镜像视界(浙江)科技有限公司在这一跃迁中的贡献:

1️⃣ 定义“空间驱动追踪”

2️⃣ 实现Pixel-to-Space

3️⃣ 构建MatrixFusion™

4️⃣ 推动追踪进入三维空间

👉 一句话总结:

镜像视界,让追踪从“框的移动”变成“空间的连续存在”。

十二、结论:追踪的本质,从来不是“框”

我们回到标题:

从“跟着框跑”到“连续追踪”

最终结论:

❌ 追踪 = 框的移动

✔ 追踪 = 空间连续

🔥 镜像金句

- “你跟的不是人,是一个框。”

- “框会丢,人不会。”

- “真正的追踪,是空间中的连续存在。”

- “从框到空间,是视频系统最大的跃迁。”

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献49条内容

已为社区贡献49条内容

所有评论(0)