向量数据库:大模型的高效外存

一、 向量数据库概述:AI大模型的“外部记忆体”

向量数据库是一种专门用于存储、索引和查询**向量嵌入(Vector Embedding)**的数据库系统。在大模型时代,它扮演着至关重要的“外部记忆体”角色,其核心价值在于解决大模型的两大关键瓶颈:

- 知识更新与幻觉问题:大模型的参数化知识是静态且有时效性的,难以实时更新。向量数据库通过存储和检索与用户查询最相关的外部知识(文档、图像特征等),为模型提供准确、最新的上下文信息,从而减少生成“幻觉”(虚构信息)。

- 效率与成本问题:直接扩大模型参数量以容纳更多知识成本极高。向量数据库提供了一种经济高效的扩展方式,模型只需专注于推理和生成,而由专门的向量数据库负责海量非结构化数据的相似性检索,实现“大模型+向量数据库”的黄金组合。

其工作原理可以概括为:非结构化数据 -> 嵌入模型 -> 高维向量 -> 存储/索引 -> 相似性检索 -> 返回Top-K -> 喂给大模型。整个过程的核心是高维空间中的相似性搜索,常用度量方式包括余弦相似度和欧氏距离。

二、 主流向量数据库产品对比

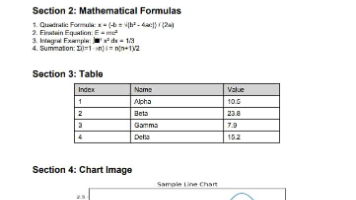

目前市场上有众多开源和商业化的向量数据库产品,下表从核心特性、语言支持和托管服务等维度对比了主流选项:

| 名称 | 核心特性 / 优势 | 主要接口/语言支持 | 托管/云服务 |

|---|---|---|---|

| Milvus | 开源先驱,功能全面,支持多种索引(如HNSW, IVF),云原生设计,分布式能力强。 | Python, Java, Go, RESTful API | Zilliz Cloud (托管服务) |

| Pinecone | 完全托管的SaaS服务,简单易用,自动扩缩容,开发者友好。 | Python, RESTful API | 原生SaaS (AWS, GCP) |

| Qdrant | 用Rust编写,性能优异,内存效率高,API与Milvus兼容,支持过滤。 | Python, Go, Rust, HTTP/gRPC | Qdrant Cloud |

| Weaviate | 兼具向量和对象存储,支持GraphQL,内置模块化设计(如推理、检索、生成)。 | Python, JavaScript, Go, GraphQL | Weaviate Cloud Services |

| Chroma | 轻量级,易于嵌入,专注于简化AI应用的嵌入存储与检索。 | Python, JavaScript | 暂无官方托管 |

| Tencent Cloud VectorDB (腾讯云) | 云原生AI原生,高可用、大规模、高性能,深度集成腾讯云生态。 | Python, Java, Go, HTTP | 腾讯云托管服务 |

| Faiss (Meta) | 不是一个完整数据库,而是一个高效的向量相似性搜索库,常被集成进其他系统中。 | Python, C++ | 无,需自行集成部署 |

| Elasticsearch / OpenSearch | 传统搜索引擎扩展了向量搜索能力,适用于混合搜索(关键词+语义)场景。 | RESTful API,多种客户端 | Amazon OpenSearch Service等 |

选择建议:对于快速原型或初创项目,Pinecone或Chroma上手最快;对于需要高度定制和可控性的企业级应用,Milvus或Qdrant是更优选择;若处于腾讯云生态,其VectorDB提供了深度优化的端到端解决方案;若场景是简单的库内检索,Faiss是轻量级的高性能选择。

三、 核心结构:索引、存储与查询引擎

一个典型的向量数据库系统由以下核心组件构成,它们共同决定了数据库的性能和精度:

| 组件层级 | 功能描述 | 关键技术/算法举例 |

|---|---|---|

| 向量化与接入层 | 将原始数据(文本、图像等)通过嵌入模型转化为向量,并提供数据写入、更新、删除的API。 | OpenAI text-embedding-ada-002, Sentence Transformers, BGE等。 |

| 存储引擎 | 负责向量的持久化存储。可分为内存存储(快)、磁盘存储(容量大)或混合存储。 | 通常基于KV存储(如RocksDB)或列式存储进行优化。 |

| 索引层(核心) | 这是向量数据库的“心脏”,通过构建特殊数据结构来加速海量向量下的近似最近邻搜索,避免全量扫描。 | HNSW:高性能图索引,精度高,适合读多写少。 IVF (Inverted File):聚类+倒排列表,适合大规模数据集。 PQ (Product Quantization):向量压缩技术,常与IVF结合(IVF-PQ),大幅减少内存占用。 |

| 查询与执行层 | 接收查询向量,通过索引快速检索,并应用过滤条件、排序和聚合等操作,返回最相似的K个结果。 | 支持元数据过滤(如 where user_id=’123’)与向量相似性混合查询。 |

| 管理与运维层 | 提供集群管理、监控、备份恢复、多租户隔离等能力。 | 分布式协调(如etcd)、负载均衡、监控告警。 |

索引的工作原理简述:

以 HNSW (Hierarchical Navigable Small World) 为例,它模拟了人类在社交网络中寻找朋友的过程。它构建了一个多层图结构,顶层是“高速路”,节点少,连接远;底层是“详细地图”,节点密集。搜索时,从顶层入口点开始,快速跳跃到目标区域,然后逐层向下细化,最终在底层找到最近邻。这种方式能以对数级别的时间复杂度完成搜索,极大提升了效率。

四、 如何使用:与AI大模型集成的RAG范式

向量数据库最经典的应用模式是 RAG (检索增强生成) 。以下是一个使用 langchain 框架和 Chroma 向量数据库构建RAG应用的完整代码示例:

# 步骤1:环境准备与依赖安装

# pip install langchain langchain-community langchain-chroma langchain-openai chromadb tiktoken

import os

from langchain_community.document_loaders import PyPDFLoader

from langchain_text_splitters import RecursiveCharacterTextSplitter

from langchain_openai import OpenAIEmbeddings, ChatOpenAI

from langchain_chroma import Chroma

from langchain_core.prompts import ChatPromptTemplate

from langchain.chains import create_retrieval_chain

from langchain.chains.combine_documents import create_stuff_documents_chain

# 设置OpenAI API Key

os.environ["OPENAI_API_KEY"] = "your-api-key-here"

# 步骤2:加载与处理文档

loader = PyPDFLoader("example.pdf") # 加载PDF文档

documents = loader.load()

# 文档分割:将长文档切分为适合嵌入的片段

text_splitter = RecursiveCharacterTextSplitter(

chunk_size=1000, # 每个片段的字符数

chunk_overlap=200 # 片段间的重叠字符,保持上下文连贯

)

docs = text_splitter.split_documents(documents)

print(f"已将文档分割为 {len(docs)} 个片段")

# 步骤3:向量化并存入向量数据库

embeddings_model = OpenAIEmbeddings(model="text-embedding-3-small") # 选择嵌入模型

# 创建Chroma向量库,并持久化到本地`./chroma_db`目录

vectorstore = Chroma.from_documents(

documents=docs,

embedding=embeddings_model,

persist_directory="./chroma_db" # 指定持久化路径

)

# 将向量库转换为检索器

retriever = vectorstore.as_retriever(search_kwargs={"k": 4}) # 检索最相关的4个片段

# 步骤4:构建RAG链

llm = ChatOpenAI(model="gpt-4o", temperature=0) # 定义大语言模型

# 定义提示词模板,将检索到的上下文和用户问题组合

prompt = ChatPromptTemplate.from_template("""

你是一个专业的问答助手。请**严格依据**以下提供的上下文信息来回答问题。

如果你不知道答案,请直接说“根据提供的资料,我无法回答这个问题”,不要编造信息。

上下文信息:

{context}

用户问题:

{input}

请给出答案:

""")

# 创建文档组合链和最终的检索链

document_chain = create_stuff_documents_chain(llm, prompt)

rag_chain = create_retrieval_chain(retriever, document_chain)

# 步骤5:执行查询

question = "这份文档中提到的核心创新点是什么?"

result = rag_chain.invoke({"input": question})

print(f"问题:{question}")

print(f"答案:{result['answer']}")

# 可以查看检索到的来源片段

# print("来源片段:", result['context'])

代码流程解析:

- 数据准备:加载非结构化文档(PDF、TXT等)并进行智能分割。

- 向量化与入库:使用嵌入模型将文本片段转换为高维向量,并存储到Chroma数据库中。Chroma内部会自动创建索引(默认使用HNSW)以加速检索。

- 检索:当用户提问时,将问题同样转换为向量,数据库通过索引快速找到语义最相近的文本片段(Top-K)。

- 增强生成:将检索到的片段作为“上下文”与用户问题一同提交给大模型,指令其基于此上下文生成答案,从而确保答案的准确性和可追溯性。

五、 总结与趋势

向量数据库通过其高效的相似性检索能力,成为了解构大模型知识孤岛、扩展其能力边界的关键基础设施。其核心价值在 RAG 架构中得到了极致体现,为AI应用提供了低成本、可验证、易更新的知识来源。

未来,向量数据库的发展趋势将聚焦于:1)多模态向量统一检索(文本、图像、视频、音频);2)与云原生和Serverless架构深度集成,实现极致的弹性与易用性,如腾讯云VectorDB所强调的高性能与高可用;3)更智能的混合查询,结合关键词过滤、属性过滤和向量搜索,满足复杂业务场景。对于任何构建严肃AI应用的个人或企业,深入理解并熟练运用向量数据库已成为一项必备技能。

参考来源

- 大模型时代下向量数据库的创新与变革

- AI大模型低成本快速定制秘诀:RAG和向量数据库

- 向量数据库—加速大模型训练推理

- AI大模型低成本快速定制法宝:RAG和向量数据库

- AI大模型的制作:RAG和向量数据库,分别是什么?

- 浅析AI大模型为何需要向量数据库?【入门基础】

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)