知识蒸馏(Knowledge Distillation)完全指南:原理、实践与进阶

一句话概括:知识蒸馏是一种模型压缩技术,它让一个轻量级的“学生模型”模仿一个高性能的“教师模型”的输出行为,从而在保持小体积、低延迟的同时,获得接近大模型的能力。

一、为什么需要知识蒸馏?—— 大模型的“奢侈”与小设备的“渴望”

近年来,深度学习模型变得越来越大:BERT-base 有 1.1 亿参数,GPT-3 有 1750 亿参数,最新的多模态模型甚至达到万亿级别。这些大模型在自然语言处理、计算机视觉等领域取得了惊人的成绩,但它们也带来了三个现实问题:

| 问题 | 具体表现 | 影响 |

|---|---|---|

| 推理延迟高 | 一次前向传播可能需要几百毫秒甚至数秒 | 不适合实时交互(如搜索引擎、语音助手) |

| 内存/显存占用大 | 参数多,中间激活值大 | 难以部署在手机、嵌入式设备、边缘服务器上 |

| 能耗高 | 每次推理消耗大量电能 | 大规模部署成本高昂,不符合绿色计算趋势 |

知识蒸馏应运而生,它的目标就是:在尽量不牺牲精度的前提下,获得一个轻量、快速的模型。

二、核心思想:从“标准答案”到“解题思路”

2.1 传统训练:只给“硬标签”

在常规的分类任务中,我们使用 one-hot 编码的硬标签(hard label)训练模型。例如,一张猫的图片,标签是 [0, 0, 1](假设类别顺序:狗、老虎、猫)。模型被强制要求输出 [0, 0, 1],而其他类别的概率必须严格为 0。

问题:硬标签丢失了类别之间的相似性信息。猫和狗都是哺乳动物,猫和老虎都属于猫科——这些常识信息没有被传递。

2.2 知识蒸馏:引入“软标签”

一个训练好的大模型(教师),对于同一张猫图,可能会输出:

text

猫: 0.9 老虎: 0.07 狗: 0.03

这个概率分布被称为软标签(soft label)。它不仅告诉正确答案是“猫”,还隐含了:

-

猫与老虎更接近(0.07 vs 0.03)

-

猫与狗也有一定相似性(0.03)

这种“暗知识”(dark knowledge)反映了教师模型对类别间关系的理解。学生模型通过学习软标签,可以更快地掌握数据的内部结构,甚至比直接用硬标签训练效果更好。

比喻:硬标签就像老师只告诉你“答案是B”;软标签则像老师不仅给答案,还解释了“为什么A错、C错、B对”,以及A、B、C之间的相似点和差异点。

三、数学原理:温度缩放与损失函数

3.1 温度参数 T:控制软标签的“平滑度”

教师模型输出的 logits(未归一化的分数)记为 zizi。通过带温度 TT 的 Softmax 函数,我们得到软标签:

qi=exp(zi/T)∑jexp(zj/T)qi=∑jexp(zj/T)exp(zi/T)

-

当 T=1T=1:标准 Softmax,概率分布较尖锐(最大类接近1,其余接近0)。

-

当 T>1T>1:分布变得平滑,非最大类的概率相对增大,从而放大类别间的细微差异(暗知识)。

-

当 T→∞T→∞:趋向均匀分布,所有类别概率相等,失去信息。

为什么需要较大的 TT?

因为对于硬标签,教师模型输出中正确类别的 logit 通常远大于其他类,导致软标签几乎退化为硬标签。提升 TT 可以让非最大类的概率得到更多权重,学生模型才能学到丰富的“暗知识”。

3.2 学生模型的损失函数

学生模型的训练目标由两部分加权组合而成:

-

蒸馏损失(软损失):

Lsoft=T2⋅KL(q∥pT)Lsoft=T2⋅KL(q∥pT)

学生模型在相同温度 TT 下的输出概率 piTpiT 与教师软标签 qiqi 之间的KL散度(Kullback-Leibler Divergence)。KL 散度衡量两个概率分布的距离,值越小表示学生越接近教师的输出模式。乘以 T2T2 是为了抵消因温度缩放带来的梯度量级变化,保持损失尺度合理。

-

硬损失:

Lhard=CrossEntropy(pT=1,ytrue)Lhard=CrossEntropy(pT=1,ytrue)

学生模型在 T=1T=1 时的输出概率与真实硬标签之间的交叉熵。这保证学生模型不偏离真实分类目标,尤其是在训练初期教师软标签可能有偏差时。

总损失:

L=α⋅Lsoft+(1−α)⋅LhardL=α⋅Lsoft+(1−α)⋅Lhard

其中 αα 是超参数,通常取值 0.7~0.9,强调模仿教师的重要性。

直觉理解:软损失让学生“学得像老师”,硬损失让学生“不犯错”。两者结合,学生既能吸收老师的智慧,又不会脱离任务本质。

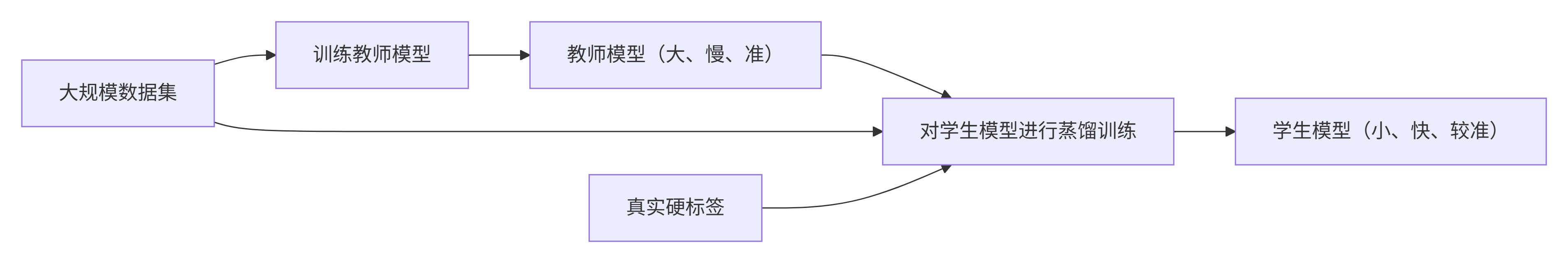

四、知识蒸馏的标准流程

-

准备教师模型:在大规模数据集上训练一个高性能的大模型(如 BERT-large、ResNet-152)。教师模型可以很慢、很大,因为它只用于生成软标签,不直接部署。

-

生成软标签:将训练数据(或额外的无标签数据)输入教师模型,获得软标签(通常存储为文件或实时计算)。

-

训练学生模型:设计一个更小的网络结构(如 6 层 Transformer、MobileNet)。在相同的训练集上,同时使用软标签和硬标签训练学生模型,损失函数为上述组合损失。

-

部署学生模型:学生模型体积小、速度快,精度接近教师模型,可直接用于生产环境。

五、知识蒸馏的常见变体

| 变体 | 描述 | 适用场景 |

|---|---|---|

| 离线蒸馏(Offline) | 教师固定,提前生成软标签或实时计算。 | 标准做法,简单稳定。 |

| 在线蒸馏(Online) | 教师和学生同时训练,教师可以是整个模型的平均或另一个分支。 | 无预训练教师,适合从头开始。 |

| 自蒸馏(Self-distillation) | 同一模型的高层输出作为低层的教师。 | 不需要额外模型,可提升同构网络的性能。 |

| 多教师蒸馏 | 使用多个教师模型的集成软标签。 | 进一步提高学生模型的上限。 |

| 交叉模态蒸馏 | 教师和学生处理不同模态(如教师是图文模型,学生是纯文本模型)。 | 跨模态知识迁移。 |

六、知识蒸馏的代码实现(PyTorch 详细版)

以下是一个完整的蒸馏训练循环示例,包含教师模型加载、学生模型定义、损失函数和训练步骤。

python

import torch

import torch.nn as nn

import torch.nn.functional as F

from torch.utils.data import DataLoader

from transformers import BertForSequenceClassification, BertConfig

# ---------- 1. 加载教师模型 ----------

teacher_model = BertForSequenceClassification.from_pretrained("bert-base-uncased")

teacher_model.eval() # 教师模型不参与梯度更新

for param in teacher_model.parameters():

param.requires_grad = False

# ---------- 2. 定义学生模型(更小) ----------

student_config = BertConfig(

hidden_size=384, # 原768

num_hidden_layers=6, # 原12层

num_attention_heads=6, # 原12头

intermediate_size=1536, # 原3072

)

student_model = BertForSequenceClassification(student_config)

# ---------- 3. 定义蒸馏损失函数 ----------

def distillation_loss(student_logits, teacher_logits, labels, T=4.0, alpha=0.9):

# 软损失:KL散度(学生模拟教师)

soft_student = F.log_softmax(student_logits / T, dim=-1)

soft_teacher = F.softmax(teacher_logits / T, dim=-1)

loss_soft = F.kl_div(soft_student, soft_teacher, reduction='batchmean') * (T ** 2)

# 硬损失:交叉熵(真实标签)

loss_hard = F.cross_entropy(student_logits, labels)

return alpha * loss_soft + (1 - alpha) * loss_hard

# ---------- 4. 训练循环 ----------

optimizer = torch.optim.AdamW(student_model.parameters(), lr=2e-5)

dataloader = ... # 你的 DataLoader

student_model.train()

for epoch in range(epochs):

for batch in dataloader:

input_ids, attention_mask, labels = batch

# 教师模型前向(无梯度)

with torch.no_grad():

teacher_outputs = teacher_model(input_ids, attention_mask=attention_mask)

teacher_logits = teacher_outputs.logits

# 学生模型前向

student_outputs = student_model(input_ids, attention_mask=attention_mask)

student_logits = student_outputs.logits

# 计算蒸馏损失

loss = distillation_loss(student_logits, teacher_logits, labels, T=4.0, alpha=0.9)

optimizer.zero_grad()

loss.backward()

optimizer.step()

print(f"Epoch {epoch}, Loss: {loss.item():.4f}")

# 保存学生模型

torch.save(student_model.state_dict(), "distilled_student.pt")

注意:实际使用时,Hugging Face 提供了预蒸馏模型(如 distilbert-base-uncased),可以直接加载并微调,省去自行蒸馏的过程。

七、知识蒸馏 vs. 其他模型压缩技术

| 技术 | 原理 | 压缩比 | 精度保留 | 推理加速 | 是否需要额外数据 | 实现难度 |

|---|---|---|---|---|---|---|

| 知识蒸馏 | 模仿教师输出分布 | 5-10倍 | >95% | 3-5倍 | 可能需要无标签数据 | 中等 |

| 量化 | 降低数值精度(FP32→INT8) | 4倍 | >98% | 2-3倍 | 校准数据集(可选) | 低 |

| 剪枝 | 移除冗余连接或神经元 | 2-4倍 | 90-95% | 1.5-2倍 | 无 | 中等 |

| 低秩分解 | 将权重矩阵分解为小矩阵乘积 | 2-3倍 | 80-90% | 1.5-2倍 | 无 | 高 |

最佳实践:通常将 蒸馏 + 量化 组合使用,先蒸馏得到一个紧凑模型,再量化进一步减小体积和加速推理,实现 20 倍以上的压缩比,且精度损失可控制在 2-3% 以内。

八、知识蒸馏在大模型时代的应用场景

| 场景 | 教师模型 | 学生模型 | 收益 |

|---|---|---|---|

| 移动端视觉 | ResNet-152 | MobileNetV3 | 模型大小从 200MB 降到 20MB,推理速度提升 10 倍 |

| 边缘端 NLP | BERT-large | DistilBERT / TinyBERT | 体积减少 60%,速度提升 40%,精度保留 97% |

| 代码生成特化 | GPT-4(API) | 7B 开源模型 | 降低 API 成本,实现本地私有化部署 |

| 多模态检索 | CLIP (ViT-L) | 轻量级 Transformer | 在手机端实现实时图文匹配 |

| 对话系统 | ChatGPT (175B) | 6B 模型(如 Alpaca) | 支持离线运行,隐私安全 |

九、进阶技巧与注意事项

9.1 温度 T 的调优

-

T 较小(1~2):软标签接近硬标签,学生主要学习正确分类,适合任务简单或数据充足时。

-

T 较大(4~10):软标签平滑,暗知识丰富,适合复杂任务或学生模型较小时。

-

通常从 T=4 开始尝试,用验证集调整。

9.2 软标签的存储与计算

-

如果教师模型很大,可以预先对训练集生成软标签并存储到磁盘,避免训练时反复前向传播。

-

对于超大数据集,可以动态计算软标签,使用梯度检查点等技术减少内存。

9.3 学生模型架构的选择

-

学生模型不一定非得是教师模型的“缩小版”。例如,教师是 Transformer,学生可以是 CNN 或 RNN,甚至不同模态。

-

学生模型过小时,蒸馏收益有限;过大会失去压缩意义。通常学生参数量为教师的 10%~30%。

9.4 当教师模型不可用时

-

可以使用自蒸馏:让模型自己的深层指导浅层。

-

或者在线蒸馏:同时训练多个模型,相互学习。

9.5 蒸馏的局限性

-

教师模型的质量直接影响学生上限。如果教师有偏见,学生会继承。

-

对于数据分布极不均衡的任务,软标签可能偏向多数类,需要特殊处理。

-

蒸馏无法创造超越教师的知识,只能压缩。

十、总结与展望

知识蒸馏自 2015 年 Hinton 等人提出以来,已成为模型压缩和知识迁移的基石技术。它巧妙地将大模型的理解能力“蒸馏”进小模型,实现了精度与效率的优雅平衡。

核心要点回顾:

-

软标签:教师模型的输出概率分布,蕴含类别间关系。

-

温度 T:控制软标签平滑度,放大暗知识。

-

组合损失:软损失(KL散度)+ 硬损失(交叉熵)。

-

应用广泛:从 BERT 到 GPT,从图像分类到多模态检索。

对于初学者,建议先使用 Hugging Face 的预蒸馏模型(如 DistilBERT、TinyBERT)体验效果;再尝试自定义蒸馏,例如用 BERT-base 蒸馏一个 6 层的学生模型。掌握蒸馏后,你可以进一步学习量化、剪枝,构建高效、轻量的 AI 系统。

思考题:

-

如果教师模型和学生模型的结构完全不同(如 CNN 蒸馏到 MLP),如何设计损失函数?

-

在生成任务(如机器翻译)中,蒸馏应该使用什么样的软目标?是词级别的概率分布,还是序列级别的得分?

欢迎在评论区讨论!

参考文献:

-

Hinton, G., Vinyals, O., & Dean, J. (2015). Distilling the Knowledge in a Neural Network. NIPS 2014 Deep Learning Workshop.

-

Sanh, V., Debut, L., Chaumond, J., & Wolf, T. (2019). DistilBERT, a distilled version of BERT: smaller, faster, cheaper and lighter. arXiv:1910.01108.

-

Gou, J., Yu, B., Maybank, S. J., & Tao, D. (2021). Knowledge distillation: A survey. International Journal of Computer Vision, 129(6), 1789-1819.

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)