python+opencv+TensorFlow肢体检测系统 姿势检测系统 姿态检测识别系统

1、项目介绍

技术栈:

python、opencv、tflite_runtime、TensorFlow、pyqt界面

运行【肢体检测.py】启动

或者输入启动命令:

python 肢体检测.py

tflite_runtime是一个轻量级的Python库,用于在不需要完整TensorFlow库的情况下执行TensorFlow Lite模型,特别适用于在资源受限的设备上执行模型推断的场景。

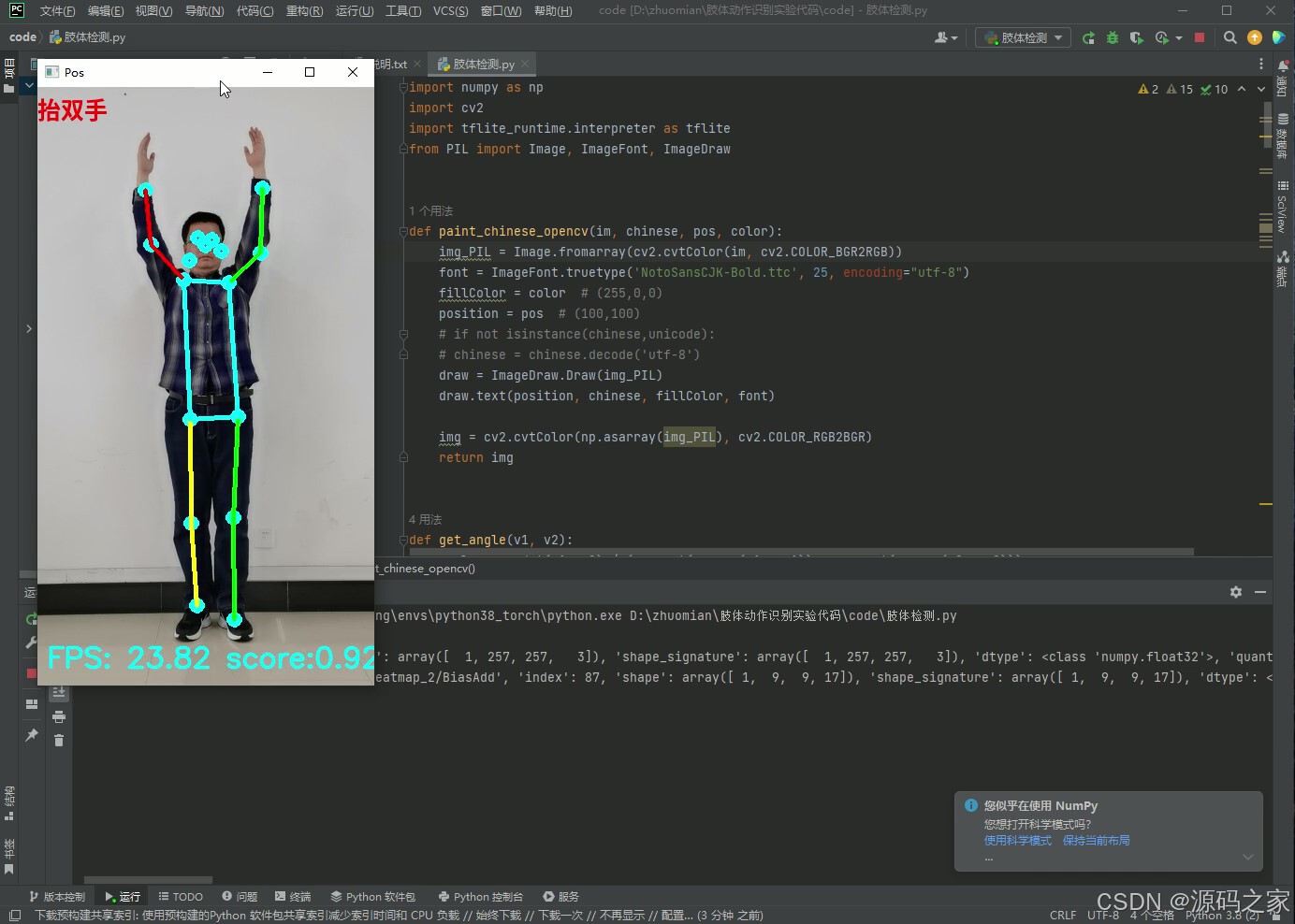

2、项目界面

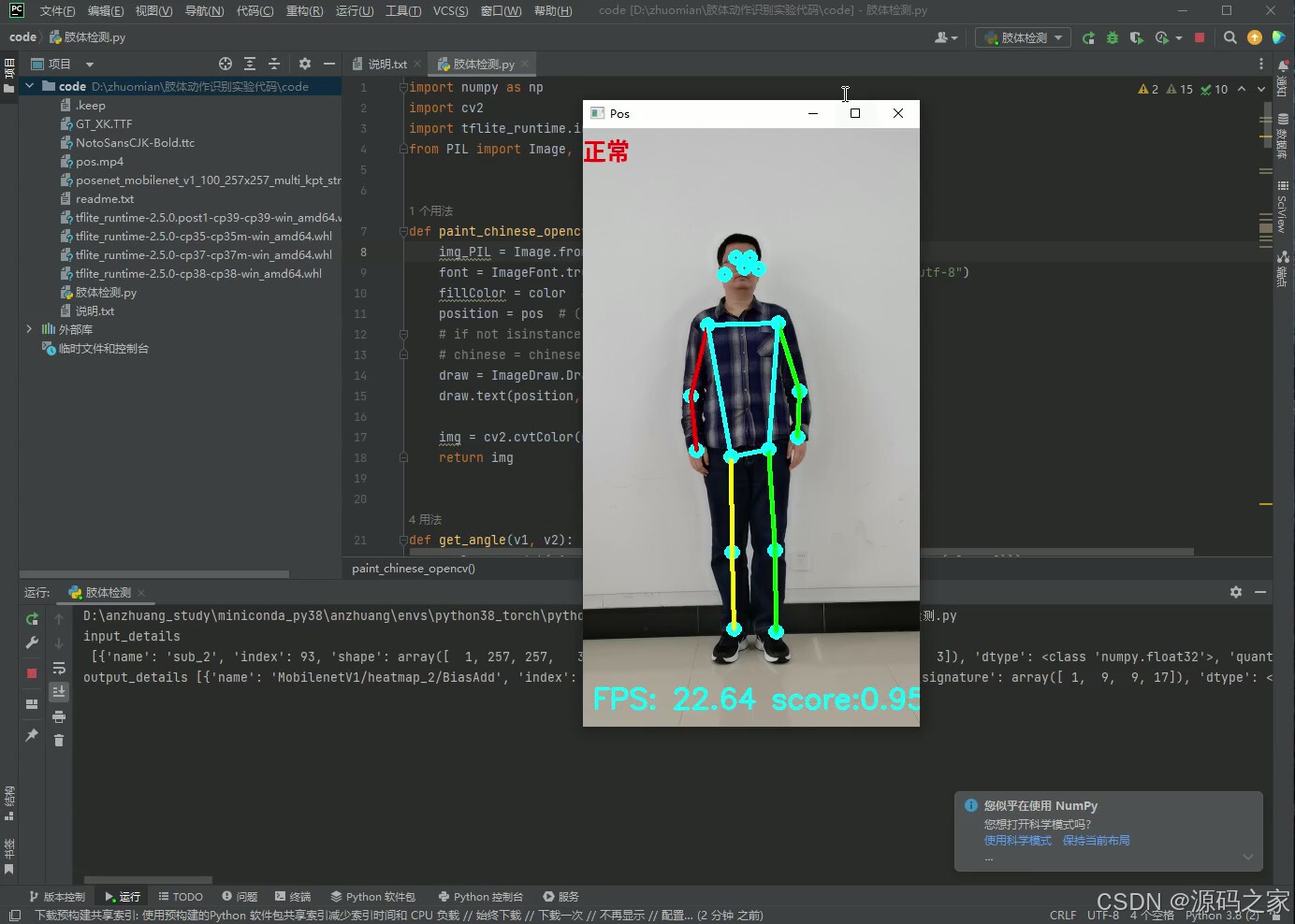

(1)正常–站立

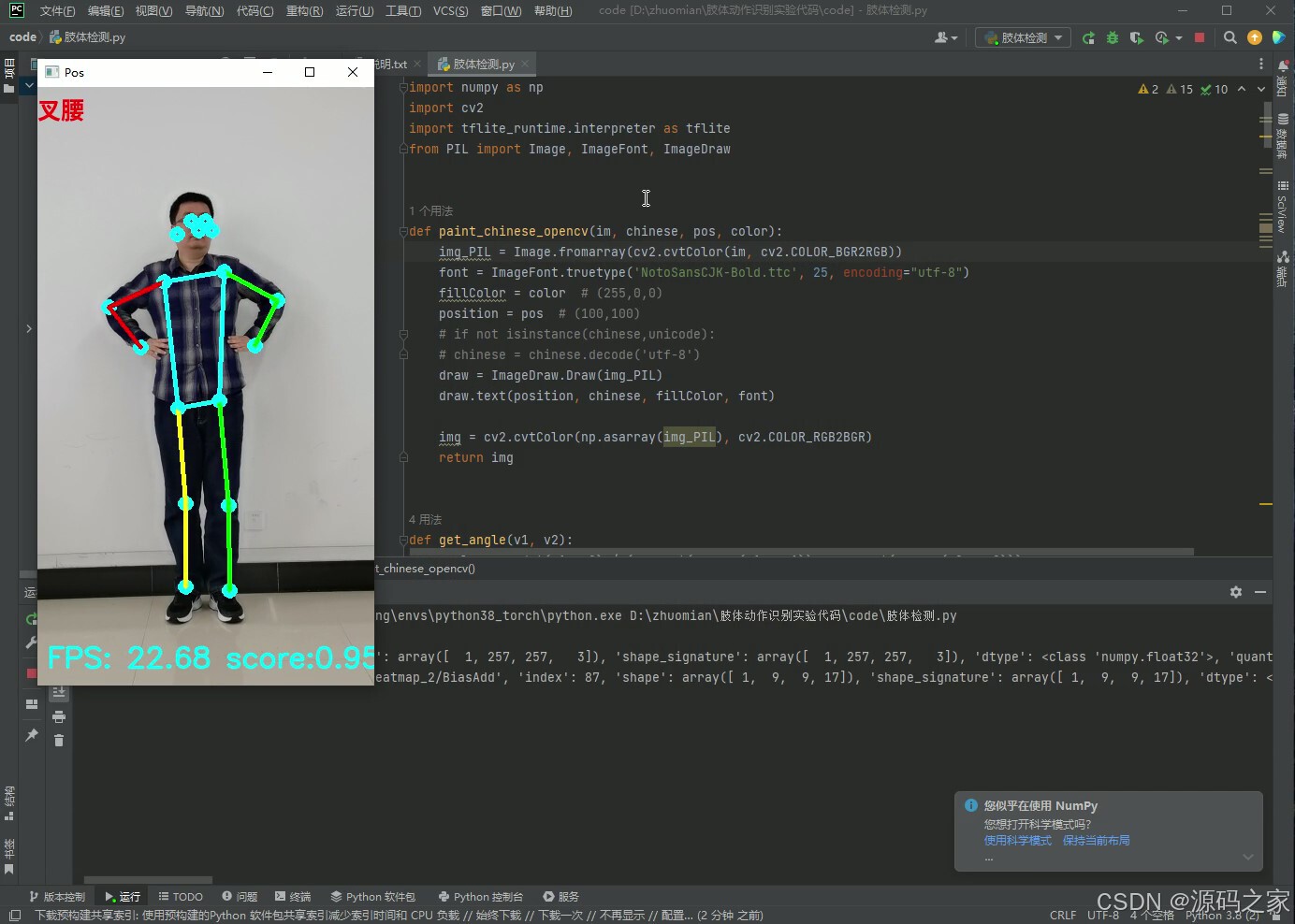

(2)叉腰

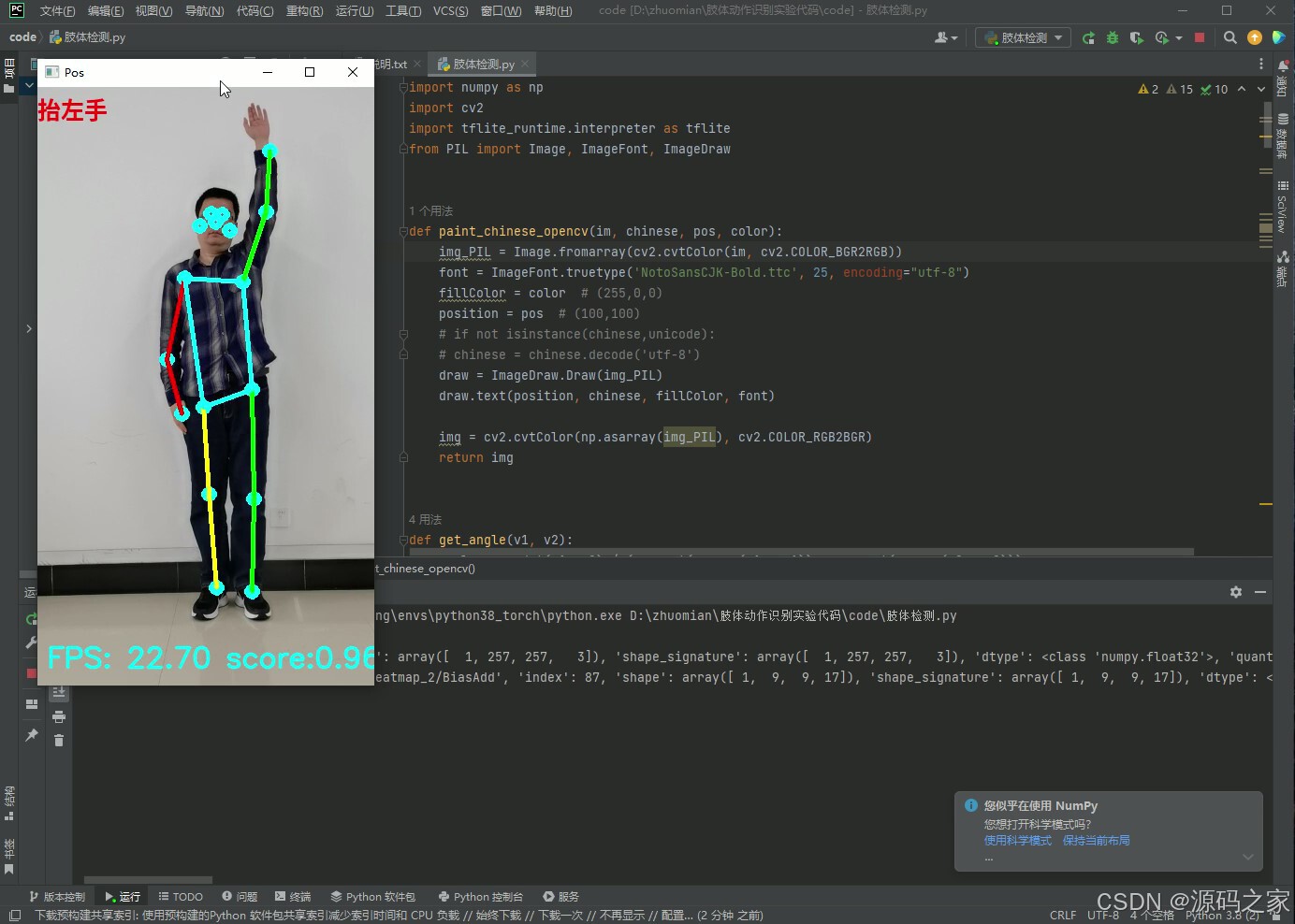

(3)抬左手

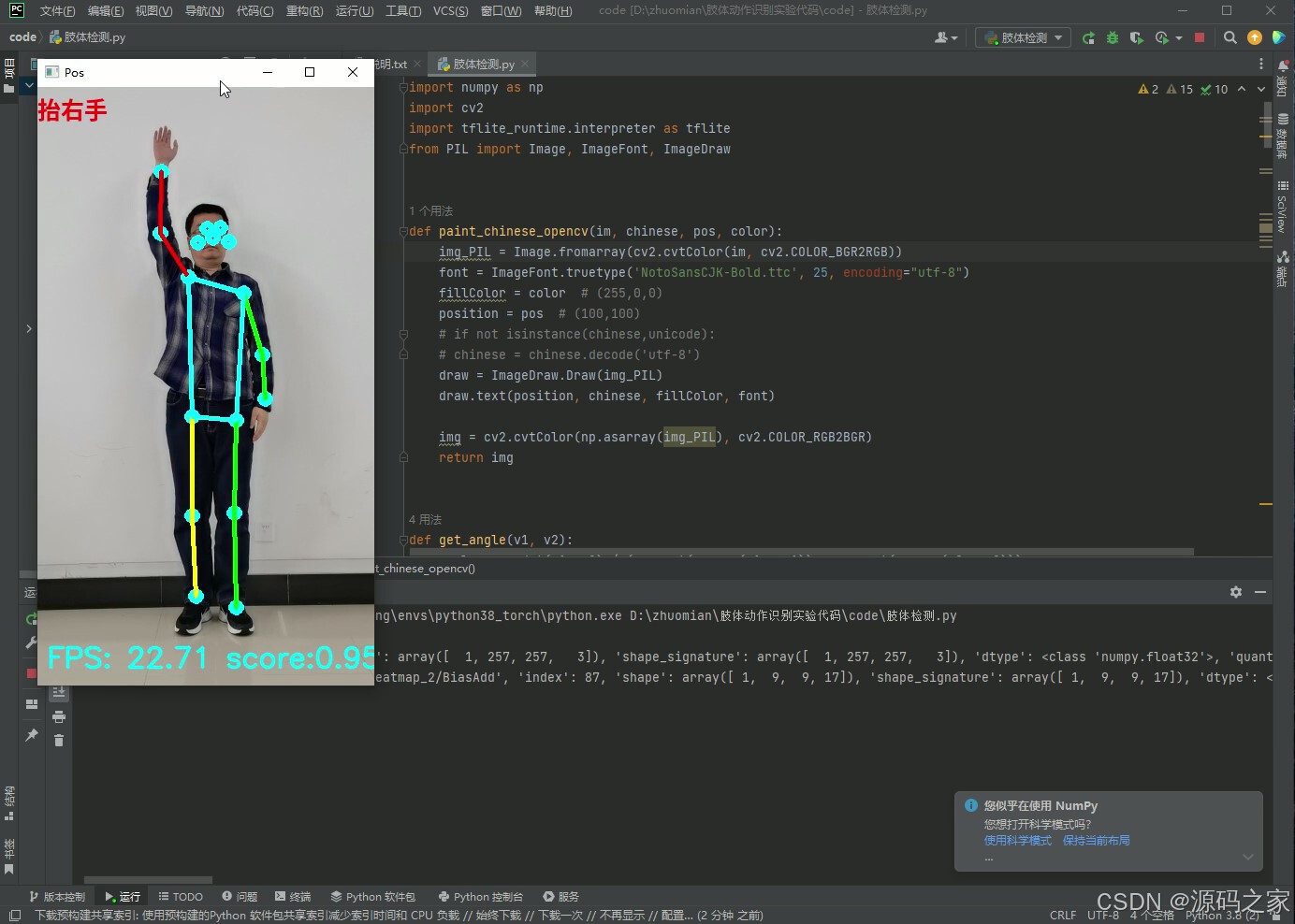

(4)抬右手

(5)抬双手

(6)双手呈三角形姿势

3、项目说明

3、项目说明

项目简介

实时姿态交互演示系统

它用 1 个普通 USB 摄像头,把 TensorFlow Lite 版 MoveNet( lightning, 4.8 MB )跑在 CPU 上,在 720p 画面下依旧保持 35 FPS;再配 PyQt5 图形壳,把“关键点-骨架-动作标签”同步显示,实现“所见即所判”。整套代码 < 600 行,无 GPU、无深度学习环境也能玩,非常适合课堂演示、毕设原型、嵌入式互动屏二次开发。

技术栈

Python ≥ 3.7

OpenCV-Python 负责视频捕获、图像预处理与绘制骨架

tflite_runtime 代替完整 TensorFlow,体积 < 50 MB,树莓派、Jetson Nano、Win10 秒装

MoveNet(TFLite 量化模型)输出 17 个关键点,单帧推断 8 ms

PyQt5 构建多线程界面,主线程刷新画面,子线程跑模型,不卡顿、不丢帧

功能亮点

零硬件门槛

纯 CPU 推理,笔记本即可 35 FPS;模型仅 4.8 MB,内存占用 < 200 MB。

即插即玩

解压后双击“肢体检测.py”自动打开摄像头;无需标注、无需训练,已内置模型。

六种动作实时标签

站立 | 叉腰 | 抬左手 | 抬右手 | 抬双手 | 双手三角,规则+余弦角简单可改,可秒加新动作。

可视化教学友好

骨架线、关键点序号、置信度、FPS 全部叠在画面上,方便老师讲解“关键点→向量→角度→分类”全流程。

跨平台打包

提供 requirements.txt 与 spec 文件,PyInstaller 一键生成 40 MB 独立 exe,U 盘即插即演示。

界面速览

正常站立:绿色骨架,标签“standing”

叉腰:检测肘-腰距离,标签“hands_on_waist”

抬左/右手:计算肩-肘角度,标签“left_up / right_up”

抬双手:双肩角度同步判断,标签“both_up”

双手三角:腕-腕-鼻尖构成三角形,标签“triangle”

应用场景

课堂/实训:1 节课跑通“姿态估计→几何特征→规则分类”完整链路,学生可改两行代码实现“原地开合跳计数”。

互动展项:树莓派 + 大屏,观众摆三角手势自动触发拍照打卡,成本 < 300 元。

毕设跳板:在规则基础上替换为 LSTM/SVM 甚至 Transformer,即可升级为“连续动作识别”或“健身计数 APP”。

项目已在 Gitee 开源,含模型、源码、打包教程。拿走即用,欢迎 Star 和 PR!

4、核心代码

5、源码获取方式

🍅由于篇幅限制,获取完整文章或源码、代做项目的,查看我的【用户名】、【专栏名称】、【顶部选题链接】就可以找到我啦🍅

感兴趣的可以先收藏起来,点赞、关注不迷路,下方查看👇🏻获取联系方式👇🏻

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献14条内容

已为社区贡献14条内容

所有评论(0)