TurboQuant 技术革命:打破大模型私有化部署的显存壁垒,重构主权 AI 的基础设施边界

在大模型技术从通用能力验证走向行业深度落地的今天,隐私合规与数据主权已经成为企业选型 AI 方案的核心红线。对于金融、政务、医疗、高端制造等强监管、高隐私敏感的行业而言,将核心业务数据传输给第三方中心化 AI 服务商(如 OpenAI、Anthropic、DeepSeek),始终存在不可控的合规与安全风险。但过去一年里,无数试图在自有主权基础设施上私有化部署大模型的企业,都撞上了一堵无法绕开的硬墙:GPU 显存的物理上限。

纸面参数亮眼的百亿、千亿参数大模型,一旦进入真实生产环境,面对长上下文窗口、KV 缓存的指数级增长、多用户并发请求的负载,往往无法适配企业级的商用硬件。这道显存壁垒,不仅成为了中心化 AI 服务商的核心竞争护城河,更成为了中小企业拥抱私有化、可控 AI 的最大门槛。

而 Google 最新发布的 TurboQuant 大模型内存压缩技术,正在彻底打破这一僵局。这项针对 LLM 推理核心瓶颈的创新,实现了 KV 缓存内存约 6 倍的压缩、注意力计算最高 8 倍的加速,且无任何可感知的精度损失;在实际业务负载中,可根据模型与工作流的差异,将大模型运行的整体内存需求降低 10% 至 25%。这不仅是一次推理效率的技术突破,更是一次重构私有化 AI 部署边界的行业革命。

一、私有化部署的核心卡点:被 KV 缓存困住的大模型能力

要理解 TurboQuant 的颠覆性价值,首先要厘清大模型推理过程中的显存占用核心矛盾。

长期以来,行业对大模型显存优化的关注,大多集中在模型权重的量化压缩上:从 FP16 到 FP8,再到 INT4、INT2 的低比特量化,核心目标是降低静态的模型权重显存占用,让更大的模型能塞进更小的显卡。但在真实的企业级生产场景中,静态权重早已不是显存占用的唯一瓶颈 —— 甚至在长上下文、高并发的场景下,动态增长的 KV 缓存(Key-Value Cache)才是压垮显存的最后一根稻草。

KV 缓存是 Transformer 架构大模型推理效率的核心设计。在自注意力机制的计算过程中,每生成一个新的 token,都需要复用之前所有 token 的 Key 和 Value 向量。如果每次生成都重新计算,会造成指数级的算力浪费;而 KV 缓存的作用,就是将已经计算完成的 Key 和 Value 向量缓存到显存中,后续推理直接复用,大幅降低计算延迟。

但这个设计带来了一个无法回避的问题:上下文窗口越长、并发用户数越多,KV 缓存的显存占用就会线性增长。举个例子,一个 70B 参数的大模型,INT4 量化后的权重显存占用约 35GB,但当上下文窗口拉到 32K、并发数达到 10 的时候,KV 缓存的显存占用会轻松突破 100GB,远超模型权重本身的占用。这也是为什么很多企业发现,本地能跑通 Demo 的大模型,一到多用户、长上下文的生产环境就频繁爆显存、服务崩溃。

过去,企业要解决这个问题,只有两个选择:要么采购天价的高端 GPU 集群(如 NVIDIA A100/H100 80GB),用硬件堆出显存冗余;要么牺牲上下文长度、限制并发数,阉割大模型的核心能力。而这两个选择,都让中小企业的私有化 AI 部署变得不切实际 —— 前者成本高不可攀,后者完全无法满足业务需求。

二、TurboQuant 的核心突破:无损压缩 KV 缓存,重构推理效率边界

TurboQuant 的核心突破,就在于它精准命中了 KV 缓存这个行业最大的痛点,实现了不损失精度的前提下,对 KV 缓存的极致压缩,同时反向提升了注意力计算的效率。

不同于传统针对静态模型权重的量化技术,TurboQuant 是一套专为 LLM 推理过程中的 KV 缓存设计的动态压缩技术。Google 的技术论文显示,TurboQuant 通过针对 KV 向量的分布特性设计的专属量化算法,在保留注意力计算核心语义信息的前提下,将 KV 缓存的内存占用压缩了约 6 倍,同时让注意力模块的计算速度最高提升了 8 倍。更关键的是,在标准的大模型能力基准测试中,这项技术没有带来任何可测量的精度损失 —— 这意味着企业不需要在模型能力和部署成本之间做任何妥协。

在整体的系统级表现上,TurboQuant 为大模型部署带来了立竿见影的显存优化效果:根据不同的模型架构、量化格式与业务负载,它可以将大模型运行的整体内存需求降低 10% 至 25%。这个数字看似不大,却足以彻底改写私有化部署的硬件边界 —— 对于显存占用已经触达 GPU 物理上限的大模型而言,20% 的显存节省,意味着可以在不升级硬件的前提下,将上下文窗口提升近一倍,或者将并发支持能力提升 30% 以上,这对于生产级应用而言,是质的飞跃。

三、实测验证:TurboQuant 在全量级模型上的落地价值

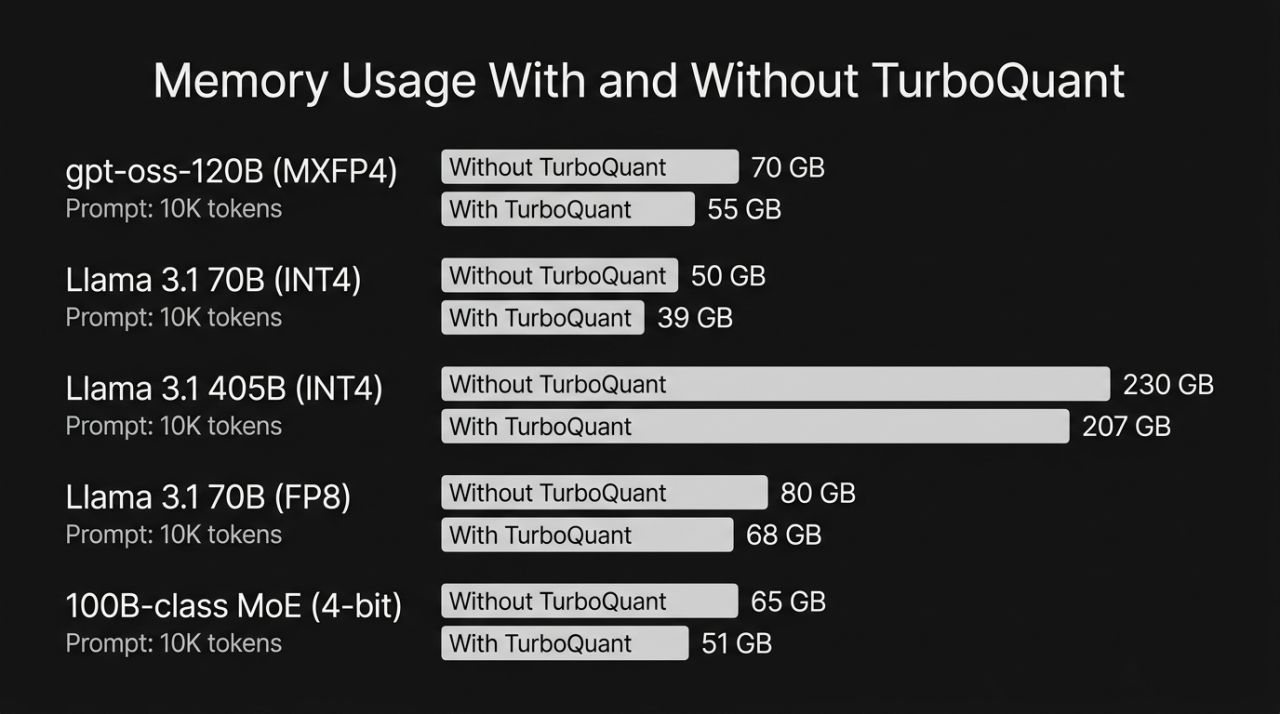

TurboQuant 的优化效果,在不同规模、不同量化格式的大模型上,都得到了实测验证。在 10K tokens 的 prompt 输入场景下,不同模型开启 TurboQuant 前后的内存占用变化,直观展现了这项技术的落地价值:

1. 百亿级参数模型:单卡部署的门槛大幅降低

对于 100B 左右的主流企业级模型,TurboQuant 带来了约 20% 的显存降幅,直接让单卡稳定部署成为可能:

- gpt-oss-120B (MXFP4 量化):未开启 TurboQuant 时,整体内存占用为 70GB;开启后降至 55GB,显存占用降低 21.4%,节省了 15GB 的宝贵显存空间。这意味着原本需要单张 A100 80GB 才能勉强跑通的模型,现在不仅可以在同一张卡上稳定运行,还能预留出足够的显存冗余应对并发请求,甚至可以适配显存更低的消费级旗舰显卡,大幅降低部署的硬件门槛。

- 100B-class MoE 4-bit 量化模型:未开启 TurboQuant 时内存占用 65GB,开启后降至 51GB,降幅达 21.5%。MoE 架构是当下开源大模型的主流方向,其显存占用对 KV 缓存更为敏感,TurboQuant 的优化让这类高能力、低算力需求的 MoE 模型,在中小企业的商用硬件上落地成为可能。

2. 70B 级主流开源模型:生产级负载的能力全面释放

Llama 3.1 70B 是当前企业私有化部署最主流的开源模型,TurboQuant 针对不同量化格式的该模型,都带来了显著的优化效果:

- Llama 3.1 70B (INT4 量化):未开启 TurboQuant 时内存占用 50GB,开启后降至 39GB,降幅 22%。对于这个最常用的企业级模型而言,11GB 的显存节省,意味着单张 A100 80GB 显卡,不仅可以稳定运行模型,还能将上下文窗口从 10K 提升至 32K,同时支持更高的并发数,彻底释放了长上下文 RAG、智能体 Agent 等核心企业级场景的能力。

- Llama 3.1 70B (FP8 量化):未开启 TurboQuant 时内存占用 80GB,开启后降至 68GB,降幅 15%。FP8 量化在保留更高模型精度的同时,原本需要刚好占满单张 A100 80GB 的显存,开启 TurboQuant 后预留出 12GB 的冗余空间,彻底解决了生产环境中并发波动导致的显存溢出崩溃问题,大幅提升了服务的稳定性。

3. 405B 千亿级超大规模模型:打破硬件的物理上限

对于 Llama 3.1 405B 这类千亿参数的超大规模模型,TurboQuant 的价值更是颠覆性的:未开启 TurboQuant 时,INT4 量化下 10K tokens 的内存占用就高达 230GB,意味着至少需要 3 张 A100 80GB 显卡才能勉强部署;开启 TurboQuant 后,内存占用降至 207GB,降幅 10%,节省了 23GB 的显存。

对于千亿级模型而言,10% 的显存降幅,直接改写了部署的硬件门槛:原本需要 4 张显卡才能保障稳定运行的模型,现在 3 张显卡即可实现生产级部署,硬件采购成本直接降低 25%;同时,原本只能支持 10K 上下文的硬件配置,现在可以轻松支持 32K 甚至更长的上下文窗口,让超大规模模型的长文档理解、全业务流程智能体等核心能力,在私有化基础设施上成为可能。

四、行业格局重构:打破中心化壁垒,开启主权 AI 新时代

TurboQuant 的出现,绝不仅仅是一次技术参数的优化,更是一次对 AI 行业格局的重构,它彻底动摇了中心化 AI 服务商的核心竞争壁垒。

过去,中心化 AI 服务商的核心护城河,除了模型能力本身,就是庞大的基础设施投入。只有巨头才能负担起数万张高端 GPU 组成的集群,支撑长上下文、高并发的大模型推理服务;而中小企业要么只能付费使用第三方 API,放弃数据主权,要么只能用能力受限的小模型,无法满足业务需求。这道显存的硬件壁垒,让 AI 行业形成了 “中心化服务为主,私有化部署为辅” 的格局,数据主权始终掌握在少数巨头手中。

而 TurboQuant 这类 KV 缓存优化技术,与持续迭代的开源大模型形成了完美的合力。当下,Llama 3.1、通义千问 Qwen、DeepSeek 等开源模型的能力,已经无限逼近甚至在部分场景超越了闭源的中心化 AI 服务;而 TurboQuant 则解决了这些开源大模型私有化部署的最大痛点 —— 显存门槛。两者结合,真正实现了 “开箱即用的主权 AI”:隐私敏感的中小企业,不需要采购天价的 GPU 集群,不需要将核心业务数据传输给第三方,用现有的商用硬件,就能在自有基础设施上,部署和运行生产级的大模型应用,完全掌控数据与模型的全生命周期。

这对于金融、政务、医疗、高端制造等强监管行业而言,更是革命性的突破。这些行业的核心数据,绝对不能出域,而过去他们只能在 “数据安全” 和 “AI 能力” 之间二选一;现在,TurboQuant 让他们可以同时拥有两者:在完全合规的自有基础设施上,运行千亿参数的超大规模模型,实现长文档审核、合规风控、智能诊疗、研发辅助等核心业务场景的 AI 赋能,真正释放了产业 AI 的潜力。

五、从论文到生产:落地挑战与不可逆的行业趋势

当然,TurboQuant 从论文走向全行业的规模化落地,依然有一段路要走。

目前,这项技术还处于早期的技术验证阶段,Google 的论文已经验证了其核心能力与效果,但要实现全行业的普及,还需要完成更广泛的框架适配与工程化加固。首先,TurboQuant 需要集成到当前主流的大模型推理框架中,包括 vLLM、Hugging Face TGI、NVIDIA TensorRT-LLM 等,这些框架是企业部署大模型的核心基础设施,只有完成原生集成,才能让开发者无需修改代码,即可一键开启优化。

其次,这项技术需要完成全场景的适配验证,包括不同的模型架构(Transformer、MoE、Mamba 等)、不同的量化格式、不同的上下文长度(从 1K 到 1M 超长上下文)、不同的并发负载场景,确保在所有企业级生产场景中,都能保持稳定的优化效果与无损的精度表现。

值得庆幸的是,行业已经展现出了极强的拥抱意愿,目前已经出现了早期的开源实现实验,全球的开发者与厂商都在加速推进这项技术的落地。而从行业的长期趋势来看,这种向着更高效、更低门槛的本地大模型部署的方向,已经不可逆转。

TurboQuant 的出现,也为大模型推理效率优化指明了新的核心方向:从静态的权重优化,走向动态的推理过程全链路优化。过去,行业的显存优化大多集中在静态的模型权重上,从量化、蒸馏到稀疏化,已经接近了物理极限;而推理过程中动态增长的 KV 缓存、注意力计算的冗余,还有巨大的优化空间。TurboQuant 的成功,证明了针对推理过程的动态优化,能带来远超权重优化的系统级收益,这也会成为未来大模型推理优化的核心赛道。

未来,TurboQuant 这类技术,会和权重量化、模型稀疏化、算子优化、分布式推理等技术深度融合,形成全链路的大模型推理优化体系,持续降低大模型的部署门槛。我们可以预见,在不久的将来,千亿参数的大模型,可以在单张消费级显卡上稳定运行,长上下文、高并发的生产级服务,不再需要天价的 GPU 集群;每个企业,甚至每个开发者,都能拥有完全属于自己的、可控的、私有化的大模型。

从本质上来说,TurboQuant 带来的,从来都不只是显存占用的降低,而是 AI 行业权力结构的重构。它打破了中心化 AI 服务商的硬件护城河,为中小企业打开了主权 AI 的大门,让数据主权与 AI 能力不再是不可兼得的选择题。在 AI 技术深度融入千行百业的今天,隐私、可控、自主,已经成为企业 AI 部署的核心诉求。TurboQuant 这类技术的持续迭代,与开源大模型生态的蓬勃发展,正在共同推动 AI 行业从 “中心化的 API 调用时代”,走向 “分布式的主权 AI 时代”,而这,才是 AI 技术真正的民主化。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献45条内容

已为社区贡献45条内容

所有评论(0)