Agentic AI 全栈开发指南:打通构建与生产部署的完整工具链与工程化实践

在 AI 技术从实验室 Demo 走向企业级生产落地的今天,行业正面临一个核心的能力鸿沟:AI 工程师、机器学习工程师精通大模型推理、Agent 逻辑搭建与 RAG 系统构建,却往往缺乏生产级部署、全生命周期运维与工程化管控的能力;而传统开发者、DevOps 工程师熟稔软件交付的全流程规范、CI/CD 自动化与基础设施管控,却对 Agentic AI 的构建链路、上下文管理与模型工程化逻辑陌生。

这种割裂,已经成为 Agentic AI 规模化落地的最大瓶颈。我们正处在一个关键的转折点:是时候彻底打通这条鸿沟了。无论你是前端 / 后端开发者、AI 算法工程师、机器学习工程师、数据工程师还是 DevOps 工程师,都应该具备端到端构建并部署生产级 Agentic AI 应用的能力。而这一切,已经有了成熟的实现路径 —— 一套完整的 Agentic AI 开发者工具链,搭配 DevOps 全流程工程化体系,足以让每一个技术人完成从创意到生产的全链路落地。

一、Agentic AI 时代:从 “能跑通” 到 “能落地” 的核心挑战

Agentic AI,即具备自主规划、多步推理、工具调用与环境交互能力的智能体系统,早已超越了传统单轮对话的聊天机器人范畴。如今的 Agentic 应用,正在深度嵌入企业的业务流程、研发管线、数据处理与自动化工作流中:它可以是 7×24 小时处理企业文档的智能助手,可以是自主完成代码开发、测试、部署的研发自动化机器人,也可以是端到端管控软件交付全流程的智能运维中枢。

但行业的普遍现状是,超过 80% 的 Agentic AI 项目停留在 Demo 阶段。核心原因并非模型能力不足,而是工程化能力的缺失:很多开发者可以用大模型 API 快速搭建一个能完成简单任务的 Agent,却无法解决生产环境中的高并发稳定性、数据安全合规、可观测性、迭代自动化、故障快速恢复等核心问题。AI 构建与 DevOps 部署的能力割裂,让无数优秀的 AI 创意无法真正创造业务价值。

作为兼具 DevOps 背景与 AI 系统构建能力的从业者,我们深刻意识到:Agentic AI 的未来,必然是 “构建 - 部署 - 运维 - 迭代” 全链路的一体化。一个合格的 Agentic AI 开发者,不仅要懂如何搭建智能体,更要懂如何让它在生产环境中稳定、安全、高效地运行。而这一切的起点,就是一套完整、成熟、可落地的 Agentic AI 开发者工具链。

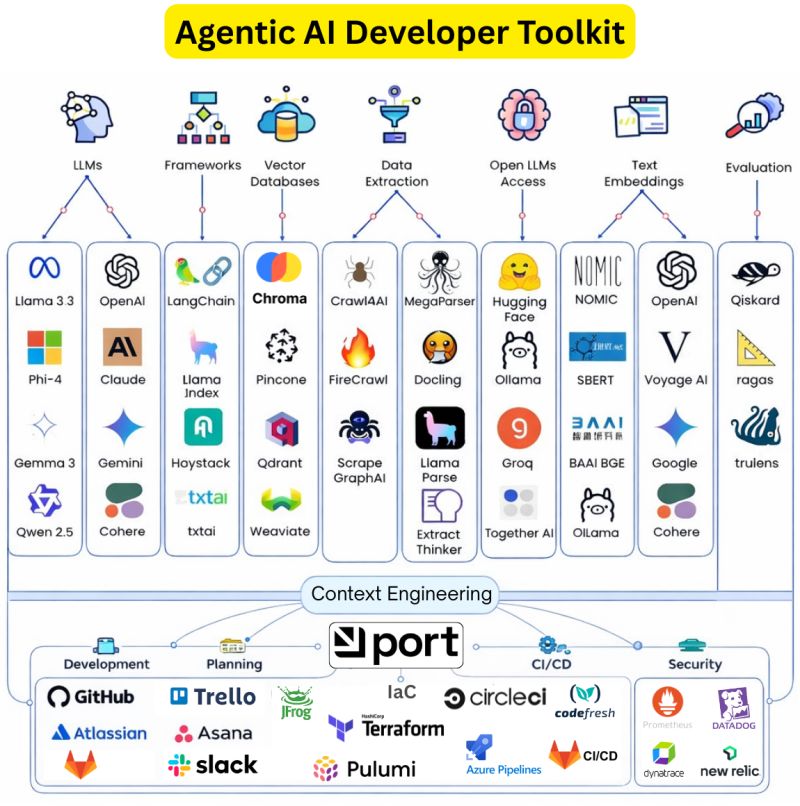

二、Agentic AI 构建全栈工具链:从模型底座到效果评估的完整闭环

一套健壮的 Agentic AI 应用,绝非单一模型的调用,而是多个模块协同工作的完整系统。我们将从底层模型到上层评估,拆解 Agentic AI 构建的全链路工具矩阵,覆盖智能体开发的每一个核心环节。

1. 核心大模型底座(LLMs):Agent 的推理中枢

大模型是 Agentic AI 的 “大脑”,其推理能力、工具调用能力、上下文窗口长度,直接决定了智能体的能力上限。当前开发者拥有完整的闭源 + 开源选型矩阵,可根据业务场景、合规需求与成本预算灵活选择:

- 闭源商用模型:OpenAI、Anthropic Claude、Google Gemini、Cohere,这类模型开箱即用,具备行业领先的多步推理、工具调用与长上下文处理能力,无需 GPU 部署成本,适合快速落地企业级应用;

- 开源可定制模型:Meta Llama 3.3、微软 Phi-4、Google Gemma 3、阿里云通义千问 Qwen 2.5,这类模型支持私有化部署、权重微调与深度定制,可满足企业数据合规、离线运行、场景化优化的核心需求,是生产级私有化 Agent 的首选底座。

2. Agent 开发框架(Frameworks):智能体的骨架与中枢

从零开发 Agent 的规划、记忆、工具调用逻辑,意味着极高的研发成本与重复造轮子。成熟的 Agent 开发框架,封装了智能体运行的核心能力,是开发者搭建 Agent 的核心脚手架:

- LangChain:行业生态最完善的智能体开发框架,支持几乎所有主流大模型、向量数据库与第三方工具,提供了完整的 Chain、Agent、Memory、Tool 封装,适配从简单 Demo 到复杂企业级应用的全场景需求;

- Llama Index:专注于 RAG(检索增强生成)与数据索引优化,擅长处理复杂的私有数据接入与检索逻辑,是知识密集型 Agent 的首选框架;

- Haystack、txtai:兼顾轻量化与企业级能力,支持端到端的 LLM 应用开发,适配高并发生产环境,同时提供了灵活的扩展能力,满足开发者的定制化需求。

3. 向量数据库(Vector Databases):Agent 的长期记忆中枢

Agent 的长期记忆、私有知识检索、历史上下文管理,都依赖向量数据库实现。作为 RAG 架构的核心组件,它解决了大模型的知识时效性差、幻觉频发、无法接入私有业务数据的核心痛点,将非结构化数据转换为向量格式存储,供 Agent 实时精准检索:

- 轻量级开发选型:Chroma,本地部署零门槛,适配快速 Demo 与小型项目开发,是入门级开发者的首选;

- 生产级托管选型:Pinecone、Qdrant,云原生分布式向量数据库,支持高并发查询、弹性扩缩容、多租户隔离,具备完善的企业级特性,是生产级 Agent 的主流选择;

- 多模态场景选型:Weaviate,原生支持多模态数据的向量存储与检索,适配图文、音视频等复杂数据场景的 Agent 开发。

4. 数据提取与处理(Data Extraction):Agent 的外部信息入口

Agent 的能力边界,取决于它能获取的信息质量。真实世界的业务数据,大多以网页、PDF、文档、表格等非结构化形式存在,高质量的数据提取工具,是 Agent 接入外部信息的核心入口:

- 网页数据抓取:Crawl4AI、FireCrawl、Scrape GraphAI,可将复杂网页转换为干净的结构化 Markdown 数据,适配动态网页、登录态页面、反爬场景的抓取,解决了传统爬虫数据噪音大、无法适配 LLM 处理的痛点;

- 文档解析处理:MegaParser、Docling、Llama Parse、Extract Thinker,专门处理复杂格式的 PDF、Word、Excel 文档,支持多栏布局、公式、表格、图片内容的精准解析,是企业内部文档知识库构建的核心工具。

5. 开源大模型访问与推理(Open LLMs Access):开源模型的落地桥梁

开源大模型的能力已经无限逼近闭源模型,但部署、推理、优化的门槛,依然是很多开发者的阻碍。这套工具矩阵,彻底降低了开源模型的使用门槛:

- 模型生态中枢:Hugging Face,全球最大的开源模型仓库,提供了海量的预训练模型、微调脚本与部署工具,是开源 LLM 生态的核心入口;

- 本地一键部署:Ollama,一行命令即可在本地完成主流开源大模型的部署与运行,支持离线调用、多模型切换,适配本地开发与离线场景;

- 云端推理 API:Groq、Together AI,提供高速、低成本的开源大模型推理 API,无需自行部署 GPU 服务器,即可调用 Llama、Qwen、Mistral 等主流开源模型,平衡了开源模型的定制化能力与闭源 API 的低门槛优势。

6. 文本嵌入模型(Text Embeddings):向量检索的质量基石

嵌入模型的质量,直接决定了 RAG 系统的检索准确率,进而影响 Agent 的知识获取能力与回答准确性。开发者可根据场景选择闭源 API 或开源本地化方案:

- 闭源开箱即用方案:OpenAI、Voyage AI、Google、Cohere 提供的嵌入 API,效果稳定、适配性强,无需本地部署,适合快速落地的通用场景;

- 开源本地化方案:NOMIC、SBERT、智源研究院 BAAI BGE,其中 BGE 系列模型是中文场景的标杆,支持本地部署、微调优化,适配企业私有化、合规性需求,是国内生产级 RAG 系统的首选。

7. Agent 系统评估(Evaluation):从 Demo 到生产的质量把关

Agentic AI 应用要走向生产,必须具备可量化、可复现的评估体系。没有完善的评估,就无法定位 Agent 的幻觉、检索错误、工具调用失败等问题,更无法实现稳定的迭代优化:

- RAG 系统专项评估:ragas,专门针对检索增强生成系统设计,提供了检索准确率、回答相关性、幻觉率、上下文忠实度等核心指标的自动化评估,是 RAG 链路优化的核心工具;

- AI 安全与鲁棒性评估:Qiskard,专注于 AI 系统的偏见检测、对抗性测试、鲁棒性验证,可有效规避 Agent 在生产环境中出现有害输出、错误决策等风险;

- 全链路可观测评估:trulens,提供 Agent 推理全链路的跟踪与评估,可可视化展示 Agent 的每一步规划、工具调用、检索过程,快速定位性能瓶颈与逻辑错误,实现 Agent 的全生命周期优化。

三、打通构建与部署的鸿沟:Context Engineering 与 DevOps 全链路工程化

完成 Agent 的逻辑搭建与效果评估,只是生产落地的第一步。真正的核心挑战,是如何让 Agent 在生产环境中稳定运行、自动化迭代、全链路可观测。这就需要我们将 DevOps 的工程化理念,深度融入 Agentic AI 的开发生命周期,通过 Context Engineering(上下文工程),实现 AI 构建与 DevOps 部署的无缝衔接。

Context Engineering 是 Agentic AI 工程化的核心。Agent 的运行,本质是上下文的持续管理与优化 —— 不仅包括业务知识的上下文,还包括代码版本、基础设施配置、部署状态、监控数据、安全策略的全生命周期上下文。而我们需要做的,就是将 Agent 的开发、规划、部署、CI/CD、安全运维全流程,纳入统一的上下文管理体系,让 Agent 不仅能处理业务逻辑,更能自主管理自身的软件交付全生命周期。

基于这套理念,我们搭建了完整的 Agentic AI DevOps 工具链,覆盖软件交付全流程的每一个环节:

1. 开发与版本管理(Development)

代码与配置的版本管理,是所有软件项目的基础,Agentic AI 项目也不例外。GitHub 作为全球最大的代码托管平台,承载了 Agent 代码、Prompt 工程、配置文件、评估脚本的版本管理与团队协作;Atlassian 生态则提供了完善的需求管理、任务跟踪与缺陷管控能力,让 Agent 的开发迭代纳入规范的敏捷研发流程,彻底告别 “脚本式开发、无版本管控” 的混乱模式。

2. 项目规划与协作(Planning)

Agentic AI 的开发是持续迭代的过程,清晰的项目规划与高效的团队协作,是项目落地的核心保障。Trello、Asana 提供了轻量化的敏捷项目管理能力,可将 Agent 开发的需求拆解为可落地的任务,跟踪迭代进度;Slack 作为团队沟通中枢,可与 Agent 深度集成,实现开发进度推送、任务告警、智能问答的闭环;JFrog 则提供了企业级制品管理能力,统一管理 Agent 的模型权重、依赖包、容器镜像,保障构建产物的一致性、安全性与可追溯性。

3. 基础设施即代码(IaC)

生产级 Agentic AI 应用的部署,依赖稳定、可复现的基础设施。手动配置的服务器、数据库、网络环境,必然会出现 “本地能跑、生产跑不起来” 的环境不一致问题。IaC(基础设施即代码)的核心价值,就是将基础设施的配置代码化、版本化,实现基础设施的自动化部署与一致性管控。

- Terraform 作为行业标杆,采用声明式语法,支持几乎所有主流云厂商,可一键定义 GPU 服务器、Kubernetes 集群、向量数据库实例、网络安全策略等云资源,实现基础设施的跨云统一管理;

- Pulumi 则支持用 Python、Go、TypeScript 等通用编程语言编写基础设施配置,对 AI 开发者更加友好,无需额外学习专属语法,即可实现 Agent 部署基础设施的自动化与可复现。

4. 持续集成 / 持续部署(CI/CD)

CI/CD 是打通 Agent 构建与部署的核心桥梁,它将代码提交、测试、构建、部署的全流程自动化,彻底解决人工部署的低效、易错、不可复现问题。基于 CircleCI、Codefresh、GitLab CI/CD、Azure Pipelines 等工具,我们可以为 Agentic AI 项目搭建完整的自动化流水线:开发者提交 Agent 代码到 GitHub 后,流水线自动触发,依次执行单元测试、安全性扫描、Agent 效果自动化评估、容器镜像构建、制品仓库推送、测试环境自动部署、回归测试验证,最终完成生产环境的灰度发布。这套流水线,让 Agent 的每一次迭代都可追溯、可验证、可回滚,实现了从代码提交到生产部署的全流程无人值守,彻底打通了 AI 开发与生产部署的最后一公里。

5. 监控与安全管控(Security)

Agentic AI 应用上线后,全链路的可观测性与安全管控,是生产稳定运行的核心保障。Prometheus+Grafana 作为开源监控的标配,可实时监控 Agent 的 API 调用延迟、大模型推理成功率、向量数据库查询性能、GPU 资源使用率等核心指标,设置告警阈值实现故障的快速响应;Datadog、New Relic、Dynatrace 则提供了全栈可观测性能力,从应用性能、基础设施状态到用户体验,端到端跟踪 Agent 的运行状态,快速定位生产环境的性能瓶颈与故障。同时,完善的安全工具链,可实现 Agent 的访问控制、数据加密、合规审计、漏洞扫描,保障企业数据不泄露、Agent 不被恶意攻击,满足行业合规要求。

四、全链路统一管控:Port 平台与 MCP 协议的自动化革新

当我们拥有了完整的 Agent 构建工具链与 DevOps 工程化体系,下一个核心问题就是:如何将这些分散的工具、系统、数据串联起来,实现真正的 Agentic Workflows 全自动化?答案就是 Port 平台与 MCP(Model Context Protocol)协议的结合。

MCP 协议是专为大模型设计的上下文交互协议,它提供了标准化、安全的方式,让大模型可以访问外部工具、数据系统与业务流程,彻底解决了 Agent 工具调用的碎片化、安全性差的问题。而 Port 作为统一的开发者门户平台,正是串联所有能力的核心中枢 —— 它可以对接所有的 SDLC 工具、MCP 服务器与 AI Agent 工具链,实现全链路的上下文统一管理与自动化管控。

通过 Port 平台,我们可以实现真正的 Agentic SDLC 自动化:你可以让 Agent 自主读取 Jira 的需求任务,自动生成代码并提交到 GitHub,触发 CI/CD 流水线完成构建与测试,自动查看生产环境的监控数据,根据性能指标自动调整基础设施的扩缩容策略,全程无需人工干预。所有工具的上下文、数据、权限,都通过 Port 平台统一管理,无需在数十个工具之间来回切换,真正释放了 Agentic AI 的自动化潜力。

五、端到端落地实践:用完整工具链搭建生产级 Agentic 应用

基于上述全栈工具链,我们可以梳理出一套可复制的生产级 Agentic AI 应用落地路径,让每一个开发者都能完成从构建到部署的全流程操作:

- 需求定义与模型选型:明确 Agent 的核心业务场景与能力边界,根据合规需求、成本预算与性能要求,选择适配的大模型底座;

- 数据处理与知识库构建:通过数据提取工具完成业务数据的抓取与解析,选择适配的嵌入模型生成向量,存入向量数据库,搭建高准确率的 RAG 知识库;

- Agent 逻辑开发:基于 Agent 开发框架,搭建智能体的规划、记忆、工具调用核心逻辑,集成业务所需的外部工具与 SDLC 系统 API;

- 效果评估与迭代优化:通过专业评估工具,完成 Agent 的准确率、幻觉率、安全性、鲁棒性的全维度测试,根据评估结果优化 Prompt、检索策略与 Agent 逻辑;

- 基础设施代码化:通过 IaC 工具定义生产环境所需的云资源,实现基础设施的可复现、可版本管控;

- CI/CD 流水线搭建:搭建自动化交付流水线,实现代码提交后的自动测试、构建、部署全流程自动化;

- 生产部署与监控运维:将 Agent 部署到生产环境,搭建全链路可观测体系,设置告警策略,保障生产环境的稳定运行;

- 全链路自动化管控:通过 Port 平台对接所有工具与 MCP 服务器,实现 Agent 对 SDLC 全流程的自主管控,完成真正的 Agentic Workflows 落地。

六、Agentic AI 的未来:开发能力的民主化与工程化的标准化

我们正处在 AI 工程化的关键拐点。过去,AI 开发与 DevOps 是两个完全独立的领域,能力的鸿沟让很多开发者无法将 AI 创意落地为生产级应用。而今天,这套完整的 Agentic AI 开发者工具链,已经彻底打破了这种壁垒。

未来,Agentic AI 的开发门槛会持续降低,工程化能力会持续标准化。无论你是专注于业务逻辑的应用开发者,还是深耕模型优化的 AI 工程师,亦或是精通基础设施的 DevOps 工程师,都可以通过这套工具链,端到端完成生产级 Agentic AI 应用的构建与部署。

更重要的是,Agentic Workflows 会深度重塑软件研发的全流程。从需求分析、代码开发、测试验证,到部署运维、迭代优化,软件交付的每一个环节,都可以被 Agentic AI 自动化。而我们要做的,就是掌握这套完整的工具链与工程化方法论,提前拥抱这个 AI 驱动的研发新时代。

如果你也关注 Agentic AI 的工程化落地,希望探索如何通过 Agentic Workflows 实现软件交付全流程的自动化,欢迎一起交流探讨,共同推动 Agentic AI 从 Demo 走向规模化生产落地。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献39条内容

已为社区贡献39条内容

所有评论(0)