World2Act:基于技能组合世界模型的潜行为后训练研究

26年3月来自阿联酋MBZUAI的论文“World2Act: Latent Action Post-Training via Skill-Compositional World Models”。

世界模型(WM)已成为一种很有前景的视觉-语言-动作(VLA)策略后训练方法,旨在提高系统在环境变化下的鲁棒性和泛化能力。然而,大多数基于WM的后训练方法依赖于像素级监督,这使得策略对像素级伪影以及不完善的WM展开导致的幻觉非常敏感。World2Act,一个后训练框架,使用对比匹配目标将VLA动作直接与WM视频动态潜信息对齐,从而降低对像素的依赖性。后训练性能与展开质量密切相关,但当前的WM难以处理任意长度的视频生成,因为它们大多是在固定长度的视频片段上训练的,而机器人的执行时长变化很大。为了解决这个问题,提出一种基于LLM的自动技能分解流程,该流程将高级指令分割成低级提示。流程生成 RoboCasa-Skill 和 LIBERO-Skill,支持在不同任务周期内保持时间一致性的技能组合工作记忆。实证研究表明,将 World2Act 应用于 GR00T-N1.6 和 Cosmos Policy 等VLA上,在 RoboCasa 和 LIBERO 上取得最先进的结果,并将实际性能提高6.7%,增强具身智体的泛化能力。

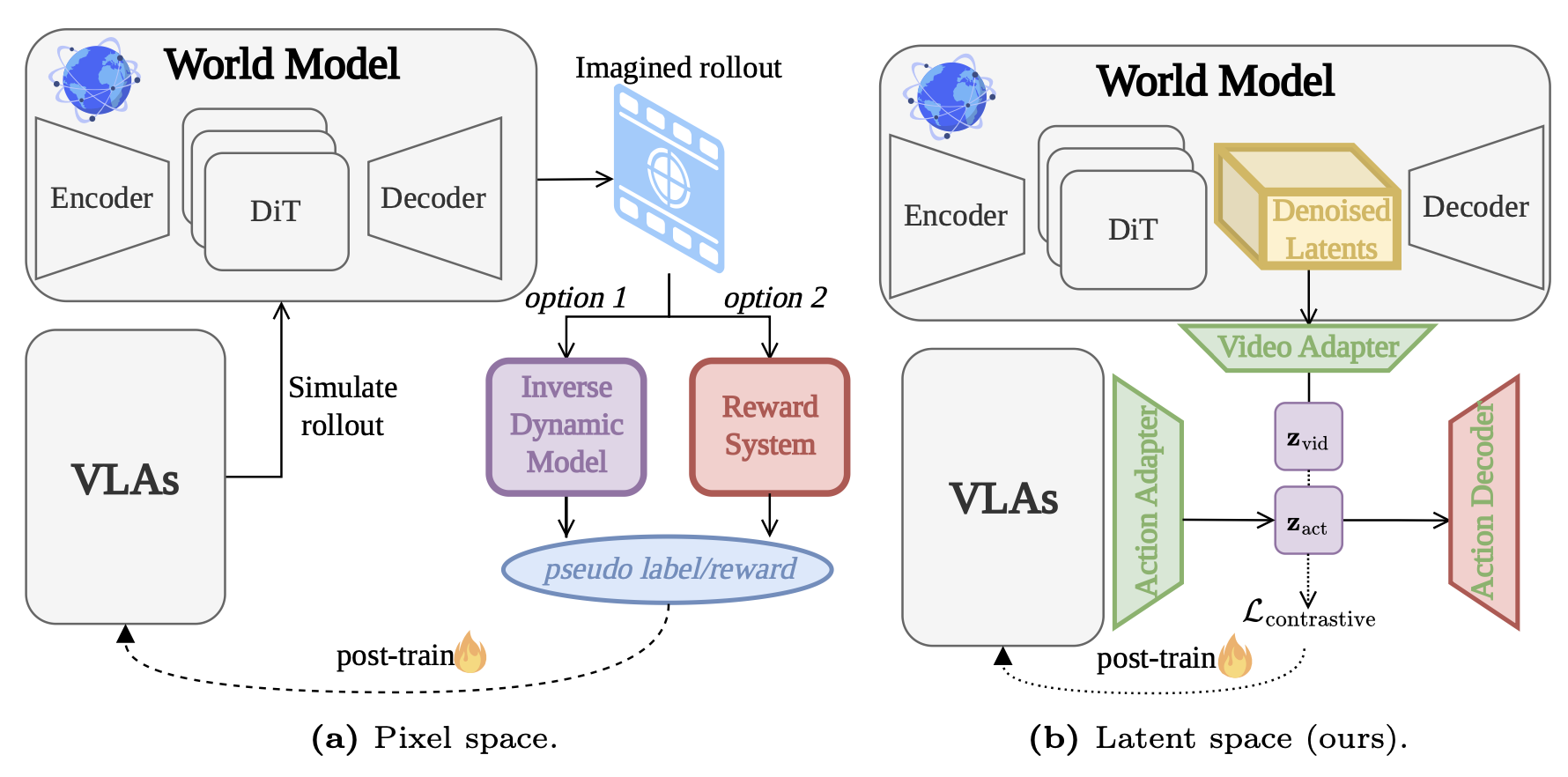

以往的后训练工作[31,51]主要针对通过逆动力学模型(IDM)[27]或奖励信号[20]实现像素到动作的监督。然而,世界模型(WM)的标签或奖励受到WM训练分布的限制[13]。具体而言,当WM生成非流形轨迹或接触不一致时,像素空间展开会放大训练信号中的噪声和幻觉,尤其是在较长的时间范围内[39]。像素空间中的这种幻觉会损害VLA策略的性能,因此需要更可靠的训练后方法。

来自WM的视频潜信息捕捉丰富的、可迁移的行为动态[15,55],因此为将知识从WM迁移到VLA提供一种比像素更灵活的替代方案[3]。以往将潜视频映射到动作的工作主要侧重于统一的视频-动作表示,例如UWM[62]和Cosmos-Policy[30]。然而,这些统一框架通常利用过高维的联合嵌入空间,这可能会破坏训练过程的稳定性[21]。为了兼顾两者的优势,其利用世界模型(WM)的潜空间对VLA进行后训练。与以往基于WM的后训练方法在像素空间中细化动作不同,该方法通过对比损失将策略的动作特征与工作记忆的视频动态潜在特征对齐,从而降低对工作记忆展开中像素级幻觉的敏感性,如图所示。

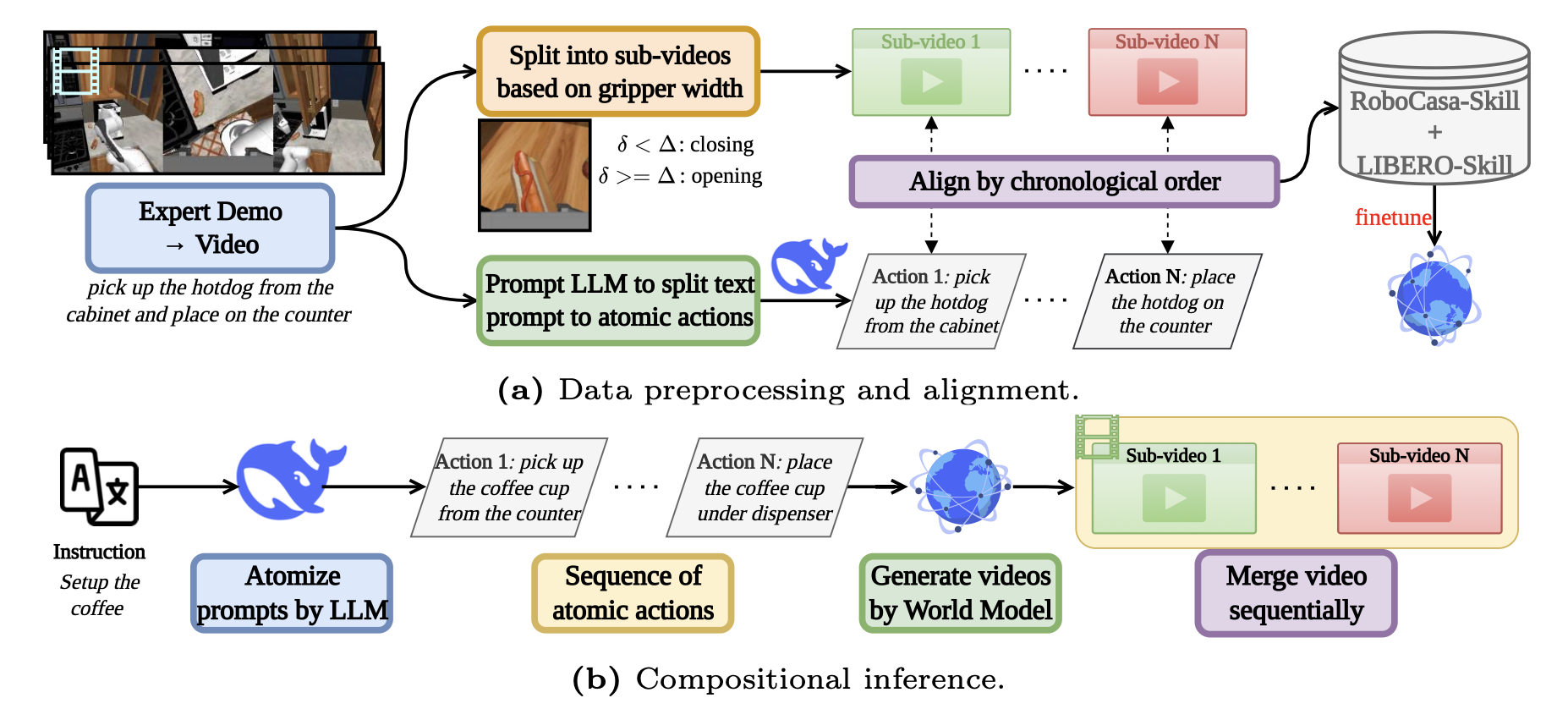

在机器人操作领域,视频生成规模化面临的主要障碍之一是支持任意长度的执行。机器人任务的持续时间差异很大,而大多数视频扩散模型都经过训练以生成固定长度的片段[23]。本文通过技能组合世界模型来应对这一挑战,该模型通过将行为分解为短小的原子动作片段来生成任意长度的行为。并非一次性对整个多步骤任务进行建模,而是将其表示为一系列有序的技能,从而减少长度差异,并使训练和推理更加一致。

技能组合视频生成如图所示。(a) 数据处理。根据机械臂状态变化对每个演示进行分割,并使用 LLM 将指令分解为原子技能提示。(b) 推理流程。LLM 首先生成一个有序的原子提示列表,微调后的WM利用该列表为每个技能生成一个子视频。子视频拼接起来得到最终视频。

如图(a)介绍数据处理。对于视觉流,根据机械臂的夹持器开口大小来识别交互边界。令 w_t 表示 t 时刻的机械臂夹持器宽度,w_0 表示在episode开始时标定后的完全打开宽度。将闭合信号定义为 δ_t = w_0 − w_t,其中 δ_t ≈ 0 表示机械臂夹持器保持完全打开状态,而更大的值则表示增加的闭合度。为了分割演示,将每一帧分类为事件 E_t ∈ {接触, 非接触},如果 δ_t ≥ ∆,则 E_t = 接触,否则为非接触。每个子视频片段都用于捕获一个完整的动作周期:从非接触帧开始,到接触事件结束。对于语言流,用 DeepSeek [17] 将每个全局的高级指令分解为有序的低级技能描述列表。最后,按时间顺序将每个动作片段与其对应的低级提示同步。这样就产生两个短视域子视频数据集,每个数据集都包含原子语言命令:RoboCasa-Skill 和 LIBERO-Skill。

视频片段与提示之间的精确匹配对于训练可靠的世界模型至关重要。其对对齐质量进行基准测试,并证明分解过程能够产生更一致的视频长度分布,从而缓解原始数据集中常见的长尾问题。

其流程在 RoboCasa-Skill 数据集上实现 96.2% 的同步率(定义为分割的子视频数量与生成的原子提示之间成功一对一匹配的比率),在 LIBERO-Skill 数据集上实现 86.9% 的同步率,这表明视频片段和语言片段之间具有很高的对齐率。不常见的失败主要是由于机械臂抓取器或非抓取交互(例如使用机械臂关门)产生的罕见噪声[42]造成的。具体而言,RoboCasa-Skill 的中位数附近密度增加 17%,LIBERO-Skill 的中位数附近密度增加 72%,这表明更大比例的训练片段落在均匀的时间范围内。这种集中分布形成一个一致的时间范围,从而降低分布方差,并稳定了任意长度视频生成的学习动态。

如图(b)展示基于技能的自回归推理流程。给定一条全局指令,首先使用 DeepSeek 生成一个有序的原子技能提示列表。然后,视频扩散世界模型为每个底层技能提示生成一个子视频。为了保持时间连续性,生成过程按顺序进行:用当前子视频的最后一帧作为下一个子视频的初始视觉条件。生成所有技能后,将生成的子视频连接起来,得到一个完整的、高层任务的视频。

虽然技能组合WM能够成功地为操作任务合成连贯的视觉规划,但它完全在像素域中运行。它理解应该发生的行为动态,但并不输出控制机器人如何运动的控制信号。为了将这些丰富的、动态的视觉先验转化为可操作的控制,需要一种机制来连接WM和运动策略。

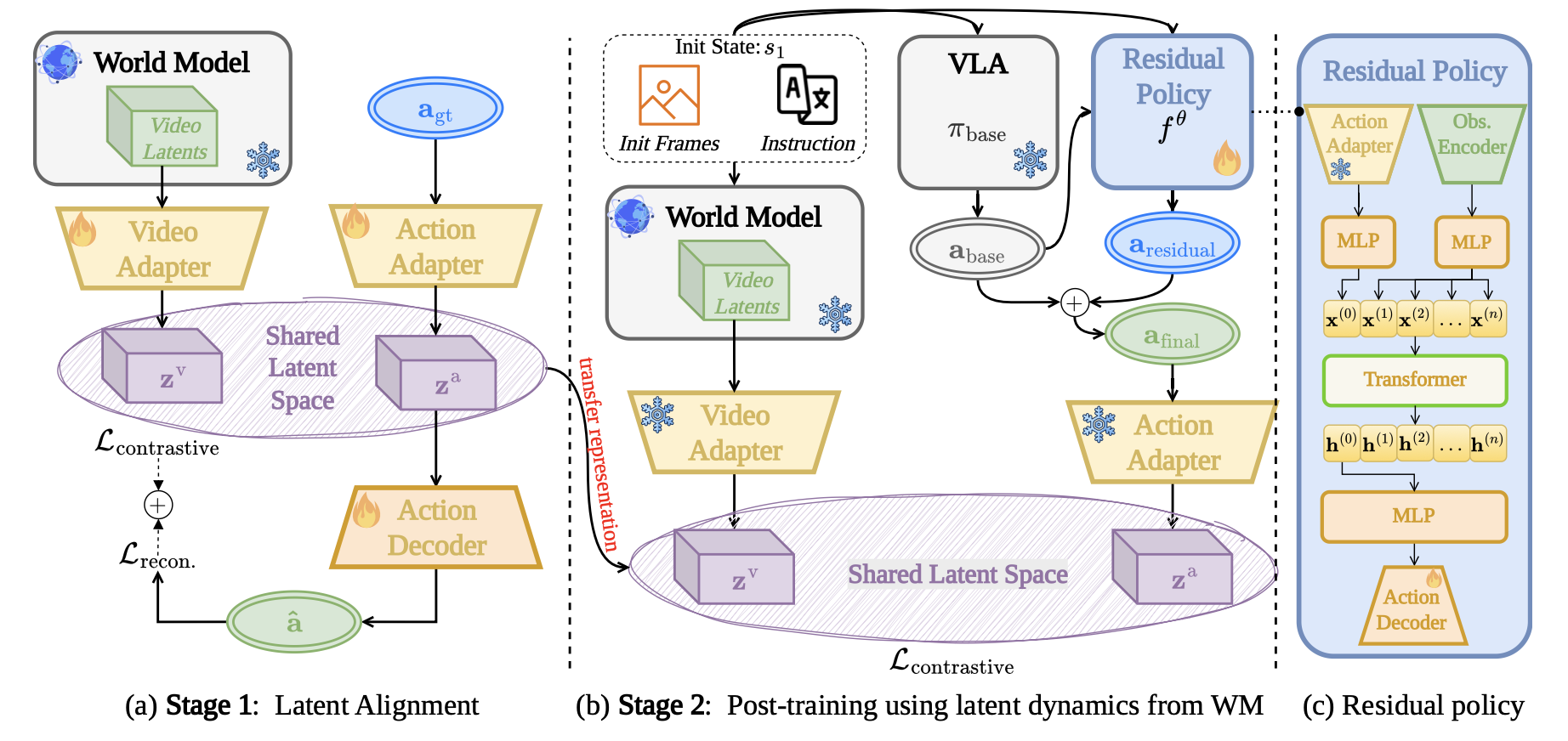

World2Act 是一种后训练方法,它将可泛化的动态先验信息从世界模型 (WM) 迁移到视觉-语言-动作 (VLA) 策略。如图所示,方法分两个阶段进行:i) 通过桥接适配器学习一个共享的潜空间,该空间将视频动态与机器人动作对齐;ii) 通过优化由该对齐空间指导的残差策略来对 VLA 进行后训练。

第一阶段

第一阶段的目标是弥合世界模型预测的视觉动态与机器人动作之间的表征差距。利用预训练的、技能组合的世界模型,并严格冻结它以保持其时间一致的动态先验。

有两个适配器:一个基于卷积神经网络(CNN)的视频适配器将视频提取的潜向量投影成一系列视频嵌入;一个基于多层感知器(MLP)的动作适配器将原始机器人动作分组到 M 个连续帧的非重叠窗口中,以对齐两种模态的时间分辨率。在每个窗口内,它将 M 个动作向量连接成一个块向量,保留机器人的高频控制变化,例如快速关节运动。然后,将连接后的块表示编码成块级动作潜变量。

用两个训练目标联合优化适配器。首先,为了确保动作潜信息保留有意义的运动学和时间动态,基于多层感知器 (MLP) 的动作解码器将动作潜变量中的每个潜块映射到 M 个帧级动作向量,并展开这些向量以获得重构的动作序列。使用标准的均方误差 (MSE) 损失函数来监督这一过程。

其用双向 InfoNCE 损失函数 [38] 来对齐视频和动作动态,该损失函数通过最大化模态间的互信息来有效地捕捉潜任务语义。一个关键的设计选择是对比单个全局轨迹嵌入,还是在每个时间块上对齐表征。采用分块对齐,以鼓励整个轨迹上的对应关系,并减少模型使用粗略的任务标识或背景线索而非细粒度的时间动态来匹配序列的捷径解决方案。对于每个锚框,抽取 B 个负样本(批内抽取),包括:i) 来自不同原子技能的简单负样本,以及 ii) 来自同一技能其他演示的困难负样本,以防止表征崩溃。

训练完成后,视频和动作适配器诱导出一个共享的、对齐的潜空间;然后冻结适配器,并使用该空间来指导第二阶段的训练。

第二阶段

受 Silver [43] 的启发,直接微调参数化程度高的 VLA 骨干网络效率极低,且极易发生灾难性遗忘 [40]。因此,冻结基础 VLA 模型,并通过引入残差策略,学习一个轻量级的残差校正,该校正由第一阶段的跨模态对比损失引导。该策略在保持高样本效率的同时,保留 VLA 的通用任务知识。

核心思想是训练一个残差策略,使 VLA 的动作潜变量向WM的动态先验靠拢。这种设计使得目标函数无需奖励,仅需在当前增强策略下进行策略内展开,而无需环境成功或奖励信号。

在架构上,残差策略使用 CNN 对图像观测数据进行编码,并使用 MLP 对机器人本体感觉数据进行编码,从而生成潜token。同时,基础动作块通过冻结动作适配器获得动作token。将动作token和观测token连接起来,并使用自注意 Transformer 对其进行处理,以获得上下文特征。最后,映射到多层感知器 (MLP),然后通过动作解码器 来预测残差动作。

为了获得目标视觉动态信号,用世界模型生成视频潜特征,条件取决于展开初始化。用潜特征而不是视频展开,因为世界模型提取的潜特征提供动态先验的紧凑表示,即使像素级合成不完美或出现伪影,该表示仍然有效。接下来,冻结的视频适配器将视频潜特征投影到视频动态嵌入中,将其用作当前策略动作嵌入的目标。同时,将组合动作通过冻结的动作适配器进行映射,以获得相应的动作嵌入。

最后,计算两个嵌入在 B 个并行环境中的对比损失,以获得残差网络的训练信号:来自同一环境的潜变量构成正样本对,而来自不同初始条件但相同任务的展开则作为负样本,类似于第一阶段定义的硬负样本。通过最小化此对比目标来更新残差策略,并将视频和动作潜变量与先前预训练的共享潜空间对齐。

实验设置

用两个标准的机器人操作基准测试集 RoboCasa [36] 和 LIBERO [33] 进行评估,并将平均成功率 (SR) 作为主要指标。

遵循标准协议 [30,33,36],在 5 个种子点上对每个种子点进行 50 次试验,并报告平均成功率,以便与其他方法进行公平的比较。

基线。将方法与最新的 VLA 数据集进行比较,包括 π0 [7]、π0.5 [25]、UVA [32]、Rethink-VLA [47]、UWM [62]、UniVLA [8]、OpenVLA-OFT [29]、Cosmos Policy [30] 以及 GR00T 系列(N1.5 [6] 和 N1.6 [16])。为了评估训练后处理的效果,还将方法与 DreamGen [27]、VLA-RFT [31] 和 Ctrl-World [20] 进行比较。为了公平比较,在相同的强大骨干网络 GR00T-N1.6 [16] 和 Cosmos Policy [30] 之上实现 World2Act 和其他后训练方法。由于 GR00T-N1.6 是在混合来源的跨具身数据 [37] 上进行预训练的,其总体行为不一定与 RoboCasa/LIBERO 任务分布一致。因此,额外在每个模拟器上使用 1000 条专家轨迹对其进行微调,以获得一个与任务对齐的参考模型,将其记为 GR00T-N1.6-ft。为了确保一致性和可复现性,所有基线模型均在单个 NVIDIA RTX 4090 (24GB) 显卡上进行评估。

后训练数据合成。为了生成后训练数据,为每个模拟器合成 1000 条轨迹。值得注意的是,后训练轨迹是在与测试场景完全不相交的场景中采集的,以避免数据泄露。用技能组合世界模型生成这些轨迹,该模型通过组合原子技能片段来生成多步骤执行。对于WM骨干网络,考察四个候选模型:Hunyuan 1.5 [48]、Wan-2.2 [45]、LTX-Video [22] 和 Cosmos-Predict2 [2];并基于对物理对齐和指令跟踪的全面评估选择 Cosmos-Predict2。用8个AMD Instinct MI210 GPU(48GB)在RoboCasa-Skill和LIBERO-Skill数据集上对Cosmos-Predict2进行微调。在接下来的实验中,将此模型称为Skill-WM,并将其与在原始未分割数据集上训练的Base-WM进行比较。

真实机器人实验

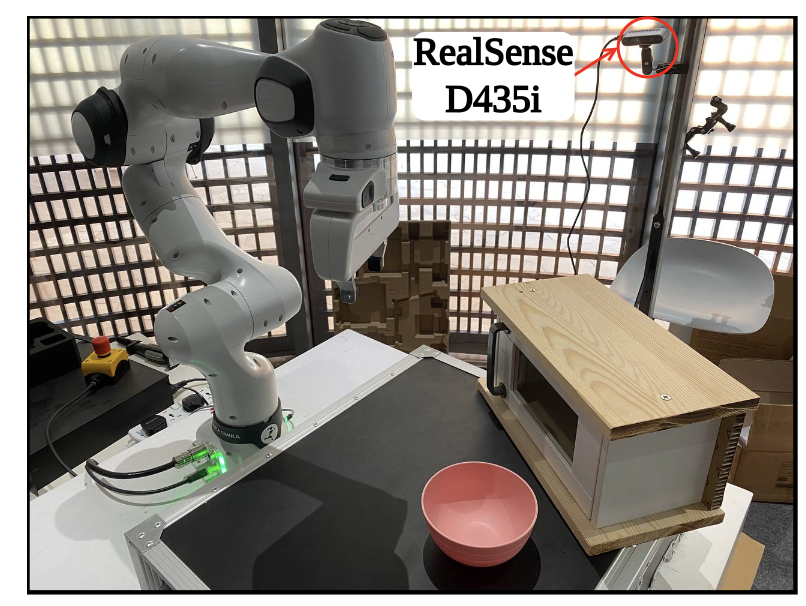

设置。为了展示框架在实际应用中的可行性,用 Franka Research 3 机械臂对三个任务进行评估:(i)拿起杯子并放在盘子上,(ii)拿起碗,以及(iii)关闭抽屉。用 GELLO 远程操控设备 [49] 收集的每个任务的 20 个演示数据来微调 GR00T-N1.6 模型。然后,用 World2Act 对基线模型进行后训练,该基线模型包含由 Skill-WM 生成的 100 条轨迹。观测数据由第三视角摄像头提供,如图显示了物理设置。每个任务进行 20 次试验。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献107条内容

已为社区贡献107条内容

所有评论(0)