AI Agent 是什么,如何理解它,未来挑战和思考

想象一下,你有一个非常聪明的助手,你告诉他一个目标,他不仅能理解,还能自己想办法、找工具、一步步去完成,甚至在遇到问题时会反思、调整策略,直到目标达成。这就是 AI Agent 的核心理念。

它不再仅仅是一个能和你聊天的 AI,而是一个能自主完成任务的智能系统。

1. AI Agent 的本质

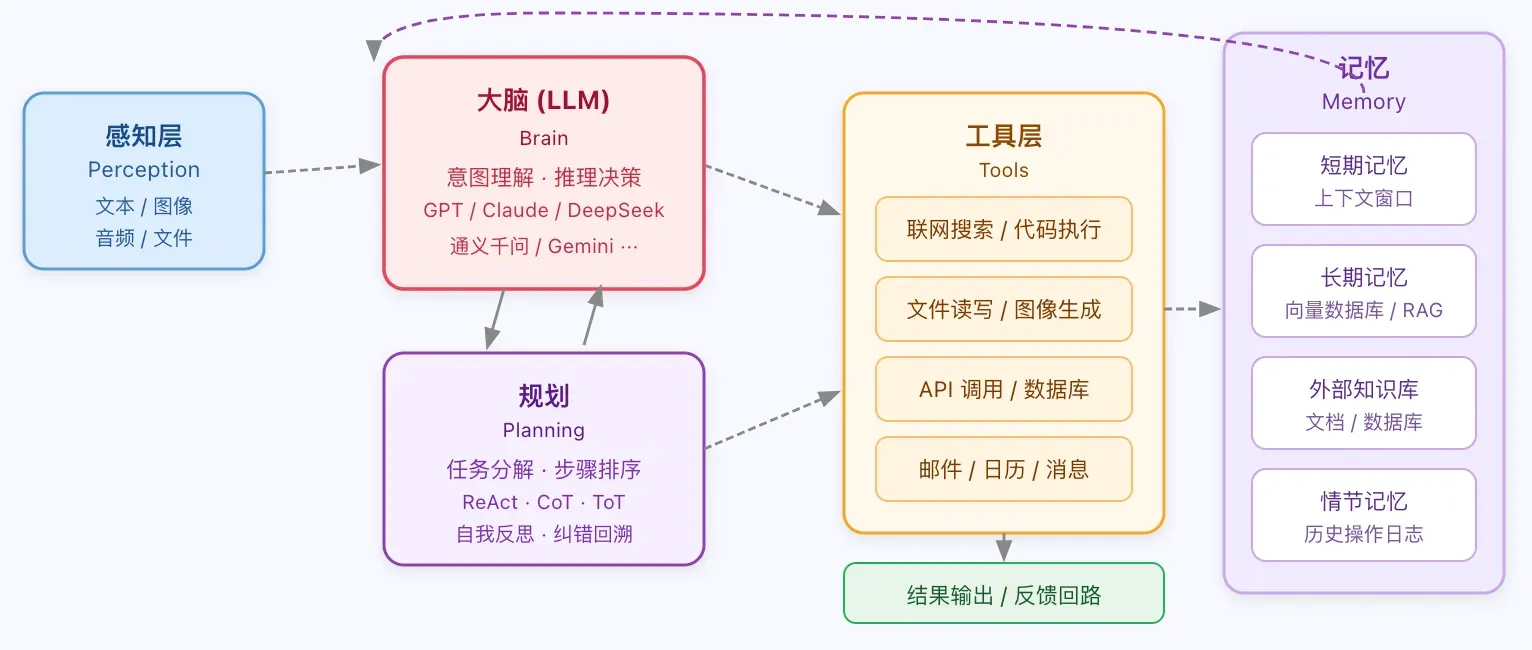

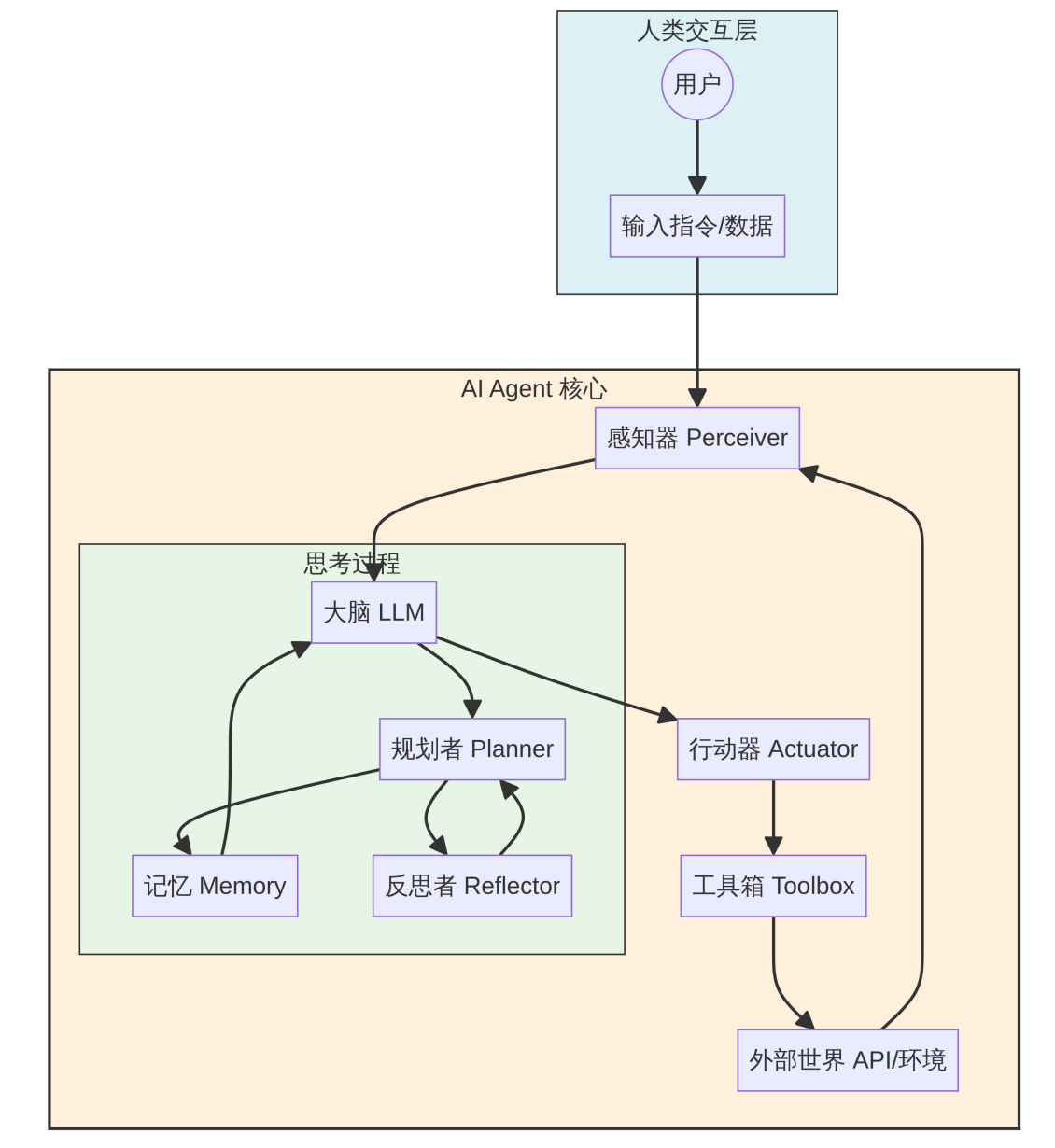

可以把 AI Agent 理解成一个拥有“大脑”、会“感知”、能“规划”、有“记忆”并且会“使用 工具”的智能体。

2. AI Agent 的核心架构

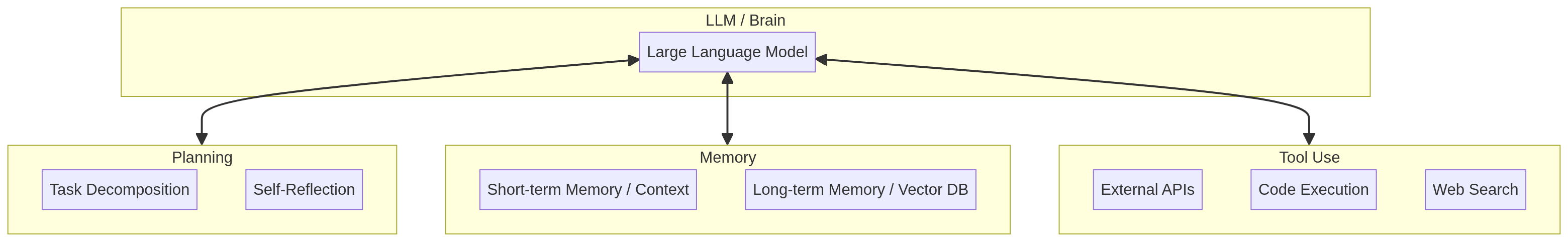

一个典型的 AI Agent 系统以大型语言模型(LLM)为核心,并围绕其构建了三个关键组件:规划(Planning)、记忆(Memory)和工具使用(Tool Use)。这些组件协同工作,使得 Agent 能够理解任务、制定策略、存储信息并与外部世界互动。

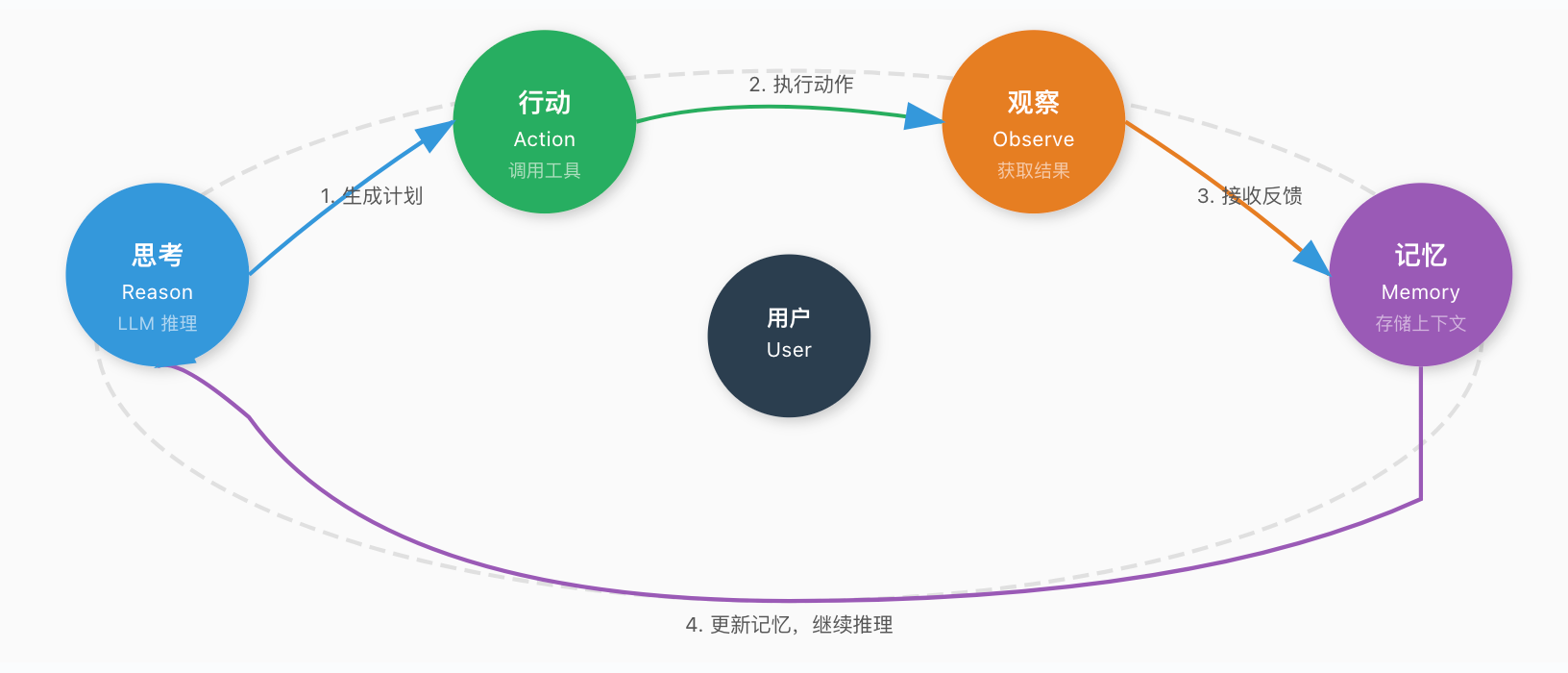

这个“感知-思考-行动-反思”的循环,就是 AI Agent 实现自主性的关键。它的工作方式就像一个人的思维过程:

- 感知:接收外部信息(比如你的指令、环境变化)。

- 思考:用“大脑”分析信息,理解意图,并制定计划。

- 行动:根据计划,调用合适的“工具”去执行。

- 反思:观察行动结果,如果没达到预期,就调整计划,重新思考和行动。

3. AI Agent 核心组件深度解析

|

组件 |

核心职责 |

关键技术 |

|

感知层 |

接收多模态输入,构建上下文 |

多模态模型、OCR、ASR |

|

大脑 |

理解意图、推理决策、调用指令 |

LLM、Function Calling |

|

规划 |

任务分解、步骤排序、自我反思 |

ReAct、CoT、ToT、Reflection |

|

记忆 |

管理上下文、存储长期知识 |

向量数据库、RAG、上下文窗口 |

|

工具 |

执行具体操作,连接外部世界 |

搜索 / 代码 / API / 文件系统 |

核心公式:Agent = LLM + Planning + Memory + Tool Use

4. Agent 与传统 AI 模型的区别

|

维度 |

传统 AI 模型 |

AI Agent |

|

交互方式 |

单次输入输出 |

多轮对话、持续交互 |

|

决策能力 |

基于输入直接推理 |

规划、反思、迭代优化 |

|

工具使用 |

无法主动调用外部工具 |

可调用搜索、计算器、API 等 |

|

记忆机制 |

仅限当前上下文 |

短期+长期记忆 |

|

目标导向 |

完成单一预测任务 |

完成复杂目标 |

|

错误处理 |

输出即结束 |

可自我纠错、重试 |

5. 实际案例

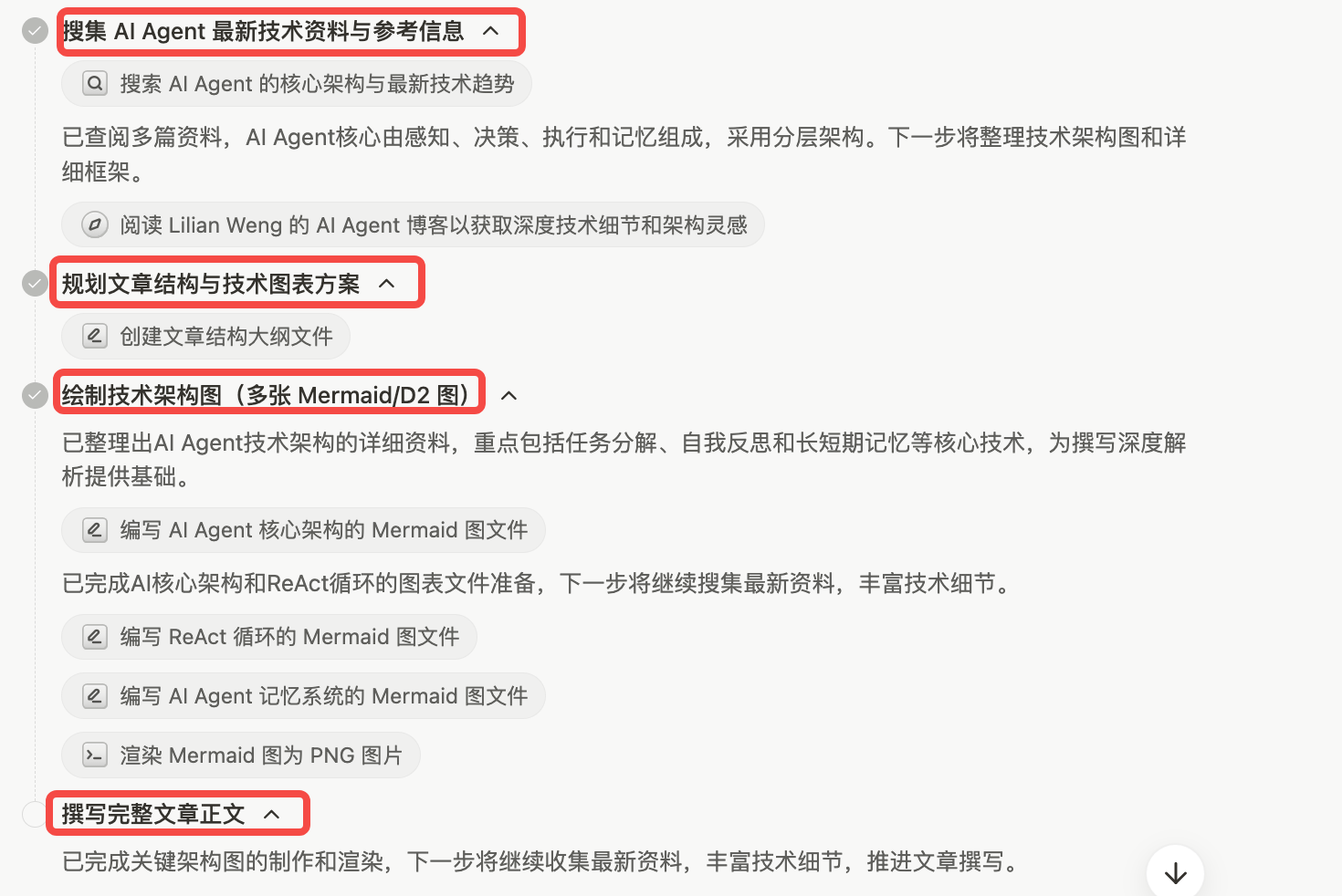

比如使用 Manus 写一篇 AI Agent 的技术文章。 Manus像一个助手一样,帮我生成一篇技术文章

将通过工具调用、信息汇总等处理流程,最终生成一篇高质量的技术文章。

6. AI Agent 的挑战

尽管 AI Agent 展现出令人兴奋的潜力,但在其发展和应用过程中仍面临诸多挑战。

- 幻觉 (Hallucination):Agent 仍可能生成不准确或虚假的信息,尤其是在面对不确定性或知识边界之外的问题时。

- 效率与成本:多步骤推理和频繁的工具调用会增加计算资源消耗和延迟,影响效率和成本。

- 安全性与可控性:赋予 Agent 自主行动能力也带来了潜在的安全风险和伦理问题,如何确保 Agent 的行为符合预期且可控是重要课题。

- 可解释性:Agent 的决策过程往往是一个黑箱,难以理解其推理路径和错误原因,这限制了其在关键领域的应用。

7. 总结

未来 Agent 将具备更强的自我学习、自我优化能力,能够适应更广泛的任务和环境,结合视觉、听觉等多种模态信息,使 Agent 能够更全面地感知和理解世界,针对复杂负载问题,多 Agent 将协同工作,共同解决复杂问题,从而形成分布式智能系统, Agent 的发展被认为是实现通用人工智能的关键一步,它将推动 AI 从辅助工具向真正智能实体的转变。

本文到此结束,感谢阅读。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献12条内容

已为社区贡献12条内容

所有评论(0)