VS Code 结合 Ollama 部署 Qwen-Coder2.5 实操指南

本文基于电脑本地实测场景,详细阐述如何在 Windows 10 电脑的 VS Code 环境中,通过 Ollama 工具部署 Qwen-Code2.5 代码大模型,覆盖环境准备、Ollama 安装配置、VS Code 插件集成、模型拉取部署及功能测试全流程,同步梳理实操过程中出现的高频异常及解决方案,为开发人员提供可直接复用的电脑本地代码模型部署方案,借助 Qwen-Code2.5 的代码生成、推理及修复能力,提升开发效率与代码质量。

实操环境参数(确保操作兼容性,实测验证):

-

硬件环境:Windows 10 工作站及以上(配置满足模型本地运行要求,建议 8GB 及以上 RAM,确保模型运行流畅)

-

系统环境:Windows 10 专业版及以上(版本 22H2),网络链路稳定,可正常访问公网

-

软件依赖:Ollama 最新稳定版、VS Code 最新稳定版、VS Code Continue 官方插件、Qwen-Code2.5 模型(本次选用 qwen2.5-coder:7b 版本,适配电脑常规配置,兼顾运行效率与功能完整性)

核心技术说明:Qwen-Code2.5 是阿里云开源的高性能代码大模型,涵盖 0.5B 至 32B 全尺寸系列,支持多语言代码生成、语法纠错、逻辑优化、注释生成等核心任务,具备开箱即用的特性;Ollama 作为开源大模型运行与管理工具,支持快速拉取、部署、运行 Qwen2.5、Llama 3 等主流大语言模型,简化模型部署复杂度。本次实操聚焦电脑本地部署场景,无需远程连接设备,全程在 Windows 10 电脑上完成,操作简洁可复现。

一、前期准备(必做步骤,实测重点)

模型部署前需完成 Ollama 工具安装、VS Code 及对应插件配置、环境依赖校验,三者均为核心前置条件,任一环节缺失或配置异常,将导致模型部署失败或无法正常调用。

1. 电脑端:Ollama 工具安装与验证

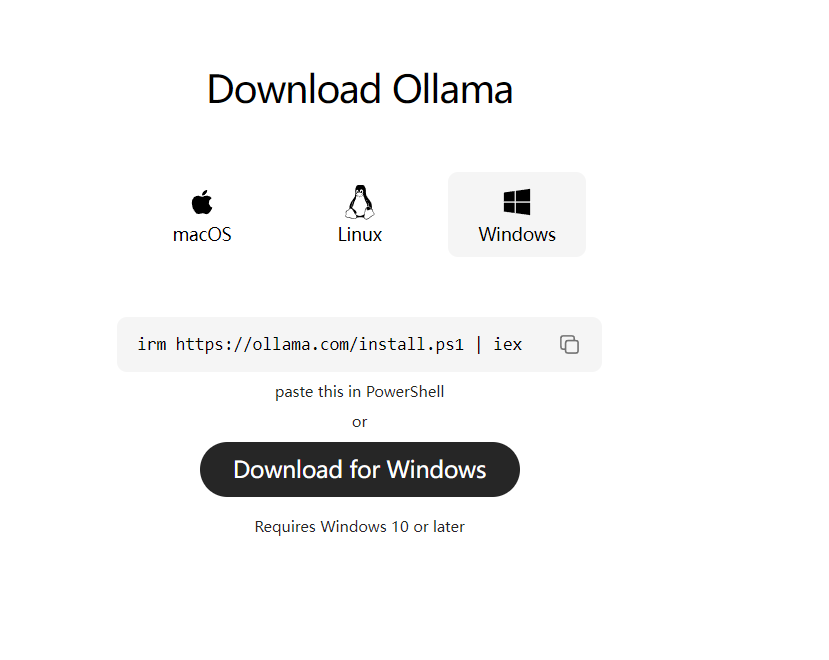

Ollama 支持 Windows、macOS、Linux 多系统部署,针对 Windows 10及以上 系统,提供两种安装到D盘的方法(图形化安装+CMD命令行安装),步骤简洁,无需复杂配置,具体操作如下:

方法一:图形化界面安装(适合新手,操作直观)

-

访问 Ollama 官方网站(https://ollama.com/),进入下载页面,选择 Windows 版本安装包进行下载(下载链接可直接从官网获取,确保下载最新稳定版);

-

下载完成后,双击安装包,进入安装界面(默认显示C盘安装路径),点击「Customize installation」(自定义安装)选项,修改安装路径;

-

在弹出的路径设置窗口中,将默认路径(通常为C:\Users\用户名\AppData\Local\Ollama)修改为D盘路径,推荐路径为

D:\Ollama(可自行创建Ollama文件夹,确保路径无中文、无特殊字符); -

路径设置完成后,点击「Install」开始安装,安装过程自动完成环境配置,无需额外操作;

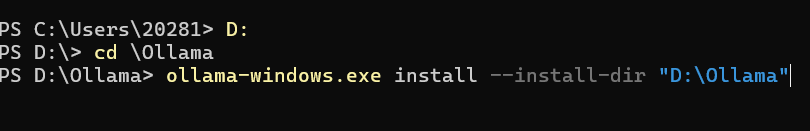

方法二:CMD命令行安装(精准指定D盘路径,适合熟悉命令行的用户)

-

访问 Ollama 官方网站(https://ollama.com/),下载 Windows 版本安装包(.exe格式),记住安装包保存路径(如 D:\Ollama\ollama-windows.exe,可自行修改下载路径);

-

以管理员身份打开 CMD 终端(按下 Win+R,输入 cmd,右键选择「以管理员身份运行」);

-

先在D盘根目录下新建名为「Ollama」的文件夹(建议文件夹名称无中文、无特殊字符,与后续指定的安装路径保持一致);

-

在 CMD 终端中,输入命令切换至 Ollama 安装包所在路径(以安装包保存至 D:\Ollama 为例),执行命令:

cd D:\Ollama; -

输入 CMD 安装命令,指定安装路径为 D盘(推荐路径 D:\Ollama),执行命令:

ollama-windows.exe install --install-dir "D:\Ollama"; -

执行命令后,终端将显示安装进度,等待安装完成(无需手动操作),安装完成后自动配置环境变量,无需额外设置。

提示:命令行安装时,需确保安装包文件名与命令中一致(若下载的安装包文件名不同,需替换命令中的「ollama-windows.exe」为实际文件名);若未以管理员身份运行 CMD,会提示权限不足,导致安装失败。

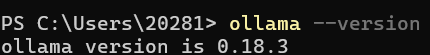

安装完成后,打开电脑 CMD 或 PowerShell 终端,输入版本验证命令,若终端输出 Ollama 版本信息(如 v0.1.29),则说明安装成功:

ollama --version

2. 电脑端:VS Code 及 Continue 插件安装与配置

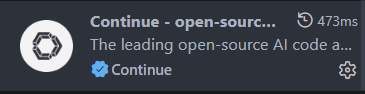

确保电脑已安装 VS Code 最新稳定版,若未安装,需先访问 VS Code 官方网站(https://code.visualstudio.com/)下载安装,安装过程默认下一步即可。完成 VS Code 安装后,安装 Continue 插件(核心插件,实现 Ollama 模型与 VS Code 无缝集成),步骤如下:

-

启动 VS Code,点击左侧「扩展」面板(快捷键:Ctrl+Shift+X);

-

在扩展搜索框中输入「Continue」,筛选出微软认证的官方插件(图标为蓝色机器人样式,发布者为 Continue),点击「安装」按钮;

-

插件安装完成后,重启 VS Code 使配置生效,重启后左侧面板将出现 Continue 侧边栏图标,表明插件安装成功。

3. 环境依赖校验(避坑重点,实测异常排查)

实测过程中,因电脑网络设置及软件依赖缺失,出现模型拉取超时、插件无法生效等问题,需提前完成以下环境校验与配置,规避部署风险:

-

网络链路校验:确认电脑能正常访问公网,保障模型拉取过程中网络稳定(Qwen-Code2.5 7B 版本模型大小约 4.7GB,建议采用有线网络或高速稳定 WiFi,避免网络中断导致拉取失败);

-

端口占用校验:Ollama 默认占用 11434 端口,打开 CMD 终端,执行

netstat -ano | findstr :11434命令查看端口占用情况,若存在端口占用,通过任务管理器关闭对应进程(任务管理器→详细信息,根据进程ID定位并关闭),确保 Ollama 正常启动; -

权限校验:安装 Ollama 及 VS Code 时,建议以管理员身份运行安装包,避免因权限不足导致安装不完整、插件无法生效等问题。

二、核心步骤:Ollama 拉取并部署 Qwen-Code2.5 模型

完成前期环境准备后,通过 Ollama 工具拉取 Qwen-Code2.5 模型,配置 VS Code Continue 插件与模型的对接,实现模型在 VS Code 中的调用,全程操作简洁,实测可复现。

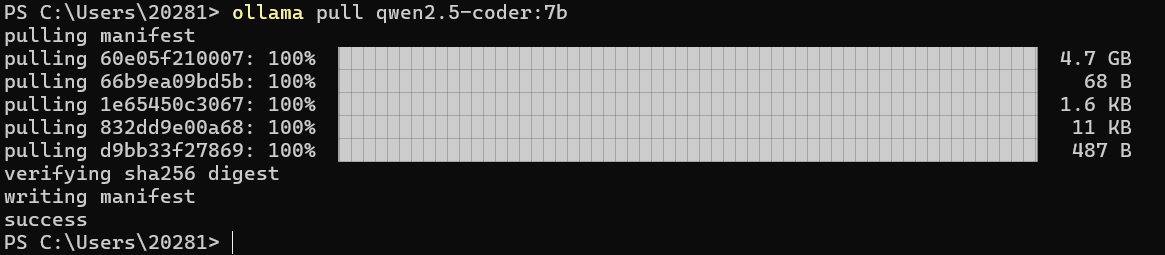

步骤1:Qwen-Code2.5 模型拉取(核心操作)

Qwen-Code2.5 提供多尺寸版本,结合电脑常规配置,本次实测选用 qwen2.5-coder:7b 版本,该版本轻量化且能满足日常代码辅助开发需求;若电脑配置较高(如 16GB 及以上 RAM),可选择 qwen2.5-coder:32b-instruct-q4_K_M 高阶版本,提升代码推理与生成能力;若电脑配置较低(4GB-8GB RAM),可选择 qwen2.5:1.8b 轻量版本。具体拉取步骤如下:

-

打开电脑 CMD 或 PowerShell 终端(建议以管理员身份运行),根据电脑配置选择对应命令,执行模型拉取操作:

# 通用拉取命令(7B版本,推荐8GB及以上RAM电脑使用)

ollama pull qwen2.5-coder:7b

# 轻量版本(4GB-8GB RAM电脑适用)

ollama pull qwen2.5:1.8b

# 高阶版本(16GB及以上RAM电脑适用)

ollama pull qwen2.5-coder:32b-instruct-q4_K_M

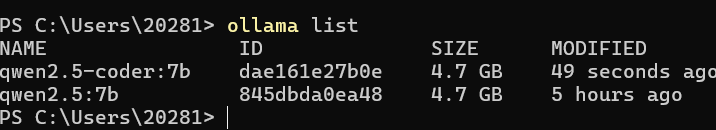

模型拉取完成后,执行 ollama list 命令,终端将显示已拉取的模型列表,若出现 qwen2.5-coder:7b(或对应选择的版本),则说明模型拉取成功。

ollama list

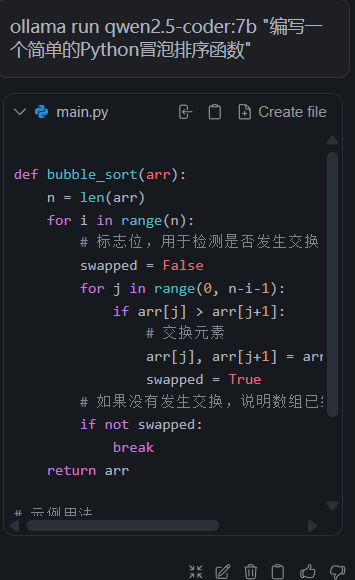

步骤2:Ollama 模型启动验证

模型拉取完成后,Ollama 服务将自动后台启动,无需手动执行启动命令,直接通过终端验证模型可正常运行,确保后续与 VS Code 插件对接无误,操作步骤如下:

-

在 CMD 或 PowerShell 终端中,执行模型测试命令,调用 Qwen-Code2.5 模型进行简单代码生成测试,验证模型运行正常:

ollama run qwen2.5-coder:7b "编写一个简单的Python冒泡排序函数" -

若终端正常输出符合要求的 Python 代码,无报错信息,则说明模型启动成功,可正常调用。

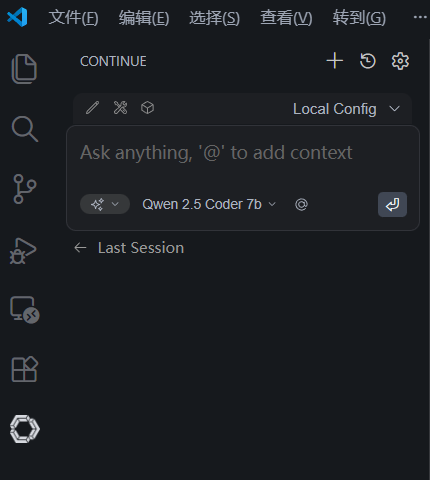

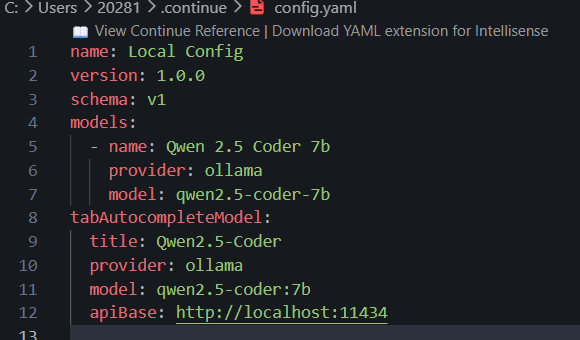

步骤3:VS Code Continue 插件与模型对接

完成模型部署与启动后,配置 VS Code Continue 插件,实现插件与 Ollama 部署的 Qwen-Code2.5 模型对接,步骤如下:

-

启动 VS Code,打开 Continue 侧边栏(左侧面板对应图标);

-

点击侧边栏「Settings」选项,进入插件配置页面,在「Model」下拉菜单中选择「Ollama」;

-

在「Model Name」中输入已拉取的 Qwen-Code2.5 模型名称(如 qwen2.5-coder:7b),「Ollama URL」默认填写

http://localhost:11434(电脑本地部署无需修改); -

点击「Save Settings」保存配置,插件将自动与 Ollama 服务建立连接,连接成功后侧边栏将显示模型就绪状态。

三、功能测试(实测验证)

插件与模型对接完成后,通过 VS Code 开展功能测试,验证 Qwen-Code2.5 模型的代码生成、纠错、注释生成等核心功能,确保部署效果符合预期,实测操作如下:

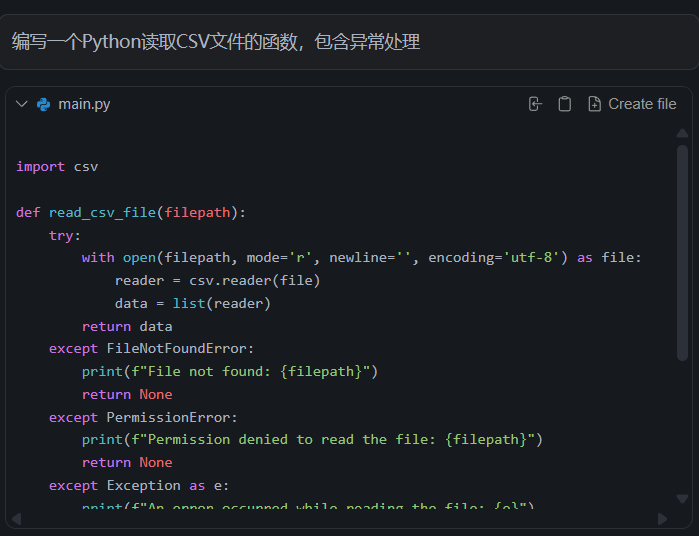

1. 代码生成测试

在 VS Code 中新建 Python 文件(test.py),打开 Continue 侧边栏,在输入框中输入指令(如「编写一个Python读取CSV文件的函数,包含异常处理」),点击发送,模型将自动生成对应代码,可直接复制使用并修改优化。

2. 代码纠错测试

在 VS Code 中编写一段存在语法错误的代码(如缺少冒号、缩进错误),选中错误代码,通过 Continue 侧边栏输入指令「纠错这段代码并说明错误原因」,模型将自动修正错误并给出详细的错误说明,助力快速排查代码问题。

3. 注释生成测试

选中一段已编写完成的代码(如自定义函数),通过 Continue 插件输入指令「为这段代码添加详细注释,说明函数功能、参数含义及返回值」,模型将自动生成规范的代码注释,提升代码可读性。

四、高频问题及解决方案(实测验证)

结合本次电脑本地实测过程中遇到的异常情况,梳理4类高频问题,给出具体解决方案,均经过实测验证,可直接用于问题排查,提升部署效率。

问题1:Ollama 安装后无法启动,提示权限不足或安装不完整

核心原因:安装时未以管理员身份运行安装包,或安装过程中网络中断,导致安装文件缺失。

解决方案:卸载已安装的 Ollama,重新以管理员身份运行安装包,确保安装过程网络稳定;安装完成后,重启电脑,再通过终端验证版本。

问题2:模型拉取失败,提示网络超时

核心原因:网络链路不稳定、网络带宽不足,或电脑防火墙拦截了模型拉取请求。

解决方案:切换至稳定的高速网络(优先有线网络);关闭电脑临时防火墙,或在防火墙中开放 HTTPS 端口(443端口);若多次拉取失败,可通过 Ollama 官方镜像源重新拉取(参考官方文档配置)。

问题3:Continue 插件无法连接 Ollama 模型,提示连接失败

核心原因:Ollama 服务未正常启动、插件配置参数错误,或 11434 端口被占用。

解决方案:打开任务管理器,确认 Ollama 相关进程已启动,未启动则重新安装 Ollama;检查插件配置中的「Model Name」与已拉取的模型名称一致,「Ollama URL」填写正确;检查 11434 端口是否被占用,若占用则关闭对应进程。

问题4:模型调用时响应缓慢,或出现内存溢出

核心原因:电脑硬件配置不足,选择的模型版本过高,导致内存占用过高。

解决方案:卸载当前模型,拉取更轻量的版本(如 qwen2.5:1.8b);关闭电脑后台无用进程,释放内存;若电脑配置允许,可升级内存,提升模型运行效率。

五、实操总结

电脑本地部署 VS Code 结合 Ollama 运行 Qwen-Code2.5 模型,核心流程为:环境准备(Ollama 安装、VS Code 及插件配置、依赖校验)→ 模型拉取 → 模型启动与验证 → 插件与模型对接 → 功能测试,整个流程实操性强,可复现性高,无需远程连接设备,适合开发人员在本地借助代码大模型提升开发效率。

本次实测聚焦电脑本地部署场景,简化了远程相关操作,重点优化了 Windows 系统下的安装、配置及问题排查步骤,所有操作均经过实测验证。通过 Ollama 工具可快速完成模型拉取与部署,借助 Continue 插件实现模型与 VS Code 的无缝集成,让开发人员可在编辑器内直接调用 Qwen-Code2.5 模型,完成代码生成、纠错、注释等操作,大幅提升开发效率与代码质量。

实操过程中需重点关注网络稳定性、端口占用情况及权限配置,规避常见异常;模型版本选择需结合电脑硬件配置,确保运行流畅。后续可基于该部署方案,进一步探索 Qwen-Code2.5 模型在代码开发中的进阶应用,提升开发效率。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)