别再只拿AI做质检了!工业大模型实战:从“看缺陷”到“自主决策”的架构跃迁

写在前面

在工业圈摸爬滚打这几年,我见过太多“伪智能”项目。

很多工厂花了几百万上了一套“AI视觉检测系统”,结果呢?

- 换个光照角度,误报率飙升到30%;

- 产线换型(Changeover),得重新采集几千张图、训练好几天;

- 最要命的是,它只能告诉你“这个坏了”,却没法告诉PLC“该怎么调参数修好它”,更别提自动剔除或调整机械臂路径。

这就是传统工业AI的死穴:只有“感知(Vision)”,没有“认知(Reasoning)”,更没有“行动(Action)”。 它们只是昂贵的、带摄像头的规则判断器。

2026年,工业人工智能的风向彻底变了。大模型(LLM)与多模态技术(VLM)的下场,正在把工业AI从“单点质检”推向“全链路自主决策”。

今天这篇长文,不聊虚头巴脑的概念,咱们直接拆解一套**“视觉感知 + 逻辑推理 + 自动化控制”**闭环的实战架构。我会手把手教你如何用开源技术栈,构建一个能看懂复杂工艺、能分析根因、甚至能自动生成控制代码的工业智能体。

如果你正被传统的CV算法瓶颈卡住脖子,或者想让你的自动化产线真正“活”过来,这篇文章就是为你写的。

一、痛点复盘:为什么传统CV在工厂里越来越“难用”?

过去十年,工业视觉主要靠**深度学习(CNN/YOLO)**打天下。这套打法在标准化场景(如手机屏幕划痕检测)很有效,但一遇到复杂场景就原形毕露:

- 长尾缺陷搞不定:那些几年才出现一次的罕见缺陷(Corner Case),你根本凑不够训练数据。模型没见过,就识别不出。

- 泛化能力差:在A产线训练的模型,搬到B产线,因为背景颜色变了、相机位置偏了5毫米,性能直接崩盘。

- 缺乏逻辑链:传统模型是个黑盒。它输出“NG”,但不知道是因为“温度过高导致变形”还是“刀具磨损导致毛刺”。工人拿到结果,还得人工排查原因。

- 与控制系统割裂:视觉系统是视觉系统,PLC是PLC。中间隔着厚厚的“人肉接口”——工人看屏幕,手动按按钮。

破局关键:引入大语言模型(LLM)作为“大脑”,引入多模态大模型(VLM)作为“眼睛”,让它们具备常识推理和任务规划能力。

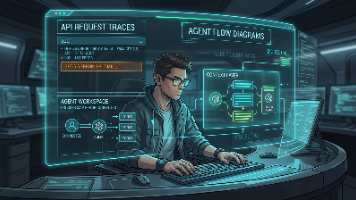

二、架构设计:打造工业界的“超级操作员”

我们要构建的不是一个简单的分类器,而是一个Industrial Agent(工业智能体)。

核心架构图

[物理世界] (产线/机器人/传感器)

|

v

+-----------------------+

| 1. 多模态感知层 |

| (VLM + 传统CV融合) | --> 输出:结构化描述 + 异常坐标

+-----------+-----------+

|

v

+-----------------------+

| 2. 推理决策大脑 |

| (LLM + RAG知识库) | --> 输出:根因分析 + 处置策略

+-----------+-----------+

|

v

+-----------------------+

| 3. 自动化执行层 |

| (Code Gen -> PLC/Robot)| --> 动作:调整参数/剔除/停机

+-----------------------+

关键技术选型(2026工业版)

- 感知层:

- VLM(视觉语言模型):选用 Qwen-VL-Max 或 LLaVA-Next-Industrial(微调版)。它们能理解“划痕”、“油污”、“装配间隙”等语义概念,而不仅仅是像素特征。

- 传统CV辅助:对于高精度测量(如微米级尺寸),依然保留传统算法(Halcon/OpenCV),将数值结果转化为文本描述喂给LLM。

- 推理层:

- 基座模型:Qwen-2.5-72B-Instruct(本地部署,保障数据隐私)或 GPT-4o(云端,处理非敏感逻辑)。

- RAG(检索增强生成):挂载企业的维修手册、历史故障库、工艺参数表。让模型回答时有据可依,杜绝幻觉。

- 执行层:

- Code Interpreter:让LLM直接生成Python脚本或ST(Structured Text)代码片段,经安全校验后下发给控制器。

- OPC UA / MQTT:标准化的工业通信协议,打通IT与OT。

三、实战拆解:三步构建“能思考”的产线

第一步:让机器“看懂”复杂场景(VLM落地)

别指望VLM直接输出坐标,它的强项是语义理解。我们要采用 “VLM粗检 + 传统CV精测” 的混合模式。

场景:检测汽车发动机缸体的复杂装配缺陷(如密封圈未到位、螺丝漏装、表面异物)。

实施逻辑:

- 图像预处理:相机抓拍,进行去噪、增强。

- VLM语义分析:

- Prompt设计:

你是一名资深质检专家。请观察这张发动机缸体图片。 1. 描述画面中的关键部件状态。 2. 检查是否存在以下缺陷:密封圈缺失、螺丝松动、表面油污。 3. 如果发现缺陷,请用自然语言描述位置和类型,并给出置信度。 4. 输出格式为JSON。 - VLM输出示例:

{ "status": "NG", "defects": [ {"type": "missing_seal", "location": "cylinder_head_top_left", "confidence": 0.95, "description": "左上角气缸盖密封圈明显缺失,露出金属底座"} ] }

- Prompt设计:

- 传统CV精确定位:拿到VLM的“左上角”提示后,调用传统算法在该ROI区域进行亚像素级边缘检测,确认具体坐标 (x,y)(x, y)(x,y),供机械臂抓取或剔除。

优势:VLM解决了“没见过的缺陷怎么描述”的问题,传统CV解决了“精度不够”的问题。

第二步:让机器“想通”根因(RAG + 推理)

发现缺陷只是第一步,找到原因并解决才是价值所在。

实施逻辑:

- 构建知识库:将工厂几十年的《设备维修手册》、《工艺故障树》、《历史报警日志》清洗成向量数据库(使用 Milvus 或 Qdrant)。

- 推理链(Chain of Thought):

- 当VLM报告“密封圈缺失”时,LLM自动触发查询:

- “查找‘密封圈缺失’相关的历史案例。”

- “查找当前工位的前序工艺参数(温度、压力)。”

- LLM综合分析:

“检测到密封圈缺失。检索知识库发现,该问题在过去3次出现时,均伴随‘压装工位压力偏低(<50Bar)’。查看实时SCADA数据,当前压力为48Bar。推断根因:压装机液压泵压力波动。”

- 当VLM报告“密封圈缺失”时,LLM自动触发查询:

- 生成建议:

“建议操作:1. 立即停机检查液压泵;2. 临时调整压力设定值至55Bar;3. 追溯过去10件产品进行复检。”

效果:这不再是冷冰冰的“NG”报警,而是一份带诊断报告的工单,直接推送到维修工的平板上。

第三步:让机器“动手”执行(Code Gen + 自动化)

最高级的形态,是自愈(Self-Healing)。

场景:流水线上的产品标签贴歪了。

实施逻辑:

- 感知:VLM识别到标签倾斜角度为15度。

- 决策:LLM判断无需停机,可在线修正。它调用工具函数

calculate_correction_path(angle)。 - 代码生成:LLM生成一段Python代码(或ST代码),计算机械臂需要补偿的旋转角度。

# LLM生成的伪代码 def correct_label_pose(current_angle): offset = -current_angle robot.move_relative(roll=offset) robot.press_down(force=5N) return "Correction Completed" - 安全沙箱执行:

- 关键点:生成的代码绝不能直接运行!必须经过一个确定性验证器(Validator)。

- 验证器检查:速度是否超标?是否会碰撞?是否在安全范围内?

- 验证通过后,通过OPC UA发送给机器人控制器执行。

- 反馈闭环:执行后再次拍照,确认修正成功。

四、深水区挑战:如何搞定“幻觉”与“实时性”?

工业场景对可靠性的要求是99.999%,而大模型天生有幻觉。怎么解?

1. 对抗幻觉的“三重锁”

- 锁一:RAG强制约束。Prompt中明确:“必须依据检索到的知识库内容回答,若知识库无记录,请回答‘未知’,严禁编造。”

- 锁二:多模型投票(Consensus)。对于关键决策,同时调用两个不同大小的模型(如7B和72B),只有结论一致时才执行。

- 锁三:人机回环(Human-in-the-loop)。对于高风险操作(如停机、修改核心参数),LLM只生成“建议方案”,必须由人工点击“确认”后才下发。

2. 解决延迟:端云协同

工业现场网络环境复杂,且要求毫秒级响应。

- 小模型驻边:在产线边缘网关(如Jetson Orin或工控机)部署量化后的7B小模型,负责实时的视觉检测和简单逻辑判断(延迟<200ms)。

- 大模型上云/私有云:复杂的根因分析、长周期优化策略,异步发送到云端大模型处理,结果定期更新到边缘端知识库。

- 缓存机制:常见缺陷的处理方案直接缓存,命中即返回,跳过推理过程。

3. 数据隐私与隔离

工厂数据是核心机密。

- 私有化部署:使用 vLLM 或 Ollama 在内网服务器全量部署开源模型(如Qwen, Llama 3)。

- 数据脱敏:上传到云端(如果必须)前,自动抹去产品型号、客户信息等敏感字段。

五、案例复盘:某电子厂SMT产线的智能化改造

背景:SMT贴片后,AOI(自动光学检测)误报率高,且无法区分“连锡”和“助焊剂残留”,需大量人工复判。

改造方案:

- 接入VLM:替换原有规则引擎,用微调后的VLM对AOI截屏进行二次研判。

- 知识库挂载:导入该厂过去5年的《缺陷图谱》和《工艺调整记录》。

- 闭环控制:

- 若VLM判定为“连锡”,且连续出现3次,LLM自动分析锡膏印刷机参数,生成“刮刀压力+0.5kg”的调整指令,经工程师确认后自动下发。

- 若判定为“助焊剂残留”,直接标记为“误报”,放行产品,并记录案例优化模型。

成效:

- 复判人力减少 80%。

- 误报率从 15% 降至 2% 以下。

- 故障平均修复时间(MTTR)缩短 40%。

六、结语:工业AI的下半场,是“知行合一”

工业人工智能的未来,绝不是堆砌更多的摄像头,也不是训练更大的模型。

真正的护城河,在于如何将“视觉的感知力”、“大模型的推理力”与“自动化设备的执行力”无缝融合。

- 让机器不仅能看见缺陷,还能读懂工艺;

- 不仅能报警,还能开方子;

- 不仅能等待指令,还能主动优化。

这是一场从“自动化”到“自主化”的深刻变革。对于工程师而言,这意味着我们需要跳出单一的算法视角,去理解OT(运营技术)的流程,去掌握Agent编排的艺术,去构建那些真正能抗住产线高压、解决实际痛点的系统。

路虽远,行则将至。别让你的AI只停留在PPT里,把它放进车间,让它去拧螺丝、去查故障、去守护生产线。那才是工业AI该有的样子。

附录:工业AI落地工具箱 (2026版)

- 模型库: HuggingFace (Qwen-VL, LLaVA), ModelScope (通义千问系列)

- 推理框架: vLLM (高吞吐), TensorRT-LLM (NVIDIA加速), ONNX Runtime (边缘端)

- 向量数据库: Milvus (大规模), Qdrant (轻量级), pgvector (Postgres集成)

- 编排框架: LangGraph (复杂流程控制), Dify (快速应用搭建)

- 工业协议: OPC UA (统一架构), MQTT (消息队列), Modbus TCP (遗留系统兼容)

- 仿真验证: NVIDIA Isaac Sim (数字孪生验证)

(本文基于真实项目经验总结,具体实施需结合现场工况与安全规范)

如果觉得文章帮你理清了思路,欢迎点赞、收藏。关于工业大模型落地的具体坑点,欢迎在评论区留言,咱们一起探讨。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献127条内容

已为社区贡献127条内容

所有评论(0)