IntelliJ IDEA 2026.1 上强度了:Spring 运行时 Debug + AI 全面接入,太香了

IntelliJ IDEA 2026.1 上强度了:Spring 运行时 Debug + AI 全面接入,太香了

大家有没有这种感觉:

以前聊 IDE 更新,更多是在看“补全快没快一点”“界面顺没顺一点”“某个语言特性跟上没跟上”。但这次 IntelliJ IDEA 2026.1 放出来之后,味道明显不一样了。

它已经不是那种“修修补补、加几个小功能”的版本了,而是很明显地在往一个 AI 开发平台 的方向走。

尤其是这次最让我眼前一亮的,不只是 AI 全面接入,而是 Spring 运行时 Debug 这个新功能。说直白点,就是以前很多必须打断点、停程序、来回翻代码才能看清楚的问题,现在开始有机会在程序不停的情况下直接看运行状态了。

如果你平时是写 Java、Spring Boot、Gradle、Kubernetes 这一套的,那这次更新真不是“可升可不升”,而是属于那种——升完你会明显感觉开发流更顺了。

这次更新,为什么值得开发者认真看一眼?

因为 IntelliJ IDEA 2026.1 最关键的变化,不是某一个单点功能,而是它在重新定义 IDE 这件事。

JetBrains 这次释放出来的信号非常明确:

- IDE 不再只是一个“写代码的地方”

- AI 不再只是一个“聊两句、补几行代码的插件”

- 越来越多原本分散在不同工具里的活,开始被往 IDEA 里面收

你会发现,这次更新涉及的内容不是零散的小修小补,而是整条开发链路:

- AI 智能体接入

- Java 新版本支持

- Spring 调试体验升级

- 依赖源码自动可见

- 命令补全增强

- Gradle 官方最佳实践

- Git worktree 并行开发

- AI 直接操作数据库

- Kubernetes 集群管理体验优化

这说明 JetBrains 不是在给 IDEA 打几个“AI 补丁”,而是真的在推动它从 IDE 往 开发工作平台 演进。

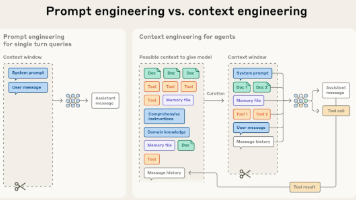

1、AI 这次不是“加了”,而是“全面接进来了”

先看最明显的一条:全面拥抱 AI。

根据原文,IntelliJ IDEA 2026.1 已经开始走开放式 AI 生态路线,原生支持:

- Codex

- Cursor

- 各类兼容 ACP 协议 的 AI 智能体

而且它还支持 自定义模型,也就是说你可以通过 API Key 的方式接入任意模型,包括:

- 本地模型

- 其他云厂商模型

- 团队内部统一接入的模型能力

这件事为什么重要?

因为以前很多 IDE 里的 AI 能力,本质上还是“官方喂你什么你就用什么”。但现在不一样了,它开始变成一个更开放的平台:你习惯哪个 AI 工具,你就把哪个工具带进自己的专业开发工作流。

这比“某个模型更强”更关键。

因为真实开发里,大家越来越不可能只用一个工具打天下了。有人喜欢用 Claude 做复杂代码理解,有人喜欢用 Codex 跑命令行任务,也有人会用 Gemini 去处理长文档和多源资料。IDEA 现在的方向,就是尽量让这些选择不再互相冲突,而是能在同一个工作流里共存。

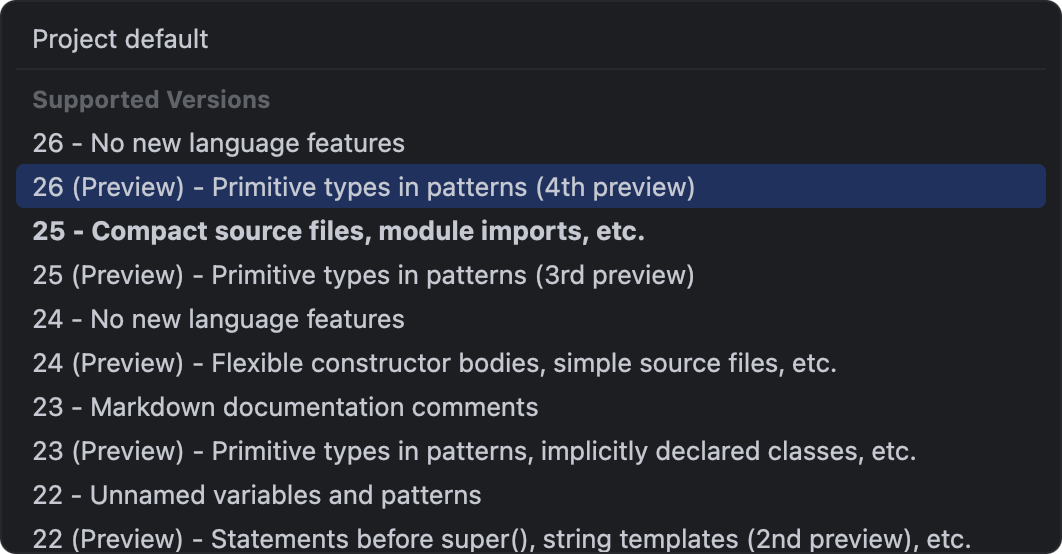

2、Java 26 刚来,IDEA 已经跟上了

JetBrains 在追 Java 新版本这件事上,速度一直挺稳,这次也没掉链子。

原文提到,Java 26 刚发布没几天,IntelliJ IDEA 2026.1 就已经给出支持了。

虽然 Java 26 没有新的正式语言特性,但它也不是完全没料,重点提到了两类预览能力:

- 模式匹配:第 4 次预览

- 懒加载常量:第 2 次预览

这意味着什么?

对很多喜欢提前尝鲜、或者需要跟进新版本特性的开发者来说,IDE 跟进得快,成本就会低很多。你不用等很久,也不用靠半残支持凑合用,直接就能在日常开发里把这些新特性跑起来。

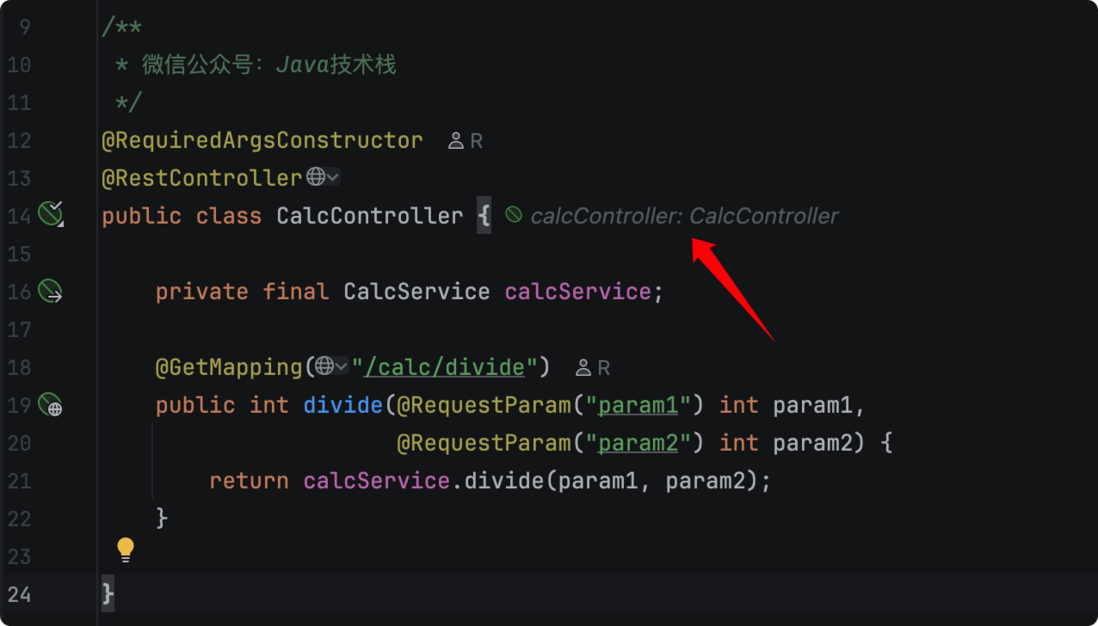

3、这次最狠的新功能:Spring 运行时 Debug

这绝对是这篇更新里最值得单独拎出来讲的点。

原文里提到,Spring Debugger 现在可以让你在代码运行时,直接看到 Spring 应用的实际状态,不用暂停程序了。

这句话听起来轻飘飘,但做过 Spring 项目的人都知道,这意味着什么。

以前我们调 Spring 应用,经常是这套流程:

- 打断点

- 停程序

- 看变量

- 猜配置

- 查 Bean 注入

- 来回翻项目结构

这个过程最大的问题不是麻烦,而是很容易把调试节奏切碎。尤其是排一些框架层、配置层、依赖注入层的问题时,你很多时间都花在“确认真实运行状态”上,而不是花在“真正定位问题”上。

而现在这个运行时 Debug 的方向,等于是想直接把这些信息摊到你面前:

- 依赖到底是怎么注入的

- 当前用了什么配置

- 当前环境到底是什么

- 某些 Bean 为什么不对

- 某些受保护端点为什么访问异常

- 配置有没有真正生效

这类能力一旦成熟,对 Spring 开发的体验提升会非常夸张。

当然,原文也提到目前这个功能还没有完全开发完成,现在只能看到注入到 Spring 组件中的 Bean 类,后面应该还会继续补。

但就算现在还没 fully done,这个方向已经足够让人兴奋了。

因为它解决的不是“写代码更快一点”,而是排障这件事终于可能不那么痛苦了。

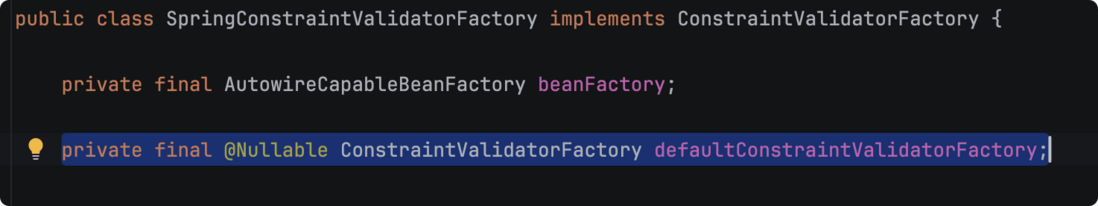

4、依赖源码和文档开箱即用,这个改动会被低估

现在 AI 生成代码越来越多,很多人以为开发效率上去了,问题就少了。实际恰恰相反:你更需要上下文了。

因为 AI 可以帮你写,但不能替你理解所有第三方依赖、框架行为和调用链。

原文里提到,从 IntelliJ IDEA 2026.1 开始:

所有依赖项的源代码将以非侵入的方式自动下载

这意味着以后你在看代码、查依赖、追调用链、排查问题时,会更容易拿到完整上下文。

这个改动的价值不在于“少点两下鼠标”,而在于你理解问题的路径被缩短了。

特别是现在很多团队已经进入“AI 先出代码、人来验逻辑”的阶段,依赖源码和文档能不能顺手看到,会直接影响你审代码和查问题的效率。

5、命令补全这次是真的增强了,而且更像 AI 工作入口

这次命令补全的升级也很值得看。

原文总结了几个点:

-

命令补全接入了更多 AI 能力

你不用离开编辑器,就能在提示框里直接让 IDE:- 解释代码

- 生成文档

- 修改代码

-

所有后缀模板现在都可以通过

..发现和调用 -

命令补全现在也支持

.properties配置文件了

这几条看起来像“中小更新”,但合在一起意思很明显:

IDEA 正在把命令补全、模板、AI 指令,逐步收拢到一套更统一的使用方式里。

这很重要。

因为很多 AI 功能之所以大家用不起来,不是因为它不强,而是因为它离主工作流太远。你得切页面、切窗口、切聊天框、切思路。切着切着,人就烦了。

而这次的方向,就是尽量让这些动作还留在你的编辑器上下文里完成。

6、Gradle 官方最佳实践,来得很及时

这一条也非常实用,尤其是对现在越来越多人会让 AI 帮忙写 Gradle 配置来说。

原文提到,JetBrains 联合:

- Gradle

整理了一套官方最佳实践。

而且目前已经发布了 30 多条。

为什么这个更新很值?

因为 Gradle 这东西,灵活是灵活,但灵活的另一面就是容易乱。更麻烦的是,AI 很可能给你一个“能跑”的配置,但不一定是“长期最优”的配置。

官方最佳实践出来之后,至少有三类人能受益:

- 自己配 Gradle 的开发者

- 团队内部做规范沉淀的人

- 让 AI 生成构建配置的人

以后问 AI:“这个 Gradle 应该怎么配更合理?”

它至少有更靠谱的权威依据可参考,而不是纯靠互联网碎片经验胡拼。

7、编辑器交互更顺滑了,但这次不是主角

原文还提到,编辑器在这些方面做了优化:

- 光标动画更顺滑

- 文本选择更自然

- 界面看起来更清爽

作者自己的感受是:变化没有特别明显。

我觉得这个判断挺真实的。

因为这也反过来说明了一件事:这次真正让人有版本感知的,已经不是传统 UI 小修小补了,而是 AI 和开发链路层面的系统升级。

8、Git worktree 支持更完整了,AI 并行开发会越来越香

这条更新我个人也很看好。

原文提到,随着 AI 智能体越来越适合并行处理任务,Git worktree 的价值会被进一步放大,而 IntelliJ IDEA 现在已经把这块支持做得更完整了。

这个能力的典型使用场景特别清晰:

- 你在

main分支继续主线开发 - 拉一个独立工作树处理线上紧急修复

- 再开一个工作树交给 AI 智能体去跑任务

彼此互不影响。

如果你在大项目里工作,这种体验真的很顶。

因为很多时候浪费时间的不是写代码,而是:

- 切分支

- 清工作区

- 怕改乱

- 怕冲突

- 怕 AI 改到不该改的地方

worktree 一旦配合 AI 用起来,就很容易把“探索任务”“修复任务”“主线开发”分开跑,整体节奏会顺很多。

9、AI 现在可以在 IDE 里直接操作数据库了

这也是一条很有实战价值的更新。

以前想在 IDEA 里让 AI 操作数据库,通常得借 MCP 多绕一层。原文说,现在:

Codex 和 Claude Agent 在 IDE 里的 AI 聊天,已经能直接支持你连接的数据库了

这意味着很多数据库相关任务开始可以直接自然语言处理,比如:

- 查数据

- 分析问题

- 看表结构

- 理解查询关系

- 甚至直接修改数据库内容

如果你用的是外部智能体,原文也说了,依然可以像以前一样通过 MCP 服务器接入。

这一条最关键的意义在于:数据库开始进入 AI 辅助开发的主上下文了。

以前数据库是另一个窗口、另一个工具、另一套心智模型。现在它开始被拉回 IDE 主战场。

对后端开发来说,这个变化很大。

10、Kubernetes 操作也越来越像“IDE 内建能力”了

最后一个很实用的点,是 Kubernetes 体验的继续优化。

原文提到,IDEA 这次专门做了一个欢迎页,帮助你更快进入整个集群操作流程。你现在可以更顺手地在 IDEA 里做这些事:

- 连接集群

- 切换上下文

- 应用配置

- 查看资源树

- 排查日志

- 做调试

这类能力看上去像“运维向”,但对现在做 Java 后端、云原生应用、Spring Boot 微服务的人来说,其实已经越来越日常了。

如果一个 IDE 能把代码、调试、数据库、构建、集群这些链路尽量往一起收,你的上下文切换成本就会明显下降。

IntelliJ IDEA 这次为什么特别适合拿来聊 Claude、Codex、Gemini?

虽然原文里明确点名的是 Codex、Cursor、Claude Agent,没有直接写 Gemini,但这篇更新其实很适合放到更大的 AI 编程工作流里看。

因为 IDEA 2026.1 的核心,不是绑定某一个模型,而是:

- 开放 AI 接入

- 支持自定义模型

- 接受不同智能体进入同一工作流

- 让 IDE 成为 AI 协作主场

这背后意味着一个更现实的趋势:

Claude 更适合什么?

如果你现在做的是:

- 理解复杂代码库

- 处理跨文件修改

- 做长链路重构

- 排查复杂 bug

- 持续围绕一个上下文协作

那 Claude Code / Claude Agent 这类工具往往会更顺手。

它的优势通常不在“啪一下生成一段”,而在于长上下文持续协作能力更适合复杂工程任务。

Codex 更适合什么?

如果你更偏:

- 命令行工作流

- 脚本和自动化

- 工程执行

- 快速操作验证

- API 兼容生态

那 Codex CLI 这类工具会更贴近你的开发节奏。

尤其是在需要结合终端、执行命令、验证结果、反复迭代的任务里,Codex 的感觉通常会更自然。

Gemini 更适合什么?

虽然这篇原文没直接展开 Gemini,但如果放到现在真实开发流里,Gemini CLI 也有非常明确的价值:

- 适合超长上下文

- 适合图文混合理解

- 适合长文档、规范、方案资料归纳

- 适合多源输入一起梳理

比如你在接手一套系统时,要先吃设计文档、截图、流程图、需求说明、接口规范,这时候 Gemini 这类工具往往很适合先做“资料吸收和梳理”的前置工作。

真正高效的方式,往往不是三选一

越来越多开发者最后都会发现:

真正高效的工作流,不是“只押一个 AI”,而是按任务分工。

比如:

- 用 Gemini 先吃长文档和多源资料

- 用 Claude 做代码库理解、重构和复杂修改

- 用 Codex 跑工程执行、脚本和命令行任务

而 IntelliJ IDEA 2026.1 这种开放 AI 生态路线,本质上就是在为这种 多模型协作开发流 铺路。

国内怎么把这套 AI 开发流接得更顺?

如果你只是偶尔体验某一个工具,按官方文档分别配置当然没问题。

但如果你已经开始认真把 Claude Code、Codex CLI、Gemini CLI 带进日常工作流,真正麻烦的通常不是“某个 CLI 装不装得上”,而是后面这堆事情:

- 不同平台分别维护 Key

- 不同模型分别管理额度

- 不同工具分别改配置

- 切来切去,工作流越来越散

- 国内网络和支付也经常让人头大

如果你更希望少折腾一点,可以看看 Code80。

它现在的思路比较直接:一个 API Key 接入 Claude、GPT、Gemini 等主流模型,而且已经把 Claude Code、Codex CLI、Gemini CLI 的安装接入路径整理出来了。你按教程改一下 endpoint,就能尽量少折腾地把这套多模型工作流先跑顺。

对于想长期把 AI 真正接进开发主流程的人来说,这种统一接入方式会更省心一些。

常见问题

1、IntelliJ IDEA 2026.1 最值得看的更新到底是什么?

如果只看一个,我会优先看 Spring 运行时 Debug。

因为它解决的是最实际的开发痛点:调试时不用总靠断点把程序停下来,很多运行时状态开始能更直接看到。

2、这次更新最核心的方向是什么?

不是“AI 按钮更多了”,而是 IDE 开始平台化。

AI、数据库、依赖源码、Git worktree、Kubernetes 这些能力,正在被收进一条更连续的开发链路里。

3、这次 AI 接入到底意味着什么?

意味着 IDEA 不再只是内置一套固定 AI,而是开始允许不同 AI 工具真正进入你的专业工作流。这种开放性,比单纯“支持某个模型”更重要。

4、Claude、Codex、Gemini 该怎么选?

一个简单的思路是:

- Claude:复杂代码理解、重构、长链路协作

- Codex:命令行任务、脚本自动化、工程执行

- Gemini:超长文档、资料归纳、多模态输入处理

最实用的方式通常不是三选一,而是按任务分工。

5、国内开发者怎么更省事地把这些工具都接起来?

如果你不想维护多套 Key、多套额度和多套配置,可以直接看看 Code80 的安装教程。它现在已经把 Claude Code、Codex CLI、Gemini CLI 的接入路径整理好了,更适合想长期使用多模型工作流的人。

写在最后

IntelliJ IDEA 2026.1 这次最值得兴奋的地方,不是“它终于有 AI 了”,而是它开始让人看见一个更清晰的未来:

AI 不再只是 IDE 旁边的外挂,而是在逐步进入开发主流程。

你写代码、看依赖、查数据库、做调试、开 worktree、管 Kubernetes,这些原本分散在不同工具里的动作,正在被重新组织进一个更统一的工作环境里。

而 Spring 运行时 Debug 这种能力,某种程度上就是这个趋势最直接的体现。

因为它不是锦上添花,而是真的在改日常开发体验。

如果你之前还觉得“AI 进 IDE”更多是个噱头,那 IntelliJ IDEA 2026.1 这次,确实值得重新看一眼。它已经不只是能陪你聊两句,而是真的越来越像一个能下场干活的开发搭子了。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)