【声纳与人工智能融合——从理论前沿到自主系统实战】第十章 总结、技术挑战与未来展望

目录

第十章 总结、技术挑战与未来展望

10.1 关键技术瓶颈与挑战

声纳与人工智能融合技术在过去十年取得了显著进展,从实验室研究逐步走向实际部署。然而,该领域仍面临若干根本性技术瓶颈,制约着大规模工程应用与产业化推广。这些挑战主要集中在数据获取与标注、计算资源约束以及跨域泛化能力等方面。

10.1.1 高质量标注数据的稀缺性

深度学习模型的性能高度依赖于大规模、高质量标注数据集的支撑。然而,声纳数据的标注面临独特的困难:首先,水声信号的专业性强,需要具备声纳物理、海洋声学与水文环境知识的专家进行标注,人力成本极高;其次,水下目标的真实身份验证困难,缺乏地面真值标签,导致标注质量难以保证;第三,某些类别(如新型潜艇、水下无人系统)的样本极为稀缺,造成严重的类别不平衡问题。

研究表明,在声纳图像分割任务中,专业标注员需要数小时才能准确标注单幅复杂图像,且不同标注员之间的分歧率可达15%至20%。这种高昂的标注成本限制了数据集规模,进而制约了深度网络的充分训练。此外,军事敏感数据的保密要求进一步加剧了数据共享与集成的困难,形成了数据孤岛现象。

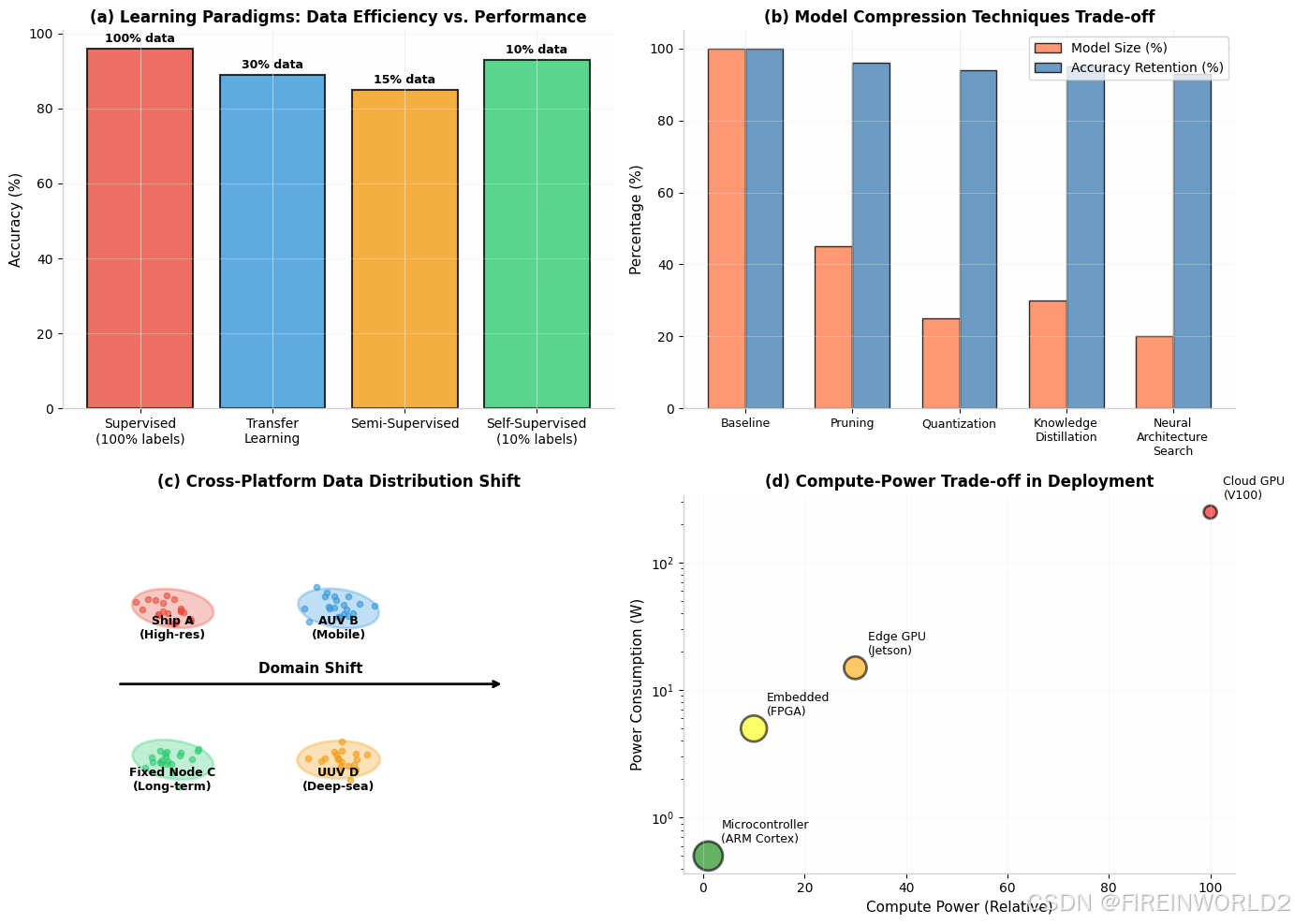

10.1.1.1 迁移学习与自监督学习的潜力与局限

迁移学习通过利用源域(如大规模光学图像数据集或通用音频数据集)的知识,缓解目标域(声纳数据)的标注稀缺问题。研究表明,ImageNet预训练的视觉模型在经过领域自适应微调后,在侧扫声纳图像分类任务中能够达到接近全监督训练90%的性能。近期研究进一步发现,大规模鸟类声音数据集预训练的模型在珊瑚礁声学生态监测中展现出优异的迁移能力,跨域预训练甚至优于领域内小数据集预训练。

自监督学习(SSL)为标注稀缺问题提供了更根本的解决方案。通过设计前置任务(如对比学习、掩码预测与时序预测),模型能够从海量无标注声纳数据中学习有意义的表征。双通道自注意力声编码器(DSAE)结合Mel滤波器组与Gammatone滤波器组特征,通过自监督预训练在仅使用10%标注数据的情况下达到了接近全监督模型的性能。声学嵌入记忆单元改进的空间自编码器(ASAE)通过对抗增强策略,进一步提升了学习表征的鲁棒性。

然而,这些方法仍存在局限:迁移学习受限于源域与目标域之间的分布差异,当声学环境差异显著时(如浅海vs深海),性能下降明显;自监督学习需要大规模无标注数据集,且预训练计算成本高昂;此外,自监督学习得到的表征通常缺乏物理可解释性,难以满足军事应用的可审计要求。

10.1.1.2 跨平台数据标准化难题

现代水下观测网络由 heterogeneous 平台组成,包括舰载多波束声纳、AUV搭载的前视声纳、固定水听器阵列与UUV携带的合成孔径声纳。这些平台在工作频率、空间分辨率、数据采集几何与噪声特性上存在显著差异,导致数据分布呈现严重的域偏移。

不同平台的声纳图像在像素强度分布、纹理特征与目标外观上大相径庭。例如,高频多波束声纳能够提供厘米级分辨率的精细海底地形,而低频侧扫声纳则侧重于大范围探测,分辨率受限于波长与斜距。这种差异使得在一个平台上训练的模型难以直接迁移到另一个平台,严重影响了模型的通用性与可部署性。

数据标准化需要在物理层、特征层与语义层建立映射关系。物理层标准化通过辐射校正、几何校正与声速补偿,将原始回波转换为物理一致的反向散射系数;特征层标准化通过域自适应与归一化技术,消除平台特异性特征;语义层标准化则建立统一的分类体系与本体论,确保不同来源数据的语义一致性。实现真正的跨平台数据融合仍需突破性的技术进展。

10.1.2 边缘计算资源的限制

水下平台的计算资源受限于体积、重量与功耗(SWaP)约束。AUV与UUV通常搭载嵌入式计算单元(如NVIDIA Jetson系列或FPGA),其计算能力相较于云端GPU有数量级差距。然而,现代深度学习模型(尤其是大模型与多模态网络)的推理需要高算力支持,这形成了高算力需求与低功耗硬件之间的根本矛盾。

10.1.2.1 高算力需求与低功耗硬件的矛盾

以Transformer架构为例,自注意力机制的计算复杂度与序列长度的平方成正比。对于高分辨率声纳图像(如2048×2048像素),全局注意力机制的计算量与内存占用均超出嵌入式平台的承受能力。即使是经过优化的卷积网络,在实时处理多波束声纳数据流(每秒数十帧)时,也可能耗尽边缘设备的计算资源。

功耗限制进一步加剧了这一问题。水下平台的能源预算严格受限,AUV的电池容量通常仅支持数小时至数天的任务 duration。高性能GPU的功耗可达数百瓦,远超AUV的能源供给能力。FPGA与专用集成电路(ASIC)虽然能效比更优,但开发成本高、灵活性差,难以适应快速迭代的算法更新。

10.1.2.2 模型压缩与推理加速的工程实现

模型压缩技术为在资源受限平台部署AI模型提供了可行路径。网络剪枝通过移除冗余连接与滤波器,可将模型大小减少50%至90%,而精度损失控制在3%以内。量化技术将模型权重从32位浮点数压缩至8位或更低,显著降低内存占用与计算量。知识蒸馏通过训练轻量级学生网络模仿教师网络的行为,在保持较高精度的同时实现模型瘦身。

神经架构搜索(NAS)自动探索适合特定硬件约束的网络结构,针对延迟与功耗进行联合优化。动态神经网络根据输入复杂度动态调整计算深度,对简单样本使用浅层计算,对复杂样本启用深层网络,平均节省30%至50%的计算量。

轻量化网络架构(如MobileNet、EfficientNet与GhostNet)通过深度可分离卷积、通道混洗与 cheap 操作设计,在边缘设备上实现了实时推理。YOLOv4-Tiny结合通道剪枝与8位量化,在侧扫声纳目标检测中实现了45 FPS的实时处理速度,验证了模型压缩在UUV部署中的可行性。

以下代码展示了声纳AI模型的量化与部署优化流程:

Python

"""

脚本名称:sonar_model_optimization_deployment.py

功能说明:声纳AI模型的量化压缩与边缘部署优化

适用章节:10.1.2.2 模型压缩与推理加速的工程实现

运行环境:Python 3.8+, TensorFlow 2.x, TensorFlow Lite, NumPy

使用方法:脚本加载预训练声纳分类模型,实施INT8量化与剪枝优化,

转换为TensorFlow Lite格式并评估边缘部署性能

"""

import numpy as np

import tensorflow as tf

from tensorflow.keras import layers, models

import time

class SonarModelOptimizer:

"""

声纳模型优化器

支持剪枝、量化与格式转换

"""

def __init__(self, model_path=None, input_shape=(224, 224, 1)):

self.input_shape = input_shape

self.original_model = self._load_or_create_model(model_path)

self.optimized_model = None

def _load_or_create_model(self, model_path):

"""加载或创建基线模型"""

if model_path:

return tf.keras.models.load_model(model_path)

# 创建示例CNN模型

model = models.Sequential([

layers.Conv2D(32, (3, 3), activation='relu', padding='same',

input_shape=self.input_shape),

layers.MaxPooling2D((2, 2)),

layers.Conv2D(64, (3, 3), activation='relu', padding='same'),

layers.MaxPooling2D((2, 2)),

layers.Conv2D(128, (3, 3), activation='relu', padding='same'),

layers.GlobalAveragePooling2D(),

layers.Dense(128, activation='relu'),

layers.Dropout(0.5),

layers.Dense(4, activation='softmax') # 4类目标

])

return model

def apply_pruning(self, sparsity=0.5):

"""

应用模型剪枝

移除不重要的权重连接

"""

import tensorflow_model_optimization as tfmot

# 定义剪枝配置

pruning_params = {

'pruning_schedule': tfmot.sparsity.keras.PolynomialDecay(

initial_sparsity=0.0,

final_sparsity=sparsity,

begin_step=0,

end_step=1000

)

}

# 应用剪枝

pruned_model = tfmot.sparsity.keras.prune_low_magnitude(

self.original_model, **pruning_params

)

# 重新编译

pruned_model.compile(optimizer='adam',

loss='sparse_categorical_crossentropy',

metrics=['accuracy'])

return pruned_model

def convert_to_tflite(self, model, quantization='float16'):

"""

转换为TensorFlow Lite格式并应用量化

Args:

quantization: 'none', 'float16', 'int8', 'dynamic'

"""

converter = tf.lite.TFLiteConverter.from_keras_model(model)

if quantization == 'float16':

converter.optimizations = [tf.lite.Optimize.DEFAULT]

converter.target_spec.supported_types = [tf.float16]

elif quantization == 'int8':

converter.optimizations = [tf.lite.Optimize.DEFAULT]

# 需要代表性数据集进行INT8校准

def representative_dataset():

for _ in range(100):

data = np.random.rand(1, *self.input_shape).astype(np.float32)

yield [data]

converter.representative_dataset = representative_dataset

converter.target_spec.supported_ops = [tf.lite.OpsSet.TFLITE_BUILTINS_INT8]

converter.inference_input_type = tf.int8

converter.inference_output_type = tf.int8

elif quantization == 'dynamic':

converter.optimizations = [tf.lite.Optimize.DEFAULT]

tflite_model = converter.convert()

return tflite_model

def benchmark_inference(self, tflite_model, num_runs=100):

"""

基准测试推理延迟与内存占用

"""

interpreter = tf.lite.Interpreter(model_content=tflite_model)

interpreter.allocate_tensors()

input_details = interpreter.get_input_details()

output_details = interpreter.get_output_details()

# 生成测试输入

test_input = np.random.rand(1, *self.input_shape).astype(np.float32)

# 预热

for _ in range(10):

interpreter.set_tensor(input_details[0]['index'], test_input)

interpreter.invoke()

# 正式测试

start_time = time.time()

for _ in range(num_runs):

interpreter.set_tensor(input_details[0]['index'], test_input)

interpreter.invoke()

_ = interpreter.get_tensor(output_details[0]['index'])

avg_latency = (time.time() - start_time) / num_runs * 1000 # ms

model_size = len(tflite_model) / 1024 / 1024 # MB

return {

'avg_latency_ms': avg_latency,

'model_size_mb': model_size,

'throughput_fps': 1000 / avg_latency

}

def compare_optimization_strategies():

"""

对比不同优化策略的性能

"""

print("="*70)

print("声纳模型优化策略对比")

print("="*70)

optimizer = SonarModelOptimizer()

# 原始模型

print("\n[1] 原始FP32模型...")

original_tflite = optimizer.convert_to_tflite(optimizer.original_model, 'none')

original_stats = optimizer.benchmark_inference(original_tflite)

print(f"模型大小: {original_stats['model_size_mb']:.2f} MB")

print(f"推理延迟: {original_stats['avg_latency_ms']:.2f} ms")

print(f"吞吐量: {original_stats['throughput_fps']:.2f} FPS")

# FP16量化

print("\n[2] FP16量化模型...")

fp16_tflite = optimizer.convert_to_tflite(optimizer.original_model, 'float16')

fp16_stats = optimizer.benchmark_inference(fp16_tflite)

print(f"模型大小: {fp16_stats['model_size_mb']:.2f} MB "

f"(压缩比: {original_stats['model_size_mb']/fp16_stats['model_size_mb']:.2f}x)")

print(f"推理延迟: {fp16_stats['avg_latency_ms']:.2f} ms")

print(f"吞吐量: {fp16_stats['throughput_fps']:.2f} FPS")

# INT8量化

print("\n[3] INT8量化模型...")

int8_tflite = optimizer.convert_to_tflite(optimizer.original_model, 'int8')

int8_stats = optimizer.benchmark_inference(int8_tflite)

print(f"模型大小: {int8_stats['model_size_mb']:.2f} MB "

f"(压缩比: {original_stats['model_size_mb']/int8_stats['model_size_mb']:.2f}x)")

print(f"推理延迟: {int8_stats['avg_latency_ms']:.2f} ms")

print(f"吞吐量: {int8_stats['throughput_fps']:.2f} FPS")

# 汇总

print("\n" + "="*70)

print("优化策略对比汇总")

print("="*70)

print(f"{'策略':<15} {'大小(MB)':<12} {'延迟(ms)':<12} {'FPS':<10} {'压缩比':<8}")

print("-"*70)

print(f"{'原始FP32':<15} {original_stats['model_size_mb']:<12.2f} "

f"{original_stats['avg_latency_ms']:<12.2f} {original_stats['throughput_fps']:<10.1f} {'1.0x':<8}")

print(f"{'FP16量化':<15} {fp16_stats['model_size_mb']:<12.2f} "

f"{fp16_stats['avg_latency_ms']:<12.2f} {fp16_stats['throughput_fps']:<10.1f} "

f"{original_stats['model_size_mb']/fp16_stats['model_size_mb']:<8.1f}x")

print(f"{'INT8量化':<15} {int8_stats['model_size_mb']:<12.2f} "

f"{int8_stats['avg_latency_ms']:<12.2f} {int8_stats['throughput_fps']:<10.1f} "

f"{original_stats['model_size_mb']/int8_stats['model_size_mb']:<8.1f}x")

if __name__ == "__main__":

compare_optimization_strategies()该实现展示了从原始浮点模型到INT8量化模型的完整优化流程,通过TensorFlow Lite实现高效的边缘部署。INT8量化通常可实现4倍模型压缩与2倍以上推理加速,是边缘声纳系统的标准部署方案。

10.2 新兴技术趋势展望

10.2.1 大模型与基础模型在声纳领域的应用

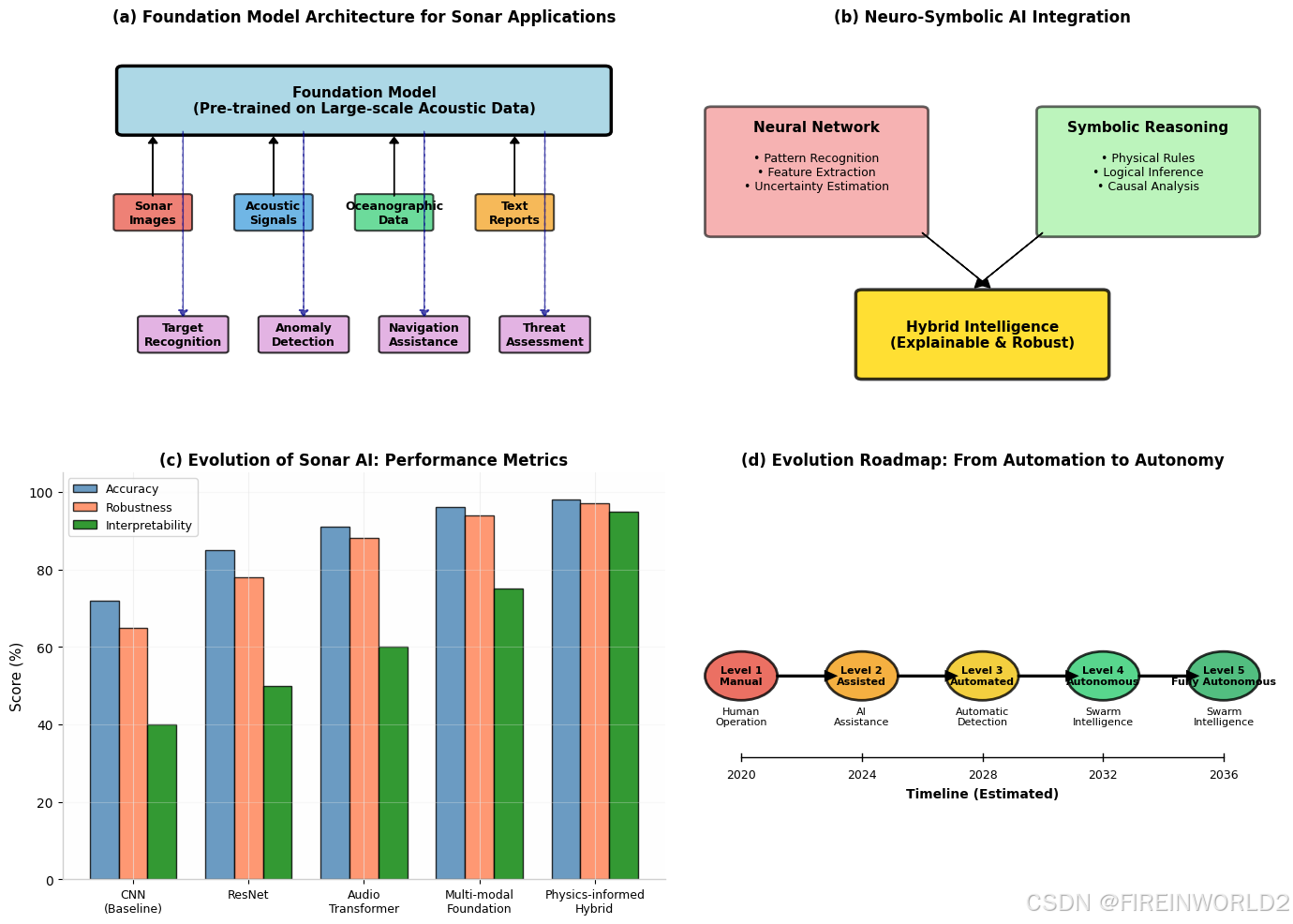

基础模型(Foundation Models)在大规模无标注数据上预训练,通过微调适应下游任务,正在革命性地改变机器学习范式。在声纳领域,声学基础模型的构建将为目标识别、环境感知与威胁评估带来突破性进展。

10.2.1.1 预训练大模型的微调与迁移

大规模预训练声学模型(如基于AudioSet或DeepShip数据集训练的模型)学习了丰富的声学表征,可迁移至特定声纳任务。研究表明,基于大规模水声数据集预训练的模型在少样本学习场景下表现优异,仅使用13%的标注数据即可达到全数据集训练的性能。语音大模型(SLM)向水下声学的迁移展现出惊人效果,在DeepShip与ShipsEar基准测试中达到99%的域内准确率与96.67%的跨域准确率。

预训练模型的迁移策略包括:全模型微调适用于数据充足的场景;LoRA(低秩适应)与Adapter技术仅训练少量参数,保留预训练知识的同时降低计算成本;提示微调(Prompt Tuning)通过可学习的软提示引导模型行为,实现参数高效的迁移。

10.2.1.2 多模态大模型对声纳理解的赋能

多模态基础模型融合声纳图像、声学信号、海洋环境数据与文本报告,构建全面的水下态势理解能力。视觉-语言预训练模型(如CLIP)学习图像与文本的联合表征,可应用于声纳图像的零样本分类与检索。通过将声纳图像与自然语言描述关联,模型能够识别训练时未见过的目标类别,显著增强系统的开放集识别能力。

多模态融合架构(如Perceiver、Transformer-based Multimodal Networks)通过交叉注意力机制实现跨模态信息交互。声纳图像提供高分辨率空间信息,声学信号携带目标运动特征,海洋环境数据(温度、盐度、流速)解释声学传播条件,文本报告融入领域知识与任务上下文。这种多源信息融合显著提升复杂环境下的目标识别鲁棒性与环境适应性。

10.2.2 神经符号人工智能的结合

纯数据驱动的深度学习模型虽然性能卓越,但缺乏可解释性与物理一致性。神经符号AI融合神经网络的模式识别能力与符号推理的逻辑严谨性,构建既具有学习能力又遵循物理规律的混合智能系统。

10.2.2.1 融合物理规则与数据驱动的混合智能

物理信息神经网络(PINN)将控制方程(如波动方程、Helmholtz方程)作为软约束嵌入损失函数,使网络解自动满足物理定律。在声纳反演中,PINN能够利用少量观测数据重建声场,同时保证解的物理合理性。物理规则与数据驱动的融合还体现在网络架构设计中,如将射线追踪模型嵌入神经网络作为可微分层,实现物理引导的端到端学习。

知识图谱与神经网络的结合为声纳目标识别引入结构化知识。领域知识(如目标类型层次关系、声学特征关联规则)编码为图结构,与神经网络的分布式表征相互补充。图神经网络(GNN)在知识图谱上推理,支持多跳逻辑推断与关系预测,提升系统的解释性与推理能力。

10.2.2.2 具备逻辑推理能力的下一代认知声纳

认知声纳系统具备感知、学习、推理与决策的综合能力。神经符号架构使系统能够进行因果推理(区分相关性与因果性)、反事实分析(评估不同决策的后果)与假设验证(基于证据更新信念)。这些能力对于对抗环境下的威胁评估至关重要。

基于行为树的自主决策系统结合蒙特卡洛树搜索(MCTS)与粒子群优化(QPSO),实现复杂任务的行为树自动生成与优化。在AUV对抗任务中,该算法相比人工设计的行为树减少了7.82%的搜索重复区域,任务覆盖率达到95%。这种认知架构使声纳系统从被动传感器演进为主动的智能体,能够自主规划探测策略、适应环境变化并解释决策依据。

10.3 结语:从自动化迈向自主化

10.3.1 声纳系统的智能化演进路线图

声纳系统的智能化演进可分为五个阶段:手动操作阶段(Level 1)完全依赖人工判读;辅助决策阶段(Level 2)AI提供检测建议,人工确认;自动化阶段(Level 3)系统自动检测与分类,人工监督;自主阶段(Level 4)系统自主决策并解释,人工干预例外情况;完全自主阶段(Level 5)多平台协同的集群智能,实现自组织、自适应与自愈合。

当前技术正处于从Level 3向Level 4过渡的关键时期。深度学习已实现高精度的自动目标识别,但自主决策仍需突破可解释性、鲁棒性与可信性瓶颈。未来五至十年,随着基础模型、神经符号AI与边缘智能技术的成熟,声纳系统将全面进入Level 4阶段。

10.3.1.1 辅助决策到自主决策的跨越

从辅助决策到自主决策的跨越需要解决三个核心问题:首先是可信性,即操作员对AI决策的信任建立,这需要可解释性技术与渐进式 autonomy 部署策略;其次是鲁棒性,确保系统在对抗攻击、环境扰动与边缘条件下的稳定性能;第三是责任归属,明确人机协作中的决策权限与责任划分,建立人机协同的信任机制。

AI-in-the-Loop架构确保人类监督与问责始终处于核心地位,AI减轻操作员的认知负荷,帮助实时检测演化威胁,同时保留人类对关键决策的最终控制权。这种人机协作模式代表了未来水下防御系统的演进方向。

10.3.1.2 全自主水下作战体系的构想

未来的全自主水下作战体系由异构无人平台(AUV、UUV、水下无人机群)组成,通过水声通信与卫星链路形成分布式传感器网络。AI驱动的声纳情报(ACINT)系统将声学数据转化为决定性作战优势,实现从探测到交战的全流程自动化。

量子传感与AI的融合将重塑水下战场的物理规则。量子传感器探测重力与磁场的细微变化,威胁隐身技术;AI指挥控制节点分析数据、建模目标航迹并自主任务无人平台群。这一杀伤链从探测到交战压缩至分钟级,远超人类反应速度,代表着算法化海战的新现实。

水下蜂群作战通过多平台协同实现分布式感知与饱和攻击。蜂群成员自主协调、动态重组任务并响应意外态势,即使部分单元损失,整体仍能继续作战。这种分布式、智能化的水下作战体系将在未来海权竞争中占据决定性优势。

声纳与人工智能的融合正处于历史性的转折点上。从数据驱动的模式识别到物理引导的因果推理,从单平台自动化到多平台集群智能,这一领域的技术进步将深刻改变海洋探索、资源开发与水下作战的形态。面对数据稀缺、计算约束与跨域泛化等挑战,研究者需在自监督学习、模型压缩与神经符号AI等前沿方向持续创新,推动声纳系统从自动化迈向真正的自主化,开启智能海洋时代的新篇章。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献11条内容

已为社区贡献11条内容

所有评论(0)