OpenCV实现视频运动目标检测:背景建模与光流估计

在计算机视觉领域,视频中的运动目标检测是基础且核心的技术之一,广泛应用于智能监控、交通流量分析、行为识别等场景。OpenCV作为开源的计算机视觉库,提供了丰富的API,能快速实现运动目标检测的经典算法。本文将详细介绍背景建模(MOG2)和光流估计(LK光流)两种主流方法,结合完整代码拆解实现逻辑,帮助大家掌握视频运动目标检测的核心技巧。

一、运动目标检测核心思路

视频由连续的帧组成,运动目标检测的本质是识别帧间存在像素变化的区域或跟踪特征点的位移。

• 背景建模:通过构建并更新背景模型,将当前帧与背景模型做差,提取前景(运动目标)区域,属于区域级检测;

• 光流估计:基于像素灰度不变假设,跟踪帧间的特征点位移,通过特征点的运动反映目标的运动趋势,属于特征点级跟踪。

两种方法各有优势:背景建模能直观定位运动目标的轮廓,光流估计能精准捕捉目标的运动轨迹,可根据实际场景选择使用。

二、背景建模(MOG2)实现运动目标检测

3.1 算法原理

MOG2(Mixture of Gaussians 2)是改进的高斯混合模型背景建模算法,相比传统MOG算法,它支持自适应学习率,能动态更新背景模型,有效处理光照变化、背景轻微抖动等问题,同时还能对前景区域进行阴影检测并剔除,提升前景提取的准确性。

核心步骤:

1. 初始化高斯混合背景模型;

2. 逐帧读取视频,将当前帧输入模型得到前景掩码;

3. 对前景掩码进行形态学操作,消除噪声;

4. 查找前景区域的轮廓,通过轮廓筛选去除小面积噪声,绘制目标外接矩形。

3.2 完整代码实现

import cv2

# 读取视频文件,也可传入0调用摄像头

cap = cv2.VideoCapture('test.avi')

# 定义形态学操作的核,十字形核去噪效果更优

kernel = cv2.getStructuringElement(cv2.MORPH_CROSS, (3, 3))

# 创建MOG2背景减除器,默认开启阴影检测

fgbg = cv2.createBackgroundSubtractorMOG2()

while True:

# 逐帧读取视频

ret, frame = cap.read()

# 若读取失败(如视频结束),退出循环

if not ret:

break

# 显示原始帧

cv2.imshow('frame', frame)

# 应用背景减除器,得到前景掩码(二值图像)

fgmask = fgbg.apply(frame)

cv2.imshow('fgmask', fgmask)

# 形态学开运算:先腐蚀后膨胀,消除前景中的小噪声点

fgmask_new = cv2.morphologyEx(fgmask, cv2.MORPH_OPEN, kernel)

cv2.imshow('fgmask1', fgmask_new)

# 查找前景区域的外部轮廓

contours, h = cv2.findContours(fgmask_new, cv2.RETR_EXTERNAL, cv2.CHAIN_APPROX_SIMPLE)

# 遍历轮廓,筛选有效运动目标

for c in contours:

# 计算轮廓周长

perimeter = cv2.arcLength(c, True)

# 过滤周长过小的轮廓(噪声),阈值可根据实际场景调整

if perimeter > 188:

# 获取轮廓的外接矩形

x, y, w, h = cv2.boundingRect(c)

# 在原始帧上绘制绿色外接矩形,线宽2

frame = cv2.rectangle(frame, (x, y), (x+w, y+h), (0, 255, 0), 2)

# 显示绘制了目标矩形的帧

cv2.imshow('fgmask_new_rect', frame)

# 等待60ms,按ESC键(27)退出

k = cv2.waitKey(60)

if k == 27:

break

# 释放视频捕获对象,销毁所有窗口

cap.release()

cv2.destroyAllWindows()3.3 代码关键解析

1. cv2.createBackgroundSubtractorMOG2():创建背景减除器,可通过参数history(历史帧数量)、varThreshold(方差阈值)、detectShadows(是否检测阴影)调整模型性能;

2. 形态学开运算:针对前景掩码中的椒盐噪声,通过cv2.MORPH_OPEN消除,核的形状和大小可根据噪声情况调整;

3. 轮廓筛选:使用cv2.arcLength计算轮廓周长,过滤小周长轮廓,避免将噪声识别为运动目标,阈值188需根据视频分辨率、目标大小灵活调整;

4. 外接矩形绘制:cv2.boundingRect获取轮廓的最小外接矩形,通过cv2.rectangle在原始帧上标记目标位置。

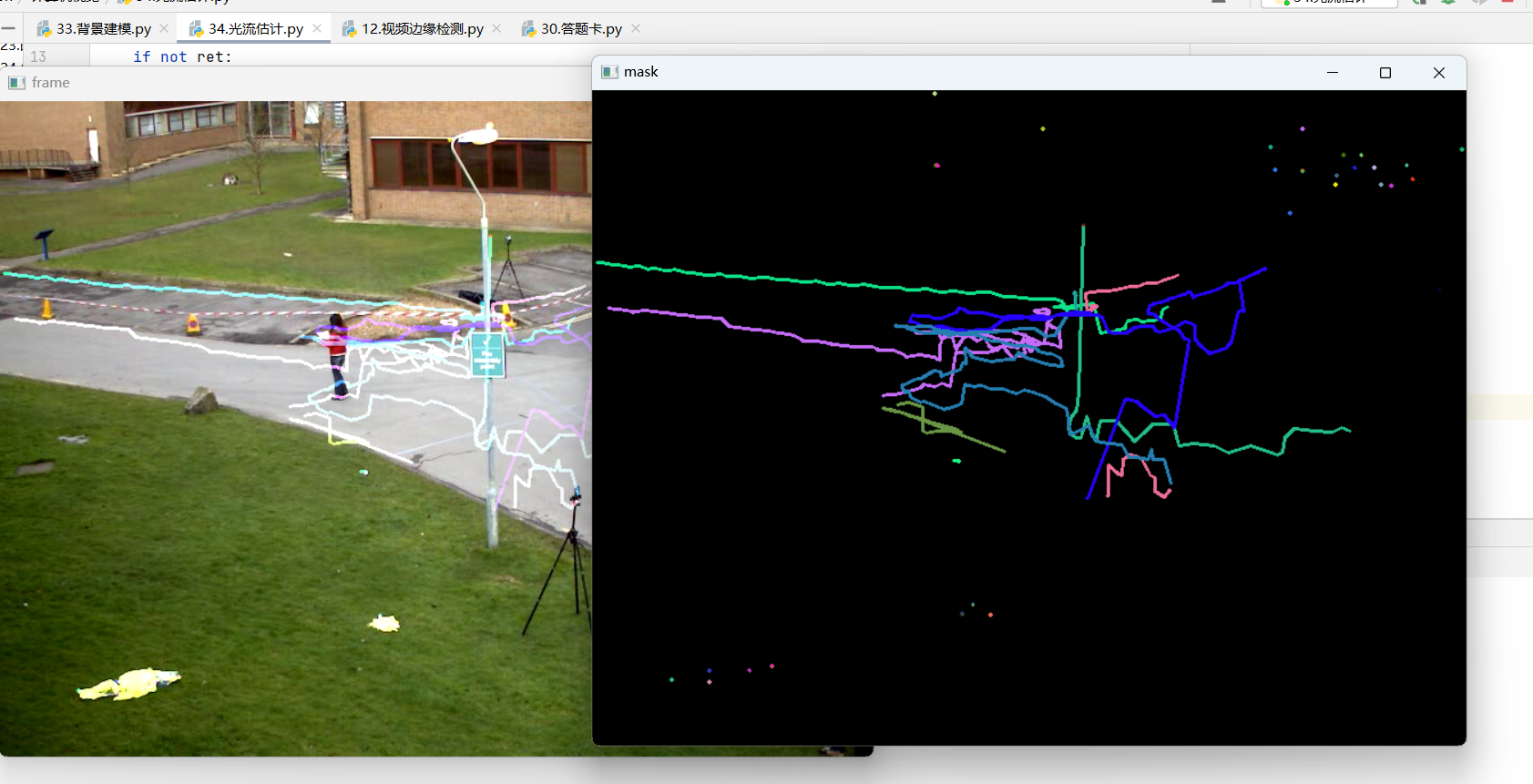

3.4 运行效果

运行代码后会弹出四个窗口:原始帧、原始前景掩码、去噪后的前景掩码、标记目标的帧,可清晰看到运动目标被绿色矩形框精准定位,背景的轻微变化和噪声被有效过滤。

三、光流估计(LK光流)实现运动目标跟踪

4.1 算法原理

LK光流(Lucas-Kanade)是经典的稀疏光流算法,属于特征点光流,仅跟踪帧间的关键特征点(而非所有像素),计算量小、速度快。其基于两个核心假设:

1. 像素灰度不变:同一特征点在连续帧中的灰度值保持不变;

2. 空间一致性:特征点周围的像素具有相同的运动趋势。

本文使用金字塔LK光流(cv2.calcOpticalFlowPyrLK),通过构建图像金字塔,在不同尺度下跟踪特征点,解决了传统LK光流无法处理大位移目标的问题,提升了跟踪的鲁棒性。

核心步骤:

1. 读取视频第一帧,转换为灰度图,提取角点特征;

2. 逐帧读取后续视频,转换为灰度图,计算前后帧特征点的光流;

3. 筛选出跟踪成功的特征点,绘制特征点的运动轨迹;

4. 更新特征点和灰度图,继续跟踪下一帧。

4.2 完整代码实现

import numpy as np

import cv2

# 读取视频文件

cap = cv2.VideoCapture('test.avi')

# 生成100个随机颜色,用于绘制不同特征点的轨迹

color = np.random.randint(0, 255, (100, 3))

# 读取第一帧,作为跟踪的初始帧

ret, old_frame = cap.read()

# 转换为灰度图,光流估计基于灰度图计算

old_gray = cv2.cvtColor(old_frame, cv2.COLOR_BGR2GRAY)

# 定义角点检测的参数

feature_params = dict(

maxCorners=100, # 最大检测的特征点数量

qualityLevel=0.3, # 特征点的质量阈值,0-1,值越高特征点越优

minDistance=7 # 特征点之间的最小距离,避免密集检测

)

# 检测初始帧的角点特征

p0 = cv2.goodFeaturesToTrack(old_gray, mask=None, **feature_params)

# 创建掩码图像,用于绘制运动轨迹

mask = np.zeros_like(old_frame)

# 定义LK光流的参数

lk_params = dict(

winSize=(15, 15), # 搜索窗口大小

maxLevel=2 # 图像金字塔的层数

)

while True:

ret, frame = cap.read()

if not ret:

break

# 转换当前帧为灰度图

frame_gray = cv2.cvtColor(frame, cv2.COLOR_BGR2GRAY)

# 计算金字塔LK光流,得到当前帧特征点和跟踪状态

p1, st, err = cv2.calcOpticalFlowPyrLK(old_gray, frame_gray, p0, None, **lk_params)

# 筛选跟踪成功的特征点(st=1表示跟踪成功)

good_new = p1[st == 1]

good_old = p0[st == 1]

# 遍历特征点,绘制运动轨迹

for i, (new, old) in enumerate(zip(good_new, good_old)):

a, b = new.ravel() # 当前帧特征点坐标

c, d = old.ravel() # 上一帧特征点坐标

# 绘制特征点的运动连线

mask = cv2.line(mask, (int(a), int(b)), (int(c), int(d)), color[i].tolist(), 2)

# 显示轨迹掩码

cv2.imshow('mask', mask)

# 将轨迹掩码与当前帧融合,显示跟踪效果

img = cv2.add(frame, mask)

cv2.imshow('frame', img)

# 等待150ms,按ESC键退出

k = cv2.waitKey(150)

if k == 27:

break

# 更新上一帧的灰度图和特征点,用于下一帧跟踪

old_gray = frame_gray.copy()

p0 = good_new.reshape(-1, 1, 2)

# 释放资源

cap.release()

cv2.destroyAllWindows()3.3 代码关键解析

1. 特征点检测:cv2.goodFeaturesToTrack是Shi-Tomasi角点检测算法,能检测出图像中的强角点,作为光流跟踪的初始特征点,参数需根据图像纹理调整;

2. 金字塔LK光流计算:cv2.calcOpticalFlowPyrLK输入前后帧灰度图和初始特征点,输出当前帧特征点p1、跟踪状态st和误差err;

3. 跟踪状态筛选:st == 1表示特征点跟踪成功,过滤掉跟踪失败的点,避免轨迹混乱;

4. 轨迹绘制:通过cv2.line在掩码图像上绘制特征点的前后帧连线,再通过cv2.add将轨迹与原始帧融合,直观展示运动趋势;

5. 特征点更新:将当前帧跟踪成功的特征点作为下一帧的初始特征点,实现连续跟踪。

3.4 运行效果

运行代码后会弹出两个窗口:轨迹掩码窗口(仅显示特征点的运动连线)、融合窗口(原始帧+运动轨迹),不同特征点的轨迹以不同颜色显示,可清晰看到运动目标的位移方向和轨迹变化。

四、两种方法的对比与场景选择

| 方法 | 核心优势 | 局限性 | 适用场景 |

|---|---|---|---|

| 背景建模(MOG2) | 直观定位目标轮廓,易实现 | 对光照突变敏感,需背景稳定 | 静态背景的智能监控、区域入侵检测 |

| 光流估计(LK 光流) | 跟踪精准,支持动态背景 | 仅跟踪特征点,无目标轮廓 | 目标运动轨迹分析、无人机跟踪 |

实际应用建议:

1. 若需要定位运动目标的具体位置和轮廓,且背景相对稳定,优先选择MOG2背景建模;

2. 若需要分析目标的运动趋势、速度和轨迹,或背景存在轻微动态变化,优先选择LK光流估计;

3. 复杂场景可将两种方法结合,通过背景建模定位目标,再通过光流估计跟踪目标的运动细节。

五、优化与拓展方向

本文实现的是基础版本的运动目标检测与跟踪,可从以下方面进行优化和拓展,提升工程实用性:

1. 背景建模优化:调整MOG2的学习率、方差阈值,结合形态学闭运算填补前景轮廓的空洞,加入目标计数功能;

2. 光流估计优化:加入特征点重检测机制,当跟踪的特征点数量过少时,重新检测特征点,避免跟踪中断;

3. 多目标跟踪:结合目标检测算法(如YOLO),先检测目标再进行光流跟踪,实现多目标的精准匹配和跟踪;

4. 摄像头实时检测:将cv2.VideoCapture的参数从视频路径改为0,调用电脑摄像头实现实时的运动目标检测;

5. 结果保存:通过cv2.VideoWriter将检测/跟踪后的视频保存到本地,方便后续分析。

六、总结

本文通过OpenCV实现了MOG2背景建模和金字塔LK光流两种经典的视频运动目标检测算法,从原理、代码、解析、效果四个维度进行了详细讲解。两种算法分别从区域和特征点角度实现了运动目标的检测与跟踪,是计算机视觉入门的必备技能。

OpenCV为计算机视觉开发提供了便捷的API,无需深入底层算法实现,即可快速搭建原型系统。在实际项目中,需根据场景特点调整算法参数,甚至结合多种算法,才能实现鲁棒、高效的运动目标检测与跟踪。希望本文能帮助大家快速上手,在此基础上完成更复杂的计算机视觉开发任务。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献9条内容

已为社区贡献9条内容

所有评论(0)