RAG深度解析一:从参数化知识到检索增强的范式重构

【内容定位】深度技术原理

【文章日期】2026-03-27

【场景引入】

进入2026年3月,一场围绕大语言模型“可信性”的讨论在技术社区再度升温。开发者们早已不再争论模型参数量,而是转向一个更实际的问题:如何让动辄千亿参数的大模型,在回答“我司最新的产品政策是什么”或“某篇昨天才发表的论文核心观点”时,不再言之无物甚至凭空捏造?这个问题的答案,指向了一个自2023年以来持续演进,并已深刻重塑AI应用开发范式的核心技术架构——检索增强生成。

【价值承诺】

本文将从变革层的视角出发,深入解析检索增强生成的技术原理。我们不会停留在“搜索+生成”的表面描述,而是深入到其重构概率模型、重塑系统架构的数学与工程内核,揭示它如何成为连接大语言模型静态知识与动态世界的关键桥梁。

【阅读收益】

阅读本文,你将清晰地理解:

- 范式重构的本质:RAG如何从数学上重构大模型的条件概率生成框架。

- 核心组件的原理:现代向量检索与注意力机制如何协同工作,实现从海量数据中精准定位并融合信息。

- 系统的三级跳:RAG架构如何从“基础拼接”演进到“高级优化”,并迈向“模块化智能体”。

- 前沿的优化思想:当前最核心的“检索-生成目标对齐”问题及其解决思路。

一、 核心范式:从“闭卷生成”到“开卷检索”的数学重构

理解RAG的深度,必须从其重构的基础数学模型开始。传统大语言模型的生成,是一个基于其内部固化参数Θ的条件概率过程:P(答案 | 问题, Θ)。它的所有知识都“封印”在训练完成的参数中,这直接导致了知识的静态性、幻觉与不可追溯。

RAG带来的根本性变革,是引入了一个隐变量——检索到的上下文c。它将生成过程重构为一个包含检索与生成的联合概率模型:

P(答案 | 问题) = Σ_{c∈C} P(答案 | 问题, c) * P(c | 问题)

这个公式描述了一场深刻的范式转移:

- P(c | 问题) 代表检索系统。它的目标是在向量空间中进行最大后验概率估计,即寻找与问题语义最相似的文档片段c。这通常通过将问题和文档转化为高维向量(嵌入),并计算余弦相似度来实现。这本质上是将非结构化的知识检索,转化为高维空间中的最近邻搜索问题。

- P(答案 | 问题, c) 代表生成系统。即大语言模型基于检索到的上下文c进行条件生成,其概率通过自回归分解。

这里的深刻矛盾与前沿方向在于:检索系统的优化目标(寻找语义最相似的文档)与生成系统的终极目标(生成最准确有用的答案)并不天然对齐。一篇与问题“语义相似”的长篇背景文档,其信息密度可能远不如一个直接给出关键数据的简短表格。这一矛盾催生了RAG领域最前沿的研究:如何让检索器学会“讨好”生成器,即端到端的任务感知检索优化,例如通过生成器的损失梯度反向传播来微调检索器的嵌入模型。

二、 三大技术支柱拆解:向量、索引与注意力

一个生产级的RAG系统,建立在三大相互耦合的技术支柱之上。

2.1 支柱一:从语义到向量——嵌入模型

检索的基石是将文本映射为向量,实现从“词汇匹配”到“语义匹配”的跨越。以Sentence-BERT为代表的现代嵌入模型,通过对比学习进行训练。其核心是InfoNCE损失函数,它通过构造(正样本对,负样本对),让模型学会将语义相似的句子(如“如何训练一个模型”和“机器学习模型的训练步骤”)映射到向量空间中相近的点,而语义不同的句子则远离。这使得模型能够理解“苹果公司”与“iPhone”的语义关联,而非仅仅匹配“苹果”这个词。2026年的前沿进展在于支持更长上下文(如32K token)的嵌入模型,减少了分块带来的语义割裂。

2.2 支柱二:在亿级高维空间中闪电搜索——近似最近邻索引

当每个文档都被表示为768或1024维的向量后,如何在数千万个这样的向量中,在毫秒内找到与问题向量最相似的Top-K个?暴力计算的距离复杂度O(N)不可行。工程上的答案是用可控的精度损失换取速度的指数级提升,即近似最近邻搜索。

主流算法HNSW(可导航小世界图)借鉴了“六度分隔理论”,构建一个多层图结构。底层是包含所有向量的稠密连接图,高层则是少量向量构成的“快速通道”图。搜索时,从顶层入口点开始,像在高速公路上快速接近目标区域,然后逐层向下,在越来越稠密的“地方道路”图中精确定位。通过这种巧妙的层级结构,将搜索复杂度从线性降低到对数级别。

2.3 支柱三:信息融合的神经枢纽——注意力机制

当检索到的多个文档块与原始问题一起输入大语言模型时,交叉注意力机制是信息融合的核心。在生成答案的每一个字时,模型都会动态计算当前状态与上下文中每一个字的关联权重,以此决定从何处汲取信息。这里的挑战在于,标准的注意力机制可能存在“位置偏见”,更容易关注输入序列开头和结尾的信息,导致“中间迷失”。因此,对检索结果进行重排序,将最关键的证据置于上下文的首尾,或采用更先进的上下文压缩技术,成为提升生成忠实度的关键工程实践。

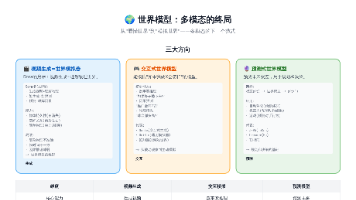

三、 架构演进:从流水线到智能体核心的三级跳

RAG的系统架构自身也在快速演进,清晰地经历了从工具到平台的三个阶段。

3.1 第一阶段:基础RAG——简单的“检索-拼接-生成”流水线

这是最初的范式验证阶段。流程简单直接:用户问题→向量化检索→Top-K结果拼接→提示生成。它证明了“外部知识注入”的可行性,但问题显著:检索精度完全依赖基础嵌入模型,无关上下文会稀释关键信息,对需要多步推理的复杂问题无能为力。

3.2 第二阶段:高级RAG——全链路优化的生产系统

为解决基础RAG的痛点,优化模块被加入流水线的每个环节,形成了当前(2026年)企业级应用的主流架构:

- 检索前优化:引入查询重写/扩展,利用大模型将模糊的用户问题(“它怎么用?”)改写成更精准的查询(“解释RAG系统中向量数据库的使用方法”)。

- 检索中优化:采用混合检索,结合基于语义的稠密向量检索和基于关键词的稀疏检索(如BM25),并利用文档的元数据进行过滤,兼顾召回率与精度。

- 检索后优化:加入重排序步骤,使用更精细但计算成本更高的交叉编码器模型对初步检索结果进行精排,筛选出对生成答案最有价值的片段。还可能进行上下文压缩,只保留信息密度最高的部分。

3.3 第三阶段:模块化RAG——向智能体范式的演进

进入2024年后,RAG开始从固定流水线解耦为一系列可编排的智能模块。检索器不再是被动响应查询,而是可以与路由模块、记忆模块、工具调用模块协同工作。例如,一个智能体在规划复杂任务时,可以主动、迭代地调用RAG模块来获取所需知识。这使得RAG从一个独立的问答系统,演进为复杂AI智能体的“长期记忆与知识核心”,能够处理需要规划、多步检索与综合分析的复杂任务,代表了下一代AI系统的架构方向。

结语

RAG远非一个简单的“搜索框+摘要器”。从数学上看,它通过引入隐变量重构了生成式AI的概率框架;从工程上看,它集成了表示学习、高维索引和注意力机制三大技术支柱;从系统演进看,它正从一条解决特定痛点的“补丁”式流水线,进化为支撑下一代自主智能系统的核心基础设施。其思想内核——承认单一模型的边界,通过架构化的“参数化记忆”与“非参数化记忆”相结合,在开放世界中实现可靠、可追溯的智能——正在成为AI工程实践中的新范式。深入理解其原理,不仅是构建当前可信AI应用的关键,更是迈向未来更复杂、更自主AI系统的必修课。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献20条内容

已为社区贡献20条内容

所有评论(0)