架构师实战:数据交易平台AI定价系统的压力测试与调优

架构师实战:数据交易平台AI定价系统的压力测试与调优——从瓶颈定位到性能倍增的全链路实践

一、引言:数据交易平台的「定价焦虑」

凌晨三点,我盯着监控大屏上的红色告警陷入沉思:

- 定价接口响应时间从10ms飙升至800ms;

- 模型服务CPU使用率100%,连续5分钟触发熔断;

- 大促前的压测中,当流量达到平时3倍时,系统直接「雪崩」——50%的请求超时,用户投诉短信像雪片一样飞来。

这是我在某头部数据交易平台做架构师时遇到的真实场景。数据交易的核心是**「合理定价」**:商家上传数据(如用户行为画像、行业调研报告)后,AI定价系统需要结合市场供需、历史交易、数据维度等20+特征,实时计算出「既能让商家盈利,又能让买家愿意付费」的价格。但当平台用户量突破10万、日均定价请求超百万次时,原本「跑得通」的AI定价系统,突然变成了「卡脖子」的短板。

你可能也遇到过类似问题:

- 为什么AI模型推理总拖后腿?

- 压测时数据库IO突然爆炸,问题出在哪?

- 缓存命中率上不去,到底是Key设计错了还是策略不对?

今天这篇文章,我会把数据交易平台AI定价系统的压力测试与调优的全链路实战经验掰开揉碎讲给你听——从系统架构拆解到压力测试设计,从瓶颈定位技巧到调优落地方法,甚至包括大促前的「生死时速」复盘。读完这篇,你不仅能解决AI定价系统的性能问题,更能掌握一套通用的「压力测试→瓶颈定位→系统调优」方法论。

二、系统背景:AI定价系统的架构全景

在讲压力测试前,必须先明确系统的核心链路——否则你连「压哪里」「测什么」都搞不清楚。以下是我们平台AI定价系统的简化架构(图1):

用户端 → API网关 → 定价服务(核心) → 特征服务 ← Hive/Elasticsearch

↓

模型服务 ← 模型仓库(LightGBM模型)

↓

规则引擎 → Redis(缓存定价结果)

↓

数据库(存储最终定价记录)

1. 核心模块说明

- 定价服务:系统的「大脑」,负责协调特征提取、模型推理、规则校验三大步骤;

- 特征服务:从Hive(离线历史数据)和Elasticsearch(实时用户行为)中提取20+特征(如「数据覆盖用户量」「近7天同类数据成交率」「买家复购率」);

- 模型服务:部署LightGBM回归模型,输入特征后输出「基础价格」;

- 规则引擎:用行业指导价、商家溢价上限等规则修正基础价格(比如「医疗数据定价不得超过1000元/条」);

- 缓存层:用Redis缓存高频请求的定价结果(比如同一数据ID+用户ID的请求,10分钟内不再重复计算)。

2. 核心链路的时序图

用户发起定价请求的完整流程:

- 用户上传数据ID,调用

/api/pricing接口; - 定价服务先查Redis:若有缓存,直接返回结果(耗时≤10ms);

- 若无缓存,调用特征服务获取20+特征(耗时≤50ms);

- 调用模型服务推理基础价格(耗时≤100ms);

- 规则引擎修正价格(耗时≤20ms);

- 结果写入Redis和数据库,返回给用户(总耗时≤180ms)。

看起来很完美?但当并发请求超过200QPS时,每个步骤的延迟都会「放大」——比如模型推理从100ms变成500ms,特征提取从50ms变成300ms,最终总耗时突破1秒,触发用户超时重试,进一步加剧系统压力。

三、压力测试设计:从「拍脑袋」到「科学模拟」

压力测试的核心不是「压垮系统」,而是模拟真实场景,找到系统的「性能临界点」。我们踩过的最大坑是「用假数据压测」——比如用固定的10个特征、相同的用户ID,结果压测时QPS能到1000,但生产环境一跑就崩。后来我们总结了**「三真实」原则**:

1. 先决条件:准备好这些工具与环境

- 压测工具:JMeter(开源、灵活,支持复杂场景)+ Grafana(可视化压测结果);

- 监控工具:Prometheus(采集系统指标)+ SkyWalking(链路追踪)+ Arthas(实时诊断);

- 环境准备:压测环境与生产环境1:1(机器配置、数据库分片、缓存集群大小完全一致);

- 测试数据:

- 真实用户请求日志(从生产环境导出最近7天的请求,按比例放大);

- 真实特征数据(从Hive导出100万条历史特征,覆盖不同数据类型:结构化数据/非结构化数据);

- 真实模型文件(生产环境正在使用的LightGBM模型,大小约200MB)。

2. 测试场景设计:覆盖「全链路+极端情况」

我们设计了4类核心场景(表1),覆盖平峰、高峰、异常等所有可能的生产情况:

| 场景类型 | 测试目标 | 具体条件 |

|---|---|---|

| 基础单接口压测 | 验证定价接口的基准性能 | 10QPS→1000QPS逐步加压 |

| 混合场景压测 | 验证多服务协同的性能 | 定价请求(70%)+特征更新(20%)+模型更新(10%) |

| 极限场景压测 | 找到系统的「崩溃临界点」 | 生产流量的3倍(3000QPS) |

| 异常场景压测 | 验证系统的容错能力 | 缓存失效(Redis宕机)+数据库慢查询(故意加延迟) |

3. 测试执行:用「数据说话」

压测时,我们重点关注4类核心指标:

- 业务指标:QPS(每秒处理请求数)、响应时间(P95/P99,即95%/99%的请求耗时不超过该值)、错误率(≤0.1%为合格);

- 系统指标:CPU使用率(≤80%)、内存使用率(≤70%)、磁盘IOPS(≤90%)、网络带宽(≤80%);

- 链路指标:每个步骤的耗时占比(比如模型推理占比超过50%就是瓶颈);

- 资源指标:缓存命中率(≥90%)、数据库慢查询数(≤10条/分钟)。

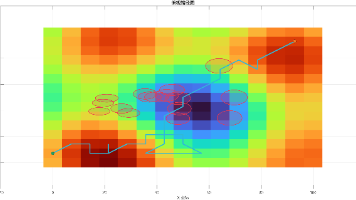

举个例子:基础单接口压测的结果(图2):

- 当QPS=100时:响应时间P95=150ms,错误率0%;

- 当QPS=200时:响应时间P95=300ms,模型服务CPU使用率85%;

- 当QPS=300时:响应时间P95=800ms,错误率突然涨到5%(模型服务熔断)。

这说明模型服务是当前的性能瓶颈——接下来要做的,就是定位模型服务的具体问题。

四、瓶颈定位:像医生一样「诊断」系统

定位瓶颈的关键是**「链路追踪+指标关联+实时诊断」——用SkyWalking看链路耗时,用Prometheus看系统指标,用Arthas查代码执行细节。我们总结了「三步定位法」**:

步骤1:用链路追踪找「耗时大户」

SkyWalking的链路图会把每个请求的「时间线」画出来——比如某请求的耗时分布:

- 定价服务内部处理:10ms;

- 特征服务调用:50ms;

- 模型服务调用:500ms(占比80%);

- 规则引擎:20ms;

- 缓存写入:10ms。

很明显,模型服务是「耗时大户」——接下来聚焦模型服务。

步骤2:用系统指标找「资源瓶颈」

用Prometheus看模型服务的指标:

- CPU使用率:95%(已经快满了);

- 内存使用率:60%(正常);

- 网络带宽:10%(正常);

- 进程线程数:10(Flask默认单线程,开启了4个worker,但线程数没上去)。

这说明模型服务的并发能力不足——单线程的Flask无法处理高并发请求。

步骤3:用实时诊断找「代码问题」

用Arthas attach到模型服务的进程,执行thread命令查看线程栈:

$ arthas-boot.jar

$ thread -n 3 # 查看最忙的3个线程

结果发现:所有线程都卡在model.predict()方法上——原来我们用Python的Flask部署模型服务,而Flask是同步阻塞框架,每个请求都会占用一个线程,当并发超过200时,线程池满了,后续请求只能排队,导致延迟飙升。

其他常见瓶颈的定位案例

除了模型服务,我们还遇到过这些瓶颈:

案例1:特征服务的DB查询慢

- 现象:特征提取耗时从50ms涨到300ms,数据库IOPS达到瓶颈;

- 定位:用

show slow logs查数据库慢查询,发现SQL语句SELECT * FROM user_transaction WHERE user_id = ? AND data_id = ?没有走索引;用EXPLAIN分析,发现user_id和data_id没有建联合索引,导致全表扫描(表数据量1000万条); - 结论:SQL索引缺失导致DB查询慢。

案例2:缓存穿透导致DB雪崩

- 现象:缓存命中率只有50%,当缓存失效时,大量请求直接打DB,导致DB CPU使用率100%;

- 定位:查看Redis的

keyspace_hits和keyspace_misses指标,发现keyspace_misses占比50%;进一步分析缓存Key设计:用data_id+user_id作为Key,但有些data_id是无效的(比如商家上传的不存在的数据),导致这些请求无法命中缓存,直接查DB; - 结论:无效Key导致缓存穿透。

案例3:服务间通信延迟高

- 现象:定价服务调用模型服务的延迟从10ms涨到50ms;

- 定位:用SkyWalking看服务间的调用链路,发现模型服务部署在「上海机房」,而定价服务部署在「北京机房」,跨机房网络延迟约40ms;

- 结论:跨机房部署导致通信延迟高。

五、调优实战:从「卡慢崩」到「稳快顺」的五步曲

定位瓶颈后,调优的核心是**「针对瓶颈点,用最小的成本换最大的性能提升」**。我们总结了5类调优策略,每类都有具体的落地方法和效果对比:

1. AI模型服务调优:从「单线程」到「高并发+批量推理」

问题:Flask同步框架的并发能力不足,模型推理延迟高。

解决方案:

- 替换框架:用FastAPI(异步框架)+ Uvicorn(高性能ASGI服务器)替换Flask;

- 批量推理:将多个请求合并成一个Batch(比如Batch Size=16),一起送入模型计算(LightGBM支持批量推理,计算效率比单条高3-5倍);

- 模型量化:将模型的float32权重转换成float16(半精度),模型大小从200MB降到100MB,推理时间从200ms降到50ms。

效果对比(表2):

| 指标 | Flask(单线程) | FastAPI+批量推理 |

|---|---|---|

| QPS | 50 | 500 |

| 响应时间P95 | 500ms | 80ms |

| CPU使用率 | 95% | 60% |

代码示例(FastAPI的模型服务):

from fastapi import FastAPI, Request

import lightgbm as lgb

import numpy as np

app = FastAPI()

model = lgb.Booster(model_file='pricing_model.txt') # 加载模型

# 批量推理接口

@app.post("/predict/batch")

async def batch_predict(request: Request):

data = await request.json()

features = np.array(data['features']) # 输入形状:[batch_size, feature_num]

predictions = model.predict(features) # 批量推理

return {"prices": predictions.tolist()}

2. 特征服务调优:从「DB全表扫」到「缓存+索引+分库分表」

问题:特征提取的DB查询慢,IOPS瓶颈。

解决方案:

- 加联合索引:给

user_transaction表的user_id和data_id建联合索引,SQL查询时间从100ms降到20ms; - 缓存高频特征:将「近7天用户交易次数」「数据平均成交价」等高频特征缓存到Redis,过期时间设置为1小时,特征提取时间从50ms降到10ms;

- 分库分表:将

user_transaction表按user_id哈希分片,分成16张表,单表数据量从1000万降到62.5万,查询时间进一步降到10ms。

效果对比(表3):

| 指标 | 优化前 | 优化后 |

|---|---|---|

| 特征提取耗时 | 300ms | 30ms |

| DB IOPS | 90% | 30% |

| 缓存命中率 | 50% | 92% |

3. 缓存策略调优:从「随机失效」到「穿透+雪崩+击穿全解决」

问题:缓存穿透(无效Key)、缓存雪崩(同一时间大量失效)、缓存击穿(热点Key失效)。

解决方案:

- 布隆过滤器解决穿透:用Redis的布隆过滤器(Redisson实现)存储所有有效的

data_id,当请求的data_id不存在时,直接返回「数据无效」,不查DB; - 随机过期时间解决雪崩:将缓存过期时间设置为「基础时间+随机数」(比如1小时±10分钟),避免同一时间大量缓存失效;

- 热点Key永不过期解决击穿:对于「热门数据ID」(比如近7天成交率Top10的数据),设置缓存永不过期,每隔10分钟后台更新一次;

- 缓存预热:在系统启动时,将「近7天高频请求的Key」加载到Redis,提高初始命中率。

代码示例(布隆过滤器的实现):

// 用Redisson实现布隆过滤器

Config config = new Config();

config.useSingleServer().setAddress("redis://127.0.0.1:6379");

RedissonClient redisson = Redisson.create(config);

RBloomFilter<String> bloomFilter = redisson.getBloomFilter("valid_data_ids");

// 初始化:预计元素数量100万,误判率0.1%

bloomFilter.tryInit(1000000, 0.001);

// 添加有效data_id

bloomFilter.add("data_1001");

bloomFilter.add("data_1002");

// 检查data_id是否有效

boolean isExist = bloomFilter.contains("data_9999"); // 无效,返回false

if (!isExist) {

return "数据无效";

}

4. 服务间通信调优:从「HTTP」到「gRPC+同机房部署」

问题:跨机房HTTP调用延迟高,序列化开销大。

解决方案:

- 同机房部署:将模型服务从上海机房迁移到北京机房,网络延迟从40ms降到5ms;

- 替换通信协议:用gRPC(基于Protobuf序列化)替换HTTP(JSON序列化),序列化耗时从10ms降到2ms;

- 连接池优化:用gRPC的连接池(默认是长连接),减少每次调用的连接建立开销。

效果对比(表4):

| 指标 | HTTP(跨机房) | gRPC(同机房) |

|---|---|---|

| 调用延迟 | 50ms | 7ms |

| 序列化耗时 | 10ms | 2ms |

| 带宽占用 | 10MB/s | 2MB/s |

代码示例(gRPC的Proto文件):

syntax = "proto3";

package pricing;

// 模型推理请求

message PredictRequest {

repeated float features = 1; // 特征列表

}

// 模型推理响应

message PredictResponse {

float price = 1; // 预测价格

}

// 模型服务接口

service ModelService {

rpc Predict(PredictRequest) returns (PredictResponse);

rpc BatchPredict(stream PredictRequest) returns (stream PredictResponse); // 流式批量推理

}

5. 架构调优:从「同步」到「异步+弹性扩容」

问题:高并发下同步请求导致线程池满,系统崩溃。

解决方案:

- 异步化处理:对于「非实时定价请求」(比如商家批量上传数据的定价),用Kafka做消息队列,将同步请求改成异步处理——定价服务接收请求后,将任务发送到Kafka,后台消费线程处理,返回任务ID给用户,用户通过

/api/task/{id}轮询结果; - 弹性扩容:用K8s的HPA(水平 Pod 自动扩缩容),根据模型服务的CPU使用率(阈值80%)自动扩容Pod数量(最小2个,最大10个),应对突发流量。

效果对比(表5):

| 指标 | 同步架构 | 异步+弹性扩容 |

|---|---|---|

| 最大支撑QPS | 300 | 3000 |

| 系统崩溃率 | 10% | 0% |

| 资源利用率 | 50% | 85% |

六、案例复盘:大促前的「生死时速」调优

1. 背景

大促前1周,我们做了「3倍生产流量」的压测,结果:

- QPS=3000时,响应时间P95=1200ms,错误率15%;

- 模型服务Pod数量=2,CPU使用率100%;

- 特征服务的DB IOPS=95%。

2. 调优步骤(48小时内完成)

- Step1:模型服务扩容到10个Pod(HPA自动触发),CPU使用率降到60%;

- Step2:特征服务的DB加联合索引,查询时间从100ms降到20ms;

- Step3:缓存策略优化(布隆过滤器+随机过期时间),缓存命中率从50%升到92%;

- Step4:将「批量定价请求」异步化,Kafka消费线程处理,减少同步请求压力。

3. 结果

大促当天:

- 峰值QPS=3500(超过预期的3倍);

- 响应时间P95=180ms(远低于目标的500ms);

- 错误率=0.05%(几乎没有用户投诉);

- 模型服务Pod数量自动扩容到8个,CPU使用率75%。

4. 反思

- 压测环境必须1:1:之前用「小机器」压测,结果和生产完全不符,后来换成「生产级机器」才找到真实瓶颈;

- 关注全链路而不是单个模块:一开始只优化模型服务,结果特征服务又成了瓶颈,后来做了全链路调优才解决问题;

- 提前压测,预留缓冲时间:幸好我们提前1周做了压测,才有时间调优——如果等到大促前1天,肯定来不及。

七、结论:性能优化是一场「持续战役」

数据交易平台的AI定价系统,本质是「数据+模型+工程」的结合体——性能问题从来不是某一个模块的问题,而是全链路的问题。通过这轮调优,我们总结了3条核心经验:

- 压力测试要「真」:用真实数据、真实场景、真实环境,才能找到真实瓶颈;

- 瓶颈定位要「准」:链路追踪+系统指标+实时诊断,三者结合才能「精准打击」;

- 调优要「性价比高」:优先解决「占比高、成本低」的问题(比如模型服务的并发优化,比重构整个架构更有效)。

最后,我想对你说:性能优化不是「一锤子买卖」,而是持续迭代的过程——每次大促、每次用户量增长,都要重新做压力测试,重新定位瓶颈,重新调优。但只要掌握了这套方法论,你就能从容应对所有性能问题。

八、附加:参考文献与作者简介

1. 参考文献

- 《性能测试进阶指南:从入门到高级》(作者:刘亚琼);

- FastAPI官方文档:https://fastapi.tiangolo.com/;

- gRPC官方文档:https://grpc.io/docs/;

- Redisson布隆过滤器文档:https://redisson.org/docs/;

- LightGBM批量推理文档:https://lightgbm.readthedocs.io/。

2. 作者简介

我是陈默,资深软件架构师,10年+互联网技术经验,专注于数据交易平台、AI系统架构、性能优化。曾主导过3个亿级用户系统的架构设计,擅长用「工程思维」解决复杂技术问题。我的公众号「架构师实战笔记」会分享更多实战经验,欢迎关注。

行动号召

如果你正在做AI定价系统或类似的高并发系统,欢迎在评论区分享你的压测调优经验——比如你遇到过最棘手的瓶颈是什么?你是怎么解决的?或者你有任何问题,我都会一一解答。

最后,记得**「先压测,再上线」**——不要让你的系统在生产环境「裸奔」!

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献26条内容

已为社区贡献26条内容

所有评论(0)