Cursor套壳Kimi后续:甩技术报告自证,国产大模型或成赢家?

各位学弟学妹,最近 AI 圈的 Cursor 套壳 Kimi 的瓜想必大家都吃了,本以为这事会不了了之,结果 Cursor 直接放出了 Composer 2 的技术报告,摆明了要自证不是纯套壳,而是有技术地做二次开发。更有意思的是,人家不仅老老实实给 Kimi K2.5 署了名,还和 Kimi 官方和解了,就是网友们似乎并不买账。今天学长就带大家好好捋捋这份报告里的门道,还有另一边 Kimi 团队杨植麟的最新观点,看完你就知道国产开源大模型现在到底有多顶。

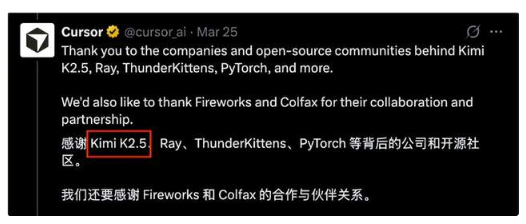

Cursor 这次的技术报告,开篇态度那叫一个诚恳,先夸了一波友商 Kimi。他们说训练前评估了 GLM5、Kimi K2.5、DeepSeek V3.2 等多款开源基础模型,最终选定 Kimi K2.5,不仅是因为它综合能力突出,还考虑到自研基础设施中的执行效率这些附加因素。不得不说,经此一事,Cursor 算是把中国开源模型的 “体面” 学透了。

选定基础模型后,Composer 2 并非直接拿来用,而是做了两步独立的自研训练,这也是这份报告的核心,学长给大家拆解清楚:

第一步是持续预训练,核心目的就是提升模型在编码领域的能力,为后续训练打基础。整个过程分三个阶段,先主攻 32k token 序列长度的训练,再把序列长度扩展到 256k,最后通过小样本指令调优适配特定代码任务。为了提升线上推理速度,还新增了多 token 预测层,结合投机解码和自蒸馏策略保证收敛。从训练数据来看,模型在自研代码库的损失值呈对数线性下降,能证明这次预训练是真的有效果。

第二步是异步强化学习,这一步的训练环境完全模拟真实的 Cursor 对话场景,覆盖了各类软件工程核心任务。训练框架基于大规模策略梯度,还用了单指令多样本的算法保证稳定性,同一指令只参与一次训练,用 Adam 优化器更新全部参数。另外还优化了 GRPO 算法,移除长度标准化项避免偏差,引入 KL 散度做正则化。而且团队发现,模型的平均性能和 best-of-K 性能是同步提升的,这说明强化学习不仅优化了推理路径,还让正确解的覆盖范围更广了。

除此之外,Composer 2 还加了辅助奖励机制,代码风格、交互表达做得好会有正向奖励,不当调用工具会有产品级惩罚,还能根据训练中的模型行为动态调整奖励规则,这一点能看出是真的结合了实际使用场景做优化。

为了验证效果,Cursor 还搞了个自研的内部评估集 CursorBench,和常见的 SWE-bench 比起来,这个评估集的任务都来自真实的 Agent 使用场景,评判标准也不只是看功能对不对,还会考量代码质量、执行效率、智能体交互等多个维度。数据上的差距也很明显,CursorBench 的代码修改量中位数有 181 行,而 SWE-bench 验证集和多语言版只有 7-10 行;指令提示也更简洁,中位数 390 字符,远低于公开基准测试的 1185-3055 字符。

从测试结果来看,Composer 2 在 CursorBench-3 的准确率能到 61.3%,对比自家 1.5 版本提升 37%,对比 1 版提升 61%,和原版 Kimi K2.5 比,准确率也有大幅提升。成本层面更是实现了帕累托最优,推理成本和小模型相当,精度却能媲美前沿大模型,Token 使用效率也和其他 SOTA 模型持平,没有额外的资源消耗。说句实话,这波操作下来,Composer 2 简直就是 Kimi K2.5 的海外 pro 版,而且 Cursor 还把基础模型和技术报告都开源了,也算是另一种意义上的 “全员套壳支持国产开源模型” 了,只要记得署名,其实也没啥毛病。

这边 Cursor 还在为套壳风波找补,另一边 Kimi 早就把目光放到了未来,杨植麟在中关村论坛的演讲里,分享了团队对开源模型和模型训练的最新思考,学长觉得这些观点对理解 AI 行业的发展特别有帮助,大家一定要记好。

首先,杨植麟认为大模型的本质是把能源转化为智能,核心是要规模化,但规模化不是无脑堆算力,而是讲方法、讲效率。Kimi 自己的 Scaling 策略主要有三点:一是提升 Token 效率,用有限的数据学到更多智能,这才是模型的核心竞争力;二是扩展上下文长度,Kimi 不是简单拉长窗口,而是专门设计了 Kimi Linear 网络架构和训练数据,从根本上提升长上下文处理能力,能应对更复杂的长程逻辑任务;三是引入 Agent 集群,这是 Kimi K2.5 的新思路,不执着于把单个模型做到极致,而是让一群 Agent 协作解决复杂问题,实现规模化的输入、输出和执行。

其次,好的底层网络架构也至关重要。Kimi 最新开源的注意力残差架构,算是把注意力应用在网络深度上的 LSTM 变种,能让模型更高效地利用各层信息。其实注意力架构、残差学习都是多年前的经典技术,现在算力更强了,研究也更偏向工程化和大规模验证,过去的标准答案也可以被重新挑战和改进,这也是 AI 研发的核心思路之一。

关于开源,Kimi 的态度很明确:要做,还要大力做。现在开源模型已经逐渐成为新的行业标准,Kimi K2.5 更是成了全球芯片厂商测试硬件性能的基准,很多研究机构也在用它做研究。通过开源让大家以低门槛获取智能,最终形成开源生态,才能共同推动 AI 领域的发展,这一点也能看出国产大模型的格局。

最后,杨植麟还断言,大模型训练已经进入第三阶段了,学长给大家梳理一下这个阶段划分,能清晰看到行业的发展趋势:2023 和 2024 年,大模型训练主要靠天然数据,辅以少量人工标注;2025 年,行业更重视人工筛选高质量任务,搭建大规模强化学习系统;而从 2026 年开始,AI 研发流程会迎来重大变化,研发主体会从人转向 AI,AI 会自己合成任务、构建训练环境、探索新模型架构,研究员更多是提供算力和 Token 资源。简单说,就是从 “人采数据” 到 “人选任务”,再到 “AI 自主训练”,AI 会从被训练者,变成研发的参与者甚至主导者,未来 AI 的研发速度,只会比我们想象的更快。

看完这两件事,学长最大的感受就是,国产开源大模型已经走到了世界前列,Kimi K2.5 能被海外企业当作基础模型做二次开发,还成为行业基准,这本身就是实力的证明。而 Cursor 的这次操作,也从侧面印证了国产大模型的技术价值,未来随着开源生态的完善,相信会有更多人参与到国产 AI 的研发中,这才是行业发展的核心动力。不知道大家对 Cursor 的技术报告,还有 Kimi 的未来布局有什么看法,欢迎在评论区和学长一起交流。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献10条内容

已为社区贡献10条内容

所有评论(0)