用于多标签疾病诊断和可解释的图像内和图像间原型学习。

论文总结

1、有开源代码https://github.com/cwangrun/CIPL

2、提出一种图像间和图像内的原型学习框架,用于从医学图像中进行准确的多标签疾病诊断和解释。

3、提出一种新的基于两级对齐的正则化策略,有效地利用了一致的图像内信息,以增强模型的鲁棒性和预测性能。

摘要

原型学习的最新进展已经显示出巨大的潜力,可以提供有用的决策解释,将激活图和预测与特定类别的训练原型联系起来。这种原型学习对于各种单标签疾病已经有了很好的研究,但是对于相关性较高且更具挑战性的多标签诊断,在图像中多种疾病往往是并发的,由于多种疾病的纠缠,现有的原型学习模型很难获得有意义的激活图和有效的类原型。在本文中,我们提出了一种新颖的跨图像和图像内的原型学习( CIPL )框架,用于从医学图像中进行准确的多标签疾病诊断和解释。 CIPL利用常见的图像间语义,在学习原型时对多种疾病进行拆分,可以对复杂的病理病变进行全面的理解。此外,我们提出了一种新的基于两级对齐的正则化策略,有效地利用了一致的图像内信息,以增强解释的鲁棒性和预测性能。大量实验表明,我们的CIPL在两个公共的疾病诊断多标签基准测试集:胸片和眼底图像中达到了最先进的分类精度( SOTA )。定量的可解释性结果表明,CIPL在弱监督的胸部疾病定位中也比其他领先的基于显著性和原型的解释方法具有优势。

引言

近十年来,深度学习[ 1 ] [ 2 ],如深度神经网络( deep neural networks,DNNs ),在支持医疗领域的疾病诊断和治疗方面取得了成功,包括疾病分类[ 3 ] [ 4 ] [ 5 ] [ 6 ]、病灶检测[ 7 ] [ 8 ]、器官分割[ 9 ] [ 10 ] [ 11 ]等。通常,DNNs需要复杂的网络架构、高维的特征表示和大量可训练的网络参数,在解释模型的内部机制和深入了解模型如何进行预测方面面临重大挑战。因此,DNNs通常被认为是黑盒模型[ 12 ]。 然而,在对人类生活有深远影响的安全关键医疗应用中,人们越来越需要使用可解释的深度学习疾病诊断算法,这些算法可以被人类专家毫不费力地理解和信任[ 12 ],[ 13 ]。大多数现有的疾病诊断算法试图通过典型的基于事后解释的显著图来提高模型的可解释性或透明性[ 14 ] (例如, CAM及其变体 ,视觉注意 ,反事实例子和遮挡敏感性)。 然而,这些方法有许多缺点,例如:1 )显著图只给出了与模型预测相关的图像区域的空间重要性,但它们没有解释这些图像区域是如何用于预测的,这不足以解释模型的内部工作[ 12 ],[ 13 ];2 )对于不同的类别,显著图可能基本相同,如文献[ 12 ]中所述;3 )事后解释往往是不可靠的,甚至是误导性的,因为它们不参与模型的训练来惩罚解释错误,除非使用额外的正则化训练目标[ 19 ],[ 20 ]来约束显著图。这些缺陷通过原型学习[ 21 ],[ 22 ]的模型可解释性得到缓解,如图所示 1 ( a ),它利用了自解释模型[ 23 ],[ 24 ],[ 25 ] .该策略的基本思想是训练模型从训练样本中自动学习特定类别的原型(图像级 ,区域级[ 23 ] ,或像素级[ 25 ] , )。然后,通过将测试样本与学习到的原型进行比较来进行预测解释,从而帮助解释模型的内部工作。这种自我解释策略依赖于训练-测试样本关联进行决策,这类似于认知心理学研究中的人类推理[ 27 ],[ 28 ],揭示了人类在学习解决问题时使用过去的案例作为模型。正因为如此,直觉上,最近的研究成功地将其用于单标签分类问题,例如,乳腺癌[ 29 ],糖尿病视网膜病变[ 30 ]和阿尔兹海默症[ 31 ]的诊断和解释,其中类特定的原型可以从相应类的单标签训练样本中清楚地学习。然而,基于原型的解释策略在多标签分类问题中的应用面临着严峻的挑战,这主要是由于多标签样本的复杂性,这些样本内在地交织了来自多个类别的代表性疾病特征。 这种复杂性对特定类别原型的有效学习提出了重大障碍,导致原型与多类疾病特征高度纠缠。在本文中,我们通过跨图像和图像内的原型的学习( Cross-and Intra-image原型的Learning,CIPL )来解决多标签疾病诊断和解释问题。我们的CIPL方法的总体动机如图1所示。

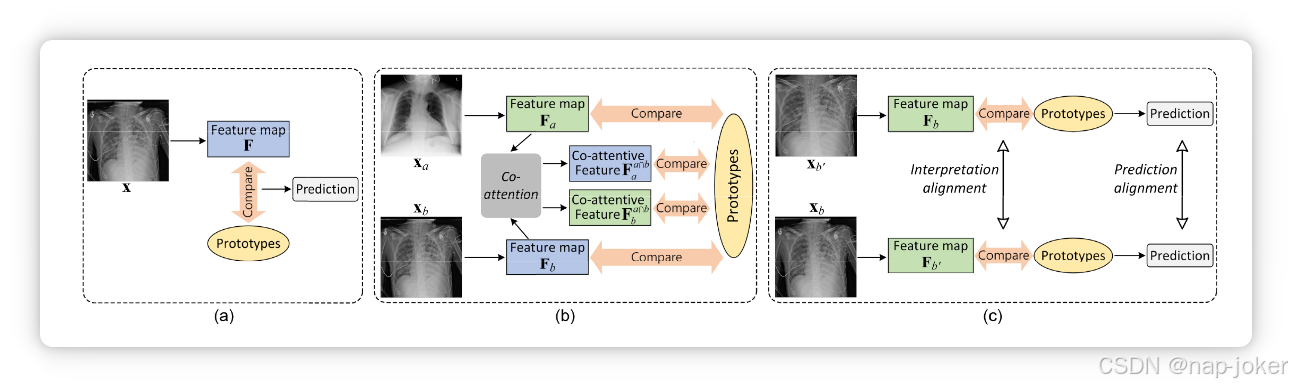

图1 .在多标签学习中,( a )传统的原型学习策略仅考虑个体图像信息,直接从训练样本中存在的纠缠的多种疾病中学习类原型;( b )我们的跨图像原型学习策略利用成对图像的共同语义,从解耦的多种疾病中学习类原型;( c )我们的图像内原型学习策略利用图像的成对增强视图之间的一致线索来调节解释和预测。

与图1 ( a )中传统的原型的学习策略仅从包含多个类别疾病特征纠缠的多标签训练图像中学习类别原型相比,本文提出利用成对图像共有的跨图像语义,以联合注意力对多类别疾病特征进行解纠缠,如图1 ( b )所示。 通过这种方式,我们的CIPL方法使类原型能够获得对每个疾病类的病理病变的全面理解。此外,为了获得稳健的解释和改进的分类,我们的CIPL进一步利用了图像不同视图之间一致且有意义的图像内线索,如图1 ( c )所示。这是通过一个基于两级对齐的范式来实现的,该范式以自我监督的方式来规范模型的解释和预测。总体而言,图像间和intra - image策略可以互补地从多标签训练样本中有效学习类原型。 总的来说,我们的主要贡献如下:

1 )我们提出了CIPL方法来解决基于原型学习的多标签疾病诊断和解释。CIPL利用丰富的图像间语义和一致的图像内线索来互补地促进从多标签图像中学习原型。

2 )提出了一种新的多疾病解耦策略,通过发现多标签样本之间共同的图像间语义,使类原型能够全面地理解病理病变。

3 )提出了一种新的基于两级对齐的正则化方法,该方法利用一致的图像内信息来提高解释的鲁棒性和预测性能。 在两个公开的多标签数据集上的大量实验表明,我们的CIPL达到了最先进的( SOTA )疾病诊断和解释结果。

相关工作

多标签疾病诊断

从计算机视觉等通用领域来看,多标签分类( multi-label classification,MLC )在各种场景下得到了广泛的研究[ 32 ] [ 33 ] [ 34 ] [ 35 ],例如处理类别标签不平衡[ 32 ]和探索标签之间的依赖关系[ 33 ]。例如,DB-Focal [ 32 ]设计了一种分布均衡损失来解决长尾多标签场景下的负标签占优问题。C-Tran [ 33 ]使用卷积神经网络( CNN )编码器从图像中提取视觉特征,使用视觉转换器编码器捕捉视觉特征和标签之间的复杂依赖关系。CPCL [ 36 ]通过类别原型来利用多标签图像的组成性质来提高分类性能。 近年来,MLC在医学影像领域的多标签疾病诊断中得到了广泛的应用,其中最常见的是胸部X光片中的胸部疾病[ 37 ],[ 38 ],[ 39 ],[ 40 ],[ 41 ],[ 42 ],[ 43 ]。例如,Che XNet [ 37 ]使用深度密集卷积网络( Dense Net121 )对胸部放射学进行分类,达到了放射科医生级别的肺炎检测性能。MAE [ 44 ]通过使用现代自监督技术,例如掩膜自编码器[ 45 ],对DenseNet121网络进行预训练,进一步提高了性能。Ana XNet [ 46 ]采用图卷积网络对多标签胸片中疾病标签之间的依赖关系以及解剖区域之间的关系进行建模。在[ 16 ]中,一个分层的(即. 针对胸片图像的多标签胸部疾病诊断与定位,提出了一种前景、阳性、异常)注意力挖掘方法。在[ 38 ]中,通过利用X射线的两种视觉特征,开发了一种多模态胸部疾病推理框架。疾病知识的图像和图嵌入。MARL [ 47 ]提出了一种用于胸部X线分类的深度强化学习框架,使诊断代理具有探索性,并有助于提高分类精度。Thora X- Prior Net [ 48 ]同时利用疾病特异性先验和肺部区域先验作为指导,关注有意义的解剖区域,用于增强胸部疾病分类。在[ 49 ]中,我们设计了一个名为TA - DCL的框架,它结合了三元组注意力和双池对比学习,用于医学图像中的通用多标签分类,包括胸部和眼科疾病。 最近的研究[ 50 ],[ 51 ],[ 52 ],[ 53 ]已经转向开发基于视觉语言预训练技术的胸部X射线基础模型,在一些广泛使用的公共基准上显示出领先的性能。尽管取得了令人鼓舞的结果,上述方法大多依赖于黑盒深度学习模型,这些模型只能产生对人类用户可解释性较差的诊断结果,这可能阻碍其成功转化为现实世界的临床实践。相比之下,可解释的深度学习模型不仅可以提供诊断预测,还可以阐明其决策背后的推理。 这种透明性对于模型调试是非常有益的,因为它允许在错误或意外预测发生时分析错误行为[ 12 ]。

可解释性的原型学习

原型学习的概念可以追溯到文献[ 21 ],其中开创性的原型网络旨在学习一个度量空间,通过计算每个类的原型表示的相似度来进行分类。在[ 21 ]中,原型是图像级的,因为它们被估计为每个类的整个图像的嵌入特征向量的平均值。源于[ 21 ],一些后续研究在图像分类中引入了模型解释的原型学习思想。 其中一个重要的代表是Proto PNet [ 23 ] [ 54 ],它从每个类的训练图像中自动学习区域级的原型来表示对象部件,然后通过评估测试图像和学习的训练原型(原型部件)之间的相似性来实现可解释的推理。由于这种样本驱动的特性,一些工作扩展到使用像素原型来提高语义分割模型的透明度[ 22 ],[ 25 ]。最近,原型学习已经被探索用于单标签疾病诊断和解释,例如,糖尿病视网膜病变分级[ 30 ],乳腺癌筛查[ 29 ],[ 55 ]和阿尔茨海默病检测[ 31 ]。 在这些单标签任务中,通过直接从相应类别的单标签训练样本中学习,可以很容易地获得特定类别的原型,以捕获具有代表性和判别性的视觉模式。然而,对于更具挑战性的多标签问题,一个训练样本往往同时与多个标签相关联。这表明多个类的判别特征纠缠在一起,破坏了类原型的有效学习。为了克服这个问题,我们提出了一种带有共同注意力机制的十字象原型学习策略,以解开多个类的疾病特征,使类原型能够全面地表示每个疾病类的病理病变。 此外,我们还提出了一种基于两级对齐的正则化策略,利用一致的图像内线索来获得稳健的解释和改进的分类。

方法

我们介绍了我们的CIPL方法,用于从医学图像中诊断和解释多标记疾病。给定一组带有图像级标签的训练图像,CIPL被训练来自动学习每个类的区域级原型,这些原型编码具有代表性和判别性的视觉特征,例如。(病变组织或正常组织)。由于我们针对的是多标签问题,CIPL进一步充分利用了额外的跨图像和图像内信息,从而有利于类原型的学习。在测试过程中,CIPL通过评估测试图像与训练图像区域的类原型之间的相似性来实现可解释性推理。 用D = { ( xa , ya) } | D | a = 1表示训练集,其中x∈X┐RH × W × 3是一个大小为H × W且具有3个颜色通道的图像,ya = [ y1 , y2 , ... , yC],⊤∈Y┐{ 0,1 } C表示图像级的类标号,其中C表示所有可能的疾病标号的个数,yc是一个二值指示子,即如果图像xa中存在标号c的疾病,则yc = 1,否则yc = 0 .与传统的MLC一样,我们将多疾病诊断问题描述为每个C疾病标签的二分类问题(一种疾病vs .无发现/正常)。换句话说,我们的CIPL通过将测试图像与每个疾病类的原型以及无发现类的原型进行比较,实现了可解释的多标签预测。 如果存在多个疾病类别,其与各自类别原型的相似度大于未找到疾病类别的相似度,则将测试图像与所有这些多个疾病标签进行分类。

方法概述

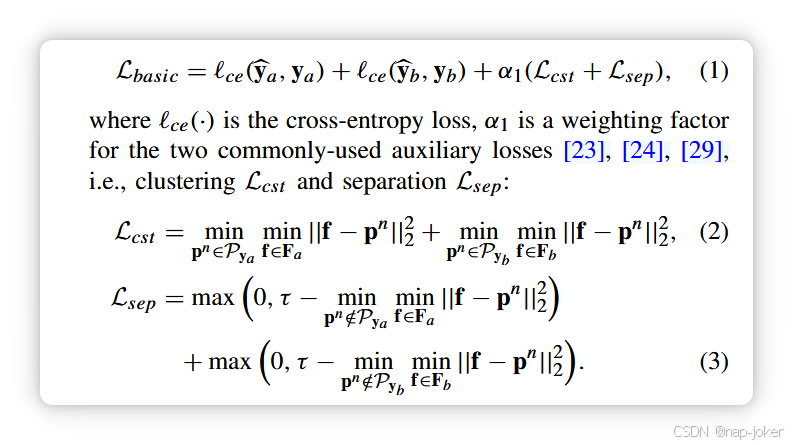

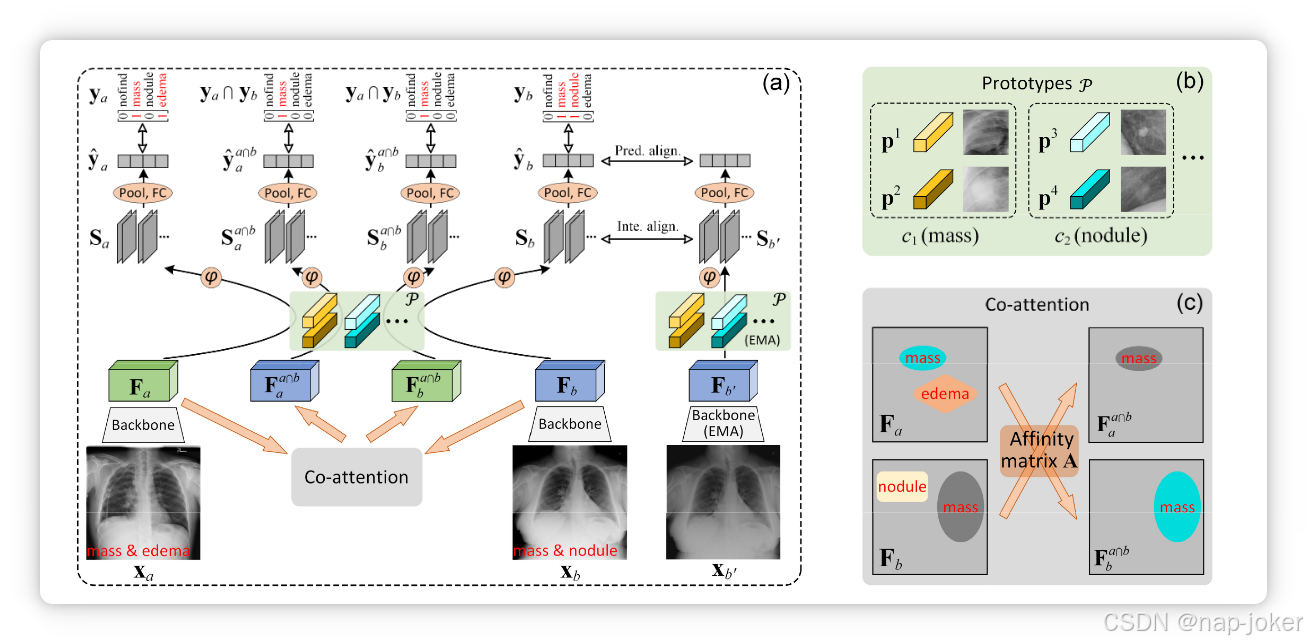

我们的CIPL概述如图2所示,其中训练图像对,用xa,xb表示,从D中采样,然后送入相同的特征骨架f θ f:X→F (以θ f为参数),以提取特征映射Fa,Fb∈F┐RH ̄× W ̄× D,其中D表示特征维数,通常H ̄< H,W ̄< W.遵循原型学习的一般协议[ 23 ],[ 24 ],[ 29 ],原型层φ P:F→S学习N = M( C + 1 )类特定的原型P = { pn } Nn = 1,每个类有M个原型(包括没有发现的原型),pn∈R1 × 1 × D,如图2所示( b ) .原型层计算特征映射Fa,Fb与原型P,e.g .,Sn,( i , j)a = exp - | | F( ai , j) - pn | | 2 2 / D之间的相似映射Sa,Sb∈S RH ̄× W ̄× N,其中i∈{ 1,..,H ̄},j∈{ 1,..,H ̄} .二元任务,每个任务对应一种疾病vs .无发现。最后,利用softmax函数得到C个二元概率预测Δ ρ ya,Δyb∈RC × 2。我们的CIPL方法的基本训练目标定义如下:

以训练图像xa为例,式中的聚类损失Lcst为:( 2 )保证图像在Fa中至少包含一个局部特征向量f∈R1 × 1 × D,且接近于其所属类(用集合Pya表示)的原型之一,而在Eq中的分离损失Lsep。( 3 )迫使Fa的所有特征向量远离属于其他类的原型(具有正的边界τ)。到目前为止,我们的CIPL遵循传统的训练策略,如目前的方法(例如, Proto PNet )中只考虑个体图像信息进行原型学习。然而,由于多类疾病特征在多标签样本中的纠缠而产生了挑战,这极大地阻碍了类原型的有效学习。 为了解决这个问题,我们在第三节- B中描述了我们的CIPL如何通过一个联合注意力额外挖掘十字象语义,以方便从多个类别中解开疾病特征,使原型对各种病理损伤模式有更精确和全面的理解。同时,我们进一步提出了一种基于两级对齐的策略,通过利用一致的图像内信息来规则化原型学习,如第III - C节所述。

图2 . ( a )我们提出的用于多标签疾病诊断和解释的CIPL方法的体系结构。CIPL利用联合注意力从成对图像xa和xb中挖掘图像间语义,目的是从多标签训练样本中学习解耦的类原型。CIPL还规范了原型的学习,增强图像视图之间的解释和预测一致性,例如,xb和xb′;( b )为每个疾病类(这里我们举例说明每个类的两个原型)编码代表性病理病变的原型实例;( c )联合注意力提取成对图像之间的共同语义,用于多类疾病的拆解。

基于共同注意力的跨图像原型学习

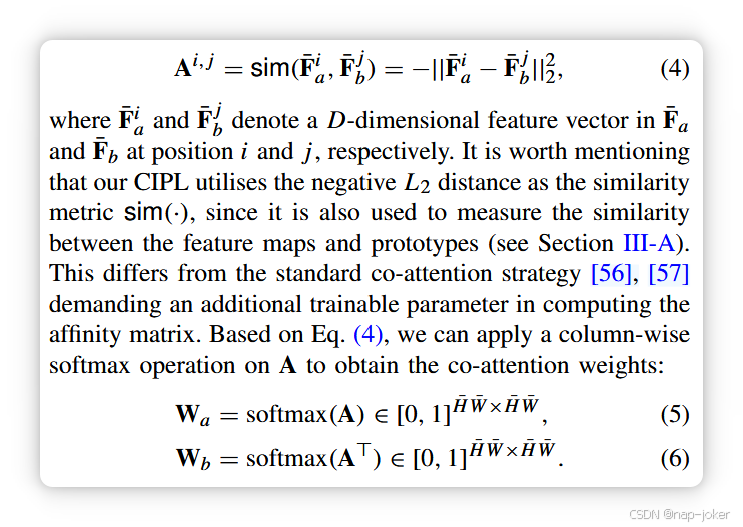

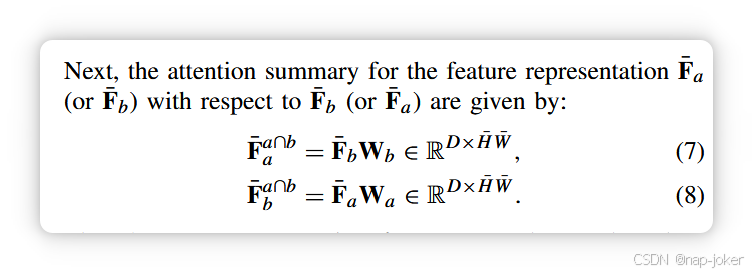

在多标签诊断问题中,标签共现通常会导致与多种疾病相关的特征纠缠在一起,这是有效地从多标签样本中学习特定类别原型的首要障碍。在这一部分中,我们提出了一种解耦这些纠缠特征的解决方案,目的是提高多标签问题中类原型的学习。为了实现这一点,我们利用了成熟的协同注意力技术[ 56 ],[ 57 ],[ 58 ]来利用图像间信息。协同注意力已经被证明可以有效地捕获不同实体之间的潜在关系,例如,视觉语言导航[ 59 ]和视频分割[ 57 ]。 受共同注意力机制的一般思想启发,我们的CIPL方法利用它来发现成对训练图像中的共同语义,这增强了多疾病特征解耦,并允许类原型捕获复杂病理病变的视觉模式。如图2 ( a )所示,我们的CIPL方法关注的是特征空间中的图像对,即xa,xb,其中两幅图像共享一个公共标签,记为ya∩yb。具体来说,首先将Fa和Fb转化为矩阵,记为F ~ a和F ~ b∈RH ~ W ~ × D,并令。计算一个亲和力矩阵A∈RH ~ W ~ × H ~ W ~,每个项计算如下:

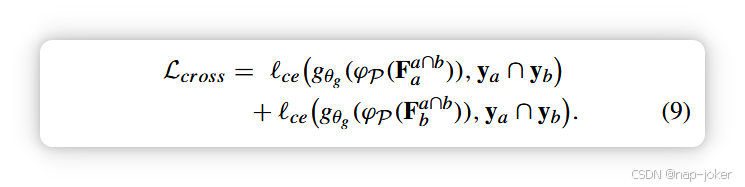

然后,对上述两个共注意特征进行重塑,以恢复它们的空间维度,即Faa∩b和Fa∩b∈R H ̄× W ̄× D,它们应保持Fa和Fb之间的共同语义,并集中于xa和xb中的共享对象区域( e.g. ,同一疾病类别的病理病变)。这样,对类别敏感解耦后的特征就可以被很好地提取出来( (见图2 ( c )) ),从而有利于类原型的学习。因此,通过与P中的原型进行比较,将协同注意力特征纳入原型层φ P ( · ),其预测输出以公共标签ya∩yb:进行监督。

考虑图2中的插图,其中肿块和水肿存在于xa中,而肿块和结节存在于xb中。由于共注意力本质上是在xa和xb之间的所有特征位置对之间进行的,因此在共注意力特征Faa∩b和Fa∩b b中只保留了具有共同语义的疾病mass。当使用常见的标签mass作为监督信号时,mass原型将唯一地与相应的肿块区域解缠特征相关联,以全面准确地理解病理性肿块病变。 从另一个角度来看,两个相关图像的共同注意力使得我们的CIPL能够意识到保留在xa和xb中的语义是相关的,并且可以被利用来共同学习有效的原型来识别群体性疾病。它本质上利用了跨训练数据的上下文信息。除了利用相关十字象语义的基于共同注意力的原型学习策略外,我们进一步开发了一种基于对齐的原型学习范式,该范式可以在训练图像的不同视图之间挖掘一致且有用的图像内线索,在接下来的第三节- C中介绍。十字象和图像内策略提供了一种互补的方式,以帮助模型从多标签样本中获得有效的原型。

基于对齐的图像内原型学习

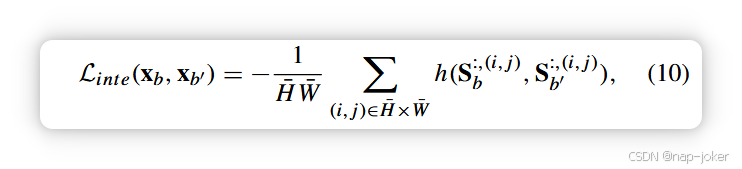

继承自现有基于原型的方法的优势,我们提出的CIPL方法不仅为疾病诊断提供分类预测,还通过呈现一组相似性图谱,提供了有前景的可解释推理。这些地图与训练图像中得出的疾病代表性原型相关联,提供了疾病解释的透明过程。为了促进解释的鲁棒性和预测性能,我们提出了一种基于自监督的对齐方法,通过利用图像视图之间一致且有意义的图像内信息,规范原型学习和模型预测。根据流行的自监督学习技术[60],我们采用两种不同的视角,分别记作xb、xb′,并从同一训练图像中增强,如图2(a)所示。由于我们的CIPL通过训练原型的相似映射实现模型解释,我们建议通过强制两个输入视图之间的解释一致性来利用图像内线索。这被表述为两个图像视图中相似映射Sb和Sb′之间的空间对齐,具体如下:

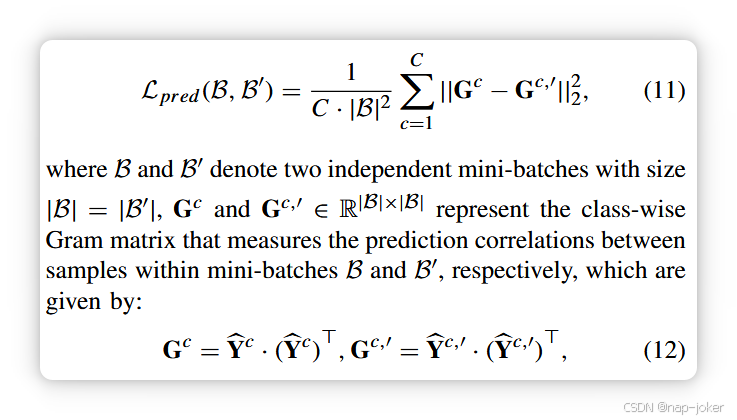

其中 h(·) 计算余弦相似度。在方程(10)中,我们的CIPL致力于构建具有不同结构和表现特征的病理病变的稳健原型。除了解释比对外,我们还提出加强两个图像视图分类预测的比对,其中一个简单的解决方案是最小化两个视图中概率预测的KL散度,针对每个训练样本。然而,我们通过实验发现,这种解法并未显著提升预测性能(详见我们的实验)。因此,我们通过进一步考虑样本关系,设计了一种新的批次级比对策略,其表述如下:

其中 ̂Y = [̂ y1,̂ y2, . . ,̂ y|B|], ̂Y′ = [̂ y′ 1,̂ y′ 2, . . ,̂ y|B′|]∈ R |B|×C×2,分别表示对所有小批次B和B′训练样本的概率预测。注意,在方程(11)和(12)中,我们省略了定义同一图像不同视图的符号b、b′,以保持定义不杂乱。

为了实现稳定训练,我们采用了著名的动量更新技术[61],构建了一个指数移动平均(EMA)模型,θetm+a1 := λθetma + (1 − λ)θ t ,其中λ = 0.999为动量系数。在训练过程中,一个图像视图(如xb)被输入到当前模型,另一个视图xb′输入到EMA模型。训练完成后,EMA模型可以被丢弃。

总体训练目标

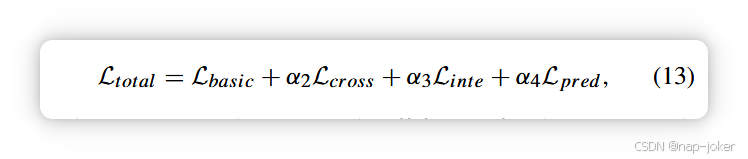

我们已引入CIPL方法的所有培训组成部分,用于多标签疾病诊断和解读。总体培训目标如下:

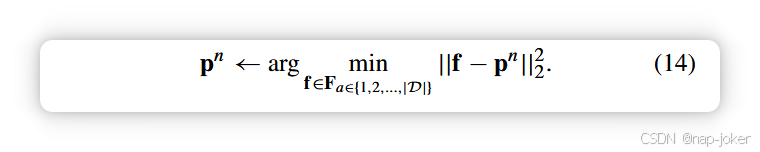

其中α2、α3和α4是相应损失项的权衡因子。为了使P中的所有原型都能用实际的训练图像补丁表示,我们在每个训练轮数后,用对应类别[23]、[24]中最接近的训练补丁特征替换每个原型pn,用

这一步确保原型的透明性(即将其置于人类可理解的图像空间中),从而通过根据测试图像与训练样本原型的相似性对测试图像进行分类,实现基于案例的可解释性。为了促进原型捕捉到的视觉模式的丰富性和多样性,在方程(14)中,我们采用了贪婪原型替换策略[29],确保所有原型均源自完全不同(非重复)的训练图像。具体来说,如果观察到重复原型,替换步骤会使用下一个最相似的训练图像补丁。 此外,方程(14)也用于可视化所学类原型(见第四节图3),如[23]、[24]。与为单标签问题设计的传统原型学习方法[23]、[24]、[29]相比,我们的CIPL方法没有引入任何过多的可学习网络参数。在训练阶段,由于亲和矩阵的计算,CIPL会带来适度的计算开销增加,但在测试阶段则不需要额外的计算资源。

实验

数据集

本研究利用两个公开基准数据集验证我们提出的CIPL方法在多标签诊断和解读中的有效性,分别是胸椎疾病在NIH ChestX-ray14 [62]和眼科疾病在眼病智能识别(ODIR)[63]上的应用。多标签NIH ChestX-ray14数据集[62]包含112,120张胸部X光图像,包含14个胸椎疾病标签及一个“无发现”标签,这些数据来自30,805名患者。在ChestX-ray14中,880张图像被注释,配有984个边界框,指定了8个疾病类别中的疾病区域。在我们的实验中,原始X光片被调整为H = W = 512,同时使用ChestX-ray14进行胸椎疾病的分类和弱监督定位。

疾病分类:我们的实验设置严格遵循官方的列车/检测分段[62]。分类结果采用AUC、F1评分和准确性评估,我们遵循之前的研究[51]、[52],确定计算平均F1分数和准确度的阈值。弱监督疾病定位:我们平均类别激活图谱,生成阈值为0.5的二元定位掩码。与以往的定位方法一致 [16], [64]我们的方法仅依赖图像级训练标签,训练涵盖所有111,240张图像,且无任何框标注。然后对剩余880张带有框标注的图像进行测试。定位表现通过阈值IoU准确率[16]评估,定义为正确定位病例与各疾病类别总病例的比例。正确的定位由预测与真实定位掩码之间的IoU分数决定,且应超过预先定义的IoU阈值T(IoU)。ODIR [63] 是一个公开的彩色眼底图像数据库,包含多标签眼科疾病。在ODIR中,左右眼共计10,000张图像,涵盖5,000名患者。标签针对每位患者提供,包括正常、糖尿病、青光眼、白内障、老年黄斑变性(AMD)、高血压、近视及其他疾病。ODIR还提供与每张眼底影像相关的详细诊断关键词,允许重新标记图像并进行眼平分类。在本研究中,我们采用[65]中的重新标记程序实现眼平诊断。我们的实验遵循官方的列车/测试分段[63],即整个ODIR被划分为列车组(6970张图像)、现场测试组(1972张图像)和场外测试组(991张),排除低质量图像(如镜头灰尘、图像偏移和隐形光学盘),如[63]、[65]。原始眼底图像经过自动圆形边框裁剪过程,随后调整尺寸为H = W = 640作为模型输入。我们报告AUC、F1评分和准确度指标以评估分类表现。

实验配置

我们提出的方法采用了类似CNN的特征骨架fθ f(胸部X光采用DenseNet-121[71],眼底影像采用ResNet101[72]),这些方法与主流以往研究一样,在ImageNet上预训练。为实现严谨的模型评估,我们完全使用两组数据集提供的官方训练/测试数据,未引入任何额外数据或测试时间增加,如[73]所示。通常,输入图像会被骨干 fθ f 下采样 32 次,因此 H ̄ = H 32,W ̄ = W 32 。通过在 fθ f 后附加两个 1 × 1 卷积层(一个由 ReLU 激活,另一个由 Sigmoid 激活),我们得到了特征维数 D = 256。在这两种任务中,我们每类采用 M = 50 个原型,因此 X 光和眼底图像分别采用 N = 750 和 400 个原型。我们的CIPL采用PyTorch平台实现,并使用带有迷你批次大小的Adam优化器训练 |B|= |B′|= 24,初始学习率为10⁻⁻,达到稳定表现后每5个时代降低0.5个速率。在方程(3)中,我们有边际τ=2。方程(1)和方程(13)中的权重因子设定为α1 = 0.02,α2 = α3 = α4 = 0.5。我们首先仅用式(1)中的Lbasic训练CIPL以热身模型,然后使用方程(13)中的整体目标L总来训练模型40个历时。我们的方法会用不同的随机初始化种子进行五次运行,结果会从中报告。在第三节-C中,我们的图像内原型学习策略依赖于两个增强图像视图xb和xb′。然而,这两种观点在空间上不应有剧烈的差异,因为方程(10)在空间层面强制执行相似映射的解释对齐。为此,我们设计了一个两步增强方案。第一步应用基本的定位导向变换,包括缩放、剪切、旋转、平移和翻转,以增加训练集的多样性。这张增强图像作为下一步的输入,下一步应用色彩导向的变换,涉及对比度、亮度、锐度和色调的变化。为了在两种视角之间引入更多变化,我们还使用了输入95%到100%大小的随机裁剪,宽高比在0.95到1.05之间。这样,两种视角之间的细微位置差异进一步纳入,但特定位置的病理病变大致对应于两视角中的同一区域,因此有助于获得一致且稳健的原型。值得注意的是,增强应保留图像的关键语义特征,同时避免过度修改,以免扭曲底层类别特征。因此,我们通过变化所用增强的强度进行一系列实验,将增强应用于训练图像,并监控模型在测试集中的表现。最优的增强集合是基于观察到的最佳表现来确定的。我们的代码将公开,更多增强细节可由此获得。

对比方法

胸部X光分类:我们首先比较现有领先的多标签X光分类方法[3]、[16]、[37]、[44]、[46]、[47]、[48]、[49]、[50]、[51]、[52]、[62]、[66]、[67],这些方法在第二节-A中介绍。此外,我们还比较了基于主要为单标签任务设计原型的先进可解释方法:ProtoPNet [23]、XProtoNet [70]、ProtoPNet++ [29]、可变形 ProtoPNet [24]和 PIP-Net [69]。ProtoPNet [23] 是利用区域级原型进行可解读图像分类的原始工作,并以此为我们建立CIPL的基线。XProtoNet [70] 依赖 ProtoPNet,进一步将原型与疾病发生图整合。ProtoPNet++ [29] 提出了一种两分支方法,将 ProtoPNet 与不可解释的全局深度学习分类器进行集成。可变形的ProtoPNet[24]利用空间灵活的原型机,自适应地捕捉自然图像中物体特征的变化。PIP-Net [69] 首先预训练了类无关的原型,然后对原型类连接稀疏性进行了规范化,以实现紧凑分类解释。

眼底影像分类:鉴于对多标签眼底影像诊断研究有限,我们首先将工作与以下通用多标签影像分类方法进行比较:DB-焦点[32]、C-Tran[33]、CPCL[36]和TA-DCL [49],这些方法详见第二节A。此外,我们还与上述提出的基于原型的可解释方法进行比较:ProtoPNet [23]、ProtoPNet++ [29]、可变形 ProtoPNet [24]和 PIP-Net [69]。

多标签的疾病分类和可解释性

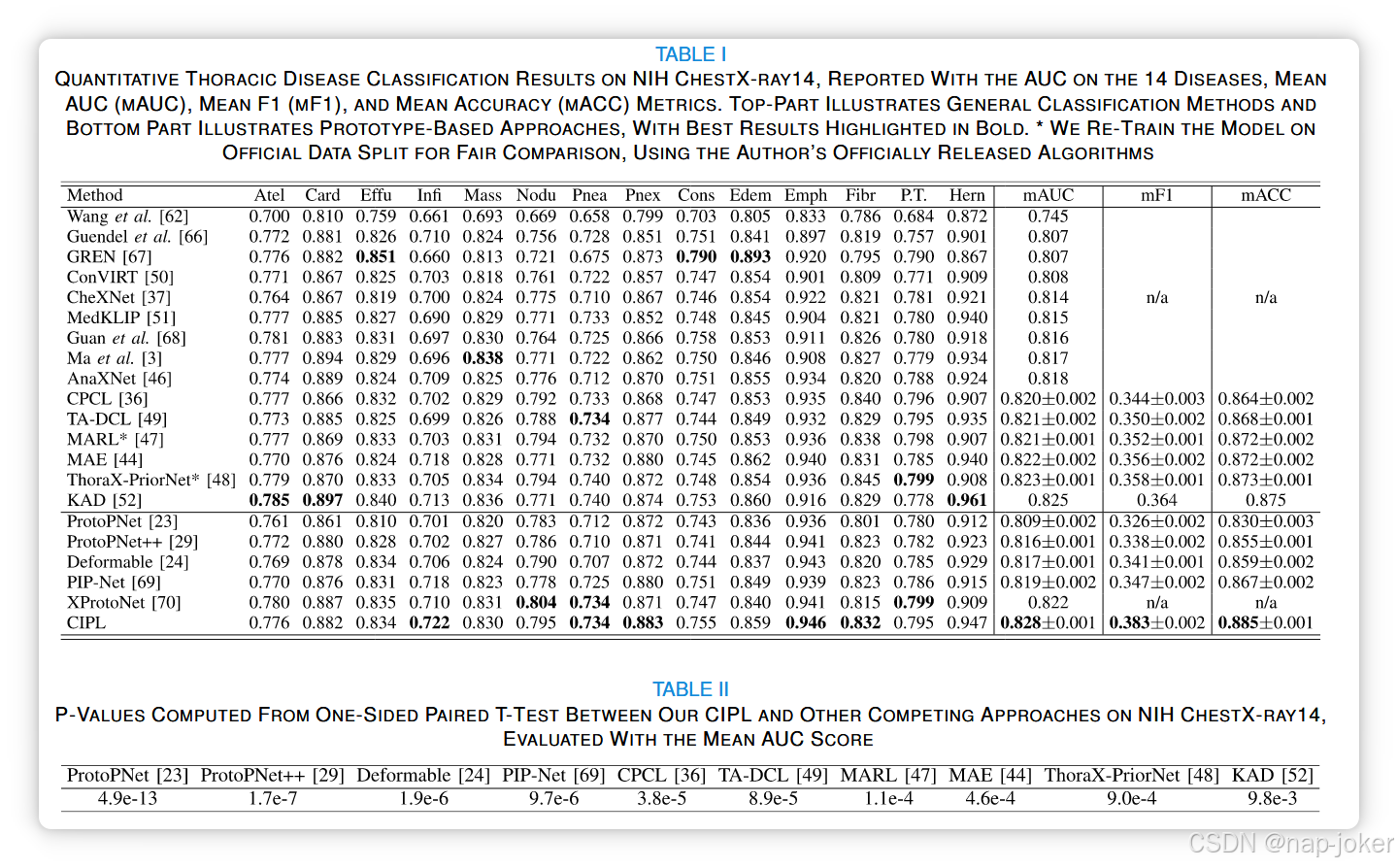

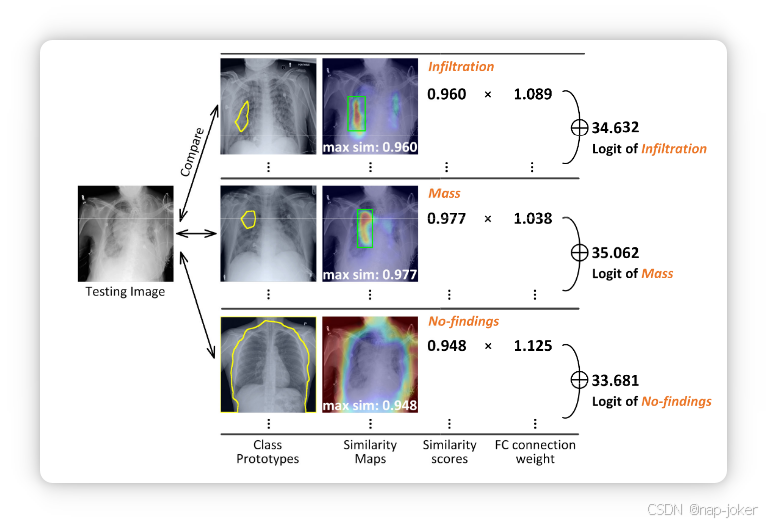

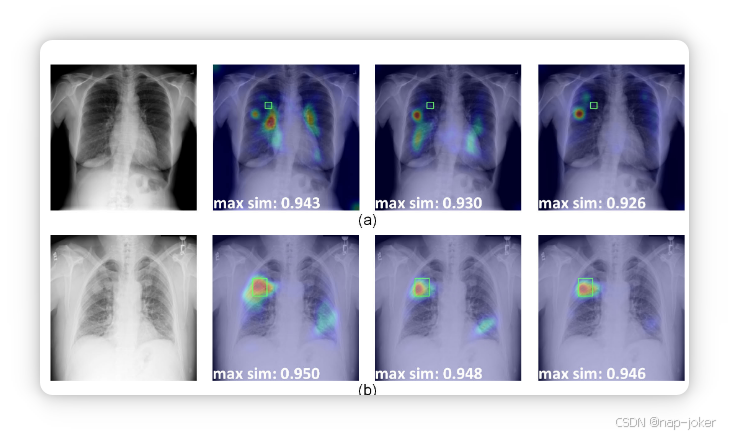

表I显示了我们CIPL及其他竞争方法在NIH ChestX-ray14上进行的胸腔疾病分类结果。如图所示,我们的CIPL方法在所有这些方法中取得了最佳分类效果,平均AUC为0.828,平均F1得分为0.383,平均准确率为0.885,并且在五种胸椎疾病中达到了最高的AUC结果。与ProtoPNet基线[23]的开创性工作相比,我们的CIPL显示出显著的平均AUC提升,从0.809提升至0.828。请注意,我们的方法也远远超越了其他更先进的可解释原型学习方法[24]、[29]、[69]、[70],验证了CIPL在利用原型学习实现多标签分类的跨图像和图像内信息方面的优势。此外,我们的CIPL优于目前依赖黑盒深度神经网络的SOTA胸部X光分类方法,如ThoraX-PriorNet [48]、MARL [47]、MAE [44]和TA-DCL [49]。令人鼓舞的是,我们的CIPL方法优于近期的视觉语言模型(如ConVIRT [50]、MedKLIP [51]和KAD [52]),这些模型甚至在大型MIMIC-CXR [74]数据库中的图像-文本对上预训练,并在ChestX-ray14上进行了进一步微调。这些结果凸显了我们方法在为胸腔疾病提供准确诊断和解读结果方面的优势。表II提供了我们提出的CIPL与其他先进竞争方法使用单侧配对T检验的统计分析。所有这些方法均在ChestX-ray14测试集上进行推断,测试有1000次自助重复。我们可以看到,CIPL相较于其他方法的性能提升(以平均AUC计)具有统计学显著性,显著水平为0.05。图3(a)提供了不同基于原型的方法学习的典型质量原型的视觉对比。可以看出,尽管从单标签训练样本中获得了良好的质量原型,之前基于原型的方法可能会不理想地生成质量原型,同时激活质量和其他疾病(例如第二种情况中顶部用白色箭头标出的溢出),显示了纠缠原型的现象。此外,之前的方法往往会产生不准确的原型,甚至与实际质量区域不对齐(例如第三种情况中顶部的白色椭圆),这是由于多标签训练样本中其他疾病的干扰。相比之下,我们的CIPL成功从单标签和多标签样本中获得解缠和正确的原型。我们还在图4中提供了更多通过CIPL方法学习到的其他胸椎疾病类别的视觉原型,展示了它们高度的解缠特性。图5展示了通过胸部X光检查图像进行多病变胸腔诊断解读的示例。显然,我们的CIPL将输入图像与特征空间中学到的类原型进行比较,生成了每个疾病类别的一系列相似性图,且无发现。分类对数是通过对应类别的加权最大相似度分数相加生成的。在此例中,由于浸润和质量的分类对数高于无发现,我们的模型构成了疾病诊断结果

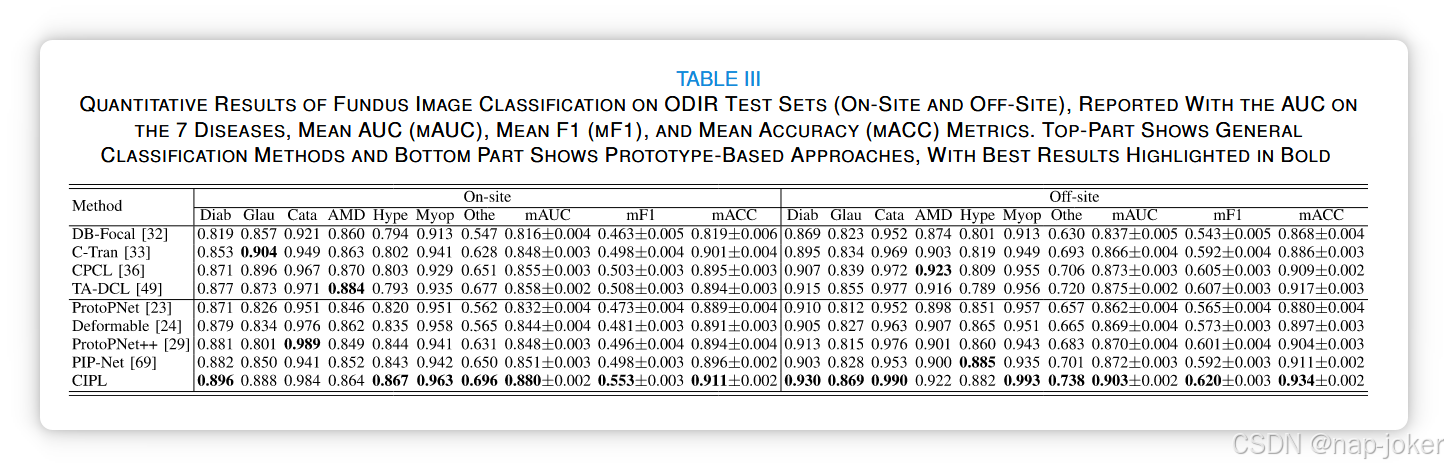

图像中的渗透和质量。值得注意的是,我们的模型激活了与放射科医生领域知识中手工疾病注释高度匹配的相应疾病区域。表III提供了ODIR数据集上眼科疾病诊断的定量结果。观察到我们的CIPL在两个测试集中均能稳定产生最佳的平均分类AUC结果。值得注意的是,CIPL在现场和异地测试集上,显著超过现有基于原型的方法[23]、[24]、[29]、[69],分别以平均AUC为单位提升至少2.9%和3.1%,证明了跨标和图像内原型学习在多标签眼底图像分类中的有效性。我们在图3(b)中展示了不同方法的AMD病典型视觉原型。我们的CIPL生成的AMD原型能精确覆盖与AMD病相关的病理病变,而其他比较方法的AMD原型往往与其他疾病纠缠在一起(见白色箭头),在某些情况下,它们完全忽略了实际的AMD病变(白色省略号表示)。

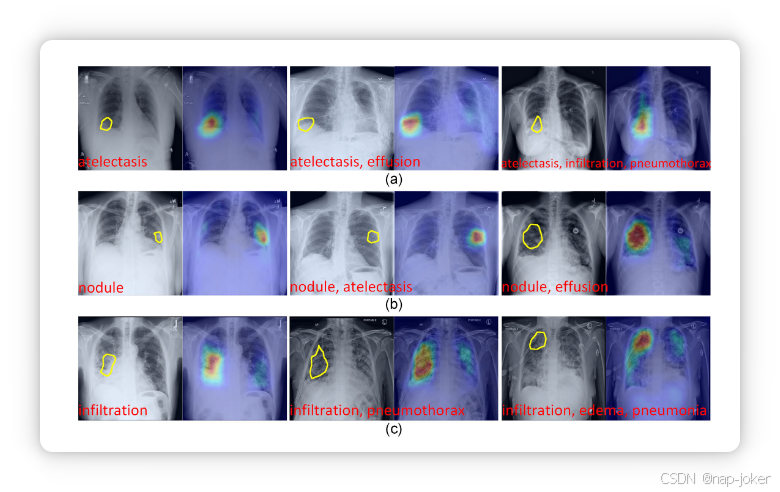

图4。通过我们CIPL方法从NIH ChestX-ray14中学习的肺不张(a)、结节(b)和浸润(c)的视觉原型。在每对中,左侧图像显示原型(用黄色计数器表示)在源训练图像中,右侧图像则在自激活相似度图中高亮原型。真实影像标签用红色写成。

图5。我们CIPL方法中用于多病诊断解读的典型例子,基于胸部X光检查图像,绿色框表示真实的疾病注释。为简化起见,图中仅展示了一个原型及其对应的类渗透、质量和无发现的相似映射。

图8。我们CIPL方法的失败案例。(a) 细微结节病变的误定位,显示与真实结节类别的前3相似图。(b) 结节图像的错误分类,显示前3相似图与假预测的肿块类。每个相似映射中的绿色框表示地真结点注释。

弱监督多标签疾病定位

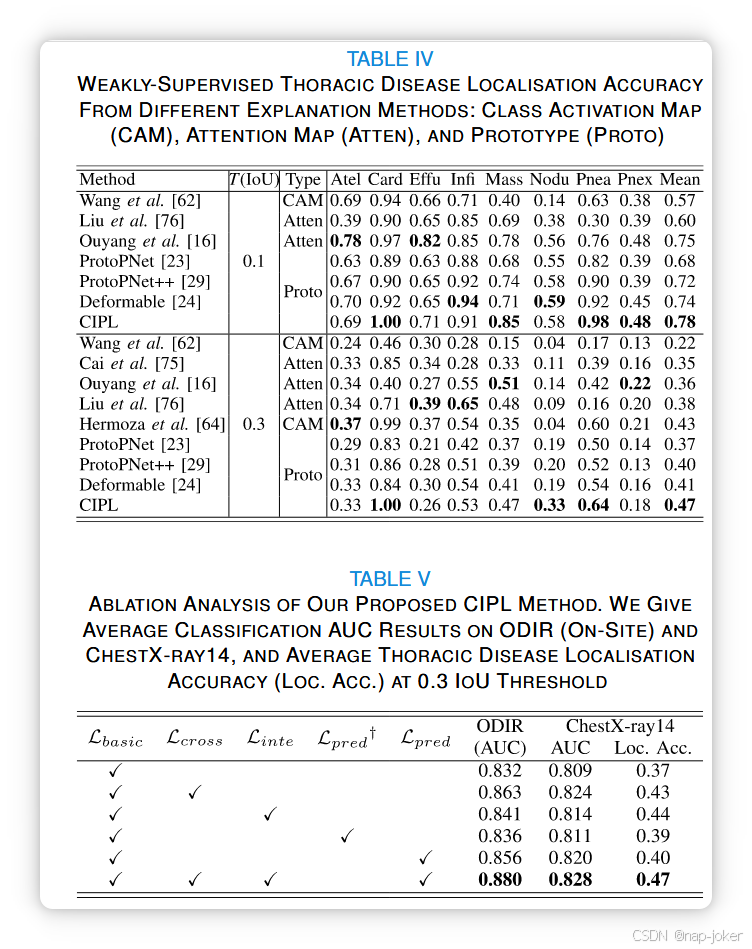

我们还评估了CIPL方法在NIH ChestX-ray14中,在弱监督环境中定位胸腔疾病的有效性,该方法利用平均类别激活图谱进行定位过程,详见IV-A部分。在本任务中,我们与目前基于CAM[62]、[64]和视觉注意力[16]、[75]、[76]的SOTA弱监督定位方法进行比较。表IV展示了阈值IoU准确性结果,并提供了用于疾病定位的解释类型。如图所示,我们的CIPL在大多数疾病中定位准确性显著提升,IoU阈值分别为0.1和0.3,平均准确率分别为0.78和0.47。与以往领先的基于显著性(如CAM和视觉注意力)定位方法相比,我们的CIPL准确率远高于此。特别是,CIPL在学习过程中也优于仅考虑单个图像信息的其他基于原型的方法[24]、[29]、[69]。这些改进归功于利用丰富的交叉影像语义,准确理解各类疾病的病理病变,以及有益的图像内线索,生成一致且稳健的原型,这一点通过以下IV-F节的详尽消融研究得到证明

消融实验

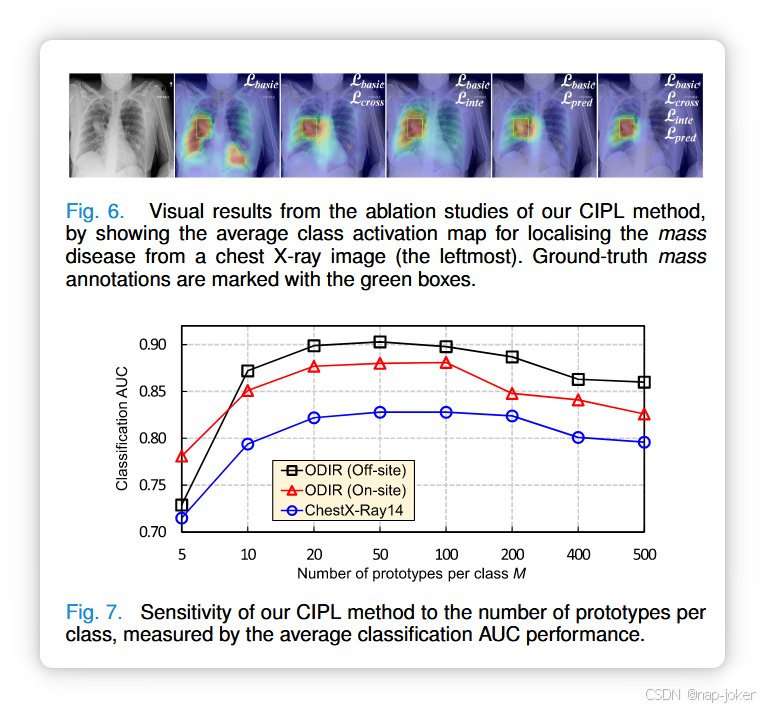

1)跨图像原型学习:我们进行消融实验,研究交叉图像策略在改善疾病分类和定位表现方面的有效性。表V提供了ODIR和ChestX-ray14的结果,其中基线CIPL仅使用基础训练目标Lbasic,与ProtoPNet[23]方法相同。我们注意到,以Lcross表示的跨图像原型学习策略,可以显著提升这两种任务的分类性能。同时,这一策略极大地促进了胸椎疾病定位的准确性(典型案例见图6),因为它利用配对图像的常见语义,全面理解病理病变。 2)图像内原型学习:在表V中,我们还提供了图像内原型学习策略的消融分析。关于预测对齐,人们可能会担心仅仅对每个训练样本对应两个视图的预测,详见第三节-C。因此,我们也通过最小化两个单样本视图(Lpred †表示)预测的 KL 发散来提供此类结果。可以注意到,解释对齐Linte显著提高了疾病定位的准确性(见图6),因为它设计使原型对两个增强图像视图具有鲁棒性。相比之下,批次级预测比对Lpred在AUC分类表现上显著提升,优于样本级预测比对Lpred †,因为Lpred考虑样本间的整体关系,从而为模型提供更有用的正则化信号。3)原型数量:我们研究CIPL方法对每个类别M的原型数量的敏感度,如图7所示。显然,分类结果通常表现为从20到100的稳健性M。然而,原型数量有限导致训练样本中丰富多样的模式表现不足,结果不理想。相反,过多的原型会引入不必要的甚至有害信息,导致性能下降和模型复杂度的增加。根据图7,我们在所有剩余实验中每类将原型数量设定为50个。

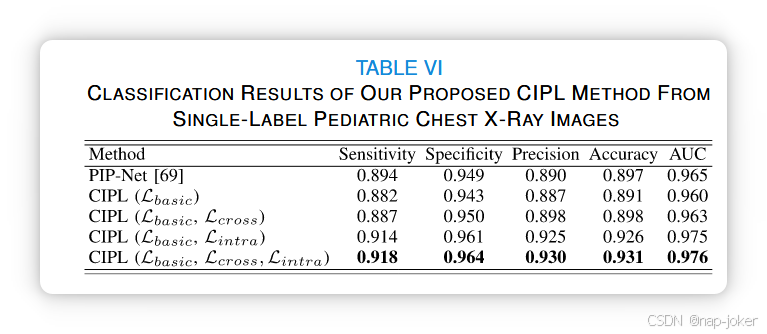

单标签疾病诊断情景

我们的CIPL方法旨在解决多标签疾病诊断和解读,但有必要探讨其在单标签诊断方案中的有效性。为此,我们采用了公开可访问的胸部X光数据集[77]。该数据集包含5,856张儿科胸部X光图像,其中5,232个样本用于训练,624个样本用于测试。这些影像分为以下三类:正常肺炎、细菌性肺炎和病毒性肺炎。本实验采用相同的训练细节(批处理大小、学习率、每类原型编号)、超参数(α1、α2、α3、α4 和 τ)及数据增强,详见 IV-B 部分。表VI提供了单标签胸部X光分类任务的实验结果,其中Lintra = Linte + Lpred,我们评估了整体的敏感性、特异性、精度、准确性和AUC评分。如实可观察,交叉图像训练策略Lcross相比仅使用Lbasic的基线CIPL实现了略有提升的性能。这是因为单标签训练图像中只有一种疾病类型,而学习到的原型自然地从中解开。结合表V的消融结果,可以进一步确认我们的交叉影像策略在解决纠缠多标签疾病诊断方面是有效的。在表VI中,我们提出的图像内学习范式Lintra展示了显著的性能提升,因为它以自监督方式利用一致且有意义的图像内信息,无论训练图像是单标签还是多个标签。

讨论

本文介绍了CIPL框架,旨在有效学习多标签疾病诊断的解开原型。我们的CIPL框架为诊断决策提供了有力的相似性解释,即将测试样本与代表训练图像特定区域的类别特定原型进行比较。除了依赖区域级原型外,基于相似性的解释还可以通过图像级原型[78]、[79]、[80]实现,这些原型通过不同的学习技术生成,如聚类[79]和自编码模型[78]、[81]。然而,这些图像级原型基于整体图像表示,导致可解释性不如我们方法中使用的区域级原型细致度。从人类用户的角度来看,了解测试图像中哪些部分(例如医学图像中的病理性病变)与区域级原型相似,比仅仅判断整个测试样本是否与整张图像训练原型相似更有意义。典型学习旨在寻找一组针对类别的原型来描述或总结训练数据,推断依赖于测试样本与这些原型之间的相似性。从这个意义上说,典型学习大致可以归类为一种转导推理[82],其中利用与标记参考样本的距离或亲和力进行分类。即使该过程简单且人类易于理解,其有效性往往取决于训练数据分布的复杂性以及原型近似该分布的能力[83]。图7对此问题有明确阐明,显示过多或不足的原型数量都可能对模型性能产生负面影响。虽然基于原型的分类方法为疾病诊断带来了有吸引力的可解释结果,但我们的实验仍揭示了一些不利的失败案例,主要分为两类。1)如图8(a)所示,细微病理病变的错定位发生在病变(如绿色框标出的结节)极小时,难以与正常组织区分,导致原型激活在错误区域。值得注意的是,误定位并不总是导致错误分类。由于模型的透明度,这类情况易于识别,便于进一步细化模型。2)误分类为视觉上相似的类别,如图8(b)所示,质量原型也激活了结节病变,导致质量类别的假阳性预测。我们认为部分原因是结节和肿块的形状都具有受限且规则的形状,在图像中难以区分。为解决这个问题,未来我们计划在模型训练中加入约束措施,以鼓励这些视觉相似疾病类别的原型可分离性。

总结

在这项工作中,我们提出了CIPL方法,用于从医学图像进行多标签疾病诊断和解读。我们的方法利用常见的交叉图像语义来解开多个类别的疾病特征,从而更有效地学习类别原型,全面理解各种病理病变。此外,我们的方法利用一致的图像内信息,通过基于比对的正则化策略,提升解读的鲁棒性和预测性能。两个多标签基准测试的实验结果展示了我们CIPL相较于其他竞争方法在疾病分类和解释(通过弱监督定位测量)方面的优势。此外,我们的图像内原型学习策略灵活且易于扩展,以应对单标签疾病诊断和解读。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献28条内容

已为社区贡献28条内容

所有评论(0)