2026年03月27日 AI 科技日报 (微软 MAI-Image-2 挤入图像生成前三)

2026年03月27日 AI 科技日报 (微软 MAI-Image-2 挤入图像生成前三)

共收录 33 条资讯

AI模型

开发者吐槽 Opus 代码可靠性

开发者 theo 分享使用 Anthropic Claude Opus 的经历:让模型独立开发一个新功能一小时后,再花 20 分钟讨论才发现整体方案方向错误,导致最终无法测试。这个案例表明,当前顶级大模型在复杂系统设计和自我校验方面仍存在明显短板,更适合作为辅助编程工具,而非完全放手的自动化开发者。依赖 AI 编程的团队需要保留严格的人类代码审查和测试流程。

关键词: Claude Opus AI 编程 代码可靠性 Anthropic

来源: @theo

链接: https://x.com/theo/status/2034827787266400455

MiniMax 联合 OpenClaw 直播解析 M2.7

MiniMax 宣布与 OpenClaw 举办线上生态直播,围绕其多模态模型 M2.7 展开介绍,从早期自进化思路讲到在 10 万规模 OpenClaw 集群上的高效运行方案。活动中还向参与者发放算力代金券。这一合作展示了国内模型厂商在大规模推理集群调度和生态合作上的布局,对使用 OpenClaw 做推理编排或计划接入 MiniMax 模型的开发者和云平台运营方具有参考价值。

关键词: MiniMax M2.7 OpenClaw 推理集群 多模态模型

来源: @MiniMax_AI

链接: https://x.com/MiniMax_AI/status/2034811662138839479

微软 MAI-Image-2 挤入图像生成前三

有报道指出,微软最新图像生成模型 MAI-Image-2 已跻身当前主流 AI 图像生成工具的前三梯队。该模型面向通用图像创作场景,重点提升提示理解能力和画面质量,配合微软现有办公与开发工具生态,未来有望在文生图、营销物料生成和设计辅助等领域提升产品竞争力,也会加剧与 Midjourney、DALL·E 等模型的功能对比与评测。

关键词: 微软 MAI-Image-2 图像生成 多模态

来源: @NandoDF

链接: https://x.com/NandoDF/status/2034760671649313159

谷歌发布AI音乐模型Lyria 3 Pro

谷歌发布AI音乐生成模型Lyria 3 Pro,面向专业和普通创作者提供文本生成配乐、旋律草稿等能力。官方强调更高保真度和风格控制,可用于短视频、广告、游戏等场景的背景音乐制作。业内也关注其与版权素材、艺术家合作和版权合规机制的后续安排。

关键词: 谷歌 音乐生成 Lyria 3 Pro AIGC

来源: ai-bot.cn

链接: https://www.ithome.com/0/932/738.htm

美团开源多模态大模型LongCat-Next

美团龙猫团队发布并开源多模态大模型LongCat-Next,支持图文等多种输入形式,面向实际业务和科研场景。官方提供模型权重和推理代码,方便企业与开发者在搜索推荐、本地生活服务等领域做定制化应用与评估,进一步丰富国内多模态开源生态。

关键词: 美团 多模态大模型 LongCat-Next 开源

来源: ai-bot.cn

链接: https://ai-bot.cn/longcat-next/

产品发布

Claude Code 支持 Telegram 远程控制

社区整理了 Claude Code 官方插件远程连接 Telegram 的详细配置流程,包括在 Telegram 通过 BotFather 创建机器人并获取 Token,使用命令安装 telegram 插件、配置 Token、启动带插件的 Claude Code 进程,以及通过聊天获得配对码并设置访问白名单。这让开发者可以在手机或桌面 Telegram 中远程下发指令,控制本地 Claude Code 进行编码和自动化任务。

关键词: Claude Code Telegram 机器人 远程控制 开发插件

来源: @op7418

链接: https://x.com/op7418/status/2034819697858978070

Claude Code 插件接入 Discord 工作流

同一套教程还给出了 Claude Code 连接 Discord 的步骤:在 Discord 开发者平台创建应用与 Bot,将 Bot 加入自己的服务器并重置获取 Token,然后在 Claude Code 中安装并配置对应插件。这样团队可以在 Discord 频道内直接驱动本地 AI 编码环境,适合多人协作开发、代码评审或自动化脚本触发等场景,把聊天工具变成轻量工作流前端。

关键词: Claude Code Discord Bot 团队协作 开发自动化

来源: @op7418

链接: https://x.com/op7418/status/2034819697858978070

Claude Code Channels 机制解读

开发者分享了两篇文章系统介绍 Claude Code 的 Channels 机制,一篇从概念出发,说明如何通过不同 Channel 把本地编辑器、终端、聊天工具等统一接入,另一篇则讲实现细节。Channels 实际上是面向 AI 编码的“多入口路由层”,让同一套智能能力可以在 VSCode、CLI、Telegram 等多端复用,对自建开发助理平台和插件生态有一定借鉴意义。

关键词: Claude Code Channels 多端接入 开发流程

来源: @chenchengpro

链接: https://x.com/chenchengpro/status/2034803991826272744

BibiGPT 适配 WebMCP 支持代理控制音视频

BibiGPT 宣布已完成对 WebMCP 的准备和适配,用户可在 Chrome 中通过 ‘chrome://flags’ 开启 WebMCP 进行测试。之后,AI Agents 就能通过 MCP 工具远程操控 BibiGPT 网站,对网页音视频内容进行自动总结。作者还计划发布 MCP server、Agent Skill、WebMCP 全套开发教程,这有助于更多开发者把现有 Web 产品变成可被 AI 代理直接操作的“技能”。

关键词: BibiGPT WebMCP MCP 工具 音视频总结

来源: @Jimmy_JingLv

链接: https://x.com/Jimmy_JingLv/status/2034807184010486258

研究论文

Chollet 批评用人类短板为 AI 护航

Keras 之父 François Chollet 指出,每当前沿 AI 系统在某类任务上表现不佳时,总有人用“人类也不会”来淡化问题,例如推理、未见任务的适应能力、指令遵循或幻觉等。但随着模型能力提升,这类说法又会悄然消失。他以 ARC 1 任务为例认为,普通聪明人类可以完成,而模型长期表现不稳。该观点呼吁业界更严谨地评估 AI 的能力边界,而不是模糊人与模型之间的差距。

关键词: François Chollet 模型评测 ARC 基准 AI 能力边界

来源: @fchollet

链接: https://x.com/fchollet/status/2034811827004350787

发布 Principia 数学推理评测与数据

研究团队发布用于训练和评估大模型数学推理能力的 Principia 套件,包括面向方程、集合、矩阵、区间和分段函数等“数学对象”的评测基准 PrincipiaBench,以及配套训练数据集 Principia Collection。结果显示,这类针对数学结构的数据能明显提升模型在数学和通用推理任务上的表现,值得从事科学计算、工程建模和数学教育的团队关注与采用。

关键词: 大模型推理 数学对象 评测基准 训练数据

来源: @jaseweston

链接: https://x.com/jaseweston/status/2034804911792079264

工具推荐

用 AI 代理编码需压缩人工闭环

工程师 nptacek 指出,在使用 AI 代理进行编码时,关键是让自己的人类“运行循环”尽量紧凑:任何发现会反复执行的操作,都应该设法通过脚本或代理自动化。通过不断观察并消除这些重复步骤,可以显著提高开发效率,把精力集中在问题定义和结果评估上。这一思路对尝试构建多代理开发流水线的团队和个人开发者具有实际指导意义。

关键词: AI 代理 自动化开发 开发效率 工作流优化

来源: @nptacek

链接: https://x.com/nptacek/status/2034820999552573699

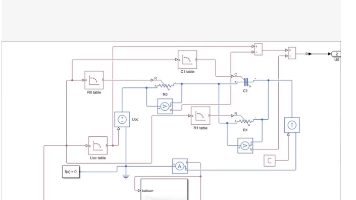

远程 GPU over IP 桥接方案

有开发者开源了一套基于 IP 的 GPU 远程桥接方案,可将远端机器上的 GPU 能力通过网络“映射”给本地使用。相比传统的远程桌面或 SSH + CUDA 方式,这类 GPU over IP 方案更偏向在容器、集群或多机开发环境中按需调配算力,适合训练或推理任务跨机分配,对没有本地高端显卡的开发者和小团队较有价值。

关键词: GPU over IP 远程算力 分布式计算 开发工具

来源: @tom_doerr

链接: https://x.com/tom_doerr/status/2034831007744917902

纯 C 实现的通用向量检索扩展

一款采用纯 C 编写的向量检索扩展发布,主打“可在任意环境运行”,不依赖重型运行时或特定框架。它适用于在现有应用中轻量集成语义搜索和向量相似度检索能力,尤其适合对性能和可移植性要求较高的嵌入式、边缘或本地部署场景,为构建 RAG 系统和知识库提供更小巧的基础组件。

关键词: 向量检索 纯 C 语义搜索 RAG

来源: @tom_doerr

链接: https://x.com/tom_doerr/status/2034827194204147868

任意项目自动热重载工具

一款支持“自动热重载任意项目”的开发工具被社区推荐,重点在于无需复杂配置即可监听代码变更并自动重启或刷新应用。类似能力在前后端开发、微服务、本地 AI 应用迭代时非常实用,能减少反复手工重启和切换窗口的时间,对提升开发反馈速度和实验效率有帮助,尤其适合频繁调参和小步快跑的 AI 工程项目。

关键词: 热重载 开发效率 自动重启 工程工具

来源: @tom_doerr

链接: https://x.com/tom_doerr/status/2034823369384743292

面向 AI 的多代理编码编排工具

有新项目专门用于“编排 AI 编码代理”,可协调多个不同能力或职责的代码代理协同工作。例如,可将代码生成、重构、测试、文档撰写等拆分给不同代理,再由该工具统一调度和监控。对构建复杂 AI 软件工程流水线、尝试多代理协作编程的团队有参考意义,也能作为评估不同模型和代理策略的实验平台。

关键词: AI 代理 代码编排 自动化开发 多代理系统

来源: @tom_doerr

链接: https://x.com/tom_doerr/status/2034819543768408357

面向 LLM 的数据管道 Python 库

一款 Python 库提供面向大模型的“原生数据管道”,号称可从 5000 个数据源拉取信息。它聚焦数据收集、清洗和结构化,方便将多源信息统一喂给 LLM,用于问答、分析或 RAG 应用。对需要整合大量外部 API、RSS、数据库和 SaaS 的 AI 产品团队,这是减少胶水代码和数据接入成本的工具,有助于更快搭建端到端数据流水线。

关键词: LLM 数据管道 Python 库 数据集成 RAG

来源: @tom_doerr

链接: https://x.com/tom_doerr/status/2034815718617739371

无厂商锁定的 AI 编码代理监控工具

一款用于“监控编码代理”的工具被介绍,特点是不过度绑定特定平台或模型,可接入不同 AI 代码代理并统一观察其执行情况。它可能包含任务跟踪、日志记录、运行状态和错误监控等能力,帮助团队评估代理质量、发现失败模式,逐步调整策略。适合在生产环境中使用 AI 编程助手、自动修复或代码审查的工程团队。

关键词: AI 代理 监控工具 工程可观测性 代码自动化

来源: @tom_doerr

链接: https://x.com/tom_doerr/status/2034811893555040392

多代理本地 AI 编码工作台

有项目提供“多代理编码工作空间”,用于统一管理本地运行的多个 AI 代理。开发者可在一个界面中调用不同模型或能力的代理,协同完成代码生成、调试、测试等任务。相较单一聊天式 IDE 插件,这类多代理工作台更适合复杂项目和自动化流水线,对探索“AI 软件工程流水线”的团队和个人开发者有实践价值。

关键词: 多代理 本地 AI 编码工作台 开发工具

来源: @tom_doerr

链接: https://x.com/tom_doerr/status/2034808068584677845

面向 Git 与 tmux 的 SWE 仪表盘

一款专为软件工程师设计的仪表盘工具支持 Git 与 tmux 集成,可在命令行环境下集中查看代码仓库状态、分支、提交以及相关任务视图。配合 AI 助手,它可以成为“开发驾驶舱”,让工程师在终端中高效切换上下文、查看代码变更并驱动 AI 辅助编程,对重度使用终端和多仓库管理的开发者会比较实用。

关键词: SWE 仪表盘 Git tmux 开发效率

来源: @tom_doerr

链接: https://x.com/tom_doerr/status/2034804242586665251

Pi Agent 新编辑扩展提升代码修改质量

社区开发者为 Pi Agent 提供了一个新的编辑扩展,用户可将扩展脚本放入本地 ‘~/.pi/agent/extensions’ 目录并与任意模型结合使用。作者提到类似 GPT 5.4 的模型有时会倾向整体重写文件,新扩展尝试通过更细粒度的编辑策略减少这种情况,对追求可读 Diff、稳渐变更的工程团队更加友好,也方便实验不同模型在代码编辑场景下的行为。

关键词: Pi Agent 代码编辑 扩展插件 LLM 编程

来源: @badlogicgames

链接: https://x.com/badlogicgames/status/2034803981474566384

博客内容技能化接入 AI 代理

有开发者展示了将个人 Blog“技能化”的尝试,即通过 MCP 或类似机制,把博客作为一个可调用的结构化知识源接入 AI 代理。这样,代理可以直接在博客中检索、引用内容,用于回答问题或生成文章。对有长期内容积累的个人或团队来说,把网站内容封装为可编程技能,有助于构建自己的私有知识助手和内容自动化工作流。

关键词: 博客技能化 MCP 知识库 AI 代理

来源: @chenchengpro

链接: https://x.com/chenchengpro/status/2034806894045630516

TorchSpec 推出用于推测解码训练框架

PyTorch 生态推出 TorchSpec,这是一个原生于 PyTorch 的大模型推测解码训练框架,由 TorchSpec 与 Mooncake 团队联合开发。它通过 Mooncake 将推理引擎产生的隐藏状态流式传输给训练节点,实现推理与训练管线解耦、分别扩展,便于在大规模集群上高效优化推测解码模型,对需要降低推理延迟和成本的模型服务团队尤为有用。

关键词: TorchSpec 推测解码 PyTorch Mooncake

来源: @PyTorch

链接: https://x.com/PyTorch/status/2034763012972646815

MCMC 方法学习资源打包分享

数据科学家 Kirk Borne 分享了一套马尔可夫链蒙特卡洛(MCMC)学习资源,包括概念入门文章、带代码的仿真实例以及配套书籍,并推荐了相关技术长帖。对从事贝叶斯建模、概率编程和不确定性估计的研究者与工程师来说,这些材料有助于系统掌握 MCMC 理论与实操,快速将抽象方法应用到真实机器学习与统计建模项目中。

关键词: MCMC 贝叶斯推断 概率编程 学习资源

来源: @KirkDBorne

链接: https://x.com/KirkDBorne/status/2034810045435719943

行业动态

RunPod 报告:vLLM 成主流推理框架

RunPod 发布最新 State of AI 报告,基于 50 万开发者真实生产数据显示,vLLM 已成为大模型推理的事实标准,约半数文本端点运行在 vLLM 及其变体上。开源推理框架在企业生产环境中的占比持续提升,说明更多团队选择自建或自管推理基础设施。对云厂商、模型提供方以及想优化推理成本和性能的研发团队具有重要参考价值。

关键词: vLLM 大模型推理 RunPod 报告 开源框架

来源: @vllm_project

链接: https://x.com/vllm_project/status/2034828731983044971

DeepLearningAI:AI 项目应从用户出发

DeepLearningAI 提醒初学者,许多 AI 项目一开始就纠结用哪种模型、哪种架构,但更重要的问题是:谁真正遇到这个问题、用户的场景是什么。优秀的 AI 项目应从真实痛点和用户需求出发,再反向选择技术方案,而不是为技术本身找应用。对刚入行的工程师和想做落地产品的团队来说,这一方法论有助于提高项目成功率和业务价值。

关键词: DeepLearningAI AI 项目方法论 用户需求 产品思维

来源: @DeepLearningAI

链接: https://x.com/DeepLearningAI/status/2034827288357839316

工程师称学习 GPU 内核回报极高

工程师 jxmnop 认为,对于被裁或转型中的软件工程师,系统学习编写 GPU 计算内核可能是回报率最高的路径之一:在具备基础工程能力的前提下,用六到十二个月深入掌握内核开发和性能优化,有机会获得高薪岗位,相关人才在大厂极为抢手。这一观点折射出大模型时代对底层算子和加速计算专家的强烈需求,对考虑转向系统性能和计算架构方向的开发者具有现实意义。

关键词: GPU 内核 性能优化 开发者转型 高薪技能

来源: @jxmnop

链接: https://x.com/jxmnop/status/2034809761800364292

OpenCode 团队工作流被 AI 工具重塑

OpenCode 团队成员回顾开发初期时,经常在自家工具和传统编辑器之间来回切换,要刻意提醒自己使用新工具,而现在则变成“要刻意克制使用频率”。这说明当 AI 编码环境在体验和效率上达到某个门槛后,会自然成为主力工作流。对跟踪 AI IDE 演进的人来说,这是一个真实的“行为转折点”信号,反映 AI 正逐步融入日常开发。

关键词: OpenCode AI IDE 开发工作流 团队实践

来源: @thdxr

链接: https://x.com/thdxr/status/2034820194023973051

黄仁勋与多家开源前沿模型团队会面

英伟达披露,黄仁勋近期与多家构建开源和前沿大模型的团队交流,包括 AMP、Cursor、LangChain、Mistral、Perplexity 等,讨论开放前沿模型的快速发展趋势。英伟达正通过硬件、软件栈与生态合作,巩固其在大模型训练与部署基础设施上的关键角色,这一动向影响模型初创公司、应用开发者以及云服务商的技术路线和成本结构。

关键词: 英伟达 开源模型 大模型生态 算力基础设施

来源: @NVIDIAAI

链接: https://x.com/NVIDIAAI/status/2034759323419635999

Chollet 批评评估 AI 时的人类标准漂移

François Chollet 评论称,每当最新 AI 系统在某类任务上表现不佳时,总有人用“人类也做不到”来淡化差距,但一旦模型能力提升,这种说法又悄然消失。他以推理、适应新任务、遵循指令以及 ARC 任务为例,指出人类在这些方面其实有明确能力。此番讨论强调了为 AI 设计稳健、透明评价标准的重要性,提醒研究者警惕不断移动的对比基准。

关键词: François Chollet AI 评测 人类对比 基准漂移

来源: @fchollet

链接: https://x.com/fchollet/status/2034811827004350787

字节开源DeerFlow2.0等多项AI进展

字节跳动开源智能体编排框架DeerFlow2.0,支持构建多智能体工作流,方便搭建复杂企业级应用。CapCut上线两项新AI功能,进一步降低视频创作门槛。快手披露单季AIGC素材消耗达40亿元,显示短视频平台在内容生产和创作者工具上持续加大投入。

关键词: DeerFlow2.0 CapCut 快手 AIGC 智能体

来源: aibase.com

链接: https://news.aibase.com/zh/daily/26587

其他

团队分享 AI 开发三环迭代模式

QuixiAI 分享其在 AI 产品迭代中的经验,提出由三个并行循环组成的开发模式:一环持续构建和扩展新功能,一环集中实际使用产品并系统性记录问题,一环专门负责修复缺陷和技术债。通过将开发、使用和修复拆分成独立但紧密联动的闭环,团队可以在利用 AI 加速开发的同时,维持较高的产品质量。这种流程设计对小团队和 AI 初创公司具有参考价值。

关键词: QuixiAI 开发流程 缺陷管理 AI 产品

来源: @QuixiAI

链接: https://x.com/QuixiAI/status/2034822623654297832

DeepLearningAI 提醒项目应从用户问题出发

DeepLearningAI 指出,很多初学者做 AI 项目时一开始就纠结模型和架构选择,而忽视了更关键的问题:谁真正有这个需求、要解决什么具体痛点。优秀的 AI 项目应从真实用户场景和可验证的问题出发,再反推模型与技术栈。该观点对产品经理、创业团队和学生都有参考意义,可避免为技术而技术,提升项目落地价值。

关键词: AI 项目实践 用户需求 产品思维 教育

来源: @DeepLearningAI

链接: https://x.com/DeepLearningAI/status/2034827288357839316

关注我,每天获取AI最新资讯。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献12条内容

已为社区贡献12条内容

所有评论(0)