降AI率工具的语义重构技术解读:为什么能有效降论文AIGC率?

降AI率工具的语义重构技术解读:为什么能有效降论文AIGC率?

用过降AI率工具的同学可能都有一个疑问:这东西到底是怎么工作的?为什么把论文丢进去处理一下,AIGC率就能从60%降到5%?它是不是就是把句子翻来覆去换个说法?

说实话我一开始也是这么想的,直到我认真研究了一下AIGC检测的原理和降AI率工具的技术逻辑,才发现这里面的门道比我以为的深得多。今天这篇文章我尽量用通俗的语言把这个技术链条讲清楚。

一、先搞懂AIGC检测系统在"看"什么

要理解降AI率工具为什么有效,首先得知道AIGC检测系统到底在检测什么。很多同学以为检测系统就是拿你的论文去跟AI生成的语料库做比对,如果重合度高就判定为AI生成。

实际上不是这样的。

AIGC检测的核心逻辑:特征识别,而非内容比对

AIGC检测系统识别的不是你的具体内容,而是你文本中的"AI特征"。什么是AI特征?简单来说有以下几个维度:

(1)词汇选择的概率分布

AI生成文本时,每个位置选择的词都是概率最优解或接近最优解。这意味着AI用的词往往是"最合适的"“最标准的”。但人写东西不是这样——人会用一些不那么"精准"但更有个人风格的词,有时候甚至用词不太规范。

检测系统会分析你文本中每个位置的用词是否都落在"高概率区间"。如果大部分词都是统计意义上的"最优选择",那这段文字就有很大概率是AI生成的。

(2)句间连贯性模式

AI生成的文本有一个显著特征——句子和句子之间的衔接非常自然、非常顺滑。每一句都在逻辑上完美承接上一句。但人写的文章不是这样的,人的思维会有跳跃、会有不太顺畅的过渡、会有一些看起来有点"多余"的表述。

检测系统会计算文本的"连贯性得分",如果这个得分异常高,就是AI的信号。

(3)信息密度均匀度

AI生成的每个段落在信息密度上往往比较均匀——每段话都包含差不多的信息量。但人写东西会有详略之分,有的段落信息密度很高,有的段落可能就是过渡性的几句话。

(4)结构模式的可预测性

AI特别喜欢用一些固定的结构模式,比如"首先…其次…最后…"、“一方面…另一方面…”。虽然人也会用这些结构,但AI使用这些模式的频率和规整度远高于人类。

小结:检测系统看的是"统计特征",不是"具体内容"

理解这一点非常关键。AIGC检测不是在判断"这段话是不是AI说过的",而是在判断"这段话的统计特征是否符合AI的生成模式"。

这就解释了为什么有些同学手写的论文也会被误判——如果你的写作风格恰好很"AI"(用词精准、逻辑顺滑、结构规整),那检测系统就会认为你的文本有AI特征。

二、浅层替换为什么对降AI率没用?

搞清楚了检测逻辑,再来看为什么简单的同义词替换对降AI率不起作用。

同义词替换改变的是什么?是个别词汇。但前面说了,检测系统看的是整体的统计特征分布。你把"进行"换成"开展",并不改变这个位置选择高频词的概率特征。你把句子从主动语态变成被动语态,句间的连贯性模式没变。你换了几个过渡词,整体的结构可预测性照样没降。

打个不够精确但好理解的比方:AI写的文章就像是一栋标准化建造的高楼,每层的高度一样、窗户的间距一样、外墙的颜色一样。同义词替换就像给这栋楼换了个油漆颜色——换完之后你看外观变了,但整栋楼的建筑结构一点没变。检测系统看的恰恰是这个"建筑结构",不是外墙颜色。

三、语义重构为什么能有效降AI率?

终于说到正题了。语义重构的本质是改变文本的"建筑结构",而不是换"油漆颜色"。

语义重构的三个层次

第一层:表达方式重构

这是最基础的一层。不是简单换词,而是用完全不同的表达方式来传达同一个意思。

比如原文(AI风格):“本研究采用问卷调查法,共发放问卷500份,回收有效问卷462份,有效回收率为92.4%。”

语义重构后:“问卷一共发了500份,最后拿回来能用的有462份,算下来大概是92%多一点的有效率。”

你会发现处理后的文字不只是换了几个词——整个表达的"味道"变了。从规整的学术表达变成了更口语化的叙述。这种变化直接影响了检测系统识别的"词汇概率分布"特征。

第二层:逻辑结构重构

AI的论证逻辑通常是线性的:提出观点→给出论据→得出结论。语义重构会打乱这种线性结构,比如先抛出一个反问,再用例子引入,然后才说明观点。

这种重构直接改变了检测系统计算的"句间连贯性模式"和"结构可预测性"——因为人写东西的论证顺序本来就不是那么"完美"的。

第三层:信息密度重构

语义重构还会调整段落的信息密度分布。有些地方会展开说得更详细,有些地方会精简处理。这种不均匀的信息密度分布更符合人类写作的特征。

为什么这能骗过检测系统?

注意,我不用"骗过"这个词。更准确地说,语义重构之后的文本确实更接近人类写作的统计特征。检测系统判断的依据就是统计特征,当文本的统计特征从"AI区间"移动到了"人类区间",检测系统自然不会再将其标记为AI生成。

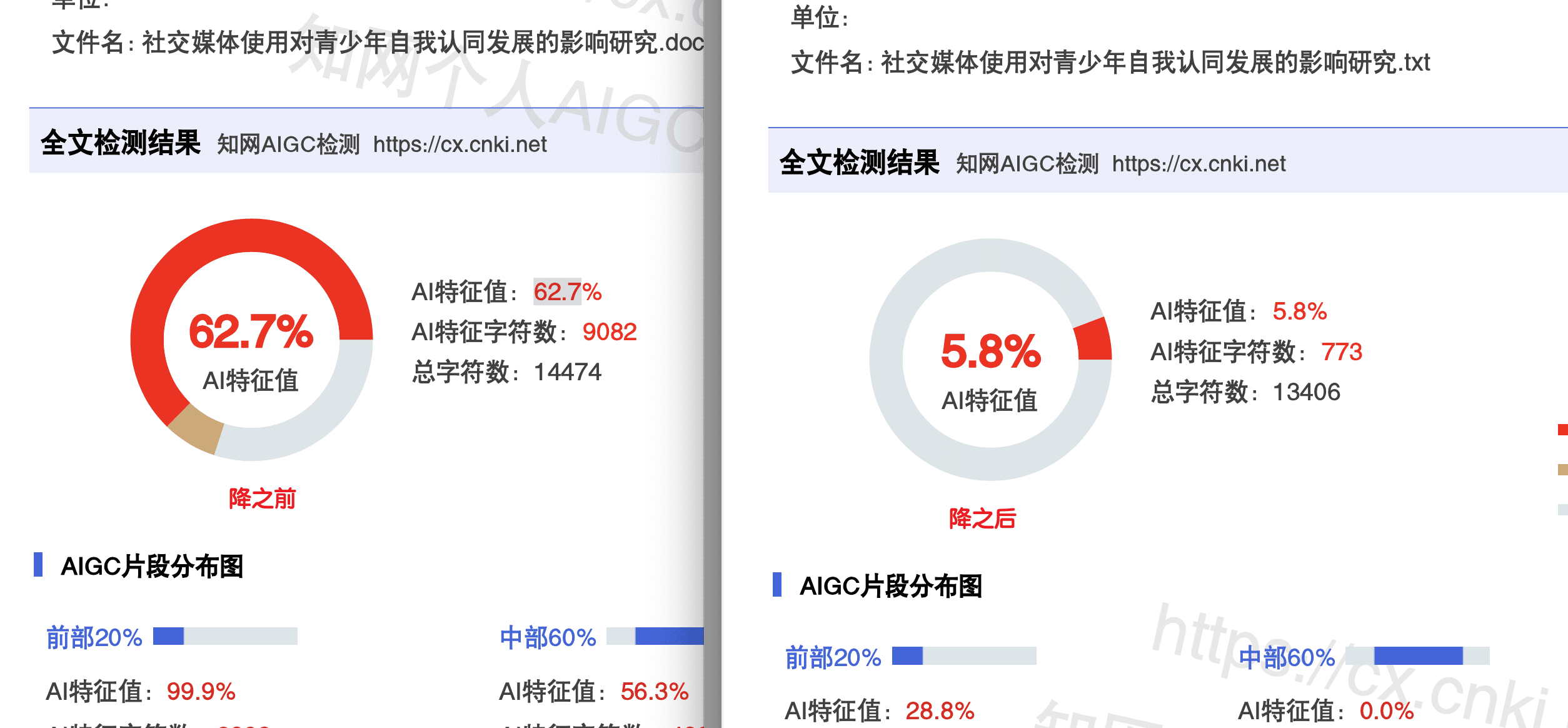

这也是为什么好的降AI率工具能把AIGC率从60%以上降到5%以下——它真正改变了文本的深层特征结构。

四、主流降AI率工具的语义重构能力对比

不同的降AI率工具对语义重构的实现水平差距很大。

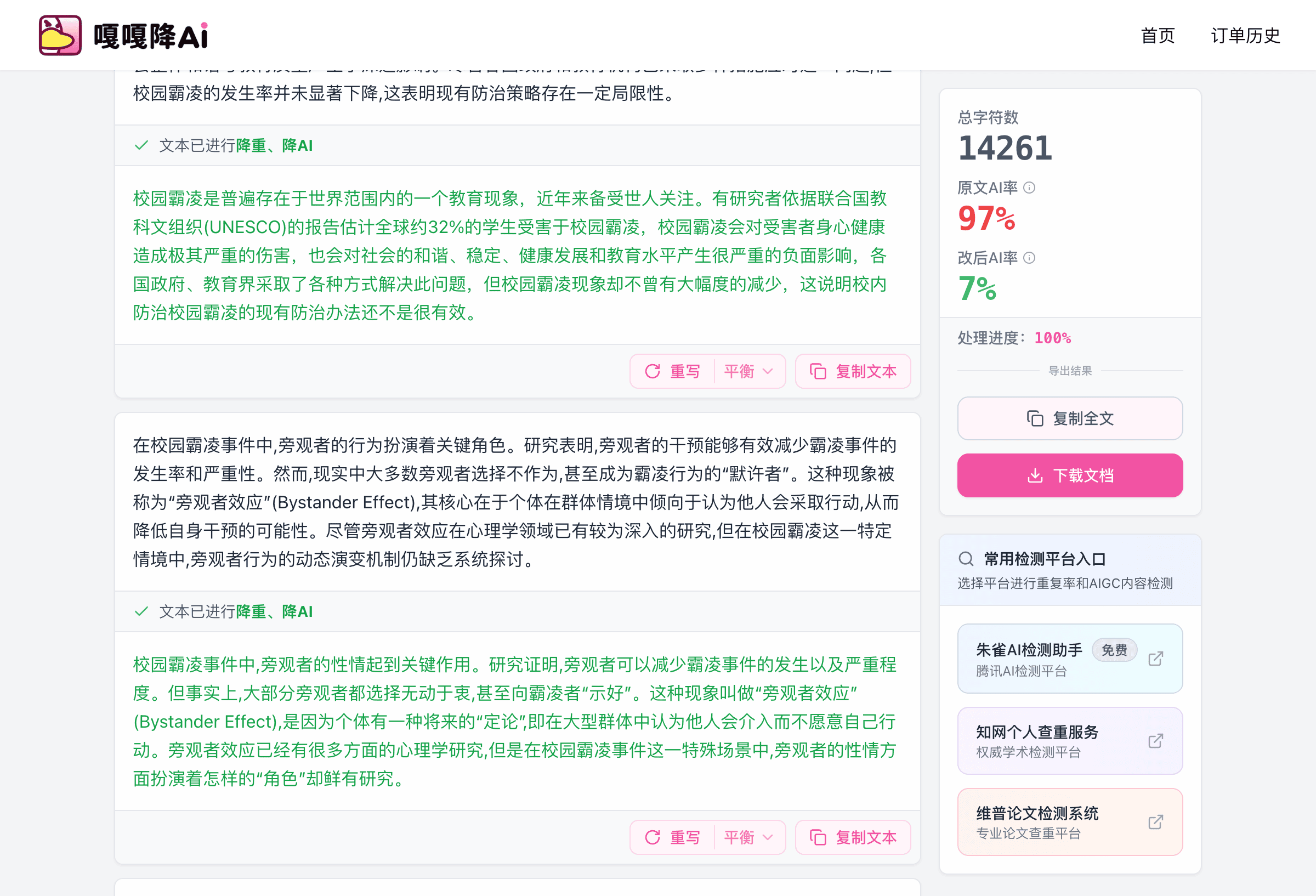

嘎嘎降AI:多平台适配的语义重构

嘎嘎降AI的技术亮点在于它能针对不同检测平台的算法特点做适配。因为知网、维普、万方这些平台虽然都是检测AI特征,但各自的侧重点不同。嘎嘎降AI支持9个平台的降AI率处理,说明它的语义重构引擎能根据不同平台的检测逻辑进行差异化调整。

实际效果上,嘎嘎降AI能把知网AIGC率从60%+降到5%-8%的区间,1000字免费试用可以让你先验证效果。

比话降AI:知网方向的深度语义重构

比话降AI选择了另一条路——专攻知网。它的语义重构引擎是专门针对知网AIGC检测算法设计的,对知网检测的特征维度有针对性的优化。

从处理效果来看,比话降AI在知网这个平台上的降AI率能力非常强。它承诺处理后AI率大于15%全额退款还赔检测费,这个承诺背后就是对自己语义重构技术的信心。定价8元/千字,支持10万字/篇。

率零:基础语义重构的平价选择

率零的语义重构能力相对基础一些,但对于AIGC率要求不太严格(20%-30%)的学校来说已经够用了。它的免费额度比较多,适合预算有限的同学。

五、语义重构的边界在哪里?

语义重构技术虽然有效,但并非没有边界。

边界一:专业术语的处理

有些学科的专业术语是固定的,不能随便替换。好的降AI率工具会识别并保留这些术语,只对非专业性的表述做重构。比话降AI在这一点上做得不错,处理后的文本保留了原文的专业性。

边界二:数据和事实的准确性

语义重构不应该改变论文中引用的数据、实验结果等客观事实。如果降AI率工具为了改变统计特征而篡改了数据,那就是本末倒置了。所以处理后一定要人工核查一遍数据和引用的准确性。

边界三:检测算法也在进化

AIGC检测和降AI率本质上是一个技术博弈的过程。检测算法会针对语义重构的特征做新的识别尝试,降AI率工具也会持续升级应对。目前来看,基于深度语义重构的降AI率技术仍然有效,但未来双方的博弈不会停止。

六、技术之外的思考

理解了降AI率的技术原理之后,你可能会产生一个更深层的问题:这种"道高一尺魔高一丈"的博弈有意义吗?

我的看法是,AI辅助学术写作已经是不可逆的趋势了。未来的方向不是"禁止AI参与",而是"规范AI的参与方式"。降AI率工具在当前阶段的意义,是帮助那些合理使用了AI辅助的同学,避免因为检测系统的机械判定而被错误处罚。

只要你的论文有自己的研究思路和原创见解,AI只是帮你在表达和整理上提效,那降AI率处理就是完全正当的。但如果你的论文从头到尾都是AI写的、没有自己的思考——那降AI率只是解决了表面问题,答辩的时候该暴露还是会暴露。

希望这篇技术解读对你有帮助。如果还有其他技术层面的疑问,欢迎评论区讨论。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献936条内容

已为社区贡献936条内容

所有评论(0)