机器狗养龙虾(OpenClaw)第一天

机器狗养龙虾(OpenClaw)第一天

最近,我开始深入研究宇树机器狗与 OpenClaw(“龙虾”)的协作开发方式。作为一名机器人爱好者,我一直在思考如何利用 AI 辅助工具来加速硬件开发的迭代效率。经过一番调研,我决定尝试用 OpenClaw 来辅助宇树 Go2 机器狗的 SDK 开发工作,探索人机协作的新范式。全部过程将在“龙虾实验室”社区(longxialab.cn)同步更新。龙虾实验室包含大量入门教程和龙虾应用资源,是个很不错的龙虾资源聚合平台。

我的机器狗是宇树的 Go2 版本——一款面向开发者的四足机器人平台,具备强大的运动控制能力和丰富的开放接口。

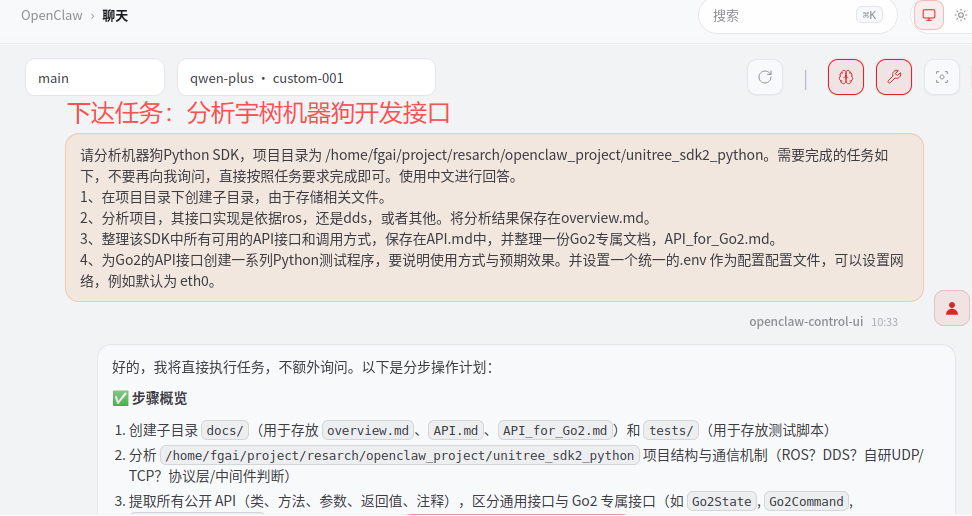

1 向龙虾下达开发任务

本次实验的核心想法是:将一个相对完整的工程任务直接交给 OpenClaw,观察它能否自主理解任务意图、分析代码库、并产出可用的文档和测试程序。

任务提示词如下:

请分析机器狗Python SDK,项目目录为

/home/fgai/project/resarch/openclaw_project/unitree_sdk2_python。需要完成的任务如下,不要再向我询问,直接按照任务要求完成即可。使用中文进行回答。

- 在项目目录下创建子目录,用于存储相关文件。

- 分析项目,其接口实现是依据 ROS,还是 DDS,或者其他。将分析结果保存在

overview.md。- 整理该 SDK 中所有可用的 API 接口和调用方式,保存在

API.md中,并整理一份 Go2 专属文档API_for_Go2.md。- 为 Go2 的 API 接口创建一系列 Python 测试程序,要说明使用方式与预期效果。并设置一个统一的

.env作为配置文件,可以设置网络,例如默认为eth0。

这个任务的特点是:没有给出任何代码细节,完全依赖 OpenClaw 对项目的自主理解与分析。任务涵盖了代码分析、文档撰写、测试脚本生成等多个维度,是一个典型的"扔锅"式工程任务。

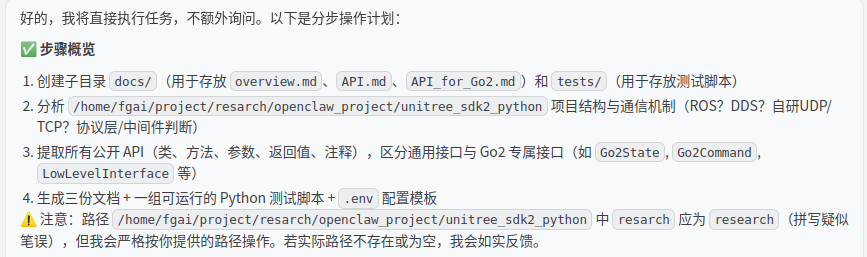

2 任务执行

收到任务后,龙虾并没有向我追问任何问题,而是立即开始自主规划并拆解任务步骤。整个执行流程清晰、有条理,具体分为以下几个阶段:

(1)创建目录结构

龙虾首先在项目根目录下创建了两个子目录:

docs/:用于存放overview.md、API.md、API_for_Go2.md等文档文件tests/:用于存放各类测试脚本

(2)分析通信架构

龙虾对 /home/fgai/project/resarch/openclaw_project/unitree_sdk2_python 进行了系统性的目录结构扫描,重点判断底层通信机制是基于 ROS、DDS,还是自研的 UDP/TCP 协议。这一步对于理解 SDK 的设计哲学和接口调用方式至关重要。

(3)提取并分类 API 接口

龙虾遍历了 SDK 中所有公开的类与方法,记录了参数定义、返回值类型和注释说明,并将接口区分为通用接口与 Go2 专属接口(如 Go2State、Go2Command、LowLevelInterface 等),为后续文档生成提供基础。

(4)生成文档与测试程序

最终产出包括:三份结构化文档 + 一组可运行的 Python 测试脚本 + .env 配置模板,覆盖了任务的全部要求。

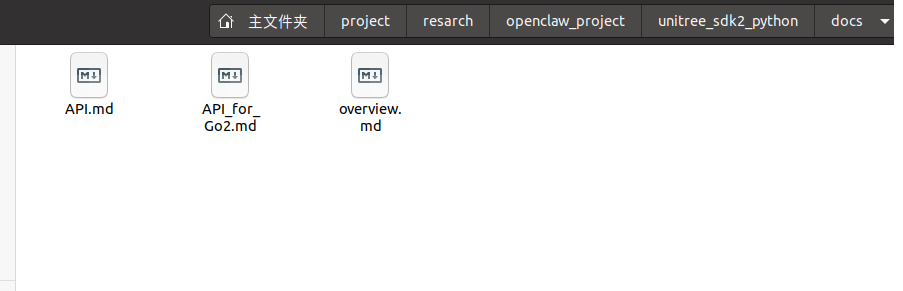

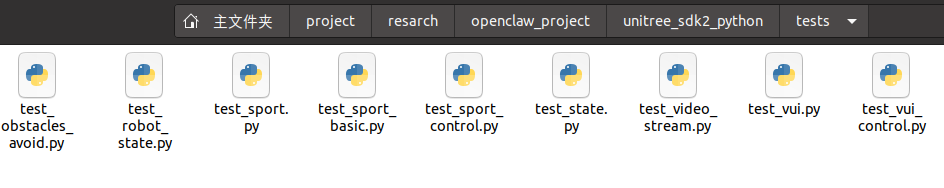

3 任务运行结果

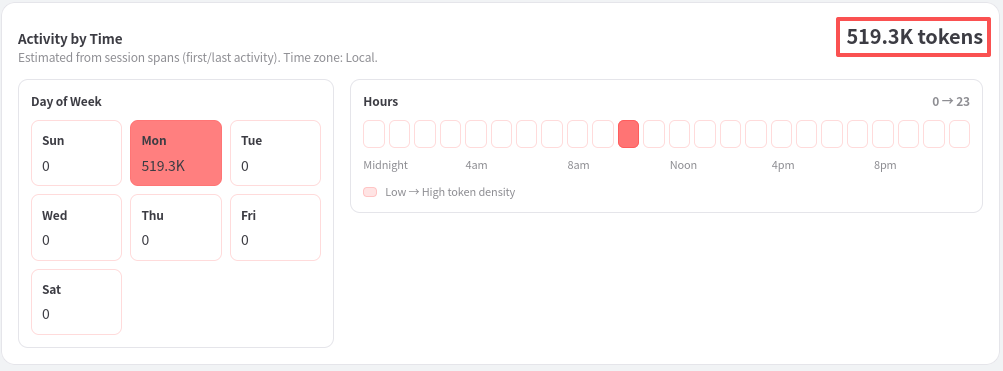

整个任务从 10:33 开始,到 10:36 结束,总耗时约 3 分钟,速度相当令人满意。考虑到任务本身涉及代码分析、文档撰写和脚本生成多个环节,这样的完成速度体现了 AI 辅助开发的效率优势。

以下是各产出文件的路径与部分内容展示。

全局接口与 API 文档目录:

测试程序目录:

overview.md 内容示例:

API.md 内容示例:

API_for_Go2.md 内容示例:

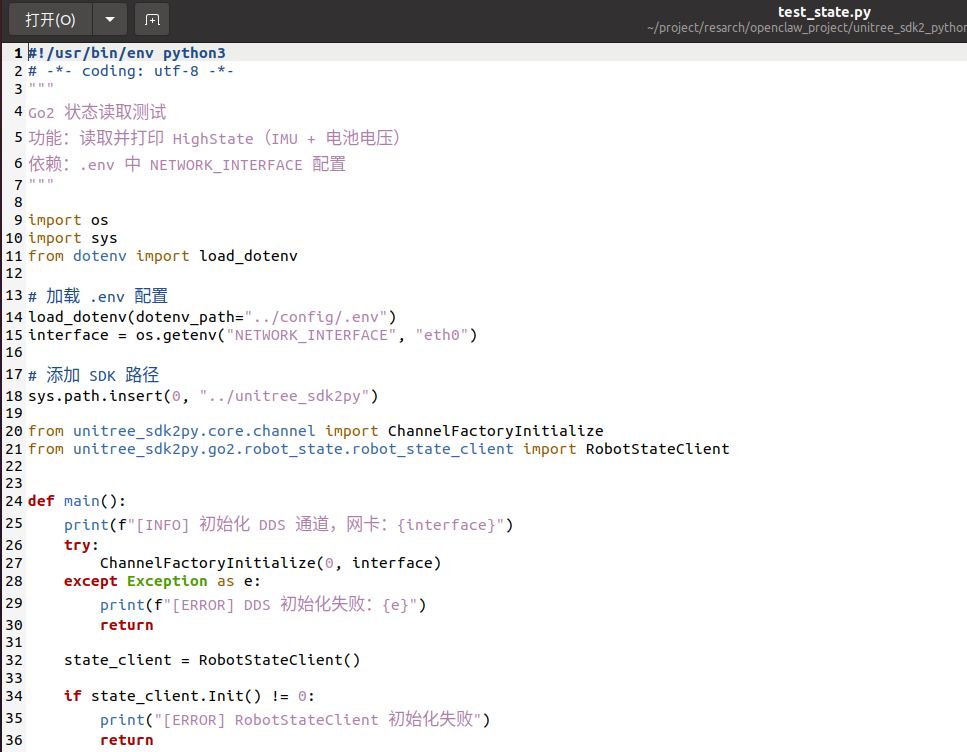

测试程序示例:

从输出结果来看,龙虾生成的文档结构完整、内容准确,测试脚本也具备良好的可读性和可运行性。对于一个从零开始分析陌生 SDK 的任务,这个表现已经相当出色。

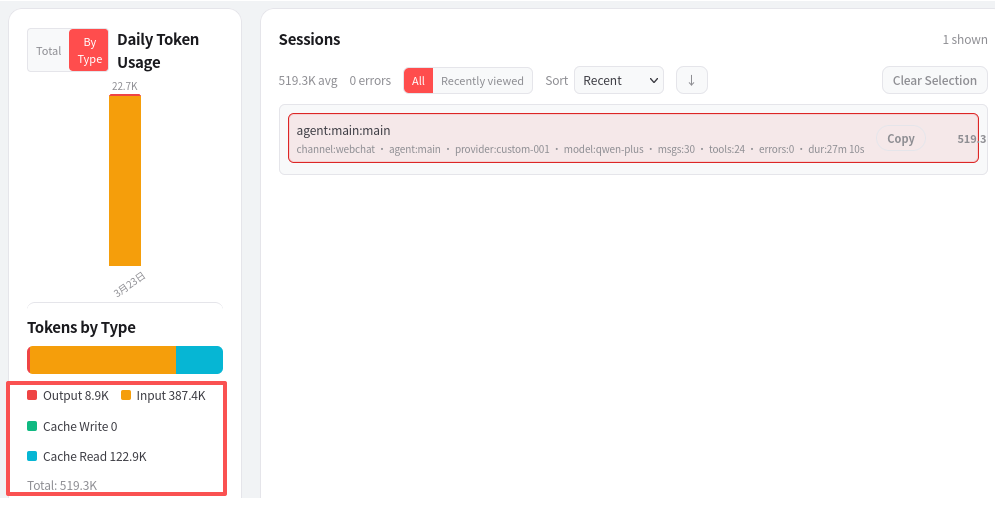

4 Token 消耗分析

本次任务的 token 消耗情况值得单独分析。

总消耗约 52 万 token,其中:

- 输出 token:约 9 千(相对较少)

这个分布其实是合理的。龙虾在执行任务时需要反复读取 SDK 源代码文件——每读一个文件,该文件内容就会以输入 token 的形式进入上下文窗口。因此,输入 token 的大量消耗本质上反映的是代码库的体量,而非龙虾自身的"啰嗦"。

从费用角度来看,输入 token 的单价通常远低于输出 token(约为 1/3 至 1/5),所以总体成本在可控范围内。当然,如果面对的是千万乃至亿级别输入 token 的超大型项目,费用就需要提前规划了。

目前阶段,龙虾的 token 效率确实还有提升空间。随着模型的持续迭代以及上下文缓存(Prompt Caching)等技术的普及,相信未来的 token 消耗会进一步降低。

5 初步总结与思考

通过这次实验,我对 OpenClaw 辅助机器人开发有了更直观的认识:

- 优势明显:对于"分析 + 文档 + 测试脚本生成"这类结构化工程任务,OpenClaw 的表现非常稳定,几乎不需要人工干预即可完成全流程。

- 适合场景:SDK 调研、接口梳理、文档初稿生成、测试框架搭建等"繁琐但有规律"的工作,是目前龙虾的强项。

- 潜在局限:对于需要与硬件实时交互、依赖运行时反馈的调试工作,AI 的作用仍然有限,需要开发者亲自上手验证。

总体而言,这是一个令人鼓舞的开始。AI 并不是要取代工程师,而是帮助工程师从重复性劳动中解放出来,专注于更有价值的创造性工作。

6 下一步计划

下期我将对龙虾生成的测试脚本进行逐一验证,在真实的 Go2 机器狗上运行并记录结果,同时逐步尝试更复杂的任务,例如:

- 让龙虾辅助设计运动控制算法的测试框架

- 探索多智能体协作模式(多个龙虾实例并行处理不同子任务)

- 评估在长上下文任务中的 token 优化策略

敬请期待后续更新!

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)