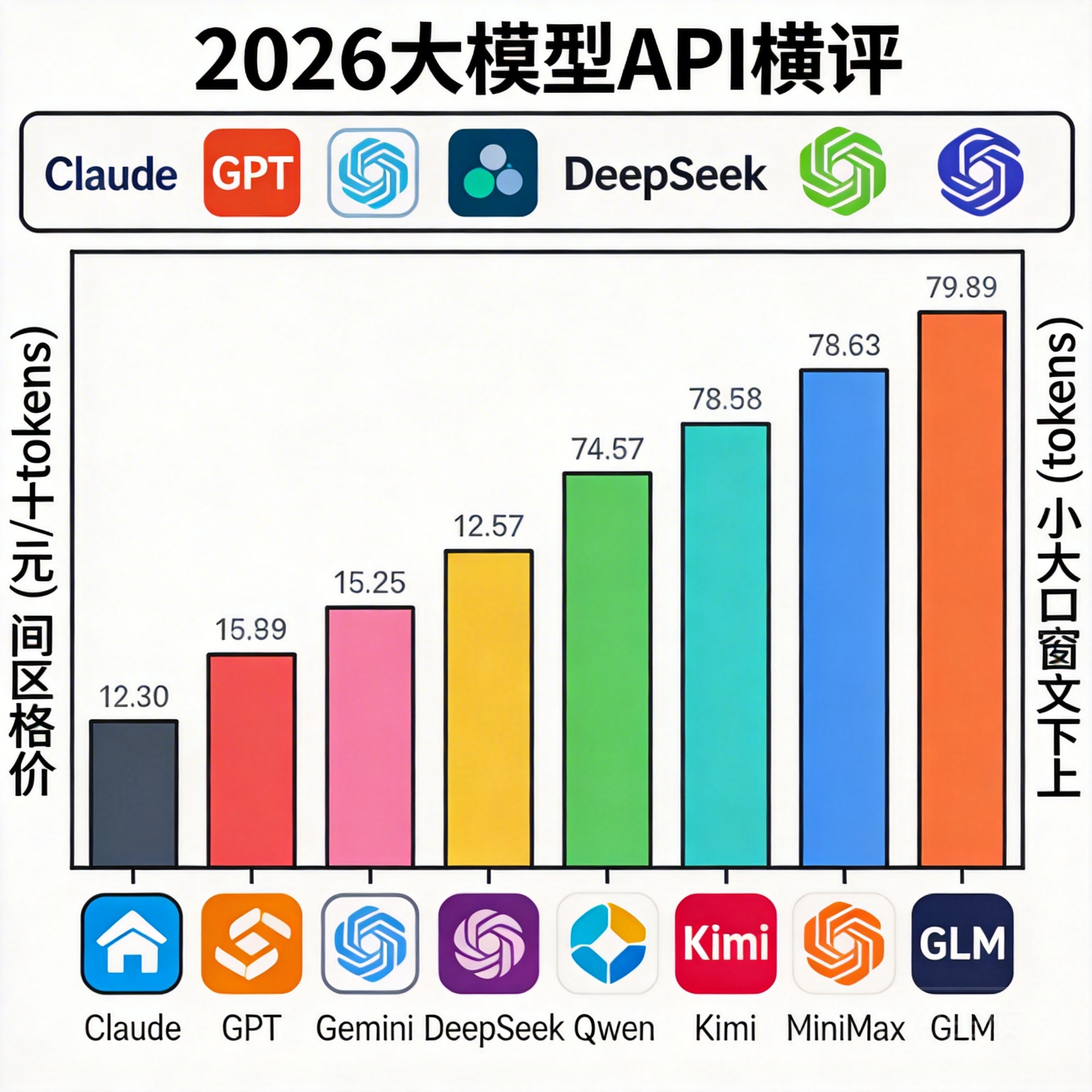

大模型API怎么选?20款主流AI模型价格与代码能力实测指南

2026年全网最全大模型API横评:Claude / GPT / Gemini / Qwen / MiniMax / Kimi / DeepSeek / GLM

大模型 API 横评是开发者选型的核心参考。本文覆盖 8 大厂商 20+ 主流模型,从价格、上下文窗口、推理能力、编程性能、中文质量、响应速度六个维度全面对比,所有数据来自官方文档(截至 2026 年 3 月)。无论你是做 Agent 开发、RAG 系统还是日常代码辅助,读完这篇可以直接做出选型决策。

一、价格总览:各模型每百万 Token 费用对比

价格是 API 选型第一要素。以下为各厂商旗舰模型和经济型模型的官方定价(2026 年 3 月,单位:美元 / 百万 Token):

国际模型

| 模型 | API ID | 输入价格 | 输出价格 | 上下文窗口 |

|---|---|---|---|---|

| Claude Opus 4.6 | claude-opus-4-6 |

$5.00 | $25.00 | 1M tokens |

| Claude Sonnet 4.6 | claude-sonnet-4-6 |

$3.00 | $15.00 | 1M tokens |

| Claude Haiku 4.5 | claude-haiku-4-5-20251001 |

$1.00 | $5.00 | 200k tokens |

| GPT-4o | gpt-4o |

$2.50 | $10.00 | 128k tokens |

| GPT-4.1 | gpt-4.1 |

$2.00 | $8.00 | 1M tokens |

| GPT-4.1 mini | gpt-4.1-mini |

$0.40 | $1.60 | 1M tokens |

| o3 | o3 |

$10.00 | $40.00 | 200k tokens |

| o4-mini | o4-mini |

$1.10 | $4.40 | 200k tokens |

| Gemini 2.5 Pro | gemini-2.5-pro |

$1.25 | $10.00 | 1M tokens |

| Gemini 2.5 Flash | gemini-2.5-flash |

$0.30 | $2.50 | 1M tokens |

| Gemini 2.5 Flash-Lite | gemini-2.5-flash-lite |

$0.10 | $0.40 | 1M tokens |

GPT-4.1 / GPT-4.1 mini 价格来自 OpenAI 官方文档,o3/o4-mini 为推理模型,按思考 token 计费,实际成本受任务复杂度影响。

国内模型

| 模型 | API ID | 输入价格 | 输出价格 | 上下文窗口 |

|---|---|---|---|---|

| DeepSeek-V3.2 | deepseek-chat |

$0.28(无缓存)/ $0.028(缓存命中) | $0.42 | 128k tokens |

| DeepSeek-R1(推理) | deepseek-reasoner |

$0.28(无缓存)/ $0.028(缓存命中) | $0.42 | 128k tokens |

| Qwen3-Max | qwen3-max |

$0.36–$1.00 | $1.43–$4.01 | 262k tokens |

| Qwen3.5-Plus | qwen3.5-plus |

$0.12–$0.57 | $0.69–$3.44 | 1M tokens |

| Qwen-Flash | qwen-flash |

$0.05–$0.25 | $0.40–$2.00 | 1M tokens |

| Kimi K2.5 | kimi-k2.5 |

[价格待核实:请查阅 platform.moonshot.cn] | — | 256k tokens |

| MiniMax M2.7 | minimax-m2.7 |

[价格待核实:请查阅 platform.minimaxi.com] | — | [待核实] |

| GLM-4-Flash | glm-4-flash |

[价格待核实:请查阅 open.bigmodel.cn] | — | 128k tokens |

DeepSeek 价格来自官方 API 文档(2026年3月),Qwen 价格为国际版 Global 区报价,国内版略有差异。

二、旗舰模型能力横评

2.1 编程 / Agent 能力

代码生成是当前大模型能力分化最明显的维度。

| 模型 | SWE-bench 得分 | 特色 |

|---|---|---|

| Claude Opus 4.6 | 72.5%(Anthropic 官方,2025年) | Agent 编程行业领先,支持 Computer Use |

| Claude Sonnet 4.6 | 72.7%(Anthropic 官方,2025年) | 性价比旗舰,速度快于 Opus |

| GPT-4.1 | [数据待核实:建议引用 OpenAI 官方评测] | 支持 1M 上下文,代码理解增强 |

| DeepSeek-V3.2 | [数据待核实:建议引用 DeepSeek 官方报告] | 国内开发者首选,FIM 补全支持 |

| Kimi K2.5 | [数据待核实] | 主打 Agentic Coding,支持 thinking 模式 |

SWE-bench 是业界主流的代码能力评测基准,测试模型在真实 GitHub issue 上的修复成功率。

2.2 推理 / 数学能力

各厂商的"推理专用模型"对比:

| 模型 | 推理方式 | 适用场景 |

|---|---|---|

| Claude Opus/Sonnet 4.6 | Extended Thinking(可配置 budget_tokens) | 数学证明、逻辑推断、多步规划 |

| o3 | 原生 Chain-of-Thought,按思考 token 计费 | 竞赛数学、复杂推理 |

| o4-mini | 轻量推理,成本低于 o3 80% | 日常推理任务 |

| DeepSeek-R1(deepseek-reasoner) | Thinking Mode,最大输出 64k | 学术推理、代码调试 |

| Kimi K2 Thinking | 思维链推理模式 | Agent 场景通用推理 |

| Qwen3-Max | 内置混合推理模式 | 中文技术文档、代码 |

2.3 长上下文处理

上下文窗口大小直接决定能处理多长的文档或代码库:

| 等级 | 模型 | 窗口大小 |

|---|---|---|

| 超长(≥1M) | Claude Opus/Sonnet 4.6、GPT-4.1/4.1-mini、Gemini 2.5 Pro/Flash、Qwen3.5-Plus/Qwen-Flash | 1M tokens |

| 长(256k–512k) | Kimi K2.5、Kimi K2-Thinking | 256k tokens |

| 中(128k–262k) | DeepSeek-V3.2/R1、GPT-4o、Qwen3-Max、GLM-4-Flash | 128k–262k tokens |

实际建议:1M 上下文适合整个代码仓库分析;256k 适合长文档问答;128k 满足绝大多数对话场景。

三、价格-性能比分析

极致性价比区(输出 $0.40–$2.50 / MTok)

- Gemini 2.5 Flash-Lite($0.10/$0.40):最便宜的 1M 上下文模型,适合高并发轻量场景

- Gemini 2.5 Flash($0.30/$2.50):速度最快之一,1M 窗口,批量处理首选

- DeepSeek-V3.2($0.28/$1.12):缓存命中后仅 $0.028 输入,国内调用稳定,FIM 补全支持

- Qwen-Flash($0.05–$0.25/$0.40–$2.00):阿里云生态首选,1M 上下文,中文质量优秀

均衡旗舰区(输出 $5–$15 / MTok)

- Claude Sonnet 4.6($3/$15):SWE-bench 72.7%,1M 上下文,当前综合能力最强的均衡模型之一

- Gemini 2.5 Pro($1.25/$10):Google 旗舰,多模态能力强,原生工具调用

- GPT-4.1($2/$8):1M 上下文,代码和指令遵循增强版,比 GPT-4o 便宜

顶级旗舰区(输出 $25–$40 / MTok)

- Claude Opus 4.6($5/$25):Agent 编程和 Computer Use 场景的当前最优模型,128k 最大输出

- o3($10/$40):推理任务天花板,适合竞赛数学和高难度分析,成本高昂

四、各场景选型建议

| 场景 | 推荐模型 | 理由 |

|---|---|---|

| Agent / 自主编程 | Claude Opus 4.6 / Sonnet 4.6 | SWE-bench 领先,支持 Computer Use |

| 生产环境高并发 | Gemini 2.5 Flash / DeepSeek-V3.2 | 速度快、成本低 |

| 复杂数学推理 | o3 / DeepSeek-R1 | 原生推理链,准确率更高 |

| 超长文档处理 | Claude Sonnet 4.6 / Gemini 2.5 Pro | 1M 窗口,长上下文质量稳定 |

| 国内部署,中文优先 | Qwen3-Max / Kimi K2.5 / DeepSeek-V3.2 | 低延迟接入,中文训练数据充足 |

| 多模态(图像/视频) | Gemini 2.5 Pro / GPT-4o / Kimi K2.5 | 原生多模态架构 |

| 极致成本控制 | Gemini 2.5 Flash-Lite / Qwen-Flash | 输入 $0.05–$0.10,1M 窗口 |

| 角色扮演 / 创意写作 | MiniMax M2-Her / Kimi K2.5 | 专项训练,多轮角色场景 |

五、各家 API 接入方式对比

# Claude (Anthropic SDK)

import anthropic

client = anthropic.Anthropic(api_key="YOUR_KEY")

resp = client.messages.create(model="claude-opus-4-6", max_tokens=1024, messages=[...])

# GPT (OpenAI SDK)

from openai import OpenAI

client = OpenAI(api_key="YOUR_KEY")

resp = client.chat.completions.create(model="gpt-4.1", messages=[...])

# DeepSeek (兼容 OpenAI SDK)

client = OpenAI(api_key="YOUR_KEY", base_url="https://api.deepseek.com")

resp = client.chat.completions.create(model="deepseek-chat", messages=[...])

# Qwen (兼容 OpenAI SDK)

client = OpenAI(api_key="YOUR_KEY", base_url="https://dashscope-intl.aliyuncs.com/compatible-mode/v1")

resp = client.chat.completions.create(model="qwen3-max", messages=[...])

# Kimi (兼容 OpenAI SDK)

client = OpenAI(api_key="YOUR_KEY", base_url="https://api.moonshot.cn/v1")

resp = client.chat.completions.create(model="kimi-k2.5", messages=[...])

# GLM (兼容 OpenAI SDK)

client = OpenAI(api_key="YOUR_KEY", base_url="https://open.bigmodel.cn/api/paas/v4/")

resp = client.chat.completions.create(model="glm-4-flash", messages=[...])

关键结论:DeepSeek、Qwen、Kimi、GLM 均兼容 OpenAI SDK,只需替换 base_url 和 api_key,迁移成本极低。

对于需要同时管理多个模型 API Key 的开发场景,可以通过统一推理网关接入,例如七牛云 AI 大模型推理服务兼容 OpenAI/Anthropic 双标准,支持 Claude、DeepSeek、Gemini 等主流模型,切换模型无需修改调用代码。

六、中文能力专项

中文任务性能是国内开发者的核心关切:

| 模型 | 中文训练数据 | 中文推荐场景 |

|---|---|---|

| Qwen3-Max / Qwen3.5-Plus | 阿里云,中文语料丰富 | 中文文档生成、客服、RAG |

| DeepSeek-V3.2 | 国内数据集,中文指令遵循强 | 中文代码注释、技术翻译 |

| Kimi K2.5 | Moonshot,中文长文本优化 | 长文摘要、合同分析 |

| GLM-4-Flash | 清华,中文学术场景 | 知识问答、学术写作辅助 |

| Claude Sonnet 4.6 | 多语言训练,中文质量上升 | 中英文混合任务 |

常见问题

Q:DeepSeek API 和 Claude API 哪个更适合做 Agent?

Claude Opus/Sonnet 4.6 在 SWE-bench(72.5%/72.7%)上领先,原生支持 Computer Use 和 Extended Thinking,是当前 Agent 场景的首选。DeepSeek 性价比更高,成本约为 Claude 的 1/10,适合预算有限或高并发 Agent 流水线。两者并不互斥:可以用 DeepSeek 做初步筛选,再用 Claude 处理复杂子任务。

Q:Gemini 2.5 Flash 和 Claude Haiku 4.5 哪个更划算?

价格上 Gemini 2.5 Flash 更低($0.30/$2.50 vs $1.00/$5.00),且同样支持 1M 上下文。Claude Haiku 4.5 上下文窗口为 200k,但在中文任务和指令遵循方面口碑更稳定。实际建议:做 benchmark 跑自己的用例后再决策。

Q:o3 值得用吗?价格这么高。

o3($10/$40 每百万 token)适合有明确的高精度推理需求场景:竞赛数学、代码安全审计、复杂法律分析。日常编程和文本任务用 Claude Sonnet 4.6 或 GPT-4.1 成本低 80% 以上,且实际输出质量差距不显著。

Q:国内访问哪个模型最稳定?

DeepSeek(api.deepseek.com)、Qwen(dashscope.aliyuncs.com)、Kimi(api.moonshot.cn)、GLM(open.bigmodel.cn)均提供国内节点,无需代理。Claude 和 GPT 官方 API 需要境外网络,可通过兼容层代理访问。

Q:如何快速测试多个模型对同一 prompt 的输出质量?

将 OpenAI SDK 的 base_url 配置为多模型推理网关,用相同代码切换 model 参数即可对比,无需为每家分别写 SDK 调用逻辑。

总结

2026 年大模型 API 格局已高度分化:

- 能力天花板:Claude Opus 4.6 和 o3 分别在 Agent 编程和数学推理上领先,但成本高昂

- 均衡旗舰:Claude Sonnet 4.6、Gemini 2.5 Pro、GPT-4.1 是性价比最高的旗舰选择

- 成本最优:DeepSeek-V3.2 和 Gemini 2.5 Flash/Flash-Lite 提供最低成本,适合高并发生产环境

- 国内首选:Qwen3-Max / DeepSeek-V3.2 / Kimi K2.5 兼顾中文质量与访问稳定性

根据 Anthropic、OpenAI、Google、DeepSeek、阿里云官方文档(2026年3月),本文所有价格和参数以官方实时定价为准,建议在正式采购前再次核实最新报价。

延伸资源:

- 多模型对比体验:https://www.qiniu.com/ai/models

- Anthropic 模型文档:https://platform.claude.com/docs/en/about-claude/models/overview

- DeepSeek API 文档:https://api-docs.deepseek.com

- Gemini 定价页:https://ai.google.dev/gemini-api/docs/pricing

本文数据截至 2026 年 3 月,大模型价格变动频繁,建议每季度核对官方最新定价后再做预算规划。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献45条内容

已为社区贡献45条内容

所有评论(0)