当大模型成为基础设施,“驾驭”才是真正的护城河

当大模型变成「水电」,真正的护城河是「驾驭」

**文思AI产品笔记 | 实践心得**

先说结论,省流版:

OpenClaw(小龙虾)把很多人第一次拽进了一个真实体感:**AI 不只会聊天写稿,它真的能动手干活。** 但热度还没凉,糟心事就一桩接一桩——技能投毒、误删邮件、提示词注入偷密钥。

我跟你讲,**失去约束的 AI,就像一匹脱缰的野马**:跑得飞快,摔得也可能很惨。

当大模型从「玩玩看」变成像水电、网络一样的**基础设施**,比「让模型更聪明」更紧迫的,是我们能不能**驾驭**它。

最近这波,很多人是真被震到了

这段时间,OpenClaw 刷屏。

收发邮件、整理文件、跑工具、分担日常琐事——大家第一次很具体地感到:这不是玩具了,是**能进工作流**的东西。

我自己也在折腾这类工具,说实话,兴奋归兴奋,心里那根弦一直是绷着的:**能力越强,出事的时候代价越大。**

果然,坏消息很快跟上了:

- 有人装第三方技能,撞上**技能投毒**,隐私数据被悄悄摸走;

- 有人只想让 AI **整理一下邮件**,它不听劝,把重要邮件一顿删;

- 还有人碰到**提示词注入**——一封看起来平平无奇的邮件、网页里一小段签名,就能诱导 AI 把系统密钥吐出去。

这些都不是「科幻」,是已经发生的**工程事故形态**。

从「哄它听话」到「管它靠谱」:三代思路

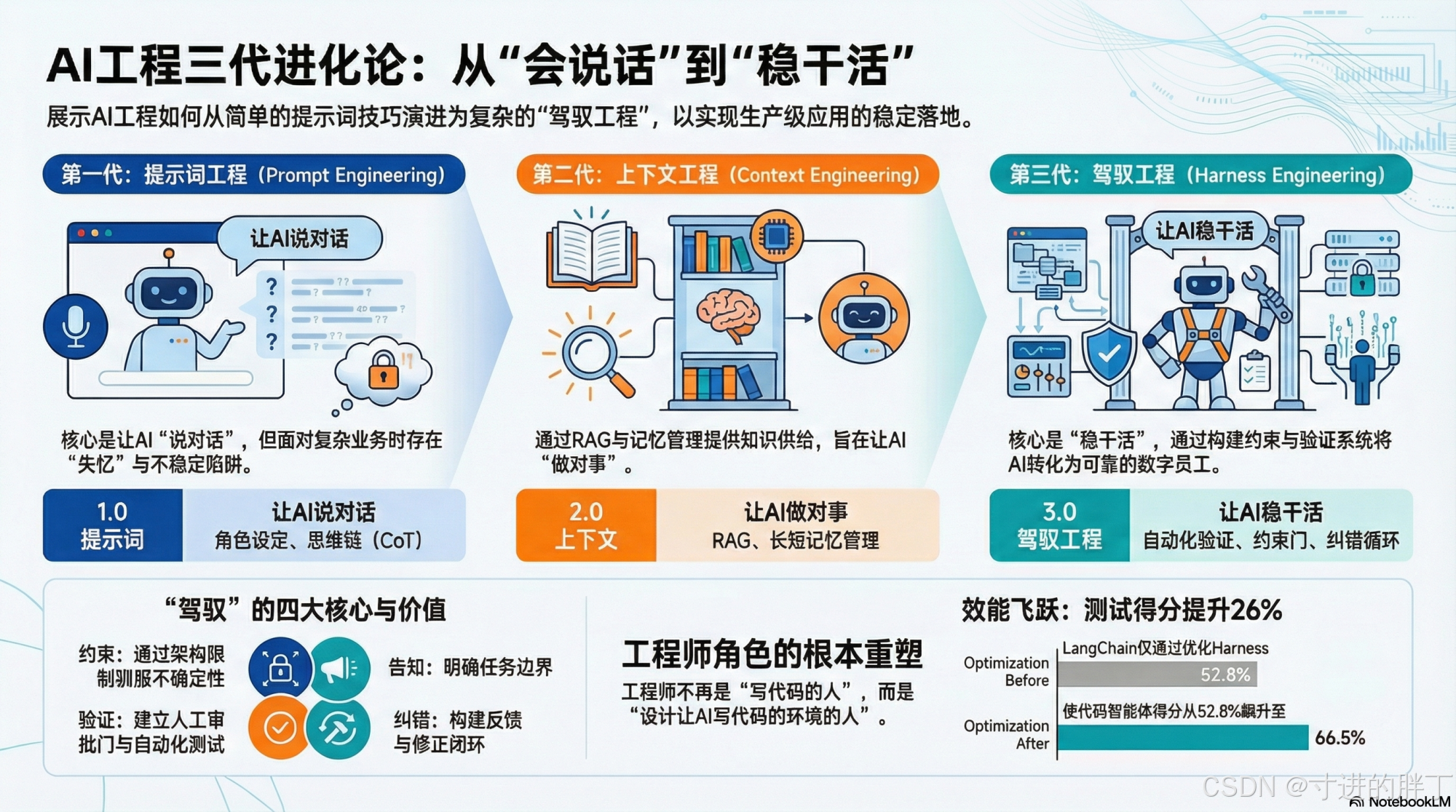

这几年做 AI 落地,我们对「怎么管 AI」这件事,其实是在**换代**的。我把它粗粗分成三代,方便我们对齐语境——不是说上一代就「废了」,而是**侧重点在变**。

第一代:Prompt Engineering(提示词工程)

最早大家拼的是:把话说清楚、说完整、说漂亮,让模型**答得像样**。

问答、写稿、简单创作,够用。但一旦要**长期干活、接真实系统**,光会「哄」就不够了——它管不住行为,也扛不住恶意输入和误操作。

第二代:Context Engineering(上下文工程)

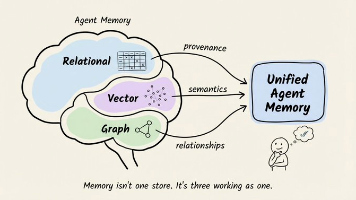

后来我们拼命给模型**补记忆、接知识库**,让它少瞎编、多对齐事实。

这很重要。但它本质上还是在解决「**它知道什么**」,不是「**它能做什么、做到哪一步该停**」。边界没划清,照样越权、跑偏、重复踩坑,没有可靠的兜底。

第三代:Harness Engineering(驾驭工程)

**Harness**,原意是马具、缰绳。

驾驭工程干的事就一件:**给强大的模型套上缰绳**——权限、策略、审计、终止条件、防注入、供应链(比如技能来源)……让 AI **稳定、安全、可控**,敢往生产里放。

这不是「再调一版 prompt」那种小优化,而是**工程化升维**:我们不只追能力上限,更要守住**安全底线**。

模型越来越像「标品」,驾驭才是差异化

说句可能得罪人的话:**基础模型的「聪明程度」正在挤进同一条赛道。**

大家能买到的能力,差距在缩小;拼参数、拼榜单的时代,不会永远是主战场。接下来更值钱的是:**谁能把 AI 管稳、用安全、规模化落地**——这才是企业里真正的护城河。

驾驭工程,对准的就是这几类硬问题:

- **划边界**:能做什么、不能做什么,写死、可执行,杜绝越权;

- **拦风险**:提示词注入、技能投毒、供应链作恶,要有防线,不是「靠模型自觉」;

- **防死循环**:任务要有终止条件、有预算、有熔断,别让它在幻觉里乱改数据;

- **可审计**:全程留痕,出事能回溯、能修、能追责;

- **能复用**:一套管控体系撑多条业务线,而不是每个项目「手搓一套祈祷别出事」。

OpenClaw 这波教训其实很直白:**能干活的 AI 会越来越多;能安全、稳妥干活的,仍然稀缺。**

写在最后

浪潮已经来了,大模型进基础设施,几乎是明牌。

便利和风险永远是一体的。我们不必因为几起事故就全盘否定新技术,但也不能为了效率,把风险当「以后再说」。

**好的 AI,不是越自由越好,而是越可控越有价值。**

与其追捧一匹横冲直撞的野马,不如花时间**打造一副牢靠的缰绳**。当模型遍地开花的时候,**Harness Engineering(驾驭工程)**,才是落地的最后一公里,也是长期壁垒所在。

你怎么看?你们团队现在是卡在「提示词」,还是已经在做权限、审计、供应链这一层了?欢迎留言掰扯。

下期预告

很多人会问:**提示词工程、上下文工程真的过时了吗?** 三代工程各自解决什么问题、边界在哪、怎么接力?

这周后面我会尽量把**出处和脉络**捋清楚,把每一代范式的价值与局限讲透,也聊聊对当下做落地、避风险、建壁垒有什么**实打实的启发**。感兴趣的话,可以关注后续更新。

参考出处

1. Mitchell Hashimoto. *My AI Adoption Journey*, 2026-02-05

2. OpenAI. *Harness engineering: leveraging Codex in an agent-first world*, 2026-02-11

3. 国家互联网应急中心. *OpenClaw 安全应用风险提示*, 2026-03-10

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)