AI 应用里的意图识别优化:从“纯 LLM 分类”到“意图知识库 + 检索路由”

在开发对话类 AI 应用时,用户体验的关键往往取决于一个看似不起眼的环节:能否快速、稳定地判断用户的真实意图。

以一个常见场景为例:用户在智能客服应用中输入:

“我想去人民广场,怎么走?”

“附近有没有卫生间?”

“我东西丢了,怎么办?”

对应用而言,这些话语对应着截然不同的处理链路。通常可以分解为两个步骤:

意图识别:判断用户是在询问路线、查询周边、寻求失物招领帮助,还是在闲聊。

槽位抽取:将关键信息结构化提取,例如出发地与目的地、地点名称、物品类型、时间等。

这两个环节的稳定性至关重要:若处理不当,可能导致意图误判引发答非所问,或信息抽取不全致使后续服务无法调用;而若设计得过于复杂,又会显著拉长响应延迟。尤其是客服这类对实时性敏感的场景,响应延迟的波动将直接影响用户体验。

下文将结合智能客服项目的实践,探讨从“纯 LLM 意图分类”到“意图知识库 + 检索路由”的优化路径。

该项目基于百炼工作流构建,意图类别主要包括:通用查询、路径规划、周边信息、失物招领、闲聊。

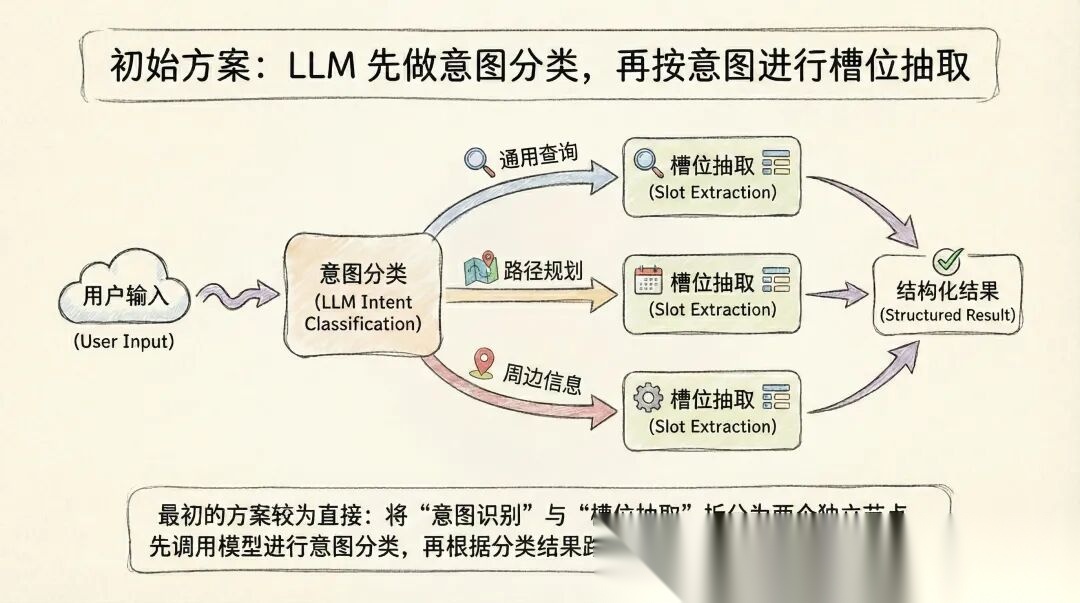

初始方案:LLM 先做意图分类,再按意图进行槽位抽取

最初的方案较为直接:将“意图识别”与“槽位抽取”拆分为两个独立节点,先调用模型进行意图分类,再根据分类结果路由至对应的槽位抽取节点。

意图识别环节使用百炼平台的意图分类节点,其提供两种执行模式:

快速模式:响应速度快,通常在 1 秒以内,但准确率受提示词质量影响较为明显。

效果模式:引入更完整的推理过程,准确率更高,但延迟也相应增加,通常大于 2 秒。

考虑到客服场景对响应速度更为敏感,当时优先选择了快速模式,以控制整体交互延迟。

方案优势

结构清晰,扩展成本低:新增或调整意图时,通常只需修改对应分支。例如新增“票务查询”意图,只需补齐该意图下的槽位抽取与后续处理逻辑即可。

单点聚焦,优化更高效:槽位抽取按意图拆分后,每个节点的覆盖范围更明确,提示词不易失控,问题定位也更直接。

方案的不足之处

随着业务规模扩大,该方案的不足也逐渐显现,主要体现在延迟与维护成本两方面。

链路更长,端到端延迟叠加:意图识别与槽位抽取分两次调用完成,虽然每个步骤的耗时可控,但整体延迟会随链路叠加而累加。

提示词维护成本上升:为提升分类准确率,需要持续补充意图定义与示例,导致提示词复杂度与 token 消耗随之增长,迭代效率受到影响。

适用场景

该方案更适合对响应速度要求相对宽松的场景,例如企业内部咨询等非实时应用,其更看重结构清晰、便于维护与持续扩展的特性。

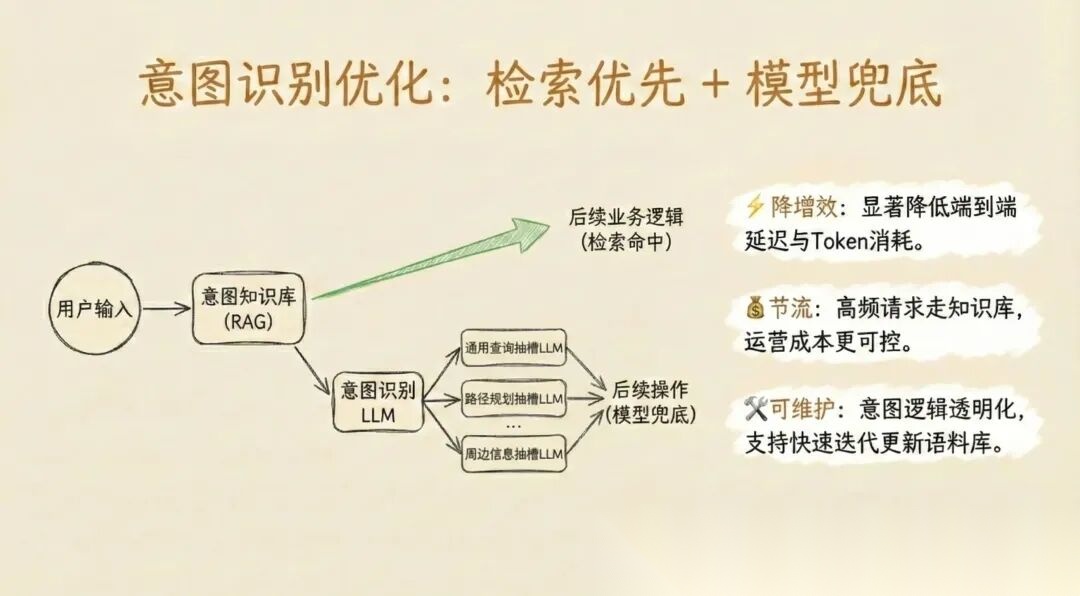

优化方案:将“实时泛化”能力前置为可维护的“意图知识库”

本轮优化的核心目标是解决以下问题:能否让一部分意图判断从“每次都需调用模型在线分类”,转变为“先检索知识库,若命中则直接路由”。

在诸多业务场景中,用户表达的差异更多体现在措辞层面,而非意图本身。将常见问法、同义表达提前沉淀为语义语料,线上通过向量检索进行相似度召回,往往能覆盖大量高频请求,从而显著降低端到端延迟与 token 消耗。

简而言之,即将 LLM 的“实时泛化”能力部分前置,构建为可维护、可迭代的“意图知识库”,线上采用“检索优先 + 模型兜底”的策略完成意图识别。

核心流程

1.构建意图知识库:每条记录包含“用户问法”与“对应意图”的映射关系。

2.线上检索:用户提问时,首先进行语义检索,召回最相近的候选问法及其意图。

3.判断与路由:

- 命中:若召回结果相似度达到预设阈值,则直接采用该意图,路由至对应槽位抽取节点。

- 未命中:再调用 LLM 结合规则进行兜底意图识别,然后路由至相应分支。

其整体思路是让高频请求通过“检索直达”快速处理,让长尾、复杂请求通过“模型兜底”确保覆盖,兼顾效率与准确性。

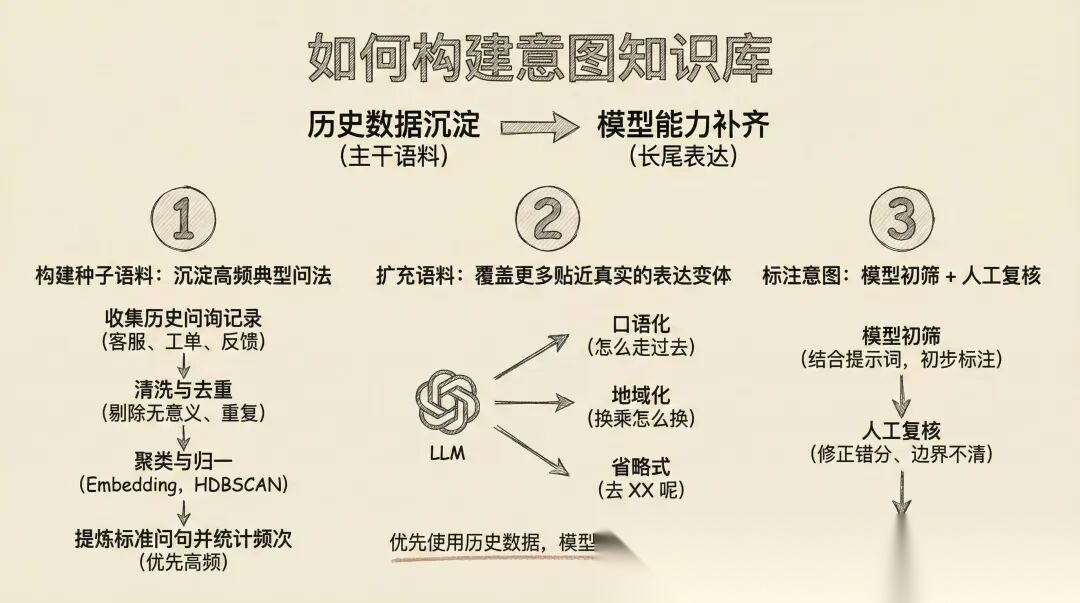

如何构建意图知识库

意图知识库的构建可概括为两个步骤:先基于历史数据沉淀主干语料,再借助模型能力适度补齐长尾表达。

- 构建种子语料:沉淀高频典型问法

收集历史问询记录:从客服对话日志、用户工单、反馈渠道等多来源获取真实的用户表达。

清洗与去重:剔除无意义内容及重复文本,保留核心的“问题句”。

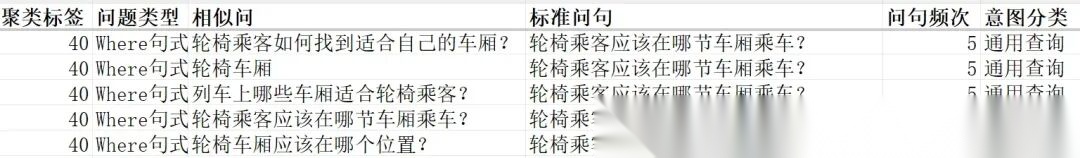

聚类与归一:使用 Embedding 技术将问题向量化,再运用 HDBSCAN 等聚类算法。聚类后,提炼出“标准问句”。

提炼标准问句并统计频次:以标准问句为维度汇总出现频次,优先选取高频问题作为典型问法种子。

- 扩充语料:覆盖更多贴近真实的表达变体

若历史记录覆盖不全,或希望快速补齐表达多样性,可借助 LLM 基于种子语料生成同义句,例如:

口语化表达:“怎么走过去”、“从这里到那边怎么坐车”。

地域化/习惯表达:“换乘怎么换”、“要不要出站”。

省略式表达:“去 XX 呢”、“到 XX 怎么走”。

需注意,有历史数据时应优先使用历史数据;模型泛化更适合作为“补齐盲区”的辅助手段,而非替代真实语料来源。

- 标注意图:模型初筛 + 人工复核

首先使用大模型结合提示词,对高频标准问句进行初步的意图标注。

随后进行人工复核,修正错分及边界不清的样本。

此步骤的目标并非追求一次性完美,而是将知识库建设至一个可运行、可迭代的初始状态。

线上识别流程:检索优先,模型兜底

线上处理流程设计得较为轻量:

检索命中且达到阈值:取相似度最高的候选作为意图分类结果,直接路由至对应槽位抽取节点。此路径通常无需 LLM 参与,延迟显著降低。

检索未命中或相似度不足:转入 LLM 结合意图识别规则的兜底判断流程,再路由至相应分支。

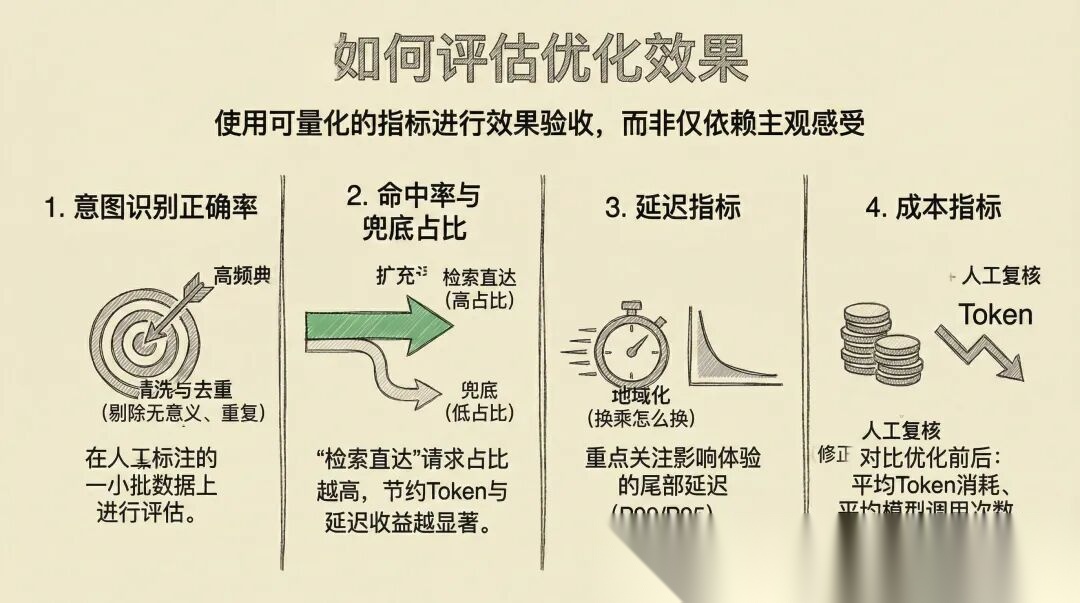

如何评估优化效果

改造完成后,建议使用可量化的指标进行效果验收,而非仅依赖主观感受:

意图识别正确率:在人工标注的一小批数据上进行评估。

命中率与兜底占比:“检索直达”的请求占比越高,节约的 token 与延迟收益越显著。

延迟指标:重点关注影响体验的尾部延迟。

成本指标:对比优化前后的平均 token 消耗、平均模型调用次数、单位会话处理成本。

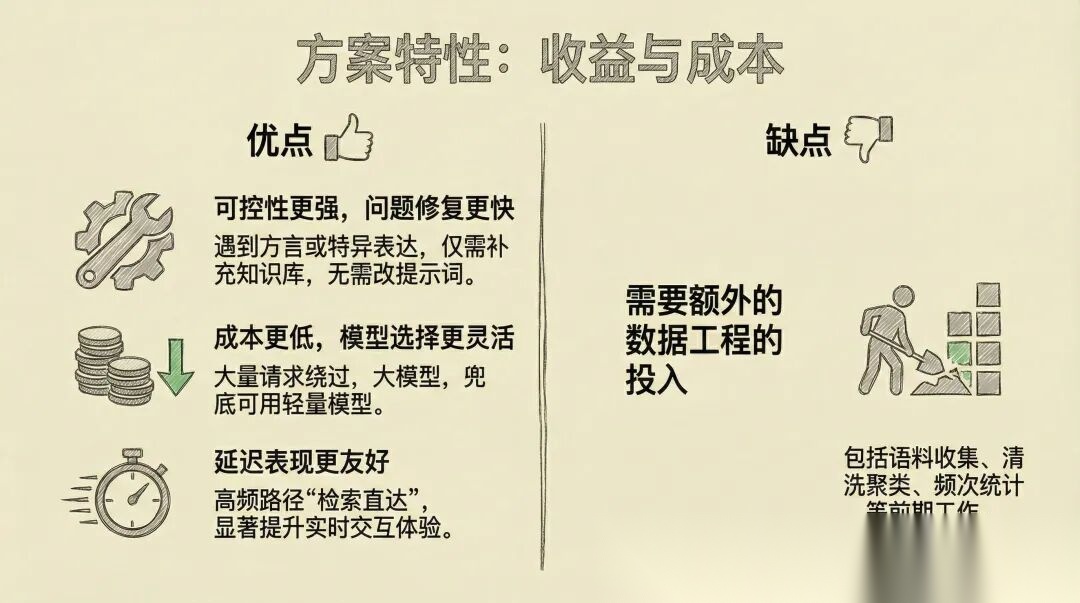

方案特性:收益与成本

学AI大模型的正确顺序,千万不要搞错了

🤔2026年AI风口已来!各行各业的AI渗透肉眼可见,超多公司要么转型做AI相关产品,要么高薪挖AI技术人才,机遇直接摆在眼前!

有往AI方向发展,或者本身有后端编程基础的朋友,直接冲AI大模型应用开发转岗超合适!

就算暂时不打算转岗,了解大模型、RAG、Prompt、Agent这些热门概念,能上手做简单项目,也绝对是求职加分王🔋

📝给大家整理了超全最新的AI大模型应用开发学习清单和资料,手把手帮你快速入门!👇👇

学习路线:

✅大模型基础认知—大模型核心原理、发展历程、主流模型(GPT、文心一言等)特点解析

✅核心技术模块—RAG检索增强生成、Prompt工程实战、Agent智能体开发逻辑

✅开发基础能力—Python进阶、API接口调用、大模型开发框架(LangChain等)实操

✅应用场景开发—智能问答系统、企业知识库、AIGC内容生成工具、行业定制化大模型应用

✅项目落地流程—需求拆解、技术选型、模型调优、测试上线、运维迭代

✅面试求职冲刺—岗位JD解析、简历AI项目包装、高频面试题汇总、模拟面经

以上6大模块,看似清晰好上手,实则每个部分都有扎实的核心内容需要吃透!

我把大模型的学习全流程已经整理📚好了!抓住AI时代风口,轻松解锁职业新可能,希望大家都能把握机遇,实现薪资/职业跃迁~

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献185条内容

已为社区贡献185条内容

所有评论(0)