省下 90% Token!这个 Rust 小工具,专治 AI Coding 的“终端垃圾”

导语: 你有没有算过一笔账?当你在 Claude Code, Codex 或 Cursor 里跑了一次

git status,为了看那 3 个改动过的文件名,AI 实际上“吞下”了 50 行样板文本。这不到 1 秒的操作,可能就消耗了你几毛钱的 Token。更糟糕的是,AI 的上下文与注意力还被这些噪音给稀释了……

一、 你正在给“无意义的垃圾”付费吗?

如果你已经习惯了使用 Claude Code、Codex、Cursor 或 Gemini CLI,你一定经历过这种“肉疼”的时刻:

你只是随手跑了一个 git status 或 pytest,AI 却瞬间“吞下”了数百行终端输出。其中 90% 的内容是:重复的日志、已通过的测试项、冗余的文件路径,以及一堆花里胡哨的终端装饰符。

真相是:终端输出,从来就不是为大模型设计的。

这不仅是在浪费昂贵的 Token,更是在稀释 AI 的注意力。为了解决这个“昂贵且低效”的问题,一个名为 RTK (Rust Token Killer) 的小工具火了。它在github上宣称能将常见命令的 Token 消耗压低 60% 到 90%。

今天,我们深度拆解一下这个 AI 时代的“上下文脱水机”。

RTK GitHub 项目首页截图

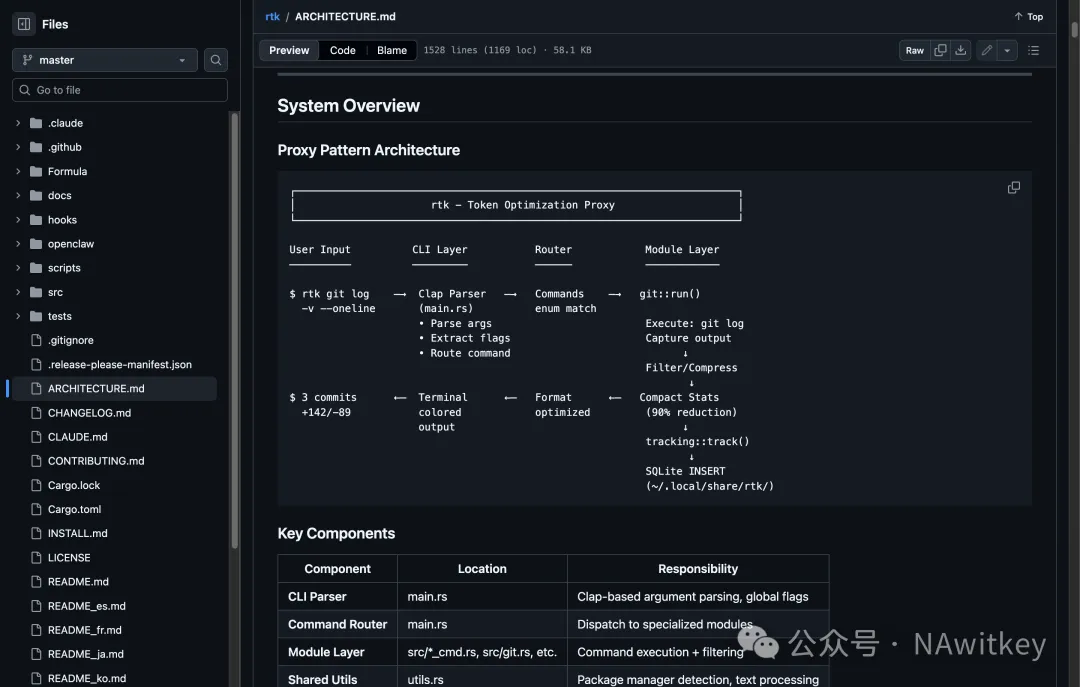

二、 什么是 RTK?它在哪个环节“杀掉”Token?

RTK(Rust Token Killer)不是一个新模型,也不是一个 Prompt 插件,而是一个用 Rust 编写的高性能 CLI Proxy(命令行代理)。

在传统流程中,AI 工具直接读取 Shell 输出,原始噪音被原封不动地塞进上下文。而在 RTK 介入后,流程变成了:

AI 工具 -> RTK 拦截 -> 执行真实命令 -> 结构化过滤/压缩 -> 极简输出 -> AI

它不负责逻辑推理,只做一件事:在命令输出进入 AI 大脑前,先做一轮“高信息密度压缩”。

RTK 官方架构文档截图

三、 它不是简单的“截断”,而是“语义化过滤”

很多人认为压缩输出就是 head -n 20 砍掉一半。但 RTK 的硬核之处在于:它是按命令类型(Command-aware)进行精准切除的。

RTK 内部为不同的开发工具配置了专门的处理模块:

-

• git: 过滤掉无关的提示信息,只保留变更的核心文件列表。

-

• pytest/cargo test: 帮你隐藏掉几百个“Pass”的测试项,只把“Fail”的报错堆栈和最后的 Summary 喂给 AI。

-

• rg/grep: 智能聚合命中的行号,去除冗余路径。

它采用了 JSON 优先解析、状态机过滤以及文本聚合等多种手段。这意味着,AI 看到的不是支离破碎的乱码,而是经过人工筛选后的“高信号”数据。

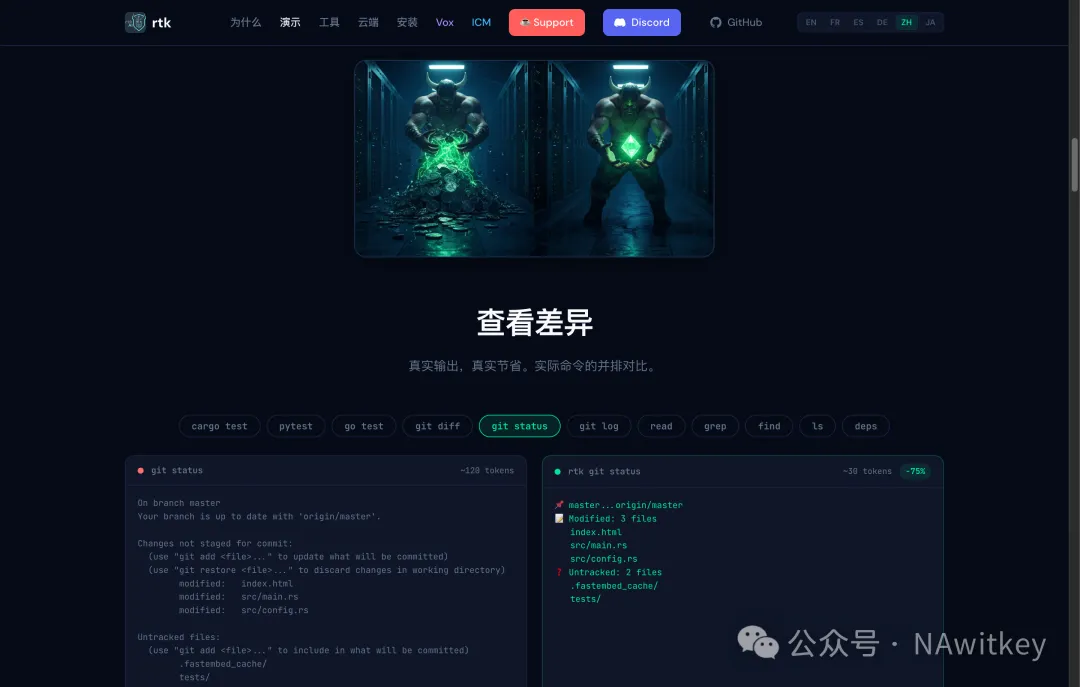

RTK 官网演示截图:git diff 压缩前后对比

四、 RTK vs tokf,你怎么选?

在追求“上下文脱水”的路上,还有一个不可忽视的选手:tokf。

很多开发者会混淆这两者,但它们的设计哲学完全不同:

| RTK | tokf | |

|---|---|---|

| 定位 | ||

| 开箱即用的产品化代理 | ||

| 配置驱动的过滤框架 | ||

| 优势 | ||

| 零配置,内置主流命令语义 | ||

| 极高自由度,规则可版本化 | ||

| 场景 | ||

| 个人开发者,追求即装即用 | ||

| 团队使用,需处理自定义脚本/内部工具 | ||

| 逻辑 | ||

| 内置 Rust 处理逻辑 | ||

rewrites.toml |

||

| 外置规则 | ||

简而言之: 如果你希望 1 分钟解决问题,选 RTK;如果你需要针对公司内部那套复杂的日志格式做精细过滤,tokf 是更好的选择。

五、 工程细节

RTK 能够获得口碑,不仅是因为省钱,更是因为它在工程细节上表现得非常专业:

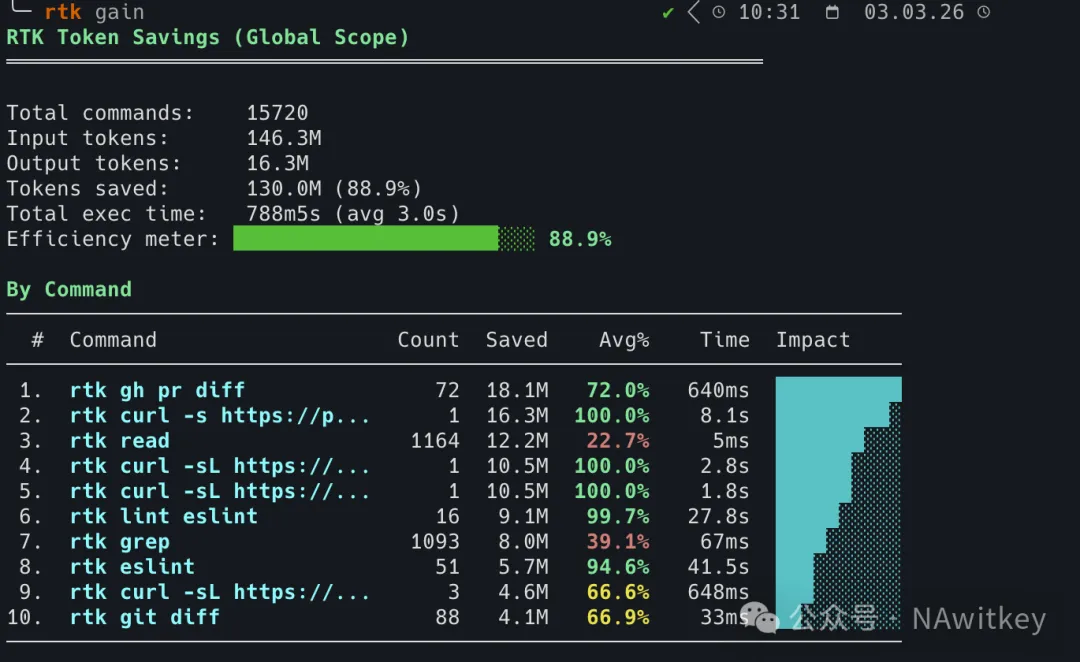

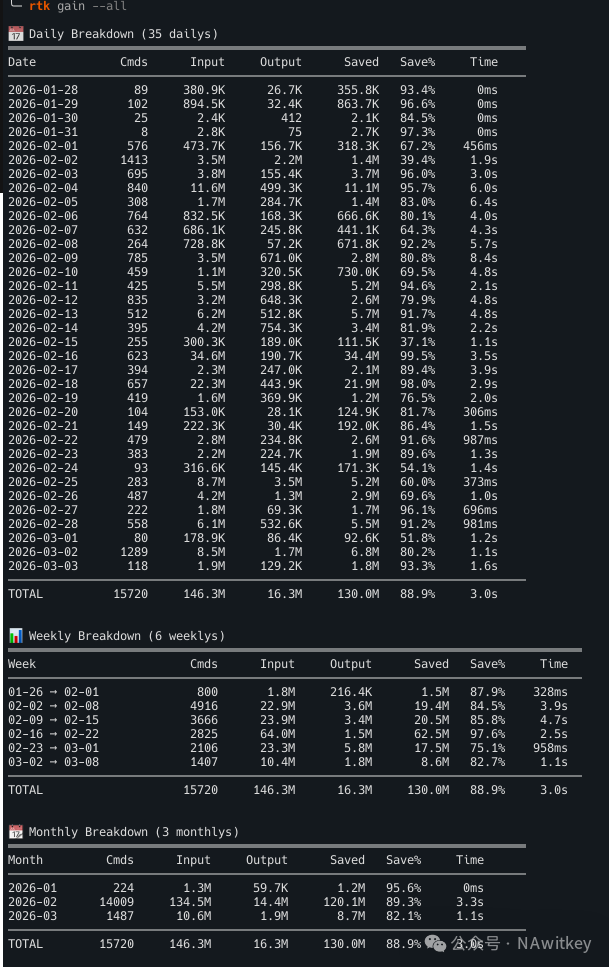

RTK Gain 仪表盘示例

RTK Gain 分项统计示例

六、 快速上手:3 步配置你的 AI 工具

如果你已经安装了 Homebrew,一行命令即可开始:

brew install rtk

随后,根据你使用的 AI 工具进行全局初始化:

-

• Claude Code / Copilot:

rtk init -g -

• Gemini CLI:

rtk init -g --gemini -

• Cursor:

rtk init -g --agent cursor -

• Codex:

rtk init -g --codex

值得注意的是: RTK 对不同工具的“入侵”方式不尽相同。对于 Claude Code 等工具,它通常采用底层的 Shell Hook 拦截;而对于 Codex,它则是通过生成一套全局指令集(如 ~/.codex/RTK.md),通过全局策略引导 Codex 在执行命令时主动选择 RTK 版本。

初始化后,当你让 AI 执行 git status 时,后台会自动改写为 rtk git status。这种无感集成才是其最高明的地方。

七、 点评:别把“摘要”当成“真相”

最后,必须泼一盆冷水:RTK 很强,但不能神化。

它最大的风险不是崩掉,而是“压得太漂亮”。当你在进行深度调试(Deep Debugging)时,某些关键的 Warning 或微小的时序差异可能会被 RTK 当作噪音过滤掉。

我的建议是:

-

• 默认开启: 处理常规任务,享受极速响应和低廉账单。

-

• 疑难杂症: 使用

-v或查看原始日志回退,确保不被“摘要”蒙蔽。

总结

AI 时代的编程优化点,可能不在于模型本身,而在于你“喂给模型什么”。

如果你把大量终端噪音灌进去,再强的模型也得先在垃圾堆里找针。RTK 做的事情并不 fancy,但它对现在AI编程时代而言极其“值钱”。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献10条内容

已为社区贡献10条内容

所有评论(0)