手把手教你Windows里安装OpenClaw小龙虾

这篇文章是一篇详细指导如何在 Windows 系统上安装和配置 AI 开发工具 “OpenClaw” 的教程,作者将其昵称为“小龙虾”。

核心内容总结如下:

-

安装思路:

由于 OpenClaw 原生更适合 Linux 环境,文章推荐在 Windows 中使用 WSL2 来创建一个 Linux 虚拟机,并在其中进行安装,这比直接在 Windows 上安装更稳定、问题更少。

-

主要安装步骤:

-

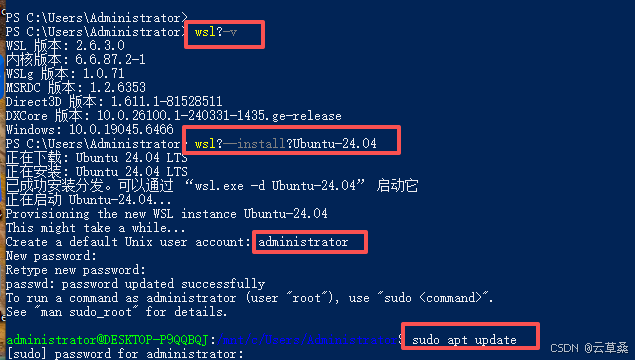

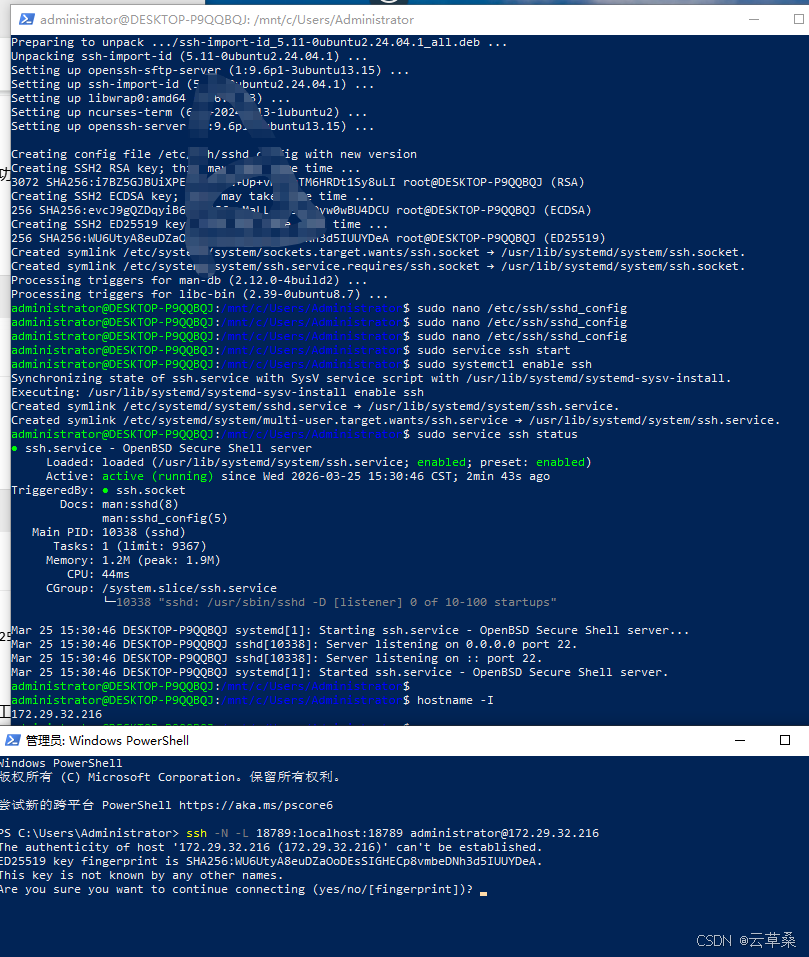

第一步:安装 WSL2。在 Windows PowerShell 中运行

wsl --install命令,安装后需重启电脑。 -

第二步:在 WSL2 中安装 Ubuntu 24.04。运行

wsl --install Ubuntu-24.04命令,安装官方推荐的 Linux 发行版。安装过程中需创建非root用户(如openclaw),并建议在安装后立即执行系统更新。 -

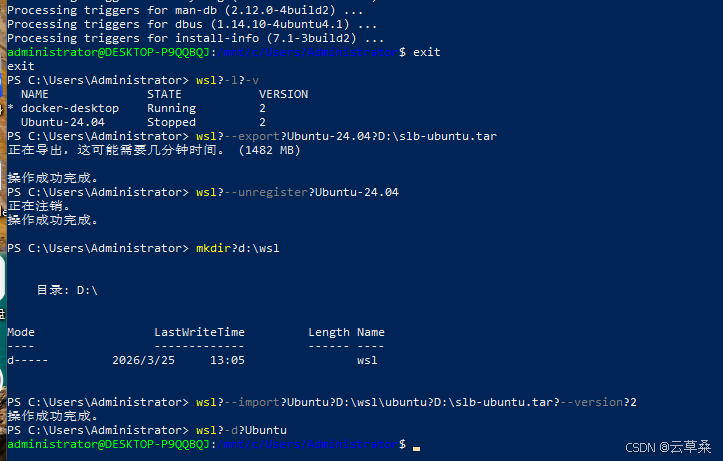

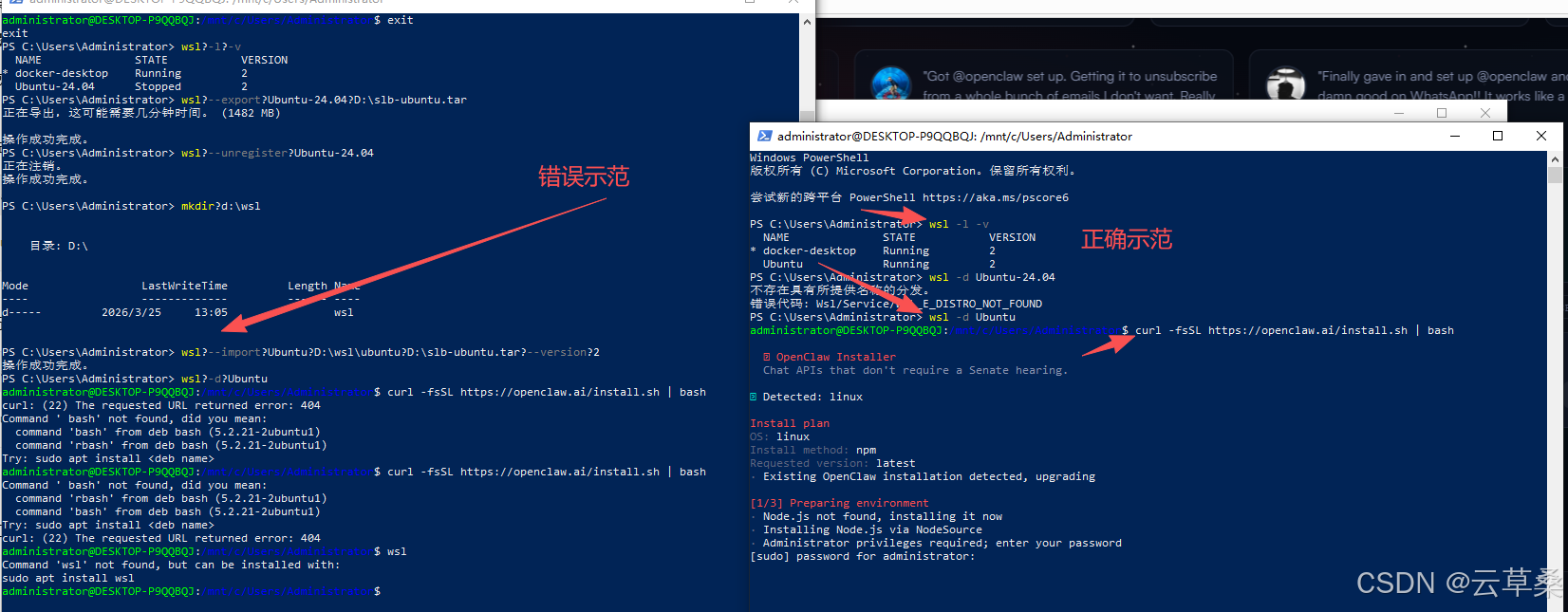

第三步(强烈推荐):将 Ubuntu 系统迁移到非系统盘。为了避免占用 C 盘空间,文章指导用户通过

export和import命令,将默认安装在 C 盘的 Ubuntu 系统完整迁移到其他盘(如 D 盘)。 -

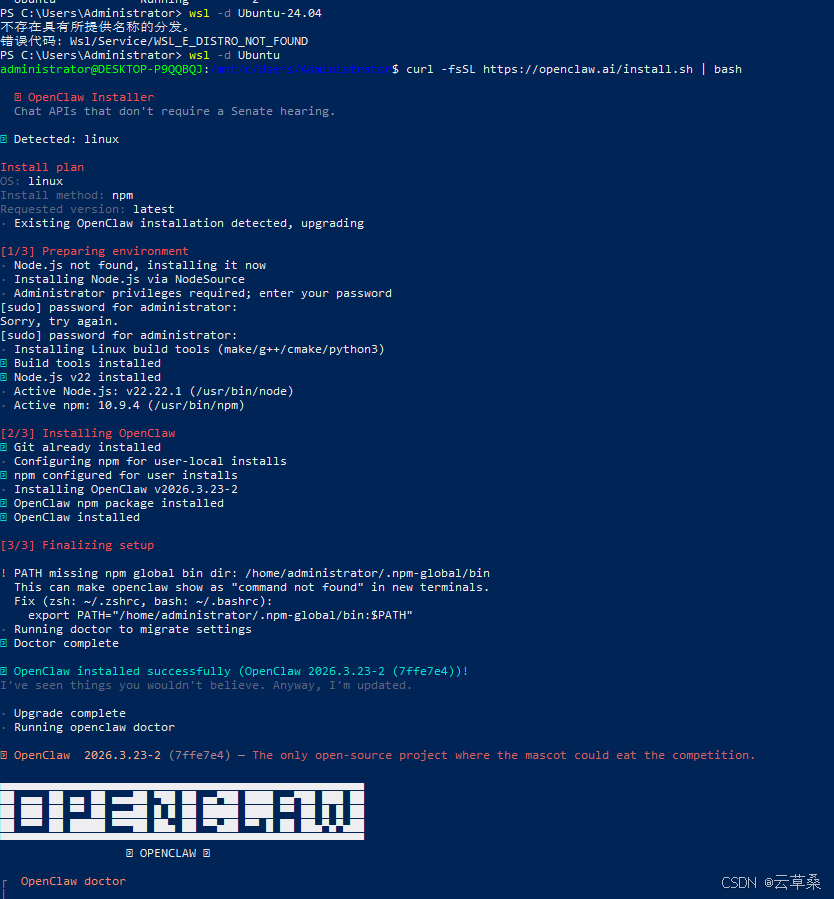

第四步:安装 OpenClaw。在 WSL 的 Ubuntu 终端中,运行官方的一键安装命令:

curl -fsSL https://openclaw.ai/install.sh | bash。文章也提到,如果安装失败,可能需要手动安装特定依赖,例如libvips-dev库。

-

-

后续配置:

-

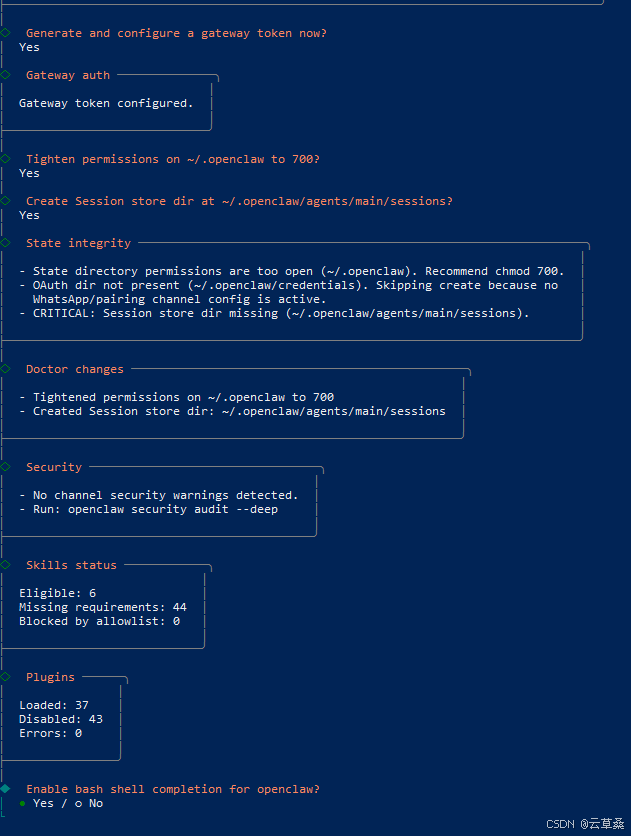

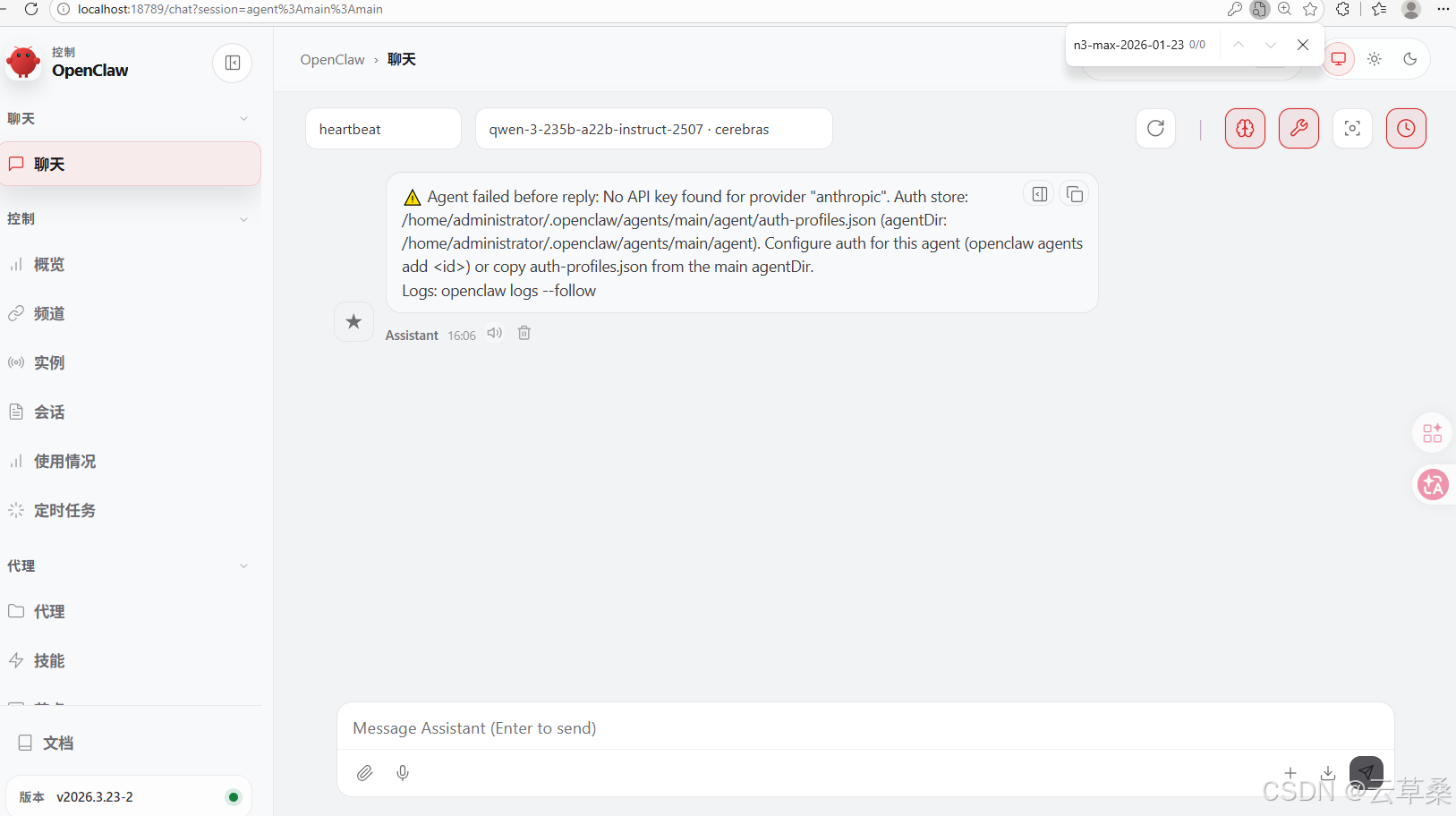

首次配置:安装完成后,程序会引导用户进行一些初始设置,如选择快速开始模式、配置模型提供商等。

-

配置大模型 API:运行

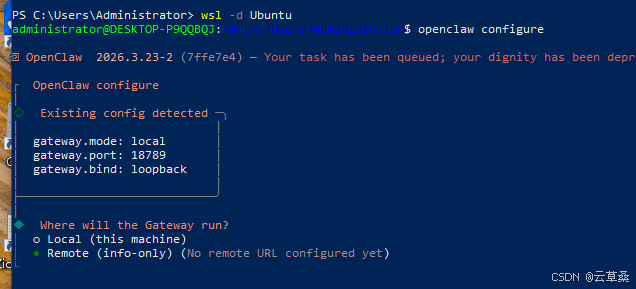

openclaw configure命令来配置大模型服务。作者以自己的经验为例,说明如果使用 Minimax 的服务,需要选择带(CN)后缀的选项,并注意正确的域名拼写。 -

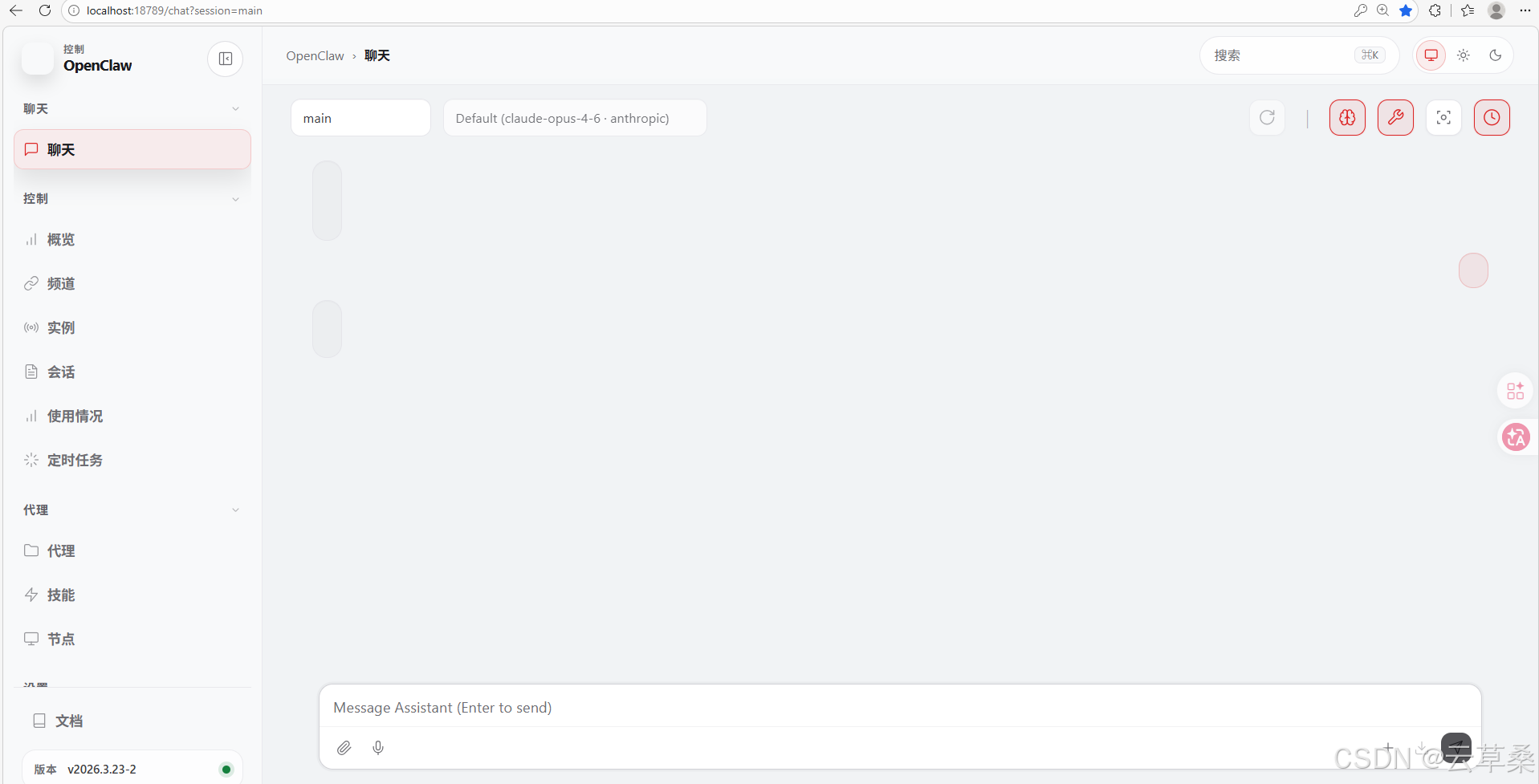

启动图形界面:运行

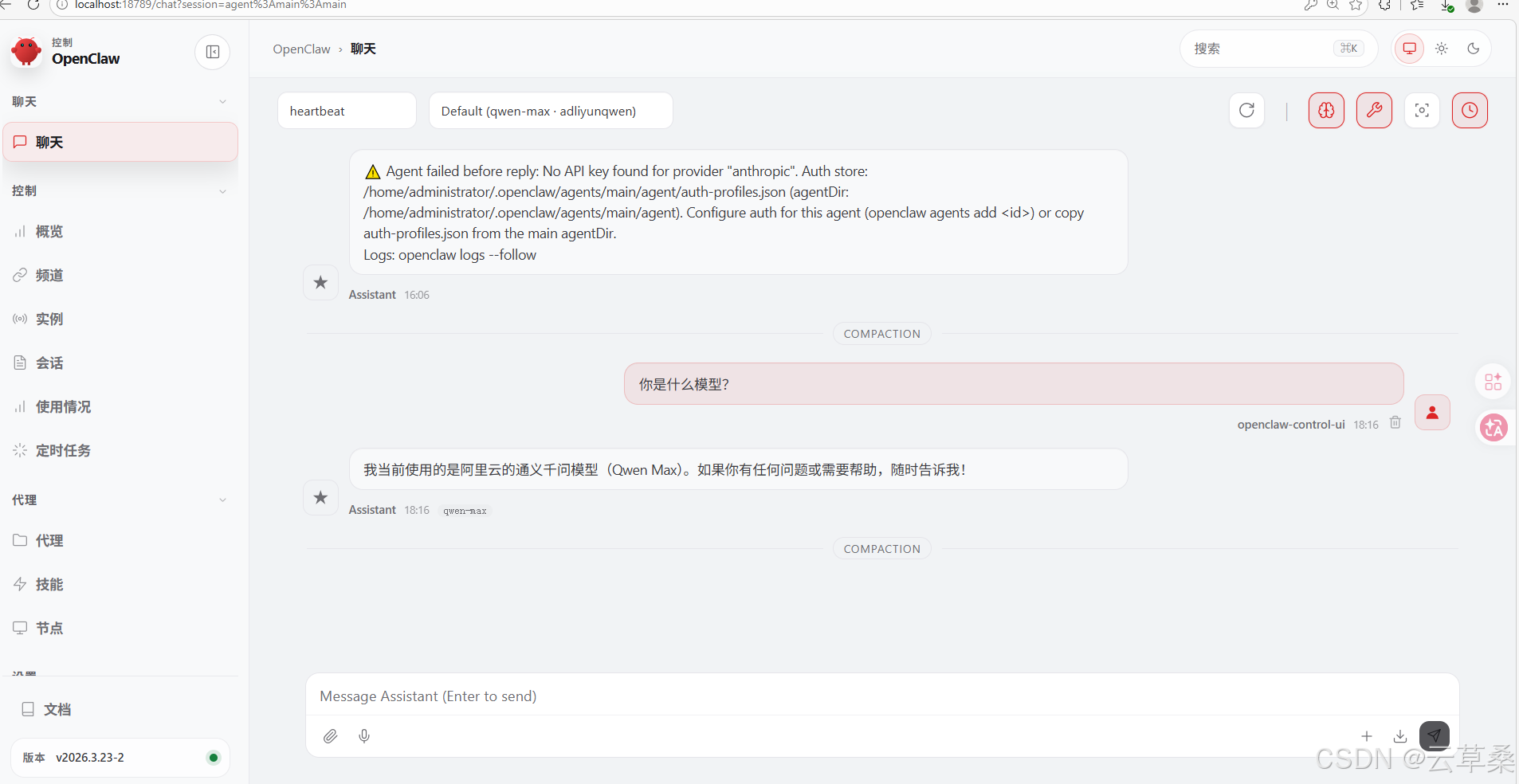

openclaw dashboard命令,会生成一个带本地令牌的链接。按住Ctrl键点击该链接,即可在浏览器中打开 OpenClaw 的图形化操作界面,开始使用。

-

wsl -v

wsl --install Ubuntu-24.04

sudo apt update

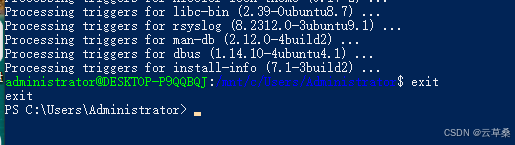

sudo apt upgrade

exit

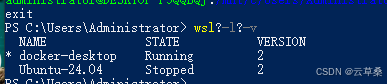

wsl -l -v

///*wsl --shutdown*//

wsl --export Ubuntu-24.04 D:\slb-ubuntu.tar

wsl --unregister Ubuntu-24.04

mkdir d:\wsl

wsl --import Ubuntu D:\wsl\ubuntu D:\slb-ubuntu.tar --version 2

wsl -d Ubuntu

# 或直接

wsl

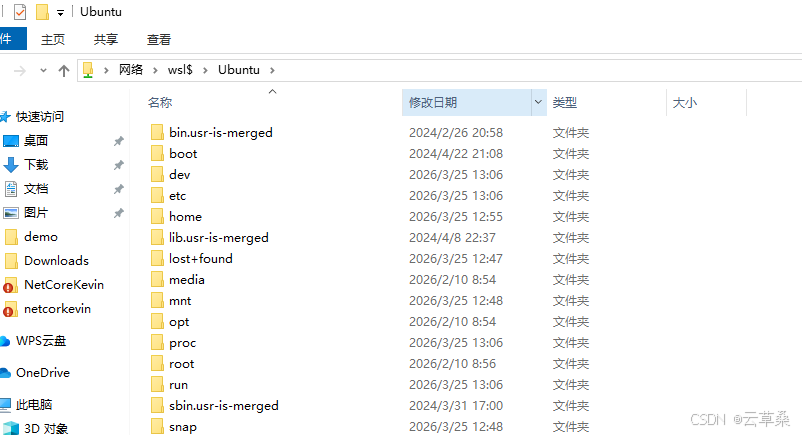

3.7 Windows里访问Linux的文件

在 Windows 资源管理器中输入以下地址可以直接访问 WSL 内的文件,非常方便:

\\wsl$\Ubuntu

官方推荐的安装步骤,在 WSL 的 Ubuntu 终端中运行:

curl -fsSL https://openclaw.ai/install.sh | bash

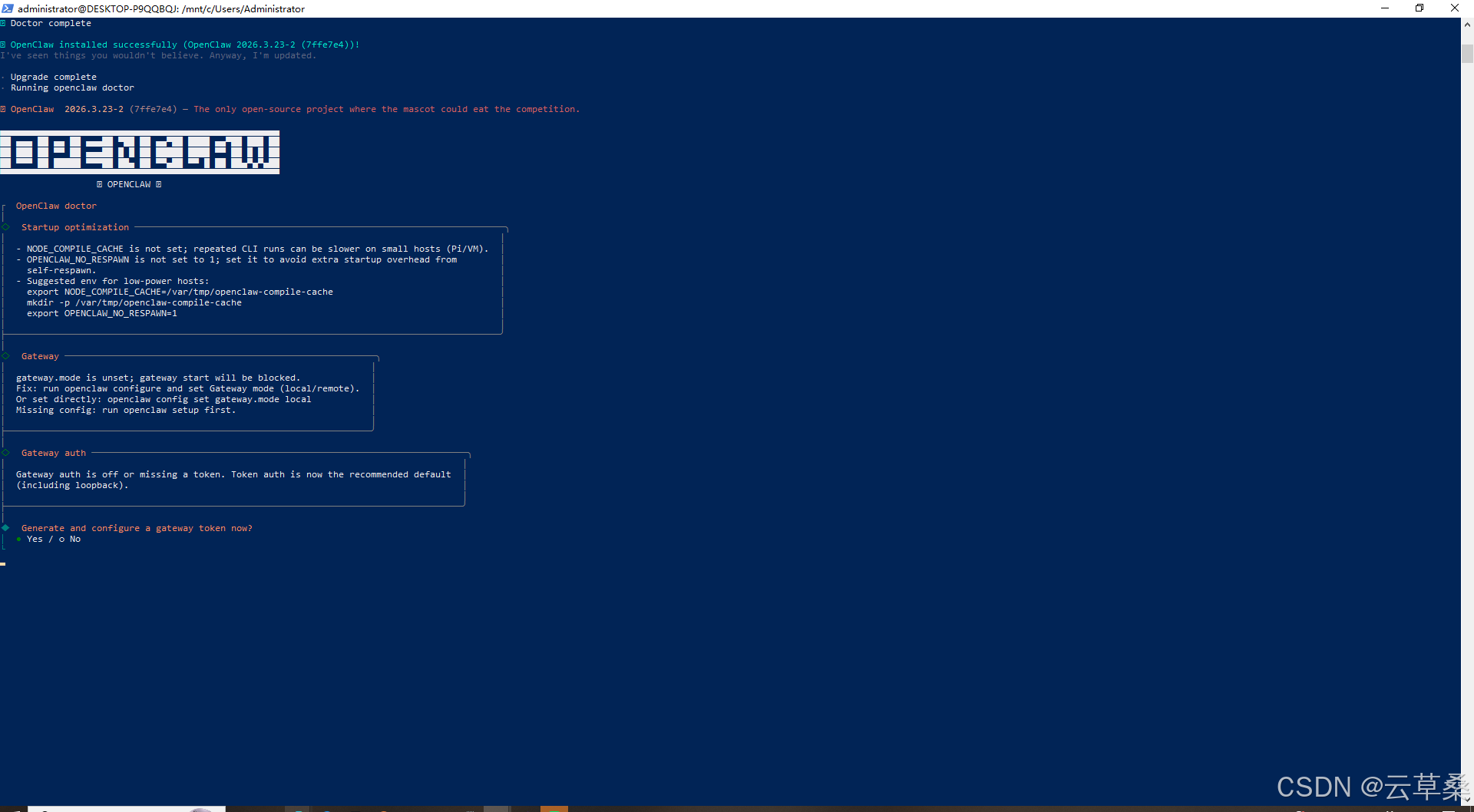

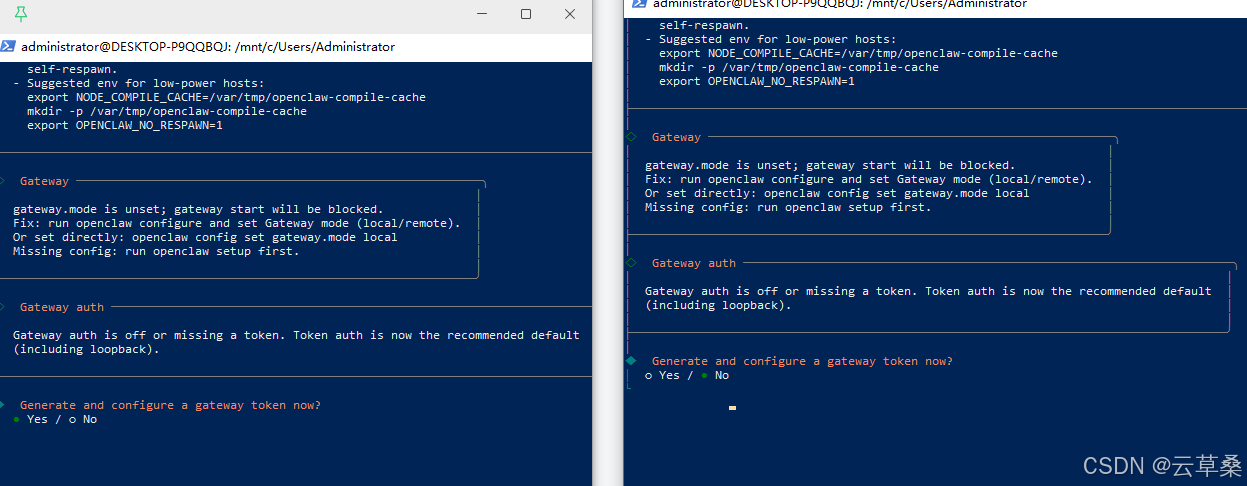

到底哪个是Yes

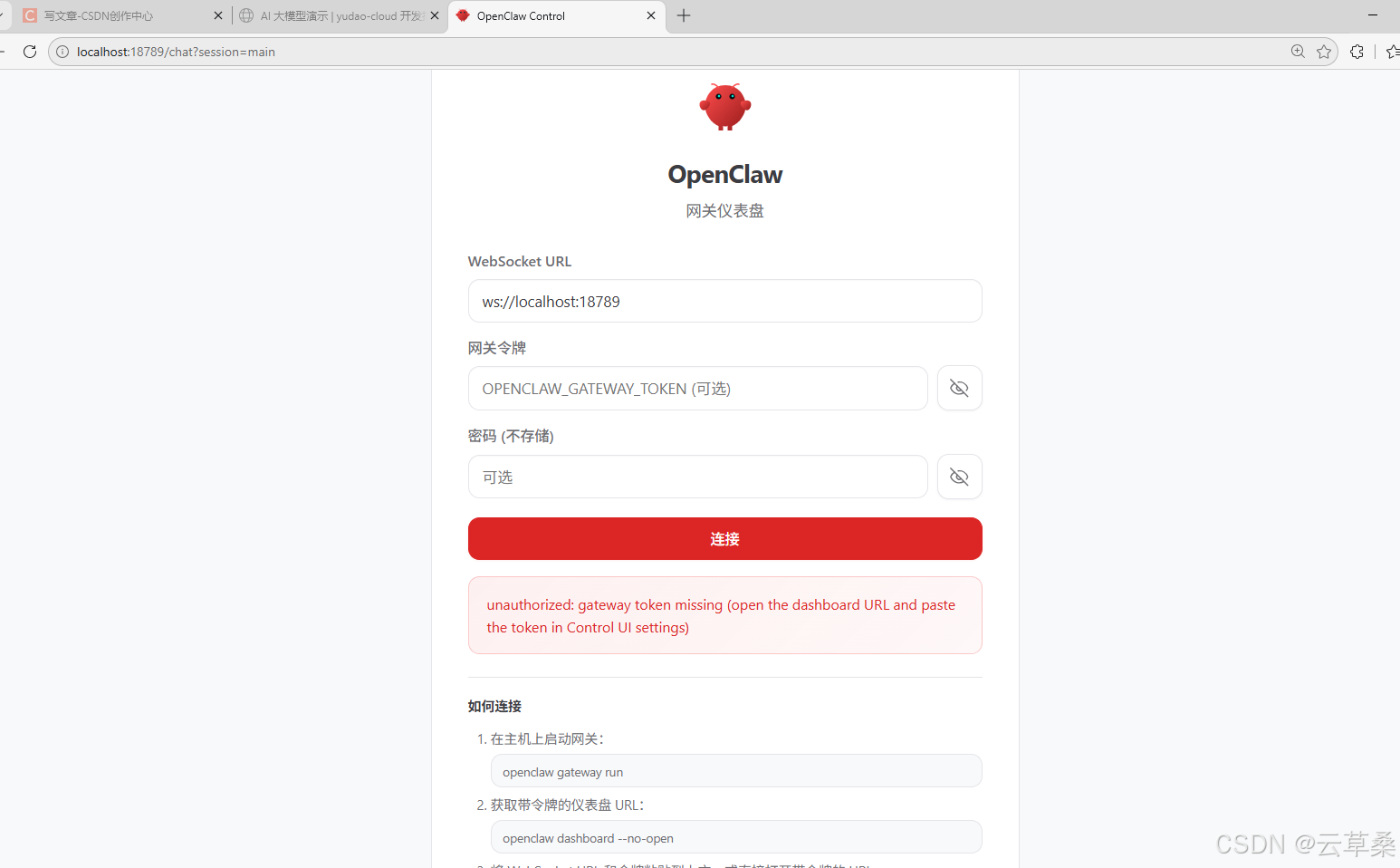

网关认证配置

诊断:网关认证已关闭或缺少令牌(Token)。令牌认证是目前推荐的默认安全方式(包括本地回环通信)。

解决方案:

程序在最后给出了一个交互式选项:Generate and configure a gateway token now?

-

为了启用安全的认证,您应该选择

Yes。 -

选择后,OpenClaw 会自动为您生成并配置一个访问令牌。

网关

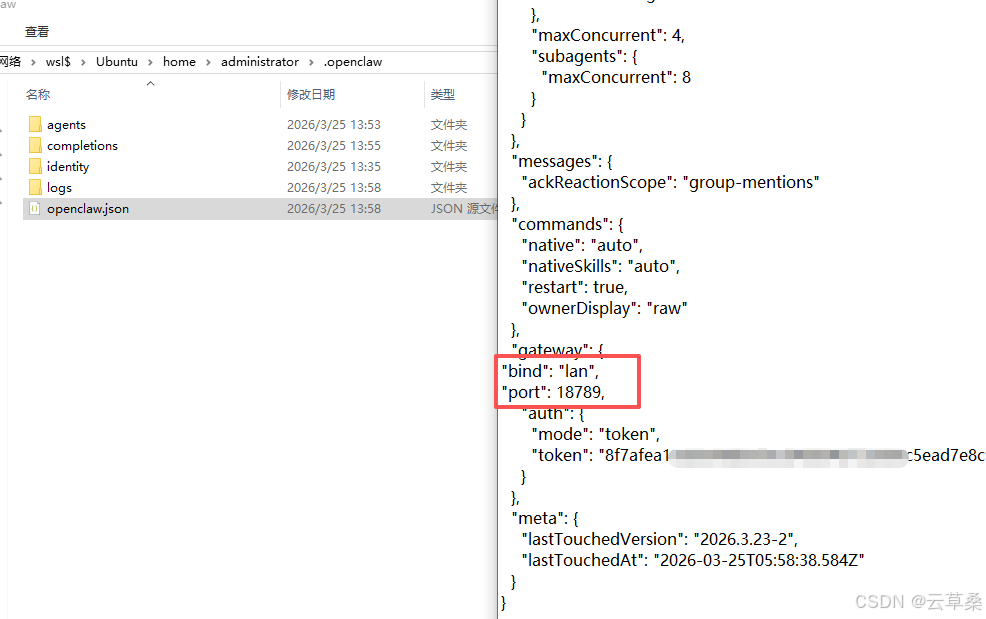

\\wsl$\Ubuntu\home\administrator\.openclaw

"gateway": {

"mode":"local",

"bind": "loopback",

"port": 18789,

"auth": {

"mode": "token",

"token": " "

}

},

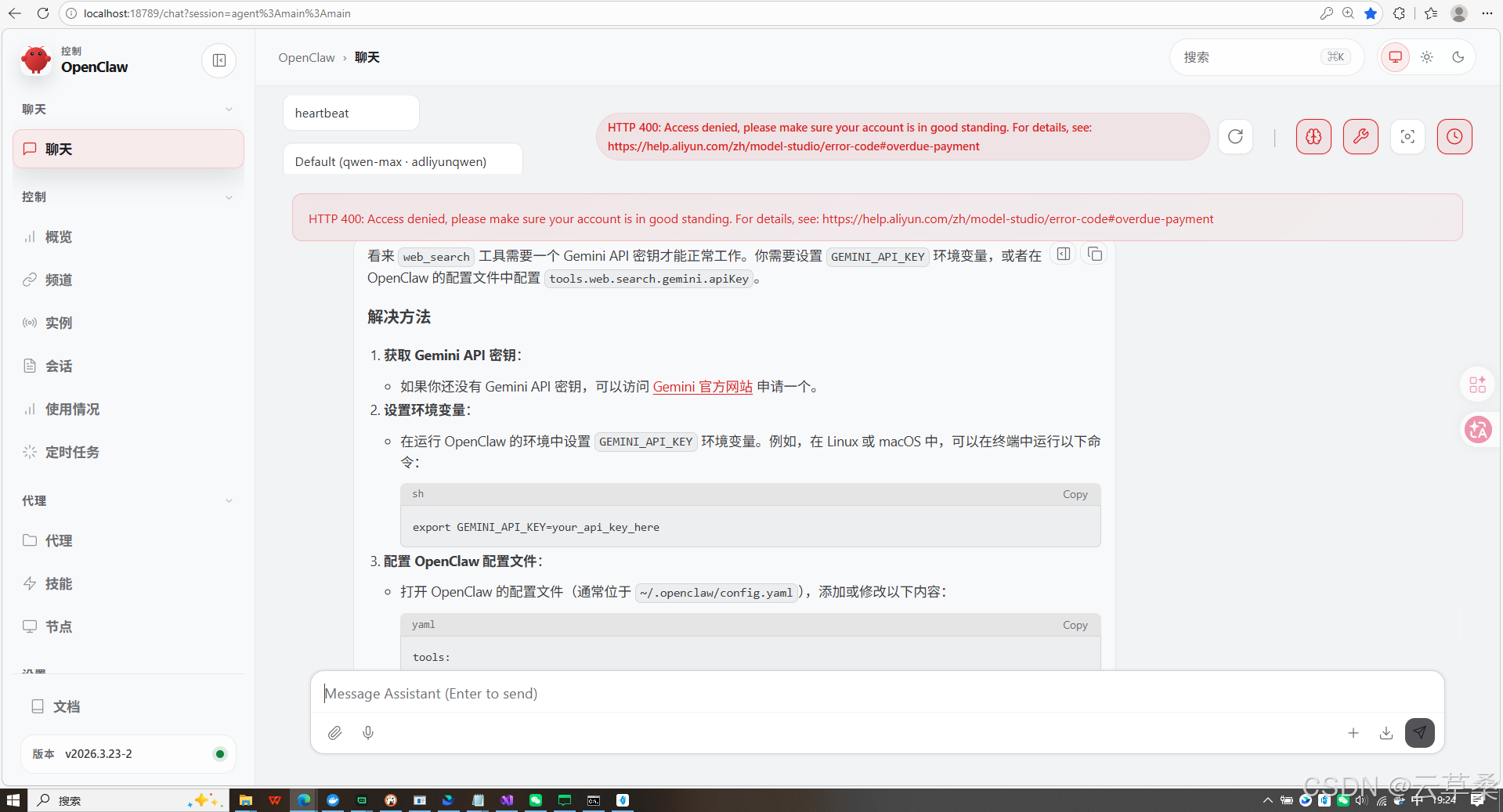

配置模型

sudo ss -tulpn | grep :18789

[sudo] password for administrator:

tcp LISTEN 0 511 127.0.0.1:18789 0.0.0.0:* users:(("openclaw-gatewa",pid=12637,fd=22))

tcp LISTEN 0 511 [::1]:18789 [::]:* users:(("openclaw-gatewa",pid=12637,fd=23))

API Base URL: https://dashscope.aliyuncs.com/compatible-mode/v1

API Key: sk-3

Endpoint ID: [留空] 或 dashscope

【腾讯文档】总结这篇文章

https://docs.qq.com/aio/DZmVzeGx3WEp2U2RO

https://docs.qq.com/aio/DZmVzeGx3WEp2U2RO

我明白问题了!你选择的 LiteLLM 配置界面显示的是默认模型,而不是阿里云百炼的模型。因为 LiteLLM 默认不知道你这个 key 是阿里云百炼的。

解决方案

方案1:使用 Custom Provider(推荐,最简单)

退回到上一级,选择 Custom Provider,然后这样配置:

model: "qwen-max"

apiBase: "https://dashscope.aliyuncs.com/compatible-mode/v1"

apiKey: "sk- "

具体操作:

按 ESC 或选择返回

选择 Custom Provider

Model: qwen-max(或你想用的模型)

API Base: https://dashscope.aliyuncs.com/compatible-mode/v1

API Key: sk-

方案2:继续用 LiteLLM,但需要配置模型映射

如果你坚持用 LiteLLM,需要手动配置模型映射。配置文件需要这样写:

agents:

defaults:

model: "litellm/qwen-max" # 注意这里是 litellm/ 前缀

provider: "litellm"

providers:

litellm:

env:

DASHSCOPE_API_KEY: "sk- "

model_list:

- model_name: "qwen-max"

litellm_params:

model: "openai/qwen-max"

api_base: "https://dashscope.aliyuncs.com/compatible-mode/v1"

api_key: "os.environ/DASHSCOPE_API_KEY"

我的建议

选择方案1(Custom Provider),原因:

配置更简单,3个参数搞定

不需要理解 LiteLLM 的复杂配置

直接使用阿里云百炼的 OpenAI 兼容接口

可用模型名称:

qwen-max(最强)

qwen-plus(平衡)

qwen-turbo(最快)

qwen-vl-plus(多模态)

qwen-coder-plus(代码)

你想用哪个方案?我可以给你更详细的操作步骤。

Select sections to configure Model

Model/auth provider Custom Provider

API Base URLhttp://127.0.0.1:11434

How do you want to provide this API key?Paste API key now

API Key (leave blank if not required) 这是在用本地大模型?

回复 曹飞书:

Select sections to configure Model

Model/auth provider Custom Provider

API Base URLhttp://127.0.0.1:11434

How do you want to provide this API key?Paste API key now

API Key (leave blank if not required) 这是在用本地大模型?

对!你看到的 http://127.0.0.1:11434 是 Ollama(本地大模型)的默认地址。

你需要改的配置

把默认值改成阿里云百炼的:

第一步:修改 API Base URL

http://127.0.0.1:11434

改成:

https://dashscope.aliyuncs.com/compatible-mode/v1

第二步:输入 API Key

sk-

第三步:设置模型名称

Model 填:

qwen-max

或者你想要的其他模型:

qwen-plus(平衡)

qwen-turbo(最快)

qwen-vl-plus(多模态)

完整配置示例

API Base URL: https://dashscope.aliyuncs.com/compatible-mode/v1

API Key: sk-

Model: qwen-max

为什么默认是 127.0.0.1:11434?

11434 是 Ollama 的默认端口

Ollama 是一个流行的本地大模型运行工具

如果你本机装了 Ollama,就可以用本地模型运行 OpenClaw

但你现在要用阿里云的云端模型,所以需要改成阿里云的地址

配置完成后,OpenClaw 就会调用阿里云百炼的 API,而不是本地模型了。继续填写就对了!

Select sections to configureModel

Model/auth providerCustom Provider

API Base URLhttp://127.0.0.1:11434

How do you want to provide this API key?Paste API key now

API Key (leave blank if not required)sk-

Endpoint compatibilityOpenAI-compatible (Uses /chat/completions)Anthropic-compatible

Unknown (detect automatically) 这一步选什么?

回复 曹飞书:

Select sections to configureModel

Model/auth providerCustom Provider

API Base URLhttp://127.0.0.1:11434

How do you want to provide this API key?Paste API key now

API Key (leave blank if not required)sk-

Endpoint compatibilityOpenAI-compatible (Uses /chat/completions)Anthropic-compatible

Unknown (detect automatically) 这一步选什么?

选择 OpenAI-compatible (Uses /chat/completions)

为什么选这个?

阿里云百炼的 compatible-mode/v1 完全兼容 OpenAI API:

✅ 使用 /chat/completions 端点

✅ 请求格式和 OpenAI 一致

✅ 响应格式和 OpenAI 一致

✅ 支持所有 OpenAI 的参数(temperature, max_tokens 等)

如果选择 Unknown 会怎样?

也可以选择 Unknown (detect automatically),系统会自动检测。但既然你知道它是 OpenAI 兼容的,直接选择更明确。

总结

选择:OpenAI-compatible

配置就完成了!然后就可以开始使用阿里云百炼的模型了。

What would you like to change?Change base URL

API Base URLhttps://dashscope.aliyuncs.com/compatible-mode/v1

How do you want to provide this API key?Paste API key now

API Key (leave blank if not required)sk-

Verification successful.

Endpoint ID 这个填什么?

回复 曹飞书:

What would you like to change?Change base URL

API Base URLhttps://dashscope.aliyuncs.com/compatible-mode/v1

How do you want to provide this API key?Paste API key now

API Key (leave blank if not required)sk-

Verification successful.

Endpoint ID 这个填什么?

可以留空不填 或者填 dashscope

说明

对于阿里云百炼的 OpenAI 兼容模式,Endpoint ID 是可选的,不是必需的。

选项1:留空(推荐)

直接按 Enter 或跳过,不填任何内容。

选项2:填个标识名

如果想填,可以填:

dashscope (百炼的英文名)

aliyun (阿里云)

qwen (通义千问)

最终配置总结

API Base URL: https://dashscope.aliyuncs.com/compatible-mode/v1

API Key: sk-

Endpoint ID: [留空] 或 dashscope

验证成功 说明你的 API Key 是有效的,继续下一步配置模型名称就好了!

怎么检查 和使用?

回复 曹飞书:

怎么检查 和使用?

配置完成后,可以这样检查和使用:

1. 检查配置状态

方法1:查看配置文件

# 查看当前配置

openclaw config get

或者直接查看配置文件:

cat ~/.openclaw/config.yaml

方法2:测试模型调用

直接在飞书里给我发个测试消息:

测试一下,你现在用的什么模型?

我会回复显示当前使用的模型信息。

2. 使用配置好的模型

在对话中指定模型

如果你想切换到不同的模型,可以这样:

请用 qwen-turbo 快速回答:什么是人工智能?

或者明确指定:

使用模型 qwen-plus 回答这个问题:...

查看支持的模型

你可以问:

列出可用的模型列表

3. 重启服务(如果需要)

如果配置后没有立即生效,重启 OpenClaw:

sh /workspace/projects/scripts/restart.sh

4. 测试完整流程

给我发几个测试问题:

简单问答:你好,现在几点了?

复杂任务:帮我写一个 Python 脚本来计算斐波那契数列

验证模型:你现在用的是什么模型?

5. 查看日志(排查问题)

如果有问题,查看日志:

# 查看最近的日志

tail -100 ~/.openclaw/logs/gateway.log

6. 切换模型

如果你想更换默认模型,可以:

重新运行配置流程

或直接修改配置文件:

agents:

defaults:

model: "qwen-turbo" # 改成其他模型

现在你可以:

发个消息测试一下

告诉我 你现在用的是什么模型?,我会告诉你当前的配置信息

要测试吗?

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)