智能体论文:Agentic AI for Intent-driven Optimization in Cell-free O-RAN翻译

AI翻译的

摘要

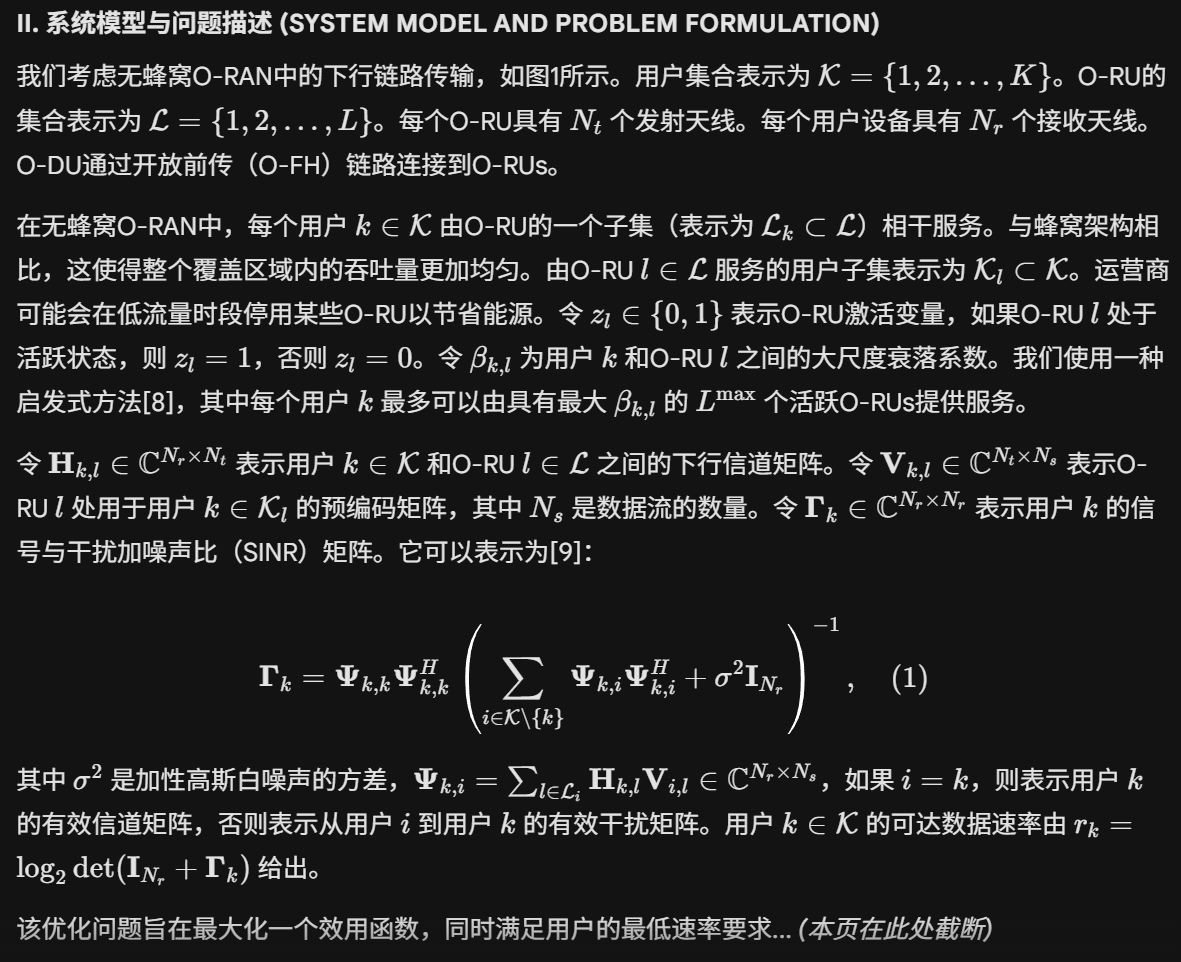

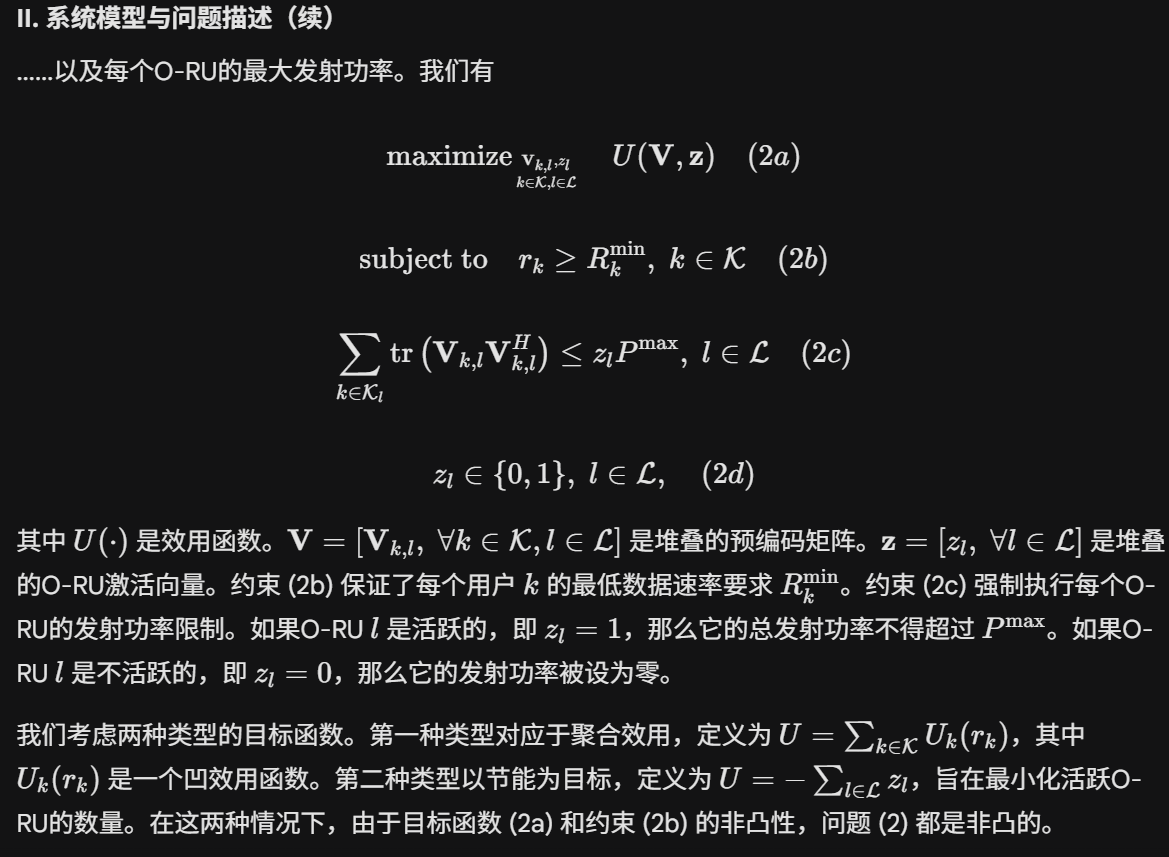

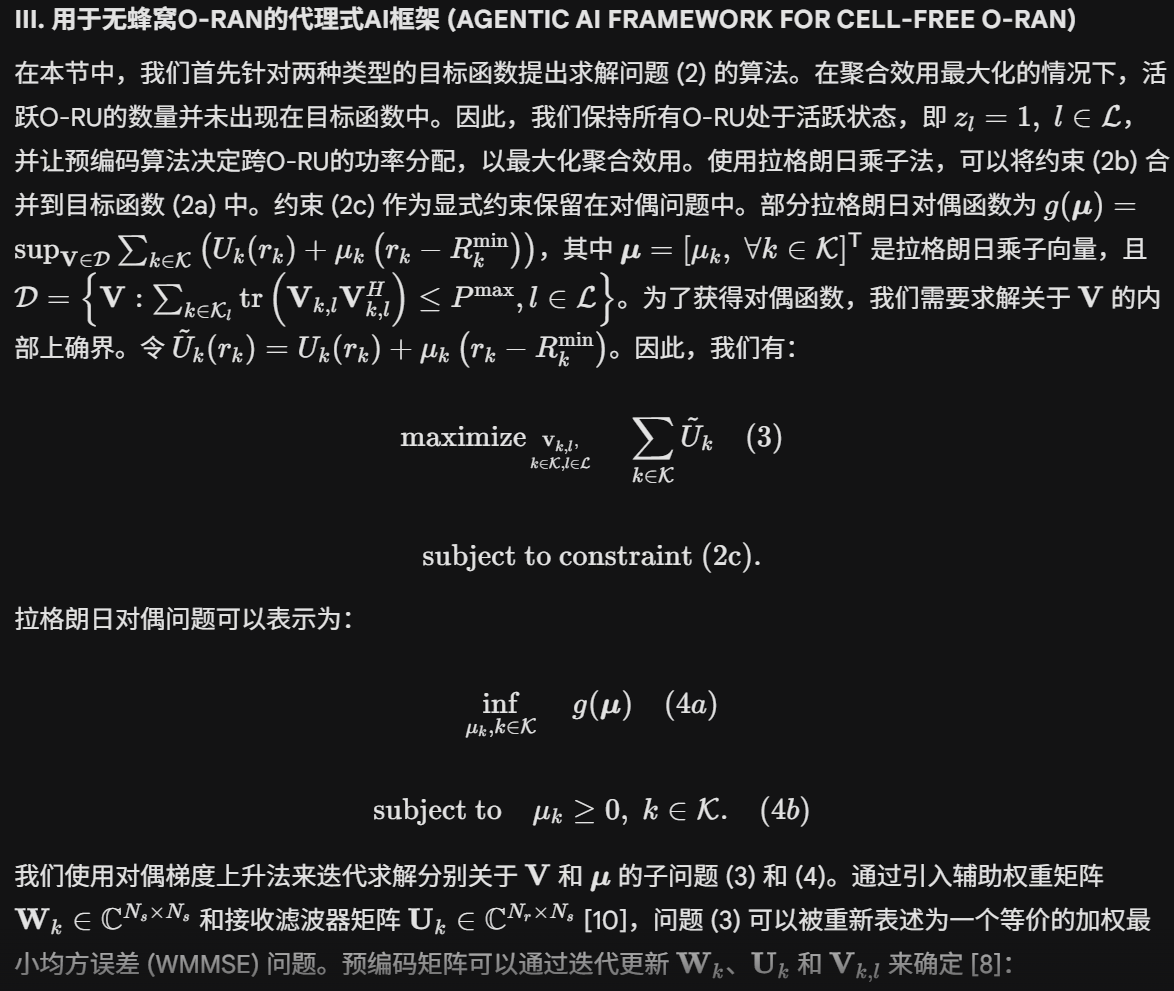

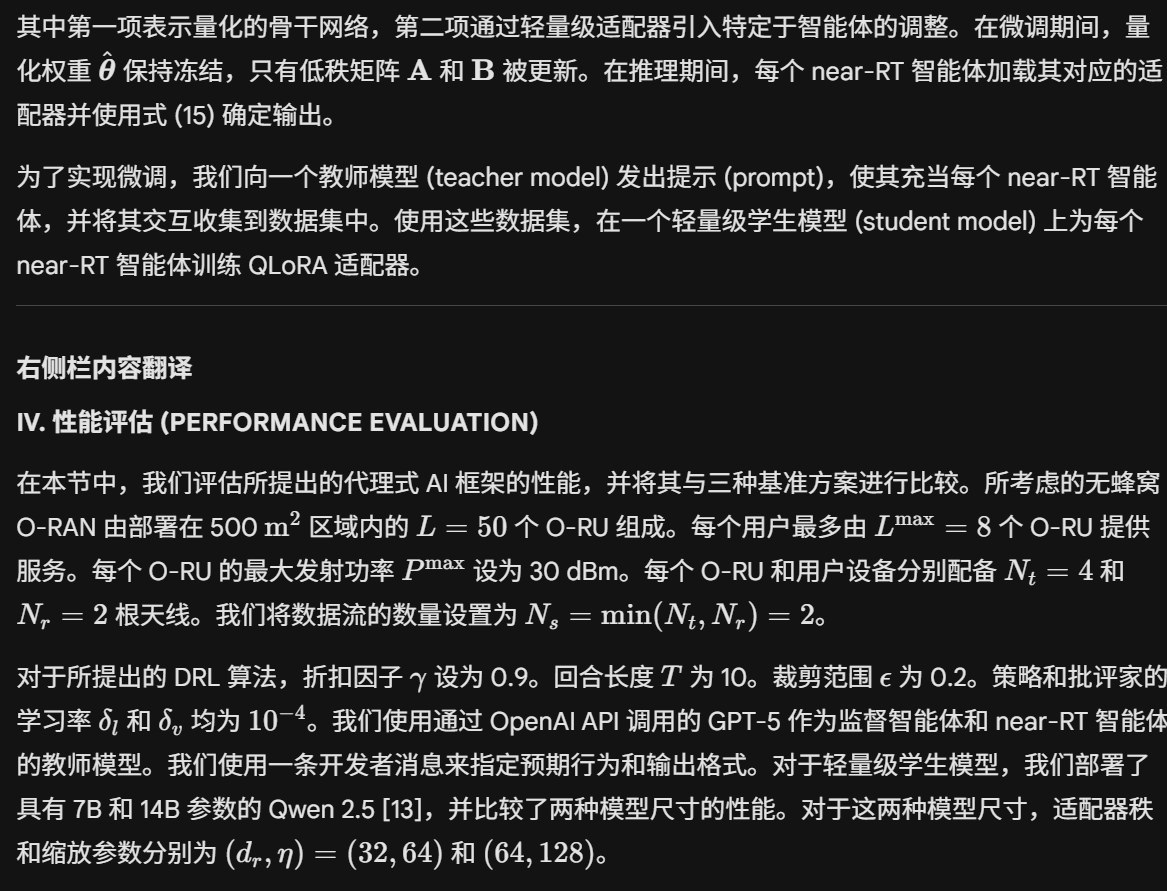

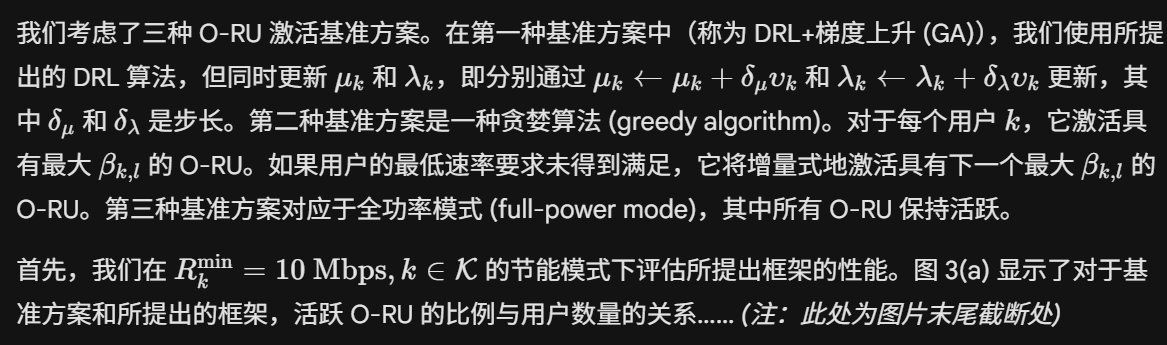

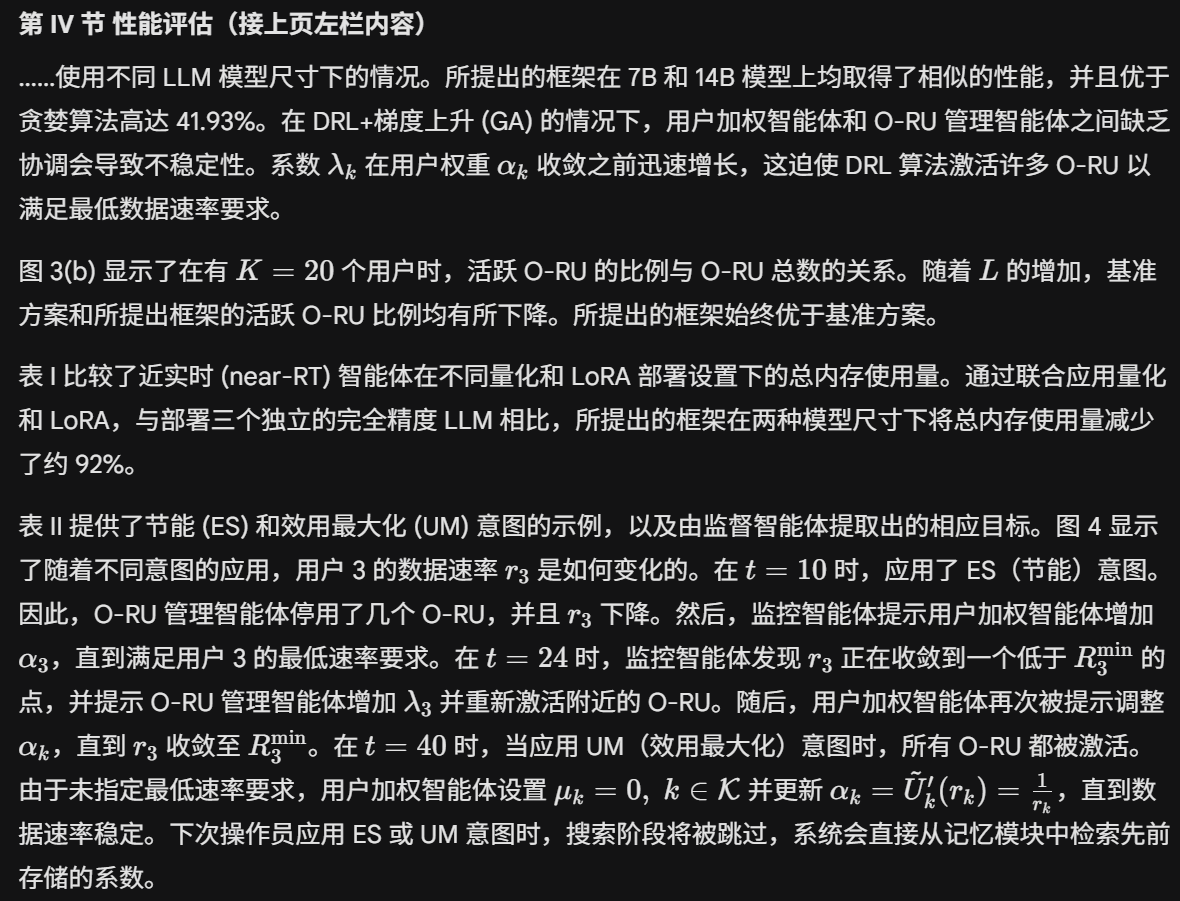

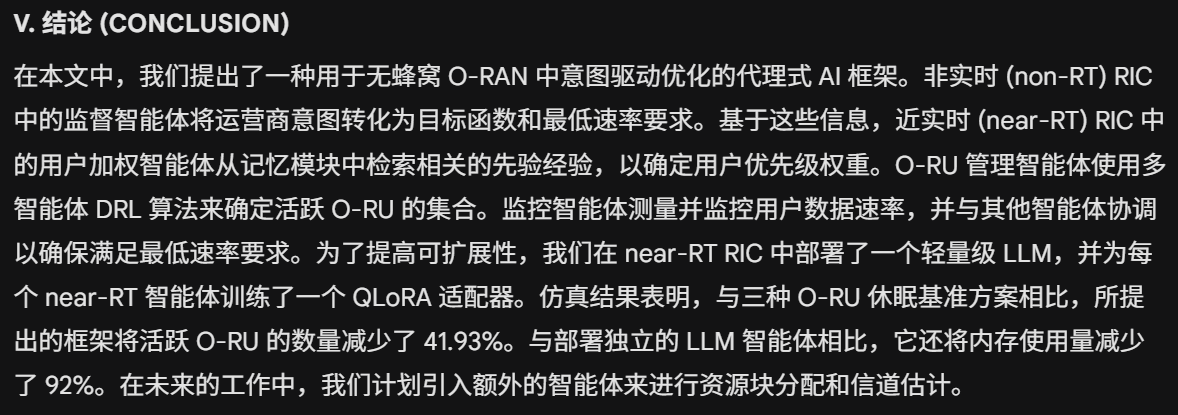

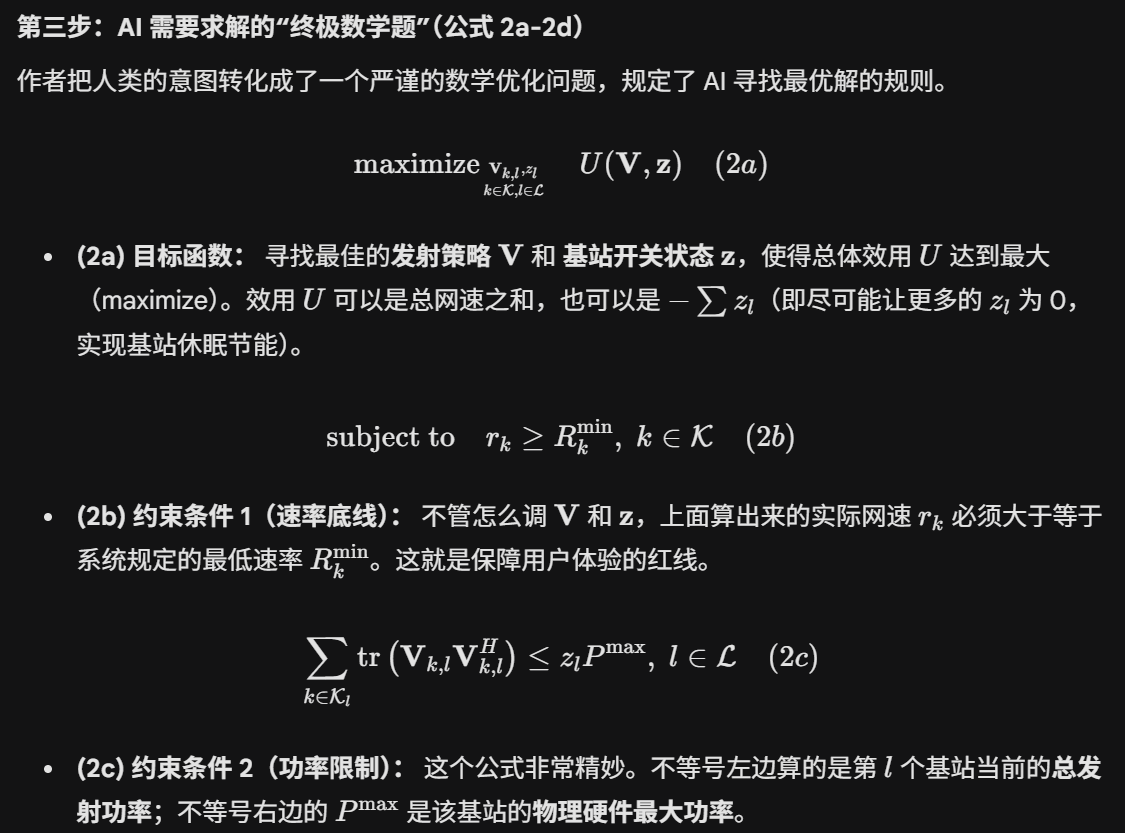

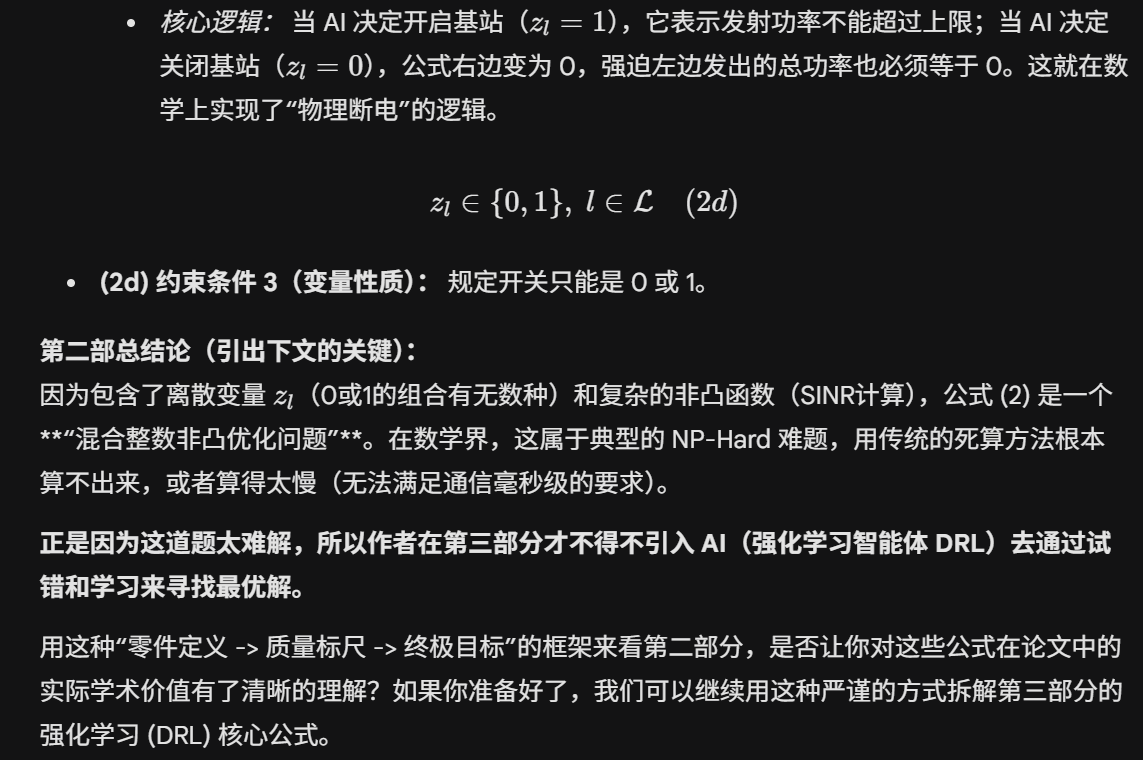

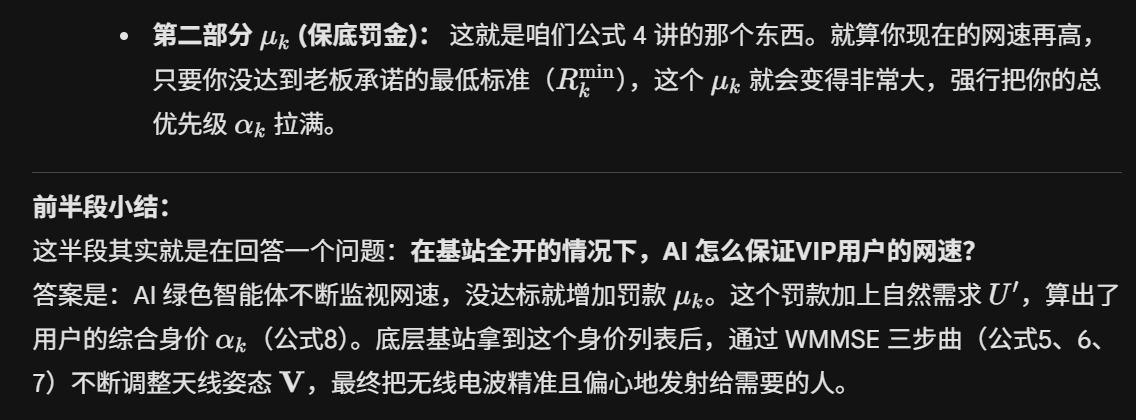

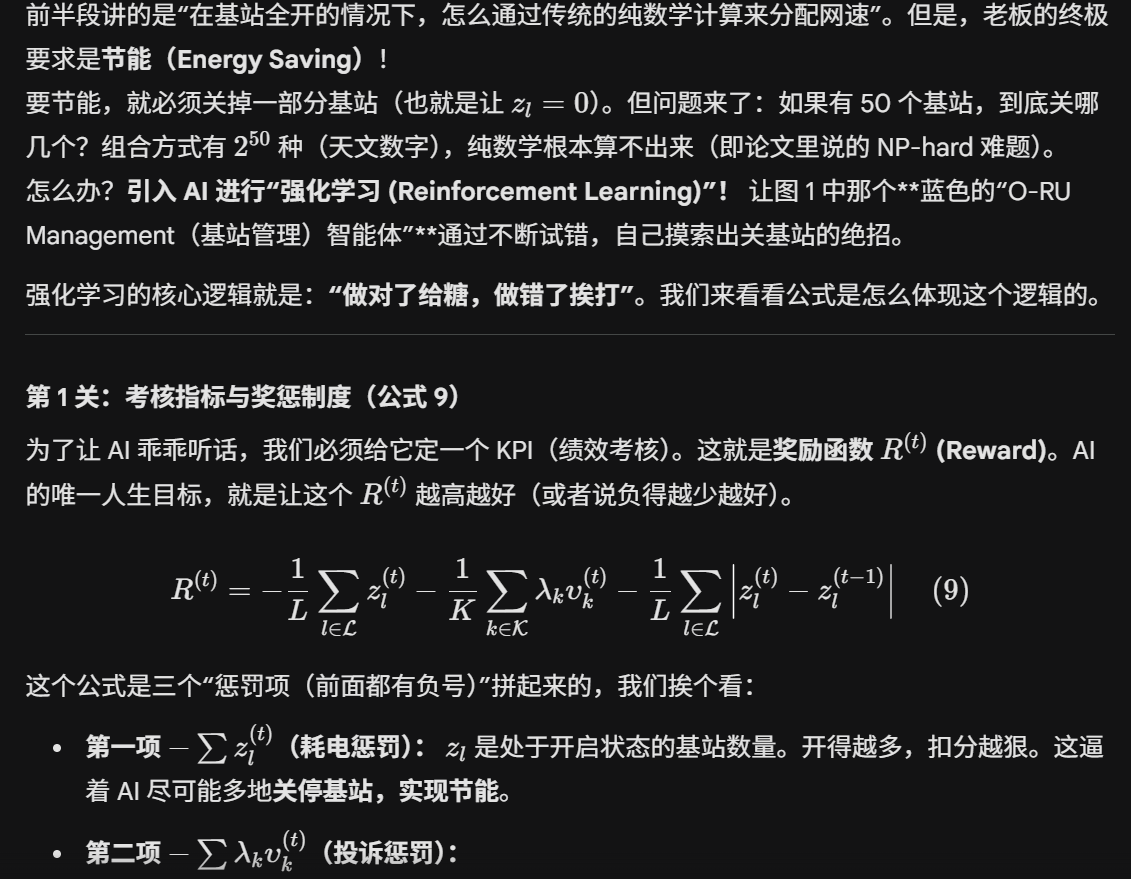

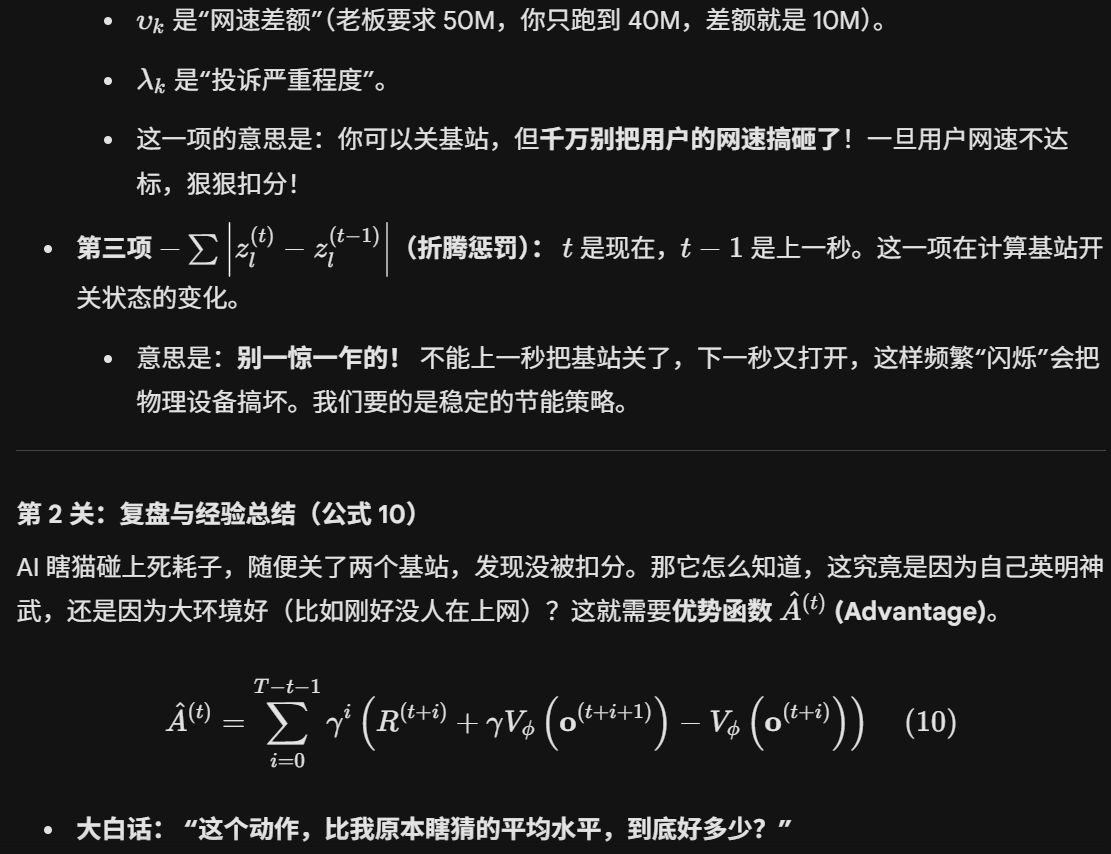

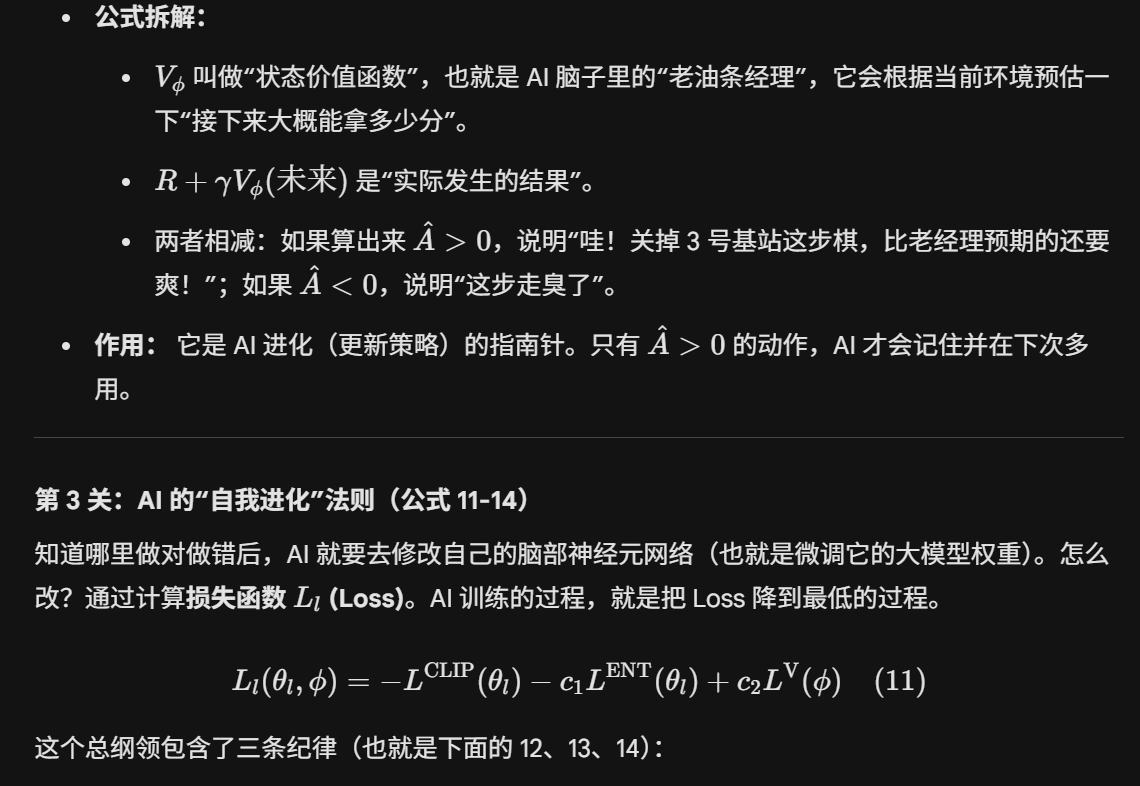

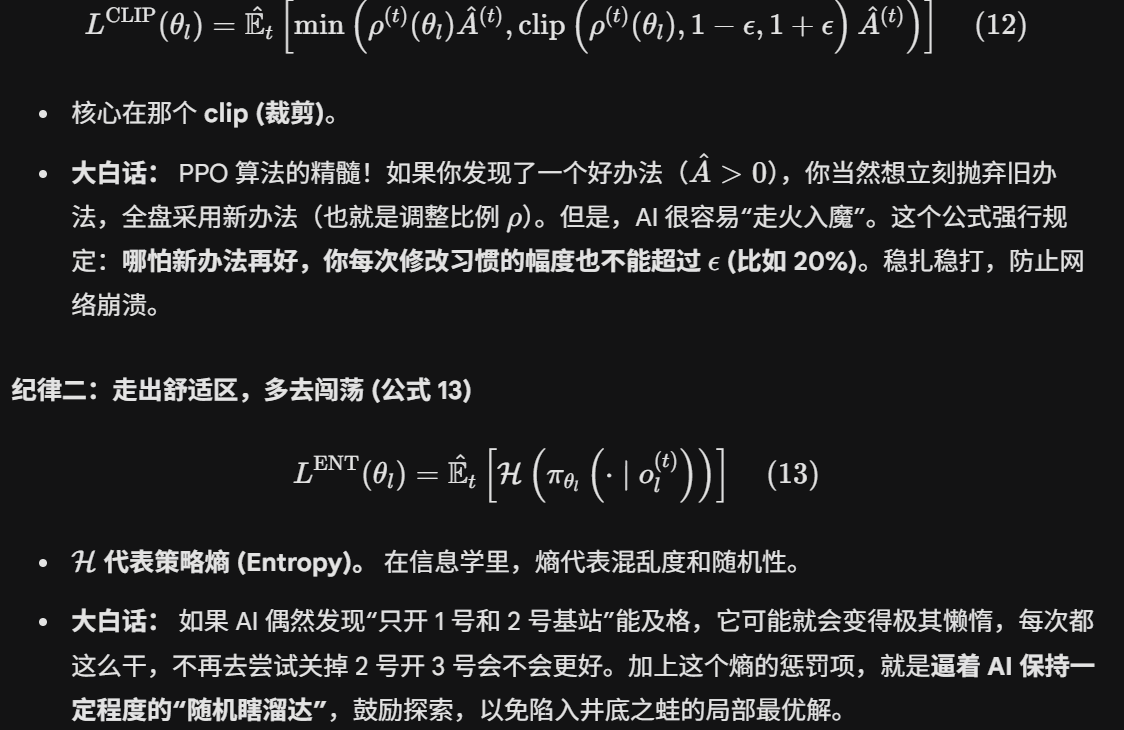

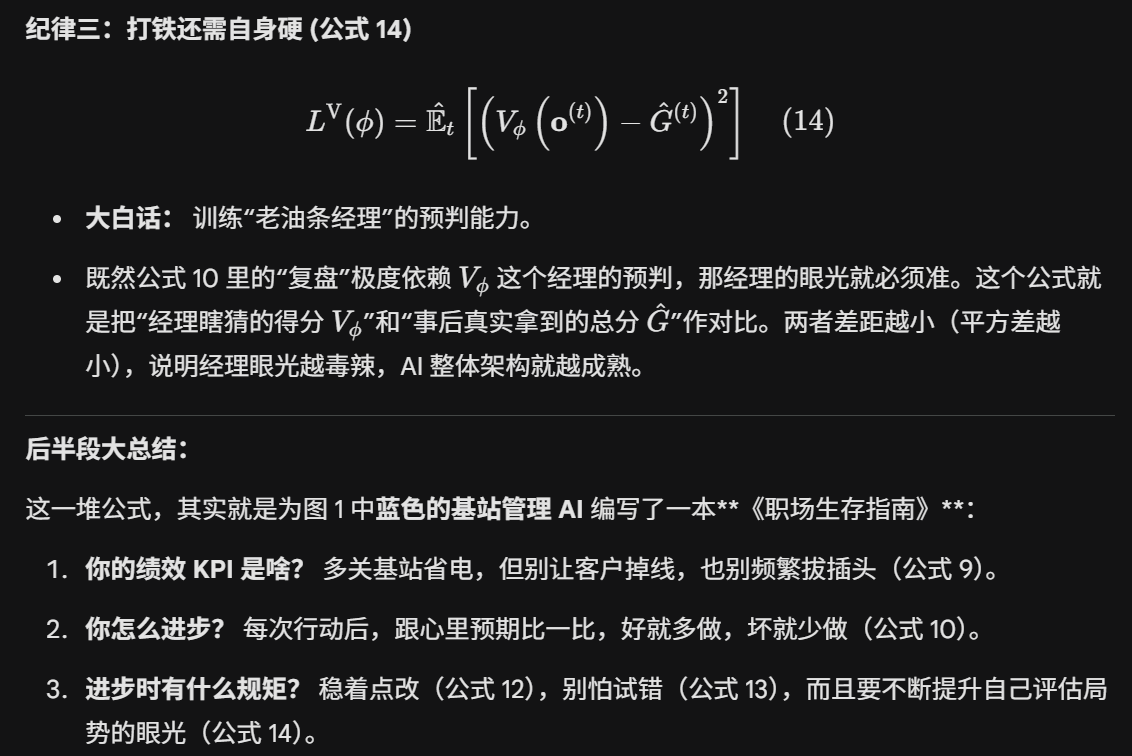

代理式人工智能(AI)正在成为自治无线接入网(RAN)的关键赋能技术,其中多个基于大语言模型(LLM)的智能体进行推理和协作,以实现运营商定义的意图。开放式无线接入网(O-RAN)架构使得此类智能体的部署和协调成为可能。然而,现有的大多数研究考虑的是由独立智能体处理的简单意图,而需要智能体之间协调的复杂意图仍未得到探索。在本文中,我们提出了一个代理式AI框架,用于无蜂窝O-RAN中的意图转译与优化。一个监督智能体将运营商的意图转化为优化目标和最低速率要求。基于这些信息,一个用户加权智能体从记忆模块中检索相关的先验经验,以确定用于预编码的用户优先级权重。如果意图包含节能目标,那么一个开放无线单元(O-RU)管理智能体也将被激活,通过使用深度强化学习(DRL)算法来确定活跃O-RU的集合。一个监控智能体测量并监控用户数据速率,并与其他智能体协调以保证满足最低速率要求。为了提高可扩展性,我们采用了一种参数高效微调(PEFT)方法,使得相同的底层LLM能够用于不同的智能体。仿真结果表明,在节能模式下,与三种基准方案相比,所提出的代理式AI框架将活跃O-RU的数量减少了41.93%。与部署单独的LLM智能体相比,使用PEFT方法,所提出的框架将内存使用量减少了92%。

引言

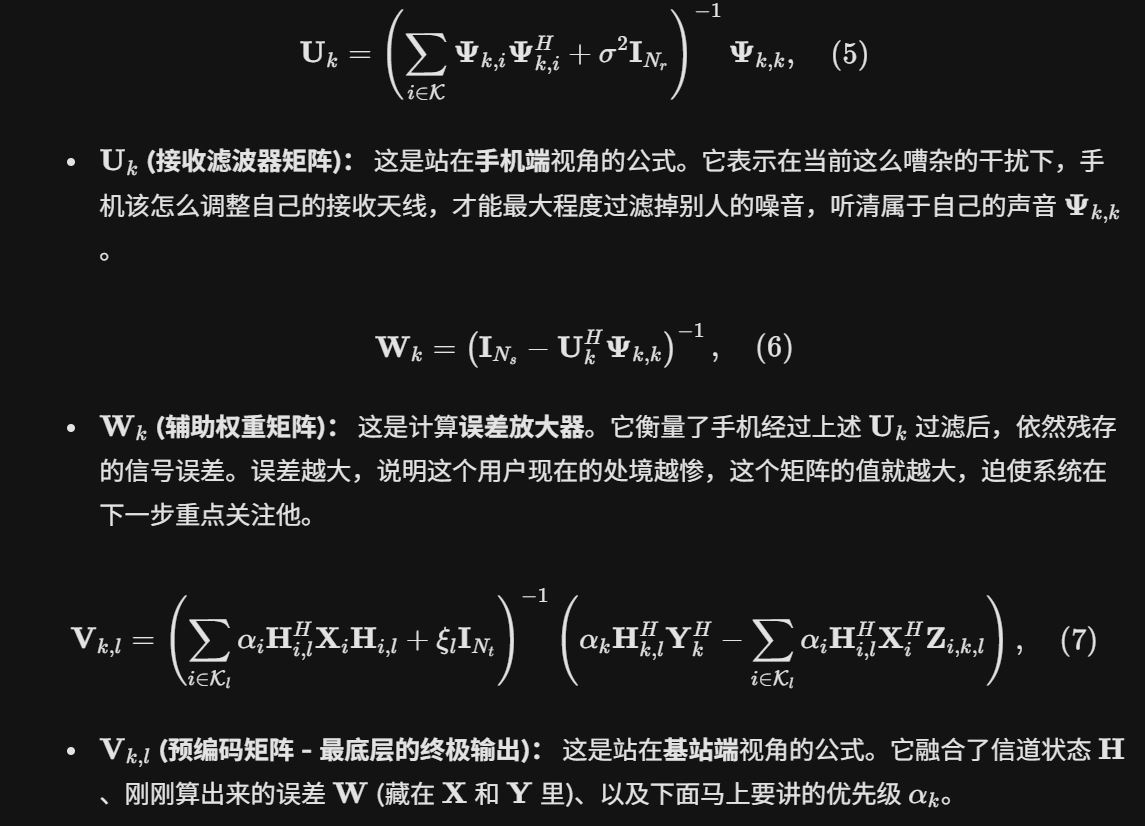

开放式无线接入网(O-RAN)架构已成为第六代(6G)移动无线网络的关键赋能技术[1]。O-RAN将传统的基站解耦为开放无线单元(O-RU)、开放分布式单元(O-DU)和开放集中式单元(O-CU)。O-DU托管执行实时(低于10毫秒)控制逻辑的分布式应用程序(dApps)[2]。O-RAN还引入了两个RAN智能控制器(RIC)。近实时(near-RT)RIC托管执行近实时(10毫秒到1秒)控制任务的xApps。非实时(non-RT)RIC托管执行非实时(超过1秒)任务的rApps[1]。rApps、xApps和dApps共同实现了跨不同时间尺度的RAN智能控制。例如,在文献[3]中,一个xApp在比例公平调度器中调整用户的权重,以保证每个用户的最低数据速率。在文献[4]中,提出了一种O-RU开关控制器rApp和一种O-CU/O-DU功能部署xApp,以最小化O-RAN中的能耗。

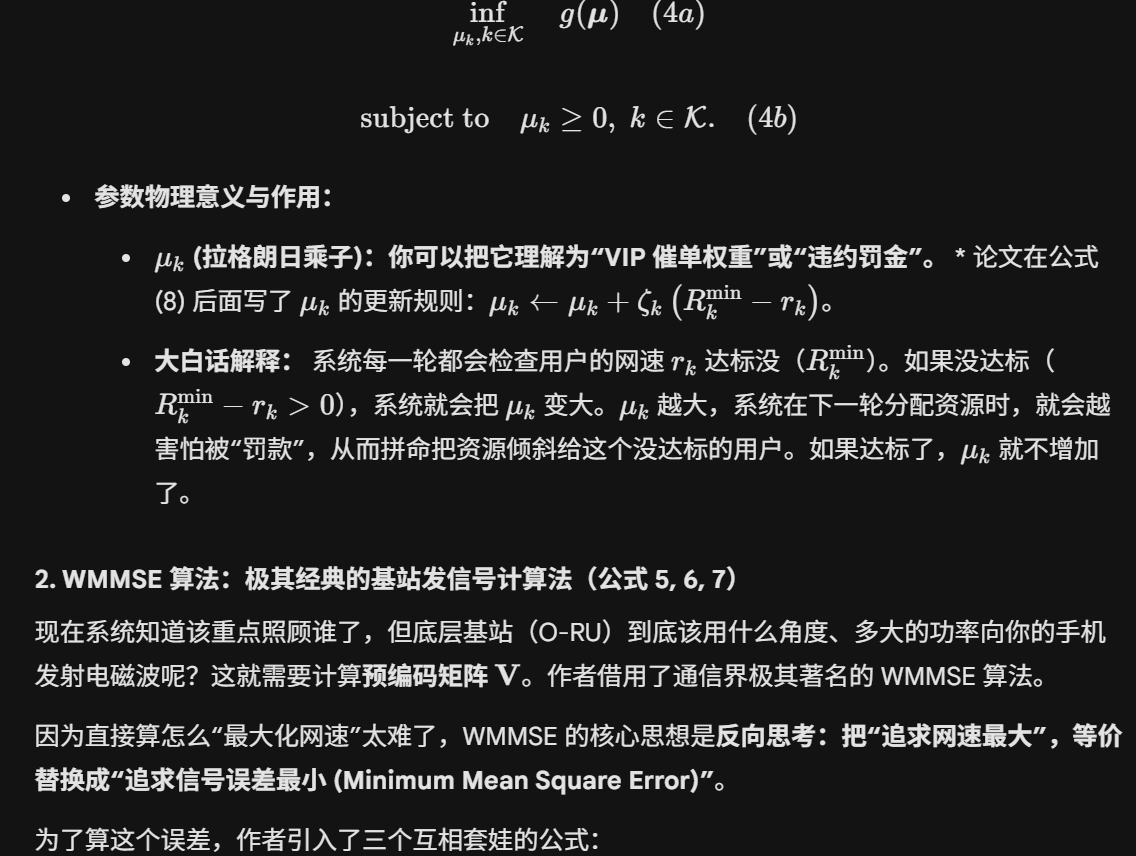

通过利用O-RAN架构的能力,研究人员目前正在推进自治RAN的愿景,即使用人工智能(AI)在无需人工干预的情况下进行适应和优化。这一愿景的关键赋能技术是代理式AI,其中多个专门的AI智能体协作来监控、分析和控制RAN。代理式AI提供了类似人类的推理和适应能力,同时以机器的速度和规模运行。传统的RAN管理要求运营商浏览复杂的仪表板并在不同系统中保持专业知识。相比之下,支持AI的RAN允许运营商用自然语言表达高级意图或长期目标。AI智能体将这些指令转化为子任务,配置RAN,并监控关键性能指标以实现期望的结果。大语言模型(LLM)凭借其卓越的自然语言理解、推理和泛化能力,成为了代理式AI极具潜力的赋能技术。

最近的研究提出了多种用于O-RAN优化的AI智能体。在文献[5]中,LLM智能体解释运营商的意图,并将这些意图与最合适的调度器进行匹配。在文献[6]中,一个智能体将运营商的意图分解为子任务,并调用专门的智能体来完成目标。在文献[7]中,非实时RIC中的一个管理智能体将运营商的意图分解为近实时RIC中功率控制和资源分配智能体的子意图。上述研究[5]–[7]仅考虑了运营商意图可以被分解为由独立智能体处理的非重叠目标的情况。需要智能体间协作的复杂意图的情况在很大程度上仍未得到探索。此外,大多数研究为每个智能体部署一个单独的LLM,这可能会限制可扩展性。

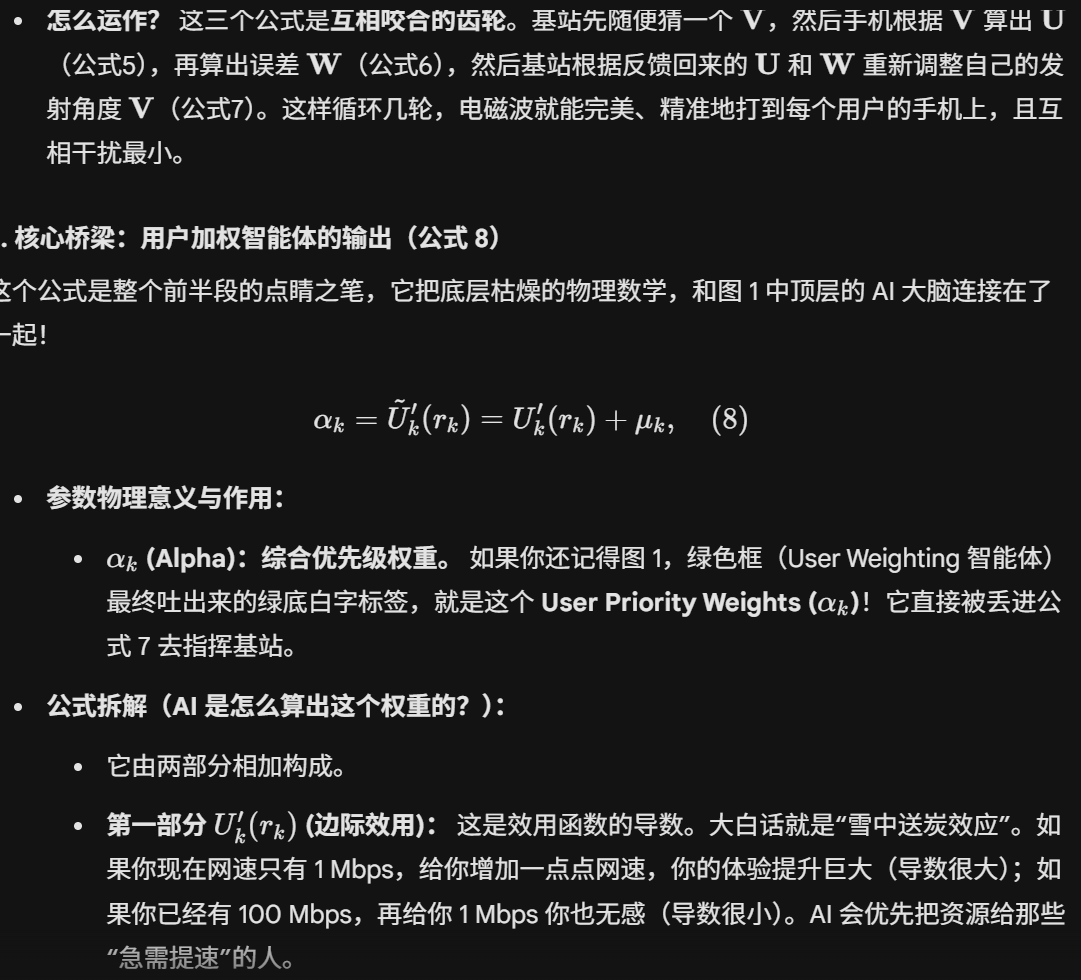

在本文中,我们提出了一个在无蜂窝O-RAN中用于意图转译和优化的代理式AI框架,其中每个用户由多个O-RU协作服务。基于LLM的智能体将以自然语言表达的运营商意图转化为特定的目标,并共同确定实现预期结果的控制参数。本文的贡献如下:

-

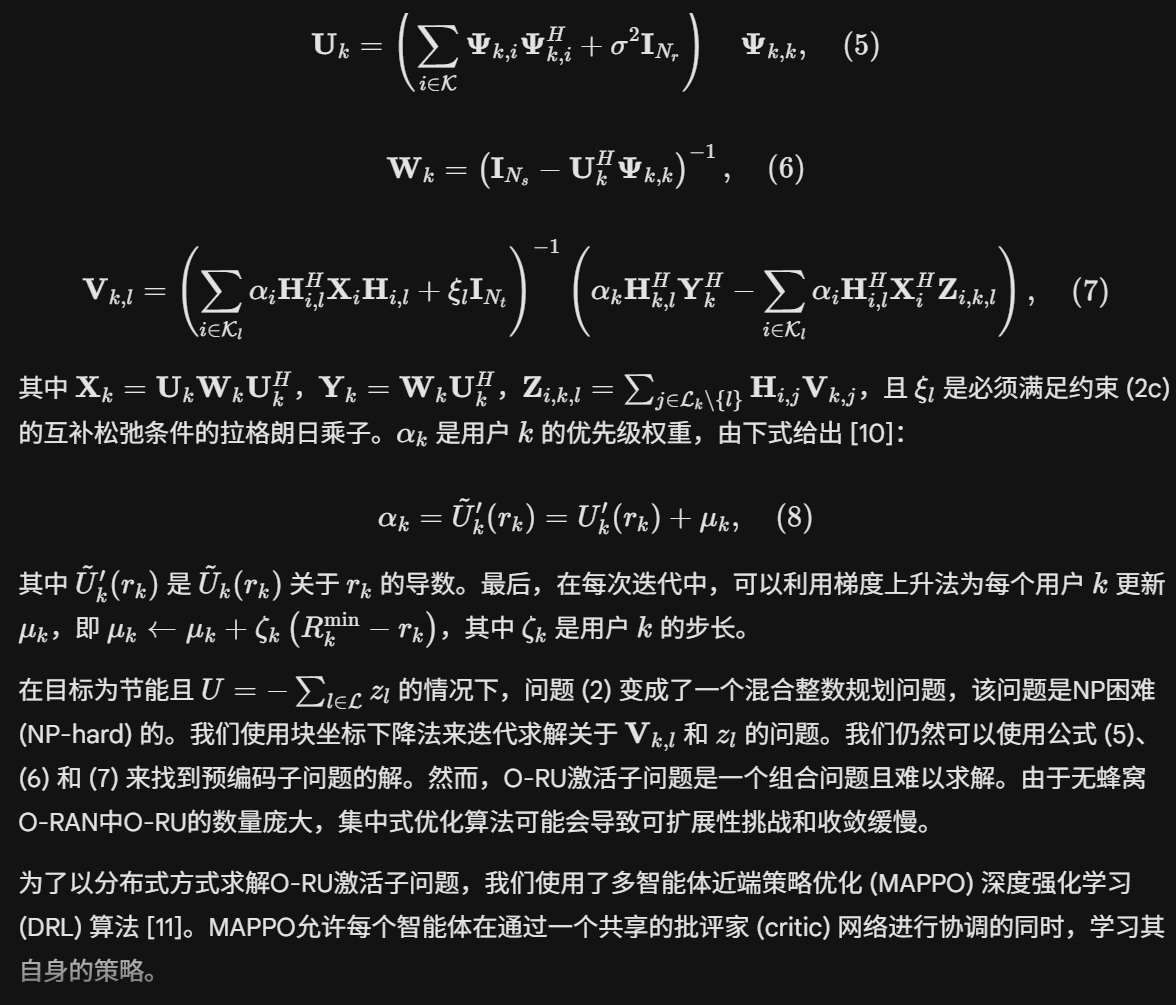

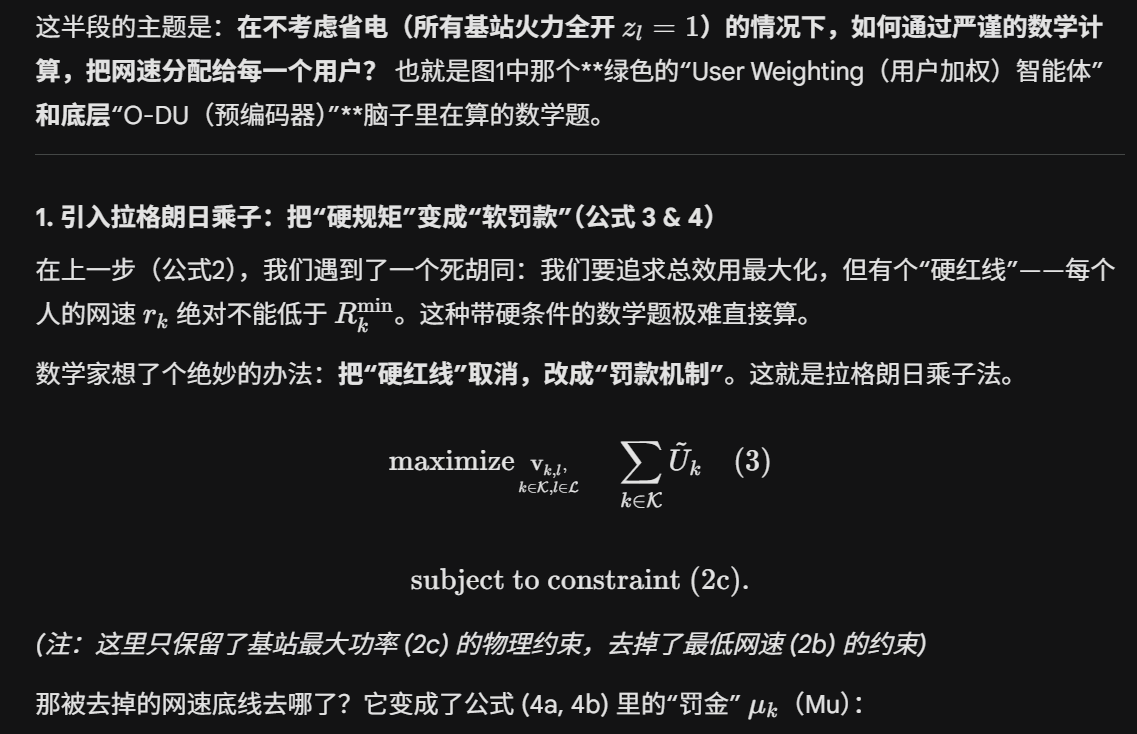

我们部署了多个在不同时间尺度上运行并通过标准化接口进行交互的智能体。非实时RIC中的监督智能体将运营商意图转化为目标函数和最低速率要求。目标函数可以是与数据速率或节能相关的效用函数。基于这些信息,近实时RIC中的用户加权智能体从记忆模块中检索相关的先验经验,以确定用于预编码的用户优先级权重。在节能模式下,O-RU管理智能体调用多智能体深度强化学习(DRL)算法来确定活跃O-RU的集合。O-DU使用这些参数进行预编码。

-

用户数据速率取决于用户优先级权重和活跃O-RU的集合。智能体间的协作对于保证最低数据速率要求是必要的。为此,一个监控智能体会测量并监控用户数据速率,协调用户加权智能体和O-RU管理智能体,并向它们提供反馈,直到满足最低数据速率约束。

-

由于LLM的体积庞大,在近实时(near-RT)RIC中部署独立的LLM智能体会限制可扩展性。为了解决这个问题,我们在near-RT RIC中部署了一个共享的LLM,并为每个智能体训练了一个量化低秩自适应(QLoRA)适配器。这种方法保留了智能体的专业性,同时大幅减少了内存使用量。

-

仿真结果表明,在节能模式下,与三种基准方案相比,所提出的代理式AI框架将活跃O-RU的数量减少了41.93%。此外,通过使用QLoRA,与部署独立的LLM智能体相比,所提出的框架将内存使用量减少了92%。

本文的其余部分组织如下。在第二节中,我们介绍了系统模型并构思了优化问题。在第三节中,我们展示了所提出的框架,并描述了每个智能体的作用以及从意图转译到优化的工作流程。性能评估在第四节中展示。结论在第五节中给出。

符号说明 (Notations):在本文中,和

分别表示复数集和实数集。粗体大写字母(例如,

)代表矩阵,而粗体小写字母(例如,

)代表向量。

的单位矩阵表示为

。

表示向量或矩阵的共轭转置。对于一个矩阵,

和

分别表示迹和行列式。

表示向量

和

的内积。

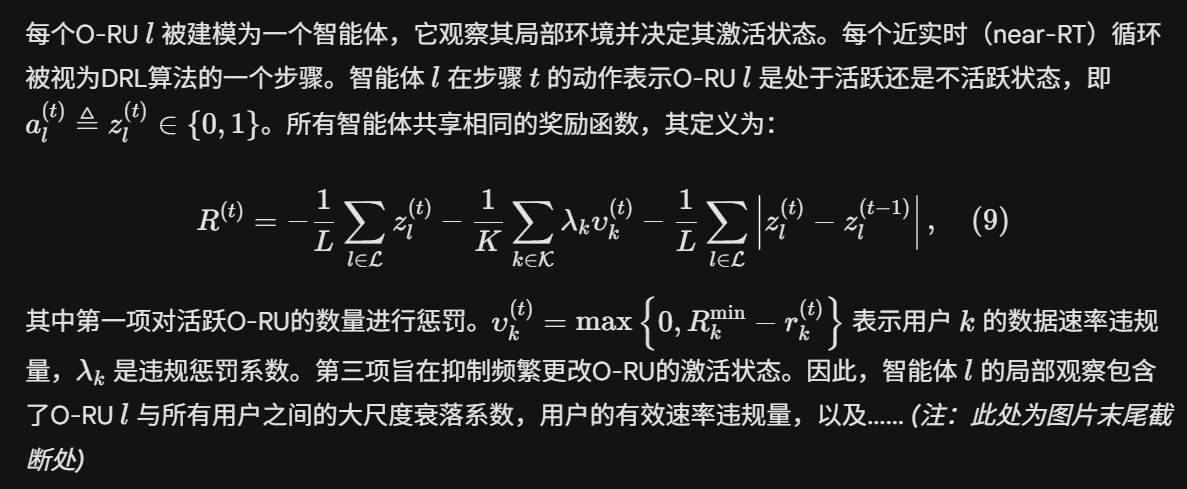

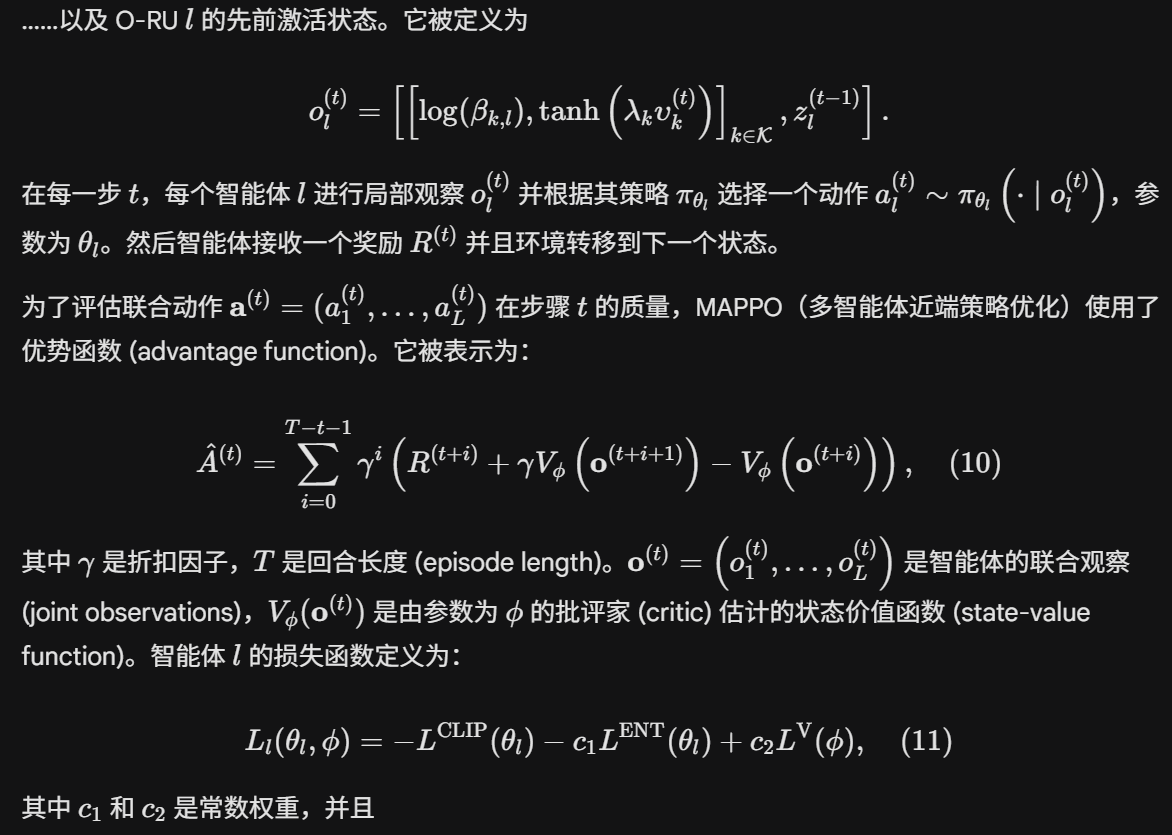

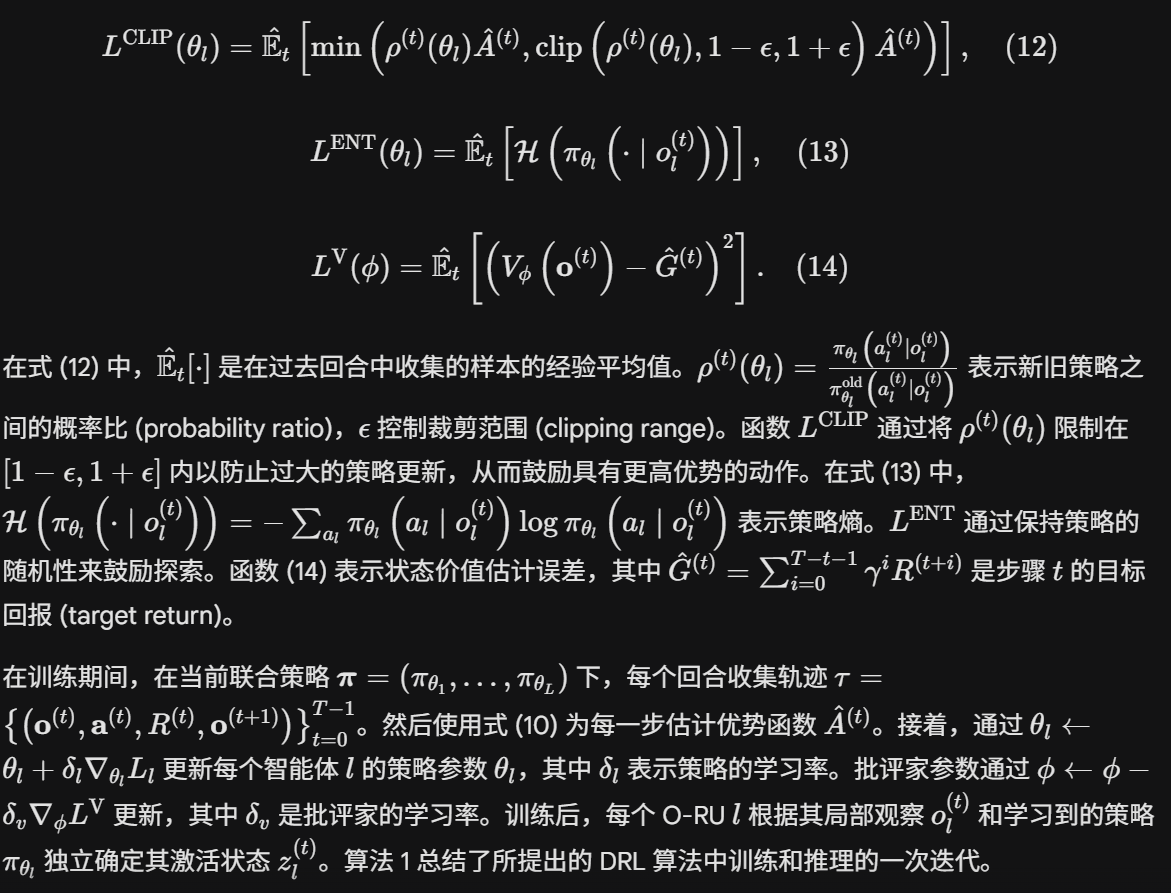

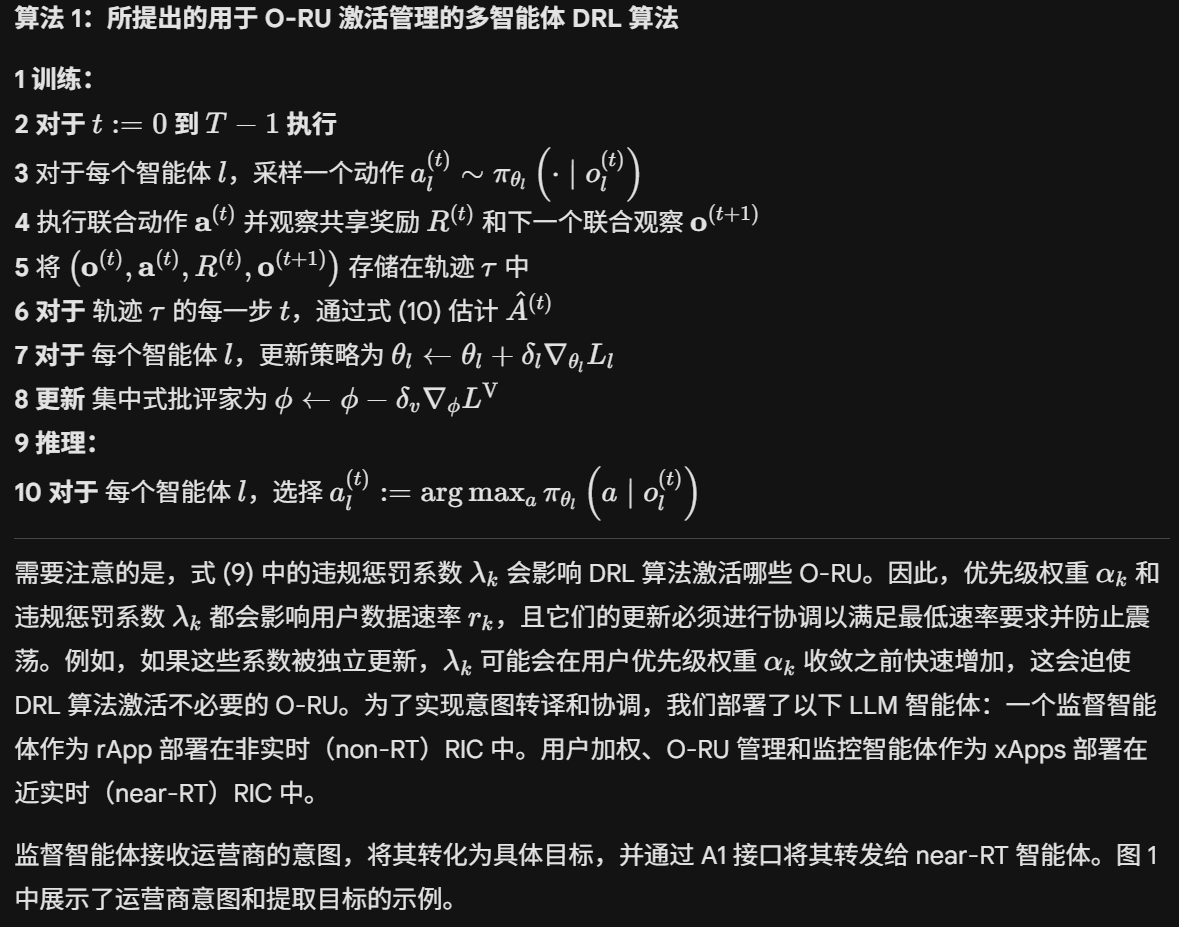

后面公式太多了,粘图片了

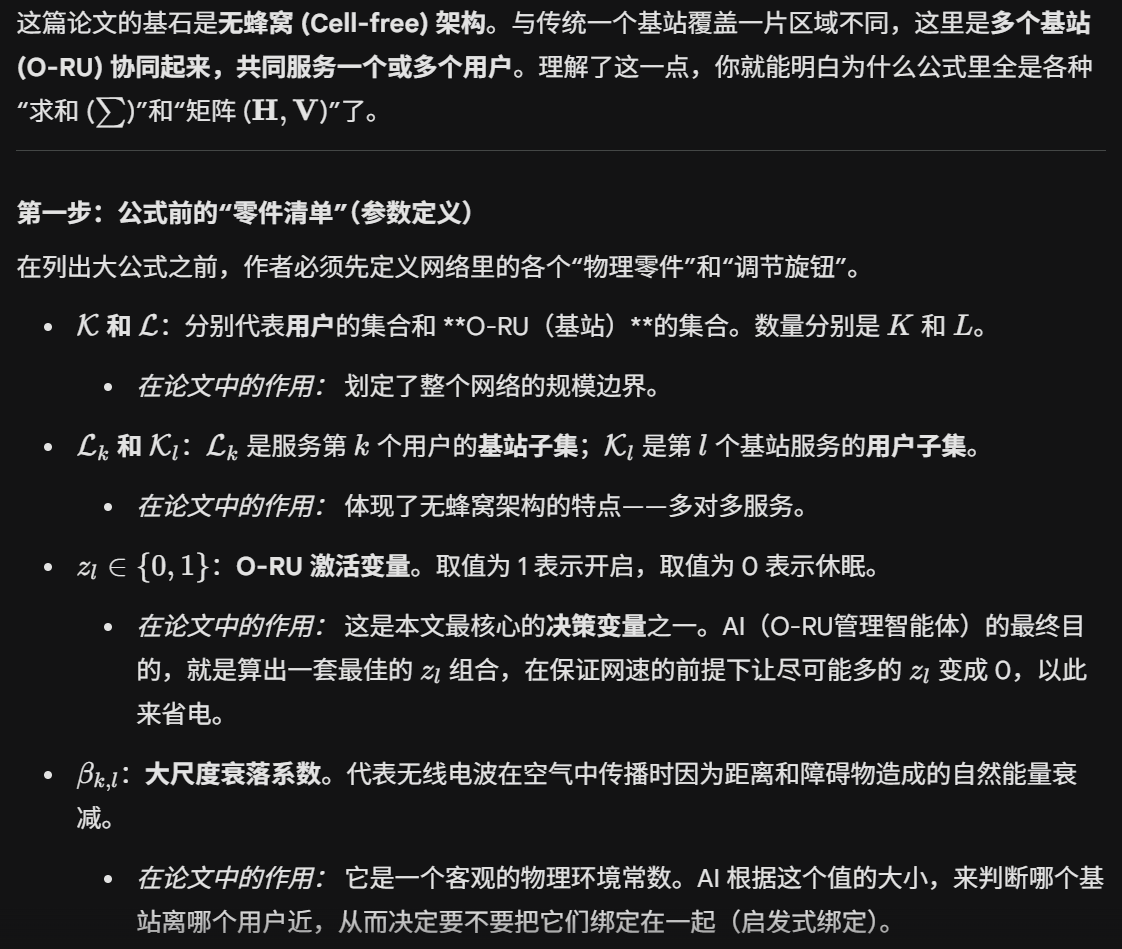

名词解释:

O-RAN:

解释: 开放式无线接入网(Open Radio Access Network)。一种打破传统基站垄断,允许不同厂商的软硬件互相组装的全新网络架构。比喻: “外卖平台的开放加盟模式”。以前的通信网络像“顺丰”,从上到下全是一家公司包办,外人插不上手。O-RAN 就像现在的外卖平台,允许A家生产电动车,B家开发APP,C家做调度算法,大家通过统一的接口合作。论文背景: 正因为 O-RAN 是开放的、允许软件控制的,作者才能有机会把 AI 大模型(LLM)塞进这个网络里当“指挥官”。

O-RU (开放无线单元):

解释: 挂在铁塔上的天线和射频模块,负责发送和接收无线电波。外卖比喻: “跑腿的外卖小哥”。最底层,数量最多,负责把外卖(数据)真正送到客户(手机)手里。他们是最耗费体力和电量的一群人。论文背景: 论文里一直强调的“节能模式(Energy Saving)”,本质上就是在半夜没人点外卖(流量低)的时候,让一部分外卖小哥(O-RU)下线休息,从而省电。

O-DU (开放分布式单元):

解释: 靠近基站的设备,负责处理对时间要求极高(毫秒级)的底层信号转换。外卖比喻: “街道分发站点”。直接管理附近几个外卖小哥,负责瞬间的接单和派单,反应必须极快。论文背景: 论文图1最下面的那个绿色框“Precoder(预编码器)”就在这里,它负责根据上面的指令,指挥天线怎么发信号。

O-CU (开放集中式单元):

解释: 集中在机房里的设备,负责处理对时间要求不高的宏观协调。外卖比喻: “城市区域总代”。不管具体送单,只管大区协调(比如你从朝阳区跑到海淀区,他负责把你的信号切换过去)。论文背景: 稍微提了一嘴,但这篇论文的核心实验没怎么动它,你可以暂且忽略。

有了硬件,还得有“软件大脑”来指挥,这就是 RIC(无线接入网智能控制器)。在这个大脑里,按照“反应速度快慢”装了三种不同级别的 APP:

RIC (大脑总部): 分为“非实时(Non-RT)”和“近实时(Near-RT)”两半。这篇论文里的所有 AI 都在这里面上班。

rApps (非实时应用):

解释: 运行在非实时 RIC 中的软件,处理时间 > 1秒 的长远宏观任务。外卖比喻: “平台总部的战略总监”。不负责具体送单,而是看报表定大方向,比如“今晚进入省钱模式,但必须保证VIP客户的送单速度”。论文背景: 论文里的 “监督智能体(Supervisor Agent)” 就是个 rApp。它听懂人类老板的话,把自然语言翻译成机器能懂的KPI目标。

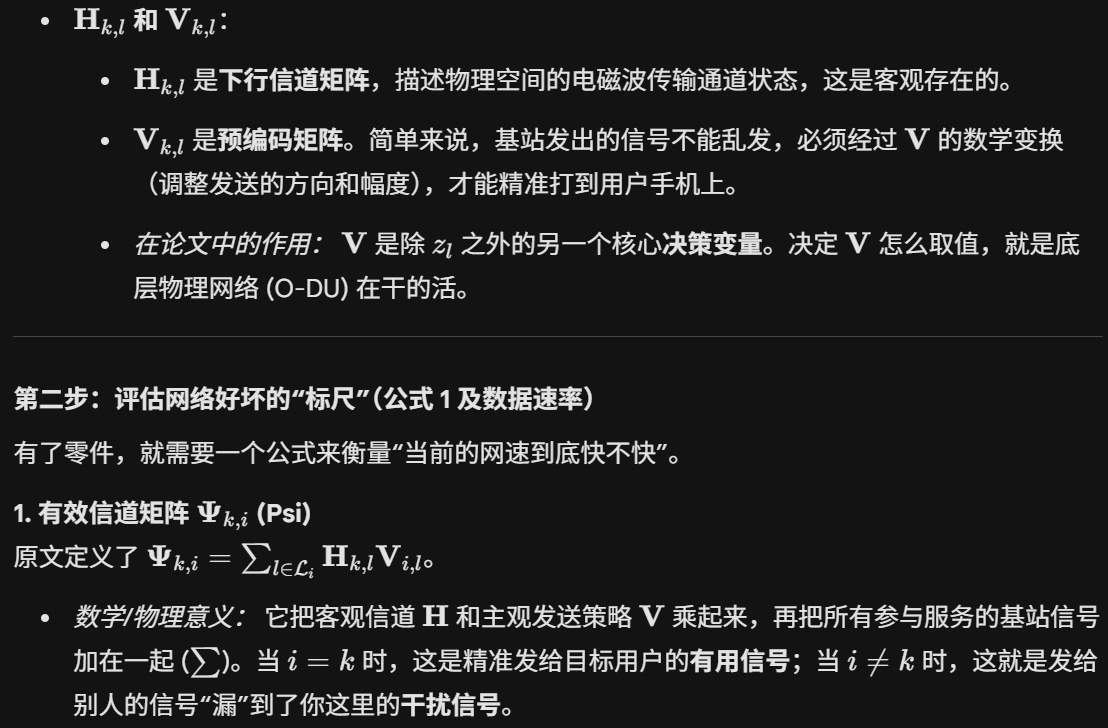

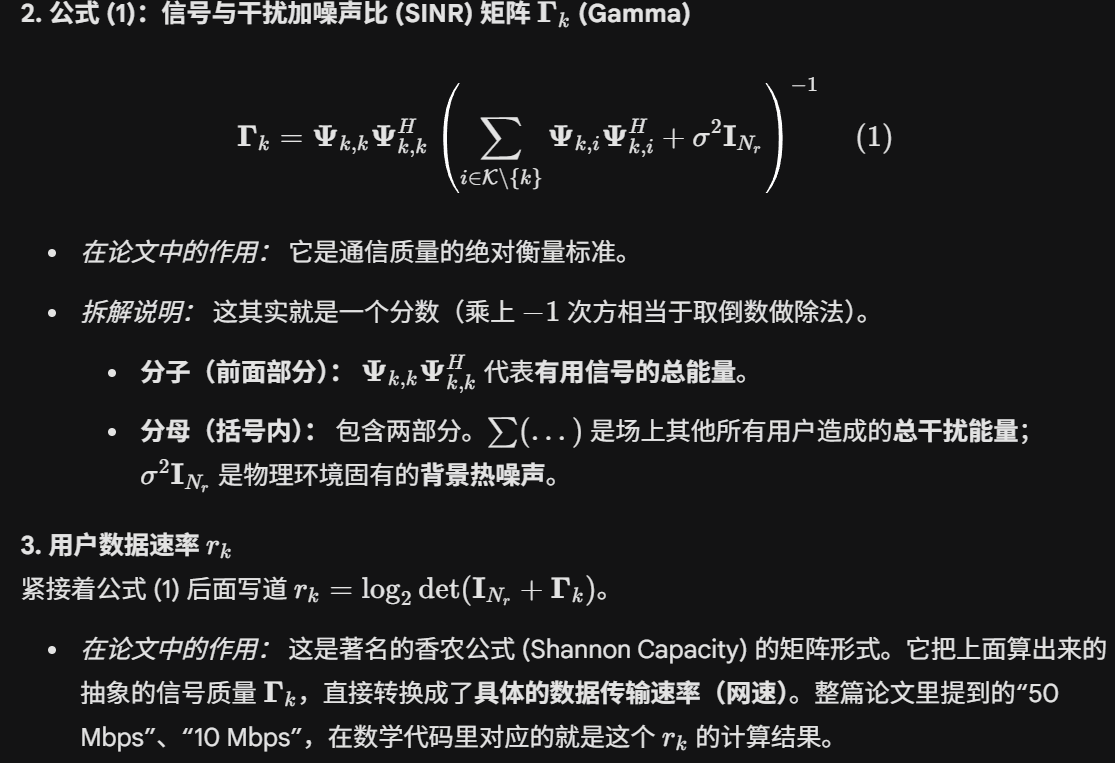

公式拆解:

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)