OpenCompass:重塑大语言模型评估格局,赋能AI战略决策

OpenCompass:重塑大语言模型评估格局,赋能AI战略决策

引言:LLM浪潮下的评估挑战

大型语言模型(LLM)的飞速发展正深刻改变着AI领域。从基础研究到行业应用,LLM展现出前所未有的能力。然而,伴随模型数量的爆炸式增长,如何公正、全面、高效地评估这些模型的性能,成为了每一个AI团队和开发者面临的核心挑战。缺乏统一的评估标准和工具,使得模型选型、性能优化和迭代决策变得异常复杂且耗时。

在这样的背景下,open-compass/opencompass 项目应运而生。作为一个全面的LLM评估平台,OpenCompass旨在提供一个公平、开放、可复现的基准,以“指南针”之姿,指引我们在复杂的LLM评估版图中前行。它不仅支持Llama3、Mistral、InternLM2、GPT-4等主流模型,更涵盖了100多个数据集,为开发者和研究者提供了一个一站式的模型评估解决方案。

背景与问题:LLM评估的痛点

对于资深工程师、架构师和技术负责人而言,LLM评估并非简单的跑分。其背后蕴含着一系列深层问题:

- 碎片化的基准与标准缺失:当前LLM评估基准众多,但缺乏一个统一、权威且持续更新的平台,导致不同评估结果之间难以横向比较。

- 评估的全面性与深度不足:仅凭几个通用数据集难以全面反映模型在特定场景下的真实能力,特别是针对复杂推理、长文本理解、代码生成等高级能力。

- 效率与资源消耗:评估大型模型需要庞大的计算资源和时间。手动配置环境、数据集、模型并进行分布式计算,门槛高且易出错。

- 结果的可复现性与透明度:由于环境、数据版本、评估脚本等差异,评估结果往往难以复现,影响了研究成果的可靠性。

- 私有模型与API模型的集成挑战:在私有化部署或依赖第三方API服务的场景下,如何将这些模型统一纳入评估体系,是实际部署中的一大难题。

OpenCompass正是为解决这些痛点而设计,它提供了一套系统化的方法论和工具链,旨在将LLM评估从经验艺术提升为可量化的工程实践。

深入剖析:OpenCompass的核心特性与架构

OpenCompass的设计哲学围绕“全面性、高效性、可扩展性”展开,其底层架构和功能实现体现了高级技术考量。

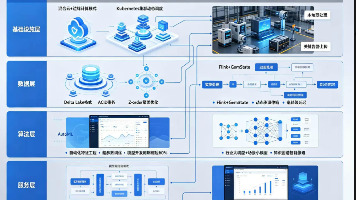

1. 模块化与高度可扩展架构

OpenCompass采用高度模块化的设计,这对于高级用户而言意味着极大的灵活性和可维护性。其核心组件包括:

- 模型(Models):统一的模型接口,无论是HuggingFace模型、API模型(如OpenAI、Claude)还是自定义模型,都能通过配置进行集成。

- 数据集(Datasets):支持多达100+数据集,通过统一的加载器进行管理。从早期版本中分散的配置(

./configs/datasets,./configs/models,./configs/summarizers)到0.4.0版本后整合进opencompass包内,体现了项目对包管理和结构一致性的优化。 - 评估器(Evaluators):定义了如何对模型输出进行评分。OpenCompass提供多样化的评估范式,例如:

- 规则评估器(Rule-based Evaluator):基于预设规则或关键词匹配进行评分。

- LLM作为评判者(LLM-as-Judge):利用另一个LLM来评估目标模型的输出质量。

GenericLLMEvaluator即是为此设计。 - 级联评估器(CascadeEvaluator):允许将多个评估器按顺序组合,形成复杂的评估流程,例如先进行初步筛选,再进行深度分析,极大地提升了评估的灵活性和定制性。

- 特定领域评估器:如

MATHVerifyEvaluator,专注于数学推理的准确性评估。

- 后处理器(Postprocessors):对模型原始输出进行处理,提取关键信息以供评估。例如,集成

XFinder作为答案抽取模型,提高了评估的准确性。 - 总结器(Summarizers):汇总所有评估结果,生成易于理解的报告。

这种架构使得开发者可以轻松地添加新的模型、数据集或自定义评估逻辑,而无需修改核心代码。

2. 高效分布式评估与推理加速

对于大型模型评估,效率是关键。OpenCompass在这方面提供了多重优化:

- 分布式任务调度:通过命令行参数

--max-num-worker,OpenCompass支持数据并行(data parallel),将评估任务分发到多个GPU或节点上。对于单卡无法加载的超大模型,--hf-num-gpus参数则支持HuggingFace模型并行(model parallel),允许模型在多个GPU上分布加载。 - 推理后端切换:除了默认的HuggingFace推理后端,OpenCompass还支持流行的推理加速框架,如LMDeploy和vLLM。通过简单的命令行参数

-a [backend]即可切换,这对于追求极致吞吐量和低延迟的评估场景至关重要。

选择不同的加速后端涉及性能、内存占用和部署复杂性的权衡。LMDeploy和vLLM通常能提供更高的QPS,但可能需要特定的硬件或环境配置。# 使用LMDeploy加速评估 opencompass --models hf_internlm2_5_1_8b_chat --datasets demo_gsm8k_chat_gen -a lmdeploy

3. 多样化评估范式与Prompt工程

OpenCompass深知Prompt工程在LLM性能激发中的作用,因此支持多种评估范式:

- 零样本(Zero-shot)、少样本(Few-shot)、思维链(Chain-of-Thought, CoT):通过灵活的Prompt模板配置,轻松切换这些范式,以探究模型在不同提示策略下的表现上限。

- 对话式与标准式Prompt:针对不同模型类型(基础模型、对话模型),提供适配的Prompt格式。

_ppl配置通常用于基础模型,而_gen配置则适用于基础模型和对话模型。 - LLM-as-Judge评估:利用一个强大的LLM作为评判者,对另一个LLM的输出进行主观质量评估,尤其适用于开放式生成任务,弥补了传统规则评估的不足。

4. 数据准备与管理

数据集是评估的基石。OpenCompass在数据准备方面提供了便利和灵活性:

- 离线下载:提供打包好的数据集供用户下载解压。

- 自动下载:支持从OpenCompass存储服务器按需自动下载数据集,简化了初始设置。

- ModelScope集成:通过集成ModelScope平台,用户可以按需加载数据集,无需预先下载全部数据到本地磁盘,极大地节省了存储空间和准备时间。

这种按需加载机制,对于需要评估大量数据集但本地存储资源有限的场景,是极其有价值的。# 安装ModelScope并设置环境变量 pip install modelscope[framework] export DATASET_SOURCE=ModelScope # 之后运行评估任务即可按需加载数据 opencompass --models hf_internlm2_5_1_8b_chat --datasets demo_gsm8k_chat_gen

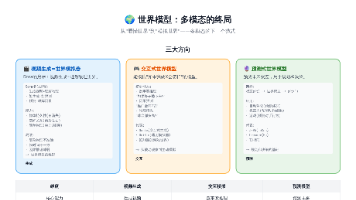

5. OpenCompass 2.0生态:CompassKit, CompassHub, CompassRank

OpenCompass不仅仅是一个工具包,它更是一个完整的生态系统,通过CompassKit、CompassHub和CompassRank三大组件,构筑了全面的LLM评估基础设施。

- CompassKit:即本项目,提供强大的评估工具集,覆盖LLM和VLM(Vision-language Models)的性能评估。

- CompassHub:一个开创性的基准浏览器界面,简化了研究人员和从业者对海量基准的探索和使用。它鼓励社区贡献,旨在成为一个开放的基准知识库。

- CompassRank:一个增强型排行榜,不仅涵盖开源基准,还纳入了专有基准的评估结果。它提供了模型在行业内跨维度表现的全面洞察,是模型选型和性能追踪的重要参考。

这三大组件协同工作,为用户提供从工具、数据到洞察的一体化体验,赋能AI战略决策。

安装与快速上手

作为一款为资深开发者设计的工具,OpenCompass的安装和使用流程简洁高效,同时提供了足够的配置深度。

环境准备

强烈推荐使用conda管理Python环境。

# 创建并激活虚拟环境

conda create --name opencompass python=3.10 -y

conda activate opencompass

# 通过pip安装OpenCompass

# 基础安装

pip install -U opencompass

# 完整安装(支持更多数据集)

# pip install "opencompass[full]"

# 支持LMDeploy加速

# pip install "opencompass[lmdeploy]"

# 支持API模型评估

# pip install "opencompass[api]"

# 从源码安装(适用于开发或获取最新特性)

# git clone https://github.com/open-compass/opencompass opencompass

# cd opencompass

# pip install -e .

# pip install -e ".[full]" # 包含完整数据集支持

数据准备

如前所述,OpenCompass支持多种数据准备方式。最便捷的方式是依赖其自动下载功能,或利用ModelScope按需加载。

首次评估

OpenCompass支持通过CLI或Python脚本进行评估。对于复杂场景,推荐使用Python脚本配置。

# CLI方式:评估InternLM2.5-1.8B-Chat在demo_gsm8k_chat_gen数据集上的表现

opencompass --models hf_internlm2_5_1_8b_chat --datasets demo_gsm8k_chat_gen

# Python脚本方式:执行预定义的评估配置

opencompass examples/eval_chat_demo.py

API模型评估

OpenCompass对API模型的支持与开源模型无异,只需配置API密钥即可无缝集成。

export OPENAI_API_KEY="YOUR_OPEN_API_KEY"

opencompass --models gpt_4o_2024_05_13 --datasets demo_gsm8k_chat_gen

用例场景:决策、优化与创新

OpenCompass的强大功能使其适用于多种高级用例:

- 模型选型与基准测试:技术负责人可利用OpenCompass全面评估不同开源或API模型在特定业务场景下的性能,为模型选型提供数据支撑。例如,比较Llama3、Qwen2.5和GPT-4o在多跳推理(MuSR)、长上下文理解(BABILong、RULER)以及代码生成(SciCode)等任务上的表现。

- 模型迭代与性能回归测试:在LLM微调或预训练过程中,利用OpenCompass进行自动化回归测试,确保新版本模型在核心基准上没有性能下降,并验证特定优化是否达到预期效果。

- 构建企业级评估平台:基于OpenCompass的模块化架构,企业可以将其集成到内部MALLOps(ML + LLM Ops)流程中,构建定制化的、可扩展的LLM评估服务,例如加入企业内部数据集、定制评估指标和可视化报告。

- 研究与创新:研究人员可以利用OpenCompass快速验证新的评估方法、Prompt策略或模型架构的有效性,加速LLM领域的前沿探索。例如,实现新的LLM-as-Judge策略,或集成新的答案后处理技术。

- 长上下文与复杂推理评估:随着模型上下文窗口的增大,评估其长文本理解和复杂推理能力变得关键。OpenCompass支持MuSR、BABILong、RULER等专门的长上下文和推理基准,为评估这些高级能力提供了强大工具。

权衡、可伸缩性与集成

权衡考量

- 灵活性 vs. 配置复杂度:OpenCompass提供了极高的灵活性,但也意味着用户需要投入时间理解其配置系统。项目通过提供大量预设配置和清晰的文档来缓解这一复杂度。

- 评估全面性 vs. 资源消耗:进行全面评估需要巨大的计算资源。OpenCompass通过分布式评估和加速后端来优化资源利用率,但用户仍需根据自身资源选择合适的评估范围。

- 开放性 vs. 结果一致性:作为一个开放平台,OpenCompass鼓励社区贡献。同时,通过版本控制、统一的数据集和模型加载机制,努力确保评估结果的可复现性和一致性。

可伸缩性

OpenCompass从设计之初就考虑了可伸缩性:

- 计算扩展:支持多GPU、多节点分布式评估,能够处理TB级数据集和大型模型。

- 功能扩展:通过模块化设计,无论是添加新的模型、数据集、评估器还是后处理器,都具有良好的可扩展性。

- 数据源扩展:支持本地文件、URL下载、ModelScope等多种数据源,未来可轻松集成更多数据平台。

集成能力

OpenCompass拥有出色的集成能力:

- 模型生态:深度集成HuggingFace生态,轻松加载各种HuggingFace模型;同时支持主流LLM API。

- 推理框架:与LMDeploy、vLLM等高性能推理框架无缝集成,提供灵活的性能优化选项。

- 数据平台:与ModelScope等数据平台集成,简化数据集管理。

- 社区与工具:与GitHub、Discord、WeChat等社区平台紧密结合,方便用户交流与贡献。

贡献与社区

OpenCompass不仅是一个工具,更是一个活跃的开源社区。项目团队积极招聘全职研究员/工程师和实习生,欢迎有志于LLM评估的开发者加入。

项目的贡献指南清晰地阐述了如何参与到项目中来,无论是提交Bug报告、提出新功能建议,还是贡献代码和文档,都将受到欢迎。

通过参与贡献,开发者不仅能提升自身在LLM评估领域的专业技能,也能直接影响这一关键基础设施的发展方向。

结语:LLM评估的未来指南

在LLM技术日新月异的今天,一个强大、灵活且可信赖的评估平台是推动AI发展的基石。OpenCompass以其全面的功能、高效的性能和开放的生态,为资深工程师、架构师和技术负责人提供了一个无与伦比的工具集,以应对LLM评估的复杂挑战。

无论您是致力于模型研发、系统集成还是AI战略制定,OpenCompass都将是您不可或缺的“指南针”,帮助您精准把握模型性能,加速创新迭代,并最终赋能您的AI战略决策。立即探索OpenCompass,开启您的LLM评估新篇章!

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)