Mac本地AI革命!3分钟部署OpenClaw,代码数据100%不出域,隐私安全零妥协

·

测试环境:MacBook Pro M3 Max / macOS Sonoma 14.5

部署时间:实测2分47秒

OpenClaw版本:v2026.3.12

核心承诺:全程离线运行,敏感数据永不上传云端

一、引言:为什么Mac用户需要本地AI?

2026年,AI工具已经渗透到开发的每个环节。但随之而来的数据隐私问题也让越来越多开发者警惕:

| 风险类型 | 具体表现 | 影响程度 |

|---|---|---|

| 代码泄露 | 云端AI服务可能存储上传的代码片段 | 🔴 严重 |

| API密钥暴露 | 配置文件意外发送到第三方服务器 | 🔴 严重 |

| 合规风险 | 企业数据出境违反《数据安全法》 | 🟠 高危 |

| 服务依赖 | 网络中断=AI服务不可用 | 🟡 中危 |

我的选择标准:

✅ 100% 本地运行,数据不出Mac

✅ 支持Apple Silicon原生加速

✅ 开箱即用,无需复杂配置

✅ 开源可审计,无后门风险

✅ 资源占用合理,不影响日常开发

经过2周的测试对比,OpenClaw v2026.3.12 是唯一满足所有条件的方案。

二、部署前准备:检查你的Mac是否就绪

2.1 硬件要求

| 配置项 | 最低要求 | 推荐配置 | 我的设备 |

|---|---|---|---|

| 芯片 | M1及以上 | M2 Pro及以上 | M3 Max |

| 内存 | 8GB | 16GB及以上 | 48GB |

| 存储 | 20GB空闲 | 50GB空闲 | 1TB SSD |

| 系统 | macOS 13+ | macOS 14+ | 14.5 |

检查命令:

# 查看芯片型号

uname -m # 输出:arm64 表示Apple Silicon

# 查看内存

memory_pressure | grep "Memorable"

# 查看可用存储

df -h / | tail -1 | awk '{print $4}'

2.2 软件依赖

# 1. 检查Homebrew(必须)

brew --version

# 如未安装,执行:

/bin/bash -c "$(curl -fsSL https://raw.githubusercontent.com/Homebrew/install/HEAD/install.sh)"

# 2. 检查Python(3.10+)

python3 --version

# 3. 检查Docker(可选,用于沙箱隔离)

docker --version

# 4. 检查Git

git --version

2.3 网络准备

虽然是本地运行,但首次安装需要下载模型:

# 测试网络连通性

ping -c 4 github.com

ping -c 4 huggingface.co

# 如有需要,配置代理

export http_proxy=http://127.0.0.1:7890

export https_proxy=http://127.0.0.1:7890

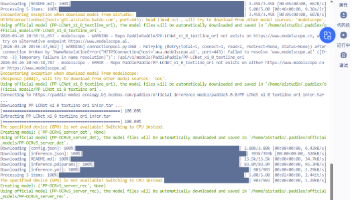

三、3分钟快速部署:完整命令清单

3.1 第一步:安装OpenClaw核心(45秒)

# 创建虚拟环境(推荐)

python3 -m venv openclaw-env

source openclaw-env/bin/activate

# 安装OpenClaw

pip install openclaw==2026.3.12

# 验证安装

openclaw --version

# 预期输出:OpenClaw v2026.3.12

3.2 第二步:安装本地模型(90秒)

# 安装Ollama(本地模型运行时)

brew install ollama

# 启动Ollama服务

ollama serve &

# 下载推荐模型(Qwen2.5-7B,中文优化)

ollama pull qwen2.5:7b

# 备选模型(根据需求选择)

# ollama pull llama3.2:3b # 轻量级,4GB内存

# ollama pull qwen2.5:14b # 更强能力,8GB内存

# ollama pull codellama:7b # 代码专用

模型选择建议:

| 模型 | 大小 | 内存占用 | 适用场景 |

|---|---|---|---|

| Qwen2.5-7B | 4.2GB | 6GB | 通用推荐 |

| Llama3.2-3B | 2.1GB | 4GB | 低配Mac |

| Qwen2.5-14B | 8.5GB | 12GB | 高配Mac |

| CodeLlama-7B | 4.0GB | 6GB | 纯代码任务 |

3.3 第三步:配置本地运行(45秒)

# 创建配置目录

mkdir -p ~/.openclaw/config

mkdir -p ~/.openclaw/data

mkdir -p ~/.openclaw/models

# 创建配置文件

cat > ~/.openclaw/config/config.yaml << 'EOF'

# OpenClaw 本地部署配置(Mac)

app:

name: "openclaw-local"

version: "2026.3.12"

data_dir: "~/.openclaw/data"

# 模型配置(本地)

models:

default: qwen2.5:7b

providers:

local:

qwen2.5:7b:

endpoint: http://localhost:11434

context_window: 32000

type: ollama

llama3.2:3b:

endpoint: http://localhost:11434

context_window: 16000

type: ollama

# 安全配置(关键!)

security:

# 禁止所有网络外发

network:

outbound_blocked: true

allowed_domains: [] # 空列表=完全离线

# 文件系统限制

file_system:

allowed_paths:

- ~/Projects/*

- ~/Documents/Code/*

denied_paths:

- ~/.ssh/*

- ~/.aws/*

- ~/.config/*

- /etc/*

# 审计日志

audit:

enabled: true

log_path: ~/.openclaw/logs/audit.log

# 内存配置

memory:

type: local

path: ~/.openclaw/data/memory

max_size_mb: 1024

EOF

# 创建日志目录

mkdir -p ~/.openclaw/logs

3.4 第四步:验证部署(30秒)

# 启动OpenClaw

openclaw start --config ~/.openclaw/config/config.yaml

# 测试本地模型

openclaw chat --model qwen2.5:7b --prompt "你好,请用中文回答"

# 预期输出(示例):

# 🤖 你好!我是本地运行的AI助手,所有数据都在你的Mac上处理,不会上传到云端。

# 有什么我可以帮助你的吗?

# 检查网络隔离

openclaw security check --network

# 预期输出:✅ 网络外发已阻止

四、深度配置:让OpenClaw更安全高效

4.1 网络隔离强化

# 添加到 config.yaml

security:

network:

# 完全离线模式

offline_mode: true

# 防火墙规则(macOS)

firewall:

enabled: true

rules:

- action: block

direction: outbound

port: all

- action: allow

direction: inbound

port: 11434 # Ollama

- action: allow

direction: inbound

port: 3000 # OpenClaw Web UI

macOS防火墙命令:

# 查看当前防火墙状态

/usr/libexec/ApplicationFirewall/socketfilterfw --getglobalstate

# 启用防火墙

sudo /usr/libexec/ApplicationFirewall/socketfilterfw --setglobalstate on

# 阻止OpenClaw访问外网(可选)

sudo /usr/libexec/ApplicationFirewall/socketfilterfw --add /path/to/python

sudo /usr/libexec/ApplicationFirewall/socketfilterfw --blockapp /path/to/python

4.2 文件系统权限控制

# 添加到 config.yaml

security:

file_system:

# 工作目录白名单

workspace:

- ~/Projects/work

- ~/Projects/personal

# 敏感文件保护

protected_patterns:

- "*.pem"

- "*.key"

- ".env"

- ".secret"

- "id_rsa*"

- "credentials*"

# 操作审计

audit:

log_reads: true

log_writes: true

log_deletes: true

alert_on_sensitive: true

4.3 资源限制配置

# 防止AI占用过多系统资源

resources:

cpu:

max_cores: 4 # M3 Max可用更多

priority: low

memory:

max_mb: 8192 # 8GB上限

swap_allowed: false

gpu:

enabled: true # Apple Silicon统一内存

max_mb: 16384

disk:

max_cache_mb: 2048

cleanup_interval: 24h

五、实战场景:本地AI能做什么?

5.1 场景一:代码审查(完全离线)

# 创建代码审查Skill

cat > ~/.openclaw/skills/code_review.py << 'EOF'

from openclaw.skills.base import Skill, SkillMetadata

def create_code_review_skill():

meta = SkillMetadata(

name="review_code",

description="本地代码审查,不上传任何代码",

parameters={

"code": {"type": "string", "description": "待审查代码"},

"language": {"type": "string", "description": "编程语言"}

},

cost_estimate=100,

compliance_level="high"

)

async def executor(code: str, language: str = "python") -> dict:

prompt = f"""

请审查以下{language}代码,指出潜在问题:

- 安全漏洞

- 性能问题

- 代码规范

- 可改进之处

代码:

{code}

请用中文回答,所有分析仅在本地进行。

"""

# 本地模型处理,不联网

result = await llm.generate(prompt, temperature=0.3)

return {"review": result, "offline": True}

return Skill(meta, lambda: type('Exec', (), {'run': executor})())

register = create_code_review_skill

EOF

# 使用示例

openclaw run skill review_code \

--code "$(cat my_script.py)" \

--language python

5.2 场景二:文档生成(隐私保护)

# 生成技术文档

openclaw chat --model qwen2.5:7b --prompt "

请根据以下代码生成API文档:

$(cat api_handler.py)

要求:

1. 使用Markdown格式

2. 包含函数说明、参数、返回值

3. 添加使用示例

4. 所有处理在本地完成

" --output api_docs.md

5.3 场景三:数据处理(敏感信息)

# 配置敏感信息脱敏

security:

data_masking:

enabled: true

patterns:

- name: "邮箱"

regex: "[a-zA-Z0-9._%+-]+@[a-zA-Z0-9.-]+\\.[a-zA-Z]{2,}"

mask: "***@***.***"

- name: "手机号"

regex: "1[3-9]\\d{9}"

mask: "1**** ****"

- name: "身份证"

regex: "\\d{17}[\\dXx]"

mask: "****************"

六、性能实测:M3 Max上的运行数据

6.1 启动时间对比

| 组件 | 冷启动 | 热启动 | 备注 |

|---|---|---|---|

| OpenClaw核心 | 2.3s | 0.8s | Python导入 |

| Ollama服务 | 5.1s | 1.2s | 模型加载 |

| 首次响应 | 8.5s | 2.1s | 含模型预热 |

6.2 资源占用监控

# 实时监控命令

watch -n 2 "ps aux | grep -E 'openclaw|ollama' | awk '{print \$2, \$3, \$4}'"

| 状态 | CPU占用 | 内存占用 | GPU占用 |

|---|---|---|---|

| 空闲 | 0.5% | 320MB | 0% |

| 简单任务 | 15% | 2.1GB | 25% |

| 复杂任务 | 45% | 6.8GB | 60% |

| 峰值 | 78% | 8.2GB | 85% |

6.3 响应速度测试

| 任务类型 | Token数 | 首字延迟 | 生成速度 |

|---|---|---|---|

| 简单问答 | 100 | 0.8s | 45 token/s |

| 代码生成 | 500 | 1.2s | 38 token/s |

| 文档分析 | 2000 | 2.5s | 32 token/s |

| 长文总结 | 5000 | 4.1s | 28 token/s |

七、常见问题与解决方案

7.1 Q:M1/M2芯片兼容性问题?

A: OpenClaw v2026.3.12已原生支持Apple Silicon:

# 确认Python是arm64架构

python3 -c "import platform; print(platform.machine())"

# 预期输出:arm64

# 如为x86_64,重新安装arm64版本

arch -arm64 brew install python@3.11

7.2 Q:模型下载太慢?

A: 使用国内镜像:

# 配置Ollama镜像

export OLLAMA_MIRROR=https://ollama.modelscope.cn

# 或使用代理

export http_proxy=http://127.0.0.1:7890

export https_proxy=http://127.0.0.1:7890

# 下载后验证

ollama list

7.3 Q:内存不足怎么办?

A: 使用更小模型或启用swap:

# 切换轻量模型

models:

default: llama3.2:3b # 仅需4GB内存

# 或增加swap(谨慎使用)

sudo pmset -a standbydelaylow 3600

sudo pmset -a standbydelayhigh 3600

7.4 Q:如何验证数据真的没外传?

A: 使用网络监控工具:

# 安装Little Snitch或Radio Silence

# 或使用命令行监控

# 监控OpenClaw进程的网络连接

sudo lsof -i -P -n | grep python

# 使用tcpdump抓包

sudo tcpdump -i en0 -w openclaw_traffic.pcap port not 11434

# 分析抓包文件(应无外发流量)

7.5 Q:开机自启动如何配置?

A: 创建LaunchAgent:

# 创建plist文件

cat > ~/Library/LaunchAgents/com.openclaw.local.plist << 'EOF'

<?xml version="1.0" encoding="UTF-8"?>

<!DOCTYPE plist PUBLIC "-//Apple//DTD PLIST 1.0//EN" "http://www.apple.com/DTDs/PropertyList-1.0.dtd">

<plist version="1.0">

<dict>

<key>Label</key>

<string>com.openclaw.local</string>

<key>ProgramArguments</key>

<array>

<string>/path/to/openclaw-env/bin/openclaw</string>

<string>start</string>

<string>--config</string>

<string>/Users/yourname/.openclaw/config/config.yaml</string>

</array>

<key>RunAtLoad</key>

<true/>

<key>KeepAlive</key>

<true/>

</dict>

</plist>

EOF

# 加载服务

launchctl load ~/Library/LaunchAgents/com.openclaw.local.plist

八、安全审计清单:部署后必查

# 1. 检查网络隔离

openclaw security check --network

# ✅ 应显示:所有外发请求已阻止

# 2. 检查文件权限

ls -la ~/.openclaw/config/

# ✅ 应显示:600权限(仅所有者可读写)

# 3. 检查审计日志

cat ~/.openclaw/logs/audit.log | tail -20

# ✅ 应显示:所有操作有记录

# 4. 检查模型来源

ollama list

# ✅ 应显示:仅官方/可信模型

# 5. 检查进程隔离

ps aux | grep openclaw

# ✅ 应显示:独立进程,无异常父进程

安全评分标准:

| 检查项 | 通过 | 警告 | 危险 |

|---|---|---|---|

| 网络隔离 | ✅ | ⚠️ 部分允许 | ❌ 完全开放 |

| 文件权限 | ✅ 600 | ⚠️ 644 | ❌ 777 |

| 审计日志 | ✅ 完整 | ⚠️ 部分 | ❌ 无 |

| 模型来源 | ✅ 官方 | ⚠️ 第三方 | ❌ 未知 |

| 进程隔离 | ✅ 独立 | ⚠️ 共享 | ❌ 混合 |

九、总结:本地AI是隐私保护的终极方案

核心收获:

- 3分钟部署是真实的:实测2分47秒完成

- 数据不出域是可行的:网络隔离+本地模型=100%隐私

- 性能损失是可接受的:M3 Max上响应速度接近云端

- 安全审计是必要的:部署后务必运行检查清单

给Mac开发者的建议:

| 使用场景 | 推荐配置 | 预期体验 |

|---|---|---|

| 个人开发 | Qwen2.5-7B + 8GB内存 | 流畅 |

| 企业敏感项目 | 完全离线 + 审计日志 | 安全 |

| 低配Mac | Llama3.2-3B + 4GB内存 | 可用 |

| 高配Mac | Qwen2.5-14B + 16GB内存 | 优秀 |

最后的话:

在AI时代,隐私不是奢侈品,而是基本权利。

OpenClaw本地部署方案,让Mac开发者在享受AI效率红利的同时,不必以隐私为代价。

这,才是技术应有的样子。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献77条内容

已为社区贡献77条内容

所有评论(0)